כמעט חצי מתעבורת האינטרנט היום מגיעה מבוטים. רובם עסוקים ב-חילוץ קישור, נתונים וכתובות URL בקנה מידה ענק. אם את/ה עדיין עושה את זה ידנית — בוא/י נגיד את האמת: את/ה פשוט נשאר/ת מאחור.

בדקתי 12 כלים של מחלץ קישורים — מתוספי Chrome מבוססי AI ועד ספריות Python — כדי להבין מי באמת מספק כשצריך לגרד אלפי כתובות במהירות.

הנה מה שגיליתי.

למה מחלצי קישורים חשובים

בואו נדבר תכל’ס: הרשת מפוצצת מידע, ועסקים מתחרים על היכולת להפוך את הבלגן הזה לתובנות שאפשר לעבוד איתן. ו- הפכו לכלי מאסט עבור צוותים שרוצים:

- לייצר לידים: צוותי מכירות יכולים לשלוף תוך דקות קישורים לפרופילי חברות ממדריכים או מ-LinkedIn, ואז להזין את ה-URLs לכלים שמחלצים פרטי קשר. בלי אינסוף קליקים.

- לאגד תוכן ולחזק SEO: אנשי שיווק יכולים לאסוף את כל כתובות המאמרים מבלוג, לעקוב אחרי קישורים נכנסים של מתחרים, או לעשות ביקורת מבנה אתר ולאתר קישורים שבורים.

- לעקוב אחרי מתחרים ולבצע מחקר שוק: צוותי תפעול יכולים לאסוף אוטומטית קישורים למוצרים חדשים, דפי תמחור או הודעות לעיתונות — ולהישאר בעניינים בלי להתאמץ.

- לאוטומט תהליכים ולחסוך זמן: מחלצי קישורים מודרניים יודעים לעבוד עם כמויות גדולות של URLs, לסרוק תתי-עמודים, ולייצא נתונים בפורמטים מסודרים (CSV, Excel, Google Sheets, Notion — מה שתרצו). כלומר: נגמרו מרתוני העתק-הדבק וניקוי קבצי טקסט מבולגנים.

כשמבינים ש-, ברור שעבודה ידנית היא לא אופציה. מחלץ הקישורים הנכון הוא כמו עוזר-על שלא מתעייף, לא מפספס קישור, ולא מבקש הפסקת קפה.

איך בחרנו את מחלצי הקישורים הטובים ביותר

עם כל כך הרבה כלים בשוק, לבחור מחלץ קישורים מרגיש לפעמים כמו ספיד-דייטינג בכנס טכנולוגי — כולם נשבעים שהם “האחד”, אבל רק מעטים באמת עומדים בזה. ככה צמצמתי את הרשימה ל-12 המובילים:

- קלות שימוש: האם גם מי שלא כותב קוד יכול להסתדר בלי דוקטורט ב-regex? פתרונות No-code ו-Low-code קיבלו נקודות בונוס.

- חילוץ בכמות גדולה וריבוי שכבות: האם הכלי מסוגל לטפל במאות URLs בבת אחת? האם הוא יודע לסרוק תתי-עמודים ולעקוב אחרי קישורים אוטומטית?

- ייצוא ואינטגרציות: האם אפשר לייצא ל-CSV, Excel, Google Sheets, Notion, Airtable או דרך API? ככל שפחות עבודה ידנית — יותר טוב.

- קהל יעד וגמישות: האם הכלי מיועד למשתמשים עסקיים, אנליסטים או מפתחים? יש כלים שמתאימים לכולם, ויש כאלה שממוקדים בנישה.

- יכולות מתקדמות: זיהוי מבוסס AI, תזמון, סקייל בענן, ניקוי נתונים ותבניות לאתרים נפוצים.

- מחיר ויכולת גדילה: שכבות חינמיות, תשלום לפי שימוש או Enterprise? בדקתי מה באמת מקבלים ביחס למחיר.

כללתי כאן הכול — מתוספי דפדפן ועד פלטפורמות ארגוניות — כך שבין אם את/ה יזם/ת סולו או צוות דאטה של Fortune 500, תמצא/י משהו שיושב בול.

Thunderbit: מחלץ הקישורים החכם ביותר למשתמשים עסקיים

נתחיל מהטופ. הוא ההמלצה הראשונה שלי לחילוץ קישורים — ולא רק כי עזרתי לבנות אותו. Thunderbit הוא שנבנה עבור משתמשים עסקיים שרוצים תוצאות — ומהר.

מה הופך את Thunderbit לבולט? זה מרגיש כמו מתמחה AI שבאמת קולט עניין. אפשר פשוט לכתוב בשפה טבעית מה רוצים (“תאסוף את כל קישורי המוצרים והמחירים מהעמוד הזה”), וה-AI של Thunderbit מבין את ההמשך. בלי להתעסק עם selectors ובלי לכתוב סקריפטים.

וזה לא נגמר שם:

- תמיכה ב-URLs בכמות גדולה: מדביקים URL אחד או רשימה של מאות — Thunderbit מטפל בכולם בפעולה אחת.

- ניווט לתת-עמודים: צריך לחלץ קישורים מעמוד רשימה ואז להיכנס לכל עמוד פרטים כדי לאסוף עוד URLs? הלוגיקה הרב-שכבתית של Thunderbit עושה את זה.

- ייצוא מובנה: אחרי חילוץ הקישורים אפשר לשנות שמות שדות, לסווג אותם, ולייצא ישירות ל-Google Sheets, Notion, Airtable, Excel או CSV. בלי כאבי ראש של עיבוד אחרי.

Thunderbit נמצא בשימוש של יותר מ-30,000 משתמשים ברחבי העולם — מצוותי מכירות ועד סוכני נדל"ן וחנויות איקומרס קטנות. וכן, יש גם (חילוץ עד 6 עמודים, או 10 עם בוסט ניסיון), כך שאפשר לנסות בלי סיכון.

הפיצ'רים שמייחדים את Thunderbit

בואו נצלול למה שבאמת עושה את ההבדל:

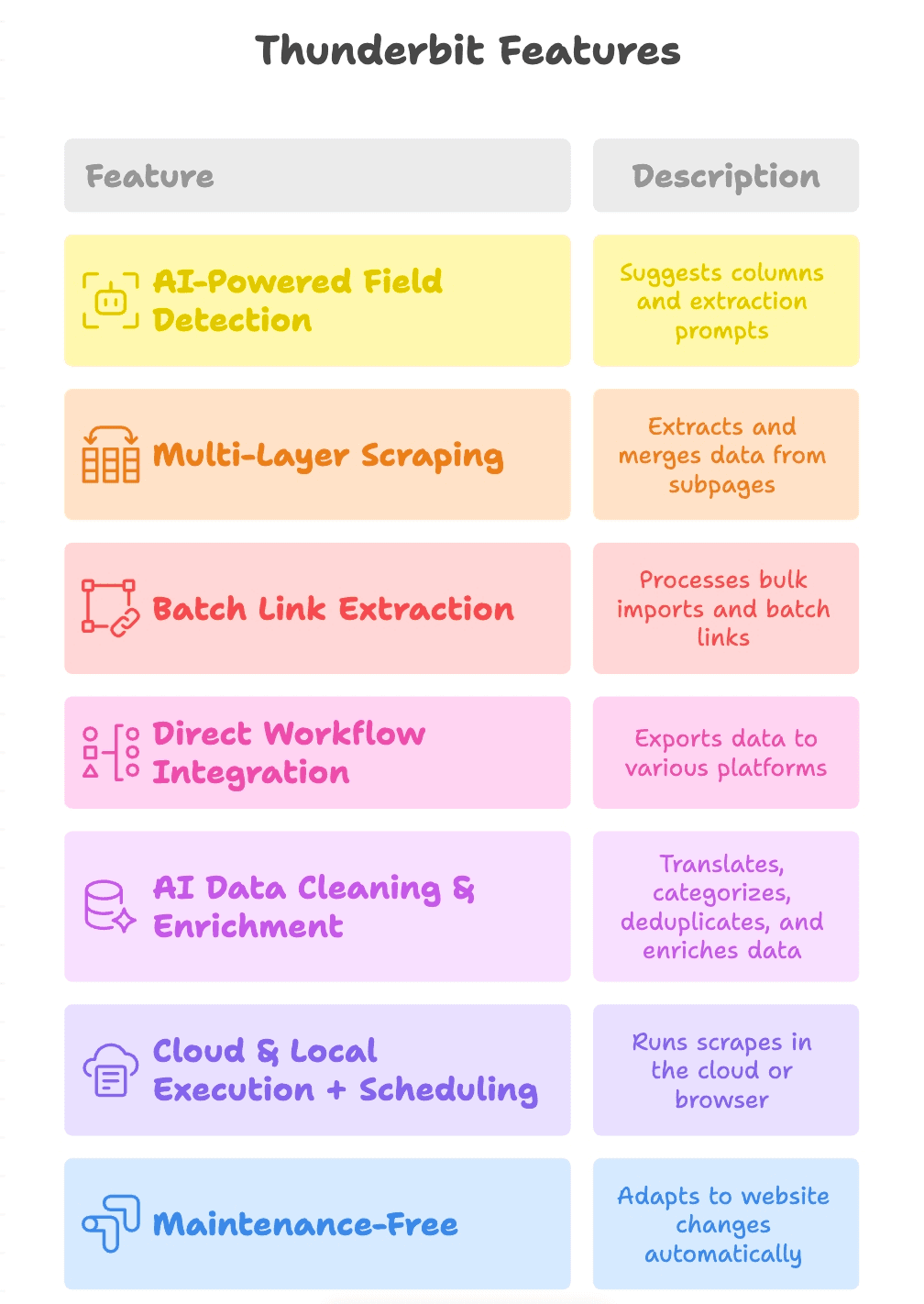

- זיהוי שדות מבוסס AI: לוחצים על “AI Suggest Fields”, ו-Thunderbit קורא את העמוד, מציע עמודות (כמו “קישור מוצר”, “כתובת PDF”, “אימייל ליצירת קשר”), ואפילו יוצר פרומפטים לחילוץ לכל שדה.

- חילוץ רב-שכבתי: Thunderbit יכול לעקוב אחרי קישורים מהעמוד הראשי לתת-עמודים (כמו עמודי מוצר או הורדות PDF), לחלץ עוד קישורים, ולאחד הכול לטבלה אחת.

- חילוץ קישורים באצווה: בין אם מדובר בעמוד אחד או באלף — Thunderbit יודע לעבד יבוא בכמות גדולה וחילוץ באצווה בקלות.

- אינטגרציה ישירה לתהליכי עבודה: מייצאים ל-Google Sheets, Notion, Airtable או מורידים כ-CSV/Excel. הנתונים מגיעים בדיוק למקום שבו הצוות צריך אותם.

- ניקוי והעשרת נתונים עם AI: Thunderbit יכול לתרגם, לסווג, להסיר כפילויות ואפילו להעשיר נתונים תוך כדי חילוץ — כך שהתוצאה מוכנה לשימוש ולא רק “דאמפ” גולמי.

- הרצה בענן או מקומית + תזמון: מריצים חילוץ בענן למהירות, או בדפדפן לאתרים שדורשים התחברות. אפשר גם לתזמן משימות חוזרות כדי לשמור על נתונים עדכניים.

- ללא תחזוקה: ה-AI של Thunderbit מסתגל לשינויים באתר, כך שמבזבזים פחות זמן על תיקון סקרייפרים שנשברו ויותר זמן על תוצאות.

Octoparse: מחלץ קישורים No-Code לכולם

הוא קלאסיקה בעולם ה-No-code. זו אפליקציית דסקטופ (Windows/Mac) עם ממשק ויזואלי של point-and-click. טוענים דף, לוחצים על הקישורים שרוצים, ו-Octoparse משלים את השאר.

- מעולה למתחילים: בלי קוד. לוחצים, מחלצים, וממשיכים.

- תומך בעימוד ותוכן דינמי: Octoparse יודע ללחוץ על “Next”, לגלול ואפילו להתחבר לאתרים.

- חילוץ בענן ותזמון: בתוכניות בתשלום אפשר להריץ משימות בענן ולתזמן ריצות חוזרות.

- אפשרויות ייצוא: הורדה כ-CSV, Excel, JSON או דחיפה למסדי נתונים.

התוכנית החינמית נדיבה למשימות קטנות (עד 10 משימות ו-50,000 שורות בחודש), אבל משתמשים כבדים יצטרכו תוכנית בתשלום (מתחיל סביב $75 לחודש).

Apify: מחלץ URL גמיש לתהליכים מותאמים

הוא כמו אולר שוויצרי לסקרייפינג. יש לו מרקטפלייס של “actors” מוכנים (כלי חילוץ), וגם אפשרות לכתוב סקריפטים משלכם ב-JavaScript או Python.

- מוכן מראש וגם ניתן להתאמה: משתמשים ב-actors קהילתיים למשימות נפוצות, או בונים משלכם לתהליך מותאם.

- חילוץ בכמות גדולה ותזמון: תור URLs, הרצה במקביל, ותזמון חילוצים חוזרים.

- API-First: ייצוא ל-JSON, CSV, Excel או Google Sheets, וחיבור לצינור הנתונים שלכם.

- תשלום לפי שימוש: קרדיטים חינמיים בכל חודש, ואז חיוב לפי צריכה.

Apify מתאים במיוחד לצוותים חצי-טכניים ולמפתחים שרוצים גמישות וסקייל.

Bright Data URL Scraper: חילוץ קישורים ברמת Enterprise

מיועד לארגונים שצריכים חילוץ בהיקפים גדולים. ה-Data Collector שלהם כולל URL Scraper מוכן לעבודות בנפח גבוה.

- מתמודד עם סקייל עצום: חילוץ אלפי או מיליוני עמודים, עם תשתית פרוקסים חזקה כדי להימנע מחסימות.

- תבניות מוכנות: סקרייפרים מוכנים לאיקומרס, סושיאל, נדל"ן ועוד.

- יכולות ארגוניות: כלי תאימות, תמיכה מקצועית ואנטי-בלוקינג מתקדם.

- מחיר: מתחיל סביב $350 ל-100,000 טעינות עמוד — מכוון בבירור לעסקים גדולים.

לסטארטאפ זה עשוי להיות מוגזם. אבל לחילוץ קריטי ובנפחים גבוהים, Bright Data הוא כוח רציני.

WebHarvy: מחלץ קישורים ויזואלי בפשטות של קליק

הוא כלי דסקטופ (Windows) שמאפשר לחלץ קישורים פשוט על ידי לחיצה עליהם בדפדפן המובנה.

- פשוט במיוחד: לוחצים על קישור, ו-WebHarvy מסמן את כל האלמנטים הדומים לחילוץ.

- תמיכה ב-Regular Expressions: תבניות מובנות למשימות נפוצות, בלי צורך בקוד.

- ייצוא ל-Excel, CSV, JSON, XML, SQL: מצוין למשתמשים עסקיים שרוצים פורמטים מוכרים.

- רישיון חד-פעמי: משלמים פעם אחת ומשתמשים לתמיד.

מתאים לעסקים קטנים, חוקרים, או לכל מי שרוצה דרך מהירה וללא התעסקות לקבל קישורים בלי קוד.

Web Scraper (תוסף Chrome): חילוץ קישורים מהיר בתוך הדפדפן

הוא כלי חינמי וקוד פתוח שהופך את הדפדפן שלכם לסקרייפר.

- הגדרת Sitemaps: מגדירים איך לנווט ומה לחלץ.

- תומך בעימוד ובסריקה רב-שכבתית: סריקת קטגוריות, תתי-קטגוריות ועמודי פרטים.

- ייצוא ל-CSV/XLSX: הורדת הנתונים ישירות מהדפדפן.

- תבניות קהילתיות: הרבה sitemaps משותפים לאתרים פופולריים.

מעולה למשימות חד-פעמיות מהירות או לסטודנטים וצוותים קטנים עם תקציב מוגבל.

ScraperAPI: מחלץ קישורים סקיילבילי למפתחים

מיועד למפתחים שרוצים להביא דפי אינטרנט בהיקף גדול בלי להתעסק עם פרוקסים, חסימות או CAPTCHAs.

- מונע API: שולחים URL ומקבלים HTML או נתונים שחולצו.

- התמודדות עם סקייל ואנטי-בוט: רוטציית פרוקסים, רינדור JS ופתרון CAPTCHA מובנים.

- משתלב בקוד שלכם: עובד עם Python, Node.js או כל שפה.

- מחיר: שכבה חינמית (~1000 קריאות API), ואז תשלום לפי בקשה.

מצוין לקרולרים מותאמים או כשצריך אמינות ומהירות בקנה מידה גדול.

ParseHub: מחלץ קישורים ויזואלי עם בחירה מתקדמת

הוא כלי דסקטופ (Windows, Mac, Linux) שמאפשר לבנות פרויקטי חילוץ בצורה ויזואלית.

- בחירה וניווט מתקדמים: קליקים, לולאות וחילוץ מותנה — גם מאלמנטים דינמיים או מוסתרים.

- תומך בעמודים מקוננים: סריקת קטגוריות, אחר כך עמודי פרטים, ואז חילוץ קישורים נוספים.

- ייצוא ל-CSV, Excel, JSON: ריצות בענן וגישה ל-API בתוכניות בתשלום.

- תוכנית חינמית: 5 פרויקטים, עד 200 עמודים לריצה.

ParseHub אהוב על אנשי שיווק וחוקרים שרוצים כוח בלי קוד.

Scrapy: מחלץ קישורים ב-Python למפתחים

הוא הסטנדרט הזהב למפתחי Python שרוצים שליטה מלאה.

- Code-First: בונים spiders מותאמים לסריקה וחילוץ קישורים בכל סקייל.

- תומך בסריקה מבוזרת: יעיל, אסינכרוני וניתן להתאמה גבוהה.

- ייצוא ל-CSV, JSON, XML או מסד נתונים: אתם שולטים בפלט.

- קוד פתוח וחינמי: אבל צריך לנהל את הסביבה בעצמכם.

אם אתם מרגישים בנוח עם Python, Scrapy הוא מהחזקים שיש.

Diffbot: מחלץ קישורים מבוסס AI לנתונים מובנים

הוא “המוח” של סקרייפינג מבוסס AI. הוא מנתח עמודים ומחזיר נתונים מובנים — כולל קישורים — בלי הגדרה ידנית.

- זיהוי תוכן אוטומטי: מזינים URL ומקבלים נתונים מובנים (מאמרים, מוצרים, קישורים ועוד).

- Crawlbot ו-Knowledge Graph: סריקת אתרים שלמים או שאילתות על אינדקס ענק של הרשת.

- מונע API: אינטגרציה עם כלי BI או צינור הנתונים שלכם.

- תמחור ארגוני: מתחיל סביב $299 לחודש — אבל מקבלים איכות בהתאם.

מתאים במיוחד לארגונים שרוצים נתונים נקיים ומובנים בלי לנהל סקרייפרים.

Cheerio: מחלץ קישורים קליל ל-Node.js

הוא מפרסר HTML מהיר בסגנון jQuery עבור Node.js.

- מהיר מאוד: מפרסר HTML במילישניות.

- תחביר מוכר: אם אתם מכירים jQuery — אתם מכירים Cheerio.

- מעולה לעמודים סטטיים: לא מרנדר JS, אבל מצוין לתוכן שמוגש מהשרת.

- קוד פתוח וחינמי: משלבים עם axios או fetch לבקשות.

אידיאלי למפתחים שבונים סקריפטים מותאמים ורוצים מהירות ופשטות.

Puppeteer: אוטומציית דפדפן לחילוץ קישורים מתקדם

היא ספריית Node.js לשליטה ב-Chrome במצב headless.

- אוטומציה מלאה של דפדפן: טעינת עמודים, קליקים, גלילה ואינטראקציה כמו משתמש אמיתי.

- תומך בתוכן דינמי והתחברויות: מושלם לאתרים כבדי JavaScript או תהליכים מורכבים.

- שליטה מדויקת: המתנה לאלמנטים, צילום מסך, יירוט בקשות רשת.

- קוד פתוח וחינמי: אבל כבד יותר במשאבים ואיטי יותר מכלים קלילים.

השתמשו ב-Puppeteer כשצריך לחלץ קישורים מאתרים שלא מסתדרים עם מחלץ קישורים (scraper) בסיסיים.

השוואה מהירה: איזה מחלץ קישורים מתאים לכם?

הנה השוואה קצרה בין כל 12 הכלים:

| כלי | הכי מתאים ל | תמיכה בכמות גדולה ותתי-עמודים | אפשרויות ייצוא נתונים | תמחור |

|---|---|---|---|---|

| Thunderbit | משתמשים עסקיים, ללא קוד | כן (AI, רב-שכבתי) | Excel, CSV, Sheets, Notion, Airtable | ניסיון חינמי, החל מכ~$9 לחודש |

| Octoparse | משתמשי No-code, אנליסטים | כן | CSV, Excel, JSON, אחסון ענן | שכבה חינמית, ~ $75 לחודש |

| Apify | צוותים חצי-טכניים, מפתחים | כן | CSV, JSON, Sheets דרך API | קרדיטים חינמיים, לפי שימוש |

| Bright Data | Enterprise | כן (נפח גבוה) | CSV, JSON, NDJSON דרך API | ~ $350 / 100k עמודים |

| WebHarvy | משתמשים ללא קוד, דסקטופ | כן | Excel, CSV, JSON, XML, SQL | רישיון בתשלום |

| Web Scraper Extension | כולם, מהיר/חינמי | כן | CSV, XLSX | חינמי, קוד פתוח |

| ScraperAPI | מפתחים, משתמשי API | כן | JSON (HTML דרך API) | חינם 1k בקשות, שכבות בתשלום |

| ParseHub | משתמשים ללא קוד, מתקדמים | כן | CSV, Excel, JSON, API | חינם 5 פרויקטים, בתשלום |

| Scrapy | מפתחים, Python | כן | CSV, JSON, XML, DB | חינמי, קוד פתוח |

| Diffbot | Enterprise, AI | כן (סריקה עם AI) | JSON (נתונים מובנים דרך API) | ~ $299 לחודש+ |

| Cheerio | מפתחים, Node.js | כן (קוד מותאם) | מותאם (JSON וכו') | חינמי, קוד פתוח |

| Puppeteer | מפתחים, אתרים מורכבים | כן (אוטומציה מלאה) | מותאם (פלט לפי סקריפט) | חינמי, קוד פתוח |

איך לבחור את מחלץ הקישורים הנכון לעסק שלכם

אז איך בוחרים? הנה דף העזר שלי:

- בלי יכולות קוד? התחילו עם Thunderbit, Octoparse, ParseHub, WebHarvy או תוסף Web Scraper.

- צריכים תהליכים מותאמים? Apify, ScraperAPI או Cheerio מצוינים למפתחים.

- סקייל ארגוני? Bright Data או Diffbot נבנו בדיוק לזה.

- מפתחי Python או Node.js? Scrapy (Python) או Cheerio/Puppeteer (Node.js) נותנים שליטה מלאה.

- רוצים ייצוא ישיר ל-Sheets/Notion? Thunderbit הוא הבחירה הכי טובה.

התאימו את הכלי לרמת הנוחות הטכנית שלכם, לנפח הנתונים ולצרכי האינטגרציה. לרוב הכלים יש ניסיון חינמי — אל תפחדו להתנסות.

הערך הייחודי של Thunderbit לחילוץ קישורים ב-2026

נחזור למה שבאמת עושה את Thunderbit שונה:

- פשטות מבוססת AI: מתארים מה רוצים בשפה טבעית — וה-AI של Thunderbit עושה את השאר.

- חילוץ רב-שכבתי: חילוץ קישורים מעמודים ראשיים, מעבר לתת-עמודים ואיסוף URLs נוספים — בתהליך אחד.

- יבוא בכמות גדולה ועיבוד באצווה: מדביקים מאות URLs, מחלצים קישורים בכמות גדולה, ומייצאים נתונים מובנים מיד.

- אינטגרציה לתהליכי עבודה: ייצוא ישיר ל-Google Sheets, Notion, Airtable או הורדה כ-CSV/Excel.

- אפס תחזוקה: ה-AI של Thunderbit מסתגל לשינויים באתר, כך שלא מתקנים כל הזמן מחלץ קישורים (scraper) שנשברו.

Thunderbit סוגר את הפער בין “רק לגרד נתונים” לבין “לקבל נתונים שבאמת אפשר לעבוד איתם”. זה הכלי שהייתי רוצה שיהיה לי לפני שנים, כששקעתי במשימות נתונים ידניות.

סיכום: לחלץ קישורים חכם יותר ולשדרג את זרימת העבודה

נתוני רשת הם הדלק לצמיחה עסקית — ומחלץ הקישורים הנכון הוא המנוע. בין אם אתם בונים רשימות לידים, עוקבים אחרי מתחרים או מאוטומטים מחקר, יש כאן כלי שמתאים לצרכים ולרמת הידע שלכם.

אם אתם רוצים לראות איך נראה חילוץ קישור מודרני, . כנראה תופתעו כמה אפשר להספיק בכמה קליקים. ואם Thunderbit לא יושב בול — נסו עוד כמה כלים מהרשימה. מעולם לא היה זמן טוב יותר לאוטומציה של הדברים המשעממים ולהתמקד במה שבאמת חשוב.

חילוץ מוצלח — ושיהיו לכם תמיד קישורים נקיים, מובנים ומוכנים לפעולה. אם תרצו להעמיק בעולם ה-web scraping, קפצו ל- לעוד מדריכים וטיפים.

שאלות נפוצות

1. למה מחלצי קישורים הם כלי חיוני?

כשכמעט מחצית מתעבורת האינטרנט מגיעה מבוטים ועסקים שואבים נתונים באגרסיביות, מחלצי קישורים הם הדרך להפוך את כאוס הרשת לתובנות שאפשר לפעול לפיהן. הם מאפשרים אוטומציה של יצירת לידים, איגום תוכן, בדיקות SEO ומעקב מתחרים — וחוסכים המון זמן ומאמץ.

2. מה מייחד את Thunderbit לעומת מחלצי קישורים אחרים?

Thunderbit משתמש ב-AI כדי להפוך את החילוץ לפשוט: מתארים את המטרה בשפה טבעית והוא מטפל בשאר. הוא תומך בהזנת URLs בכמות גדולה, חילוץ רב-שכבתי, זיהוי שדות חכם וייצוא חלק ל-Google Sheets ול-Notion. אידיאלי למשתמשים עסקיים ולמי שלא כותב קוד ורוצה תוצאות חזקות בלי כאב ראש טכני.

3. האם יש כלים שמתאימים למפתחים ולתהליכים מותאמים?

כן. כלים כמו Apify, ScraperAPI, Cheerio, Puppeteer ו-Scrapy מיועדים למפתחים. הם מציעים סקריפטים, אינטגרציה דרך API וגמישות לטיפול במשימות מורכבות, עבודות בקנה מידה גדול ואוטומציה מתקדמת.

4. אילו כלים הכי מתאימים למי שאין לו ניסיון בקוד?

Thunderbit, Octoparse, ParseHub, WebHarvy ותוסף Web Scraper ל-Chrome הם בחירות מצוינות למשתמשים לא טכניים. הם מציעים ממשקים ויזואליים, תבניות מוכנות ופיצ'רים מבוססי AI שמנגישים חילוץ קישורים לכולם.

5. איך לבחור את מחלץ הקישורים הנכון לצרכים שלי?

חשבו על רמת הידע הטכני שלכם, נפח הנתונים וצרכי הייצוא. מי שלא כותב קוד יעדיף Thunderbit או Octoparse, בעוד שמפתחים עשויים להעדיף Scrapy או Puppeteer. ארגונים גדולים יכולים לשקול Bright Data או Diffbot לפעילות רחבת היקף. תמיד כדאי להתחיל בניסיון חינמי כדי לראות מה הכי מתאים.