חיפוש ב-GitHub עבור "amazon scraper" מחזיר בערך . אם מצמצמים למאגרים שדחפו אליהם בעשרת החודשים האחרונים, נשארים בערך — בקושי 20%. השאר? מדריכים נטושים, עטיפות מיושנות וסקריפטים שהפסיקו לעבוד ברגע שאמזון הידקה את ההגנות שלה.

השקעתי לא מעט זמן בחפירה במאגרים של Amazon scraper, בקריאת בעיות ב-GitHub ובמעקב אחרי שרשורי קהילה ב-Reddit וב-Stack Overflow. התמונה ברורה: מישהו מוצא מאגר פופולרי, משקיע שעה בהגדרה שלו, מריץ אותו פעם אחת, ונתקל בקיר של CAPTCHA או בשגיאות 503. שכבת האנטי-בוט של אמזון ב-2026 כבר ממש לא דומה למה שהייתה אפילו לפני שנתיים — TLS fingerprinting, ניתוח התנהגותי ופריסה אגרסיבית של CAPTCHA הפכו את ספר המשחק הישן של "תסובבו User-Agent ותתפללו לטוב" לכמעט חסר תועלת. המדריך הזה מכסה את שיטות העבודה שבאמת חשובות אם רוצים לקבל נתוני Amazon אמינים ממאגר ב-GitHub, ומה לעשות כשסקרייפר נשבר (ולא אם).

מהו Amazon Scraper ב-GitHub, ולמה כל כך הרבה מהם נכשלים?

מאגר GitHub של Amazon scraper הוא בדרך כלל סקריפט בקוד פתוח — לרוב מבוסס Python, Node.js או Scrapy — שמחלץ נתונים מובנים מעמודי Amazon. יעדי הנתונים מוכרים: כותרת מוצר, מחיר, ASIN, דירוגים, מספר ביקורות, זמינות, מידע על מוכר, כרטיסי תוצאות חיפוש וטקסט של ביקורות.

הארכיטקטורה בדרך כלל פשוטה:

- לקוח HTTP או דפדפן headless מושך את העמוד.

- מפרש HTML או JSON מחלץ את השדות.

- הנתונים נשמרים ב-CSV, JSON או מסד נתונים.

מאגרים מתחלקים בדרך כלל לארבעה סוגים:

- ספריות Python קלות משקל (למשל, )

- Scrapy spiders (למשל, )

- ממַתּגי דפדפן כמו Selenium או Playwright

- פרויקטי עטיפת API שהם למעשה ממשק קדמי לשירות סקרייפינג מסחרי (למשל, )

דפוס הכשלים צפוי. רוב המאגרים נשברים משום ש:

- אמזון משנה את פריסת העמוד או את מקטעי ה-HTML

- אמזון מציגה 503 או CAPTCHA במקום תוכן אמיתי

- טביעת ה-TLS וה-HTTP של הסקרייפר כבר לא נראית כמו דפדפן

- חוסר התאמה בין locale, שפה או headers מעורר חשד

- התחזוקן ממשיך הלאה אחרי שפתר את המקרה הצר שלו

מספר כוכבים גבוה ו"כרגע שמיש" הם שני דברים שונים לגמרי. בבדיקה שערכתי לכתבה הזו, רק בערך שלושה מתוך שמונה מאגרים בולטים נראו פעילים בבירור ב-2026.

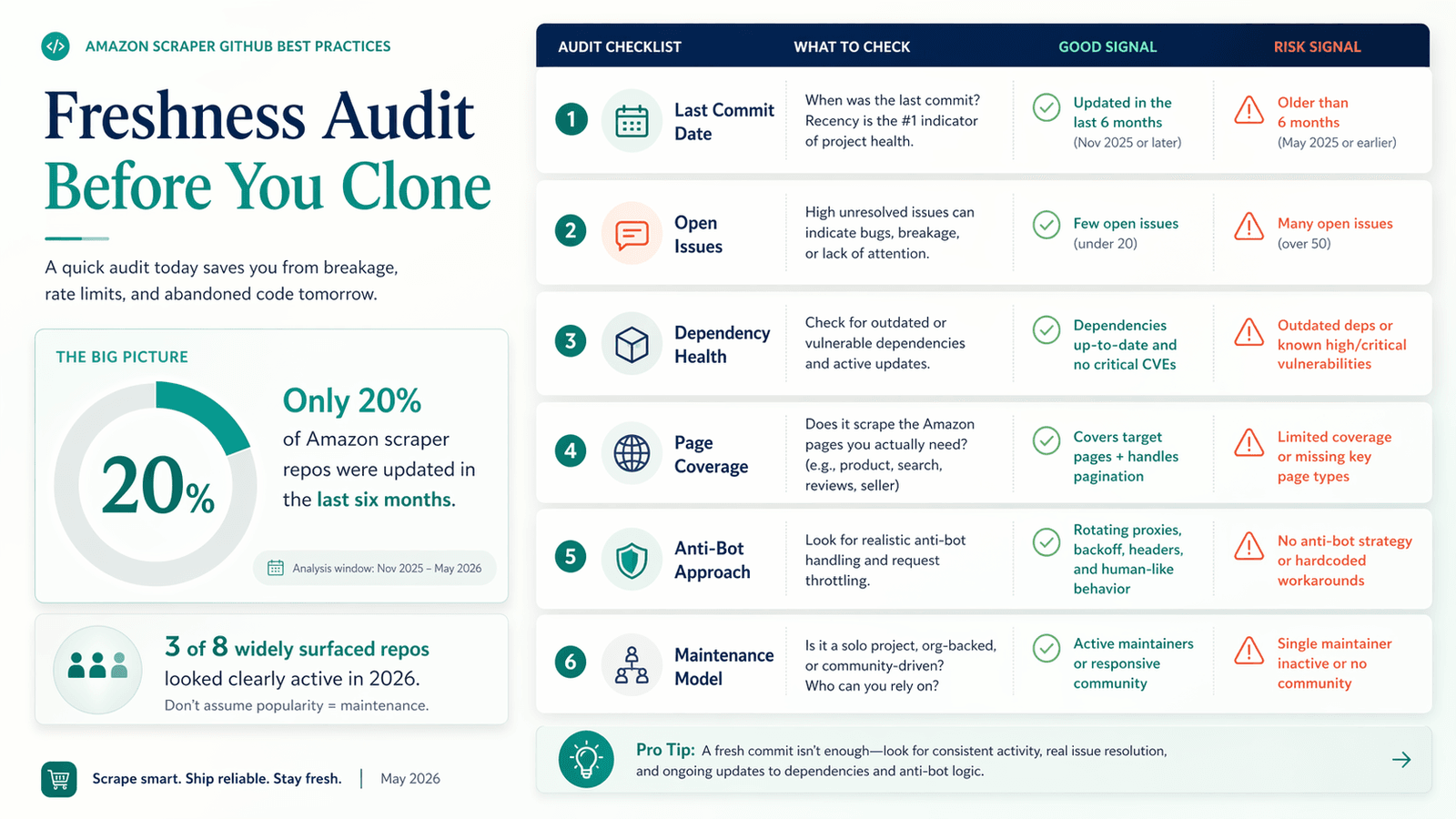

בצעו בדיקת רעננות ל-2026 לפני שאתם משכפלים כל מאגר Amazon Scraper מ-GitHub

השלב הזה חשוב יותר עבור Amazon מאשר עבור רוב היעדים האחרים. עמדת ההגנה של אמזון משתנה מהר יותר מאתר מסחר אלקטרוני טיפוסי, ולכן מאגר שעובד מצוין באתר תדמית יכול להפוך לחסר ערך על Amazon בתוך כמה שבועות. ובכל זאת, רוב הרשימות של "best amazon scraper github" ממליצות על מאגרים בלי לבדוק אם הם עדיין עובדים. משתמשים מבזבזים שעות על הגדרה של כלים שבורים.

איך לבדוק אם מאגר GitHub עדיין חי

לפני שאתם מריצים git clone על משהו, עברו על הבדיקות הבאות:

- תאריך הקומיט האחרון: כל דבר שבן יותר מ-6 חודשים הוא דגל אדום חזק עבור Amazon.

- בעיות פתוחות מול קצב תגובה: חפשו בלשונית Issues את המילים "captcha," "503," "blocked" ו-"not working." אם הדיווחים מצטברים בלי תגובות מהתחזוקן, עזבו.

- בריאות התלויות: פתחו את

requirements.txtאוpackage.json. ספריות מיושנות (למשלrequestsישן בלי טיפול מודרני ב-TLS) הן סימן אזהרה. - כיסוי סוגי העמודים של Amazon: האם המאגר מטפל בעמודי מוצר, בתוצאות חיפוש, וגם בביקורות? או רק באחד מהם?

- גישה לאנטי-בוט: כותרות קשיחות ללא תמיכה ב-proxy הן גישה של 2023 שלא תשרוד את 2026.

צ'קליסט רעננות ל-Amazon Scraper ב-GitHub

| איתות רעננות | מה לבדוק | דגל אדום 🚩 |

|---|---|---|

| תאריך הקומיט האחרון | פיד הקומיטים או תאריך הדחיפה למאגר | ישן מ-6 חודשים |

| בעיות פתוחות | לשונית Issues — לסנן לפי "captcha," "503," "blocked" | תקלות חוזרות בלי תגובות מהתחזוקן |

| בריאות התלויות | requirements.txt / package.json | ספריות מיושנות, בלי אסטרטגיית TLS מודרנית |

| כיסוי עמודי Amazon | README + דוגמאות קוד | מטפל רק בסוג עמוד אחד (למשל עמודי מוצר אבל לא חיפוש או ביקורות) |

| גישת אנטי-בוט | קוד המקור, הגדרות proxy | רק כותרות קשיחות ומחרוזות UA |

| מודל תחזוקה | האם זה באמת סקרייפר, מדריך, או עטיפת API מסחרית? | המאגר הוא בעצם רק ממשק קדמי לשירות בתשלום |

מה באמת מצאנו בבדיקה

בדקתי שמונה מאגרי Amazon scraper בולטים לפי הקריטריונים האלה. התוצאות מפוכחות:

| מאגר / כלי | כוכבים | אות לגבי קומיט אחרון | היקף | סטטוס 2026 | הערות |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2,872 | 2026-04-02 | עטיפת API מנוהלת לסקרייפר | חי, אבל לא DIY | עדכני, אבל זה למעשה ממשק קדמי לשירות מנוהל |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | API מנוהל לחיפוש, פרטים, ביקורות | חי, אבל לא DIY | כיסוי טוב, אבל זה מוצר API, לא סקרייפר גולמי |

| theonlyanil/amzpy | ~110 | 2026-02-26 | ספריית Python קלת משקל | חי | הסקרייפר הישיר והברור ביותר מ-GitHub, עם curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | ביקורות בלבד | צר אך שמיש | ישן וממוקד מאוד בביקורות |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | הקומיט האחרון ב-2023; המאגר נדחף ב-2024-08-20 | Scrapy spiders + proxy middleware | ברמת מדריך, מתיישן | טוב ללמידה, לא סטאק מוכן ל-2026 |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | CLI ב-Node לחיפוש, פרטים, ביקורות | סיכון גבוה | כיסוי רחב, אבל התחזוקה ישנה מדי |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | חיפוש ל-CSV | מת ל-2026 | פופולרי היסטורית, אבל בבירור מיושן |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | מדריך חיפוש/מוצר | מת ל-2026 | למעשה ארכיוני |

הבעיות הציבוריות מספרות את אותו סיפור. מכיל issue בשם "All requests receive captcha response." ל- יש "Doesn't seem to be working." ול- יש "Bypass Amazon protection." אלה לא מקרי קצה אזוטריים — אלה הדברים הראשונים שמשתמשים נתקלים בהם.

ספר המשחק נגד חסימות: איך להימנע מחסימה עם Amazon Scraper מ-GitHub

להיחסם הוא כאב הראש הגדול ביותר של כל מי שמשתמש בפרויקט amazon scraper github. עצות גנריות כמו "תשתמשו ב-proxies ותסובבו User-Agents" כבר לא מספיקות. סטאק האנטי-בוט של Amazon ל-2025–2026 כולל TLS fingerprinting, ניתוח התנהגותי ופריסה אגרסיבית של CAPTCHA. צריך גישה שכבתית.

התאמת TLS Fingerprint: למה requests רגיל יגרום לכם להיחסם

זו אחת הטכניקות הכי פחות מוערכות נגד חסימות. כך עובד TLS fingerprinting: כשהסקריפט שלכם פותח חיבור מאובטח ל-Amazon, השרת יכול להסיק הרבה על הלקוח לפי אופן ה"לחיצת יד" — חבילות ההצפנה שמוצעות, סדר ה-extension, הגדרות HTTP/2. דפדפנים משתמשים בהגדרות TLS ו-HTTP/2 יחסית קבועות, ואפשר לטבוע אותן באמצעות טכניקות כמו .

requests פשוט ו-httpx רגיל יכולים להעתיק headers, אבל הם לא מעתיקים התנהגות TLS ו-HTTP/2 כמו של Chrome. אמזון יודעת להבחין.

פותר זאת ישירות. הוא מספק התחזות לדפדפן — יעדים נתמכים כוללים chrome136, safari184 ו-firefox133 — כך שטביעת ה-TLS של לקוח ה-HTTP שלכם מתאימה לדפדפן אמיתי. התיעוד מזהיר במפורש לא ליצור מחרוזות JA3 אקראיות: טביעות דפדפן הן ברובן קבועות לכל גרסה, ושטויות אקראיות קלות יותר לזיהוי מטביעת דפדפן אמיתית שהועתקה.

הנתונים מהקהילה תואמים את זה. שרשור מאשר שהפרמטר impersonate שימושי כי הוא מסובב פרופילי דפדפן ושומר על התאמה בין הכותרות. שרשור מציין שאמזון חוסמת לקוחות לפי טביעת TLS "אחרי בערך חודש או חודשיים." ושרשור שואל במפורש האם אמזון מטביעה את python-requests (ספוילר: כן).

אם אתם עדיין משתמשים ב-requests רגיל כלקוח Amazon ראשי, עדכנו את ההנחה הזו לפני כל דבר אחר.

סיבוב פרוקסי נכון (לא רק "להשתמש בפרוקסי")

המטרה של proxies היא לא לסובב כמה שיותר. המטרה היא לגרום לסשנים להיראות אמינים.

Residential מול datacenter: פרוקסי datacenter זולים יותר אבל קלים יותר לזיהוי. פרוקסי residential עולים יותר, אבל הרבה יותר קשה לאמזון לסמן אותם. מתחיל ב-$4.00 לג'יגה-בייט בתשלום לפי שימוש, ויורד ל-$3.50 לג'יגה-בייט בתוכניות גדולות יותר. מתחיל ב-$6/GB. אמזון שייכת לקטגוריית "יעד מתוחכם" שבה פרוקסי residential שווים את הפרמיה.

סיבוב לפי בקשה מול לפי סשן: כאן רוב המדריכים טועים. סיבוב פרוקסי בכל בקשה תוך שמירה על קובצי Cookie ו-headers קבועים יכול להיראות פחות אנושי, לא יותר. התבנית הבטוחה:

- לשמור על מעבר חיפוש → מוצר → ביקורת באותו sticky session ככל האפשר

- להחליף סשנים כשמתחילים מסע חיפוש חדש, לא בכל בקשה

- לסובב בין סשנים, לא אקראית בתוך סשן גלישה אחד

אחד מ ציין שכתובות IP רגילות של ISP לא ביצעו כמעט כמו כתובות IP סלולריות באתרים פופולריים של מסחר אלקטרוני. דיווח על חסימה גם עם User-Agents מסתובבים ופרוקסי residential — תזכורת טובה לכך ש-proxies לבד אינם מספיקים.

קצב בקשות, backoff והגבלת קצב

דפי 503 של אמזון הם לא מזל רע אקראי. הם משוב.

פוסט על גריפת יותר מ-500 ASINים דיווח על 503 באותה נקודה בכל פעם, סביב ASIN 101, אפילו עם השהיות. התבנית ישנה, אבל הלקח עדכני: נפח גולמי מ-IP אחד או מטביעת דפדפן אחת בסופו של דבר מפעיל מנגנוני הגנה.

קצב עבודה מומלץ לסקרייפרים עצמיים מ-GitHub:

- השהיות אקראיות בין בקשות (לא מרווחים קבועים, כי אפשר לזהות אותם)

- 2 עד 5 שניות בין בקשות ציבוריות לעמודי מוצר עבור לקוחות HTTP פשוטים

- Exponential backoff אחרי 503 או CAPTCHA — נסיגה הדרגתית במקום ניסיון חוזר מיידי

- Concurrency נמוכה יותר ממה שנראה לכם שצריך

- לוגים fail-open במקום לולאות retry הדוקות

לרוב מאגרי amazon scraper github אין הגבלת קצב מובנית. תצטרכו להוסיף אותה בעצמכם.

תזמור Headers: הרבה יותר מ-User-Agent

אמזון בודקת את כל סט ה-headers, לא רק את User-Agent.

מערך כותרות ריאלי של דפדפן צריך לכלול:

User-AgentAcceptAccept-LanguageAccept-Encoding- רמזי

Sec-CH-*כשזה מתאים - התנהגות חיבור שמתאימה לפרופיל הדפדפן שנבחר

ה-headers צריכים להתאים ל-locale של המרקטפלייס. גילה שאותה הגדרת בוט זוהתה רק בחלק מהלוקאלים, כשמגיב אחר הצביע על headers הקשורים לאזור כמו Accept-Language.

הכלל: headers, פרופיל TLS/דפדפן והגאוגרפיה של ה-proxy לא צריכים לסתור זה את זה. אל תשלחו headers של Chrome עם UA של Firefox. אל תשתמשו ב-proxy אמריקאי עם Accept-Language: de-DE.

טיפול ב-CAPTCHA: מתי לפתור ומתי להתרחק

הגעה ל-CAPTCHA אומרת שאמזון כבר חשדנית. פתרון שלו לא מאפס את ציון האמון שלכם.

עבור אירועי CAPTCHA בודדים ובתדירות נמוכה:

- חבילת PyPI היא פותר CAPTCHA טקסטואלי של Amazon ב-Python טהור, אבל הגרסה האחרונה שלה היא ממאי 2023 — התייחסו אליה ככלי טקטי, לא כאסטרטגיה עמידה

- מציגה CAPTCHA של Amazon במחיר של $0.45 לכל 1,000 פתרונות

עבור לולאות CAPTCHA חוזרות:

- תפסיקו לפתור ותתחילו להתרחק

- CAPTCHA חוזר פירושו שהסשן שרוף — פתרון שלו לא בונה מחדש אמון בטביעת הדפדפן, בהיסטוריית הסשן או במוניטין ה-IP

- אם ה-CAPTCHA מצטברים לפי subnet של proxy, הבעיה היא בשכבת הרשת ולא במנתח

מתי באמת צריך דפדפן headless, ומתי זה מיותר

האינסטינקט השגוי הוא להריץ Playwright על הכול.

מקרי שימוש טובים לדפדפן:

- תוצאות חיפוש שתלויות ברינדור JavaScript או במצב תלוי-לוקאל

- תהליכי ביקורות שמפנים לדפי התחברות או sign-in

- תהליכי עבודה שבהם קובצי Cookie והקשר דפדפן חשובים יותר ממהירות גולמית

מקרי שימוש גרועים לדפדפן:

- עמודי מוצר ציבוריים רגילים

- חילוץ סטטי של פרטי מוצר כשלקוח HTTP שנראה כמו דפדפן מספיק

- שליפה המונית בקנה מידה גדול שבה יעילות חישובית חשובה

תתחילו מהלקוח הקל ביותר שעובד. על גריפה בקנה מידה תיאר את המסלול: להתחיל עם requests, אחר כך curl_cffi, ורק לעבור לדפדפן מלא כשהאפשרויות הקלות נכשלות. דפדפנים headless איטיים משמעותית ועתירי משאבים יותר מלקוחות HTTP עבור גריפת עמודי מוצר של Amazon.

מטריצת החלטה נגד חסימות לפרויקטי Amazon Scraper ב-GitHub

| תרחיש | גישה מומלצת | למה |

|---|---|---|

| עמודי מוצר ציבוריים (קנה מידה קטן) | curl_cffi + sticky residential session | הדרך הזולה ביותר שעדיין נראית כמו דפדפן |

| עמודי תוצאות חיפוש | קודם curl_cffi, ו-Playwright רק אם רינדור או state שוברים HTTP | חיפוש הוא יותר תלוי-מצב ותלוי-לוקאל |

| ביקורות (נדרשת התחברות) | מצב דפדפן עם קובצי Cookie/Session אמיתיים | התחברות וזרימות ביקורת דינמיות קשות יותר לחיקוי ב-HTTP גולמי |

| קנה מידה גדול (5k+ ליום) | API מנוהל, unlocker, או פלטפורמת no-code | קוד DIY מ-GitHub לבדו הופך לבעיה תשתיתית |

כשהפרויקט שלכם של Amazon Scraper מ-GitHub נשבר: צריך תוכנית גיבוי ללא קוד

כל מי שסופרייפר מנוסה מחזיק Plan B.

עדכוני אמזון בסופו של דבר ישברו כל מאגר GitHub, ובדיוק בזמן הכי גרוע. עבור צוותי ecommerce, סקרייפר שבור אומר פספוס שינויים במחיר, נתוני מתחרים מיושנים וחורים בדשבורדים.

הרבה אנשים שמחפשים "amazon scraper github" הם בעצם משתמשים עסקיים — אנשי תפעול ecommerce, משווקים, חוקרי FBA — שניסו פתרונות קוד כי לא מצאו אפשרויות טובות יותר. נתוני פורומים מראים תסכול אמיתי גם מ- הרשמי של אמזון: גישה מגבילה, נתונים מוגבלים, ו- שרבים מהמוכרים לא יכולים לעמוד בהן.

למה סקרייפרים של Amazon ב-GitHub דורשים תחזוקה מתמדת

הבדיקה לעיל מבהירה זאת:

- מאגרים מיושנים צוברים דיווחי שבירה בלי תיקונים

- מאגרים "עובדים" מדברים עכשיו בגלוי על אמצעי אנטי-בוט ב-README

- שרשורי קהילה מתמקדים יותר ויותר בטביעות TLS, לולאות CAPTCHA ואיכות proxy — לא ב-Selectors של CSS

עבור משתמשים עסקיים, נטל התחזוקה הזה הוא העלות הנסתרת האמיתית. המאגר חינמי. הזמן שלכם לניפוי תקלות ב-2 בלילה לא.

Thunderbit כחלופה מעשית ל-Amazon Scraper

מציע שמחלצת כותרת, מחיר, ASIN, דירוגים, מותג, זמינות, מקור משלוח ו-URL מקורי — בלי לכתוב קוד.

איך זה נראה בפועל:

- גריפה ב-2 קליקים מול הגדרה של סביבות Python, תלויות והגדרות proxy

- תבנית Amazon מיידית — בלי עומס AI, פשוט חילוץ בלחיצה אחת

- מצב browser scraping עבור עמודים שדורשים התחברות (כמו עמודי ביקורות שמאתגרים משתמשי GitHub scraper)

- גריפת ענן לעמודי מוצר ציבוריים במהירות (50 עמודים בכל פעם)

- ייצוא חינמי ל-Google Sheets, Airtable, Notion, Excel — לא רק CSV/JSON

- Scheduled scraper למעקב מחירים מתמשך

- AI שמתאים עצמו לשינויים בפריסה — בלי עומס תחזוקה עליכם

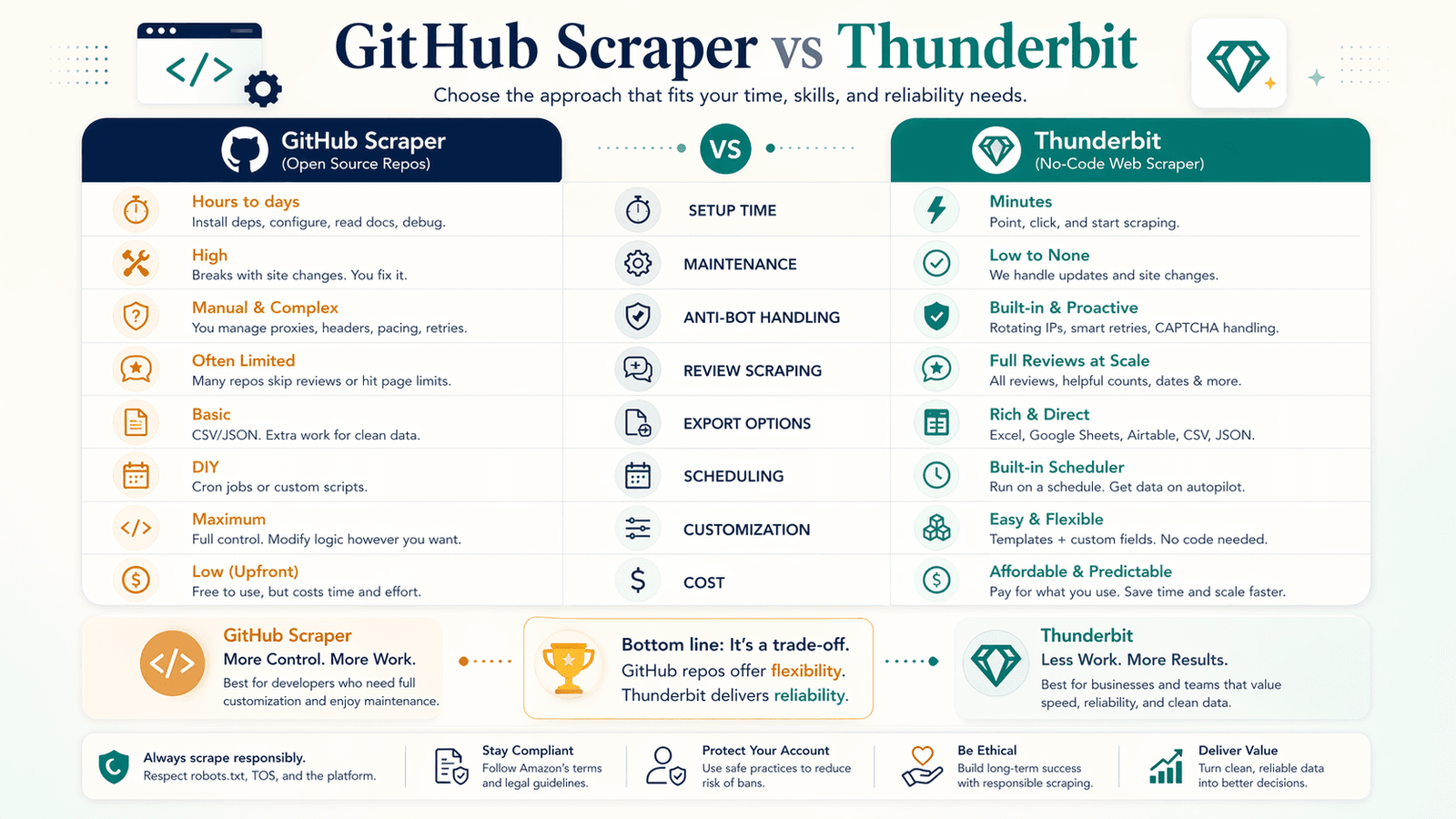

Amazon Scraper מ-GitHub מול Thunderbit: השוואה כנה

| גורם | סקרייפר מ-GitHub (למשל, AmzPy) | Thunderbit |

|---|---|---|

| זמן הגדרה | 15–60 דק' (Python, תלויות, proxies) | כ-2 דק' (התקנת תוסף Chrome) |

| תחזוקה | אתם מתקנים שבירות | ה-AI מתאים לשינויים בפריסה |

| טיפול באנטי-בוט | DIY (proxies, headers, TLS) | מובנה (מצבי ענן + דפדפן) |

| גריפת ביקורות (עם התחברות) | ניהול סשנים מורכב | מצב browser scraping |

| ייצוא נתונים | CSV/JSON בלבד | Sheets, Airtable, Notion, Excel, CSV, JSON |

| תזמון | DIY (cron, Airflow וכו') | Scheduled scraper מובנה |

| התאמה אישית | גבוהה יותר | נמוכה יותר |

| עלות | חינמי (בתוספת עלויות proxy) | יש שכבה חינמית; מבוסס קרדיטים |

הפשרה הכנה: מאגרי GitHub מציעים יותר התאמה אישית; Thunderbit מציע יותר אמינות. אם לצוות שלכם אכפת מ-up time יותר מאשר מגמישות, המסלול ללא קוד הוא בדרך כלל הבחירה הרציונלית יותר.

שיטות עבודה מומלצות לגריפת Amazon מתוזמנת וחוזרת

רוב פרויקטי amazon scraper github בנויים להרצה חד-פעמית, אבל מקרי שימוש עסקיים אמיתיים — ניטור מחירים, מעקב מלאי, ניתוח מתחרים — דורשים גריפות חוזרות. מאגרי GitHub כמעט אף פעם לא כוללים תזמון מובנה, ולכן המשתמשים צריכים לחבר יחד cron jobs, Airflow או תהליכי n8n.

תזמון עצמאי לסקרייפרי Amazon מ-GitHub

ההגדרה המינימלית להרצה מחזורית:

- Cron job על Linux או macOS להרצת הסקריפט לפי לוח זמנים

- לוגים append-only כדי שניתן יהיה לנפות תקלות בדיעבד

- Deduplication לפי ASIN + timestamp כדי שלא תשמרו נתונים כפולים

- התראות כשל (אפילו אימייל פשוט ביציאה לא-אפסית) כדי שתדעו כשהרצה נשברת ב-3 בלילה

לצוותים מורכבים יותר:

- n8n לאוטומציית workflows קלה (מוזכר לעיתים קרובות בשרשורי קהילה)

- Airflow לצינורות מתוזמנים כבדים יותר

- state שמגובה במסד נתונים אם צריך diffs והיסטוריה

שיטת העבודה המומלצת העיקרית היא לא המתזמן עצמו — אלא ניהול state. עקבו אחר הרצה מוצלחת אחרונה, סט ASIN אחרון, מחירים שהשתנו ו-URLs שנכשלו.

תזמון פשוט יותר עם Thunderbit

ה- של Thunderbit מאפשר לכם לתאר את המרווח בשפה פשוטה, להזין URLs וללחוץ "Schedule." ה-AI ממיר שפה טבעית ללוח זמנים של cron — בלי הגדרה טכנית. עבור צוותי ecommerce לא-הנדסיים שמנטרים מחירים או השקות מוצרים של מתחרים, זה מפחית באופן משמעותי את העומס התפעולי.

שיטות עבודה מומלצות לגריפות Amazon חוזרות

אלו חלות לא משנה באיזה כלי אתם משתמשים:

- Deduplicate לפי חלון ASIN + timestamp — אל תשמרו את אותו מוצר פעמיים בכל הרצה

- שמרו מחירים כמספרים, לא כמחרוזות גולמיות — חוסך ניקוי בהמשך

- הוסיפו timestamp של הגריפה לכל שורה — תצטרכו אותם לניתוח מגמות

- עקבו אחרי דלתות, לא רק אחרי המצב הנוכחי — "המחיר ירד ב-12% מאז השבוע שעבר" שימושי יותר מ-"המחיר הוא $24.99"

- התריעו על שינויים משמעותיים — ירידת מחיר של 15% אצל מתחרה שווה התראה; תנודה של 0.5% היא רעש

- חשבו על אחסון נתונים — קבצים שטוחים מספיקים להרצות קטנות; עבור 5k+ ASINים ביום, שקלו מסד נתונים או גיליון ענן

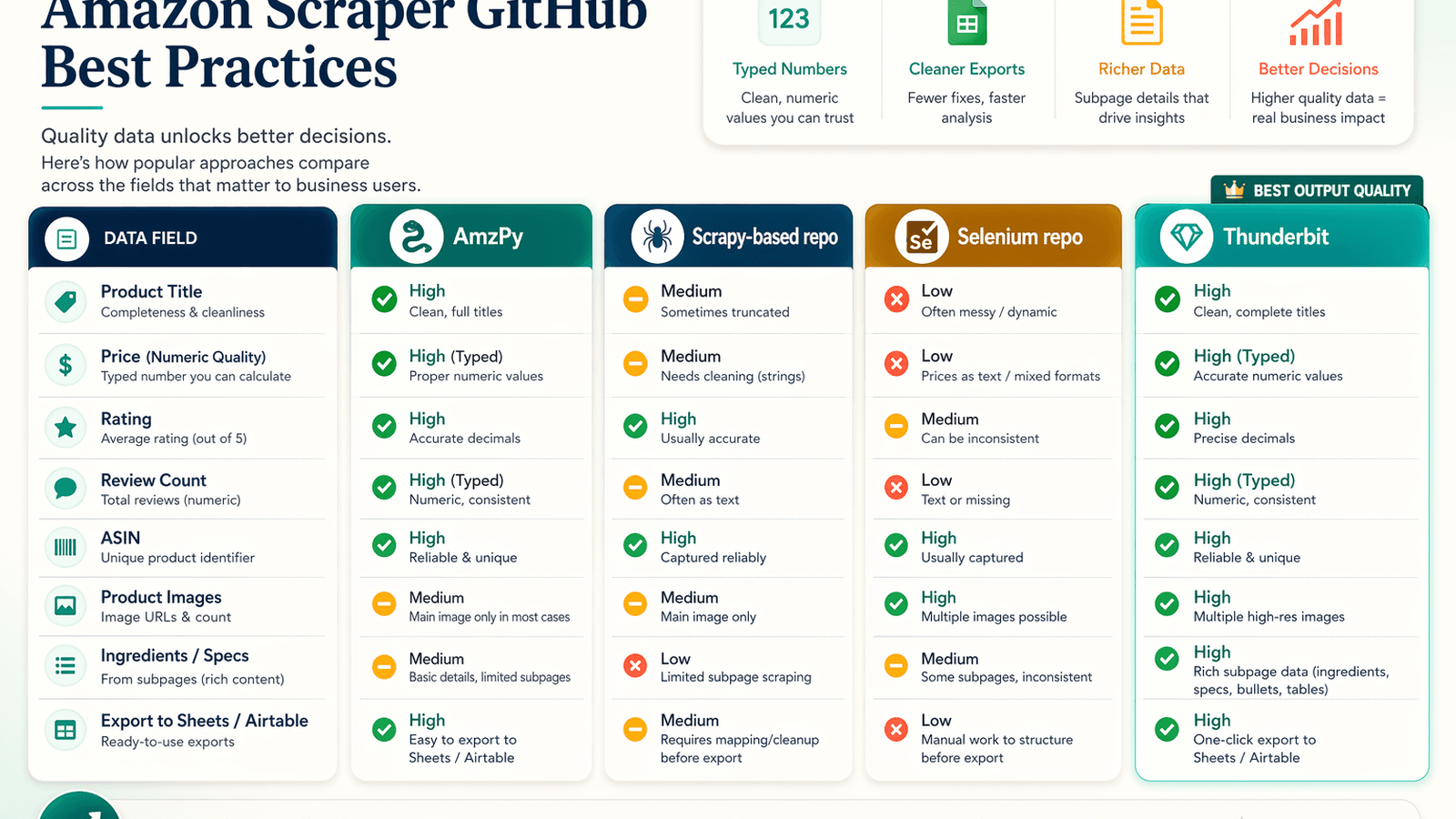

איכות פלט זו מול זו: מה כל גישת Amazon Scraper מ-GitHub באמת מחזירה

אף אחד לא משווה באמת את איכות הפלט בין מאגרי amazon scraper github. למשתמשים אכפת מאוד מאיכות הנתונים — "איזה כלי נותן את הנתונים הנקיים והשלמים ביותר" — אבל הם צריכים לשכפל ולבדוק כל מאגר בעצמם. הסעיף הזה ממלא את הפער.

מה מאגרי GitHub פופולריים באמת מחלצים, ומה הם מפספסים

בהתבסס על דוגמאות README, דוגמאות ציבוריות ופורמטי פלט מתועדים:

| גישה | מה היא מחלצת בבירור | פערים / פשרות נפוצים |

|---|---|---|

| amzpy | כותרת, מחיר, מטבע, URL של תמונה, דירוגים, ביקורות, וריאנטים, ASIN | ממוקד בעמוד מוצר; פחות עשיר בביקורות מלאות / מקטעי מפרט |

| tducret/amazon-scraper-python | CSV עם כותרת, דירוג, מספר ביקורות, URL מוצר, URL תמונה, ASIN | מיושן, ממוקד ברשימות, סיפור אנטי-בוט חלש |

| python-scrapy-playbook scraper | תוצאות חיפוש, עמודי מוצר, ביקורות, צינורות CSV/JSON | ברמת מדריך; נשען על proxy middleware חיצוני; סביר שיידרש ניקוי רב יותר |

| omkarcloud/amazon-scraper | חיפוש, קטגוריה, פרטים, ביקורות מובילות, הרבה תמונות/וידאו/מפרטים | לא סקרייפר גולמי — זה שירות API מנוהל |

| תבנית Amazon של Thunderbit | כותרת, מחיר, ASIN, מותג, דירוג, ביקורות, זמינות, מקור משלוח, העשרת תתי-עמודים | פחות שליטה ברמת הקוד לעומת סקריפטים מותאמים אישית |

טבלת השוואת איכות פלט

| שדה נתון | AmzPy | מאגר מבוסס Scrapy | מאגר Selenium | Thunderbit |

|---|---|---|---|---|

| כותרת מוצר | ✅ | ✅ | ✅ | ✅ |

| מחיר (מספרי) | ⚠️ מחרוזת | ✅ | ⚠️ מחרוזת | ✅ (סוג מספר) |

| דירוג | ✅ | ✅ | ✅ | ✅ |

| מספר ביקורות | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| תמונות מוצר | ❌ | ⚠️ תמונת ממוזערת בלבד | ✅ | ✅ (ברזולוציה מלאה, ניתן לייצוא) |

| רכיבים/מפרטים | ❌ | ❌ | ❌ | ✅ (באמצעות גריפת תת-עמודים + AI) |

| ייצוא ל-Sheets/Airtable | ❌ | ❌ | ❌ | ✅ חינם |

למה פורמט הנתונים חשוב למשתמשים עסקיים

נתונים מבולגנים יוצרים עבודה נסתרת. אפילו סקרייפר מוצלח יכול להיות כישלון תפעולי אם:

- מחירים הם מחרוזות עם סימני מטבע במקום מספרים נקיים

- ערכים חסרים אינם עקביים (מחרוזת ריקה מול null מול "N/A")

- תמונות הן רק תמונות ממוזערות ברזולוציה נמוכה

- צריך לעבד שדות ביקורת או מפרטים לפני ניתוח

עבור צוותי תפעול ecommerce, נתונים נקיים משפיעים ישירות על מהירות הניתוח וקבלת ההחלטות. ה-AI של Thunderbit מעצב את הנתונים לפי סוג — מספרים כמספרים, תאריכים כתאריכים, URLs כ-URLs — כך שהם מוכנים לשימוש מיידי. מאגרי GitHub שונים מאוד זה מזה בתחום הזה, וזמן הניקוי מצטבר מהר.

צ'קליסט מהיר: שיטות עבודה מומלצות ל-Amazon Scraper מ-GitHub

- בדקו תאריך קומיט אחרון לפני השכפול. כל דבר שבן יותר משישה חודשים הוא דגל אדום חזק עבור Amazon.

- חפשו Issues עבור "captcha," "503," "blocked" ו-"not working" לפני ההגדרה.

- העדיפו

curl_cffiאו לקוח HTTP אחר שמתחזה לדפדפן על פניrequestsרגיל. - שמרו על עקביות בין headers, פרופיל TLS, שפה וגאוגרפיית proxy — בלי סתירות.

- השתמשו ב-sticky sessions לזרימות גלישה; אל תסובבו כל בקשה בעיוורון.

- הוסיפו קצב אקראי ו-exponential backoff.

- התייחסו ל-CAPTCHA חוזר כסשן שרוף, לא כחידה לפיצוח בכוח.

- השתמשו בדפדפנים headless רק כשהלקוחות ה-HTTP לא מצליחים לשחזר את העמוד בצורה אמינה.

- שמרו checkpoints ו-state כדי שהרצות שנכשלו יוכלו להמשיך בבטחה.

- החזיקו תוכנית גיבוי — בין אם זה API מנוהל או כלי no-code כמו .

שיקולים משפטיים ואתיים לגריפת Amazon ב-2026

כמה דברים שכדאי לדעת, בקצרה.

העמדה של אמזון מגבילה והולכת ומחמירה. האותות החזקים ביותר:

- דפי העזרה של אמזון מחזירים כעת שאומר: "To discuss automated access to Amazon data please contact api-services-support@amazon.com."

- ה- של אמזון אוסר על מגוון רחב של נתיבים דינמיים, נתיבי ביקורות, פרופילים, רשימות משאלות ונתיבי הצעות.

- מתנגד במפורש לגישת סוכן סמויה או מוסווית, לעקיפת אמצעי אבטחה, ולהצגה שגויה של סוכן כ-Google Chrome. אמזון גם על המקרה.

- אמזון נגד סורקי OpenAI בסוף 2025.

הסיכון המעשי גבוה בבירור כשעוברים מעמודי מוצר ציבוריים לזרימות מאומתות, אוטומציה מוסווית או חילוץ מסחרי בנפח גבוה. זו לא ייעוץ משפטי — התייעצו עם הצוות המשפטי שלכם לגבי המקרה הספציפי שלכם.

מסקנות עיקריות: איך לקבל נתוני Amazon אמינים בלי להיחסם

לפי סדר חשיבות:

- בצעו audit לפני השכפול. הניחו שרוב תוצאות GitHub הן מיושנות, מדריכים או עטיפות ל-APIs מסחריים.

- שדרגו קודם את שכבת הרשת. TLS fingerprinting ועקביות של סשן חשובים יותר מ-HTML selectors.

- השתמשו ב-sticky residential sessions, לא בכאוס אקראי של proxies. סובבו בין סשנים, לא בתוכם.

- קצבו בקשות כמו משתמש, לא כמו stress test. השהיות אקראיות ו-exponential backoff הם לא משהו לוותר עליו.

- פתרו CAPTCHAs בודדים; פרשו מסשנים שמקבלים שוב ושוב אתגר. אל תנסו לפצח בכוח fingerprint שרוף.

- החזיקו fallback. אמזון תשנה משהו באמצע השבוע, וה-scraper שלכם מ-GitHub יישבר. כלי no-code מתוחזק כמו או API מנוהל יכולים להשאיר את צינור הנתונים שלכם חי בזמן שאתם מנפים תקלות.

- תעדפו איכות פלט. נתונים נקיים ומסודרים לפי טיפוס חוסכים יותר זמן בהמשך מאשר סקרייפר מהיר אבל מבולגן.

אם אתם רוצים אמינות על פני התאמה אישית, Thunderbit מספק חלופה מתוחזקת — בדקו את או צפו במדריכים ב-. מפתחים שרוצים שליטה מלאה בהחלט יכולים להשתמש במאגרים מ-GitHub — אבל רק עם שיטות האנטי-בוט והתחזוקה שמכוסות במדריך הזה.

שאלות נפוצות

האם מותר לגרוף נתוני מוצרים מ-Amazon עם סקרייפר מ-GitHub?

תנאי השימוש של אמזון מגבילים איסוף נתונים אוטומטי, ואמזון אכפה זאת באופן פעיל באמצעות מכתבי הפסקה-ושלילה ואמצעים טכניים נגדיים (במיוחד ב-2025–2026). גריפת נתוני מוצר ציבוריים נמצאת באזור אפור; גריפה מאחורי התחברות או הסוואת הבוט כדפדפן אמיתי כרוכות בסיכון גבוה יותר. זו לא ייעוץ משפטי — התייעצו עם הצוות המשפטי שלכם לגבי המקרה הספציפי שלכם.

באיזו תדירות סקרייפרי GitHub של Amazon נשברים?

לעיתים קרובות. אמזון משנה פריסות עמודים, מוסיפה שכבות אנטי-בוט חדשות ומפסיקה נקודות קצה באופן קבוע. בבדיקה לכתבה הזו, רק בערך 3 מתוך 8 מאגרים בולטים היו בבירור פונקציונליים ב-2026. אפילו מאגרים "עובדים" כוללים לעיתים קרובות issues פתוחים על CAPTCHA ושגיאות 503. צפו שתצטרכו לנפות תקלות או לעדכן את ההגדרה כל כמה שבועות עד חודשים.

מהו Amazon scraper הטוב ביותר ב-GitHub ב-2026?

אין מנצח יחיד — זה תלוי בשימוש ובנוחות הטכנית שלכם. עבור סקרייפר Python קל משקל וישיר, הוא אחת האפשרויות העדכניות יותר. עבור כיסוי רחב יותר באמצעות API מנוהל, עובד אבל הוא לא באמת DIY. הפעילו את צ'קליסט הרעננות מהמאמר הזה כדי להעריך כל מאגר בעצמכם לפני התחייבות.

האם Thunderbit יכול לגרוף Amazon בלי לכתוב קוד?

כן. של Thunderbit מחלצת כותרת מוצר, מחיר, ASIN, דירוגים, מותג, זמינות ועוד בלחיצה אחת. היא תומכת במצב browser scraping לעמודים שדורשים התחברות, בגריפת ענן לעמודים ציבוריים במהירות, בגריפה מתוזמנת למשימות חוזרות, ובייצוא חינם ל-Google Sheets, Airtable, Notion ו-Excel. אפשר להתחיל בהתקנת .

איך נמנעים מחסימת IP כשגורפים Amazon?

השתמשו בגישה שכבתית: (1) עברו מ-requests רגיל ללקוח שמתחזה ל-TLS כמו curl_cffi, (2) השתמשו בפרוקסי residential עם sticky sessions במקום סיבוב datacenter אקראי, (3) הוסיפו קצב אקראי ו-exponential backoff, (4) שמרו על כל סט ה-headers עקבי עם פרופיל הדפדפן וה-locale של המרקטפלייס, ו-(5) התייחסו ל-CAPTCHA חוזרים כסימן לפרוש מהסשן, לא כחידה לפתור בלי סוף. לפרטים נוספים, ראו את מטריצת ההחלטה נגד חסימות מוקדם יותר במאמר.