Minun piti seurata yli 200 uutislähdettä ja bongata niistä nousevat jutut. Käsin? Siitä olisi tullut ihan täysipäiväinen duuni. Perinteisellä skriperillä? Se posahti joka kerta, kun sivusto teki pienenkin faceliftin.

Sitten otin testiin tekoälypohjaiset artikkeliskreipperit. Yksi klikkaus, siisti data, eikä mitään CSS-selektoreiden säätöä. Ero oli oikeasti kuin yö ja päivä.

Jos olet toimittaja, SEO-asiantuntija tai tutkija ja sun pitää kerätä artikkeleita isossa mittakaavassa, tämä vertailu säästää sinulta kasan kokeiluja ja harhareittejä. Testasin sekä perinteisiä no-code-skreippereitä että AI-vetoisia vaihtoehtoja — tässä se, mikä oikeasti toimii.

TL;DR

| Plussat | Miinukset | Sopii parhaiten | |

|---|---|---|---|

| AI Article Scraper | - Kerää dataa useilta sivustoilta tarkasti - Poistaa hälyn automaattisesti - Mukautuu sivuston rakenteen muutoksiin - Tukee dynaamista sisällön latausta - Pieni datan siivous- ja jatkokäsittelytarve | - Suurempi laskentakustannus - Pidempi käsittelyaika - Osa sivuista voi vaatia manuaalista hienosäätöä - Saattaa laukaista anti-scraping-suojauksia | - Monimutkaiset tai dynaamiset sivustot (esim. uutisportaalit, some) - Laajamittainen datankeruu |

| Traditional No-code Article Scraper | - Nopea suoritus - Edullisempi - Kevyt palvelin- ja paikallisresurssien käyttö - Hyvä hallittavuus | - Vaatii usein ylläpitoa sivustorakenteen muuttuessa - Ei kerää useilta sivustoilta kerralla - Ei pärjää dynaamiselle sisällölle - Suuri datan siivouskustannus | - Nopea, laajamittainen keruu yksinkertaisilta staattisilta sivuilta - Rajalliset resurssit ja tiukka budjetti |

Mikä on artikkeliskreipperi? Miksi AI Article Scraper on tärkeä?

on eräänlainen , joka etsii ja nappaa uutis- ja artikkelisivuilta tietoja, kuten otsikot, kirjoittajat, julkaisupäivät, sisällön, avainsanat, kuvat ja videot, ja muuntaa ne rakenteiseen muotoon (esim. JSON, CSV tai Excel).

nojaavat usein : sisältö poimitaan sivun -rakenteesta sääntöjen avulla. Tässä mallissa on kuitenkin selkeitä kompastuskiviä:

- Heikko yleispätevyys: Jokainen sivusto vaatii omat , ja pienikin rakenteen muutos voi rikkoa poiminnan — eli käytännössä jatkuvaa ylläpitoa.

- Dynaamisen sisällön haasteet: Moni sivu lataa sisältöä AJAXilla tai JavaScriptillä, eikä sitä saa suoraan talteen.

- Rajallinen jatkokäsittely: poimivat lähinnä -pätkiä — ilman automaattista siivousta, muotoilua, semanttista tulkintaa tai vaikkapa sentimenttianalyysiä.

Tässä kohtaa kuvaan astuu .

Tässä kohtaa kuvaan astuu .

-

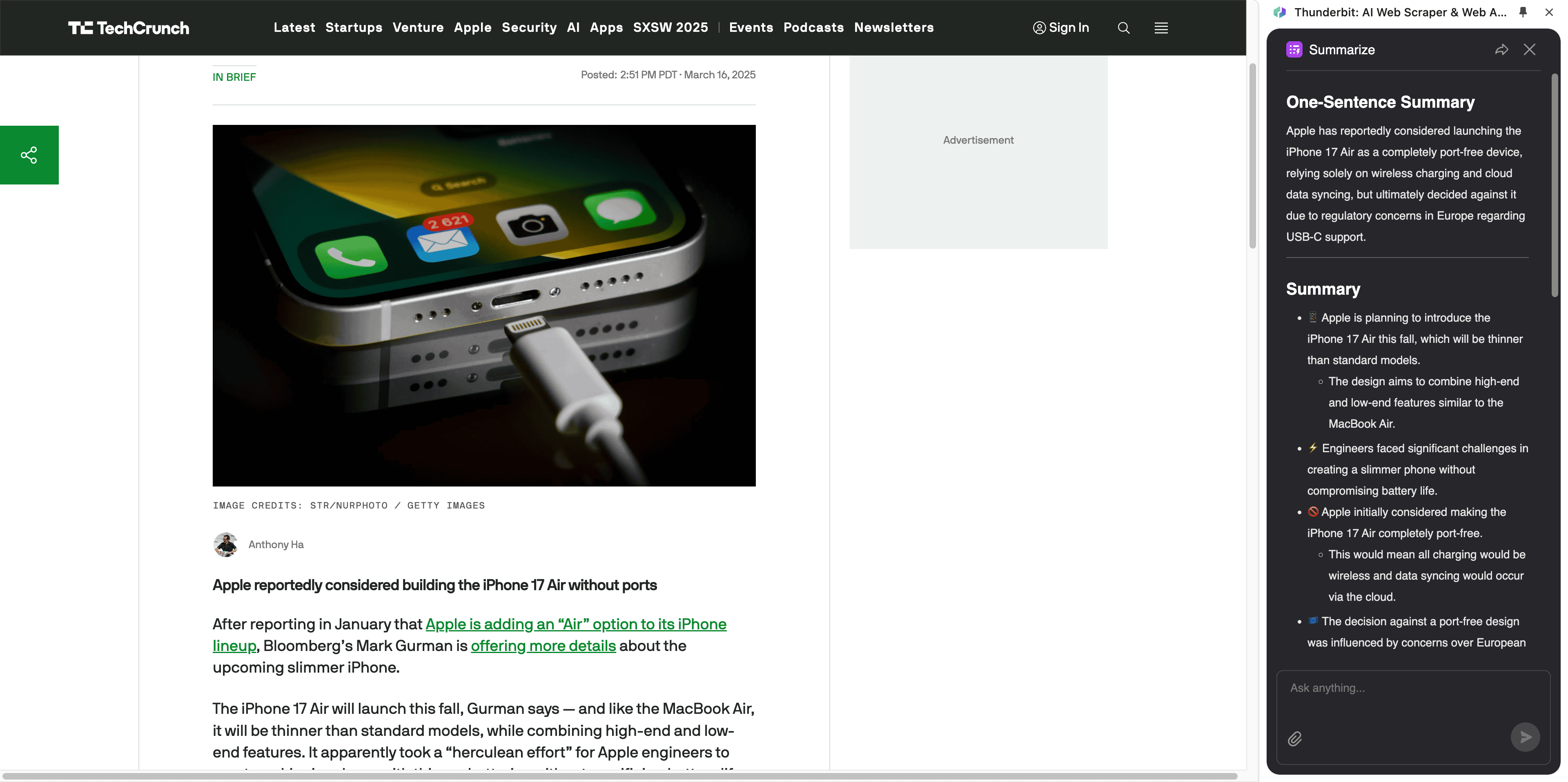

Teknologia hyödyntää LLM-malleja verkkosivujen ymmärtämiseen, ja tarjoaa esimerkiksi:

- Älykäs tunnistus: Otsikoiden, kirjoittajien, tiivistelmien ja pääsisällön tunnistaminen.

- Automaattinen hälyn poisto: Erottelee pääsisällön navigaatiosta, mainoksista ja “liittyvät artikkelit” -osioista, mikä parantaa datan laatua ja nopeuttaa keruuta.

- Mukautuminen muutoksiin: Vaikka sivun rakenne tai tyylit muuttuvat, AI pystyy jatkamaan poimintaa semanttisen ymmärryksen ja visuaalisten vihjeiden avulla.

- Toimii useilla sivustoilla: Toisin kuin , AI-skreipperi voidaan usein ottaa käyttöön eri sivustoilla ilman käsin tehtävää säätöä.

- NLP:n ja syväoppimisen yhdistäminen: Mahdollistaa esimerkiksi käännökset, tiivistämisen ja sentimenttianalyysin.

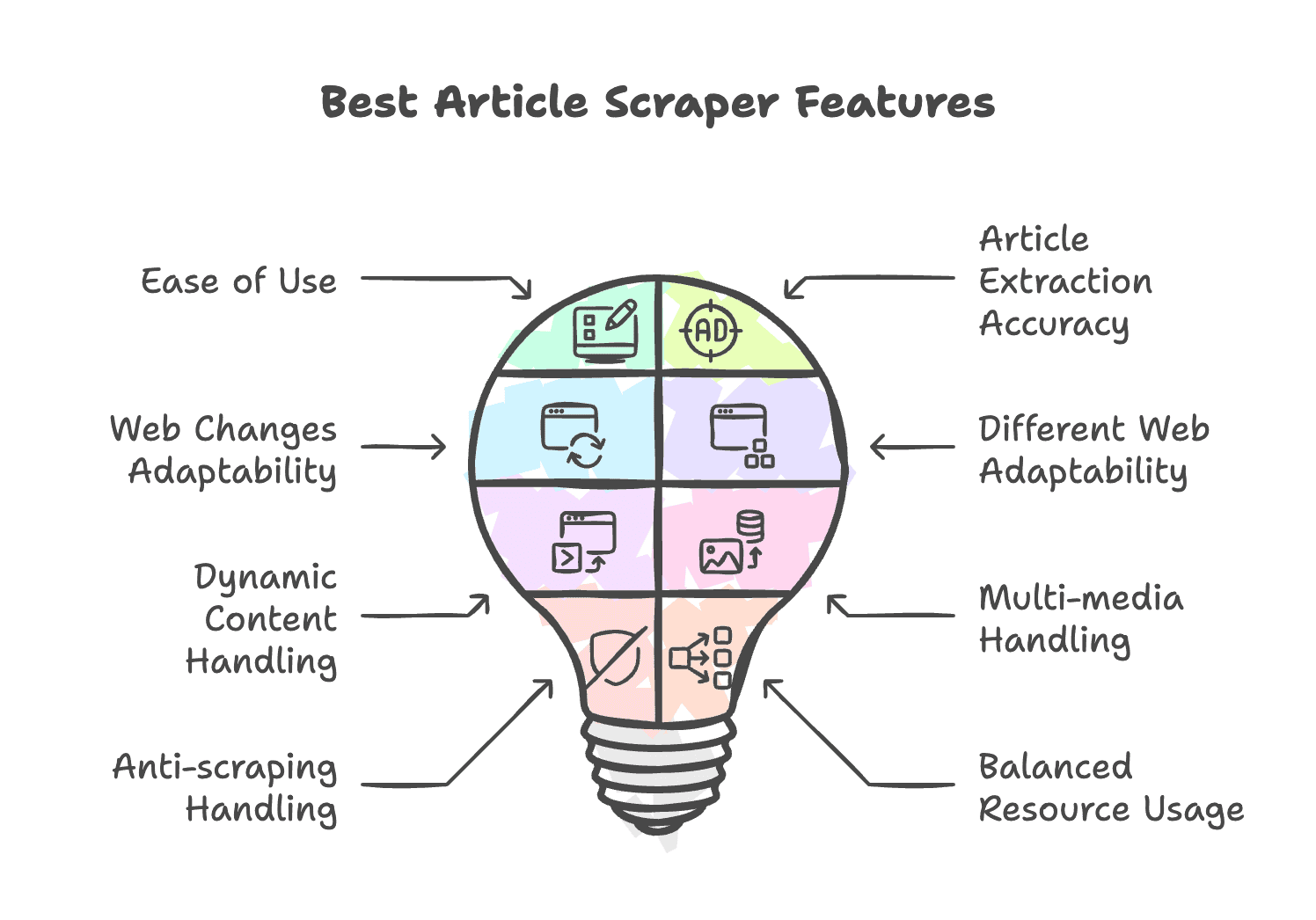

Mikä tekee parhaasta artikkeliskreipperistä vuonna 2026?

Huipputason artikkeliskreipperi osaa tasapainottaa suorituskyvyn, kustannukset, helppokäyttöisyyden, joustavuuden ja skaalautuvuuden. Näillä kriteereillä parhaat erottuvat vuonna 2026:

- Helppokäyttöisyys: Selkeä käyttöliittymä, ei koodausta.

- Poiminnan tarkkuus: Tunnistaa olennaisen sisällön ilman mainoksia ja navigaatiota.

- Mukautuminen sivuston muutoksiin: Sopeutuu rakenteen/tyylin muutoksiin ilman jatkuvaa ylläpitoa.

- Toimivuus eri sivustoilla: Ei ole naimisissa yhden sivupohjan kanssa.

- Dynaamisen sisällön tuki: JavaScript- ja AJAX-lataukset mukana.

- Multimedian käsittely: Tunnistaa kuvat, videot ja audion.

- Anti-scraping-suojauksien kierto: IP-kierto, CAPTCHA-ratkaisut ja proxyt.

- Resurssien järkevä käyttö: Ei hotki kohtuuttomasti muistia tai laskentatehoa.

Parhaat artikkeli- ja uutisskreipperit yhdellä silmäyksellä

| Työkalut | Keskeiset ominaisuudet | Sopii parhaiten | Hinnoittelu |

|---|---|---|---|

| Thunderbit | AI-pohjainen skriper; valmiit mallit; tuki PDF-, kuva- ja dokumenttiskreippaukselle; edistyneet datan jatkokäsittelyominaisuudet | Ei-tekniset käyttäjät, jotka tarvitsevat keruuta useilta niche-sivustoilta | 7 päivän ilmainen kokeilu, alkaen $9/kk (vuosisopimus) |

| WebScraper.io | Selainlaajennus; dynaamisen sisällön tuki; ei proxy-integraatiota | Käyttäjät, joilla ei ole tarvetta monimutkaisille sivuille tai edistyneille ominaisuuksille | 7 päivän ilmainen kokeilu, alkaen $40/kk (vuosisopimus) |

| Browse.ai | No-code-skriper ja monitorointi; valmiit robotit; virtuaaliselain; useita sivutustapoja; vahvat integraatiot | Yritykset, jotka tarvitsevat laajamittaista ja monimutkaista keruuta | $19/kk (vuosisopimus) |

| Octoparse | CSS-selektoreihin pohjautuva no-code; automaattinen tunnistus ja työnkulun generointi; valmiit artikkelipohjat; virtuaaliselain; anti-anti-scraping-ominaisuuksia | Organisaatiot, joilla on tarve monimutkaisten sivujen keruuseen | Alkaen $99/kk (vuosisopimus) |

| Bardeen | Laaja web-automaation kokonaisuus; valmiit mallit; no-code-skriper; sujuva integraatio työkalupinoon | GTM-tiimit, jotka haluavat upottaa artikkelikeruun olemassa oleviin työnkulkuihin | 7 päivän ilmainen kokeilu, alkaen $99/kk (vuosisopimus) |

| PandaExtract | Helppokäyttöinen UI; automaattinen tunnistus ja merkintä | Nopea “yksi klikkaus” -poiminta ilman monimutkaista asetusta | $49 kertamaksu |

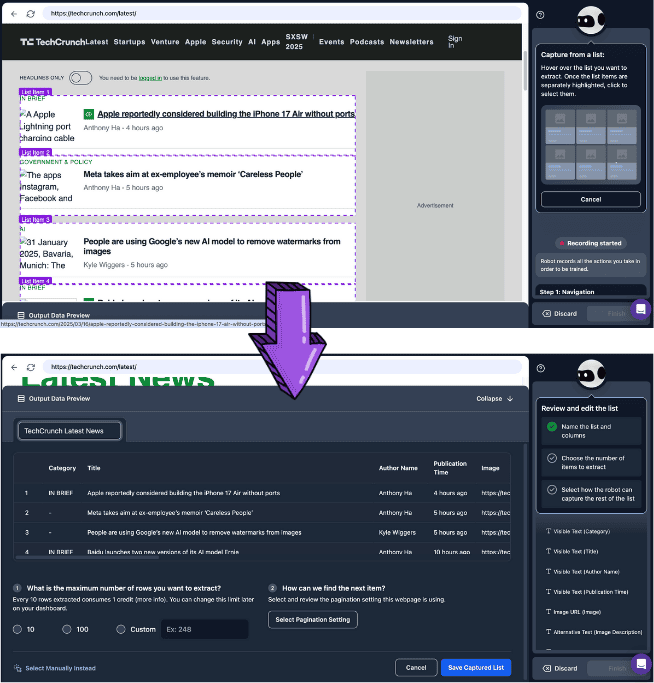

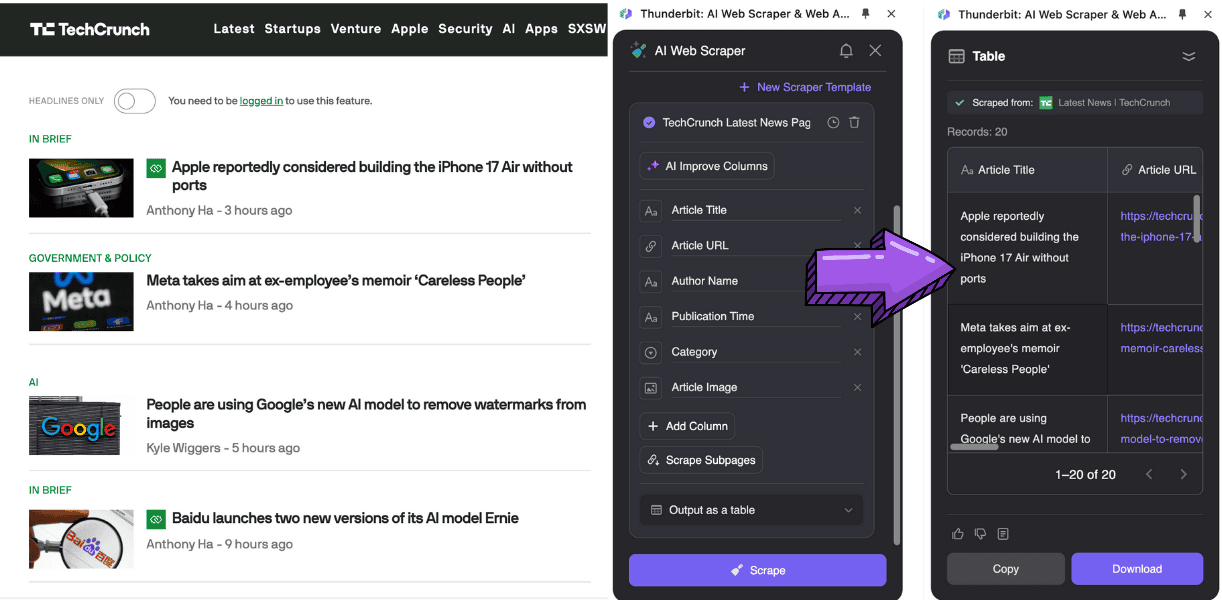

Tehokkain AI Article Scraper yrityskäyttäjille

- Plussat:

- Hyödyntää luonnollista kieltä ja tekoälyä sivun sisällön tunnistamiseen ja analysointiin — ilman CSS-selektoreita

- AI-avusteinen datan jatkokäsittely: muotoilumuunnokset, , luokittelu, käännös ja tagitus

- artikkelilistojen ja sisältöjen poimintaan yhdellä klikkauksella

- Miinukset:

- Saatavilla tällä hetkellä vain

- Ei paras vaihtoehto aivan massiiviseen datankeruuseen

- Monisivuinen keruu voi olla hitaampaa, mutta se onnistuu taustalla, jolloin saat tulokset nopeammin käyttöön

AI-pohjainen artikkeliskreipperi yrityskäyttöön

Browse.ai

- Plussat:

- No-code-artikkeliskreipperi ja seuranta

- Virtuaaliselain auttaa välttämään anti-scraping-suojauksien laukeamista

- Paljon valmiita “robotteja” yhden klikkauksen keruuseen mm. , , jne.

- Syvät integraatiot mm. ja -alustoihin

- Miinukset:

- Deep extract -käyttö vaatii kahden robotin luomisen, mikä tekee prosessista monimutkaisemman

- CSS-selektorit eivät ole kovin tarkkoja niche-sivustoilla

- Kallis — sopii paremmin jatkuviin, laajamittaisiin keruutarpeisiin

No-code-skriper pienimuotoiseen datan poimintaan

PandaExtract

- Plussat:

- Tunnistaa artikkelilistat ja yksittäiset sivut automaattisesti, käyttöliittymä on helppo

- Poimii listoja, yksityiskohtia, sähköposteja ja kuvia — sopii pieneen, rakenteiseen datankeruuseen

- Kertamaksu ja elinikäinen käyttö

- Miinukset:

- Vain selainlaajennus, ei pilviajoa

- Ilmaisversio tukee vain kopiointia, ei vientiä CSV/JSON-muotoihin jne.

Valmis käyttöön -artikkeliskreipperi organisaatioille

Octoparse

- Plussat:

- No-code-artikkeliskreipperi, jossa automaattinen tunnistus sivurakenteen hahmottamiseen ja keruutyönkulun luontiin

- Paljon valmiita artikkelimalleja, jotka saa käyttöön heti

- Virtuaaliselain, IP-kierto, CAPTCHA-ratkaisut ja proxyt anti-scraping-suojauksien kiertoon

- Miinukset:

- Automaattinen tunnistus nojaa silti pitkälti CSS-selektoreihin, joten tarkkuus on keskitasoa

- Edistyneet ominaisuudet vaativat opettelua ja teknistä ymmärrystä

- Kallis laajamittaisessa keruussa

Kattavin automaatio GTM-tiimeille

Bardeen

- Plussat:

- No-code-artikkeliskreipperi, joka hyödyntää LLM:ää yhden klikkauksen automaatioon

- Integroituu yli 100 sovellukseen, mm. , ja

- Vahvat web-automaatiotyökalut AI-analyysiin datankeruun jälkeen

- Erinomainen, kun keruu halutaan osaksi olemassa olevia työnkulkuja

- Miinukset:

- Nojaa vahvasti valmiisiin playbookeihin; omien työnkulkujen rakentaminen vaatii kokeilua

- Vaikka alusta on no-code, monimutkaisen automaation ymmärtäminen ja rakentaminen voi viedä aikaa ei-teknisiltä käyttäjiltä

- Alisivujen poiminnan (subpage extract) asetus on monimutkainen

- Erittäin kallis

Kevyt artikkeliskreipperi nopeaan datan poimintaan

Webscraper.io

- Plussat:

- No-code point-and-click -käyttöliittymä

- Tukee dynaamista sisällön latausta

- Pilviajo

- Integraatiot mm. , ja

- Miinukset:

- Ei valmiita malleja — vaatii oman sitemapin rakentamisen

- Oppimiskynnys, jos CSS-selektorit ovat vieraita

- Sivutuksen ja alisivujen poiminnan asetukset voivat olla työläitä

- Pilviversio on kallis

Edistyneemmät ratkaisut insinööreille

Teknisille käyttäjille on tarjolla myös . Ne tarjoavat esimerkiksi:

- Joustavuus: Suorat API-kutsut räätälöityyn keruuseen, dynaaminen renderöinti ja IP-kierto

- Skaalautuvuus: Helppo liittää omiin dataputkiin yritystason, tiheään ja laajamittaiseen tarpeeseen

- Pienempi ylläpitokuorma: Ei tarvitse itse pyörittää proxy-poolia tai anti-scraping-strategioita, mikä säästää operointiaikaa

API-ratkaisut yhdellä silmäyksellä

| API | Plussat | Miinukset |

|---|---|---|

| Bright Data API | - Laaja proxy-verkko (72M+ IP:tä 195 maassa) - Tarkka geo-kohdennus kaupunki/ZIP-tasolle - Vahva Proxy Manager IP-kiertoon | - Hitaammat vasteajat (keskiarvo 22,08 s) - Korkea hinta ei sovi pienille tiimeille - Jyrkempi oppimiskäyrä asetuksissa |

| ScraperAPI | - Edullisempi aloitus $49 - Autoparse automaattiseen datan poimintaan - Web UI -työkalu testaamiseen | - Saattaa veloittaa myös estetyistä pyynnöistä - Rajalliset JavaScript-renderöintiominaisuudet - Kustannukset voivat kasvaa premium-parametreilla |

| Zyte API | - AI-parsintaominaisuudet - Ei veloita epäonnistuneista pyynnöistä | - Korkeampi lähtöhinta (~$450/kk) - Kreditit eivät siirry seuraavalle kuukaudelle |

- Bright Data Web Scraper API

- Plussat:

- 195 maan kattavuus ja 72M+ asuin-IP:tä; automaattinen IP-kierto ja sijaintisimulointi — hyvä tiukasti suojatuille sivustoille (esim. , )

- Tukee JavaScript-dynaamista latausta ja sivun snapshot-tallennusta

- Miinukset:

- Kallis (laskutus per pyyntö ja kaistanleveys), heikko kustannustehokkuus pienissä projekteissa

- Plussat:

- Scraper API

- Plussat:

- 40M globaalia proxya, automaattinen datakeskus-/asuin-IP-vaihto, Cloudflare-ohituksen tuki, integraatio CAPTCHA-palveluihin (esim. )

- Rakenteiset endpointit ja asynkroniset skriperit nopeampaan keruuseen

- Miinukset:

- Dynaaminen renderöinti maksaa extraa, rajallinen tuki monimutkaisille AJAX-sivustoille

- Plussat:

- Zyte API

- Plussat:

- AI-pohjainen automaattinen web-datan poiminta — ei tarvetta rakentaa ja ylläpitää sääntöjä jokaiselle sivustolle

- Joustava pay-as-you-go-hinnoittelu

- Miinukset:

- Edistyneet ominaisuudet (esim. sessioiden hallinta, skriptattava selain) vaativat opettelua

- Plussat:

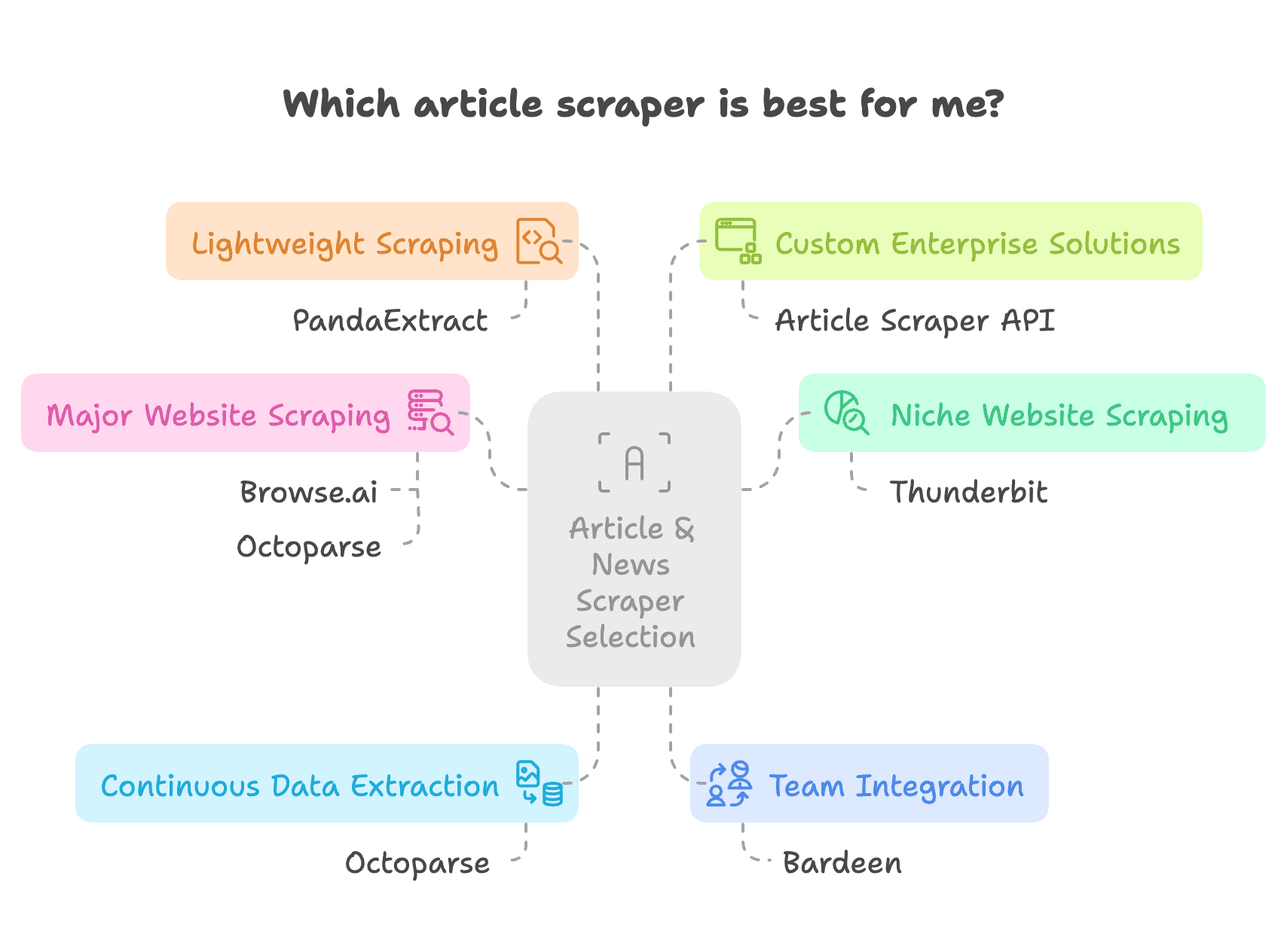

Miten valita artikkeli- ja uutisskreipperi?

Valintaa tehdessä kannattaa peilata omia tarpeita käyttötapaukseen, tekniseen osaamiseen ja budjettiin.

- Jos haluat kerätä dataa useilta niche-sivustoilta ilman, että rakennat erillisen skriperin jokaiselle sivulle, ja budjetti joustaa, on vahvin valinta. Se ei nojaa , vaan käyttää tekoälyä sivurakenteen tulkintaan ja mahdollistaa AI-analyysin keruun jälkeen. Thunderbitin tekoälylle kaikki sivustot “näyttävät samalta”, joten se poimii kokonaiset artikkelit tarkasti.

- Kun keräät uutisia ja artikkeleita isoilta sivustoilta kuten tai , tarvitset vahvat anti-scraping-ominaisuudet ja valmiit mallit, kuten Browse.ai tai Octoparse. Silti käytännössä paras vaihtoehto on Chrome-laajennus kuten : keruuprosessi muistuttaa normaalia selaamista ja kopiointia, ja kirjautumiset toimivat ilman monimutkaista säätöä.

- Jos tarvitset jatkuvaa, laajamittaista keruuta, ajastustoiminnot (kuten Octoparsessa) ovat hyödyllisiä.

- Tiimikäyttöön ja sujuvaan integrointiin olemassa oleviin työnkulkuihin Bardeen on hyvä, koska se tarjoaa artikkelikeruun lisäksi laajan automaatiotyökalupakin.

- Jos haluat kevyen työkalun pieneen datan poimintaan ilman opettelua, valitse point-and-click -työkalu kuten PandaExtract.

- Jos sinulla on tekninen tausta tai rakennat yritystason ratkaisua, harkitse API-työkaluja tai oman skriperin rakentamista näiden rinnalle.

Yhteenveto

Tässä artikkelissa käytiin läpi artikkeli- ja uutisskreippauksen perusidea sekä tyypilliset käyttötapaukset. rakentuvat varaan, mikä edellyttää jonkin verran ymmärrystä webin - ja -rakenteista — erityisesti edistyneissä toiminnoissa. Uuden sukupolven nojaavat tekoälyn semanttiseen ymmärrykseen ja visuaaliseen tunnistukseen, ja päihittävät erityisesti sivustorakenteen muutoksiin sopeutumisessa, eri sivustojen yleistettävyydessä, dynaamisen sisällön käsittelyssä sekä datan siivouksessa ja analyysissä.

Listasimme myös kuusi hyödyllistä artikkeli- ja uutisskreipperiä sekä kehittäjille suunnattuja API-työkaluja, ja vertailimme niiden vahvuuksia, heikkouksia, sopivaa datamittakaavaa, sivustotyyppejä ja kohdeyleisöä. Kun valitset ratkaisua artikkeli- ja uutisskreippaukseen, pyri löytämään omaan tarpeeseen sopiva vaihtoehto, jossa suorituskyky ja kustannukset ovat fiksussa tasapainossa.

UKK

1. Mikä on AI article scraper ja miten se toimii?

- Hyödyntää tekoälyä sivujen sisällön analysointiin ja poimintaan ilman CSS-selektoreita.

- Tunnistaa otsikot, kirjoittajat, julkaisupäivät ja pääsisällön tarkasti.

- Poistaa automaattisesti mainokset, navigaation ja muut epäolennaiset elementit.

- Sopeutuu sivuston muutoksiin ja toimii eri verkkosivustoilla.

2. Mitä etuja AI-pohjaisella artikkeliskreipperillä on verrattuna perinteisiin skripereihin?

- Yksi työkalu voi poimia sisältöä useilta sivustoilta.

- Käsittelee dynaamisen sisällön, kuten JavaScript- ja AJAX-lataukset.

- Vähemmän manuaalista asetusta ja ylläpitoa kuin CSS-pohjaisissa ratkaisuissa.

- Tarjoaa lisäominaisuuksia, kuten tiivistämisen, käännöksen ja sentimenttianalyysin.

3. Voinko käyttää Thunderbitia AI-artikkeliskreippaukseen ilman koodaustaitoja?

- Kyllä. Thunderbit on suunniteltu ei-teknisille käyttäjille ja toimii no-code-periaatteella.

- Tekoäly tunnistaa ja poimii artikkelisisällön automaattisesti.

- Valmiit mallit nopeuttavat keruuta.

- Data on vietävissä useisiin muotoihin, kuten CSV, JSON ja Google Sheets.

Lue lisää: