Si alguna vez has intentado sacar datos de la web usando Python, seguro que te ha pasado: un día estás recolectando precios de productos o leads de ventas sin lío, y al siguiente—¡pum!—tu script se queda fuera, tu IP bloqueada y te enfrentas a una muralla de CAPTCHAs que haría perder la cabeza a cualquiera. En 2025, esto ya no es solo una molestia; es el pan de cada día para quienes trabajan en ventas, marketing u operaciones y dependen de datos públicos para no quedarse atrás.

Ojo a este dato: más del se deben a defensas anti-bots como bloqueos de IP y CAPTCHAs, y cerca del se topan con estos obstáculos a menudo. Ahora que los bots ya son casi la mitad del tráfico en internet, los sitios web están más listos que nunca para defenderse. Pero tranquilo—tanto si eres un crack en Python como si buscas una solución rápida, aquí te cuento cómo esquivar bloqueos, usar proxies con cabeza y llevar tu scraping al siguiente nivel con herramientas de IA como .

Web Scraping en Python sin Bloqueos: Lo Básico

Vamos a lo básico. El raspado web es simplemente automatizar la recolección de datos de páginas web. Python es el rey para esto— usan herramientas basadas en Python para raspar datos. Pero los sitios web no suelen recibir a los bots con los brazos abiertos. ¿Por qué? Porque demasiadas peticiones automáticas pueden saturar servidores, robar contenido o dar ventaja a la competencia.

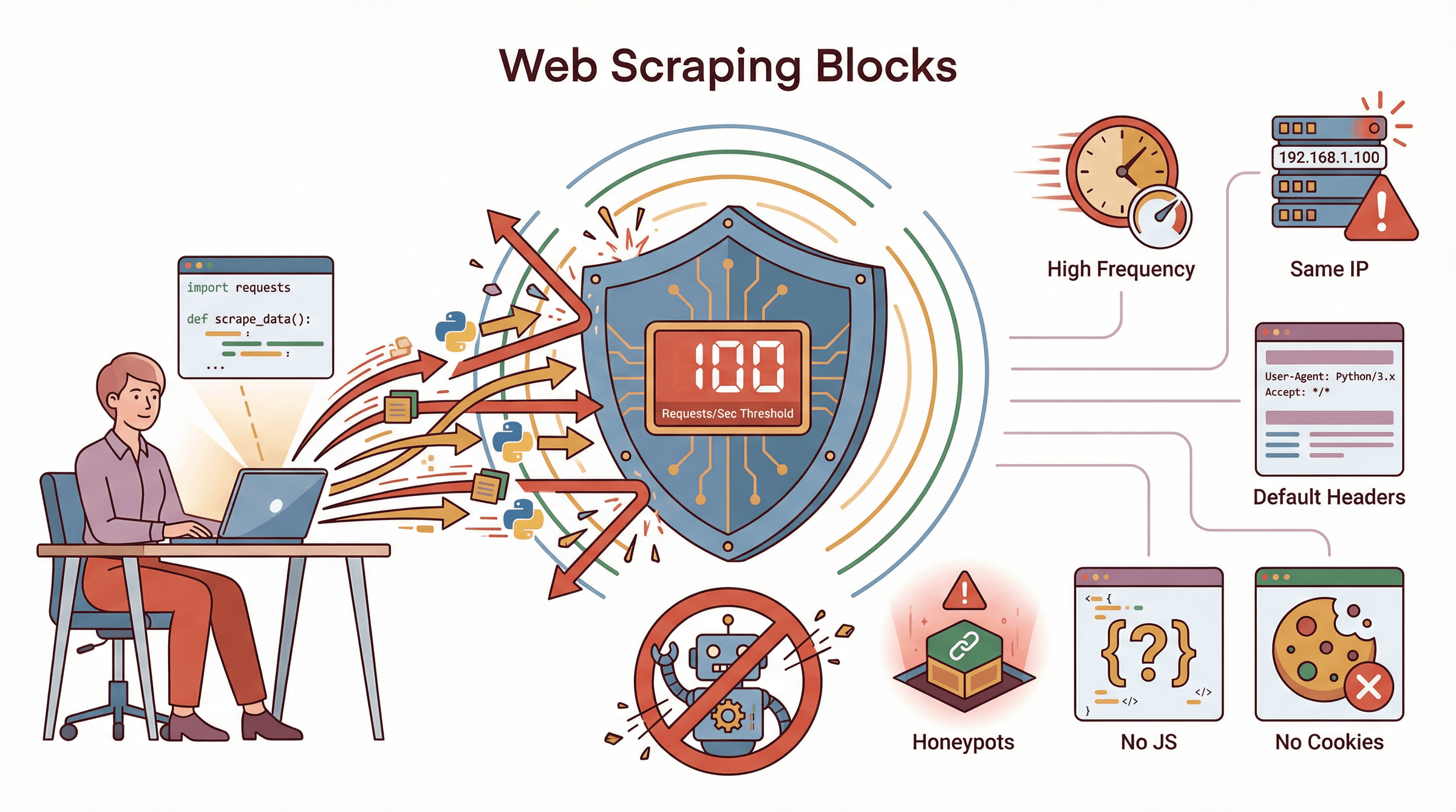

Entonces, ¿cómo se defienden los sitios? Estas son las barreras anti-scraping más comunes:

- Bloqueo de IP y limitación de velocidad: Si mandas muchas peticiones desde la misma IP, prepárate para el bloqueo o que te ralenticen.

- CAPTCHAs: Esos acertijos de “demuestra que eres humano” que fastidian tanto a bots como a personas.

- Filtrado de User-Agent y cabeceras: Si tu script se presenta como “python-requests/2.x”, es como llevar un letrero de “¡Soy un bot!”

- Desafíos JavaScript y huella del navegador: Algunos sitios piden ejecutar JavaScript o pasar controles sutiles del navegador.

- Honeypots: Enlaces o campos ocultos que solo los bots activan.

Si no tienes cuidado, tu script en Python va a activar todas estas alarmas antes de que puedas decir “403 Prohibido”.

Por Qué Evitar el Bloqueo de IP es Clave en el Web Scraping con Python

Que te bloqueen no es solo un rollo técnico—es un riesgo para el negocio. Imagina que tu equipo de ventas no puede conseguir nuevos leads, tu analista de precios se pierde una bajada de la competencia, o tu investigación de mercado se basa en datos incompletos. No es solo frustrante; puede costar dinero de verdad.

Míralo así:

| Caso de Uso | Ejemplo de Escenario | Riesgo si te Bloquean | Ventaja de un Scraping Fiable |

|---|---|---|---|

| Generación de Leads | Extraer contactos de directorios o LinkedIn | Listas incompletas, oportunidades perdidas | Leads actualizados y continuos para prospección |

| Monitoreo de Precios | Seguir precios de la competencia a diario | Datos desactualizados, cambios de precio perdidos | Inteligencia de precios en tiempo real, reacción rápida |

| Análisis de Competencia | Obtener detalles de productos o reseñas | Falta de visibilidad, lanzamientos no detectados | Visión completa de la competencia, mejor estrategia |

| Investigación de Mercado y SEO | Agregar noticias, foros o resultados de búsqueda | Análisis sesgado, tiempo de analista desperdiciado | Datos completos y actuales para mejores decisiones |

Para , los datos web no son un lujo—son esenciales.

Cómo los Sitios Web Bloquean el Web Scraping en Python: Principales Motivos

Entonces, ¿qué suele hacer que un scraper en Python acabe bloqueado? Esto es lo más típico:

Entonces, ¿qué suele hacer que un scraper en Python acabe bloqueado? Esto es lo más típico:

- Frecuencia alta de peticiones: Los humanos no navegan 100 páginas por segundo. Si lo haces, te pillan.

- Uso repetido de la misma IP: Todas las peticiones desde una sola IP, sobre todo si es de un datacenter, canta mucho.

- Cabeceras por defecto: Usar el user-agent estándar de Python o no poner cabeceras es una señal clarísima.

- Sin cookies ni sesiones: Los usuarios reales acumulan cookies al navegar. Los bots que no lo hacen llaman la atención.

- No ejecutar JavaScript: Si tu scraper no puede ejecutar JS, puedes perder datos o fallar en los controles anti-bot.

- Ignorar robots.txt: No es un bloqueo técnico, pero te pone en el radar.

- Honeypots: Si haces clic en enlaces ocultos o rellenas campos invisibles, te bloquean al instante.

Errores de novato como saturar sitios con peticiones, no rotar proxies y olvidar variar user-agents y tiempos de espera son muy comunes. He visto a gente conseguir que bloqueen toda la red de su uni en NASDAQ por mandar miles de peticiones en segundos. Un desastre.

Usar Proxies en Python para Evitar el Bloqueo de IP

Aquí es donde los proxies se vuelven tus mejores amigos. Un proxy es como un intermediario: manda tus peticiones desde otra dirección IP. Para el sitio web, parece que el tráfico viene de otro lado.

Tipos de Proxies

- Proxies de Datacenter: Baratos y rápidos, pero fáciles de detectar. Van bien para scraping de bajo riesgo.

- Proxies Residenciales: IPs de casas reales—más difíciles de bloquear, pero más lentos y caros.

- Proxies Rotativos: Cambian de IP automáticamente en cada petición. Perfectos para scraping a gran escala.

- Proxies Móviles: Usan IPs de operadores móviles. Solo necesarios para sitios muy restrictivos.

Para la mayoría de empresas, los proxies residenciales rotativos son la mejor jugada: son confiables y cambian lo suficiente para evitar bloqueos.

Cómo Integrar Proxies en Requests, Selenium y Beautiful Soup en Python

Vamos al grano. Así puedes meter proxies en tus scripts de Python:

Con Requests:

1import requests

2proxy = "http://USUARIO:CONTRASEÑA@IP_PROXY:PUERTO"

3proxies = {"http": proxy, "https": proxy}

4cabeceras = {"User-Agent": "Mozilla/5.0 ..."}

5response = requests.get("https://target-website.com/data", proxies=proxies, headers=cabeceras)

6html = response.textCon Beautiful Soup:

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3data_items = soup.find_all('div', class_='item')Con Selenium:

1from selenium import webdriver

2proxy = "IP_PROXY:PUERTO"

3chrome_options = webdriver.ChromeOptions()

4chrome_options.add_argument(f'--proxy-server=http://{proxy}')

5driver = webdriver.Chrome(options=chrome_options)

6driver.get("https://target-website.com")Para proxies rotativos, puedes recorrer una lista o usar un servicio que gestione la rotación. Recuerda: si un proxy falla, captura el error y prueba con otro.

Buenas Prácticas para Gestionar y Rotar Proxies

- Usa muchos proxies: Cuantos más, mejor. Rota tras cada petición o lote.

- Monitorea la salud de los proxies: Elimina los que fallen. Reintenta con una IP nueva si hay errores.

- No sobrecargues un solo proxy: Reparte las peticiones. No dejes que una IP haga todo el trabajo.

- Apunta a la geolocalización adecuada: Usa proxies del país objetivo si hace falta.

- Mezcla tipos de proxies: Empieza con datacenter y cambia a residenciales si te bloquean.

- Evita proxies gratuitos: Son lentos, poco fiables y suelen estar en listas negras.

- Respeta los límites del proveedor: No te fundas tu cuota de proxies demasiado rápido.

Gestionar proxies es casi un arte. Pero ni la mejor configuración de proxies lo es todo.

Más Allá de los Proxies: Técnicas Inteligentes para Evitar Bloqueos en Python

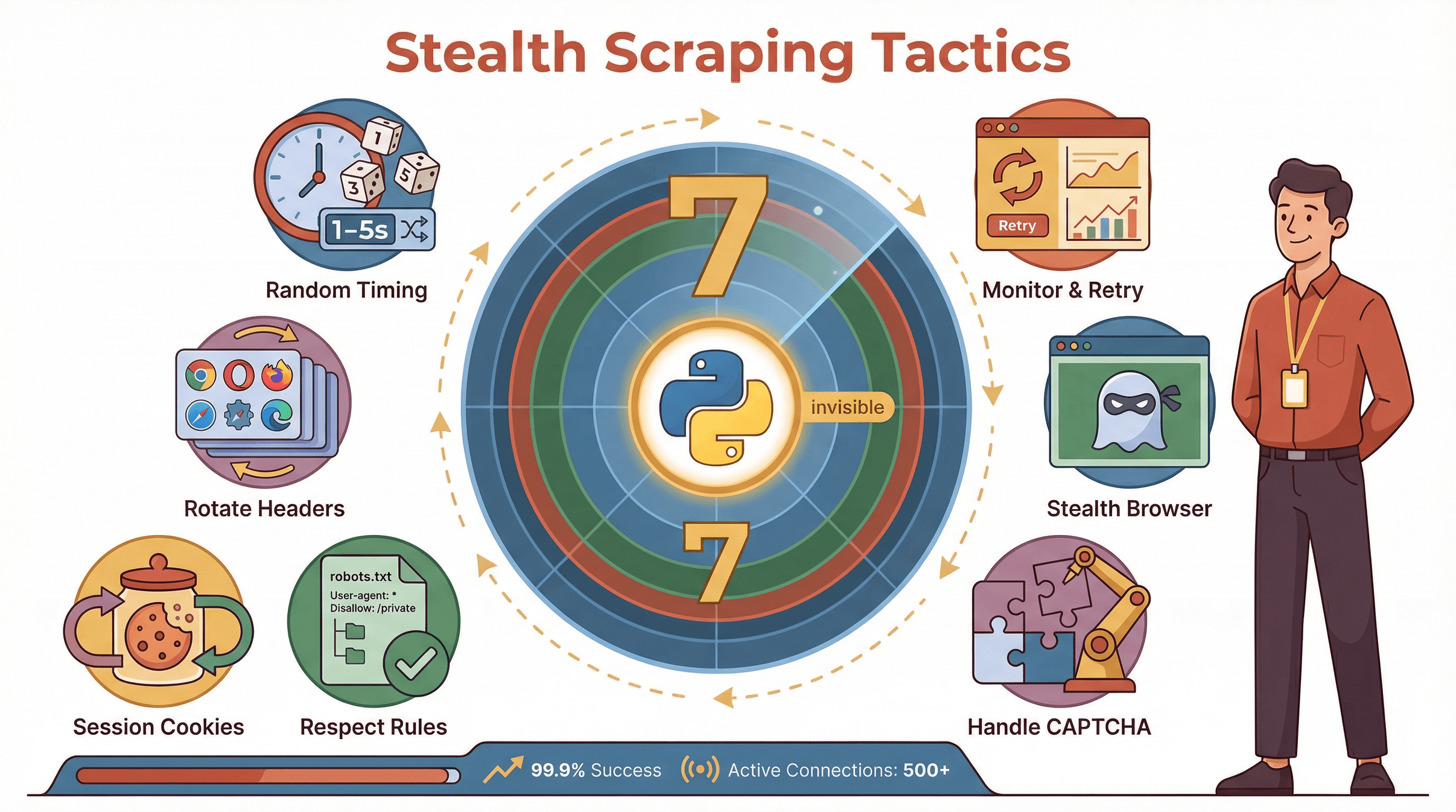

¿Quieres pasar realmente desapercibido? Añade estas tácticas a tu estrategia de proxies:

¿Quieres pasar realmente desapercibido? Añade estas tácticas a tu estrategia de proxies:

- Varía el tiempo entre peticiones: No mandes peticiones a ritmo fijo. Usa retrasos aleatorios (por ejemplo, entre 1 y 5 segundos).

- Rota user-agents y cabeceras: Usa una lista de user-agents reales de navegadores. Cambia Accept-Language, Referer, etc.

- Utiliza sesiones y cookies: Mantén cookies entre peticiones para simular una navegación real.

- Respeta robots.txt y baja el ritmo si hay errores: No ignores las reglas del sitio. Si recibes errores 429 o 503, baja el ritmo.

- Gestiona CAPTCHAs: Integra un servicio para resolver CAPTCHAs o cambia de proxy si te bloquean.

- Navegadores headless en modo sigiloso: Usa herramientas como undetected-chromedriver o plugins stealth de Playwright.

- Monitorea y reintenta: Lleva registros, vigila picos de fallos y reintenta automáticamente con nuevos proxies.

Hay librerías de Python muy útiles para esto—fake-useragent, requests.Session() y plugins de navegadores stealth son grandes aliados.

Potencia tu Scraping: Herramientas de IA vs. Métodos Tradicionales con Proxies en Python

Ahora viene lo bueno. ¿Y si pudieras olvidarte de gestionar proxies, ajustar cabeceras y pelearte con bloqueos? Ahí es donde entra .

Thunderbit es un Raspador Web IA en forma de extensión de Chrome que te deja extraer datos de cualquier web en solo dos clics—sin programar, sin configurar proxies, sin líos. Solo haz clic en “Sugerir Campos con IA”, deja que la IA detecte qué extraer y pulsa “Extraer”. Thunderbit se encarga de los proxies, bloqueos, paginación e incluso la navegación por subpáginas de forma automática.

Mira la comparación:

| Aspecto | Scraping en Python (Proxies) | Thunderbit Raspador Web IA |

|---|---|---|

| Tiempo de Configuración | Horas (código, proxies, parsing) | Minutos (apuntar, clic, listo) |

| Habilidad Técnica | Alta (programación, HTTP, proxies) | Baja (cualquiera puede usarlo) |

| Evitar Bloqueos | Manual (rotar proxies, cabeceras) | Automático (IA + gestión de proxies) |

| Mantenimiento | Constante (actualizar código, proxies) | Mínimo (IA se adapta, plantillas listas) |

| Paginación/Subpáginas | Requiere código manual | Un clic, la IA lo gestiona |

| Exportar Datos | Manual (CSV, Excel vía código) | Un clic a Sheets, Excel, Notion, Airtable |

| Escalabilidad | Depende de tu infraestructura/proxies | Alta (scraping en la nube, páginas en paralelo) |

| Coste | Tarifas de proxies + tiempo de desarrollo | Plan gratuito, luego precios asequibles |

| Fiabilidad | Variable (depende de la configuración) | Alta (optimizado para empresas) |

Thunderbit es ideal para equipos no técnicos o para quienes solo quieren los datos—rápido y sin complicaciones.

Paso a Paso: Extraer Datos sin Bloqueos con Thunderbit

Así usaría Thunderbit para sacar datos de un sitio que normalmente bloquea scripts en Python:

- Instala la extensión de Chrome de Thunderbit: .

- Navega al sitio objetivo: Inicia sesión si hace falta—Thunderbit puede usar tu sesión del navegador.

- Haz clic en “Sugerir Campos con IA”: Thunderbit analiza la página y sugiere columnas para extraer (como “Nombre”, “Precio”, “Email”).

- Haz clic en “Extraer”: Thunderbit recopila los datos en una tabla estructurada.

- Gestiona la paginación: Activa “Extraer Todas las Páginas” y Thunderbit recorrerá cada página, sumando los resultados.

- Extrae subpáginas: Usa “Extraer Subpáginas” para visitar cada página de detalle y enriquecer tus datos.

- Exporta: Un solo clic para mandar tus datos a Google Sheets, Excel, Notion o Airtable.

Thunderbit se encarga de toda la magia anti-bloqueo por ti—rota IPs, regula la velocidad y hasta resuelve CAPTCHAs sencillos. Para la mayoría de usuarios empresariales, simplemente funciona.

Cómo Thunderbit Gestiona la Paginación y el Scraping de Subpáginas

Thunderbit no se queda solo en la primera página. Puede:

- Desplazarse y hacer clic como una persona: Para scroll infinito o botones de “siguiente”, Thunderbit imita la velocidad de navegación real.

- Mantener sesiones activas: Si has iniciado sesión, Thunderbit conserva tu sesión entre páginas.

- Distribuir la carga: En modo nube, Thunderbit extrae varias páginas en paralelo, cada una desde una IP diferente.

- Gestionar contenido dinámico: Thunderbit ejecuta JavaScript, así que pilla todos los datos, incluso los que cargan después.

- Scraping de subpáginas: Thunderbit puede entrar en cada página de detalle, extraer campos extra y unirlos a tu tabla principal.

Para el sitio web, parece que varios usuarios reales están navegando normalmente—no un ejército de bots.

Comparativa: Métodos con Proxies en Python vs. Thunderbit para Empresas

Entonces, ¿qué opción te conviene más? Aquí tienes un resumen rápido:

| Factor | Python + Proxies | Thunderbit |

|---|---|---|

| Velocidad | Más lento de configurar | Resultados al instante |

| Mantenimiento | Alto (código, proxies) | Bajo (IA se adapta, plantillas) |

| Habilidad | Programador | Cualquiera |

| Riesgo de Bloqueo | Medio (si no tienes cuidado) | Bajo (automatización IA/proxies) |

| Coste | Tarifas de proxies + desarrollo | Plan gratuito, luego desde $15/mes |

| Ideal para | Scraping personalizado y complejo | Equipos de ventas, marketing, investigación |

Si eres desarrollador y te gusta personalizar todo, Python y proxies siguen siendo una gran opción. Pero para la mayoría de usuarios de negocio—sobre todo quienes quieren evitar líos con proxies—Thunderbit es un salto enorme en productividad.

Conclusiones: Extrae Datos de Forma Inteligente, No Más Difícil

Esto es lo que he aprendido (y ojalá me lo hubieran contado antes):

- Los proxies son clave para evitar bloqueos de IP en scraping con Python—pero gestionarlos es un lío.

- Las tácticas anti-bloqueo inteligentes (retrasos aleatorios, rotación de cabeceras, sesiones) marcan la diferencia.

- Herramientas con IA como Thunderbit automatizan todo lo difícil—proxies, bloqueos, paginación, subpáginas y exportación—para que te centres en lo importante: los datos.

- Elige la herramienta adecuada para tu equipo: Si buscas rapidez y fiabilidad, Thunderbit es la opción lógica. Si te mola el código y necesitas flujos personalizados, Python + proxies sigue siendo potente.

¿Quieres ver lo fácil que puede ser el scraping? y pruébalo en tu próximo proyecto. Y si quieres más trucos, pásate por el .

¡Feliz scraping! Que tus IPs nunca sean bloqueadas y tus datos siempre estén frescos.

Preguntas Frecuentes

1. ¿Cuál es la principal razón por la que los scrapers en Python son bloqueados?

La causa más común es mandar demasiadas peticiones desde una sola IP o usar cabeceras por defecto que delatan que eres un bot. Los sitios detectan estos patrones y bloquean o limitan el acceso rápido.

2. ¿Cómo ayudan los proxies a evitar bloqueos de IP en scraping con Python?

Los proxies enrutan tus peticiones por diferentes IPs, haciendo que parezca que el tráfico viene de varios usuarios. Los proxies rotativos son especialmente efectivos para scraping a gran escala.

3. ¿Cuáles son las mejores prácticas para gestionar proxies en Python?

Usa muchos proxies, rótalos seguido, monitoriza los fallos, evita proxies gratuitos y elige ubicaciones según el país objetivo. Siempre varía el tiempo y las cabeceras de tus peticiones.

4. ¿Cómo evita Thunderbit los bloqueos sin configurar proxies manualmente?

Thunderbit automatiza la rotación de proxies, regula la velocidad de las peticiones y aplica técnicas anti-bloqueo en segundo plano. Su agente IA imita el comportamiento humano, gestiona paginación y subpáginas, y exporta los datos con un solo clic—sin necesidad de programar.

5. ¿Debo usar Python o Thunderbit para mis necesidades de scraping empresarial?

Si eres desarrollador y necesitas soluciones personalizadas y complejas, Python con proxies es flexible. Pero para la mayoría de equipos de ventas, marketing e investigación que buscan datos rápidos y fiables sin líos técnicos, Thunderbit es la opción más inteligente y sencilla.

¿Listo para extraer datos de forma más inteligente? y olvídate de los bloqueos.

Más información