Si estás evaluando herramientas de web scraping en 2026, normalmente no buscas una clase de filosofía. Quieres una lista corta en la que puedas confiar, una forma rápida de distinguir las herramientas pensadas para usuarios de negocio de las stacks más pesadas para ingeniería, y pruebas suficientes para no acabar comprando la herramienta equivocada. Ese es el objetivo de esta página.

Soy Shuai Guan, cofundador y CEO de . Trabajo a diario en scraping con IA y automatización del navegador, así que me importa menos el ranking genérico y más el ajuste real: qué herramientas ayudan a un equipo de ventas u operaciones a avanzar esta semana, cuáles encajan en un flujo de trabajo de desarrolladores y cuáles solo tienen sentido cuando la escala y la infraestructura anti-bot se convierten en el problema principal.

La respuesta rápida

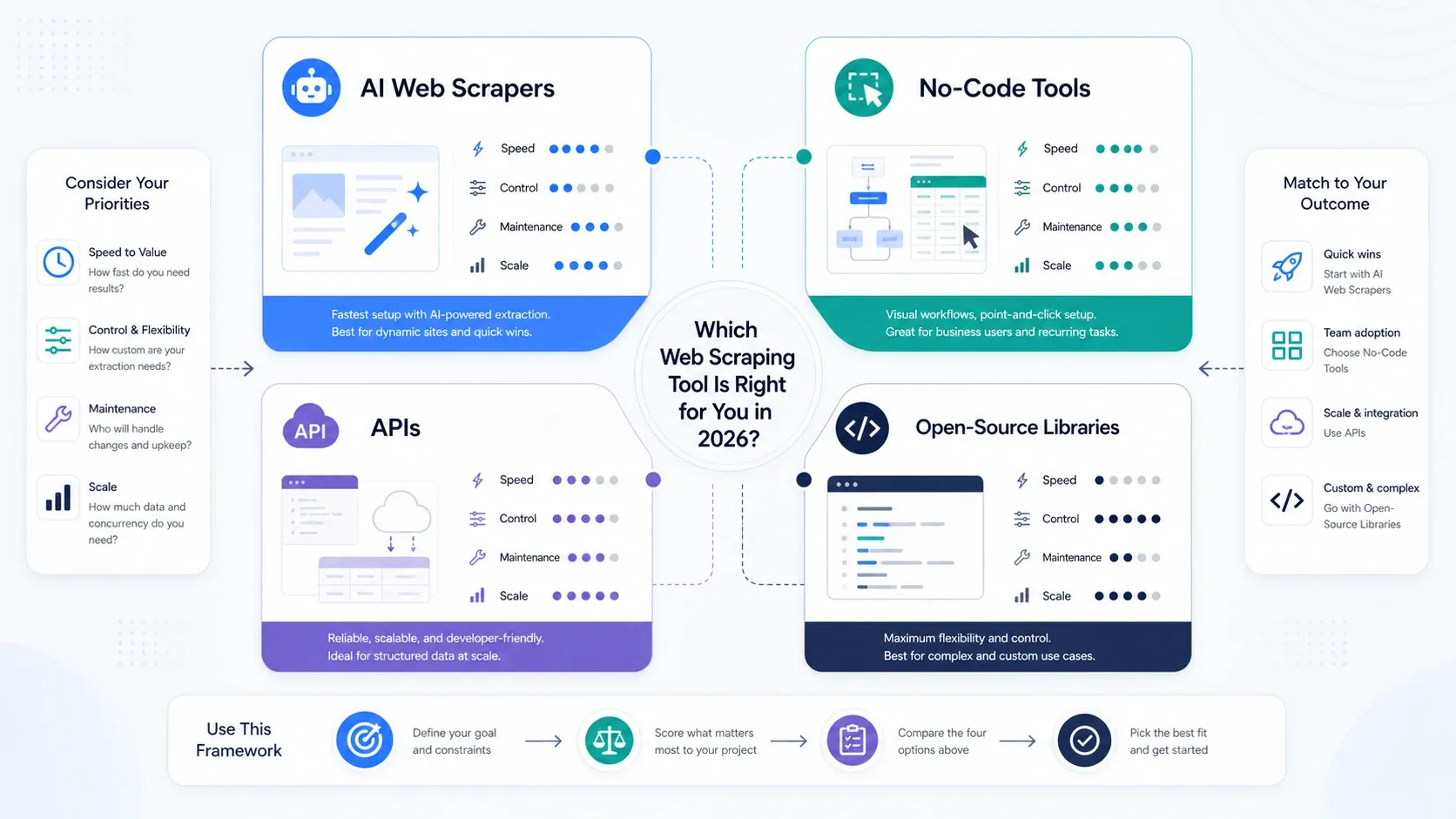

Si solo necesitas la lógica de decisión, quédate con esto:

- Elige un Raspador Web IA si quieres la ruta más rápida desde una web hasta una hoja de cálculo, con la mínima configuración.

- Elige un scraper sin código si necesitas más control de tareas, programación o ejecuciones en la nube sin escribir código.

- Elige una plataforma API si tu equipo necesita renderizado, rotación de proxy, gestión anti-bot o integración en un producto interno.

- Elige una biblioteca de código abierto si quieres control total y puedes encargarte del mantenimiento, los selectores, la infraestructura y los fallos.

Este artículo mantiene las 20 herramientas, pero la lógica de recomendación es deliberadamente simple: empieza con la herramienta más ligera que pueda manejar tu flujo de trabajo de forma fiable y baja de nivel solo cuando el mantenimiento, los bloqueos o la escala te obliguen a hacerlo.

Tabla rápida comparativa: las mejores herramientas de web scraping en 2026

Los precios y modelos de plan que aparecen abajo se comprobaron en las páginas oficiales de producto o precios el 7 de mayo de 2026. Cuando los proveedores usan facturación basada en uso o presupuestos empresariales personalizados, describo el modelo de precios en lugar de fingir que existe un precio de catálogo universalmente fiable.

| Herramienta | Tipo | Ideal para | Por qué entró en la lista de 2026 | Modelo de precios (comprobado en mayo de 2026) |

|---|---|---|---|---|

| Thunderbit | Raspador Web IA | Ventas, operaciones, ecommerce, inmobiliaria | La ruta más rápida para no programadores; sugerencias de campos con IA, subpáginas, exportaciones y flujo de trabajo en navegador + nube | Plan gratuito, planes de pago y precios personalizados para empresas |

| Browse AI | Raspador Web IA | Usuarios de negocio que monitorizan sitios web | Robots sin código, monitorización y salidas tipo hoja de cálculo/API muy sólidas | Plan gratuito, planes de pago y nivel premium gestionado |

| Bardeen | Automatización con IA + scraping | Revenue ops y flujos de trabajo en el navegador | Mejor cuando el scraping es solo un paso dentro de una automatización más amplia | Plan gratuito y planes de pago |

| Diffbot | Plataforma de extracción con IA | Empresas y equipos de datos | La mejor opción cuando quieres extracción con IA y flujos de datos estructurados a gran escala | Precios de nivel empresarial |

| Instant Data Scraper | Scraper ligero de navegador | Usuarios ocasionales y capturas rápidas de tablas | Sigue siendo una de las formas más simples de llevar una lista o tabla visible a CSV rápidamente | Gratis |

| Octoparse | Scraper sin código | Analistas y equipos de operaciones con trabajos recurrentes grandes | Constructor visual maduro con extracción en la nube, anti-bloqueo y plantillas | Plan gratuito, desde $69/mes, precios personalizados para empresas |

| ParseHub | Scraper low-code | Analistas que necesitan lógica y control de escritorio | Lógica de proyecto flexible y navegación anidada, con una curva de aprendizaje más pronunciada que las herramientas más nuevas centradas en IA | Plan gratuito y planes de pago |

| Web Scraper | Scraper sin código | Principiantes y trabajos ligeros en la nube | Buen punto de entrada si te gusta el scraping basado en sitemap y una configuración centrada en el navegador | Extensión gratuita, planes de nube de pago |

| Data Miner | Scraper de navegador | Investigadores y operadores de crecimiento | Sigue siendo útil para extracciones rápidas basadas en recetas dentro del navegador | Plan gratuito y planes de pago |

| Apify | API + plataforma de Actors | Equipos técnicos y operadores híbridos | Excelente ecosistema de Actors y ejecución personalizada cuando superas las extensiones de navegador | Plan gratuito, desde $29/mes más uso, niveles de pago superiores |

| ScrapingBee | API de scraping | Desarrolladores que extraen sitios con mucho JS | Buena opción cuando quieres renderizado y manejo de proxy sin construir tú mismo la capa del navegador | Prueba gratuita y planes de pago |

| ScraperAPI | API de scraping | Desarrolladores que escalan solicitudes rápido | API directa, créditos de prueba, productos estructurados y descarga de infraestructura más sencilla | Prueba de 7 días con 5.000 créditos, desde $49/mes |

| Bright Data | API empresarial + plataforma de proxy | Programas de alto volumen y con exigencias de cumplimiento | La pila de recopilación de datos más amplia cuando desbloqueo, proxy y adquisición gestionada importan más que la simplicidad | Precios por uso y por producto |

| Oxylabs | API empresarial + plataforma de proxy | Equipos que compran scraping como infraestructura | Muy sólido para recopilación a gran escala, especialmente en carga de precios, SEO e investigación de mercado | La API de Web Scraper parte de $49/mes; los precios de proxy varían |

| Zyte | API + stack anti-bot | Equipos de desarrollo y datos | Buena opción si quieres extracción API-first con buenos cimientos de navegador, rotación y anti-detección | Prueba con $5 de crédito gratis, compromisos basados en uso |

| Selenium | Automatización de navegador de código abierto | Automatización estilo QA y flujos de interacción complejos | Sigue siendo útil cuando la fidelidad de la interacción del usuario importa más que el rendimiento del scraper | Gratis y de código abierto |

| BeautifulSoup4 | Analizador de código abierto | Principiantes y análisis ligero | Mejor como analizador dentro de una pila sencilla, no como plataforma completa de scraping | Gratis y de código abierto |

| Scrapy | Framework de rastreo de código abierto | Rastreadores personalizados en producción | El mejor equilibrio entre potencia y madurez si quieres encargarte tú mismo del pipeline | Gratis y de código abierto |

| Puppeteer | Automatización de navegador de código abierto | Scraping orientado a Node y scripting del navegador | Genial si tu equipo ya se siente cómodo trabajando en el ecosistema de Chrome y Node | Gratis y de código abierto |

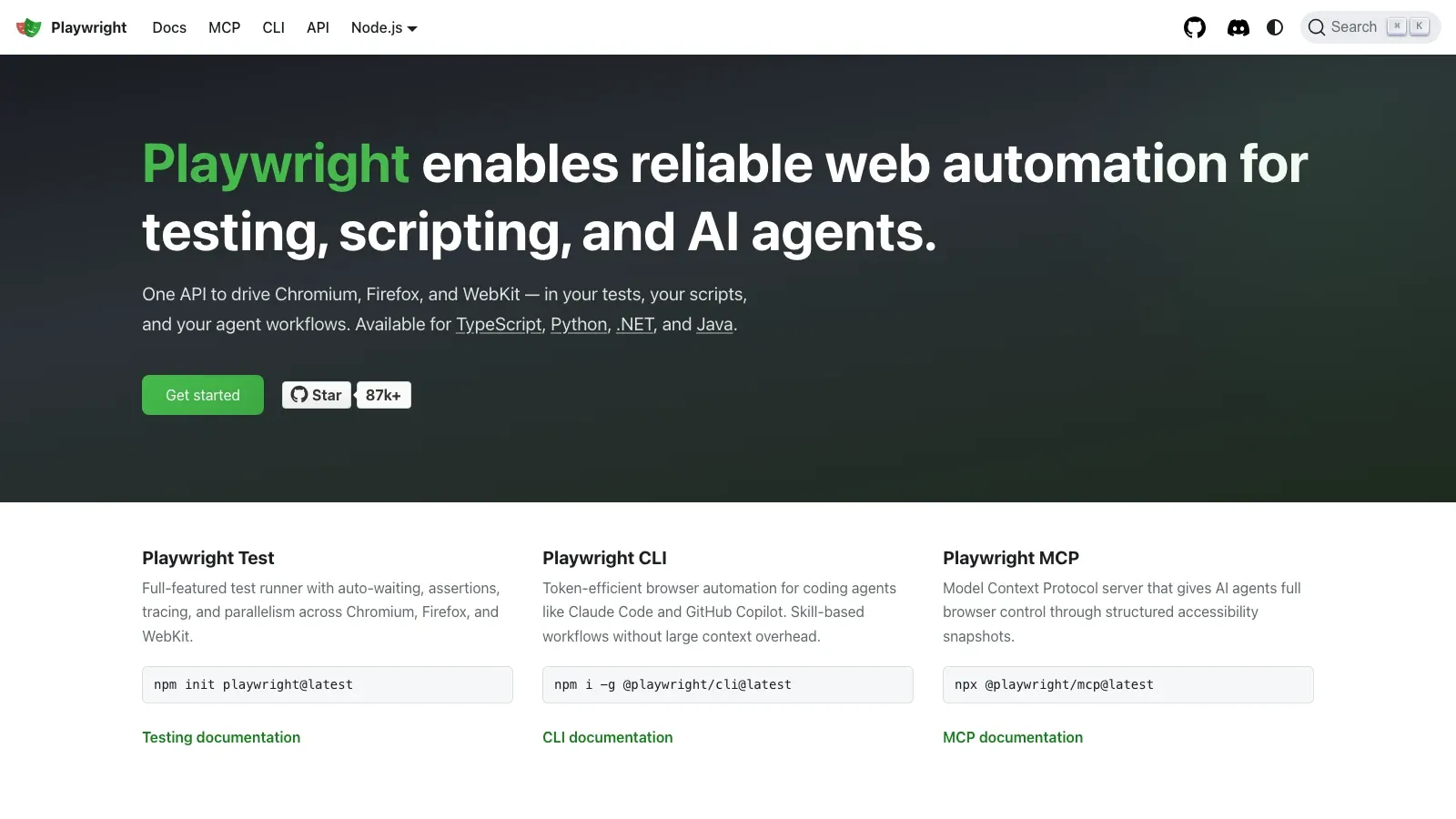

| Playwright | Automatización de navegador de código abierto | Automatización moderna multi-navegador | A menudo la opción más limpia para automatización moderna del navegador, con gran ergonomía para desarrolladores | Gratis y de código abierto |

Cómo evalué estas herramientas

Usé cuatro filtros:

- Tiempo hasta el primer scraping exitoso

Si un operador no técnico no puede obtener datos útiles rápidamente, eso importa. - Carga de mantenimiento

Una configuración rápida no sirve de nada si el flujo se rompe cada vez que un sitio cambia. - Techo de escala

Algunas herramientas son ideales para 50 páginas a la semana y terribles para 5 millones de solicitudes al mes. - Encaje en el flujo de trabajo

La mejor herramienta para un equipo de revenue ops rara vez es la mejor para un equipo de plataforma de datos.

El resultado no es un ranking universal. Es una página de decisión para elegir primero la clase de herramienta adecuada y después el producto correcto dentro de esa clase.

¿Qué tipo de herramienta de web scraping necesitas realmente?

- Elige raspadores web IA si tu objetivo principal es la velocidad operativa.

- Elige herramientas sin código si necesitas más paginación, programación y control repetible de tareas.

- Elige APIs y plataformas de scraping si el renderizado, la rotación y la capacidad de desbloqueo ya son el cuello de botella.

- Elige bibliotecas de código abierto si tu equipo valora más el control que la comodidad y puede mantener la pila internamente.

Si tu equipo todavía está decidiendo si el scraping debe vivir con operaciones o con ingeniería, empieza primero con una herramienta de IA o sin código. Aprenderás qué importa más rápido ejecutando trabajos reales que sobre-diseñando la pila desde el principio.

Mejores raspadores web IA para equipos de negocio

Estas son las herramientas que miraría primero si el resultado que quieres son datos listos para una hoja de cálculo y con la menor configuración posible.

1. Thunderbit

Thunderbit es la opción más sencilla aquí si tu equipo quiere extraer datos estructurados sin aprender selectores, scripting del navegador ni infraestructura de scraping. El flujo de trabajo se basa en sugerencias de campos con IA, enriquecimiento de subpáginas y exportación directa a las herramientas que ya usan los usuarios de negocio.

- Ideal para: ventas, operaciones, ecommerce, inmobiliaria y otros equipos que trabajan mucho en navegador.

- Por qué destaca: comprime el tiempo de configuración mejor que cualquier otra opción de esta lista para personas no programadoras.

- A tener en cuenta: si necesitas lógica de rastreo muy personalizada o control de ingeniería altamente especializado, acabarás bajando de nivel.

- Modelo de precios: plan gratuito, planes de pago de autoservicio y precios para empresas.

2. Browse AI

Browse AI sigue siendo una gran opción para usuarios de negocio que quieren configuración con clics y monitorización recurrente. Su modelo de robots es especialmente útil cuando el scraping y la detección de cambios son igual de importantes.

- Ideal para: monitorizar páginas de precios, páginas de competidores y extracción repetible de listas.

- Por qué destaca: incorporación pulida, robots preconstruidos y un camino claro de la web a la hoja de cálculo o a una salida tipo API.

- A tener en cuenta: los trabajos complejos y de gran volumen pueden encarecerse o volverse más incómodos operativamente más rápido que en las stacks API-first.

- Modelo de precios: plan gratuito, planes de pago y nivel premium/gestionado.

3. Bardeen

Bardeen resulta más atractivo cuando el scraping es solo una acción dentro de un flujo más amplio de automatización en el navegador. Si estás moviendo datos a CRM, hojas de cálculo o flujos outbound, su enfoque de automatización importa más que la profundidad bruta de scraping.

- Ideal para: revenue ops, flujos de leads y automatización de tareas nativa del navegador.

- Por qué destaca: una historia de automatización de flujos más fuerte que las herramientas de extracción pura.

- A tener en cuenta: no es la mejor opción cuando el scraping en sí es complejo y crítico para el negocio.

- Modelo de precios: plan gratuito y planes de pago.

4. Diffbot

Diffbot está aquí para equipos que necesitan extracción con IA a escala empresarial, no para quienes buscan la ruta más barata o más simple. Tiene más sentido cuando la calidad de los datos estructurados y la ingesta a gran escala importan más que el control manual.

- Ideal para: equipos de datos empresariales, inteligencia de contenidos y programas de extracción a gran escala.

- Por qué destaca: extracción estilo visión por computadora y una orientación muy sólida a la salida estructurada.

- A tener en cuenta: excesivo para equipos pequeños y poco adecuado si tu caso de uso es ligero.

- Modelo de precios: planes de nivel empresarial y venta personalizada.

5. Instant Data Scraper

Instant Data Scraper sigue mereciendo un lugar porque hay muchas situaciones en las que solo necesitas la tabla, el directorio o la lista visibles, ahora mismo. No es una plataforma, pero muchas veces basta.

- Ideal para: extracción puntual, listas rápidas de leads, directorios sencillos y tablas visibles.

- Por qué destaca: fricción casi nula para las páginas adecuadas.

- A tener en cuenta: automatización limitada, poca profundidad y encaje débil para flujos avanzados.

- Modelo de precios: gratis.

Mejores herramientas de web scraping sin código para trabajos repetibles

Cuando el trabajo deja de ser un scraping ocasional, los constructores visuales y la ejecución en la nube empiezan a importar.

6. Octoparse

Octoparse sigue siendo una de las plataformas sin código más sólidas si necesitas ejecuciones en la nube, cobertura de plantillas y una gestión de tareas más sofisticada de la que puede ofrecer una extensión del navegador.

- Ideal para: analistas, equipos de precios y operadores que ejecutan trabajos recurrentes de recopilación.

- Por qué destaca: constructor de tareas maduro, extracción en la nube, funciones anti-bloqueo y un gran ecosistema de plantillas.

- A tener en cuenta: es más potente que las herramientas de navegador centradas en IA, pero eso también implica más carga de configuración.

- Modelo de precios: plan gratuito, desde $69/mes, precios personalizados para empresas.

7. ParseHub

ParseHub sigue siendo relevante para usuarios que quieren más control que un scraper de IA, pero no quieren construir una base de código. Premia la paciencia, no la velocidad.

- Ideal para: analistas y operadores con curiosidad técnica que pueden tolerar una curva de aprendizaje más pronunciada.

- Por qué destaca: lógica de navegación flexible y más control que las herramientas ligeras de navegador.

- A tener en cuenta: la experiencia del producto se siente más pesada que la de las herramientas más nuevas, especialmente para equipos de negocio que van rápido.

- Modelo de precios: plan gratuito y planes de pago.

8. Web Scraper

Web Scraper sigue siendo un punto de entrada razonable si te gusta el modelo de sitemap y quieres algo que empiece en el navegador y luego crezca hacia programación en la nube más adelante.

- Ideal para: principiantes, proyectos personales y trabajos repetibles pequeños.

- Por qué destaca: flujo de trabajo de sitemap accesible y adopción sencilla primero en navegador.

- A tener en cuenta: se queda corto cuando necesitas una lógica de extracción más adaptativa.

- Modelo de precios: extensión gratuita para navegador y planes de nube de pago.

9. Data Miner

Data Miner se entiende mejor como una utilidad de extracción rápida que como una plataforma completa de scraping. Aun así, merece estar aquí porque el trabajo basado en recetas es útil para muchas tareas de investigación y prospección.

- Ideal para: investigadores, equipos de growth y exportaciones rápidas desde el navegador.

- Por qué destaca: modelo de recetas, baja fricción y exportación sencilla desde el navegador.

- A tener en cuenta: no es la herramienta adecuada para scraping serio a escala de plataforma.

- Modelo de precios: plan gratuito y planes de pago.

Mejores plataformas API cuando la escala y los bloqueos se convierten en el verdadero problema

Esta es la capa en la que los equipos de ingeniería dejan de pensar en “¿cómo extraigo esta página?” y empiezan a pensar en “¿cómo hago que esto sea fiable a volumen?”

10. Apify

Apify es la plataforma más flexible de este grupo si quieres tanto un marketplace de scrapers reutilizables como un lugar para ejecutar tu propio código. Conecta mejor que la mayoría entre el descubrimiento sin código y la ejecución para desarrolladores.

- Ideal para: equipos híbridos, scraping dirigido por desarrolladores y flujos de automatización reutilizables.

- Por qué destaca: el ecosistema de Actors más ejecución personalizada le da un alcance poco común.

- A tener en cuenta: una vez que pasas a algo personalizado, vuelves al terreno de ingeniería y la ventaja de simplicidad se reduce.

- Modelo de precios: plan gratuito, desde $29/mes más uso, niveles de mayor uso y empresa.

11. ScrapingBee

ScrapingBee es una buena opción cuando lo que realmente necesitas es “entrégame una página renderizada y resuelve por mí toda la infraestructura complicada”. Encaja bien con objetivos con mucho JS.

- Ideal para: desarrolladores que extraen sitios dinámicos y no quieren dedicar mucho esfuerzo a la infraestructura.

- Por qué destaca: API simple para renderizado, proxies y automatización del navegador.

- A tener en cuenta: es un servicio de infraestructura, así que sigues siendo responsable del análisis, la lógica de reintentos y la calidad aguas abajo.

- Modelo de precios: prueba y planes de pago.

12. ScraperAPI

ScraperAPI sigue siendo una de las formas más fáciles de descargar la gestión de proxy y las tasas de éxito de las solicitudes cuando quieres escalar rápido.

- Ideal para: desarrolladores que necesitan pasar de prototipo a volumen rápidamente.

- Por qué destaca: API sencilla, créditos de prueba, productos estructurados y niveles de escalado.

- A tener en cuenta: como todos los productos API-first, no elimina la necesidad de criterio de ingeniería para el análisis y la validación de datos.

- Modelo de precios: prueba de 7 días con 5.000 créditos, desde $49/mes.

13. Bright Data

Bright Data es la opción pesada cuando la capacidad de desbloqueo, el inventario de proxies y la adquisición gestionada importan más que la simplicidad de la herramienta.

- Ideal para: programas empresariales, recopilación a gran escala sensible al cumplimiento y adquisición de datos gestionada.

- Por qué destaca: amplitud de productos de proxy, scraper, navegador y datasets.

- A tener en cuenta: es caro y fácil de sobrecomprar si tu flujo principal sigue siendo relativamente simple.

- Modelo de precios: precios por uso y por producto en APIs, proxies y servicios gestionados.

14. Oxylabs

Oxylabs sigue siendo una buena elección para equipos que compran scraping como infraestructura y no como herramienta de navegador. Es especialmente relevante cuando la fiabilidad y la madurez de compras importan.

- Ideal para: recopilación empresarial, monitorización de precios, monitorización SEO e investigación de mercado.

- Por qué destaca: historia de infraestructura sólida, profundidad de proxy y un proceso de compra empresarial más claro.

- A tener en cuenta: no es ideal si tu equipo quiere un flujo de autoservicio casual.

- Modelo de precios: la API de Web Scraper parte de $49/mes; otros productos varían por unidad y uso.

15. Zyte

Zyte sigue mereciendo una consideración seria por parte de equipos de desarrollo y de datos que quieren anti-detección, acciones de navegador, renderizado JS e IP rotatorias detrás de una sola historia API-first.

- Ideal para: equipos técnicos que construyen sistemas de extracción repetibles.

- Por qué destaca: acciones de navegador, renderizado JS, rotación de IP y postura anti-bot en una sola stack.

- A tener en cuenta: es mejor para equipos con ownership de ingeniería que para operadores no técnicos.

- Modelo de precios: prueba con $5 de crédito gratis y compromisos mensuales basados en uso.

Mejores bibliotecas de código abierto para desarrolladores que quieren control total

Si quieres encargarte de la pila de scraping de principio a fin, estos son los bloques de construcción más útiles en 2026.

16. Selenium

Selenium sigue siendo útil cuando necesitas fidelidad de interacción estilo QA, flujos de automatización de navegador heredados o un control de flujo de usuario muy explícito.

- Ideal para: automatización con mucha interacción, solapamiento con QA y sitios donde el comportamiento del navegador importa más que el rendimiento de rastreo.

- Por qué destaca: ecosistema maduro y amplio soporte de navegadores.

- A tener en cuenta: es más pesado y más lento que herramientas de navegador más nuevas para muchas cargas de trabajo de scraping.

- Modelo de precios: gratis y de código abierto.

17. BeautifulSoup4

BeautifulSoup no es una plataforma completa de scraping, pero sigue siendo una de las formas más sencillas de analizar HTML desordenado en flujos ligeros.

- Ideal para: principiantes, scripts rápidos y tareas centradas en el análisis.

- Por qué destaca: API sencilla y baja carga cognitiva.

- A tener en cuenta: conviene combinarlo con herramientas de solicitudes, navegador o rastreo; por sí solo, solo es un analizador.

- Modelo de precios: gratis y de código abierto.

18. Scrapy

Scrapy sigue siendo la mejor respuesta cuando necesitas un verdadero framework de rastreo en lugar de unas cuantas scripts.

- Ideal para: rastreadores personalizados en producción y pipelines de datos propios.

- Por qué destaca: alto rendimiento, pipelines, middleware y gran extensibilidad a largo plazo.

- A tener en cuenta: hay una carga real de ingeniería, y los objetivos con mucho JS a menudo requieren herramientas complementarias.

- Modelo de precios: gratis y de código abierto.

19. Puppeteer

Puppeteer sigue siendo una opción sólida para equipos centrados en Node que quieren control directo sobre Chromium y scripting del navegador.

- Ideal para: scraping basado en Node, capturas de pantalla y tareas de automatización del navegador.

- Por qué destaca: control directo y potente del comportamiento de Chromium.

- A tener en cuenta: una historia de navegadores más limitada que Playwright y sigue consumiendo muchos recursos a escala.

- Modelo de precios: gratis y de código abierto.

20. Playwright

Playwright es mi recomendación por defecto para la automatización moderna del navegador si tu equipo escribe código y quiere una abstracción más nueva que Selenium.

- Ideal para: automatización moderna del navegador, sitios con mucho JS y equipos a los que les importa la ergonomía para desarrolladores.

- Por qué destaca: sólido soporte multi-navegador, comportamiento de espera fiable y APIs limpias.

- A tener en cuenta: sigues siendo responsable de la infraestructura del navegador, la concurrencia, la deriva de selectores y la validación de datos.

- Modelo de precios: gratis y de código abierto.

Mi lista corta por tipo de equipo

- Equipos de ventas y operaciones: empieza con Thunderbit y luego mira Browse AI si la monitorización importa más que el enriquecimiento de subpáginas.

- Analistas y equipos de investigación: Octoparse primero si los trabajos recurrentes son demasiado grandes para que las herramientas de extensión de navegador los manejen cómodamente.

- Equipos GTM muy centrados en automatización: Bardeen si el scraping es solo un paso dentro de un flujo más amplio.

- Equipos de desarrollo que construyen herramientas internas: Apify, Zyte, ScraperAPI o Playwright, según cuánta propiedad de la stack quieras asumir.

- Programas empresariales de datos: Bright Data, Oxylabs, Diffbot y Zyte son las conversaciones serias de infraestructura.

Cuándo bajar de nivel en la stack

Usa esta regla:

- Mantente con herramientas de IA hasta que topes con límites de repetibilidad o casos límite.

- Pasa a herramientas sin código cuando la programación, la paginación, el anti-bloqueo o las ejecuciones en la nube importen más que la simplicidad de un clic.

- Pasa a APIs cuando la tasa de desbloqueo, el renderizado JS y la concurrencia se conviertan en los verdaderos cuellos de botella.

- Pasa a bibliotecas de código abierto cuando el coste de la abstracción de un proveedor sea mayor que el de encargarte de toda la stack.

La mayoría de los equipos baja de nivel demasiado pronto. Ese es uno de los errores más comunes que veo.

Conclusión final

Para la mayoría de los equipos no técnicos, la respuesta correcta en 2026 no es “el scraper más potente”. Es la herramienta que consigue datos precisos en el siguiente flujo de trabajo con el menor mantenimiento posible. Por eso las herramientas first-party de IA siguen ganando para los operadores, mientras que las APIs y las stacks de código abierto siguen siendo una mejor opción para equipos técnicos con requisitos claros de escala.

Si quieres la ruta más corta desde una página hasta una salida estructurada, empieza con Thunderbit. Si ya sabes que tu trabajo necesita una infraestructura pesada, salta directamente a la capa API y a la capa de desarrolladores. Solo no confundas complejidad con sofisticación.

Preguntas frecuentes

1. ¿Cuál es la mejor herramienta de web scraping para usuarios no técnicos en 2026?

Para la mayoría de los usuarios no técnicos, herramientas first-party de IA como Thunderbit y Browse AI ofrecen la ruta más rápida hacia datos útiles porque reducen el trabajo con selectores, la fricción de configuración y la carga de mantenimiento.

2. ¿Qué debo elegir si mis sitios usan mucho JavaScript o bloquean solicitudes de forma agresiva?

Muévete hacia ScrapingBee, ScraperAPI, Zyte, Bright Data, Oxylabs, Playwright o Selenium según si quieres un servicio gestionado o control directo de ingeniería.

3. ¿Siguen siendo relevantes las herramientas sin código ahora que los raspadores web IA son mejores?

Sí. Las herramientas sin código como Octoparse y ParseHub siguen siendo importantes cuando necesitas más control explícito sobre la lógica de tareas, la ejecución en la nube y la gestión repetible de trabajos.

4. ¿Qué herramientas tienen más sentido para equipos de ingeniería?

Apify, Zyte, ScraperAPI, Scrapy, Playwright, Puppeteer y Selenium son las opciones más naturales cuando los desarrolladores son dueños del flujo de trabajo.

5. ¿Cómo puedo hacer una lista corta rápidamente en lugar de investigar demasiado?

Primero elige el tipo de herramienta, no el proveedor. Decide si necesitas simplicidad de IA, control sin código, infraestructura API o propiedad de código abierto. Luego compara productos dentro de esa capa.

Lecturas relacionadas