El 웹 스크래핑 ya no es solo cosa de unos pocos expertos: hoy es una herramienta esencial para cualquiera que trabaje en ventas, operaciones o investigación de mercados. Con la cantidad de datos en la web creciendo a un ritmo brutal—de hecho, la creación de datos a nivel mundial subió casi un —no sorprende que el ya vea los datos como el “corazón” de sus decisiones. Pero aquí viene el lío: el dice que lidiar con datos no estructurados (como HTML desordenado) es un dolor de cabeza. He visto a muchos equipos perder horas y horas copiando y pegando datos de páginas web a hojas de cálculo—créeme, es una pesadilla.

Aquí es donde BeautifulSoup de Python se vuelve tu mejor amigo. En este tutorial, te voy a mostrar cómo usar BeautifulSoup para 웹 스크래핑, con un ejemplo real en Python que puedes adaptar a lo que necesites en tu chamba. Y como siempre busco hacer las cosas más fáciles, también te enseño cómo combinar BeautifulSoup con , nuestro 웹 스크래퍼 con IA, para que tu flujo de trabajo sea más rápido y los datos salgan limpios y bien estructurados—no importa si eres novato o ya tienes callo programando.

¿Qué es BeautifulSoup y por qué usarlo para 웹 스크래핑?

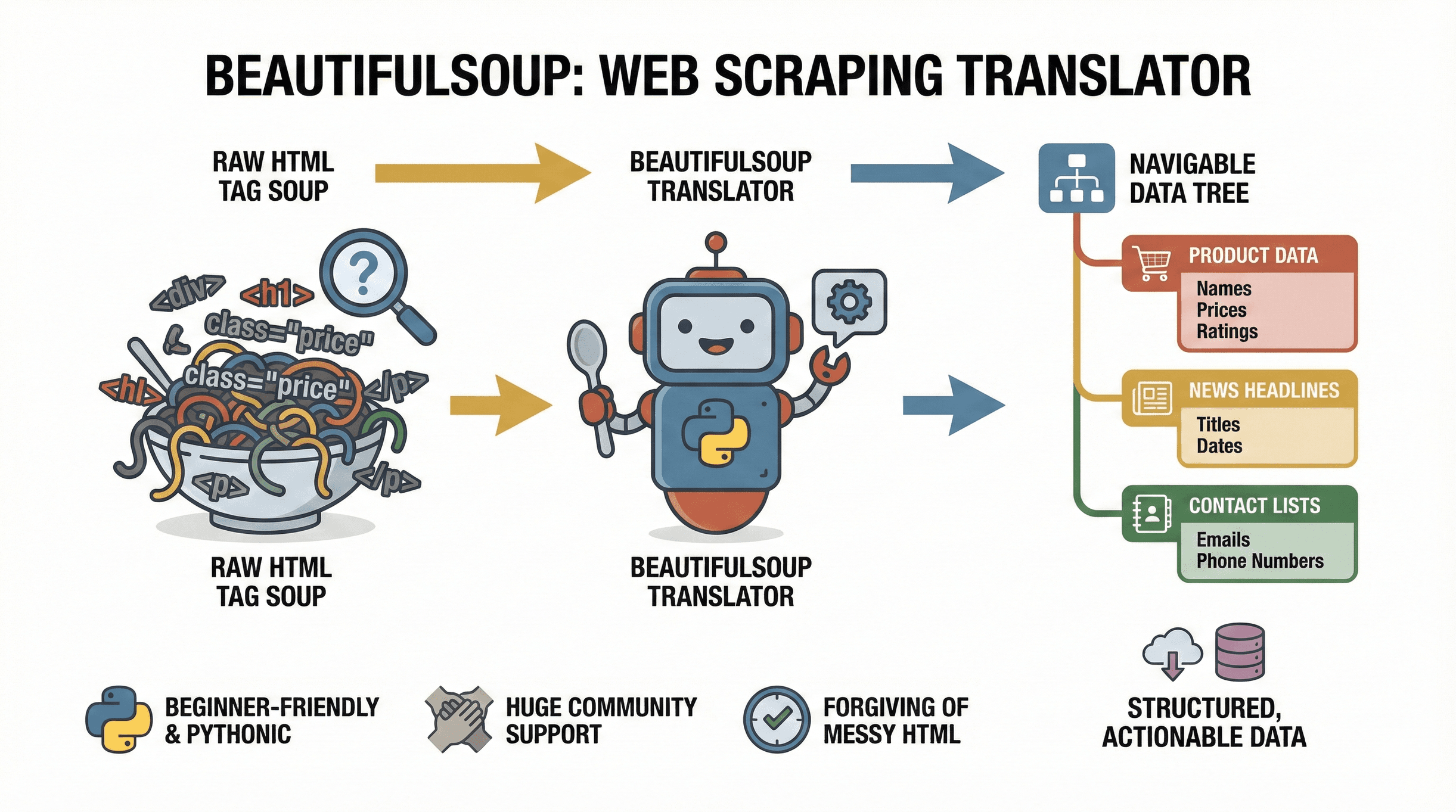

Vamos desde cero. es una librería de Python que te ayuda a analizar documentos HTML y XML. Imagínalo como un traductor: agarra el “sopa de etiquetas” de una web y la convierte en algo que puedes navegar, para que encuentres, extraigas y manipules los datos que te interesan. Ya sea que quieras sacar precios de productos de un e-commerce, juntar titulares de noticias o armar un directorio de empresas, BeautifulSoup es la herramienta ideal para convertir páginas web en datos útiles y ordenados.

Vamos desde cero. es una librería de Python que te ayuda a analizar documentos HTML y XML. Imagínalo como un traductor: agarra el “sopa de etiquetas” de una web y la convierte en algo que puedes navegar, para que encuentres, extraigas y manipules los datos que te interesan. Ya sea que quieras sacar precios de productos de un e-commerce, juntar titulares de noticias o armar un directorio de empresas, BeautifulSoup es la herramienta ideal para convertir páginas web en datos útiles y ordenados.

¿Y por qué es tan popular? Primero, porque es súper fácil de usar, incluso si apenas estás empezando. BeautifulSoup es muy tolerante con el HTML desordenado (y créeme, la web está llena de eso), y su sintaxis en Python te deja pasar de cero a extraer datos en unas cuantas líneas. Además, tiene una comunidad enorme y millones de descargas, así que si te atoras, seguro encuentras ayuda rápido.

Algunos usos típicos de BeautifulSoup:

- Sacar nombres de productos, precios y valoraciones de tiendas online

- Obtener titulares, autores y fechas de publicación de portales de noticias

- Analizar tablas o directorios (como listas de empresas o contactos)

- Recopilar correos o teléfonos de sitios de anuncios

- Monitorear cambios (precios, nuevas vacantes, etc.)

Si los datos que buscas están en HTML estático, BeautifulSoup es tu mejor aliado para el 웹 스크래핑.

Ventajas únicas de BeautifulSoup para 웹 스크래핑

Hay muchas librerías de Python para 웹 스크래핑, ¿por qué elegir BeautifulSoup? Así se compara con otras:

- Simplicidad: BeautifulSoup es ligero y fácil de aprender. No tienes que montar un framework ni escribir mucho código repetido. Perfecto para tareas rápidas o para quienes apenas empiezan.

- Tolerancia: Se lleva bien con HTML roto o mal hecho, algo más común de lo que crees.

- Flexibilidad: No te obliga a seguir una estructura rígida. Solo le das el HTML y extraes lo que quieras.

- Integración: BeautifulSoup se lleva de maravilla con otras librerías de Python como

requests(para bajar páginas),csv(para guardar datos) ypandas(para análisis).

¿Y frente a otras herramientas?

| Herramienta | Ideal para | Ventajas | Desventajas |

|---|---|---|---|

| BeautifulSoup | Análisis de HTML estático, principiantes | Sencillo, configuración rápida, tolerante, flexible | No apto para sitios con mucho JavaScript |

| Scrapy | Tareas a gran escala, asincrónicas | Potente, escalable, rastreo integrado | Curva de aprendizaje más alta, más configuración |

| Selenium | Contenido dinámico/JavaScript | Puede interactuar con JS, rellenar formularios, hacer clic | Más lento, pesado, consume más recursos |

Si apenas vas empezando o necesitas analizar páginas estáticas rápido, BeautifulSoup es el “cuchillo suizo” del 웹 스크래핑 (). Para sitios más complejos o dinámicos, puedes combinarlo con Selenium o Scrapy, pero BeautifulSoup es la mejor puerta de entrada.

Cómo preparar tu entorno Python para BeautifulSoup

¿Listo para arrancar? Así puedes dejar todo listo:

-

Instala Python: Descarga la última versión desde .

-

Crea un entorno virtual (opcional, pero recomendable):

1python -m venv venv 2source venv/bin/activate # En Windows: venv\Scripts\activate -

Instala BeautifulSoup y dependencias:

1pip install beautifulsoup4 requests lxml html5libbeautifulsoup4: La librería principalrequests: Para bajar páginas weblxmlohtml5lib: Analizadores HTML más rápidos y confiables

-

Tips para resolver broncas:

- Si te sale un error de “pip no encontrado”, prueba con

pip3opy -m pip. - En Mac/Linux, puede que necesites

sudopara permisos. - En Windows, checa que Python esté en tu PATH.

- Si te sale un error de “pip no encontrado”, prueba con

Para ver si todo jala, corre esta prueba rápida:

1from bs4 import BeautifulSoup

2import requests

3html = requests.get("http://example.com").text

4soup = BeautifulSoup(html, "html.parser")

5print(soup.title)Si ves <title>Example Domain</title>, ¡ya estás listo! ().

Ejemplo paso a paso de Beautiful Soup en Python

Vamos a lo práctico con un ejemplo real usando Python y BeautifulSoup. Imagina que quieres sacar los titulares más recientes de un sitio de noticias. Así lo harías:

1. Baja la página web

1import requests

2from bs4 import BeautifulSoup

3url = "https://www.bbc.com/news"

4response = requests.get(url)

5html = response.text2. Analiza el HTML

1soup = BeautifulSoup(html, "html.parser")3. Checa la estructura HTML

Abre las herramientas de desarrollador de tu navegador (clic derecho → Inspeccionar) y busca las etiquetas que tienen los titulares. En muchos sitios de noticias, los titulares están en etiquetas <h3> con clases específicas.

Por ejemplo, podrías ver:

1<h3 class="gs-c-promo-heading__title">Título del titular</h3>4. Extrae los datos

1headlines = soup.find_all("h3", class_="gs-c-promo-heading__title")

2for h in headlines:

3 print(h.get_text(strip=True))Esto te imprime todos los titulares de la página.

5. Guarda los datos en un CSV

Vamos a guardar esos titulares para analizarlos después:

1import csv

2with open("headlines.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.writer(file)

4 writer.writerow(["headline"])

5 for h in headlines:

6 writer.writerow([h.get_text(strip=True)])Ahora tienes un archivo CSV listo para Excel o Google Sheets.

Cómo entender la estructura HTML para extraer datos eficazmente

Antes de escribir código, siempre inspecciona el HTML de la página. Así lo puedes hacer:

- Abre las herramientas de desarrollador: Haz clic derecho en la página y selecciona “Inspeccionar”.

- Ubica los datos: Pasa el cursor sobre los elementos para ver qué etiquetas tienen la info que buscas (titulares, precios, autores, etc.).

- Anota etiquetas y clases: Busca identificadores únicos como

class="product-title"oid="main-content". - Prueba tus selectores: Usa los métodos

.find(),.find_all()o.select()de BeautifulSoup para apuntar a esos elementos.

Tip: Usa soup.prettify() para imprimir una versión bonita del HTML en tu consola de Python.

Extracción y estructuración de datos con BeautifulSoup

Supón que quieres sacar tanto títulos como autores de una página de blog:

1articles = soup.find_all("article")

2data = []

3for article in articles:

4 title = article.find("h2").get_text(strip=True)

5 author = article.find("span", class_="author").get_text(strip=True)

6 data.append({"title": title, "author": author})Ahora tienes una lista de diccionarios—perfecta para exportar a CSV o analizar después.

Puedes extraer enlaces, imágenes o cualquier atributo así:

1for link in soup.find_all("a"):

2 print(link.get("href"))O imágenes:

1for img in soup.find_all("img"):

2 print(img.get("src"))Guardar los datos extraídos: de Python a Excel o CSV

Una vez que tienes tus datos ordenados, exportarlos es pan comido. Así lo haces con el módulo csv:

1import csv

2with open("articles.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.DictWriter(file, fieldnames=["title", "author"])

4 writer.writeheader()

5 for row in data:

6 writer.writerow(row)O, si prefieres pandas:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv("articles.csv", index=False)

4df.to_excel("articles.xlsx", index=False)Siempre usa codificación UTF-8 para evitar broncas con caracteres raros, sobre todo si trabajas con datos internacionales.

Caso práctico: Extracción de datos de un sitio de noticias con BeautifulSoup

Vamos con un ejemplo práctico usando Python y BeautifulSoup: extraer títulos de artículos, autores y fechas de publicación de un sitio de noticias.

Supón que quieres sacar datos de :

1import requests

2from bs4 import BeautifulSoup

3import csv

4url = "https://edition.cnn.com/world"

5response = requests.get(url)

6soup = BeautifulSoup(response.content, "html.parser")

7articles = soup.find_all("article")

8data = []

9for article in articles:

10 title_tag = article.find("h3")

11 date_tag = article.find("span", class_="date")

12 author_tag = article.find("span", class_="author")

13 title = title_tag.get_text(strip=True) if title_tag else ""

14 date = date_tag.get_text(strip=True) if date_tag else ""

15 author = author_tag.get_text(strip=True) if author_tag else ""

16 data.append({"title": title, "date": date, "author": author})

17with open("cnn_articles.csv", "w", newline='', encoding="utf-8") as file:

18 writer = csv.DictWriter(file, fieldnames=["title", "date", "author"])

19 writer.writeheader()

20 for row in data:

21 writer.writerow(row)Este script te baja los artículos más recientes, saca el título, la fecha y el autor, y los guarda en un CSV. Puedes usar estos datos para monitorear a la competencia, analizar tendencias o investigar contenido, según lo que necesites.

Mejora tu flujo de trabajo: combina BeautifulSoup con Thunderbit

Ahora, veamos cómo hacer tu proceso de scraping aún más eficiente. es una extensión de Chrome para 웹 스크래핑 con IA que te facilita la vida. Con Thunderbit puedes:

- Usar “Sugerencia de campos por IA”: Thunderbit analiza la página y te sugiere automáticamente qué campos extraer—olvídate de buscar en el HTML o ajustar selectores.

- Extraer subpáginas: Thunderbit puede seguir enlaces a subpáginas (como fichas de productos o artículos) y enriquecer tu base de datos con más detalles.

- Exportar al instante: Manda tus datos directo a Excel, Google Sheets, Airtable o Notion con un solo clic.

- Gestionar paginación: Thunderbit puede sacar datos de varias páginas (incluyendo scroll infinito).

- Programar extracciones: Deja tareas recurrentes para tener tus datos siempre frescos.

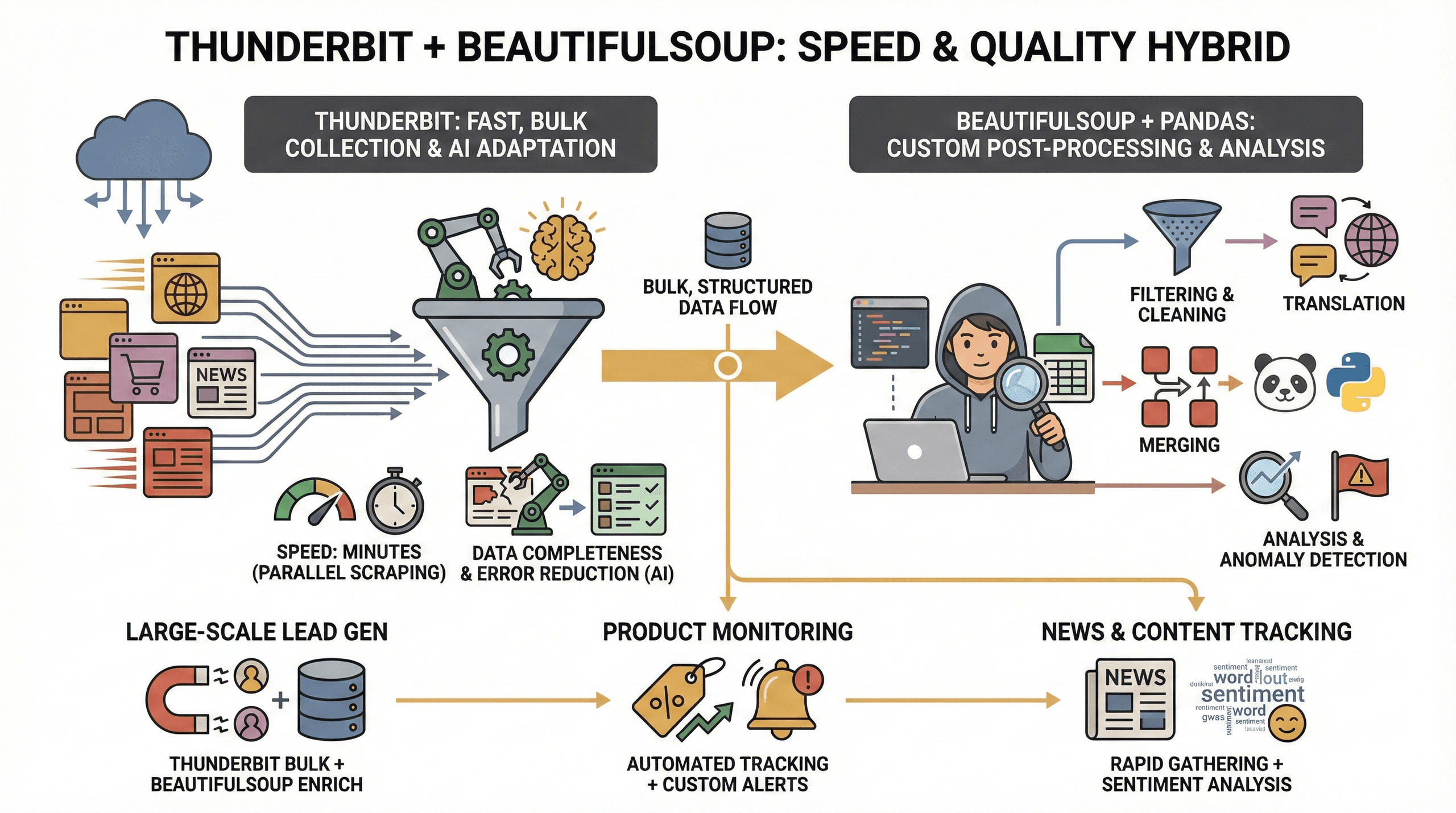

Así suelo combinar ambos:

- Empieza con Thunderbit: Abre el sitio que quieres, haz clic en el icono de Thunderbit y deja que la IA te sugiera los campos correctos (como título, autor, fecha).

- Exporta los datos: Descarga los resultados en CSV o mándalos a Google Sheets.

- Usa BeautifulSoup para procesamiento personalizado: Si necesitas análisis más avanzados (limpieza de texto, deduplicar, combinar con otras fuentes), carga el CSV exportado en Python y usa BeautifulSoup o pandas para el post-procesamiento.

Esta combinación te da lo mejor de los dos mundos: la velocidad y detección automática de campos de Thunderbit, junto con la flexibilidad de BeautifulSoup para lógica personalizada.

Velocidad y calidad de datos: ¿Por qué usar Thunderbit y BeautifulSoup juntos?

¿Por qué combinar ambas herramientas? Esto es lo que he visto en la práctica:

¿Por qué combinar ambas herramientas? Esto es lo que he visto en la práctica:

- Velocidad: Thunderbit puede extraer decenas de páginas al mismo tiempo (hasta 50 a la vez en modo nube), así que tienes tus datos en minutos, no horas.

- Datos completos: La IA de Thunderbit se adapta a cambios de diseño y puede sacar datos estructurados incluso de sitios complicados, así que no te pierdes nada.

- Menos errores: Olvídate de scripts rotos cuando cambian los nombres de clase—la IA de Thunderbit revisa la página cada vez.

- Procesamiento personalizado: Para necesidades avanzadas (filtrar, traducir, combinar datos), BeautifulSoup y pandas te dan el control total.

Este enfoque mixto es ideal para:

- Generación de leads a gran escala: Usa Thunderbit para sacar el grueso de los datos y BeautifulSoup para limpiarlos y enriquecerlos.

- Monitoreo de productos: Thunderbit se encarga del scraping repetitivo, mientras que BeautifulSoup te deja analizar tendencias o detectar anomalías.

- Seguimiento de noticias y contenido: Junta artículos rápido con Thunderbit y usa Python para análisis de sentimiento o extracción de palabras clave.

Solución de problemas comunes en 웹 스크래핑 con BeautifulSoup

El 웹 스크래핑 no siempre es fácil—estos son algunos problemas comunes y cómo los puedes resolver:

- Contenido dinámico: Si un sitio carga datos con JavaScript (scroll infinito, AJAX), BeautifulSoup solo no los ve. Usa Selenium o el modo navegador de Thunderbit para estos casos.

- Bloqueos anti-bots: Algunos sitios bloquean peticiones automáticas. Prueba usando un User-Agent personalizado, mete pausas entre peticiones o usa el scraping en la nube de Thunderbit para saltarte bloqueos sencillos.

- Cambios en la estructura HTML: Si tu script deja de funcionar, probablemente el HTML del sitio cambió. Inspecciona la página de nuevo y actualiza tus selectores. La IA de Thunderbit puede ayudarte adaptándose sola.

- Datos faltantes: Siempre checa si los elementos existen antes de llamar a

.get_text(). Usa.get()en vez de[]para atributos y evitar errores. - Problemas de codificación: Guarda los archivos con codificación UTF-8 para manejar caracteres especiales.

Y recuerda siempre respetar el robots.txt y los términos de uso del sitio. Haz scraping de forma ética—nadie quiere un robot maleducado.

Conclusión y puntos clave

El 웹 스크래핑 con BeautifulSoup es una de las habilidades más útiles en el mundo actual lleno de datos. Esto es lo que vimos en este tutorial de BeautifulSoup para 웹 스크래핑:

- BeautifulSoup es el punto de partida ideal para analizar HTML estático y extraer datos estructurados con Python.

- La configuración es súper sencilla—solo necesitas instalar Python, pip y un par de librerías.

- Inspeccionar el HTML es clave para apuntar a los datos correctos.

- Exportar a CSV/Excel hace que tus datos sean útiles al instante para análisis de negocio.

- Combinando con Thunderbit tienes detección automática de campos, scraping más rápido y exportaciones fáciles—perfecto para usuarios de negocio y quienes no programan.

- Flujos de trabajo mixtos (Thunderbit para extracción masiva, BeautifulSoup para procesamiento personalizado) te dan la mejor velocidad, calidad de datos y flexibilidad.

Si quieres llevar tu scraping al siguiente nivel, prueba ambas herramientas: experimenta con un script sencillo de BeautifulSoup y luego ve cuánto más rápido puedes ir con el . Y para más guías prácticas, visita el .

¡Feliz scraping! Que tus datos siempre sean limpios, ordenados y listos para usar.

Preguntas frecuentes

1. ¿Qué es BeautifulSoup y para qué se utiliza?

BeautifulSoup es una librería de Python para analizar documentos HTML y XML. Te ayuda a extraer datos de páginas web y convertirlos en formatos estructurados como listas o tablas, ideal para proyectos de 웹 스크래핑.

2. ¿Cómo se compara BeautifulSoup con Selenium y Scrapy?

BeautifulSoup es ligero y fácil de usar para páginas HTML estáticas. Selenium es mejor para sitios dinámicos con mucho JavaScript, mientras que Scrapy es un framework completo para scraping a gran escala y asincrónico. BeautifulSoup es la mejor opción para quienes empiezan y tareas rápidas.

3. ¿Puedo usar BeautifulSoup y Thunderbit juntos?

Claro. Thunderbit puede identificar y extraer campos de páginas web rápido usando IA, y puedes usar BeautifulSoup para procesamiento personalizado o análisis más profundo de los datos exportados.

4. ¿Cuáles son los retos más comunes al hacer 웹 스크래핑 con BeautifulSoup?

Algunos problemas comunes son manejar contenido dinámico, saltar bloqueos anti-bots y adaptarse a cambios en la estructura HTML. Usar las funciones de IA o el modo navegador de Thunderbit puede ayudarte a superar muchos de estos retos.

5. ¿Cómo exporto los datos extraídos con BeautifulSoup a Excel o CSV?

Puedes usar el módulo csv de Python o la librería pandas para guardar tus datos en archivos CSV o Excel. Usa siempre codificación UTF-8 para evitar problemas con caracteres especiales y asegurar compatibilidad con hojas de cálculo.

¿Listo para probarlo? Descarga la y empieza a extraer datos de forma más inteligente hoy mismo. Para más tutoriales y consejos, visita el .

Más información