La web rebosa de datos y, si te dedicas a los negocios, a la tecnología o simplemente eres curioso, seguro que alguna vez has querido extraer información de un sitio web en volumen, sin pasarte la tarde entera copiando y pegando. Y aquí viene lo sorprendente: para 2025, casi la mitad de todo el tráfico de Internet estará formada por bots que rastrean y extraen datos de la web, y más del 70% de las empresas digitales dependen de datos web públicos para la inteligencia de mercado y sus operaciones (). Pero aunque la necesidad de datos web se ha disparado, extraerlos de verdad puede ser, bueno, un poco pesado, sobre todo en los sitios dinámicos de hoy, impulsados por JavaScript.

Ahí es donde entra JavaScript. Como lenguaje de la web, JavaScript está especialmente preparado para manejar páginas dinámicas e interactivas que complican la vida a los raspadores tradicionales. Tanto si eres desarrollador y quieres automatizar investigaciones, como si trabajas en ventas y estás creando listas de leads, o simplemente te gusta trastear, esta guía te llevará por lo esencial para crear un raspador Web en JavaScript: desde los fundamentos hasta técnicas avanzadas, e incluso cómo saltarte el código por completo con herramientas de IA como .

Conceptos básicos de un raspador JavaScript: ¿qué es el web scraping con JavaScript?

Empecemos por lo básico. El web scraping es el proceso de extraer información de sitios web de forma automática. Imagina un asistente ultrarrápido que puede visitar cientos de páginas, copiar los datos que necesitas y ordenarlos en una hoja de cálculo limpia, sin quejarse jamás del túnel carpiano.

Un raspador JavaScript no es más que un raspador Web creado con JavaScript. Puedes ejecutar raspadores JavaScript de dos maneras principales:

- En el navegador: ejecutando scripts directamente en la consola del navegador o usando extensiones para capturar datos de la página que estás viendo.

- Del lado del servidor (Node.js): usando JavaScript fuera del navegador (gracias a Node.js) para solicitar páginas web, analizar su contenido y extraer datos de forma programática.

¿Por qué importa esto para usuarios de negocio? Porque el scraping impulsa desde la generación de leads (extraer contactos de directorios) hasta el seguimiento de precios (vigilar a la competencia) y la investigación de mercado (recopilar reseñas, noticias o tendencias). De hecho, el 48% de los usuarios de web scraping trabajan solo en comercio electrónico (). Si puedes verlo en tu navegador, probablemente un raspador JavaScript pueda extraértelo.

¿Por qué hacer web scraping con JavaScript? Ventajas clave para los sitios modernos

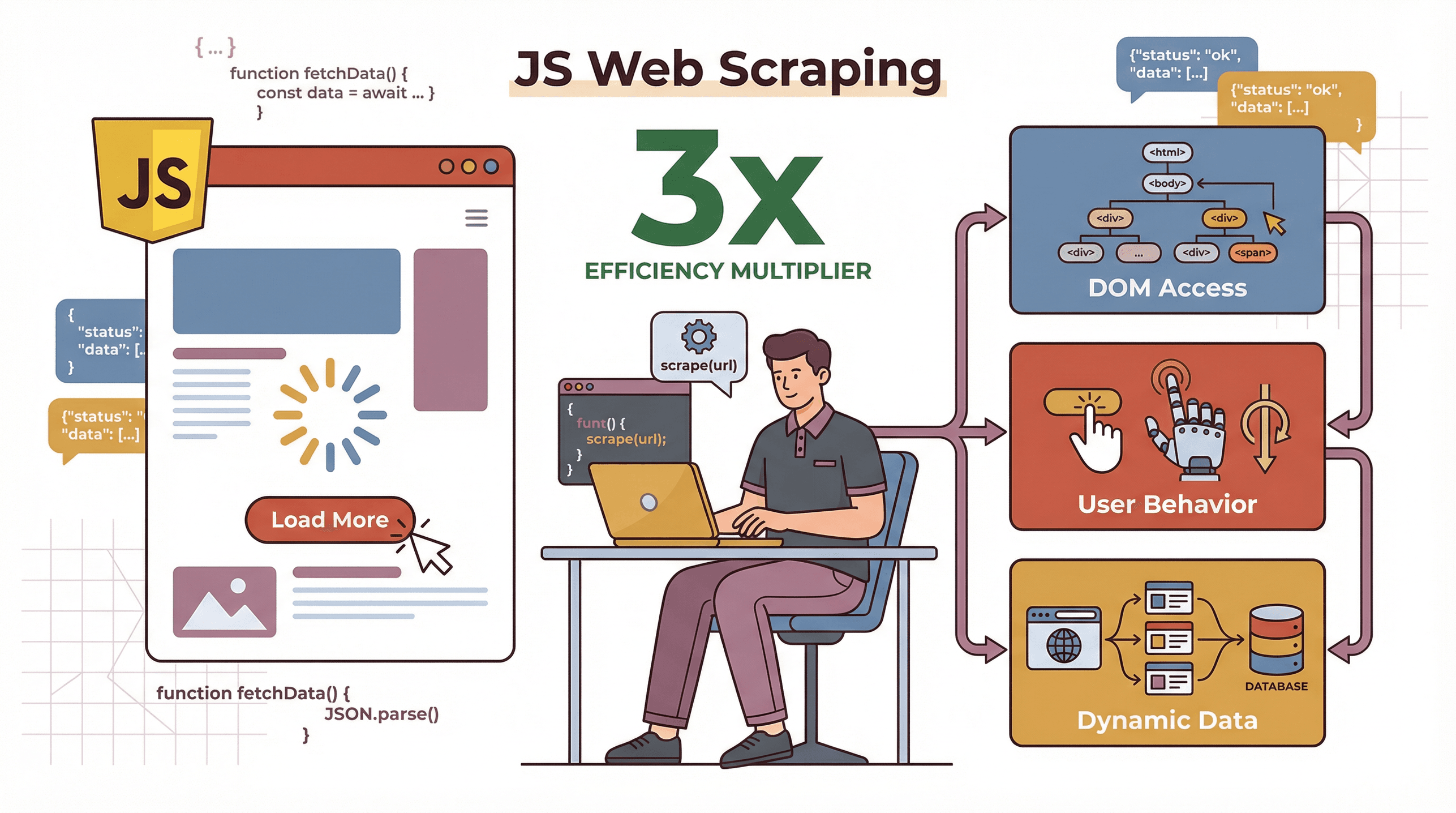

Entonces, ¿por qué usar JavaScript para extraer datos, especialmente cuando parece que Python se lleva casi toda la atención en los círculos de ciencia de datos? Aquí está la clave: los sitios modernos funcionan con JavaScript. Cargan contenido de forma dinámica, recuperan datos después de que la página se abre y, muchas veces, requieren interacción del usuario (como hacer clic en “Cargar más” o desplazarse). Los raspadores JavaScript pueden:

Entonces, ¿por qué usar JavaScript para extraer datos, especialmente cuando parece que Python se lleva casi toda la atención en los círculos de ciencia de datos? Aquí está la clave: los sitios modernos funcionan con JavaScript. Cargan contenido de forma dinámica, recuperan datos después de que la página se abre y, muchas veces, requieren interacción del usuario (como hacer clic en “Cargar más” o desplazarse). Los raspadores JavaScript pueden:

- Manejar contenido dinámico: como JavaScript es el lenguaje que se ejecuta en tu navegador, puede ver e interactuar con contenido que solo aparece después de que se ejecutan los scripts.

- Imitar el comportamiento real de un usuario: herramientas como Puppeteer te permiten automatizar clics, desplazamientos e incluso inicios de sesión, igual que una persona.

- Trabajar de forma nativa con el DOM: JavaScript puede acceder y manipular directamente la estructura de la página, lo que facilita extraer justo lo que necesitas.

¿Cómo se compara JavaScript con otros lenguajes? Aquí tienes una comparación rápida:

| Factor | JavaScript (Node.js) | Python | PHP |

|---|---|---|---|

| Contenido dinámico | Excelente: se ejecuta de forma nativa en el navegador, ideal para sitios con mucho JS | Necesita herramientas extra (Selenium/Playwright) | Limitado |

| Velocidad/concurrencia | Alta: modelo asíncrono, obtiene muchas páginas en paralelo | Buena, pero necesita asyncio/Scrapy para concurrencia | Más lento, menos común |

| Facilidad de uso | Intermedia: los desarrolladores web se sienten como en casa, pero el async puede complicar a principiantes | Más fácil para principiantes, con muchos tutoriales | Básico, menos flexible |

| Automatización del navegador | De primera clase (Puppeteer, Playwright) | Buena (Selenium, Playwright) | Rara |

| Ideal para | Sitios dinámicos, interactivos o SPA; flujos de trabajo de desarrollo web | Análisis de datos, sitios estáticos, scripts rápidos | Sitios estáticos simples |

Si tu sitio objetivo es una app de una sola página o carga datos al hacer scroll o clic, JavaScript suele ser la mejor herramienta para el trabajo ().

Configura tu primer raspador JavaScript: herramientas y entorno

¿Listo para ponerte manos a la obra? Así puedes montar un entorno básico de scraping en JavaScript, sin necesidad de frameworks.

-

Instala Node.js

Descarga e instala Node.js desde . Esto te permite ejecutar JavaScript fuera del navegador. -

Inicializa un proyecto

Abre la terminal y ejecuta:1mkdir my-scraper 2cd my-scraper 3npm init -y -

Instala las bibliotecas esenciales

Te conviene tener:- o

node-fetchpara solicitudes HTTP - para analizar HTML (piensa en jQuery para el servidor)

1npm install axios cheerio - o

-

Inspecciona tu sitio objetivo

Abre Chrome DevTools (clic derecho > Inspeccionar) y busca los elementos HTML que contienen tus datos. Anota sus clases, IDs o etiquetas.

Aquí tienes un script inicial sencillo:

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapePage(url) {

4 try {

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const pageTitle = $('head > title').text();

8 console.log("Título de la página:", pageTitle);

9 } catch (err) {

10 console.error("El scraping falló:", err);

11 }

12}

13scrapePage('https://example.com');Ejecuta node scrape.js y verás cómo se imprime el título de la página. Nada mal para tan pocas líneas de código.

Crear un raspador Web básico en JavaScript: guía paso a paso

Vamos a construir algo más útil. Imagina que quieres extraer títulos y precios de libros de , un sitio clásico para practicar.

Paso 1: inspecciona la página

Cada libro está dentro de un <article class="product_pod">. El título está en <h3><a title="Book Title"></a></h3>, y el precio en <p class="price_color">.

Paso 2: escribe el raspador

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapeBooks() {

4 const url = 'http://books.toscrape.com/';

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const books = [];

8 $('article.product_pod').each((i, elem) => {

9 const title = $(elem).find('h3 a').attr('title');

10 const price = $(elem).find('.price_color').text();

11 books.push({ title, price });

12 });

13 console.log(books);

14}

15scrapeBooks();Este script descarga la página, analiza el HTML, recorre cada libro y extrae el título y el precio. ¿El resultado? Un array ordenado de objetos libro:

1[

2 { "title": "A Light in the Attic", "price": "£51.77" },

3 { "title": "Tipping the Velvet", "price": "£53.74" }

4]Paso 3: amplíalo para paginación

¿Quieres extraer varias páginas? Busca el enlace “Siguiente” y recorre las páginas, actualizando la URL cada vez. Con un poco más de código, puedes extraer todo el sitio.

Ir más allá: manejar contenido dinámico e interacciones de usuario con JavaScript

Y ahora viene la parte divertida —y a veces frustrante—: el contenido dinámico. Muchos sitios modernos no muestran todos sus datos en el HTML inicial. En su lugar, los cargan con JavaScript después de que la página se abre, o te piden hacer clic en botones o desplazarte para ver más.

Cheerio y Axios no verán ese contenido: solo obtienen el HTML en bruto. Para extraer sitios dinámicos, necesitas un navegador sin interfaz como .

Usar Puppeteer para el rastreo avanzado de sitios web con JavaScript

Puppeteer te permite controlar Chrome (o Chromium) con código. Puedes:

- Abrir páginas

- Esperar a que carguen los elementos

- Hacer clic en botones, rellenar formularios, desplazarte

- Extraer contenido después de que se ejecuten todos los scripts

Aquí tienes un script sencillo con Puppeteer:

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com', { waitUntil: 'networkidle0' });

6 await page.waitForSelector('.dynamic-content');

7 const data = await page.evaluate(() => {

8 return Array.from(document.querySelectorAll('.dynamic-content'))

9 .map(el => el.textContent.trim());

10 });

11 console.log(data);

12 await browser.close();

13})();Incluso puedes automatizar inicios de sesión, hacer clic en botones de “Cargar más” o gestionar el desplazamiento infinito moviéndote por la página de forma programática y esperando a que aparezca contenido nuevo ().

Thunderbit: simplificar y potenciar el scraping en JavaScript

Seamos sinceros: escribir raspadores desde cero es potente, pero lleva tiempo, exige soltura técnica y requiere mantenimiento continuo. Por eso soy tan fan de , nuestra extensión de Chrome con IA que convierte el web scraping en algo de dos clics.

Thunderbit está pensado para usuarios de negocio: no hace falta programar. Así funciona:

- Sugerencia de campos con IA: haz clic en un botón y la IA de Thunderbit analiza la página y sugiere las mejores columnas para extraer (como “Nombre del producto”, “Precio”, “Email”, etc.).

- Scraping en 2 clics: revisa los campos sugeridos, pulsa “Extraer” y Thunderbit obtiene todos los datos, gestionando automáticamente la paginación y las subpáginas.

- Gestión de subpáginas y paginación: ¿necesitas más detalles? Thunderbit puede seguir enlaces a subpáginas (como detalles de productos o perfiles) y combinar esos datos en tu tabla.

- Modo nube o navegador: extrae en tu navegador (ideal para páginas con inicio de sesión) o usa la nube de Thunderbit para ir más rápido (hasta 50 páginas a la vez).

- Exportación estructurada y gratuita: exporta tus datos a Excel, Google Sheets, Airtable, Notion, CSV o JSON, siempre gratis, sin importar cuánto extraigas.

Thunderbit en acción: de la extracción de datos a la exportación

Supongamos que quieres extraer información de contacto de un directorio de empresas:

- Instala Thunderbit ().

- Abre la página del directorio.

- Haz clic en “Sugerir campos con IA”. La IA de Thunderbit propondrá columnas como “Nombre”, “Teléfono” y “Empresa”.

- Haz clic en “Extraer”. Thunderbit recopila todos los datos, incluso en varias páginas.

- Exporta a Sheets o Excel. Listo.

Lo que antes llevaba horas —o requería un desarrollador— ahora toma minutos. Y como Thunderbit usa IA, resiste mejor los cambios de diseño de los sitios: ya no tendrás scripts rotos cada vez que una web se actualiza ().

Así se compara el scraping tradicional en JavaScript con Thunderbit:

| Criterio | Raspador JS manual | JS avanzado (Puppeteer) | Raspador IA de Thunderbit |

|---|---|---|---|

| Habilidad necesaria | Programación | Programación avanzada | Ninguna (apuntar y hacer clic) |

| Contenido dinámico | Limitado | Excelente | Integrado |

| Tiempo de configuración | Horas por sitio | Horas o días | De segundos a minutos |

| Mantenimiento | Alto | Alto | Bajo (la IA se adapta) |

| Opciones de exportación | Código personalizado | Código personalizado | 1 clic a Excel/Sheets, etc. |

| Coste | Gratis (pero consume tiempo) | Gratis (hardware y tiempo) | Plan gratuito, luego desde 15 $/mes |

Técnicas avanzadas: scraping complejo con bibliotecas de JavaScript

A veces necesitas ir más allá: extraer datos detrás de inicios de sesión, gestionar desplazamiento infinito o sortear defensas anti-scraping.

A veces necesitas ir más allá: extraer datos detrás de inicios de sesión, gestionar desplazamiento infinito o sortear defensas anti-scraping.

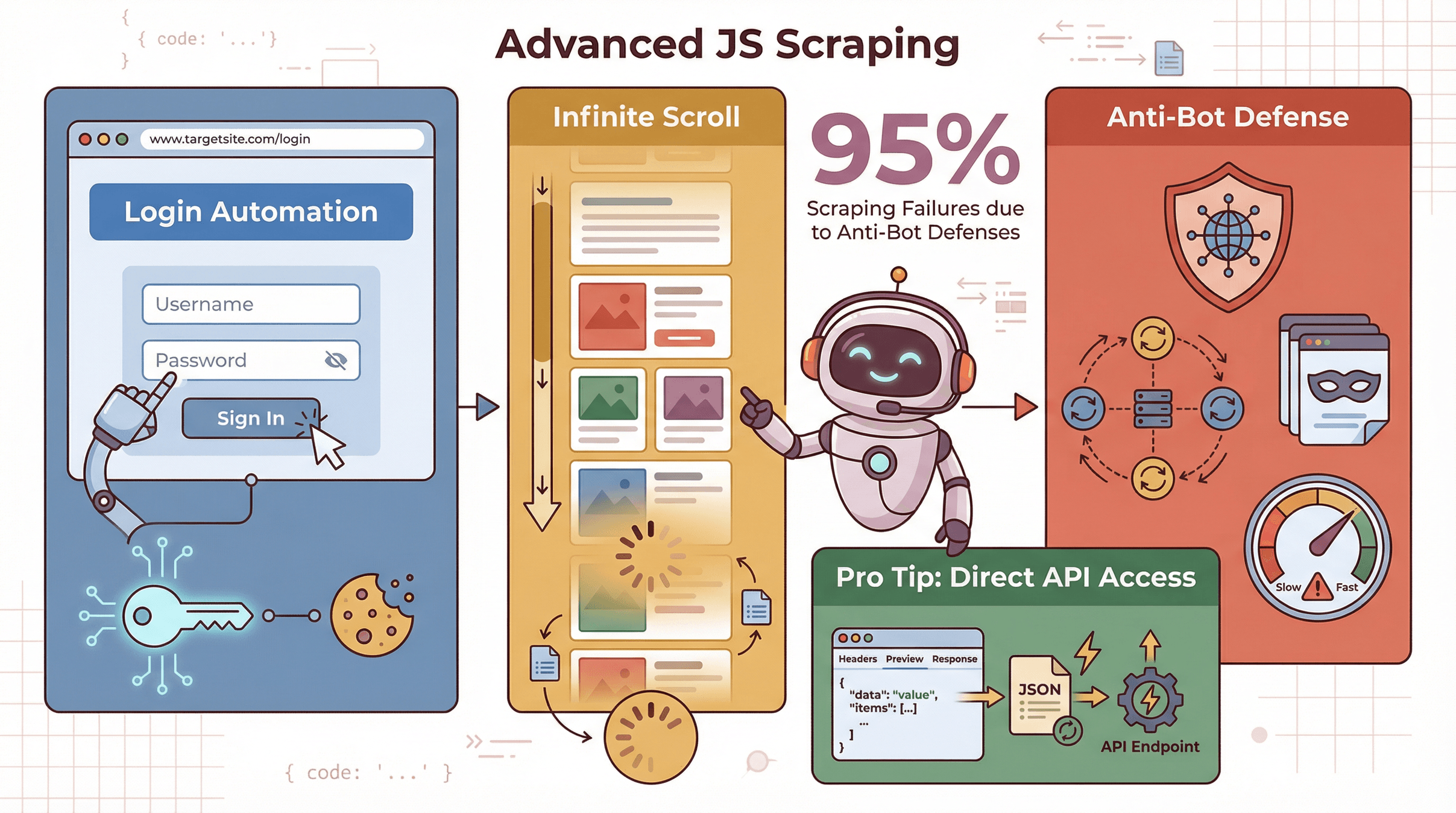

- Inicios de sesión/sesiones: con Puppeteer puedes automatizar el acceso rellenando formularios y haciendo clic en botones, y luego extraer datos como usuario autenticado.

- Desplazamiento infinito: desplázate por la página de forma programática, espera contenido nuevo y repite hasta que se cargue todo ().

- Medidas anti-scraping: usa proxies, rota agentes de usuario y limita la frecuencia de tus solicitudes para evitar bloqueos. Más del 95% de los fallos de scraping se deben a defensas anti-bot ().

Consejo profesional: a veces puedes saltarte el navegador por completo si encuentras los endpoints API ocultos del sitio (consulta la pestaña Network en DevTools). Si puedes obtener JSON directamente, tu raspador será mucho más rápido.

Optimizar y mantener tu rastreador web en JavaScript

Construir un raspador es solo la mitad del trabajo: la otra mitad es mantenerlo funcionando sin problemas.

- Procesamiento asíncrono: usa async/await y obtén páginas en paralelo, pero sin sobrecargar el servidor.

- Procesamiento por lotes: procesa los datos en bloques para evitar problemas de memoria.

- Manejo de errores: captura errores, reintenta las solicitudes fallidas y registra los problemas para depuración.

- Paginación: detecta enlaces o botones de “Siguiente” y recorre las páginas.

- Resistencia de los selectores: usa IDs o clases únicos; evita selectores frágiles que se rompan si cambia el diseño del sitio.

- Monitorización: configura alertas si tu raspador empieza a devolver datos vacíos o errores.

Mejor práctica: el scraping nunca es de “configúralo y olvídate”. Planifica actualizaciones y monitorización periódicas ().

Comparar soluciones de scraping en JavaScript: tradicional vs. Thunderbit

Aquí va una comparativa rápida para usuarios de negocio:

| Enfoque | Tiempo hasta obtener valor | Habilidad necesaria | Maneja contenido dinámico | Mantenimiento | Opciones de exportación | Escalabilidad |

|---|---|---|---|---|---|---|

| JS manual (Cheerio) | Lento | Programación | No | Alto | Lo programas tú | Bueno para estáticos |

| JS avanzado (Puppeteer) | Moderado | Programación+ | Sí | Alto | Lo programas tú | Más lento por página |

| Thunderbit | Rápido | Ninguna | Sí (con IA) | Bajo | 1 clic a Sheets/CSV | Nube o navegador |

Para la mayoría de los usuarios de negocio, Thunderbit es la forma más rápida de pasar de “necesito estos datos” a “aquí está mi hoja de cálculo”.

Conclusión y puntos clave

Crear un raspador Web en JavaScript es un superpoder en el mundo actual impulsado por los datos. Esto es lo que he aprendido —y lo que recomiendo—:

- Empieza por lo simple: usa Cheerio y Axios para sitios estáticos.

- Pasa a lo avanzado cuando haga falta: usa Puppeteer para sitios dinámicos, interactivos o que requieran inicio de sesión.

- Ahorra tiempo con herramientas de IA: para la mayoría de las necesidades de negocio, te permite saltarte el código y obtener resultados en minutos.

- Planifica el mantenimiento: los sitios cambian; tus raspadores deben estar preparados para adaptarse.

- Extrae siempre con ética: respeta los términos del sitio, no sobrecargues los servidores y usa los datos de forma responsable.

Si tienes curiosidad por probar el scraping sin dolores de cabeza, y comprueba lo fácil que puede ser. Y si quieres profundizar más, visita el para más guías, consejos y ejemplos del mundo real.

¡Feliz scraping y que tus selectores sean siempre únicos!

Preguntas frecuentes

1. ¿Qué es un raspador web en JavaScript?

Un raspador web en JavaScript es un programa (o script) escrito en JavaScript que extrae datos automáticamente de sitios web. Puede ejecutarse en el navegador o en el servidor (con Node.js), y es especialmente bueno para manejar sitios dinámicos con mucho JavaScript.

2. ¿Por qué elegir JavaScript en lugar de Python para hacer web scraping?

JavaScript es el lenguaje de la web, por lo que es ideal para extraer sitios que cargan contenido dinámicamente o requieren interacción del usuario. Python es excelente para sitios estáticos y análisis de datos, pero necesita herramientas extra para contenido dinámico.

3. ¿Qué herramientas necesito para crear un raspador JavaScript?

Para sitios estáticos: Node.js, Axios (o fetch) y Cheerio. Para sitios dinámicos: añade Puppeteer o Playwright para automatización de navegador sin interfaz. Para scraping sin código, prueba .

4. ¿Cómo simplifica Thunderbit el web scraping?

Thunderbit usa IA para detectar y extraer datos automáticamente de cualquier sitio web. Solo tienes que hacer clic en “Sugerir campos con IA”, luego en “Extraer” y exportar tus datos: sin programar ni pelearte con selectores.

5. ¿Es legal y ético hacer web scraping?

El web scraping es legal cuando se hace de forma responsable: extrae solo datos disponibles públicamente, respeta los términos del sitio y no sobrecargues los servidores. Evita extraer datos personales sin consentimiento y usa siempre los datos de forma ética.

¿Quieres ver el scraping en JavaScript en acción? Mira el para tutoriales o explora más en el .

Más información