Hay un dicho muy conocido en el mundo de los negocios: “Los datos son el nuevo petróleo”. Pero, seamos realistas: si todavía sigues copiando y pegando información a mano desde páginas web, es como intentar sacar petróleo con una cucharita. Hoy en día, donde los datos mandan, los equipos pueden llegar a gastar hasta solo buscando información, y un oficinista promedio hace . No es raro que muchos sintamos que nos ahogamos entre tareas repetitivas y manuales.

Por eso, aprender cómo hacer para extraer datos de una web con python puede ser un antes y un después para equipos de ventas, operaciones o investigación. Las herramientas de scraping en Python pueden convertir horas de trabajo manual en unas cuantas líneas de código—o, si prefieres evitar la programación, en unos pocos clics usando una herramienta con IA como . Seas novato o ya tengas experiencia con datos, aquí te cuento por qué, qué y cómo hacer scraping con Python (y cómo Thunderbit puede hacerte la vida mucho más fácil).

¿Por qué usar Python para extraer datos de páginas web?

Cuando hablamos de scraping web, Python es el lenguaje favorito, y no es casualidad. No solo es el más popular, sino que es el que organiza la fiesta, trae los snacks y se asegura de que todo salga bien.

¿Por qué Python es el rey?

- Fácil de aprender y usar: La sintaxis de Python es súper clara y amigable. No necesitas ser ingeniero para escribir un script que saque datos de la web.

- Ecosistema de librerías brutal: Python tiene librerías potentes como , , y . Cada una sirve para diferentes necesidades, desde analizar HTML estático hasta automatizar acciones en el navegador.

- Comunidad activa y documentación top: Si te atoras, seguro que alguien en Stack Overflow ya resolvió el problema. Las librerías de scraping en Python están súper bien documentadas y tienen una comunidad enorme.

- Flexibilidad e integración: Python se lleva bien con otras herramientas. Puedes combinarlo con plataformas de IA como para mejorar la extracción de datos, o usarlo para automatizar, programar y procesar la información extraída para análisis o machine learning.

Comparado con otros lenguajes como JavaScript o R, Python tiene una curva de aprendizaje mucho más suave y mejor soporte para scraping. Como dice un experto del sector: “Python es la navaja suiza del scraping web: versátil, confiable y siempre lista para cualquier reto”.

Lo básico: cómo hacer scraping de una web con Python

Vamos a ver el flujo básico para extraer datos de una web con Python. Ya sea que quieras sacar info de una sola página o recorrer todo un sitio, el proceso suele ser así:

| Paso | ¿Qué ocurre? | Ejemplo de librería Python |

|---|---|---|

| 1. Enviar solicitud web | Descarga el HTML de la página objetivo | requests.get() |

| 2. Analizar el HTML | Examina la estructura de la página | BeautifulSoup() |

| 3. Extraer los datos | Obtén la información que necesitas (ej: títulos, precios) | soup.find_all() |

| 4. Guardar/Exportar los datos | Almacena los resultados en CSV, Excel o base de datos | csv, pandas, o openpyxl |

¿Suena fácil? En la práctica, pueden aparecer retos: paginación, contenido dinámico o webs que cambian de diseño todo el tiempo. Ahí es donde herramientas como Thunderbit marcan la diferencia, ofreciendo scraping en “2 clics” y detección automática de campos con IA para que todo sea más sencillo.

Las librerías clave de Python para scraping web

El mundo Python está lleno de librerías para cada tipo de scraping. Aquí te resumo las más importantes:

BeautifulSoup: Análisis HTML rápido y sencillo

es perfecta para quienes empiezan. Ideal para analizar HTML estático y extraer datos sin complicaciones.

- Ventajas: Simple, intuitiva, ideal para proyectos pequeños.

- Limitaciones: No es la mejor para recorrer muchas páginas ni para webs con mucho JavaScript.

- Ejemplo de uso: Extraer listados de productos de una tienda online estática.

Scrapy: Potencia para scraping a gran escala

es la herramienta para scraping avanzado. Es un framework completo para recorrer muchas páginas, seguir enlaces y exportar datos a lo grande.

- Ventajas: Rápida, escalable, soporta flujos complejos (paginación, subpáginas).

- Limitaciones: Requiere más aprendizaje y configuración.

- Ejemplo de uso: Extraer todas las categorías y productos de un ecommerce grande.

Selenium: Para contenido dinámico e interacciones

es la opción para webs que dependen de JavaScript o requieren interacción (como iniciar sesión o hacer clic en botones).

- Ventajas: Automatiza navegadores, interactúa con contenido dinámico.

- Limitaciones: Más lenta y consume más recursos que otras opciones.

- Ejemplo de uso: Extraer datos detrás de muros de login o de paneles interactivos.

Requests: La base para descargar páginas web

es la librería básica para enviar solicitudes HTTP. Suele usarse junto a BeautifulSoup para tareas sencillas.

- Ventajas: Fácil de usar, gestiona cookies y sesiones.

- Limitaciones: No puede renderizar JavaScript.

- Ejemplo de uso: Descargar HTML para analizarlo con BeautifulSoup.

Lleva tu scraping al siguiente nivel: Thunderbit y Python juntos

Te cuento un secreto: aunque me encanta Python, no siempre quiero programar para cada tarea de scraping. Ahí entra : una extensión de Chrome que te deja extraer datos con IA y sin escribir ni una línea de código.

Thunderbit está pensado para usuarios de negocio que necesitan resultados rápidos. Con funciones como AI Suggest Fields, scraping de subpáginas y exportación instantánea a Excel o Google Sheets, es como tener un script de Python y un analista de datos en una sola herramienta.

Scraping en 2 clics con Thunderbit vs. programación manual en Python

Veamos la diferencia entre el método tradicional con Python y el enfoque de Thunderbit:

| Tarea | Con script en Python | Con Raspador Web IA de Thunderbit |

|---|---|---|

| Configurar entorno | Instalar Python, pip, librerías | Instalar extensión de Chrome |

| Inspeccionar estructura | Usar herramientas del navegador, escribir selectores | Clic en “AI Suggest Fields” |

| Escribir código de extracción | Programar y depurar el código en Python | Clic en “Scrape” |

| Gestionar paginación | Escribir bucles, manejar URLs | Activar “Paginación” en la interfaz |

| Exportar datos | Programar exportación a CSV/Excel | Clic en “Exportar a Sheets/Excel/Notion/Airtable” |

| Mantenimiento | Actualizar el código si la web cambia | La IA se adapta automáticamente |

Con Thunderbit, puedes extraer datos de casi cualquier web en solo dos clics—sin código, sin plantillas, sin líos. Para flujos más avanzados, puedes seguir usando Python para automatizar, programar o procesar los datos que te da Thunderbit.

Cómo conectar Thunderbit con scripts de Python

Aquí es donde la cosa se pone buena: puedes usar Python para controlar o programar tareas de scraping con Thunderbit. Por ejemplo, podrías:

- Lanzar Thunderbit en horarios programados (por ejemplo, para revisar precios cada día)

- Procesar y limpiar los datos exportados con pandas o scikit-learn

- Combinar los datos extraídos por Thunderbit con otras fuentes para análisis o machine learning

Este enfoque mixto te da lo mejor de los dos mundos: la rapidez y sencillez de Thunderbit, junto con la potencia y flexibilidad de Python para automatizaciones más avanzadas.

Guía paso a paso: cómo extraer datos de una web con Python

¿Listo para ponerte manos a la obra? Aquí tienes una guía sencilla para principiantes sobre cómo hacer scraping de una web con Python.

Paso 1: Prepara tu entorno de Python

Primero, asegúrate de tener Python instalado. Te recomiendo usar o para gestionar tu entorno.

1# Instala pip si no lo tienes

2python -m ensurepip --upgrade

3# Crea un entorno virtual (opcional, pero recomendable)

4python -m venv myenv

5source myenv/bin/activate # En Windows: myenv\Scripts\activate

6# Instala las librerías necesarias

7pip install requests beautifulsoup4 pandasPaso 2: Descarga el contenido de la página web

Utiliza la librería Requests para obtener el HTML de la página objetivo.

1import requests

2url = 'https://example.com/products'

3response = requests.get(url)

4if response.status_code == 200:

5 html = response.text

6else:

7 print("No se pudo obtener la página:", response.status_code)¿Problemas? Si te sale un error 403 o 404, revisa si la web bloquea bots o necesita cabeceras/cookies.

Paso 3: Analiza el HTML y extrae los datos

Ahora, usa BeautifulSoup para analizar el HTML y sacar lo que necesitas.

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3products = soup.find_all('div', class_='product-item')

4data = []

5for product in products:

6 name = product.find('h2').get_text(strip=True)

7 price = product.find('span', class_='price').get_text(strip=True)

8 data.append({'name': name, 'price': price})Tip: Usa la herramienta “Inspeccionar elemento” de tu navegador para encontrar las etiquetas y clases correctas.

Paso 4: Guarda y exporta tus datos

Exporta los resultados a un archivo CSV para compartirlos o analizarlos fácilmente.

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv('products.csv', index=False)O, si usas Thunderbit, simplemente haz clic en “Exportar a Google Sheets” o “Descargar como CSV”—sin necesidad de programar.

Más allá de lo básico: Automatiza y escala el scraping con Python y Thunderbit

Cuando ya domines lo esencial, puedes automatizar y escalar tus tareas de scraping:

- Gestionar paginación: En Python, recorre los números de página o enlaces “Siguiente”. En Thunderbit, activa la opción de paginación y deja que la IA lo haga por ti.

- Extraer subpáginas: Escribe código en Python para seguir enlaces, o usa el scraping de subpáginas de Thunderbit para enriquecer tu dataset automáticamente.

- Programar scraping: Usa la librería

schedulede Python o el programador integrado de Thunderbit para ejecutar extracciones periódicas (por ejemplo, monitorización diaria de precios). - Combinar fuentes de datos: Junta datos extraídos de varias webs para análisis más completos—ideal para seguimiento de competidores o estudios de mercado.

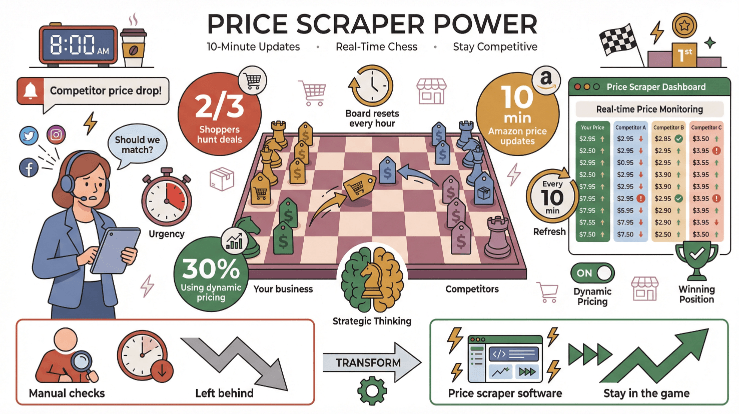

Ejemplo real: Un equipo de ecommerce usó Thunderbit para monitorear precios de la competencia en 10 webs, programando extracciones diarias y exportando los datos a Google Sheets para analizarlos al instante. ¿El resultado? y menos noches en vela con hojas de cálculo.

Ética y privacidad: cómo hacer scraping responsablemente con Python

Con gran poder de scraping viene una gran responsabilidad. Así puedes mantenerte dentro de la legalidad (y de tu conciencia):

- Respeta robots.txt y los Términos de Servicio: Revisa siempre si la web permite scraping. Si tienes dudas, pide permiso.

- Limita tus solicitudes: No sobrecargues los servidores—usa límites de velocidad y buenas prácticas.

- Evita datos personales: No extraigas información sensible o privada sin consentimiento. Cumple con leyes de privacidad como el RGPD.

- Identifica tu scraper: Configura un user-agent y sé transparente con tus intenciones.

- Respeta las solicitudes de exclusión: Si alguien pide que elimines sus datos, hazlo rápido.

Thunderbit te ayuda a cumplir estas normas limitando la velocidad de scraping, permitiendo scraping con login y ofreciendo funciones para limpiar y organizar los datos de forma responsable. Para más detalles, revisa .

De los datos en bruto a los insights: cómo aprovechar los datos extraídos para análisis y machine learning

El scraping es solo el primer paso. Con Python y Thunderbit, puedes:

- Limpiar y formatear los datos: Usa pandas para depurar tu dataset—elimina duplicados, corrige errores, estandariza formatos.

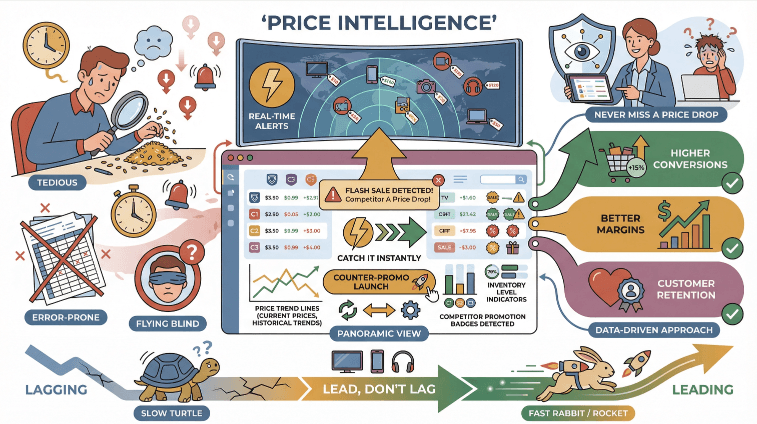

- Analizar tendencias: Haz seguimiento de precios de la competencia, analiza opiniones de clientes o detecta cambios en el mercado.

- Crear modelos de machine learning: Usa scikit-learn para entrenar modelos de análisis de sentimiento, predicción de precios o segmentación de clientes.

- Automatizar reportes: Genera paneles o alertas basados en datos web en tiempo real.

Ejemplo: Un equipo de producto extrajo miles de reseñas de clientes, limpió los datos con Python y usó la IA de Thunderbit para etiquetar el sentimiento. ¿El resultado? Insights accionables para mejorar el producto y las campañas de marketing.

Conclusión y puntos clave

En resumen:

- Python es el lenguaje ideal para scraping web por su sencillez, librerías potentes y comunidad activa.

- Thunderbit hace el scraping accesible para todos con herramientas sin código y funciones de IA que detectan campos y navegan subpáginas automáticamente.

- La combinación de Python y Thunderbit permite automatización avanzada—programa tareas, procesa datos e intégralos en tus flujos de trabajo.

- Haz scraping siempre de forma responsable: Respeta las políticas de los sitios, las leyes de privacidad y las normas éticas.

- Convierte los datos en bruto en valor para tu negocio: Usa la información extraída para análisis, reportes o machine learning.

¿Listo para llevar tus datos al siguiente nivel? Prueba a extraer datos de una web con Python—o, si prefieres evitar la programación, dale una oportunidad a la . Para más consejos y tutoriales, visita el .

Preguntas frecuentes

1. ¿Es legal hacer scraping web con Python?

El scraping es legal siempre que respetes los términos de uso del sitio, el archivo robots.txt y las leyes de privacidad de datos. Nunca extraigas información personal o sensible sin permiso.

2. ¿Cuál es la forma más fácil de extraer datos de una web si no sé programar?

tiene una extensión de Chrome con IA y sin código que te permite extraer datos de cualquier web en solo dos clics—sin necesidad de programar.

3. ¿Qué librería de Python debo usar para webs dinámicas?

Usa para sitios que requieren JavaScript o interacción del usuario. Para páginas estáticas, y suelen ser suficientes.

4. ¿Cómo puedo automatizar tareas de scraping web?

Puedes programar scripts de Python usando cron o librerías como schedule. Thunderbit también ofrece programación integrada para tareas recurrentes.

5. ¿Qué hago si una web cambia su diseño?

Los scripts tradicionales de Python pueden fallar si la web cambia. La IA de Thunderbit se adapta automáticamente, reduciendo el mantenimiento. Con Python, tendrás que actualizar los selectores o la lógica de análisis.

¡Feliz scraping! Que tus datos siempre estén limpios, ordenados y listos para usar.

Más información