Los datos son el motor que mueve cualquier negocio, pero seamos realistas: a veces gestionarlos es más enredo que ayuda. Para 2025, la cantidad y variedad de información que las empresas tienen que recolectar es brutal. Ya sea que estés haciendo encuestas rápidas a clientes, sacando precios de la competencia o armando una base de leads desde cero, el servicio correcto de recopilación de datos online puede convertir horas de trabajo manual en un par de clics y una hoja de cálculo lista para usar. Después de años metido en el mundo SaaS y la automatización, te puedo decir que la herramienta adecuada puede cambiar por completo un proyecto (¡y salvarte de un dolor de cabeza!).

Pero con tantas opciones—plataformas de encuestas, raspador web, creadores de formularios—¿cómo saber cuál elegir? Por eso armé esta guía con los 9 mejores servicios online de recopilación de datos para 2025, explicando en qué brilla cada uno, sus pros y contras, y cómo elegir el que más te conviene. Seas vendedor, investigador de mercado o simplemente estés harto de copiar y pegar, aquí seguro encuentras una solución que te va a servir.

¿Por qué los servicios online de recopilación de datos son clave para las empresas modernas?

Pongámonos en contexto: para 2025, el mundo va a generar unos de datos. Las empresas que saben aprovechar esta avalancha están viendo . Pero aquí está el truco: recolectar los datos correctos, en el momento justo y de las fuentes adecuadas es lo que separa a los que lideran del resto.

Los servicios online de recopilación de datos se han vuelto la base para tomar decisiones inteligentes. Automatizan tareas pesadas—recoger opiniones de clientes, extraer datos web, armar listas de leads—para que tu equipo se enfoque en analizar y actuar. Por ejemplo, los equipos de ventas usan raspador web para generar miles de leads al mes, mientras que los e-commerce monitorean precios y stock de la competencia en tiempo real. En el mundo de las encuestas, el confía en encuestas online para recoger feedback, y el usa esa info para lanzar nuevos productos.

¿La clave? Ya sea que recojas respuestas ordenadas o datos web caóticos, la herramienta correcta te ahorra horas, reduce errores y te da ventaja sobre la competencia.

Cómo seleccionamos los mejores servicios online de recopilación de datos

No todas las herramientas de recopilación de datos son iguales. Así elegí las 9 mejores:

- Automatización e IA: ¿Reduce el trabajo manual? ¿Permite programar tareas, sugerir campos con IA o adaptarse sola a los cambios?

- Facilidad de uso: ¿Es lo bastante intuitiva para quienes no son técnicos? Los constructores drag-and-drop y la ayuda de IA suman muchos puntos.

- Integración y exportación: ¿Permite exportar datos fácil a Excel, Google Sheets, Notion, Airtable o tu CRM?

- Escalabilidad y fiabilidad: ¿Aguanta miles de respuestas o filas sin trabarse? ¿Es robusta para necesidades de empresa?

- Precio y valor: ¿Tiene plan gratis para tareas pequeñas? ¿El precio sube de forma justa según lo que necesitas?

- Mejor caso de uso: Algunas son cracks en encuestas, otras en web scraping. Relacioné cada herramienta con el escenario donde más brilla.

También revisé opiniones reales, análisis de expertos y novedades recientes para asegurarme de que esta lista sea útil y actual.

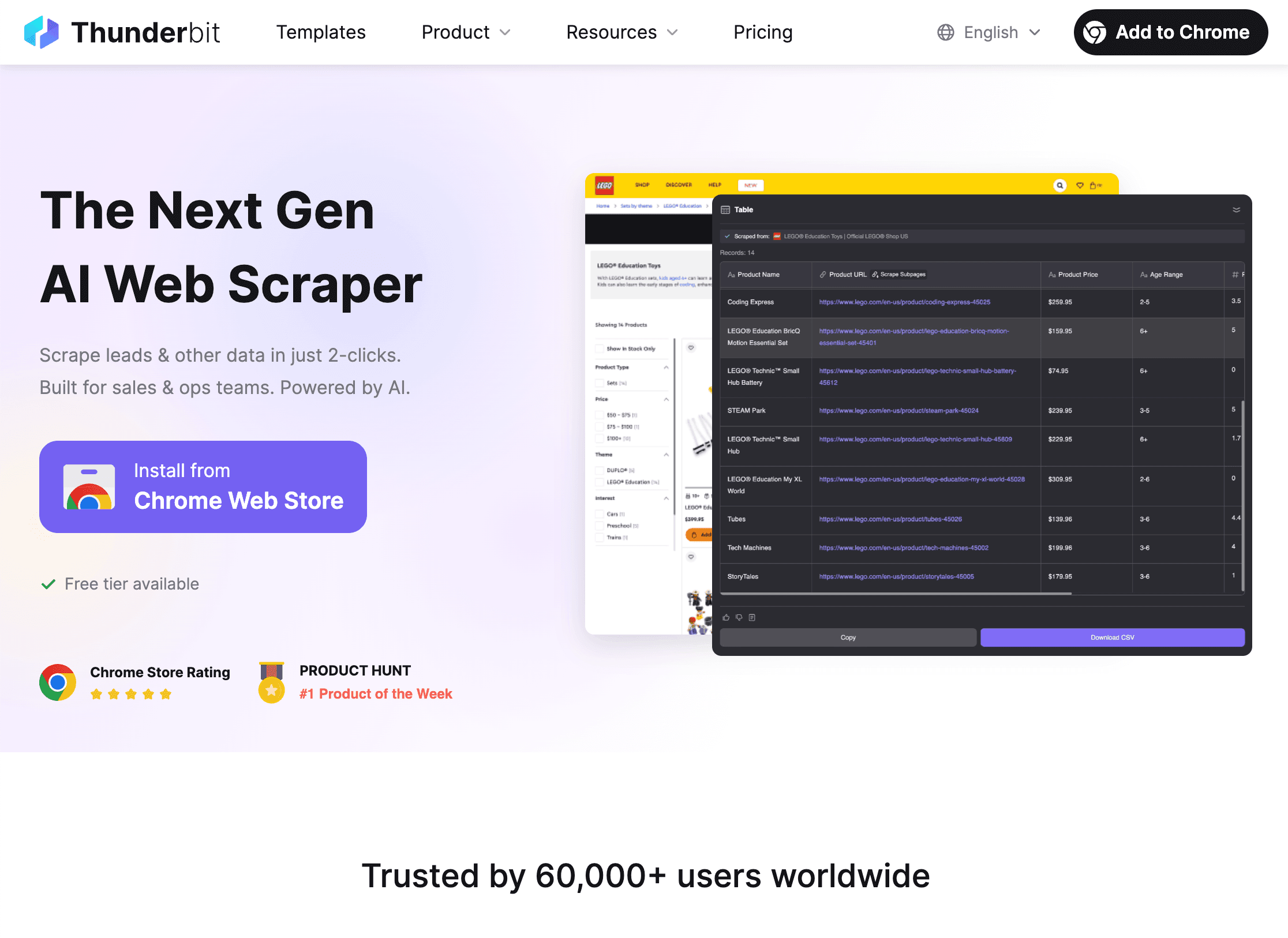

1. Thunderbit

es mi favorita para recolectar datos web, y va mucho más allá de los formularios básicos. Como , Thunderbit está pensado para usuarios de negocio que quieren extraer datos estructurados de cualquier web—sin programar, sin plantillas, sin líos.

es mi favorita para recolectar datos web, y va mucho más allá de los formularios básicos. Como , Thunderbit está pensado para usuarios de negocio que quieren extraer datos estructurados de cualquier web—sin programar, sin plantillas, sin líos.

Por qué Thunderbit destaca:

- Configuración guiada por IA: Solo haz clic en “Sugerir campos con IA” y Thunderbit analiza la página, te sugiere qué extraer y configura el raspador web por ti. Es como tener un asistente inteligente que entiende lo que buscas.

- Extracción en subpáginas y paginación: ¿Necesitas datos de páginas de detalle o de varias páginas? Thunderbit sigue enlaces, hace clic en “Siguiente” y junta todo en una sola tabla—automáticamente.

- Exportación instantánea: Exporta tus datos directo a Excel, Google Sheets, Airtable o Notion. Sin costos extra ni líos con CSV.

- Soporte para datos no estructurados: Thunderbit no solo sirve para tablas limpias—puede extraer emails, teléfonos, imágenes e incluso leer datos de PDFs o imágenes usando OCR.

- Programación y scraping en la nube: Programa tareas recurrentes (“extraer cada día a las 9am”) y deja que los servidores en la nube de Thunderbit hagan el trabajo pesado—hasta 50 páginas a la vez.

Ideal para: Generación de leads, monitoreo de competencia, operaciones e-commerce, investigación de mercado y cualquiera que necesite extraer datos de webs complejas o desordenadas.

Precio: Gratis hasta 6 páginas (o 10 con prueba), luego planes desde $15/mes para 500 filas. Todo incluido—sin bloqueos para exportar o usar IA.

Tip: Si ya no quieres copiar y pegar o lidiar con raspador web que fallan, el enfoque IA de Thunderbit es un respiro. Es especialmente útil para datos no estructurados o de nicho—como directorios, catálogos de productos o contactos en webs poco organizadas.

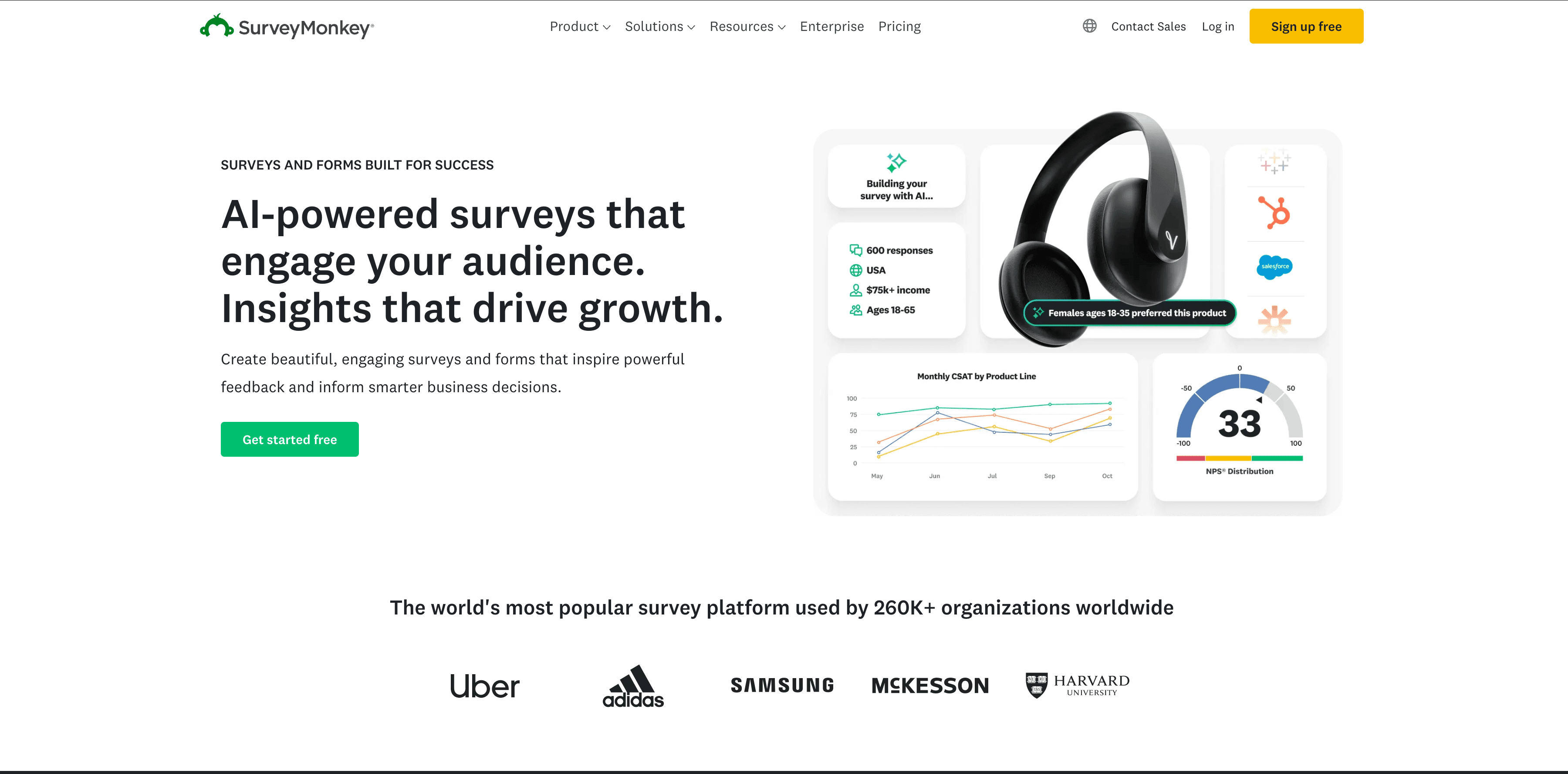

2. SurveyMonkey

es la plataforma clásica de encuestas online—confiable tanto para startups como para grandes empresas para recolectar feedback de clientes, empleados o mercados a gran escala.

es la plataforma clásica de encuestas online—confiable tanto para startups como para grandes empresas para recolectar feedback de clientes, empleados o mercados a gran escala.

Por qué SurveyMonkey destaca:

- Plantillas y generador IA: Más de 400 plantillas y un generador de preguntas con IA para lanzar encuestas pro en minutos.

- Lógica avanzada: Soporta saltos de pregunta, ramificaciones y hasta tests A/B para feedback más preciso.

- Distribución y panel de audiencia: Comparte por web, email, redes sociales o compra respuestas segmentadas del panel global de SurveyMonkey.

- Análisis e integraciones: Paneles en tiempo real, exportación a CSV/SPSS e integraciones con Salesforce, Mailchimp, Slack y más.

Ideal para: Encuestas de satisfacción, compromiso de empleados, estudios de mercado y cualquier situación donde necesites feedback profesional y escalable.

Precio: Plan gratis (10 preguntas, 25 respuestas por encuesta); planes de pago desde $25/mes. Algunas integraciones y funciones avanzadas requieren planes superiores.

Tip: El panel “Audience” de SurveyMonkey es ideal si no tienes tu propia base de contactos—puedes comprar respuestas de segmentos o regiones específicas.

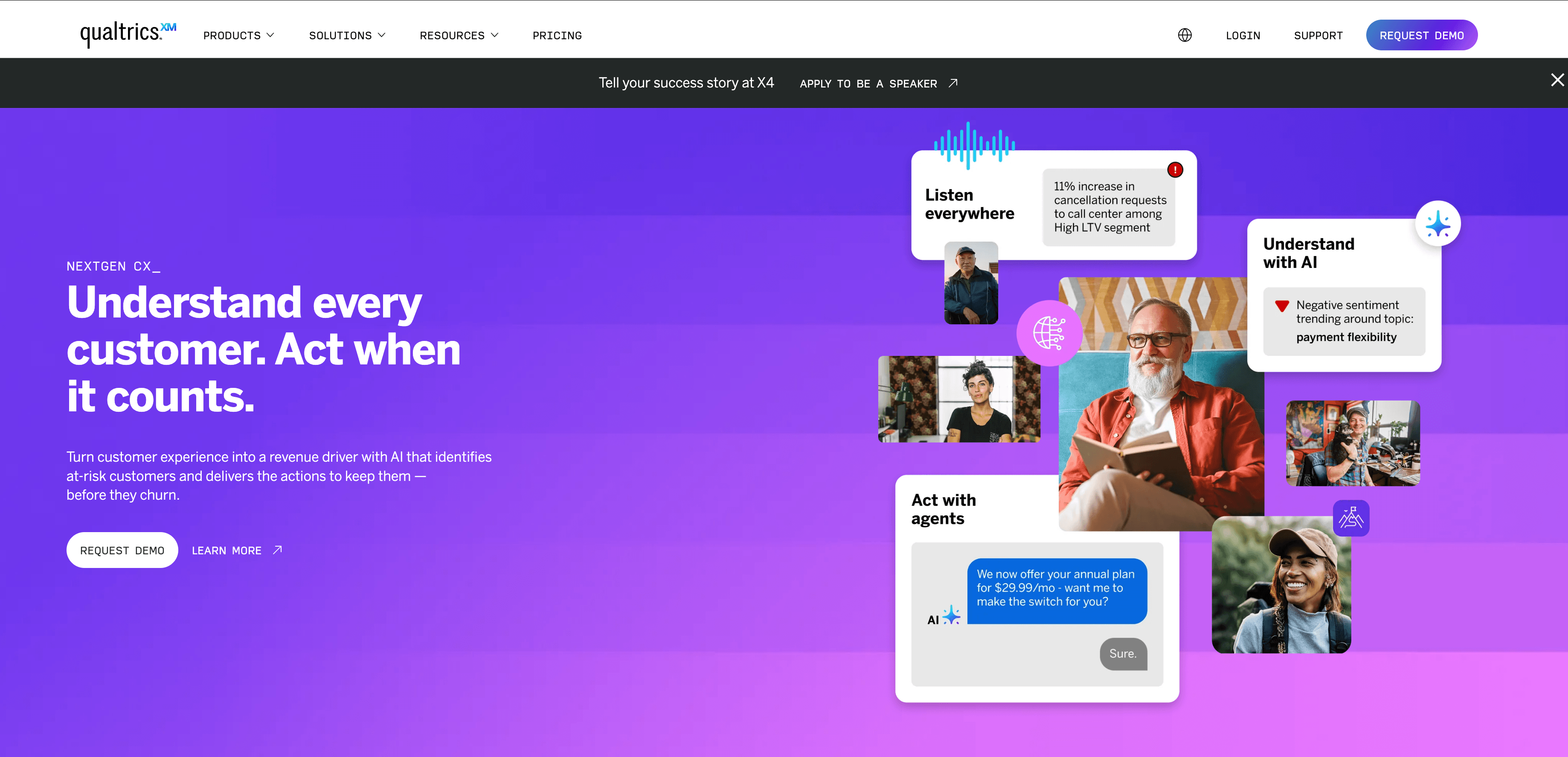

3. Qualtrics

es el referente para encuestas empresariales, gestión de experiencias y análisis avanzados.

es el referente para encuestas empresariales, gestión de experiencias y análisis avanzados.

Por qué Qualtrics destaca:

- Lógica de encuesta compleja: Ramificaciones dinámicas, datos embebidos, aleatorización y tipos de pregunta avanzados (conjoint, max-diff, etc.).

- Análisis con IA: Análisis de sentimiento integrado (Text iQ), analítica predictiva y Stats iQ para análisis estadístico avanzado—sin ser experto.

- Automatización de flujos: Acciones automáticas según respuestas (por ejemplo, crear un ticket si el NPS es bajo), integración con Salesforce, SAP y más.

- Seguridad y escalabilidad empresarial: Acceso por roles, cumplimiento normativo (GDPR, HIPAA) y soporte robusto.

Ideal para: Grandes empresas, universidades o equipos de investigación que gestionan programas de feedback complejos y de alto volumen.

Precio: Solo para empresas (presupuestos personalizados, normalmente decenas de miles al año).

Tip: Si necesitas insights de alto nivel, flujos personalizados o conectar encuestas directo con procesos de negocio, Qualtrics es el estándar de oro.

4. Google Forms

es la opción gratuita y sencilla para encuestas rápidas, sondeos o recopilación interna de datos.

es la opción gratuita y sencilla para encuestas rápidas, sondeos o recopilación interna de datos.

Por qué Google Forms destaca:

- Simplicidad: Constructor drag-and-drop, colaboración en tiempo real y vinculación instantánea con Google Sheets.

- Uso gratuito e ilimitado: Sin límites de formularios ni respuestas—ideal para equipos pequeños o proyectos internos.

- Integración: Se conecta fácil con Google Workspace (Sheets, Gmail) y puede ampliarse con Zapier o Google Apps Script.

Ideal para: Encuestas rápidas, confirmaciones de asistencia, sondeos internos o cualquier situación donde necesites un formulario en minutos.

Precio: Gratis para cualquier usuario de Google.

Tip: Aunque no es la más personalizable ni analítica, Google Forms es imbatible en rapidez y facilidad—perfecta para pymes o proyectos puntuales.

5. Typeform

es el referente en encuestas interactivas y atractivas—diseñadas para aumentar la tasa de respuesta con una experiencia conversacional, pregunta a pregunta.

es el referente en encuestas interactivas y atractivas—diseñadas para aumentar la tasa de respuesta con una experiencia conversacional, pregunta a pregunta.

Por qué Typeform destaca:

- Experiencia conversacional: Los formularios parecen un chat, no una tarea—logrando , el doble de la media del sector.

- Diseño y personalización: Plantillas atractivas, temas personalizables y fácil integración en tu web.

- Saltos lógicos y automatización: Constructor visual de lógica, automatización de flujos (envío de emails, sincronización con CRM) e integraciones con HubSpot, Slack y más.

Ideal para: Marketing, generación de leads, investigación de usuarios o cualquier situación donde la experiencia y la tasa de respuesta sean clave.

Precio: Plan gratis (10 respuestas/mes); planes de pago desde $25/mes.

Tip: Si tus formularios son atractivos, la gente los completa más. Typeform es mi elección para encuestas externas donde cada respuesta cuenta.

6. Zoho Survey

es la herramienta de encuestas integrada para quienes ya usan Zoho o buscan buenas funciones a precio asequible.

es la herramienta de encuestas integrada para quienes ya usan Zoho o buscan buenas funciones a precio asequible.

Por qué Zoho Survey destaca:

- Integración con Zoho: Conexión nativa con Zoho CRM, Campaigns, Analytics y más.

- Multilingüe y móvil: Soporta encuestas en varios idiomas y recopilación offline desde la app móvil.

- Automatización: Saltos lógicos, disparadores por email e integración de flujos (especialmente potente junto a otras apps de Zoho).

Ideal para: Pymes, especialmente si ya usan la suite de Zoho.

Precio: Plan gratis (100 respuestas/encuesta); planes de pago desde $8/mes (facturación anual).

Tip: Si ya usas Zoho CRM, Zoho Survey es la opción natural—cierra el ciclo entre feedback y datos de clientes.

7. JotForm

es el “cuchillo suizo” de los formularios online—ideal para encuestas, pedidos, registros y cobros.

es el “cuchillo suizo” de los formularios online—ideal para encuestas, pedidos, registros y cobros.

Por qué JotForm destaca:

- Constructor drag-and-drop: Más de 2,000 plantillas y una gran biblioteca de widgets (firma electrónica, calculadoras, subida de archivos, etc.).

- Lógica condicional y flujos: Muestra/oculta campos, emails automáticos, flujos de aprobación y campos calculados.

- Cobros integrados: Recibe pagos por PayPal, Stripe, Square y más—directo en el formulario.

- Integraciones: Más de 100 integraciones directas (Salesforce, Google Drive, Airtable, etc.), además de Zapier y API.

Ideal para: Pymes que necesitan formularios flexibles para registros, pedidos, encuestas o cualquier recopilación de datos más allá de preguntas y respuestas básicas.

Precio: Plan gratis (5 formularios, 100 envíos/mes); planes de pago desde $34/mes.

Tip: JotForm es perfecto si necesitas recolectar más que respuestas—piensa en inscripciones, pedidos o cualquier cosa que requiera cálculos o pagos.

8. QuestionPro

es una plataforma de encuestas avanzada, pensada para investigadores, equipos académicos y empresas que requieren tipos de preguntas y análisis complejos.

es una plataforma de encuestas avanzada, pensada para investigadores, equipos académicos y empresas que requieren tipos de preguntas y análisis complejos.

Por qué QuestionPro destaca:

- Tipos de pregunta avanzados: Soporta conjoint, max-diff, matrices y más—ideal para estudios de mercado.

- Lógica compleja: Ramificaciones detalladas, bucles y controles de calidad (por ejemplo, checks de atención, detección de fraude).

- Gestión de paneles: Crea y gestiona paneles de encuestados para investigaciones continuas.

- Integraciones: Google Sheets, Tableau, Salesforce, HubSpot y más (algunas requieren planes superiores).

Ideal para: Investigación de mercados, estudios académicos, programas de feedback a gran escala o cualquier situación que requiera funciones de encuesta de nivel profesional.

Precio: Versión básica gratis; planes de pago desde $85/usuario/mes para equipos.

Tip: Si buscas la potencia de Qualtrics sin el precio de empresa, QuestionPro es una gran alternativa—especialmente para equipos de investigación.

9. Alchemer

(antes SurveyGizmo) es la herramienta para empresas que buscan máxima flexibilidad, personalización y automatización de flujos—sin la complejidad de las grandes suites.

(antes SurveyGizmo) es la herramienta para empresas que buscan máxima flexibilidad, personalización y automatización de flujos—sin la complejidad de las grandes suites.

Por qué Alchemer destaca:

- Personalización extrema: Ramificaciones avanzadas, scripting, cuotas y branding personalizado (incluso HTML/CSS propio).

- Automatización de flujos: Más de 400 integraciones (CRM, bases de datos, helpdesks), ilimitadas en todos los planes, y triggers robustos (por ejemplo, crear tickets de soporte automáticamente desde respuestas).

- Funciones empresariales: Acceso por roles, SSO, alta seguridad y despliegue rápido (la mayoría de clientes lanzan en días, no meses).

- Rentable: Ofrece el 90% de la funcionalidad de Qualtrics a solo el 20% del precio.

Ideal para: Empresas o equipos que necesitan encuestas súper personalizadas, flujos de feedback complejos o integración profunda con sistemas de negocio.

Precio: Planes para equipos y empresas (precios medios, presupuestos personalizados, mucho más asequible que Qualtrics).

Tip: Si quieres que la plataforma de encuestas se adapte a tu negocio—y no al revés—Alchemer es tu mejor opción.

Tabla comparativa rápida: Servicios online de recopilación de datos

| Servicio | Ideal para | Automatización e IA | Integraciones | Precio inicial | Punto fuerte |

|---|---|---|---|---|---|

| Thunderbit | Web scraping, leads, e-commerce | IA guiada, subpáginas/paginación, programación | Excel, Sheets, Airtable, Notion | Gratis, $15/mes | raspador web IA más fácil, configuración en 2 clics, datos no estructurados |

| SurveyMonkey | Feedback clientes/empleados, investigación | Generador IA, lógica de salto, A/B | Salesforce, Mailchimp, Slack, más | Gratis, $25/mes | 400+ plantillas, compra respuestas en panel Audience |

| Qualtrics | Investigación empresarial, CX/EX | Lógica avanzada, Text iQ, flujos | SAP, Salesforce, BI, APIs | $$$ (personalizado) | Analítica avanzada, automatización, escala empresarial |

| Google Forms | Encuestas rápidas, formularios internos | Lógica básica, vinculación a Sheets | Google Workspace, Zapier | Gratis | Totalmente gratis, configuración instantánea, respuestas ilimitadas |

| Typeform | Engagement, marketing, generación de leads | UI conversacional, saltos lógicos, flujos | HubSpot, Slack, Zapier, webhooks | Gratis, $25/mes | 47% tasa de finalización, diseño atractivo |

| Zoho Survey | Pymes, usuarios Zoho, multi-idioma | Lógica de salto, triggers email, app móvil | Zoho CRM, Analytics, Zapier, API | Gratis, $8/mes | Integración nativa con Zoho, asequible para pymes |

| JotForm | Formularios flexibles, pedidos, registros | Lógica condicional, emails auto, pagos | 100+ apps, Salesforce, Drive, API | Gratis, $34/mes | 2,000+ plantillas, widgets, pagos y firma electrónica |

| QuestionPro | Investigación de mercado, académico, gran escala | Conjoint, ramificación, paneles, QA | Sheets, Tableau, Salesforce, API | Gratis, $85/mes | Funciones de investigación, gestión de paneles |

| Alchemer | Flujos personalizados, feedback empresarial | Lógica avanzada, scripting, triggers | 400+ (CRM, BD, helpdesk), API | $$ (personalizado) | Máxima flexibilidad, integraciones ilimitadas, despliegue rápido |

¿Cómo elegir el mejor servicio de recopilación de datos para tu empresa?

Entonces, ¿cuál te conviene? Así lo resumiría:

- ¿Necesitas extraer datos web complejos, automatizar leads o monitorear la competencia? Elige . Su configuración guiada por IA y exportaciones instantáneas lo hacen la opción más sencilla para web scraping en 2025.

- ¿Vas a hacer encuestas internas rápidas o recopilar feedback básico? es gratis, rápido y suficiente para necesidades simples.

- ¿Quieres maximizar la tasa de respuesta y sorprender a tus usuarios? es el rey de los formularios conversacionales y atractivos.

- ¿Ya usas Zoho para CRM u operaciones? se integrará perfecto en tu flujo de trabajo.

- ¿Necesitas analítica avanzada, ramificaciones o feedback a escala empresarial? , o son tus mejores opciones—elige según tu presupuesto e integraciones.

- ¿Buscas formularios flexibles para pedidos, registros o cobros? es el creador más versátil todo en uno.

- ¿Quieres una plataforma de encuestas confiable y versátil? sigue siendo la opción más usada para la mayoría de necesidades de feedback.

Tip: Empieza con una prueba gratis o plan básico, haz un piloto pequeño y ve cuál se adapta mejor a tu equipo y flujo de trabajo. No te dejes llevar por funciones que nunca vas a usar—elige la herramienta más simple que cubra tus necesidades y se integre con tu stack actual.

Recuerda: el verdadero valor no está solo en recolectar datos, sino en convertirlos en acción. La mejor herramienta es la que te ayuda a cerrar el ciclo—analizar, compartir y tomar mejores decisiones.

Preguntas frecuentes

1. ¿Cuál es la diferencia entre un raspador web y una plataforma de encuestas?

Un raspador web (como Thunderbit) extrae automáticamente datos de sitios web—ideal para recolectar información de productos, precios o contactos. Las plataformas de encuestas (como SurveyMonkey o Typeform) están pensadas para recoger feedback estructurado de personas mediante formularios o cuestionarios.

2. ¿Qué herramienta es mejor para recolectar feedback de clientes?

Para encuestas rápidas y sencillas, Google Forms o SurveyMonkey funcionan bien. Para análisis avanzados o feedback a gran escala, Qualtrics o Alchemer son más adecuadas.

3. ¿Puedo exportar datos directo a Excel o Google Sheets con estas herramientas?

Sí—Thunderbit, SurveyMonkey, Google Forms, Zoho Survey, JotForm y otras permiten exportar directo a Excel, Sheets o mediante integraciones.

4. ¿Existen opciones gratis para recolectar datos online?

Claro. Google Forms, los planes gratis de SurveyMonkey, Zoho Survey, JotForm y Thunderbit te dejan empezar sin costo, aunque los planes de pago desbloquean más funciones y límites superiores.

5. ¿Cómo elijo el mejor servicio de recopilación de datos online para mi empresa?

Empieza definiendo tu caso de uso principal (web scraping, encuestas, formularios, etc.), tus necesidades de integración y tu presupuesto. Prueba varias herramientas con un proyecto pequeño y elige la que sea más fácil para tu equipo y se adapte a tu flujo de trabajo.

¿Listo para potenciar tu recopilación de datos en 2025? para probar el web scraping con IA, o explora más consejos y guías en el . ¡Que la caza de datos te sea leve!