La web rebosa de datos, y en 2026 los proyectos de web scraping se han convertido en la salsa secreta de todo: desde la analítica empresarial hasta la detección de tendencias y los avances en investigación. He visto de primera mano cómo los proyectos de web scraping en Python han pasado de ser “extras deseables” a motores estratégicos para la innovación. Tanto si eres científico de datos, desarrollador o simplemente un curioso que trastea con proyectos, la idea adecuada (y la herramienta correcta) puede desbloquear información que, de otro modo, seguiría enterrada en el heno digital. ¿Y lo mejor? Con soluciones impulsadas por IA como , incluso las tareas de scraping más complejas ya están al alcance de la mano: no hace falta un doctorado en regex.

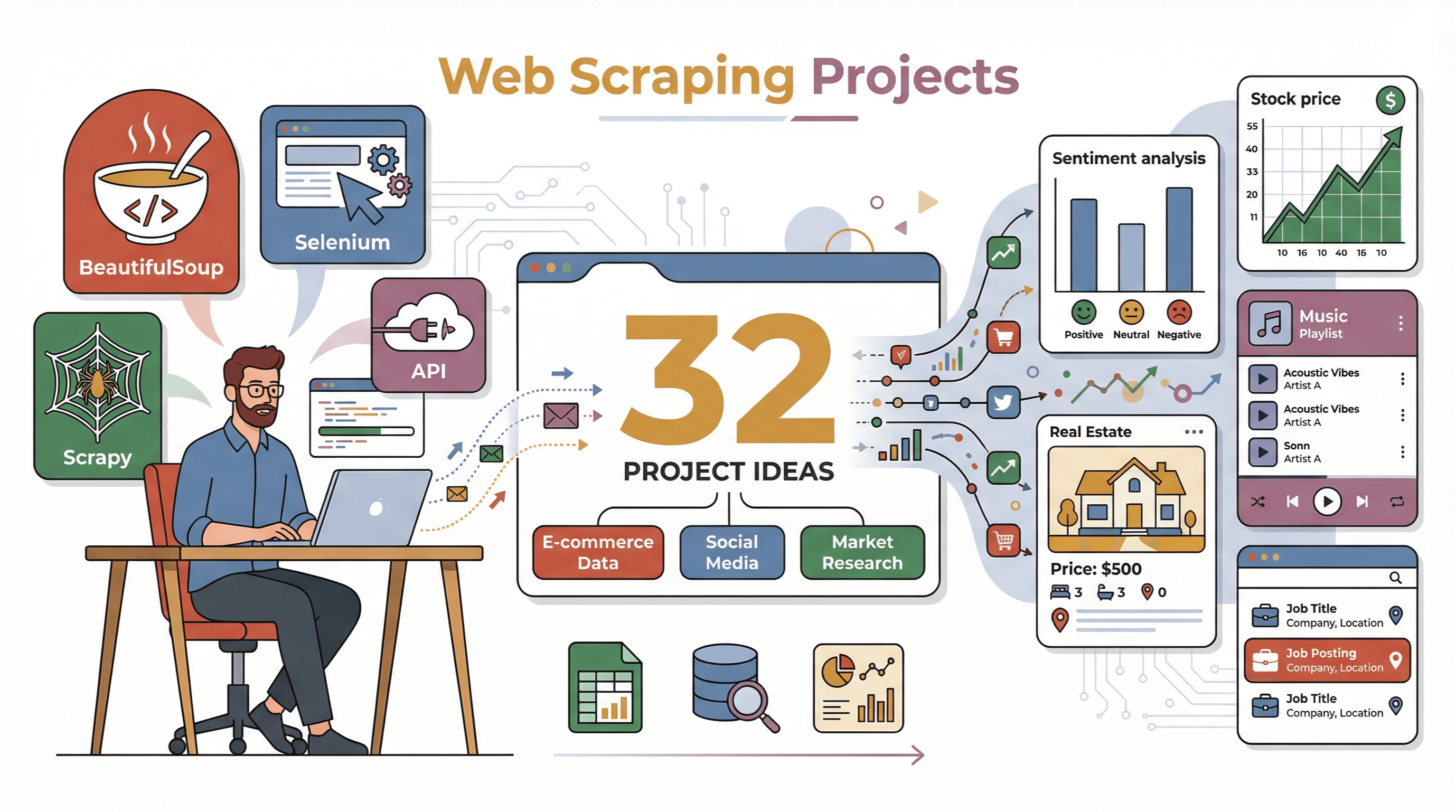

¿Listo para llevar tus habilidades al siguiente nivel y construir algo que de verdad marque la diferencia? He reunido 32 ideas creativas, avanzadas y prácticas de proyectos de web scraping en Python, cada una vinculada a las mejores herramientas (de BeautifulSoup a Scrapy y Thunderbit), con consejos sobre complejidad, automatización e impacto real. Vamos a ello y veamos hasta dónde puede llegar tu próximo proyecto orientado a datos.

Por qué los proyectos de web scraping en Python son esenciales para la innovación basada en datos

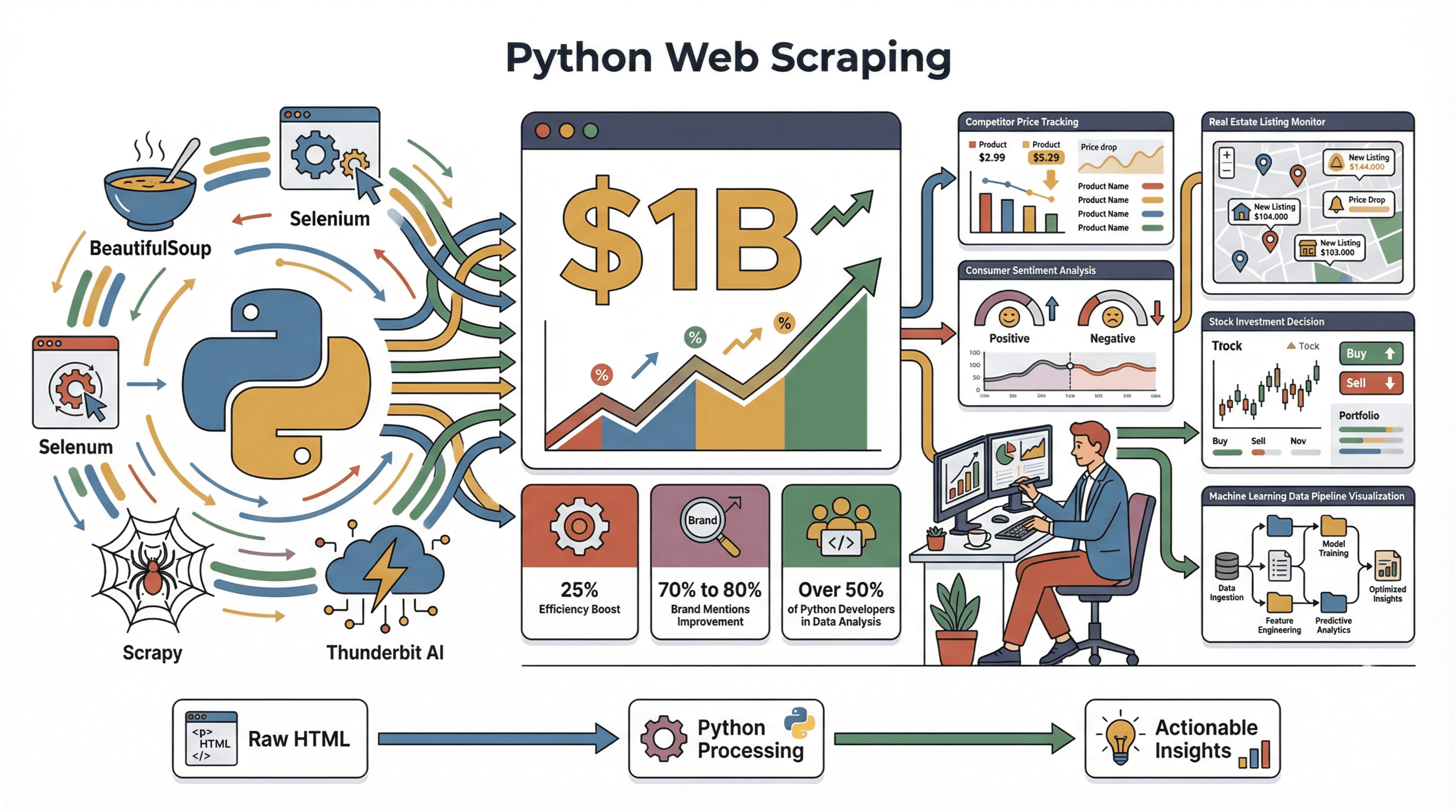

El web scraping se ha disparado hasta convertirse en una industria de 1.000 millones de dólares en 2026, y no deja de crecer (). Las empresas están usando pipelines de scraping para seguir los precios de la competencia, vigilar cambios en el sentimiento del consumidor e incluso automatizar decisiones de inversión. Un estudio encontró que el scraping de datos financieros en tiempo real mejoró en un 25% la eficiencia de las decisiones de inversión (). Mientras tanto, las marcas que analizan activamente reseñas en línea y redes sociales han visto cómo las menciones positivas suben del 70% al 80% en cinco años ().

Python es el lenguaje de referencia para estos proyectos, y es fácil ver por qué. Más de la mitad de los desarrolladores de Python en 2026 dicen trabajar en análisis y procesamiento de datos (), y su ecosistema —BeautifulSoup, Selenium, Scrapy y, ahora, herramientas impulsadas por IA como — hace facilísimo pasar de HTML en bruto a insights accionables. Ya sea que estés extrayendo reseñas de productos para análisis de sentimiento, haciendo seguimiento de anuncios inmobiliarios o creando un dataset personalizado para machine learning, los proyectos de web scraping en Python son la base de la innovación moderna basada en datos.

Cómo elegir la idea de proyecto de web scraping adecuada

Con tantas posibilidades, ¿cómo eliges un proyecto que merezca tu tiempo? Este es mi marco:

- Empieza por tu objetivo: ¿Qué decisión o proceso va a informar estos datos? Si buscas inteligencia competitiva, extrae precios o líneas de producto de la competencia. Si quieres insights de clientes, mira reseñas o redes sociales.

- Comprueba la disponibilidad de los datos: ¿Los datos son públicos, están detrás de un inicio de sesión o disponibles mediante una API? Los sitios públicos y estáticos son más fáciles; los dinámicos o protegidos requieren herramientas más avanzadas.

- Adapta la herramienta a la tarea: Para páginas estáticas, BeautifulSoup va genial. Para contenido dinámico, puede que necesites Selenium o Playwright. Para datos complejos o de varios formatos (como PDFs o imágenes), herramientas con IA como pueden ahorrarte horas.

- Piensa en escalabilidad y automatización: ¿Vas a ejecutar este proyecto una sola vez o de forma programada? El scraping programado y la exportación sencilla (a Google Sheets, Excel, etc.) son imprescindibles en proyectos continuos.

Los mejores proyectos equilibran valor de negocio y viabilidad técnica. Y si no eres un mago del código, no te preocupes: herramientas de IA como Thunderbit están haciendo que el scraping avanzado sea accesible para todo el mundo.

Comparativa de herramientas de web scraping en Python: de BeautifulSoup a Thunderbit

Vamos a desglosar las principales herramientas que querrás tener en tu arsenal:

| Herramienta | Ideal para | ¿Maneja JavaScript? | Escalabilidad | Facilidad de uso | Mantenimiento |

|---|---|---|---|---|---|

| BeautifulSoup | Páginas estáticas, tareas rápidas | No | Baja | Alta | Manual |

| Selenium | Sitios dinámicos y con mucho JS | Sí | Media | Media | Moderado |

| Scrapy | Rastreo estructurado a gran escala | No (pero se puede añadir) | Alta | Media | Moderado |

| Thunderbit | Datos complejos o mixtos con IA | Sí | Alta | Muy alta | Baja |

- BeautifulSoup es perfecto para sitios pequeños y estáticos: blogs o directorios sencillos.

- Selenium brilla cuando necesitas interactuar con contenido dinámico, inicios de sesión o scroll infinito.

- Scrapy está hecho para rastreo a escala industrial y exportaciones estructuradas, pero su curva de aprendizaje es más pronunciada.

- Thunderbit lleva la IA al proceso, y se encarga de todo: desde navegar por subpáginas hasta extraer datos de PDFs e imágenes, e incluso sugerir los mejores campos a extraer. Es mi opción preferida cuando importan sobre todo la velocidad, la resiliencia y la facilidad de uso.

Si quieres profundizar en la elección de herramientas, consulta .

Matriz de complejidad del proyecto y recomendación de herramienta

Aquí tienes una matriz rápida para emparejar cada idea de proyecto con la herramienta adecuada y estimar su complejidad:

Aquí tienes una matriz rápida para emparejar cada idea de proyecto con la herramienta adecuada y estimar su complejidad:

| Idea de proyecto | Herramienta(s) recomendada(s) | Complejidad | Resultado clave |

|---|---|---|---|

| Análisis de sentimiento de reseñas de Amazon | BeautifulSoup + NLP | Media | Reseñas + puntuaciones de sentimiento |

| Marcadores en vivo de esports | Selenium | Alta | Estadísticas en tiempo real |

| Q&A de tendencia en Quora | Selenium | Media-alta | Dataset de preguntas y respuestas |

| Datos de playlists de Spotify | Spotify API | Baja | Pistas de la playlist, métricas |

| Valoraciones de atracciones turísticas | BeautifulSoup | Media | Valoraciones, reseñas, geolocalización |

| Tendencias de taquilla de cine | API o BeautifulSoup | Baja-media | Serie temporal de taquilla |

| Tendencias y contenido en Twitter | Selenium/API | Media | Temas de tendencia, sentimiento |

| Zhihu Q&A | Selenium | Alta | Dataset chino de preguntas y respuestas |

| Seguimiento inmobiliario (Thunderbit) | Thunderbit | Baja-media | Datos de anuncios, tendencias de precios |

| Análisis de best sellers de ebooks | Selenium/API | Media | Rankings, reseñas |

| Seguimiento de precios en ecommerce | Scrapy + proxies | Alta | Historial de precios, alertas |

| Análisis de subreddits de Reddit | Reddit API | Media | Calor temático, engagement |

| Seguimiento de datos bursátiles | yfinance/API | Baja | Precios históricos, indicadores |

| Anuncios de empleo (Scrapy) | Scrapy | Media | Ofertas de empleo, salarios |

| Reseñas de Google Play | API/Selenium | Media | Reseñas, valoraciones, resumen NLP |

| Agregación de blogs de la competencia | RSS + BeautifulSoup | Media | Repositorio de contenido, clústeres temáticos |

| Feedback de cursos en línea | Selenium/API | Media | Valoraciones del curso, comentarios |

| Limpieza de directorios de empresas | Scrapy + Python | Media | Lista de empresas limpia y sin duplicados |

| Lanzamientos y tendencias de podcasts | API + NLP | Media | Podcasts en tendencia, datos de episodios |

| Extracción de archivos con Thunderbit | Thunderbit | Baja | Datos estructurados de PDFs/imágenes |

| Tendencias de citas académicas | API + parsing | Media | Recuentos de citas, líneas de tendencia |

| Datos de juegos web mediante OCR | Selenium + OCR | Alta | Estadísticas del juego a partir de imágenes |

| Análisis de reseñas de comercios minoristas | Scrapy + NLP | Media-alta | Base de datos de reseñas de consumidores, resumen |

| Noticias en vivo con Selenium | Selenium + programación | Media | Titulares en tiempo real |

| Seguimiento de tendencias de moda | Scrapy + análisis de imagen | Media | Estilos populares, datos de tendencias |

| Exportación de productos de la competencia (Thunderbit) | Thunderbit | Baja | Lista de productos, atributos clave |

| Análisis multimedia de Tumblr | API/Selenium | Media | Publicaciones, etiquetas, enlaces multimedia |

| Reseñas de empresas de logística | BeautifulSoup + NLP | Media | Sentimiento de reseñas del servicio |

| Exposición regional de marcas deportivas | API social + scraping | Alta | Métricas de exposición regional |

| Comentarios sobre productos en YouTube | YouTube API + NLP | Media | Sentimiento de comentarios, menciones de funciones |

| Frecuencia de promociones en ecommerce | Scrapy | Media | Calendario promocional, análisis de frecuencia |

| Datos de series multilingües | Scrapy + API de traducción | Alta | Descripciones multilingües |

Ahora sí, vamos con lo bueno: 32 ideas de proyectos, cada una con una guía rápida, consejos de herramientas e ideas de nivel profesional.

1. Análisis de sentimiento de reseñas de productos de Amazon (BeautifulSoup)

Extrae reseñas de productos de Amazon y aplica análisis de sentimiento para descubrir lo que realmente piensan los clientes. Usa BeautifulSoup para obtener el texto de las reseñas, las valoraciones por estrellas y los metadatos del autor de la reseña. Maneja la paginación para recopilar un dataset sólido y, después, aplica librerías de NLP en Python (como VADER o TextBlob) para puntuar el sentimiento y detectar temas comunes. Para obtener los mejores resultados, espacia las solicitudes para evitar CAPTCHAs ().

2. Marcadores y estadísticas en vivo de esports (Selenium)

¿Quieres seguir los marcadores en vivo de esports? Usa Selenium para extraer marcadores dinámicos renderizados por JavaScript desde sitios como ESL o Liquipedia. Selenium te permite automatizar acciones del navegador, gestionar inicios de sesión y extraer estadísticas en tiempo real de juegos como League of Legends o CS:GO. Consejo profesional: revisa las llamadas de red del navegador para encontrar endpoints de API ocultos y acelerar la extracción ().

3. Extracción de datos de Q&A en tendencia de Quora

Recopila preguntas y respuestas en tendencia de Quora usando Selenium para gestionar el scroll infinito y los requisitos de inicio de sesión. Extrae el texto de las preguntas, el contenido de las respuestas, los votos positivos y la información del autor. Para un análisis más profundo, haz clic en los botones “Read More” para obtener las respuestas completas y filtrar anuncios o contenido promocionado ().

4. Recopilación de datos de playlists de Spotify con Python

Usa la Spotify Web API (con la librería spotipy) para obtener pistas de playlists, metadatos y características de audio. Analiza tendencias de playlists, popularidad de canciones e incluso atributos como el tempo o la energía. Ideas de visualización: distribución por géneros, redes de artistas o tasas de rotación de canciones ().

5. Web scraping para valoraciones de atracciones turísticas

Extrae valoraciones y reseñas de atracciones turísticas de plataformas como TripAdvisor usando BeautifulSoup. Obtén nombres de atracciones, ubicaciones, valoraciones medias y número de reseñas. Limpia y geocodifica los datos para mapearlos y, después, analiza tendencias por ciudad o por temporada ().

6. Datos de taquilla de cine y visualización de tendencias

Obtén datos históricos de taquilla desde fuentes como Box Office Mojo mediante su API o BeautifulSoup. Visualiza las tendencias con librerías de Python como Matplotlib o Plotly: ingresos a lo largo del tiempo, distribución por géneros o picos estacionales ().

7. Análisis de temas en tendencia y contenido de usuarios en Twitter

Supervisa las tendencias de Twitter usando la API, si tienes acceso, o herramientas como snscrape y Selenium. Extrae hashtags en tendencia, recopila tweets y analiza el sentimiento o la coocurrencia de hashtags. Para contenido con mucho JavaScript, la automatización del navegador es imprescindible ().

8. Extracción de preguntas y respuestas interactivas de Zhihu

Extrae las preguntas y respuestas en tendencia de Zhihu usando Selenium y cookies de inicio de sesión si hace falta. Obtén el texto de las preguntas, el contenido de las respuestas, los votos positivos y la interacción de los usuarios. Para el análisis de texto chino, usa librerías como Jieba o SnowNLP.

9. Supervisión en tiempo real del mercado inmobiliario (Thunderbit)

Con , puedes supervisar anuncios y precios inmobiliarios con solo unos clics. Usa “AI Suggest Fields” para detectar automáticamente los datos de la propiedad, aprovecha el scraping de subpáginas para obtener detalles y configura extracciones programadas para actualizaciones diarias. Exporta todo a Google Sheets o Airtable, sin necesidad de código ().

10. Análisis de rankings de best sellers en plataformas de ebooks

Extrae listas de best sellers y reseñas de Amazon Kindle o Goodreads usando Selenium o APIs. Haz seguimiento de los cambios de ranking a lo largo del tiempo, analiza tendencias por género y correlaciona reseñas con la posición en ventas ().

11. Análisis de fluctuaciones de precios en ecommerce

Usa Scrapy con proxies para seguir los precios de productos en sitios de ecommerce. Recoge datos de forma programada, crea una base histórica de precios y configura alertas para caídas importantes. Analiza patrones de precios dinámicos y estrategias de la competencia ().

12. Análisis del calor temático en subreddits de Reddit

Extrae publicaciones y comentarios de subreddits usando la Reddit API (PRAW). Analiza la frecuencia de publicaciones, los votos positivos y el volumen de comentarios para identificar temas candentes y tendencias de engagement. Visualiza los datos con mapas de calor o gráficos de barras.

13. Seguimiento histórico de acciones e indicadores financieros

Obtén precios de acciones e indicadores financieros usando yfinance u otras APIs financieras. Crea datasets de series temporales, traza tendencias y correlaciónalas con indicadores económicos ().

14. Extracción de ofertas de empleo con Scrapy

Usa Scrapy para rastrear portales de empleo y extraer títulos de puestos, empresas, ubicaciones y salarios. Maneja la paginación y exporta datos estructurados para su análisis: distribución salarial, demanda de habilidades o tendencias de contratación ().

15. Script para reseñas y valoraciones de apps de Google Play

Extrae reseñas de apps en Google Play usando la API o Selenium. Obtén el texto de las reseñas, las valoraciones y los metadatos, y luego usa NLP para resumir el feedback y el sentimiento de los usuarios ().

16. Agregación de contenido de blogs tecnológicos de la competencia

Agrega publicaciones de blogs de la competencia usando feeds RSS y BeautifulSoup. Organiza el contenido, elimina duplicados y usa clustering temático para detectar tendencias y huecos de contenido.

17. Extracción de feedback y valoraciones de cursos en plataformas educativas en línea

Extrae valoraciones y comentarios de cursos en plataformas como Coursera o Udemy usando Selenium o APIs. Visualiza la popularidad de los cursos, la satisfacción y los temas recurrentes en el feedback.

18. Organización de datos de directorios de empresas y Páginas Amarillas

Extrae fichas de empresas de directorios como Páginas Amarillas usando Scrapy. Normaliza las direcciones, elimina duplicados y crea una base de datos empresarial limpia ().

19. Recopilación de lanzamientos recientes y contenido popular de plataformas de podcasts

Usa la API de iTunes o Spotify para obtener metadatos de podcasts, nuevos episodios y métricas de popularidad. Analiza temas emergentes y tendencias de publicación.

20. Subida de archivos a Thunderbit para extracción de datos personalizada

Sube PDFs o imágenes a y deja que su OCR impulsado por IA extraiga datos estructurados, sin teclear manualmente ni usar regex. Perfecto para digitalizar tarjetas de visita, facturas o listas de asistentes ().

21. Análisis de tendencias de citas académicas

Extrae datos de citas de bases académicas usando APIs como CrossRef. Analiza el recuento de citas a lo largo del tiempo para detectar tendencias de investigación emergentes.

22. Extracción de datos de juegos web mediante OCR

Combina Selenium y librerías OCR como pytesseract para extraer estadísticas de juegos web basados en imágenes. Útil para juegos que muestran puntuaciones o datos como imágenes.

23. Extracción y análisis de reseñas de consumidores en comercios minoristas online

Extrae reseñas de consumidores de comercios online usando Scrapy. Aplica NLP para puntuar el sentimiento, resumir las principales ventajas y desventajas del producto y comparar productos competidores.

24. Extracción en tiempo real de titulares y resúmenes de noticias (Selenium)

Usa Selenium para extraer titulares y resúmenes de noticias en vivo de sitios dinámicos. Programa extracciones periódicas para obtener actualizaciones en tiempo real.

25. Seguimiento de tendencias y estilos en sitios de moda

Extrae de sitios de moda los productos y estilos en tendencia usando Scrapy. Opcionalmente, utiliza análisis de imagen para detectar colores o patrones populares.

26. Exportación de listas de productos de la competencia con Thunderbit

Con , exporta en minutos listas de productos de la competencia y sus atributos. Usa sugerencias de campos con IA y scraping de subpáginas para obtener datos profundos, y exporta directamente a tu herramienta de hojas de cálculo favorita.

27. Análisis de contenido multimedia de Tumblr

Extrae publicaciones multimedia de Tumblr usando la API o Selenium. Analiza imágenes, vídeos y etiquetas para detectar tendencias de contenido.

28. Extracción de datos de reseñas de empresas de logística

Extrae reseñas y valoraciones de empresas de logística en plataformas como Trustpilot usando BeautifulSoup. Relaciona el feedback con mejoras operativas mediante análisis de texto.

29. Estadísticas de exposición regional de marcas deportivas

Recopila y analiza datos de exposición de mercado para marcas deportivas usando APIs de redes sociales y web scraping. Haz seguimiento de menciones, presencia minorista y tendencias regionales.

30. Análisis de la experiencia en comentarios de productos en YouTube

Extrae comentarios de YouTube usando la API y, después, usa NLP para obtener el sentimiento y las menciones de funciones relacionadas con la experiencia con el producto.

31. Seguimiento de la frecuencia y proporción de promociones en ecommerce

Haz seguimiento de eventos promocionales en plataformas de ecommerce usando Scrapy. Agrega los datos de eventos y visualiza las tendencias a lo largo del tiempo.

32. Extracción de descripciones de series en varias plataformas y varios idiomas

Crea scripts con Scrapy y APIs de traducción para recopilar y estandarizar descripciones de series de varias plataformas de streaming en distintos idiomas.

De un vistazo: tabla comparativa de proyectos

| # | Idea de proyecto | Herramienta(s) | Complejidad | Resultado clave |

|---|---|---|---|---|

| 1 | Análisis de sentimiento de reseñas de Amazon | BeautifulSoup + NLP | Media | Reseñas + sentimiento |

| 2 | Marcadores en vivo de esports | Selenium | Alta | Estadísticas en tiempo real |

| 3 | Q&A en tendencia de Quora | Selenium | Media-alta | Dataset de preguntas y respuestas |

| 4 | Datos de playlists de Spotify | Spotify API | Baja | Pistas de la playlist, métricas |

| 5 | Valoraciones de atracciones turísticas | BeautifulSoup | Media | Valoraciones, reseñas, mapas |

| 6 | Tendencias de taquilla de cine | API/BeautifulSoup | Baja-media | Serie temporal de taquilla |

| 7 | Tendencias y contenido en Twitter | Selenium/API | Media | Temas de tendencia, sentimiento |

| 8 | Zhihu Q&A | Selenium | Alta | Dataset chino de preguntas y respuestas |

| 9 | Seguimiento inmobiliario (Thunderbit) | Thunderbit | Baja-media | Datos de anuncios, tendencias de precios |

| 10 | Análisis de best sellers de ebooks | Selenium/API | Media | Rankings, reseñas |

| 11 | Seguimiento de precios en ecommerce | Scrapy + proxies | Alta | Historial de precios, alertas |

| 12 | Análisis de subreddits de Reddit | Reddit API | Media | Calor temático, engagement |

| 13 | Seguimiento de datos bursátiles | yfinance/API | Baja | Precios históricos, indicadores |

| 14 | Anuncios de empleo (Scrapy) | Scrapy | Media | Ofertas de empleo, salarios |

| 15 | Reseñas de Google Play | API/Selenium | Media | Reseñas, valoraciones, resumen NLP |

| 16 | Agregación de blogs de la competencia | RSS + BeautifulSoup | Media | Repositorio de contenido, clústeres temáticos |

| 17 | Feedback de cursos en línea | Selenium/API | Media | Valoraciones del curso, comentarios |

| 18 | Limpieza de directorios de empresas | Scrapy + Python | Media | Lista de empresas limpia y sin duplicados |

| 19 | Lanzamientos y tendencias de podcasts | API + NLP | Media | Podcasts en tendencia, datos de episodios |

| 20 | Extracción de archivos con Thunderbit | Thunderbit | Baja | Datos estructurados de PDFs/imágenes |

| 21 | Tendencias de citas académicas | API + parsing | Media | Recuentos de citas, líneas de tendencia |

| 22 | Datos de juegos web mediante OCR | Selenium + OCR | Alta | Estadísticas del juego a partir de imágenes |

| 23 | Análisis de reseñas de comercios minoristas | Scrapy + NLP | Media-alta | Base de datos de reseñas de consumidores, resumen |

| 24 | Noticias en vivo con Selenium | Selenium + programación | Media | Titulares en tiempo real |

| 25 | Seguimiento de tendencias de moda | Scrapy + análisis de imagen | Media | Estilos populares, datos de tendencias |

| 26 | Exportación de productos de la competencia (Thunderbit) | Thunderbit | Baja | Lista de productos, atributos clave |

| 27 | Análisis multimedia de Tumblr | API/Selenium | Media | Publicaciones, etiquetas, enlaces multimedia |

| 28 | Reseñas de empresas de logística | BeautifulSoup + NLP | Media | Sentimiento de reseñas del servicio |

| 29 | Exposición de marca deportiva | API social + scraping | Alta | Métricas de exposición regional |

| 30 | Comentarios sobre productos en YouTube | YouTube API + NLP | Media | Sentimiento de comentarios, menciones de funciones |

| 31 | Frecuencia de promociones en ecommerce | Scrapy | Media | Calendario promocional, análisis de frecuencia |

| 32 | Datos de series multilingües | Scrapy + traducción | Alta | Descripciones multilingües |

Conclusión: desbloquea nuevas posibilidades con proyectos de web scraping en Python

El web scraping con Python es mucho más que un ejercicio técnico: es una plataforma de lanzamiento para avances impulsados por datos. Tanto si estás creando dashboards, alimentando modelos de machine learning o simplemente satisfaciendo tu curiosidad, estas 32 ideas de proyecto demuestran que el único límite es tu imaginación. Y con herramientas como , no tienes que ser un experto en código para afrontar incluso los retos de scraping más difíciles.

Así que elige un proyecto, configura tu entorno de Python y empieza a experimentar. La web es tu patio de juegos de datos: construye algo increíble y deja que los insights fluyan.

Para más profundizaciones y guías prácticas, visita el .

Preguntas frecuentes

1. ¿Cuál es la mejor herramienta de Python para proyectos de web scraping?

Depende de tu proyecto. Para páginas estáticas, BeautifulSoup es simple y eficaz. Para sitios dinámicos o interactivos, Selenium es una buena opción. Para scraping a gran escala o programado, Scrapy es ideal. Para scraping sin código impulsado por IA, incluidos PDFs e imágenes, es una de las mejores opciones.

2. ¿Cómo evito que me bloqueen al hacer scraping de sitios web?

Usa user agents realistas, añade pausas entre solicitudes y respeta robots.txt. Para sitios sensibles o de alta frecuencia, considera rotar proxies y usar automatización del navegador para imitar el comportamiento humano.

3. ¿Puedo usar web scraping en proyectos comerciales?

Sí, pero revisa siempre los términos de servicio y las restricciones legales del sitio objetivo. Muchos sitios permiten scraping para uso personal o de investigación, pero el uso comercial puede requerir permiso o acceso mediante API.

4. ¿Cómo simplifica Thunderbit las tareas complejas de web scraping?

Thunderbit usa IA para detectar campos automáticamente, gestionar subpáginas y extraer datos de sitios dinámicos, PDFs e imágenes. Ofrece indicaciones en lenguaje natural y exporta datos directamente a Google Sheets, Excel, Airtable o Notion, sin necesidad de programar.

5. ¿Cuál es la mejor forma de empezar con proyectos de web scraping en Python?

Elige una idea que te entusiasme, instala las librerías necesarias (BeautifulSoup, Selenium, Scrapy o Thunderbit) y empieza en pequeño: extrae una sola página y luego escala. Experimenta, itera y no tengas miedo de probar herramientas impulsadas por IA para acelerar tu flujo de trabajo.

Feliz scraping, y que tus datos estén siempre frescos, estructurados y llenos de insights.

Más información