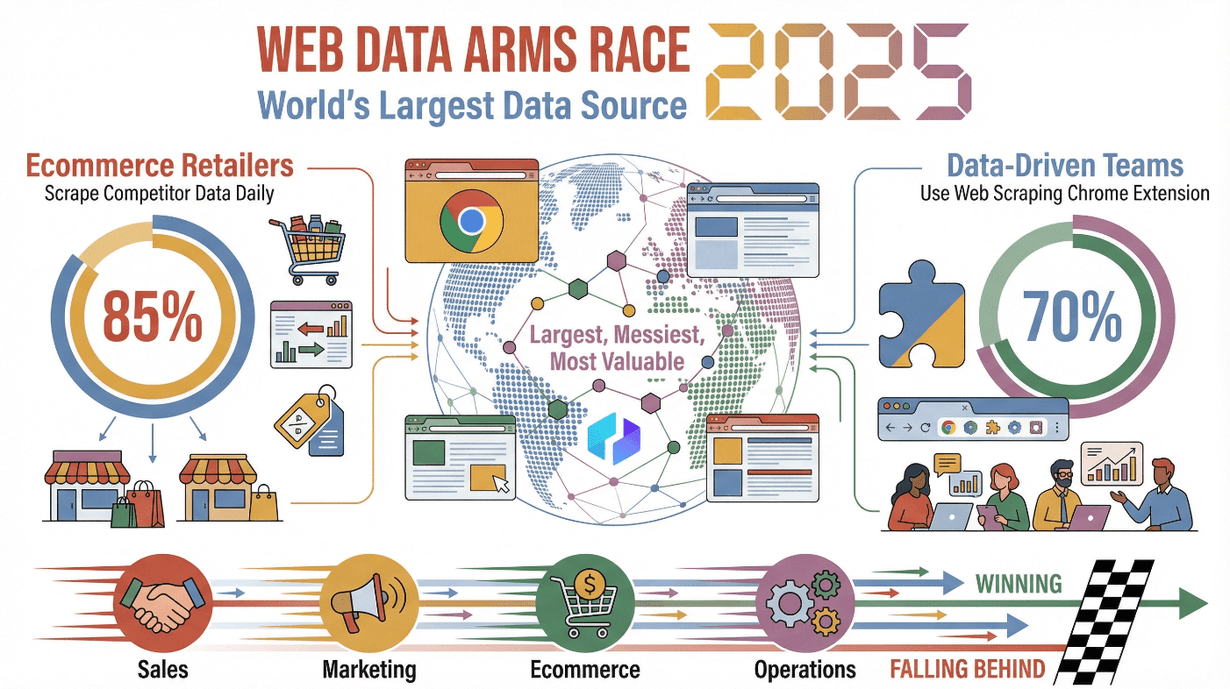

La web ya no es solo ese rincón para ver videos de gatos o reírte con memes: hoy es la fuente de datos más grande, caótica y valiosa que existe. En 2025, las empresas están metidas de lleno en una verdadera guerra de datos: , y más del . Ya sea en ventas, marketing, ecommerce u operaciones, tener los datos correctos—rápido y en el formato justo—puede ser la diferencia entre liderar o quedarse atrás.

Pero aquí viene el lío: los sitios web no te lo ponen fácil para sacar datos. Son un desorden, cambian todo el tiempo y están hechos para que los vean personas, no para que los metas directo en una hoja de cálculo. Ahí es donde entran los 웹 스크래퍼, que convierten ese caos en tablas limpias y ordenadas listas para usar. Después de años metido en SaaS y automatización, te puedo decir que elegir bien la herramienta te ahorra horas, mejora la precisión y te muestra oportunidades que ni imaginabas.

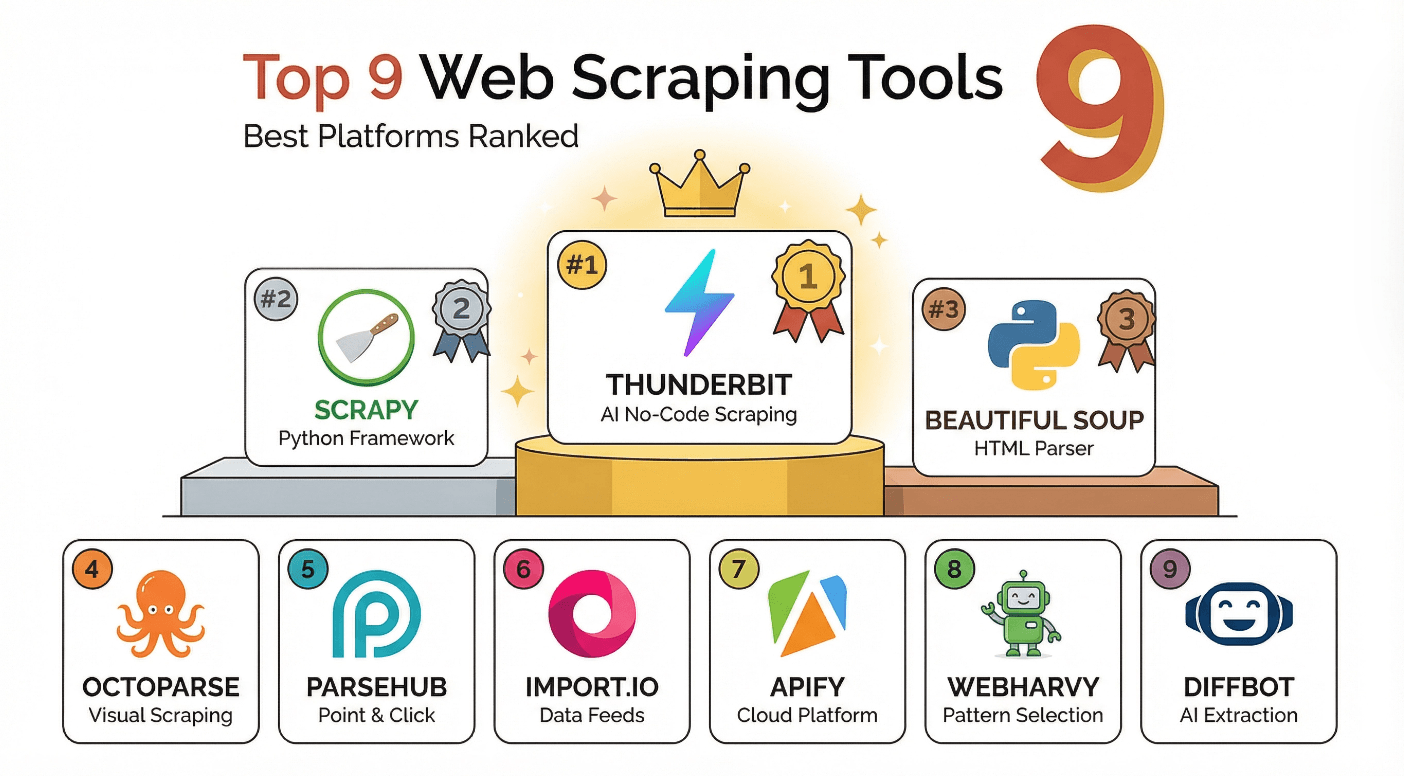

Entonces, ¿cuáles son las herramientas de 웹 스크래퍼 que realmente valen la pena en 2025? Te traigo las nueve mejores: desde extensiones de Chrome con IA para usuarios de negocio hasta frameworks open-source para desarrolladores. Vamos a verlas.

Por qué las herramientas de 웹 스크래퍼 son clave para las empresas modernas

Las herramientas de 웹 스크래퍼 son el as bajo la manga para ventas más inteligentes, marketing más afinado y operaciones más ágiles. Mira por qué son tan importantes:

- Generación de leads: Los equipos de ventas sacan datos de directorios, LinkedIn y sitios de reseñas para armar listas de prospectos.

- Análisis de la competencia: Marketing y ecommerce vigilan precios, lanzamientos y anuncios de la competencia—muchas veces en tiempo real.

- Investigación de mercado: Analistas y equipos de research recopilan reseñas, noticias y opiniones de usuarios para detectar tendencias antes que nadie.

- Monitoreo de precios: Marcas y minoristas rastrean precios y stock en cientos de webs para no quedarse atrás ().

- Agregación de contenido: Los equipos de operaciones juntan datos de portales de empleo, inmobiliarias o catálogos de proveedores para optimizar procesos.

Así es como estas herramientas hacen la diferencia en el negocio:

| Caso de uso empresarial | Problema manual | Solución con scraping web |

|---|---|---|

| Generación de leads | Copiar y pegar de decenas de sitios | Extracción automática, exportación masiva |

| Monitoreo de precios | Revisiones manuales diarias | Scraping programado, alertas instantáneas |

| Investigación de mercado | Leer cientos de reseñas | Datos estructurados y agregados |

| Agregación de contenido | Unir datos de múltiples sitios | Exportación unificada a Excel/Sheets |

| Análisis de la competencia | Datos lentos o incompletos | Insights completos en tiempo real |

El beneficio es claro: las empresas que usan herramientas modernas de 웹 스크래퍼 , y .

Cómo elegimos las mejores herramientas de 웹 스크래퍼

No todas las herramientas de 웹 스크래퍼 son iguales. Algunas están pensadas para usuarios de negocio que quieren resultados sin programar; otras son el paraíso de los desarrolladores para proyectos a medida y a gran escala. Estos son los puntos que tuve en cuenta para elegir las mejores:

- Facilidad de uso: ¿Alguien sin experiencia técnica puede usarlas rápido? ¿La interfaz es clara?

- Escalabilidad: ¿Permite procesar cientos o millones de páginas? ¿Automatiza y programa tareas?

- Opciones de exportación: ¿Se puede exportar a Excel, Google Sheets, Airtable, Notion o vía API?

- Soporte y comunidad: ¿Tiene buena documentación, tutoriales y soporte rápido?

- Precio y valor: ¿Hay plan gratis? ¿Los precios son claros y razonables?

- Funciones únicas: Extracción con IA, scraping de subpáginas, integración con API o flujos visuales.

Además, te indico para qué escenario de negocio brilla cada herramienta, así podés encontrar la ideal según lo que necesitás y tu nivel técnico.

1. Thunderbit

es mi primera recomendación para usuarios de negocio que quieren scraping web con IA sin enredos técnicos. Como extensión de Chrome, Thunderbit está pensada para equipos de ventas, marketing, ecommerce y operaciones que necesitan datos precisos y ordenados—al instante.

¿Qué hace diferente a Thunderbit? Su mezcla de simpleza y potencia:

- Sugerencia de campos con IA: Solo hacé clic en “Sugerir campos con IA” y Thunderbit analiza la página, te recomienda columnas (como Nombre, Precio, Email) y arma prompts de extracción para cada campo.

- Scraping de subpáginas: ¿Querés más detalle? La IA de Thunderbit puede entrar a cada subpágina (como fichas de producto o perfiles) y enriquecer tu tabla—sin que tengas que configurar nada extra.

- Exportación instantánea: Mandá tus datos directo a Excel, Google Sheets, Airtable o Notion. La exportación siempre es gratis.

- Scraping programado: Automatizá tareas repetitivas (como chequeos diarios de precios) con programación en lenguaje natural.

- Extractores gratis de email, teléfono e imágenes: Sacá contactos o imágenes de cualquier web con un solo clic.

- AI Autofill: Dejá que la IA complete formularios online por vos—ideal para flujos de trabajo y tareas repetitivas.

Thunderbit ya lo usan más de , y su te deja extraer hasta 6 páginas (o 10 con prueba). Los planes pagos arrancan en solo $15/mes por 500 créditos—perfecto para equipos de cualquier tamaño.

¿Querés ver Thunderbit en acción? Pasate por nuestro o mirá nuestro para tutoriales y tips.

2. Scrapy

es el framework open-source favorito de los desarrolladores que buscan control total sobre sus proyectos de scraping. Escrito en Python, Scrapy te permite crear spiders personalizados que rastrean, extraen y procesan datos a gran escala.

¿Por qué los devs eligen Scrapy?

- Framework potente: Soporta crawling complejo, pipelines personalizados e integración con APIs.

- Escalable: Perfecto para proyectos grandes, solicitudes concurrentes y scraping masivo ().

- Extensible: Podés sumar middlewares para proxies, user agents o renderizado JavaScript (con Splash).

- Comunidad activa: Hay un montón de tutoriales, plugins y soporte para casos avanzados.

Scrapy es ideal para equipos con experiencia en Python que necesitan scraping a gran escala, integración con pipelines de datos o flujos robustos y repetibles. Es gratis y open-source, pero tenés que armar y mantener tu propio entorno.

3. Beautiful Soup

es una librería de Python muy querida por quienes recién empiezan, gracias a lo fácil y potente que es para analizar HTML y XML. Si necesitás sacar datos rápido de páginas estáticas, Beautiful Soup es tu aliada.

¿Por qué elegir Beautiful Soup?

- Fácil de aprender: Curva de aprendizaje suave y muchísimos tutoriales ().

- Análisis flexible: Se banca HTML desordenado o incompleto sin drama.

- Perfecta para proyectos chicos: Ideal para scripts puntuales, extracciones rápidas o aprender los básicos del scraping.

¿Limitaciones? Beautiful Soup no está pensada para scraping a gran escala ni para sitios dinámicos, y no procesa JavaScript. Para eso, conviene combinarla con requests o Selenium, o saltar a Scrapy.

4. Octoparse

es una herramienta de 웹 스크래퍼 sin código pensada para todos: desde emprendedores hasta grandes empresas. Su interfaz de apuntar y hacer clic hace que sacar datos sea fácil, incluso en webs complejas o dinámicas.

¿Por qué gusta Octoparse?

- Sin programar: Constructor visual de flujos, selectores drag-and-drop y plantillas listas para usar.

- Modo local y en la nube: Ejecutá extracciones en tu compu o en la nube para trabajos más rápidos y grandes.

- Manejo de paginación y contenido dinámico: Saca datos de páginas con “Cargar más”, scroll infinito y sitios AJAX.

- Opciones de exportación: Descargá en CSV, Excel, JSON, HTML o exportá a bases de datos ().

El plan gratis de Octoparse sirve para tareas chicas, mientras que los pagos arrancan en unos $75/mes para uso intensivo. Es muy popular para investigación de mercado, análisis de competencia y para quienes quieren resultados sin programar.

5. ParseHub

es una herramienta visual de scraping que se luce en sitios dinámicos y con JavaScript. Su constructor de flujos te deja seleccionar, recorrer y extraer datos condicionalmente, incluso en webs complicadas.

Lo mejor de ParseHub:

- Selección visual de datos: Hacé clic para elegir elementos, recorré listas y gestioná subpáginas.

- Soporte para contenido dinámico: Saca datos cargados por JavaScript, maneja menús desplegables y automatiza clics.

- Exportación flexible: Descargá en CSV, Excel, JSON o integrá con Dropbox/Amazon S3 ().

- Plan gratis: Hasta 5 proyectos y 200 páginas por ejecución; los pagos amplían la capacidad.

ParseHub es ideal para usuarios intermedios que buscan flexibilidad sin programar. Es muy usado para scraping en ecommerce, portales de empleo e inmobiliarias.

6. Import.io

está pensada para extracción y visualización de datos a nivel empresa. Con foco en proyectos grandes, ofrece una interfaz intuitiva, soporte robusto y análisis avanzados.

¿Qué la hace especial?

- Extracción por selección: Sin código—solo seleccioná los datos que necesitás.

- Visualización de datos: Herramientas integradas para analizar, graficar y compartir resultados.

- Funciones empresariales: Cumplimiento normativo, servicios gestionados y soporte para grandes volúmenes.

- Exportación e integración: Descargá en CSV, Excel o integrá con Google Sheets y herramientas BI ().

El precio apunta a grandes empresas, así que es ideal para organizaciones con necesidades de big data y presupuesto acorde.

7. Apify

es una plataforma para automatización web y extracción de datos a escala. Es la favorita de los desarrolladores para crear, ejecutar y compartir “actores” de scraping (scripts prearmados o personalizados).

¿Por qué Apify es una gran opción?

- Marketplace de actores: Accedé a más de 200 scrapers listos para sitios comunes o creá los tuyos en JavaScript/Python.

- API-first: Integrá los datos extraídos directo en tus flujos o apps.

- Despliegue en la nube: Ejecutá tareas a escala, programá trabajos recurrentes y gestioná todo desde un panel ().

- Precios flexibles: Plan gratis para tareas chicas; pago por uso para proyectos grandes.

Apify es perfecto para equipos técnicos que quieren automatizar, escalar e integrar datos web en sus procesos.

8. WebHarvy

es una herramienta de scraping visual que detecta automáticamente patrones de datos en las páginas web. Está pensada para quienes no programan y quieren resultados sin aprender selectores XPath o CSS.

Funciones clave de WebHarvy:

- Detección automática de patrones: Hacé clic en un campo y WebHarvy encuentra elementos similares ().

- Soporte para AJAX/JavaScript: Saca contenido dinámico, imágenes y datos por palabras clave.

- Opciones de exportación: Descargá en Excel, CSV, XML, JSON o SQL.

- Licencia de pago único: Pagás una vez y lo usás para siempre (con un año de actualizaciones/soporte).

WebHarvy es muy popular entre pymes, investigadores y emprendedores que prefieren un enfoque visual y no necesitan automatización avanzada.

9. Diffbot

es el gigante de la extracción de datos web con IA. Usando machine learning y visión por computadora, Diffbot convierte cualquier página pública en datos estructurados—sin que tengas que configurar nada.

¿Qué lo hace único?

- Extracción con IA: Identifica y saca automáticamente entidades, relaciones y datos de páginas web ().

- Knowledge Graph: Acceso a una base de datos gigante y actualizada de personas, empresas, productos y más.

- Acceso por API: Integrá datos estructurados en tus apps, investigaciones o análisis ().

- Listo para empresas: Lo usan Microsoft, Adobe, Hubspot y otros grandes.

El precio arranca en $299/mes para startups, con opciones de pago por llamada a la API (). Es ideal para investigación, ciencia de datos empresarial y quienes necesitan precisión a escala con IA.

Tabla comparativa de herramientas de 웹 스크래퍼

Acá tenés una comparación directa de las nueve herramientas:

| Herramienta | Ideal para | Sin código | Con IA | API/Dev Friendly | Scraping de subpáginas | Opciones de exportación | Precio (desde) |

|---|---|---|---|---|---|---|---|

| Thunderbit | Usuarios de negocio | Sí | Sí | No | Sí | Excel, CSV, Sheets, Notion, Airtable | Gratis (6 páginas), $15/mes |

| Scrapy | Desarrolladores | No | No | Sí | Sí (personalizado) | CSV, JSON, XML, BD | Gratis, open-source |

| Beautiful Soup | Principiantes, devs | No | No | Sí | No | Personalizado (vía Python) | Gratis, open-source |

| Octoparse | No programadores, equipos | Sí | No | Parcialmente | Sí | CSV, Excel, JSON, BD | Gratis, $75/mes |

| ParseHub | Sitios visuales/dinámicos | Sí | No | Parcialmente | Sí | CSV, Excel, JSON, S3, Dropbox | Gratis, $189/año |

| Import.io | Empresas, analítica | Sí | No | Sí | Sí | CSV, Excel, Sheets, herramientas BI | Personalizado, empresarial |

| Apify | Devs, automatización | No | No | Sí | Sí | CSV, JSON, Sheets, API | Gratis, pago por uso |

| WebHarvy | No programadores, pymes | Sí | No | No | Sí | Excel, CSV, XML, JSON, SQL | $139/año (pago único) |

| Diffbot | IA, investigación, empresas | No | Sí | Sí | Sí (rastreo IA) | JSON, API Knowledge Graph | $299/mes |

Cómo elegir la herramienta de 웹 스크래퍼 adecuada

¿Y ahora, cuál te conviene? Acá va una guía rápida:

- Para no programadores/usuarios de negocio: Thunderbit, Octoparse, ParseHub, WebHarvy

- Para desarrolladores/automatización: Scrapy, Beautiful Soup, Apify

- Para empresas/necesidades de IA: Import.io, Diffbot

- Para sitios dinámicos o con JavaScript: ParseHub, Octoparse, Apify

- Para exportaciones instantáneas y ordenadas: Thunderbit, Import.io

Mi consejo: arrancá por tu objetivo de negocio y tu nivel técnico. Si querés scraping con IA, sin vueltas y exportaciones instantáneas, es difícil de igualar. Si necesitás control total o crear crawlers a medida, Scrapy o Apify son geniales. Para grandes volúmenes o extracción con IA, Import.io y Diffbot son los más potentes.

Casi todas ofrecen pruebas gratis o planes básicos—probá varias y quedate con la que mejor se adapte a tu día a día.

Preguntas frecuentes

1. ¿Qué es una herramienta de 웹 스크래퍼 y para qué sirve?

Una herramienta de 웹 스크래퍼 es un software que saca datos de sitios web y los convierte en formatos ordenados como hojas de cálculo o bases de datos. Las empresas las usan para generar leads, monitorear precios, investigar el mercado y más—ahorrando tiempo y mejorando la precisión frente al copiado manual.

2. ¿Es legal el scraping web?

El scraping web es legal cuando sacás datos públicos y respetás los términos de uso del sitio. Evitá siempre extraer información personal o sensible sin permiso y revisá la normativa local.

3. ¿Cuál es la mejor herramienta de 웹 스크래퍼 para no programadores?

Thunderbit, Octoparse, ParseHub y WebHarvy son excelentes para quienes no tienen conocimientos técnicos. Thunderbit destaca por su sugerencia de campos con IA y exportación instantánea a Excel, Google Sheets, Notion o Airtable.

4. ¿Puedo extraer datos de sitios dinámicos o con JavaScript?

¡Sí! Herramientas como ParseHub, Octoparse y Apify están hechas para manejar contenido dinámico, AJAX y páginas con “Cargar más”. La IA de Thunderbit también se adapta a muchos diseños modernos.

5. ¿Cómo elijo la herramienta de 웹 스크래퍼 adecuada para mi empresa?

Pensá en tu nivel técnico, el volumen de datos, las opciones de exportación y tu presupuesto. Si no programás, empezá con Thunderbit u Octoparse; si sos desarrollador, Scrapy o Apify pueden ser mejores; para grandes empresas, Import.io o Diffbot. Casi todas ofrecen pruebas gratis—probá varias y elegí la que mejor te funcione.

¿Listo para hacer de la web tu próxima ventaja competitiva? o pasate por nuestro para más guías y consejos. ¡Que disfrutes el scraping!

Más información