La web está creciendo más rápido que la popularidad del soju en una noche de viernes en Hongdae—y créeme, eso ya es decir mucho. Para 2026, el tema de extraer datos de la web dejó de ser solo cosa de frikis techies; ahora es la base de la inteligencia de negocios, el entrenamiento de IA y la automatización de procesos. Ya sea que estés monitoreando tendencias de mercado, alimentando tu próximo modelo LLM o simplemente tratando de no perderle la pista a los precios de la competencia, la necesidad de datos web estructurados y en tiempo real nunca ha sido tan urgente. ¿Y quién está al mando de esta fiebre del oro digital? Python, por supuesto. Gracias a su ecosistema gigante y su sintaxis amigable, Python sigue siendo el rey del raspado web, desde scripts sencillos hasta rastreadores a gran escala.

Pero aquí está el meollo: elegir los paquetes de python para raspado web correctos puede ser la diferencia entre un proyecto exitoso y uno que te haga querer tirar el portátil por la ventana. He visto equipos perder días peleando con bloqueos anti-bots por usar la herramienta equivocada, o malgastando horas tratando de entender HTML caótico cuando una librería más lista lo habría resuelto en minutos. Como alguien que lleva años metido en SaaS, automatización e IA (y que creó para que el scraping sea pan comido para todos), te traigo los 12 mejores paquetes de python para raspado web en 2026—cada uno con sus ventajas, detalles y casos de uso ideales. Vamos a ver cuál te queda mejor para tu próxima misión de datos.

¿Por qué es clave elegir bien los paquetes de python para raspado web?

Seamos realistas: no todos los proyectos de raspado web son iguales. A veces solo necesitas sacar unos precios de una página estática, pero otras veces te enfrentas a un sitio lleno de JavaScript más terco que un gato coreano. Elegir el paquete correcto puede ahorrarte horas (o días), evitarte errores y ayudarte a esquivar problemas típicos como bloqueos anti-bots o HTML desordenado.

La fama de Python en el raspado web no es solo moda pasajera. Librerías como requests y urllib3 superan los , y casi todas las herramientas top de scraping priorizan Python. Pero con gran poder viene gran responsabilidad: si eliges mal, tu proyecto puede ir más lento que el WiFi en el metro de Seúl. Si eliges bien, tendrás datos limpios y listos antes de que se enfríe tu café de conveniencia.

¿Cómo elegimos las mejores librerías de python para web scraping?

No fue cuestión de tirar una moneda en PyPI. Así evalué cada paquete:

- Rendimiento y concurrencia: ¿Puede procesar cientos o miles de páginas rápido?

- Facilidad de uso: ¿Es amigable para novatos o necesitas ser un hacker?

- Capacidad de análisis HTML: ¿Aguanta HTML roto, soporta selectores XPath/CSS y facilita la extracción?

- Soporte para contenido dinámico: ¿Puede con sitios llenos de JavaScript o solo sirve para páginas estáticas?

- Comunidad y documentación: ¿Tiene una comunidad activa y buena documentación, o te quedarás solo en Stack Overflow?

- Mejor caso de uso: ¿Sirve para scripts rápidos, grandes rastreadores o algo intermedio?

También consideré opiniones de desarrolladores, benchmarks recientes y mis propias (a veces dolorosas) experiencias. Ahora, vamos a conocer a los candidatos.

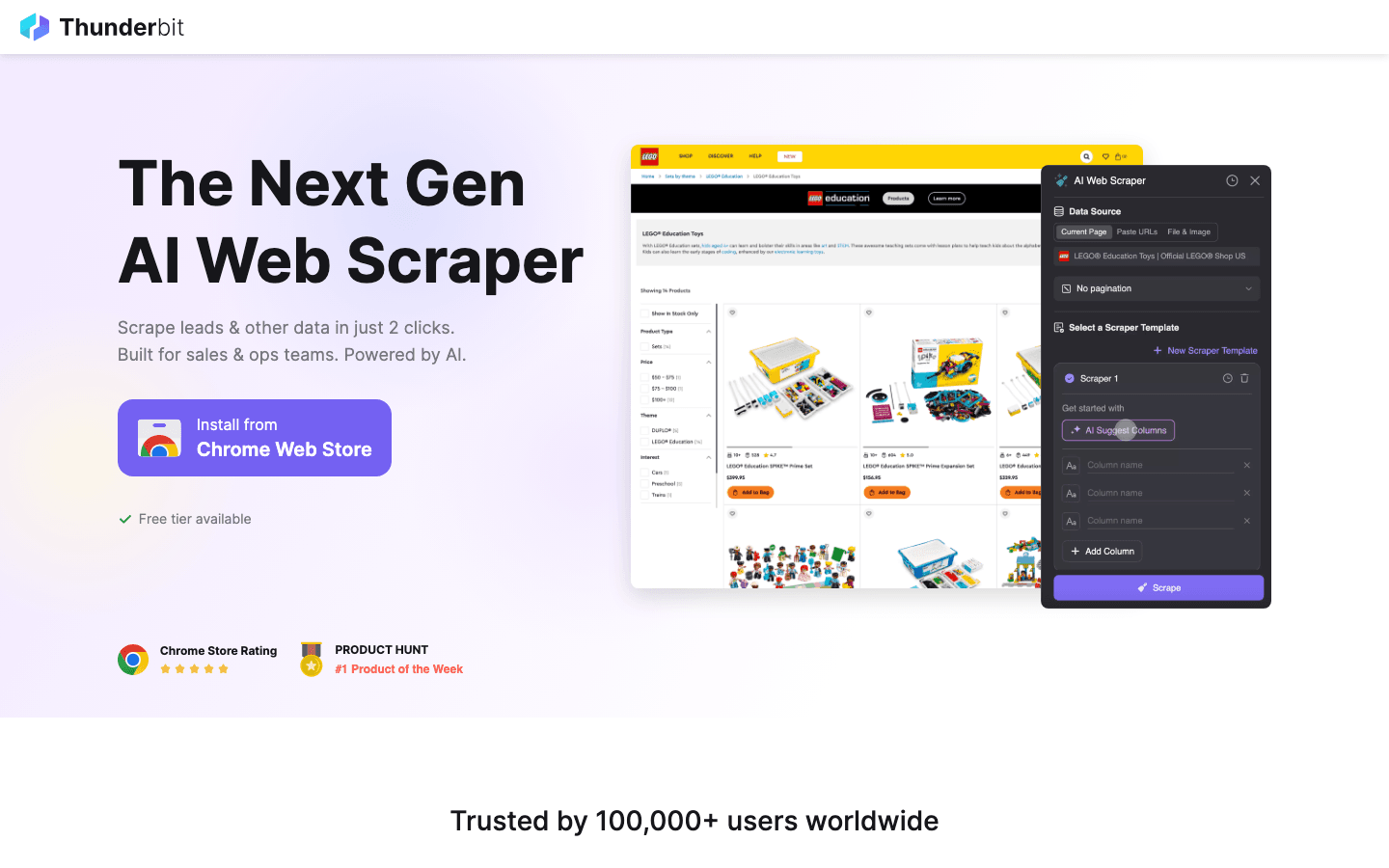

1. Thunderbit

no es una librería de Python tradicional—es una extensión de Chrome con IA que está cambiando el juego del raspado web, sobre todo para desarrolladores Python que buscan velocidad, precisión y un toque de inteligencia artificial. ¿Qué lo hace especial? Puedes usar instrucciones en lenguaje natural para decirle a la IA qué datos necesitas, y ella se encarga de todo: sugerencias de campos, navegación por subpáginas, paginación e incluso exportación a Excel, Google Sheets, Notion o Airtable.

no es una librería de Python tradicional—es una extensión de Chrome con IA que está cambiando el juego del raspado web, sobre todo para desarrolladores Python que buscan velocidad, precisión y un toque de inteligencia artificial. ¿Qué lo hace especial? Puedes usar instrucciones en lenguaje natural para decirle a la IA qué datos necesitas, y ella se encarga de todo: sugerencias de campos, navegación por subpáginas, paginación e incluso exportación a Excel, Google Sheets, Notion o Airtable.

Thunderbit es perfecto para extraer datos complejos y desordenados—como directorios caóticos, listados de productos o sitios donde el HTML parece arte moderno. Su función AI Suggest Fields analiza la página y te propone las mejores columnas, mientras que Subpage Scraping enriquece tus datos visitando automáticamente páginas de detalle enlazadas. Y si ya te cansaste de los bloqueos anti-bot, Thunderbit te da opciones de scraping en navegador y en la nube.

A los desarrolladores Python les encanta Thunderbit para prototipos rápidos, generación de leads e investigación de mercado. Puedes usar sus resultados directamente en tu pipeline de datos en Python, o incluso automatizar flujos de scraping con su API. No es una librería de código tradicional, pero se está volviendo la favorita de quienes quieren analizar datos sin perder tiempo programando.

Características principales:

- Sugerencia de campos y extracción de datos con IA

- Soporta subpáginas, paginación y hasta PDFs/imágenes

- Exporta a CSV, Excel, Google Sheets, Notion, Airtable

- No requiere código—ideal tanto para novatos como para expertos en Python que buscan rapidez

- Plan gratuito disponible; los planes de pago se adaptan a lo que necesites

Ideal para: Generación de leads, investigación de mercado, prototipos rápidos y scraping de datos web complejos o desordenados.

2. Beautiful Soup

es el clásico para analizar HTML en Python. Si estás empezando o necesitas extraer datos de páginas estáticas, es tu mejor amigo. Beautiful Soup brilla al navegar y analizar HTML mal estructurado (“tag soup”), siendo un salvavidas para sitios que no siguen las reglas.

es el clásico para analizar HTML en Python. Si estás empezando o necesitas extraer datos de páginas estáticas, es tu mejor amigo. Beautiful Soup brilla al navegar y analizar HTML mal estructurado (“tag soup”), siendo un salvavidas para sitios que no siguen las reglas.

La API es muy amigable—con métodos como .find(), .select() y .text—y se lleva de maravilla con requests para obtener páginas web. Puedes elegir diferentes analizadores (como lxml para velocidad o html5lib para máxima compatibilidad). La documentación es excelente y la comunidad, enorme.

Características principales:

- API intuitiva y muy pythonica para navegar HTML/XML

- Maneja HTML roto o inconsistente sin dramas

- Compatible con varios analizadores para velocidad o compatibilidad

- Gran comunidad y muchísimos tutoriales

Ideal para: Scripts rápidos, scraping de páginas estáticas y quienes recién empiezan.

3. Scrapy

es el peso pesado para el rastreo web automatizado a gran escala. Si necesitas extraer cientos o miles de páginas, gestionar pipelines o programar tareas recurrentes, Scrapy es tu framework. Basado en el motor Twisted, es rapidísimo y soporta crawling asíncrono, pipelines para limpieza de datos y exportación integrada a JSON, CSV o bases de datos.

es el peso pesado para el rastreo web automatizado a gran escala. Si necesitas extraer cientos o miles de páginas, gestionar pipelines o programar tareas recurrentes, Scrapy es tu framework. Basado en el motor Twisted, es rapidísimo y soporta crawling asíncrono, pipelines para limpieza de datos y exportación integrada a JSON, CSV o bases de datos.

Scrapy es súper extensible, con plugins para proxies, caché e incluso renderizado limitado de JavaScript (vía Splash o integración con Selenium). La curva de aprendizaje es más empinada que con Beautiful Soup, pero si vas en serio con el scraping a gran escala, Scrapy es el siguiente nivel.

Características principales:

- Crawling asíncrono y de alto rendimiento

- Pipelines integrados para limpieza y almacenamiento de datos

- Exporta a varios formatos (JSON, CSV, BD)

- Gran comunidad activa y ecosistema de plugins

Ideal para: Proyectos de scraping recurrentes y a gran escala, pipelines de datos y quienes buscan velocidad y fiabilidad.

4. Selenium

es la herramienta de referencia para extraer datos de sitios interactivos o llenos de JavaScript. Automatiza navegadores reales (Chrome, Firefox, etc.), permitiendo simular acciones de usuario como clics, desplazamientos y envío de formularios. Si los datos solo aparecen tras ejecutar JavaScript, Selenium puede conseguirlos—no importa lo complicado que sea el sitio.

es la herramienta de referencia para extraer datos de sitios interactivos o llenos de JavaScript. Automatiza navegadores reales (Chrome, Firefox, etc.), permitiendo simular acciones de usuario como clics, desplazamientos y envío de formularios. Si los datos solo aparecen tras ejecutar JavaScript, Selenium puede conseguirlos—no importa lo complicado que sea el sitio.

¿El pero? Selenium es lento y consume muchos recursos. Ejecutas un navegador completo por cada extracción, así que no esperes procesar miles de páginas por minuto. Pero para esos casos donde nada más funciona, Selenium es imprescindible.

Características principales:

- Automatización total de navegadores (Chrome, Firefox, Edge, etc.)

- Maneja contenido generado por JavaScript y elementos interactivos

- Soporta modo headless para scraping más rápido y sin interfaz

- Gran comunidad y documentación extensa

Ideal para: Scraping de sitios dinámicos, automatización de flujos de login y manejo de CAPTCHAs o interacciones complejas.

5. PyQuery

lleva la sintaxis de jQuery a Python, haciendo que el análisis de HTML sea familiar para quienes han trabajado con jQuery en JavaScript. Usa el rápido analizador

lleva la sintaxis de jQuery a Python, haciendo que el análisis de HTML sea familiar para quienes han trabajado con jQuery en JavaScript. Usa el rápido analizador lxml y permite usar selectores CSS como $('div.classname') para encontrar elementos.

PyQuery es ideal para prototipos rápidos y para desarrolladores que buscan código conciso y legible. Es más rápido que Beautiful Soup para consultas complejas y se integra fácilmente con herramientas asíncronas o Selenium para flujos más avanzados.

Características principales:

- Selectores y sintaxis tipo jQuery en Python

- Análisis rápido con lxml como backend

- Perfecto para quienes vienen de JavaScript

- Soporta encadenamiento y consultas concisas

Ideal para: Prototipos, fans de jQuery y quienes quieren escribir menos código para analizar HTML.

6. LXML

es el velocista del análisis de HTML y XML en Python. Construido sobre las librerías C

es el velocista del análisis de HTML y XML en Python. Construido sobre las librerías C libxml2 y libxslt, es famoso por su rendimiento y potente soporte para XPath y selectores CSS. Si trabajas con documentos grandes o necesitas consultas complejas, lxml es tu mejor opción.

Puede usarse directamente o como backend para Beautiful Soup o PyQuery. La API es un poco más avanzada, pero la velocidad y flexibilidad lo compensan en proyectos grandes.

Características principales:

- El análisis más rápido disponible en Python

- Soporte completo para XPath y selectores CSS

- Maneja documentos grandes y complejos sin despeinarse

- Puede usarse solo o como analizador para otras librerías

Ideal para: Análisis de alto rendimiento, scraping a gran escala y proyectos que requieren consultas avanzadas.

7. Requests

es el estándar de facto para hacer peticiones HTTP en Python. Su API limpia e intuitiva hace que obtener páginas web sea tan simple como

es el estándar de facto para hacer peticiones HTTP en Python. Su API limpia e intuitiva hace que obtener páginas web sea tan simple como requests.get(url). Maneja cookies, sesiones e incluso decodificación JSON de forma nativa.

Aunque Requests es síncrono (cada petición espera a completarse), es perfecto para scripts rápidos y scraping a pequeña escala. Combínalo con Beautiful Soup o lxml para un flujo clásico de scraping.

Características principales:

- API simple y muy pythonica para peticiones HTTP

- Maneja cookies, sesiones y redirecciones

- Se integra perfecto con librerías de análisis

- Comunidad y documentación masivas

Ideal para: Scripts sencillos, scraping de páginas estáticas y quienes quieren empezar rápido.

8. MechanicalSoup

es una librería ligera que automatiza interacciones simples de navegador—como rellenar formularios o navegar flujos de login—sin lanzar un navegador completo. Usa

es una librería ligera que automatiza interacciones simples de navegador—como rellenar formularios o navegar flujos de login—sin lanzar un navegador completo. Usa requests y Beautiful Soup, por lo que es mucho más rápida y ligera que Selenium para sitios que no dependen mucho de JavaScript.

Si necesitas iniciar sesión, enviar formularios o navegar por algunas páginas (y el sitio no es muy dinámico), MechanicalSoup es una excelente opción intermedia.

Características principales:

- Automatiza el llenado de formularios y la navegación

- Construida sobre Requests y Beautiful Soup

- Ligera y rápida (sin la sobrecarga de un navegador)

- Fácil de usar para interactividad moderada

Ideal para: Sitios que requieren login o envío de formularios, tareas de automatización simples y quienes quieren evitar la sobrecarga de Selenium.

9. Aiohttp

es la bestia asíncrona para peticiones web concurrentes y de alta velocidad. Si necesitas extraer cientos de páginas rápido, aiohttp permite lanzar peticiones en paralelo, reduciendo drásticamente el tiempo total. En un benchmark, extraer 50 páginas tomó solo 3 segundos con aiohttp, frente a 16 segundos usando peticiones síncronas ().

es la bestia asíncrona para peticiones web concurrentes y de alta velocidad. Si necesitas extraer cientos de páginas rápido, aiohttp permite lanzar peticiones en paralelo, reduciendo drásticamente el tiempo total. En un benchmark, extraer 50 páginas tomó solo 3 segundos con aiohttp, frente a 16 segundos usando peticiones síncronas ().

Aiohttp requiere escribir código async def y usar await, pero la ganancia de velocidad lo vale para trabajos grandes.

Características principales:

- Framework asíncrono para cliente/servidor HTTP

- Soporta sesiones, cookies y HTTP/2

- Gran aumento de velocidad para peticiones concurrentes

- Se integra con librerías de análisis asíncronas

Ideal para: Scraping de alta velocidad y gran escala, recolección de APIs y quienes dominan la programación asíncrona.

10. Twisted

es el motor de redes orientado a eventos que impulsa Scrapy. Aunque no es una librería de scraping como tal, los usuarios avanzados pueden usar Twisted directamente para crear rastreadores personalizados, manejar protocolos no HTTP o implementar spiders hiperconcurrentes.

es el motor de redes orientado a eventos que impulsa Scrapy. Aunque no es una librería de scraping como tal, los usuarios avanzados pueden usar Twisted directamente para crear rastreadores personalizados, manejar protocolos no HTTP o implementar spiders hiperconcurrentes.

Twisted es potente pero tiene una curva de aprendizaje pronunciada. Es ideal para escenarios muy personalizados o cuando necesitas construir frameworks desde cero.

Características principales:

- Redes orientadas a eventos para HTTP, WebSockets, SSH y más

- Soporta SSL, concurrencia y protocolos personalizados

- Motor asíncrono de Scrapy

- Altamente flexible para casos avanzados

Ideal para: Protocolos personalizados, creación de frameworks de scraping y usuarios avanzados que buscan máximo control.

11. Grab

es un kit de herramientas todo en uno que combina peticiones HTTP, análisis, automatización, rotación de proxies y manejo de CAPTCHAs. Es similar a Scrapy pero busca ser más fácil de aprender y usar, con soporte integrado para proxies, caché y spiders asíncronos.

es un kit de herramientas todo en uno que combina peticiones HTTP, análisis, automatización, rotación de proxies y manejo de CAPTCHAs. Es similar a Scrapy pero busca ser más fácil de aprender y usar, con soporte integrado para proxies, caché y spiders asíncronos.

La función estrella de Grab es su sistema Grab:Spider, que puede ejecutar miles de peticiones en paralelo usando multicurl. Si buscas una solución integral con menos configuración que Scrapy, échale un ojo a Grab.

Características principales:

- Soporte integrado para proxies, rotación de user-agent y caché

- Sistema de spiders asíncronos para alta concurrencia

- Análisis con XPath y arquitectura modular

- Usado en producción para scraping a gran escala

Ideal para: Proyectos de scraping todo en uno, tareas intensivas en proxies y usuarios que quieren potencia sin la complejidad de Scrapy.

12. Urllib3

es el motor HTTP de bajo nivel que impulsa muchos clientes de Python, incluyendo Requests. Ofrece agrupación de conexiones, seguridad en hilos, reintentos y control detallado sobre las conexiones HTTP. Aunque la mayoría lo usa indirectamente, urllib3 es tu opción cuando necesitas máximo rendimiento o construir librerías de más alto nivel.

es el motor HTTP de bajo nivel que impulsa muchos clientes de Python, incluyendo Requests. Ofrece agrupación de conexiones, seguridad en hilos, reintentos y control detallado sobre las conexiones HTTP. Aunque la mayoría lo usa indirectamente, urllib3 es tu opción cuando necesitas máximo rendimiento o construir librerías de más alto nivel.

No es tan amigable para principiantes como Requests, pero es robusto y muy confiable.

Características principales:

- Agrupación de conexiones y seguridad en hilos

- Control detallado sobre conexiones HTTP

- Base para muchas otras librerías

- Alto rendimiento para peticiones repetidas

Ideal para: Clientes HTTP personalizados, rastreadores multihilo y desarrolladores que construyen sobre la pila HTTP de Python.

Tabla comparativa: Paquetes de python para raspado web de un vistazo

| Paquete | Facilidad de uso | Rendimiento | Contenido dinámico | Poder de análisis | Comunidad/Docs | Ideal para |

|---|---|---|---|---|---|---|

| Thunderbit | ★★★★☆ (GUI/IA) | Rápido (nube/local) | Sí (vía IA) | Campos automáticos, subpáginas | En crecimiento (IA) | Leads, investigación de mercado, no-code |

| Beautiful Soup | ★★★★★ (muy fácil) | Medio | No | HTML/XML, tolerante | Enorme | Páginas estáticas, principiantes |

| Scrapy | ★★☆☆☆ (difícil) | ★★★★★ (muy alto) | Solo plugins | CSS/XPath, pipelines | Grande, activa | Scraping a gran escala, recurrente |

| Selenium | ★★☆☆☆ (media) | ★☆☆☆☆ (lento) | Sí (completo) | DOM completo, JS | Madura | Sitios JS, interactivos |

| PyQuery | ★★★★☆ (jQuery) | Rápido (lxml) | No* | Selectores jQuery | Moderada | Prototipos, devs jQuery |

| LXML | ★★★☆☆ (avanzado) | ★★★★★ (el más rápido) | No | XPath/CSS, XML | Moderada | Docs grandes, consultas avanzadas |

| Requests | ★★★★★ (muy fácil) | ★★☆☆☆ (síncrono) | No | HTTP, JSON | Masiva | Scripts simples, páginas estáticas |

| MechanicalSoup | ★★★★☆ (fácil) | ★★☆☆☆ (síncrono) | No | Formularios, navegación | Pequeña | Flujos de login, automatización de formularios |

| Aiohttp | ★★☆☆☆ (asíncrono) | ★★★★★ (concurrente) | No | HTTP asíncrono | Grande (async) | Scraping rápido y concurrente |

| Twisted | ★☆☆☆☆ (complejo) | ★★★★★ (personalizado) | No | Redes, protocolos | Nicho | Frameworks personalizados, usuarios avanzados |

| Grab | ★★★☆☆ (modular) | ★★★★☆ (asíncrono) | No | Proxies, XPath | Pequeña | Todo en uno, proxies/captcha intensivo |

| Urllib3 | ★★★★☆ (bajo nivel) | ★★★★☆ (agrupado) | No | HTTP, agrupación | Masiva | Clientes personalizados, crawlers multihilo |

*PyQuery puede combinarse con Selenium para sitios dinámicos.

¿Cómo elegir el paquete de python para raspado web ideal para ti?

Entonces, ¿cuál deberías elegir? Aquí va una guía rápida:

- Páginas estáticas, trabajos pequeños o eres principiante: Empieza con Requests + Beautiful Soup.

- Scraping a gran escala, recurrente o en producción: Scrapy o Grab (si quieres todo en uno).

- Sitios interactivos o llenos de JavaScript: Selenium (o Thunderbit si prefieres scraping sin código y con IA).

- Scraping rápido y concurrente: Aiohttp (si dominas async).

- Automatización de formularios o login: MechanicalSoup (para sitios simples), Selenium (para JS complejo).

- Análisis avanzado o documentos masivos: LXML o PyQuery.

- Redes o protocolos personalizados: Twisted.

- Prototipos rápidos, generación de leads o datos desordenados: Thunderbit.

Y no tengas miedo de mezclar herramientas—muchos flujos usan varias para máxima eficiencia. Por ejemplo, puedes usar Selenium para renderizar una página y luego pasar el HTML a Beautiful Soup o PyQuery para analizarlo.

Conclusión: Lleva tu raspado web al siguiente nivel con las mejores herramientas de Python

El raspado web en 2026 es más potente—y más necesario—que nunca. Con los paquetes correctos de Python, puedes convertir el caos de la web en datos limpios y útiles para tu negocio, investigación o tu próxima gran idea. Seas un desarrollador experimentado o estés dando tus primeros pasos en el mundo de los datos, aquí seguro encuentras una herramienta que te va como anillo al dedo.

¿Quieres ver cómo es el scraping sin código y potenciado por IA? . Y si buscas más consejos, tutoriales y análisis, pásate por el para estar al día en scraping, automatización y flujos de trabajo basados en datos.

¡Feliz scraping! Que tus selectores siempre acierten, tus proxies nunca te dejen tirado y tus datos sean tan limpios como tu código.

Preguntas frecuentes

1. ¿Cuál es el mejor paquete de python para raspado web para principiantes?

Para la mayoría de los que recién empiezan, la combinación de y es la forma más sencilla de arrancar. Ambos tienen APIs intuitivas, montones de tutoriales y cubren la mayoría de tareas de scraping en páginas estáticas.

2. ¿Cómo puedo extraer datos de sitios web con mucho JavaScript usando Python?

Usa para automatizar un navegador real, o prueba para scraping sin código y con IA que puede manejar contenido dinámico. Para necesidades a gran escala, Scrapy puede combinarse con Splash o Selenium.

3. ¿Qué paquete es mejor para scraping a gran escala y alta velocidad?

está hecho para crawling asíncrono a gran escala. Si necesitas aún más velocidad y dominas el código asíncrono, es una excelente opción para peticiones concurrentes.

4. ¿Puedo combinar estos paquetes en mi flujo de trabajo?

¡Claro! Muchos desarrolladores usan Requests o Selenium para obtener páginas y luego analizan con Beautiful Soup, lxml o PyQuery. Las exportaciones de Thunderbit pueden integrarse en scripts de Python para análisis posterior.

5. ¿Thunderbit es una librería de Python o una herramienta independiente?

Thunderbit es una extensión de Chrome y plataforma con IA, no una librería tradicional de Python. Sin embargo, sus resultados (CSV, Excel, Sheets, Notion, Airtable) se integran fácilmente en pipelines de datos en Python, así que es un gran aliado para desarrolladores Python.

¿Quieres estar al día en el mundo del raspado web? Suscríbete al y mantente atento al para más guías, comparativas y consejos de automatización.

Más información