Cada día se publican en internet entre 2 y 3 millones de artículos de noticias. Intentar recopilar esos datos de forma estructurada —titulares, fechas, fuentes, texto completo— es más o menos tan divertido como montar muebles sin instrucciones.

Llevo años creando y probando herramientas de automatización en , y el panorama del scraping de noticias en 2026 es una mezcla rara de oportunidades enormes y frustraciones muy reales. Google eliminó su News API oficial en 2011, los sitios de noticias aplican cada vez más medidas contra bots (Cloudflare, CAPTCHAs, barreras de renderizado con JavaScript) y los diseños cambian tan a menudo que un scraper que funciona el lunes puede romperse el miércoles. Mientras tanto, equipos de negocio —desde relaciones públicas y ventas hasta investigadores académicos e ingenieros de IA— necesitan más que nunca datos de noticias estructurados.

Así que me propuse probar 15 herramientas de scraping de noticias entre APIs, plataformas sin código y bibliotecas open source. El objetivo: ofrecerte una comparación homogénea sobre precio, carga de mantenimiento, extracción limpia de texto y encaje real para cada caso de uso, algo que ninguna otra guía ofrece.

¿Qué hace destacar a los mejores scrapers de noticias en 2026?

La mayoría de los artículos sobre los «mejores scrapers de noticias» se saltan por completo los criterios de evaluación, así que aquí va lo que realmente probé. La mayoría de esos artículos solo enumeran funciones y siguen adelante. Pero después de años construyendo infraestructura de scraping, he aprendido que los criterios que importan a los usuarios de negocio son muy concretos —y a menudo se pasan por alto.

Este es el marco de evaluación que utilicé:

| Criterio | Qué evalué |

|---|---|

| Enfoque | API, herramienta de navegador sin código o biblioteca open source |

| Gestión anti-bot | Rotación de proxies, resolución de CAPTCHA, compatibilidad con navegador sin interfaz |

| Extracción limpia de texto | ¿Puede eliminar anuncios, barras laterales y navegación, y devolver solo el cuerpo del artículo? |

| Salida de metadatos | Autor, fecha, imágenes, URL de la fuente, categoría |

| Formatos de exportación | CSV, JSON, Google Sheets, Airtable, Notion, etc. |

| Paginación / compatibilidad con lotes | ¿Puede manejar resultados de varias páginas y lotes de URLs? |

| Carga de mantenimiento | ¿Se rompe cuando cambian los diseños del sitio? ¿Adaptativo con IA o basado en selectores? |

| Coste normalizado por 1.000 resultados | Precio comparable de forma homogénea (incluye plan gratuito) |

| Caso de uso ideal | Seguimiento de PR, generación de leads, investigación académica, pipeline de LLM, etc. |

Dos criterios necesitan contexto adicional. El coste normalizado por 1.000 resultados importa porque cada proveedor cobra de forma distinta: por crédito, por solicitud, por búsqueda, por fila. Sin normalizar, estás comparando peras con manzanas. Y la carga de mantenimiento es, con diferencia, el mayor quebradero de cabeza que me mencionan los usuarios. Foro tras foro, la queja es la misma: «a los sitios de noticias les encanta romper mis crawlers todos los martes». Califiqué cada herramienta en una escala de tres niveles:

- 🟢 Bajo mantenimiento: adaptativo con IA o API totalmente gestionada: los cambios de diseño no rompen tu flujo

- 🟡 Mantenimiento medio: gestiona anti-bot, pero tu lógica de extracción todavía puede fallar

- 🔴 Alto mantenimiento: basado en selectores: cuando cambia el sitio, lo arreglas manualmente

¿Qué scraper de noticias encaja con tu rol? Matriz de decisión

Las recomendaciones de scrapers casi siempre tratan a todo el mundo igual, y ese es el problema de fondo. Un responsable de PR que sigue menciones de marca tiene necesidades totalmente distintas a las de un desarrollador Python que construye un pipeline de RAG. Así que, antes de entrar en la lista completa, aquí tienes un marco rápido:

| Caso de uso | Enfoque recomendado | Herramientas recomendadas |

|---|---|---|

| Resumen diario de noticias (sin perfil técnico) | Herramienta de navegador sin código o RSS | Thunderbit, Octoparse, ParseHub |

| Monitoreo de PR / medios a gran escala | News API con alertas | Newscatcher, Webz.io, Newsdata.io |

| Extracción de leads de ventas desde noticias | Scraper con IA y enriquecimiento de subpáginas | Thunderbit (scraping de subpáginas + extracción de email/teléfono), Apify |

| Investigación académica / creación de corpus | Biblioteca open source | Newspaper4k |

| Pipeline de LLM / ingesta para RAG | API que convierte a Markdown | Thunderbit API, ScraperAPI |

| Inteligencia competitiva / precios | Scraping programado | Thunderbit (Scheduled Scraper), Bright Data |

¿Ya sabes en qué grupo estás? Adelante. Si no, el desglose completo de abajo te ayudará.

Los 15 mejores scrapers de noticias de un vistazo

Aquí tienes la comparación principal: precios normalizados al coste por 1.000 resultados en el nivel de pago más bajo, y mantenimiento valorado con la escala de tres niveles.

| Herramienta | Tipo | Plan gratuito | Coste por 1.000 resultados (estim.) | Anti-bot | Texto limpio | Mantenimiento | Caso de uso ideal |

|---|---|---|---|---|---|---|---|

| Thunderbit | IA sin código (extensión de Chrome + nube) | 6 páginas/mes gratis | ~$3–$15 | Fuerte (modos navegador y nube) | Sí (IA + subpágina) | 🟢 Bajo | Equipos de negocio, generación de leads, monitoreo diario |

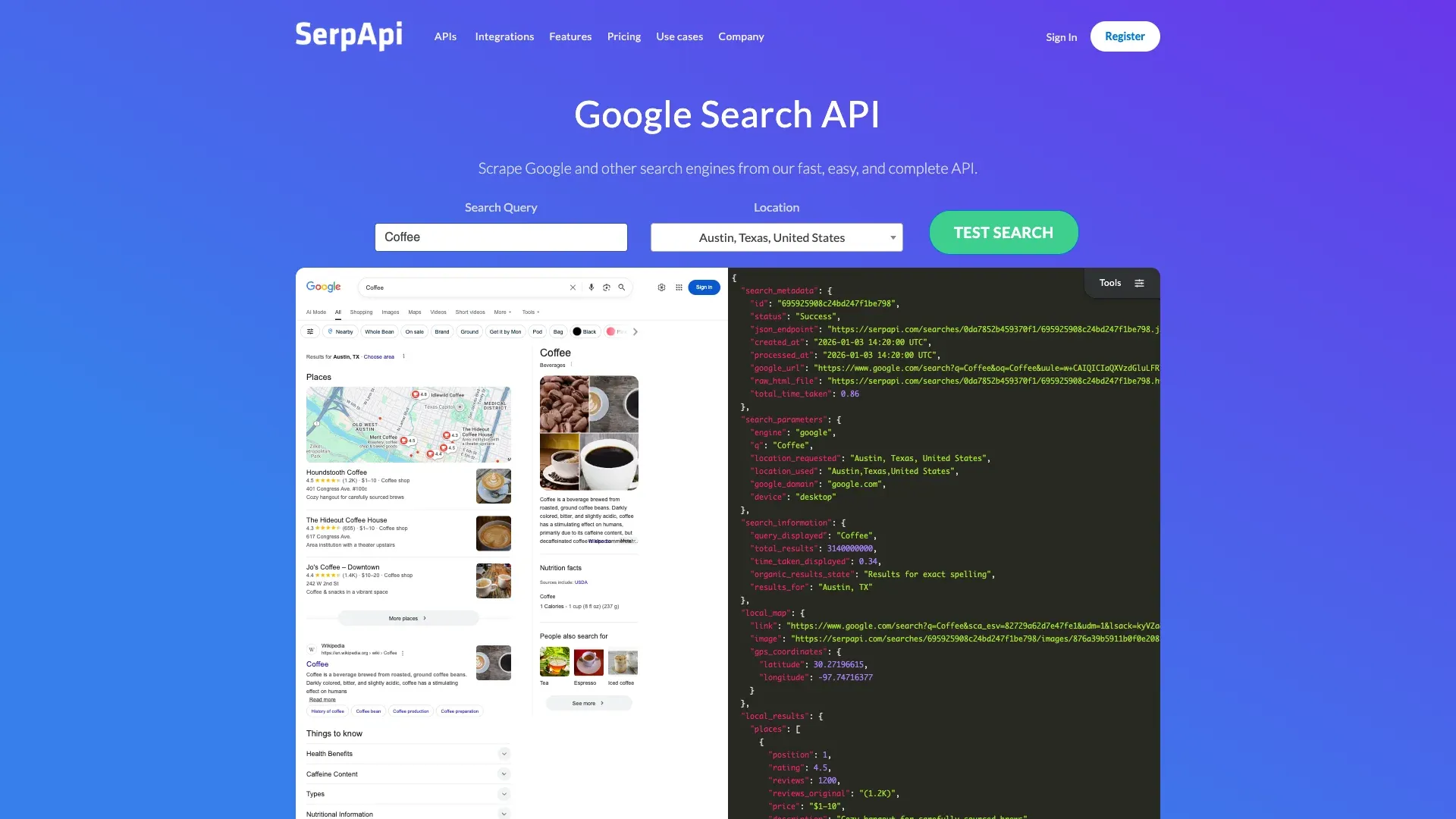

| SerpApi | API | 250 búsquedas/mes | ~$15 | Fuerte (específico para SERP) | No (solo snippets) | 🟢 Bajo | Paneles de Google News SERP |

| ScraperAPI | API | 1.000 créditos/mes | ~$1–$5 | Fuerte (proxy + renderizado JS) | No (HTML en bruto) | 🟡 Medio | Desarrolladores que quieren infraestructura anti-bot |

| Newsdata.io | News API | 200 solicitudes/día | ~$5–$15 | N/A (API gestionada) | Parcial (premium) | 🟢 Bajo | Metadatos de noticias estructurados |

| Apify | Plataforma en la nube | $5 en créditos gratis | ~$1–$6 | Fuerte | Varía según el actor | 🟡 Medio | Flujos de trabajo personalizados en la nube |

| Oxylabs | API empresarial | Prueba de 2.000 resultados | ~$0,50–$2 | Muy fuerte | Parcial | 🟢 Bajo | SERP + web a escala empresarial |

| ScrapingBee | API | Créditos de prueba | ~$2–$5 | Fuerte (Chrome sin interfaz) | Parcial (básico) | 🟡 Medio | Sitios de noticias muy cargados de JS |

| Scrapingdog | API SERP | 1.000 créditos | ~$0,10–$0,50 | Fuerte | No (datos SERP) | 🟢 Bajo | Monitoreo SERP con presupuesto limitado |

| Bright Data | Plataforma empresarial | Prueba de 1.000 solicitudes | ~$0,30–$0,50 | Muy fuerte | Sí (News Scraper) | 🟢 Bajo | Datos de noticias empresariales a gran escala |

| Octoparse | Sin código, escritorio + nube | Plan gratuito limitado | ~$5–$10 (promediado) | Fuerte | Sí (con plantillas) | 🟡 Medio | Scraping visual sin código |

| ParseHub | Sin código, escritorio | 5 proyectos, 200 páginas/ejecución | ~$5–$12 (promediado) | Moderado | Sí (con configuración) | 🔴 Alto | Principiantes, proyectos pequeños |

| Newscatcher | News API | Sin plan gratuito público | Personalizado (empresarial) | N/A (API gestionada) | Sí (enriquecido con NLP) | 🟢 Bajo | Monitoreo de PR/medios |

| Webz.io | Plataforma de datos de noticias | Sin plan gratuito de autoservicio | Personalizado (empresarial) | N/A (feed gestionado) | Sí (texto completo + metadatos) | 🟢 Bajo | Archivos históricos, entrenamiento de LLM |

| Newspaper4k | Python open source | Gratis | $0 (+ costes de servidor) | Ninguno | Sí (diseñado para ello) | 🔴 Alto | Desarrolladores, creación de corpus |

| HasData | API SERP | Créditos gratis | ~$0,25–$0,60 | Fuerte | No (datos SERP) | 🟢 Bajo | Endpoint SERP de noticias con presupuesto ajustado |

Conclusiones rápidas: Scrapingdog y HasData son las opciones API más baratas por solicitud. Thunderbit y Newspaper4k lideran en texto limpio de artículos, aunque de maneras muy distintas. Bright Data y Oxylabs dominan el nivel empresarial. ¿Dolores de cabeza de mantenimiento? Quédate con las herramientas 🟢.

1. Thunderbit — El mejor scraper de noticias con IA sin código para equipos de negocio

es la herramienta que mi equipo y yo creamos específicamente para resolver el problema de «necesito datos de este sitio web y no quiero programar ni mantener selectores». Para scrapear noticias, el flujo es tan simple como puede ser: abres una página de noticias, haces clic en Sugerir campos con IA, revisas las columnas que Thunderbit propone (titular, fecha, fuente, URL, resumen —lee la estructura de la página y detecta qué hay—) y luego pulsas Scrape.

es la herramienta que mi equipo y yo creamos específicamente para resolver el problema de «necesito datos de este sitio web y no quiero programar ni mantener selectores». Para scrapear noticias, el flujo es tan simple como puede ser: abres una página de noticias, haces clic en Sugerir campos con IA, revisas las columnas que Thunderbit propone (titular, fecha, fuente, URL, resumen —lee la estructura de la página y detecta qué hay—) y luego pulsas Scrape.

Varias funciones se combinan para hacer que Thunderbit sea especialmente potente para noticias:

- Extracción adaptable con IA: no hace falta escribir ni mantener selectores CSS. La IA lee el diseño actual de la página cada vez, así que cuando un sitio de noticias se rediseña —y todos lo hacen— tu scraper no se rompe.

- Scraping de subpáginas: después de extraer una lista de enlaces de artículos, puedes hacer clic en Scrape Subpages para visitar cada artículo y extraer el texto completo, el autor, la fecha de publicación y las imágenes. Así obtienes contenido limpio del artículo, no solo titulares.

- Field AI Prompt: puedes indicarle a la IA qué hacer por columna; por ejemplo, «extrae solo el cuerpo principal del artículo, excluye navegación y anuncios» o «clasifica el sentimiento de este artículo como positivo, neutral o negativo». Esto es único entre las herramientas sin código y es increíblemente útil para análisis de noticias.

- Browser Scraping vs. Cloud Scraping: el modo navegador usa tu propia sesión (útil para sitios que bloquean IPs de la nube), mientras que el modo nube puede procesar hasta 50 páginas a la vez para mayor velocidad.

- Scheduled Scraper: configura ejecuciones diarias o semanales con intervalos de tiempo en lenguaje natural; perfecto para seguimiento continuo de noticias.

- Exportación a todas partes: Excel, CSV, Google Sheets, Airtable, Notion: todo compatible.

Precios y limitaciones

Thunderbit ofrece un plan gratuito (6 páginas/mes) y una prueba de 10 páginas. Los planes de pago empiezan en torno a por 500 créditos (1 crédito = 1 fila). La extensión de Chrome es necesaria para el modo navegador. Las funciones de IA consumen créditos, así que un uso intensivo con miles de artículos requerirá un plan de pago, pero para la mayoría de los equipos de negocio que hacen monitoreo diario o investigación semanal, el coste es moderado.

Mantenimiento: 🟢 Bajo. La IA vuelve a leer la página cada vez.

Ideal para: equipos de ventas, PR y operaciones sin perfil técnico que quieren datos de noticias diarios sin construir ni mantener scrapers.

Si quieres ver en más detalle cómo Thunderbit hace , consulta nuestra guía.

2. SerpApi — Lo mejor para datos estructurados de Google News SERP

es una API específica para SERP que devuelve JSON estructurado de resultados de Google News. Si tu caso de uso es «dame los principales resultados de Google News para una palabra clave, estructurados y listos para un panel», SerpApi encaja muy bien. Devuelve titulares, fuente, fecha, snippet y miniatura, pero no el texto completo del artículo. Necesitarías un paso adicional (o una herramienta aparte) para obtener el cuerpo real del artículo.

es una API específica para SERP que devuelve JSON estructurado de resultados de Google News. Si tu caso de uso es «dame los principales resultados de Google News para una palabra clave, estructurados y listos para un panel», SerpApi encaja muy bien. Devuelve titulares, fuente, fecha, snippet y miniatura, pero no el texto completo del artículo. Necesitarías un paso adicional (o una herramienta aparte) para obtener el cuerpo real del artículo.

Funciones clave:

- Salida JSON estructurada desde SERP de Google News

- La detección anti-bot la gestionan ellos (específico para SERP)

- Compatibilidad con varios idiomas y regiones de Google News

Precio: plan gratuito con 250 búsquedas/mes. Los planes de pago empiezan en 75 USD/mes por 5.000 búsquedas, es decir, unos 15 USD por 1.000 resultados.

Limitación: solo devuelve snippets. Si necesitas el texto completo del artículo, SerpApi es el paso uno, no todo el pipeline.

Mantenimiento: 🟢 Bajo (API gestionada, ellos se encargan de los cambios de Google).

Ideal para: desarrolladores que construyen paneles de monitoreo de noticias o alimentan herramientas de analítica con datos SERP.

3. ScraperAPI — La mejor API de scraping económica con rotación de proxies

es una API de scraping de uso general, no específica para noticias, pero funciona bien para obtener páginas de noticias. Su valor principal es la rotación de proxies, el renderizado de JavaScript y la gestión de CAPTCHAs: la infraestructura anti-bot que, de otro modo, tendrías que construir tú mismo.

es una API de scraping de uso general, no específica para noticias, pero funciona bien para obtener páginas de noticias. Su valor principal es la rotación de proxies, el renderizado de JavaScript y la gestión de CAPTCHAs: la infraestructura anti-bot que, de otro modo, tendrías que construir tú mismo.

Funciones clave:

- Rotación de proxies con IPs residenciales y de centros de datos

- Renderizado de JavaScript para sitios de noticias dinámicos

- Gestión de CAPTCHA

- Devuelve HTML en bruto: tú analizas el contenido del artículo

Precio: plan gratuito con 1.000 créditos/mes (más créditos de prueba). El renderizado JS cuesta más créditos por solicitud. Los planes de pago empiezan en 49 USD/mes. El coste normalizado ronda los 1–5 USD por 1.000 solicitudes, según el uso de JS.

Limitación: no incluye análisis de artículos. Obtienes HTML, no texto limpio. Combínalo con Newspaper4k o tu propio parser para extraer artículos.

Mantenimiento: 🟡 Medio (gestiona anti-bot, pero la lógica de extracción la mantienes tú).

Ideal para: desarrolladores que quieren infraestructura anti-bot sin construir su propia red de proxies.

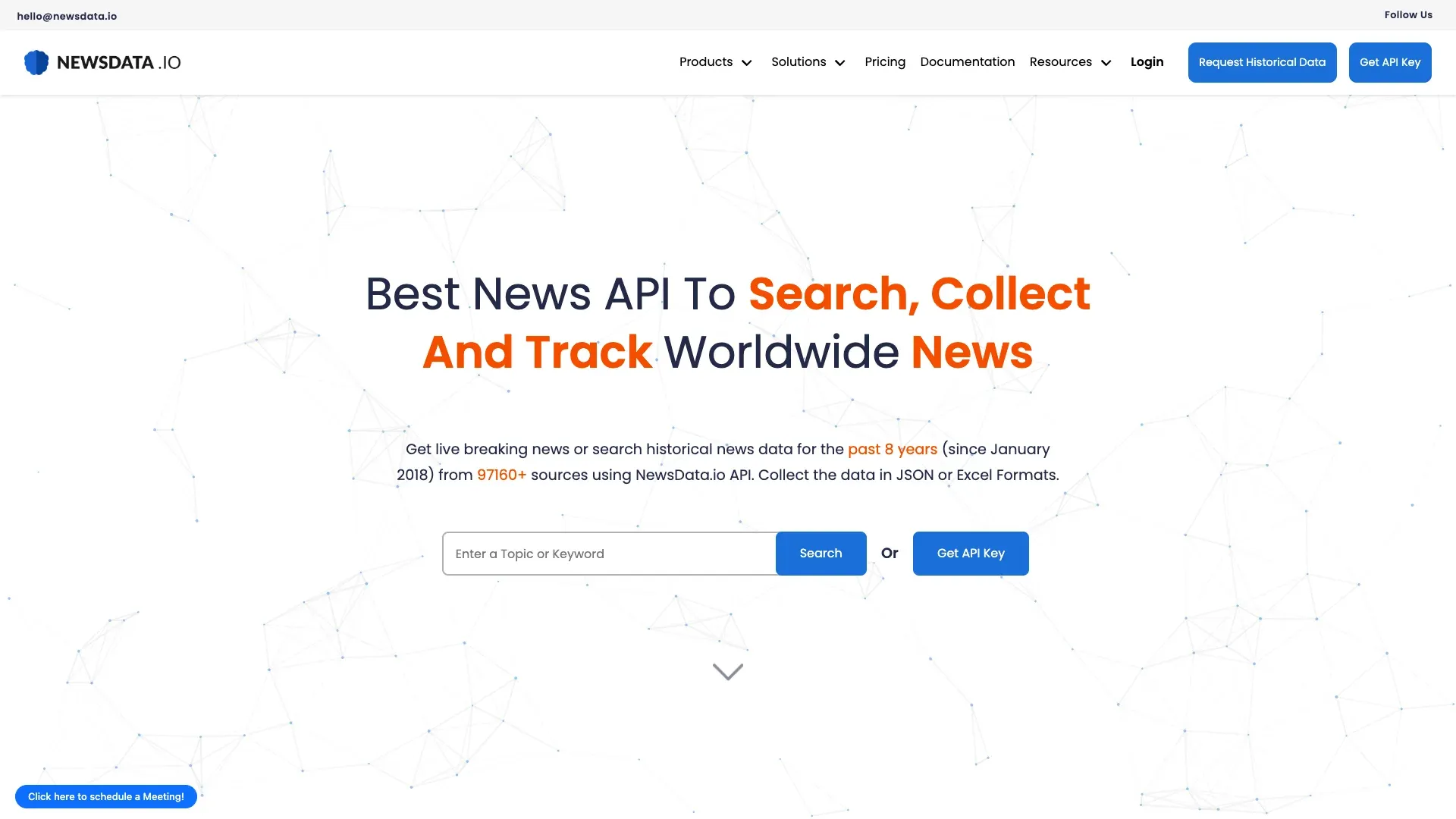

4. Newsdata.io — La mejor API de noticias dedicada para metadatos estructurados

es una API de noticias diseñada específicamente para ello, con cobertura de . Devuelve datos estructurados —título, descripción, fuente, fecha, categorías, sentimiento— y contenido completo del artículo en los planes premium.

es una API de noticias diseñada específicamente para ello, con cobertura de . Devuelve datos estructurados —título, descripción, fuente, fecha, categorías, sentimiento— y contenido completo del artículo en los planes premium.

Funciones clave:

- Consulta por palabra clave, categoría, idioma y país

- Análisis de sentimiento incluido

- Archivo histórico de noticias (planes de pago)

- Sin infraestructura de scraping que administrar

Precio: plan gratuito con 200 solicitudes/día y campos limitados. Los planes de pago desbloquean contenido completo y datos históricos. El coste por 1.000 resultados depende del nivel del plan, pero suele situarse entre 5 y 15 USD.

Limitación: cubre sus propias fuentes indexadas: no puedes señalarle una URL cualquiera y decirle «scrapea esto». Si una publicación de nicho no está en su índice, no la encontrarás aquí.

Mantenimiento: 🟢 Bajo (API de noticias totalmente gestionada).

Ideal para: equipos que necesitan metadatos de noticias estructurados y no quieren gestionar infraestructura de scraping.

5. Apify — La mejor plataforma en la nube para flujos personalizados de scraping de noticias

es una plataforma en la nube basada en actores, con scrapers ya preparados para Google News, publicaciones concretas y extracción general de artículos. Está en un punto intermedio entre el sin código y el desarrollo totalmente a medida.

es una plataforma en la nube basada en actores, con scrapers ya preparados para Google News, publicaciones concretas y extracción general de artículos. Está en un punto intermedio entre el sin código y el desarrollo totalmente a medida.

Funciones clave:

- Actores preconstruidos para Google News, extracción de artículos y más

- Soporta renderizado de JavaScript y ejecución en navegador sin interfaz

- Ejecución en la nube con programación

- Exportación a JSON, CSV, Excel, XML y más

Precio: plan gratuito con . Niveles de pago a 49, 499 y 999 USD/mes. El coste por 1.000 resultados varía según el actor: aproximadamente 1–6 USD para actores de scraping de noticias.

Limitación: los actores preconstruidos los mantiene la comunidad y pueden romperse cuando cambian los sitios de noticias. Requiere más configuración que las herramientas puramente sin código.

Mantenimiento: 🟡 Medio (los actores pueden necesitar actualizaciones cuando cambian los sitios).

Ideal para: equipos que quieren ejecución en la nube y se sienten cómodos eligiendo y configurando actores del marketplace.

6. Oxylabs — La mejor infraestructura de scraping de nivel empresarial

es un servicio de scraping empresarial con más de 100 millones de proxies, resolución de CAPTCHA y renderizado en navegador. Su SERP Scraper API maneja resultados de Google News con geolocalización, y su Web Scraper API funciona para páginas de noticias arbitrarias.

es un servicio de scraping empresarial con más de 100 millones de proxies, resolución de CAPTCHA y renderizado en navegador. Su SERP Scraper API maneja resultados de Google News con geolocalización, y su Web Scraper API funciona para páginas de noticias arbitrarias.

Funciones clave:

- Enorme infraestructura de proxies con geotargeting

- SERP Scraper API para Google News

- Web Scraper API para URLs arbitrarias

- Salida JSON/CSV, solicitudes concurrentes a gran escala

Precio: desde 49 USD/mes para datos SERP. Precios personalizados para grandes volúmenes. Prueba gratuita de hasta 2.000 resultados.

Limitación: caro para equipos pequeños. Diseñado principalmente para operaciones a gran escala.

Mantenimiento: 🟢 Bajo (API empresarial totalmente gestionada).

Ideal para: empresas que necesitan datos de noticias de alto volumen y geolocalizados, con fiabilidad empresarial.

7. ScrapingBee — Lo mejor para sitios de noticias muy cargados de JavaScript

es una API de scraping centrada en el renderizado de JavaScript con ejecución real en navegador. Si el sitio de noticias que necesitas carga el contenido mediante JS del lado del cliente —y muchos sitios modernos lo hacen—, ScrapingBee lo maneja bien.

es una API de scraping centrada en el renderizado de JavaScript con ejecución real en navegador. Si el sitio de noticias que necesitas carga el contenido mediante JS del lado del cliente —y muchos sitios modernos lo hacen—, ScrapingBee lo maneja bien.

Funciones clave:

- Chrome sin interfaz con rotación de proxies

- Gestión de CAPTCHA

- Función básica de «Article Extraction» para algunas páginas

- Devuelve HTML en bruto, JSON o salida estilo Markdown

Precio: planes desde . Basado en créditos, y el renderizado JS consume más. Hay créditos de prueba disponibles.

Limitación: la función de extracción de artículos es básica frente a las alternativas con IA. Principalmente devuelve HTML, así que en la mayoría de flujos seguirás necesitando análisis.

Mantenimiento: 🟡 Medio (gestiona anti-bot, pero la extracción requiere configuración del usuario).

Ideal para: desarrolladores que scrapean sitios de noticias muy cargados de JS y quieren HTML renderizado sin administrar navegadores sin interfaz.

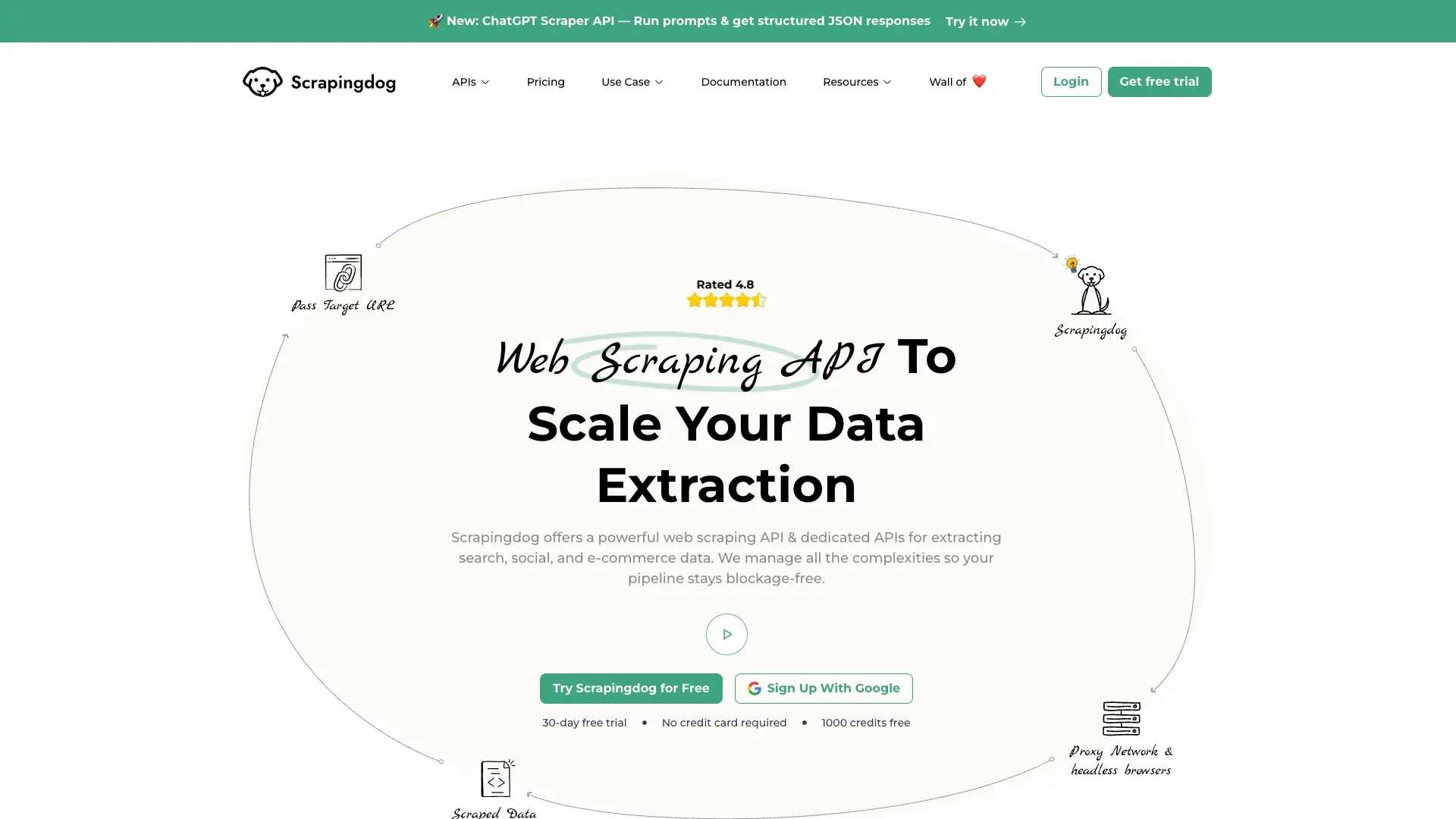

8. Scrapingdog — La mejor API SERP asequible para noticias

es una API SERP de bajo coste con un endpoint dedicado a Google News. Los tiempos de respuesta son rápidos (unos 2 segundos por solicitud en las pruebas) y su precio es el más competitivo de esta lista entre las opciones API.

es una API SERP de bajo coste con un endpoint dedicado a Google News. Los tiempos de respuesta son rápidos (unos 2 segundos por solicitud en las pruebas) y su precio es el más competitivo de esta lista entre las opciones API.

Funciones clave:

- Endpoint dedicado a Google News

- Salida JSON estructurada (titulares, fuente, fecha, snippets)

- Tiempos de respuesta rápidos

Precio: desde 40 USD/mes por 400.000 solicitudes: aproximadamente 0,10 USD por 1.000 resultados, lo que es extraordinariamente barato. Plan gratuito con 1.000 créditos.

Limitación: solo devuelve datos SERP (titulares, snippets), no el contenido completo del artículo. La misma desventaja que SerpApi, pero a una fracción del precio.

Mantenimiento: 🟢 Bajo (API SERP gestionada).

Ideal para: desarrolladores con presupuesto ajustado que necesitan datos SERP de Google News a escala.

9. Bright Data — Lo mejor para datos empresariales de noticias a gran escala

es la gran potencia empresarial. Su plataforma incluye un producto dedicado de News Scraper, una enorme infraestructura de proxies, resolución de CAPTCHA, renderizado en navegador y entrega posterior a S3, Snowflake y más.

es la gran potencia empresarial. Su plataforma incluye un producto dedicado de News Scraper, una enorme infraestructura de proxies, resolución de CAPTCHA, renderizado en navegador y entrega posterior a S3, Snowflake y más.

Funciones clave:

- Producto dedicado de News Scraper

- Conjuntos de datos preconstruidos y recopilación en tiempo real

- Gestión automática de proxies y resolución de CAPTCHA

- Recopilación programada y alertas

- Exportación a JSON, CSV, NDJSON, S3, Snowflake, GCS, Azure, SFTP

Precio: desde ~0,30–0,50 USD por 1.000 registros en pago por uso. Hay planes empresariales personalizados. Prueba gratuita de 1.000 solicitudes.

Limitación: estructura de precios compleja con compromisos mínimos. Diseñado principalmente para presupuestos empresariales.

Mantenimiento: 🟢 Bajo (gestionado por la empresa, alta fiabilidad).

Ideal para: grandes organizaciones que necesitan canales de datos de noticias fiables y de alto volumen.

10. Octoparse — El mejor scraper visual sin código para páginas de noticias

Octoparse es una aplicación de escritorio con un generador visual de flujos de trabajo de apuntar y hacer clic. Tiene plantillas preconstruidas para sitios de noticias comunes, gestiona paginación y scroll infinito, y ofrece ejecución en la nube para tareas programadas.

Octoparse es una aplicación de escritorio con un generador visual de flujos de trabajo de apuntar y hacer clic. Tiene plantillas preconstruidas para sitios de noticias comunes, gestiona paginación y scroll infinito, y ofrece ejecución en la nube para tareas programadas.

Funciones clave:

- Generador visual de flujos de trabajo de apuntar y hacer clic

- Plantillas preconstruidas para sitios de noticias

- Ejecución en la nube con programación

- Rotación de IP y resolución automática de CAPTCHA

- Exportación a Excel, CSV, JSON, bases de datos, Google Sheets

Precio: plan gratuito con 10 tareas y 50.000 exportaciones/mes. Planes de pago desde unos 89 USD/mes.

Limitación: al extraer mediante selectores, los scrapers se rompen cuando los sitios de noticias actualizan el diseño. Requiere correcciones manuales, y los sitios de noticias cambian el diseño con mucha frecuencia.

Mantenimiento: 🟡 Medio (las plantillas ayudan, pero los selectores aún pueden fallar).

Ideal para: usuarios que quieren un generador visual sin código y no les importa mantener plantillas de vez en cuando.

11. ParseHub — La mejor opción gratuita sin código para principiantes

ParseHub es un scraper visual de apuntar y hacer clic con un generoso plan gratuito. Maneja contenido renderizado con JavaScript y funciona bien para proyectos puntuales de investigación o extracción de noticias a pequeña escala.

ParseHub es un scraper visual de apuntar y hacer clic con un generoso plan gratuito. Maneja contenido renderizado con JavaScript y funciona bien para proyectos puntuales de investigación o extracción de noticias a pequeña escala.

Funciones clave:

- Selección visual de elementos (sin código)

- Maneja páginas renderizadas con JavaScript

- Exporta a CSV/JSON

- Plan gratuito: 5 proyectos, 200 páginas por ejecución

Precio: plan gratuito con 5 proyectos y 200 páginas/ejecución. Planes de pago desde 189 USD/mes.

Limitación: basado en selectores CSS, por lo que los scrapers se rompen con frecuencia cuando cambian los diseños. Escalabilidad limitada y más lento que las herramientas API. Los usuarios en Reddit y foros señalan de forma constante la curva de aprendizaje y la fragilidad.

Mantenimiento: 🔴 Alto (los selectores fallan a menudo, sin adaptación con IA).

Ideal para: principiantes que hacen proyectos pequeños y puntuales de investigación de noticias y quieren un punto de partida gratuito.

12. Newscatcher — La mejor API de noticias para PR y monitoreo de medios

es una API de agregación de noticias dedicada que cubre . Está diseñada para monitoreo de medios, seguimiento de PR y análisis de tendencias, con campos enriquecidos por NLP como sentimiento, resumen y extracción de entidades.

es una API de agregación de noticias dedicada que cubre . Está diseñada para monitoreo de medios, seguimiento de PR y análisis de tendencias, con campos enriquecidos por NLP como sentimiento, resumen y extracción de entidades.

Funciones clave:

- Cobertura de más de 70.000 fuentes

- Enriquecimientos NLP: sentimiento, resumen, extracción de entidades, deduplicación, agrupación

- Consulta por palabra clave, tema, fuente, idioma y país

- Acceso a archivo histórico

Precio: precios empresariales (cotización personalizada). No hay plan gratuito público para probarla, aunque pueden ofrecer pruebas bajo petición.

Limitación: el precio orientado a empresas puede quedar fuera del alcance de equipos pequeños. Sin plan gratuito de autoservicio.

Mantenimiento: 🟢 Bajo (API totalmente gestionada).

Ideal para: equipos de PR y monitoreo de medios en empresas medianas y grandes.

13. Webz.io — Lo mejor para archivos históricos de noticias y datos para entrenar LLM

es una plataforma de datos de noticias con un archivo histórico masivo: miles de millones de artículos acumulados durante años. Ofrece tanto feeds en tiempo real como acceso a datos históricos, con salida JSON estructurada que incluye texto completo del artículo, metadatos y enriquecimientos.

es una plataforma de datos de noticias con un archivo histórico masivo: miles de millones de artículos acumulados durante años. Ofrece tanto feeds en tiempo real como acceso a datos históricos, con salida JSON estructurada que incluye texto completo del artículo, metadatos y enriquecimientos.

Funciones clave:

- Miles de millones de artículos en el archivo histórico

- Feeds en tiempo real y acceso a datos históricos

- Texto completo del artículo con metadatos estructurados

- Muy popular entre equipos de IA/ML para conjuntos de entrenamiento y pipelines RAG

Precio: precios empresariales/personalizados (según volumen de datos). Sin plan gratuito de autoservicio para noticias.

Limitación: no está pensado para usuarios ocasionales. Solo precios empresariales.

Mantenimiento: 🟢 Bajo (feed de datos totalmente gestionado).

Ideal para: equipos de IA/ML que crean conjuntos de entrenamiento y equipos empresariales que necesitan archivos históricos profundos de noticias.

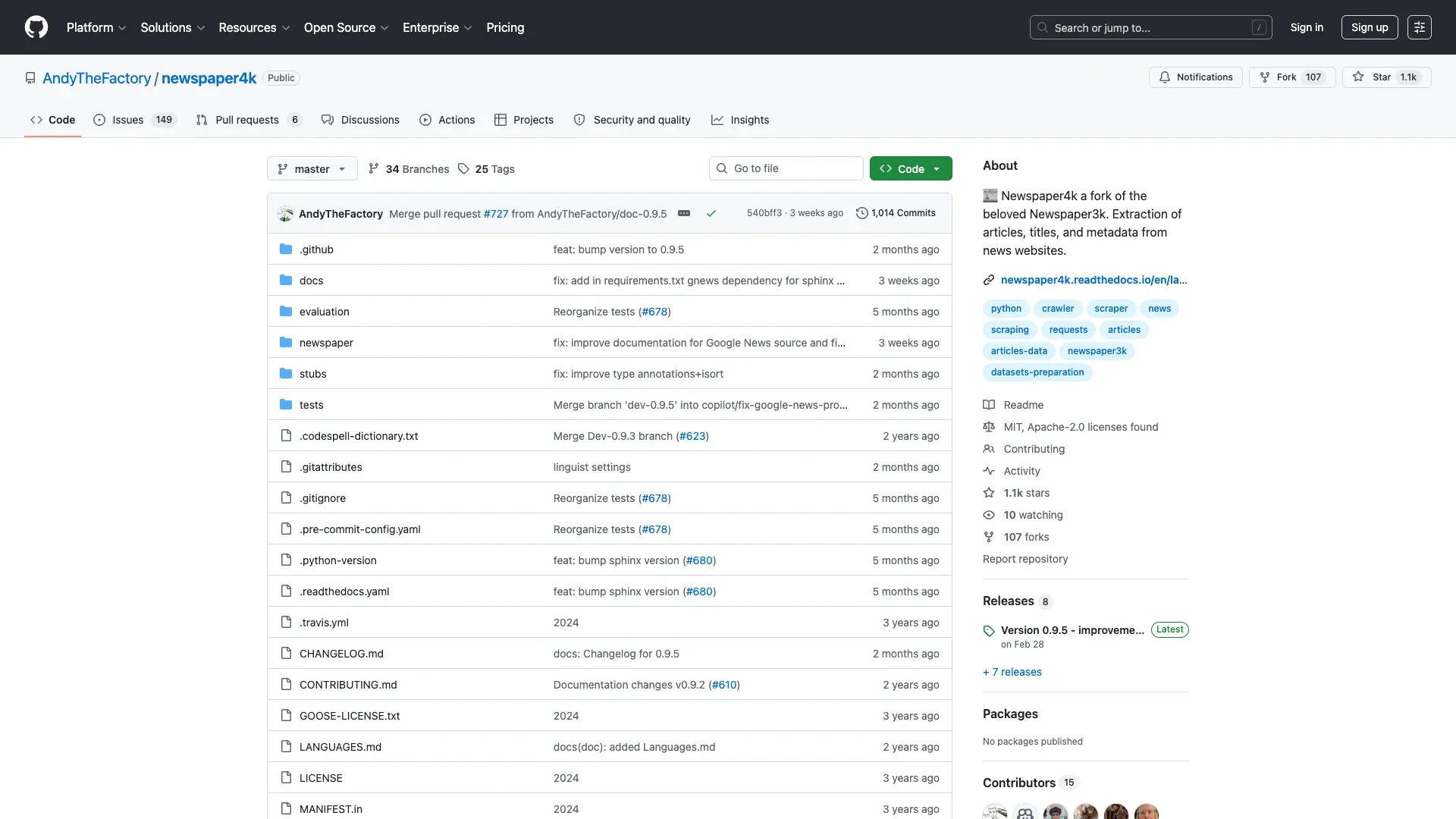

14. Newspaper4k — La mejor biblioteca open source para extraer artículos

es una biblioteca de Python, sucesora de Newspaper3k, diseñada específicamente para extraer contenido limpio de artículos. Elimina anuncios, barras laterales y navegación, y devuelve solo el artículo: título, cuerpo, autores, fecha de publicación, imágenes, palabras clave y resumen.

es una biblioteca de Python, sucesora de Newspaper3k, diseñada específicamente para extraer contenido limpio de artículos. Elimina anuncios, barras laterales y navegación, y devuelve solo el artículo: título, cuerpo, autores, fecha de publicación, imágenes, palabras clave y resumen.

Funciones clave:

- Extrae texto limpio del cuerpo del artículo, eliminando ruido

- Devuelve título, autores, fecha de publicación, imágenes, palabras clave y resumen

- Totalmente gratis y open source

- Ligera y rápida para páginas HTML estáticas

Precio: gratis. Pero necesitarás tu propio servidor, infraestructura de proxies y tiempo de desarrollo.

Limitación: no incluye gestión anti-bot. Falla en sitios de noticias muy dinámicos o renderizados con JS. Requiere conocimientos de Python y un pipeline a medida para cualquier cosa más allá de una extracción básica. Cuando cambia la estructura HTML de un sitio, tú lo arreglas.

Mantenimiento: 🔴 Alto (se rompe cuando cambia el HTML del sitio, requiere correcciones manuales).

Ideal para: desarrolladores Python que construyen pipelines personalizados de extracción de noticias y quieren el máximo control sobre el análisis de artículos.

15. HasData — La mejor API SERP económica con endpoint de noticias

es una API SERP con un endpoint dedicado a Google News. Devuelve JSON estructurado con resultados de noticias a un precio competitivo.

es una API SERP con un endpoint dedicado a Google News. Devuelve JSON estructurado con resultados de noticias a un precio competitivo.

Funciones clave:

- Endpoint dedicado a Google News

- Salida JSON estructurada

- Tiempo de respuesta de unos 3–4 segundos por solicitud

- Créditos gratis para pruebas

Precio: desde (5 créditos por solicitud de noticias = 40.000 solicitudes). Eso equivale a unos 0,25–0,60 USD por 1.000 resultados.

Limitación: devuelve datos SERP (titulares, snippets), no el contenido completo del artículo.

Mantenimiento: 🟢 Bajo (API SERP gestionada).

Ideal para: equipos con presupuesto ajustado que necesitan datos SERP de Google News sin pagar el precio de SerpApi.

Patrones que vale la pena destacar

Después de revisar las 15 herramientas, aparecen varios patrones claros.

Las APIs SERP (SerpApi, Scrapingdog, HasData) son excelentes para datos estructurados de titulares, pero se quedan cortas cuando necesitas el texto completo del artículo. Las APIs de noticias dedicadas (Newsdata.io, Newscatcher, Webz.io) resuelven muy bien el problema de los metadatos, pero no pueden scrapear URLs arbitrarias. Las herramientas sin código (Thunderbit, Octoparse, ParseHub) te dan flexibilidad para scrapear cualquier página, aunque sus perfiles de mantenimiento varían muchísimo. Y Newspaper4k te da la extracción más limpia de artículos, si estás dispuesto a construir y mantener tú mismo el pipeline.

API vs. sin código vs. open source: el coste real por 1.000 artículos

Nadie más normaliza esta comparación entre todas las categorías. Aquí va la cuenta:

| Método | Tiempo de configuración | Coste por 1.000 artículos | Mantenimiento | Ideal para |

|---|---|---|---|---|

| Open source (Newspaper4k) | Horas–días | $0 (pero con coste de servidor + tiempo de desarrollo) | 🔴 Alto | Desarrolladores con necesidades personalizadas |

| API de noticias (Newsdata.io, Newscatcher, Webz.io) | Minutos | $5–$50+ | 🟢 Bajo | Datos estructurados, archivos históricos |

| API de scraping (ScraperAPI, ScrapingBee, Oxylabs) | 30 min | $1–$5 | 🟡 Medio | Desarrolladores que quieren gestión anti-bot |

| IA sin código (Thunderbit, Octoparse, ParseHub) | 2 minutos | $3–$15 | 🟢–🟡 | Usuarios de negocio, equipos sin perfil técnico |

El coste oculto de las herramientas open source «gratuitas» es el tiempo de desarrollo. ¿Un desarrollador senior pasando 4 horas al mes arreglando un pipeline roto de Newspaper4k? Eso no es gratis, es caro.

En el otro extremo, APIs empresariales como Webz.io y Newscatcher tienen poco mantenimiento, pero llevan etiquetas de precio que solo tienen sentido a escala.

Para la mayoría de los equipos de negocio con los que hablo, el punto óptimo suele ser una herramienta de IA sin código —como Thunderbit— para scraping flexible y puntual, o una API de noticias dedicada para un monitoreo estructurado y continuo.

El problema del mantenimiento: por qué la mayoría de los scrapers de noticias se rompen (y cuáles no)

Esto merece su propia sección.

Es la queja número uno que veo en foros, tickets de soporte y conversaciones con usuarios. Los sitios de noticias cambian de diseño constantemente, a veces cada semana. Un scraper basado en selectores CSS o XPath puede funcionar perfectamente hoy y devolver basura mañana.

Así se reparten las 15 herramientas en el espectro de mantenimiento:

| Nivel de mantenimiento | Herramientas | Qué pasa cuando cambia un sitio |

|---|---|---|

| 🟢 Bajo (adaptativo con IA o API gestionada) | Thunderbit, SerpApi, Newsdata.io, Newscatcher, Webz.io, Scrapingdog, HasData, Oxylabs, Bright Data | La IA vuelve a leer la página o el proveedor de la API se encarga. No tienes que tocar nada. |

| 🟡 Medio (plantilla + proxy) | ScraperAPI, ScrapingBee, Apify, Octoparse | Se gestiona el anti-bot, pero tu lógica de extracción o actor/plantilla puede necesitar actualización. |

| 🔴 Alto (basado en selectores) | ParseHub, Newspaper4k | Cuando cambia el sitio, tu scraper se rompe. Tienes que corregir manualmente selectores o reglas de análisis. |

La forma de Thunderbit merece una mención especial: como la IA lee la estructura actual de la página cada vez que ejecutas un scraping, no hay selectores codificados que mantener. He visto a nuestros usuarios scrapear las mismas fuentes de noticias durante meses sin tener que actualizar su configuración, incluso después de que esos sitios cambiaran de diseño. Ese tipo de fiabilidad es lo que importa cuando ejecutas un resumen diario de noticias o un informe competitivo semanal.

Texto limpio de artículos: ¿qué scrapers de noticias eliminan realmente el ruido?

«Conseguí los datos, pero están llenos de anuncios, menús de navegación y basura en la barra lateral». Esa es, aproximadamente, tres de cada cinco preguntas de soporte que veo sobre scraping de noticias.

Aquí va el desglose honesto:

| Capacidad de texto limpio | Herramientas |

|---|---|

| Devuelve texto limpio del artículo de forma nativa | Newspaper4k, Thunderbit (con scraping de subpáginas + Field AI Prompt), Newsdata.io (premium), Webz.io, Bright Data (News Scraper), Newscatcher |

| Devuelve solo titulares/snippets (sin texto completo) | SerpApi, Scrapingdog, HasData, Oxylabs (modo SERP) |

| Devuelve HTML en bruto (el usuario debe analizarlo) | ScraperAPI, ScrapingBee |

| Varía según la configuración | Apify, Octoparse, ParseHub |

Newspaper4k es el estándar de oro para eliminar ruido de páginas de noticias normales: fue creado literalmente para eso. Pero requiere Python y falla en sitios muy cargados de JS.

El Field AI Prompt de Thunderbit es el equivalente sin código: puedes indicarle a la IA por columna que «extraiga solo el cuerpo principal del artículo, excluya navegación y anuncios», y además puede etiquetar, categorizar o resumir el texto durante la extracción. Para equipos que necesitan texto limpio de artículos sin programar, esta es la opción más práctica que he encontrado.

Si te interesa comparar la extracción con IA frente a los métodos tradicionales, nuestro artículo sobre profundiza más.

Scrapear noticias de forma responsable: bases legales y éticas

No encontré ningún otro artículo competitivo que aborde esto, y es una laguna que merece cubrirse, especialmente para lectores empresariales.

robots.txt: compruébalo siempre. Muchos sitios de noticias importantes prohíben explícitamente el scraping de ciertas rutas. Las herramientas responsables —Thunderbit incluido— permiten scraping basado en navegador que respeta el contexto de la sesión, pero aun así deberías revisar el robots.txt del sitio antes de ejecutar trabajos a gran escala.

Términos de servicio: hay una diferencia importante entre extraer metadatos (títulos, fechas, URLs) para investigación interna y republicar artículos completos con copyright. Lo primero suele implicar menos riesgo; lo segundo puede generar exposición legal real. Casos recientes como y muestran que el panorama legal sigue evolucionando.

Buenas prácticas: usa APIs oficiales cuando existan (Google News RSS, Newsdata.io, Newscatcher). Haz caché de forma responsable. Limita la tasa de solicitudes. Nunca eludas paywalls. Varias herramientas de esta lista —incluidas Thunderbit, ScraperAPI y Bright Data— ofrecen limitación de velocidad integrada o funciones de scraping ético que ayudan a mantenerte en el lado correcto de la línea.

Este artículo es informativo y no constituye asesoramiento legal. Si vas a scrapear a escala empresarial, consulta con tu equipo legal.

Cómo encaja Thunderbit en tu flujo de scraping de noticias

Como mi equipo construyó Thunderbit, conozco mejor que nadie sus fortalezas y límites para scrapear noticias. Así es como funciona realmente el flujo.

El flujo típico para un usuario de negocio se ve así:

- Abre una página de noticias (resultados de Google News, la portada de una publicación, una página de búsqueda de tema) en Chrome.

- Haz clic en la extensión de Thunderbit y pulsa AI Suggest Fields. Thunderbit lee la página y propone columnas: titular, fecha, fuente, URL, snippet, imagen, etc.

- Ajusta las columnas si hace falta. ¿Quieres clasificación de sentimiento? Añade una columna con un Field AI Prompt como «clasifica el sentimiento como positivo, neutral o negativo». ¿Quieres solo artículos de una categoría concreta? Añade un prompt de filtro.

- Haz clic en Scrape. Elige el modo Browser (usa tu sesión, útil para sitios que bloquean IPs de la nube) o el modo Cloud (más rápido, procesa hasta 50 páginas a la vez).

- Usa Scrape Subpages para visitar cada URL del artículo y extraer el texto completo, el autor, la fecha de publicación y las imágenes.

- Exporta a Excel, CSV, , Airtable o Notion.

Para monitoreo continuo, el Scheduled Scraper te permite configurar ejecuciones diarias o semanales con intervalos en lenguaje natural (por ejemplo, «todos los días laborables a las 8:00»). Y como Thunderbit soporta , el monitoreo internacional de noticias es sencillo.

Donde Thunderbit es menos ideal: scrapear millones de artículos al mes al menor coste posible por unidad; en ese caso, una API empresarial como Bright Data o Webz.io será más rentable. Y si necesitas enriquecimiento NLP profundo (extracción de entidades, agrupación, deduplicación) integrado en la respuesta de la API, Newscatcher está diseñado precisamente para eso.

Puedes probar Thunderbit gratis mediante la —no hace falta tarjeta de crédito—.

Cómo elegir el scraper de noticias adecuado

Mi chuleta, resumida a partir de probar las 15 herramientas:

- ¿Usuario de negocio sin perfil técnico que quiere datos diarios de noticias? Empieza con Thunderbit. Dos clics, sin código, y la IA gestiona los cambios de diseño.

- ¿Desarrollador construyendo un pipeline de monitoreo? SerpApi o Scrapingdog para datos SERP. ScraperAPI o ScrapingBee para HTML en bruto con anti-bot.

- ¿Equipo empresarial que necesita escala y fiabilidad? Bright Data u Oxylabs.

- ¿Equipo de PR que sigue menciones de marca en miles de fuentes? Newscatcher o Newsdata.io.

- ¿Investigador que construye un corpus de texto? Newspaper4k (si dominas Python) o el scraping de subpáginas de Thunderbit (si no).

- ¿Ingeniero de IA que alimenta un pipeline RAG? Thunderbit API o Webz.io para texto de artículos limpio y estructurado.

- ¿Con presupuesto muy ajustado? Scrapingdog para API, plan gratuito de Thunderbit para sin código, Newspaper4k para open source.

La herramienta adecuada depende de tu tolerancia al mantenimiento, tu presupuesto y tu nivel técnico. ¿No estás seguro? Empieza con un plan gratuito —la mayoría de estas herramientas lo ofrecen— y comprueba qué flujo encaja con tu realidad.

Para más opciones y comparaciones, nuestro resumen de los cubre el panorama más amplio. Y si quieres entender antes de comprometerte con una herramienta, esa guía es un buen punto de partida.

Conclusión

El scraping de noticias en 2026 es un problema resuelto: elige la herramienta adecuada para tu situación y los datos fluyen. Se acabaron las recomendaciones universales. Las APIs SERP son geniales para titulares, pero no te darán el texto del artículo. Las APIs de noticias dedicadas son fantásticas para metadatos estructurados, pero no pueden scrapear URLs arbitrarias. Las herramientas sin código con IA como Thunderbit te dan flexibilidad y poco mantenimiento, mientras que las bibliotecas open source te dan control a cambio de tus fines de semana.

Mi recomendación sincera: decide si necesitas titulares, texto completo del artículo o metadatos enriquecidos, y luego ajústalo al nivel de mantenimiento y presupuesto que puedas sostener. Y si quieres ver cómo es el scraping de noticias moderno y adaptativo con IA sin escribir ni una línea de código, . Creo que te sorprenderá cuánto puedes hacer en unos pocos clics.

Feliz scraping, y que el texto de tus artículos esté siempre limpio, que tus selectores nunca fallen y que tus exportaciones lleguen a la hoja de cálculo correcta.

Preguntas frecuentes

1. ¿Cuál es el mejor scraper de noticias para usuarios sin perfil técnico?

Thunderbit es la mejor opción para usuarios sin perfil técnico. Su flujo de trabajo con IA y 2 clics no requiere código ni selectores CSS. La IA lee automáticamente la estructura de la página, sugiere los campos de extracción y se adapta cuando cambian los diseños, así que no tienes que mantener nada. Además, exporta directamente a Google Sheets, Airtable y Notion.

2. ¿Puedo obtener el texto completo de los artículos con los scrapers de noticias, o solo titulares?

Depende de la herramienta. Las APIs SERP como SerpApi, Scrapingdog y HasData devuelven solo titulares y snippets. Las APIs de noticias dedicadas como Newsdata.io y Webz.io devuelven texto completo en los planes premium. Las herramientas sin código como Thunderbit pueden extraer el texto completo mediante scraping de subpáginas, y Newspaper4k está diseñado específicamente para extraer artículos limpios en Python. Comprueba siempre si una herramienta devuelve HTML en bruto, snippets o el cuerpo limpio del artículo antes de decidirte.

3. ¿Se rompen los scrapers de noticias cuando los sitios web cambian el diseño?

Las herramientas basadas en selectores (ParseHub, Octoparse, Newspaper4k, pipelines custom de Scrapy) se rompen con frecuencia cuando los sitios de noticias actualizan el diseño, y eso ocurre a menudo. Las herramientas adaptativas con IA como Thunderbit vuelven a leer la estructura de la página cada vez, así que los cambios de diseño no rompen el flujo. Las APIs gestionadas (SerpApi, Newsdata.io, Newscatcher) se encargan de los cambios por su cuenta. Si el mantenimiento te preocupa, da prioridad a las herramientas marcadas como 🟢 Bajo en la tabla comparativa.

4. ¿Cuál es la forma más barata de scrapear noticias a escala?

Para scraping basado en API, Scrapingdog ofrece el coste por solicitud más bajo (desde unos 0,10 USD por 1.000 resultados). Para scraping sin código, el plan gratuito de Thunderbit cubre proyectos pequeños y los planes de pago empiezan en unos 9 USD/mes. Para open source, Newspaper4k es gratis, pero ten en cuenta el tiempo de desarrollo y los costes de servidor, que pueden acumularse rápido.

5. ¿Es legal scrapear sitios web de noticias?

Scrapear datos públicamente accesibles para investigación interna suele implicar menos riesgo, pero republicar artículos completos con copyright puede crear exposición legal. Comprueba siempre el robots.txt y los Términos de servicio del sitio antes de scrapear. Usa APIs oficiales cuando existan, respeta los límites de velocidad y nunca eludas paywalls. Casos recientes como hiQ v. LinkedIn y Meta v. Bright Data muestran que el panorama legal sigue evolucionando. Para scraping a escala empresarial, consulta con tu equipo legal.

Más información