¿Qué lenguaje de programación deberías usar para hacer web scraping? Depende de tu proyecto, y he visto a desarrolladores tirar la toalla después de elegir el equivocado.

El mercado del software de web scraping alcanzó los . El lenguaje adecuado puede traducirse en resultados más rápidos y menos mantenimiento. El incorrecto significa scrapers rotos y fines de semana perdidos.

Llevo años creando herramientas de automatización. Aquí tienes siete lenguajes que he usado para scraping, con ejemplos de código, pros y contras honestos, y una mirada a cuándo conviene saltarte el código por completo y usar en su lugar.

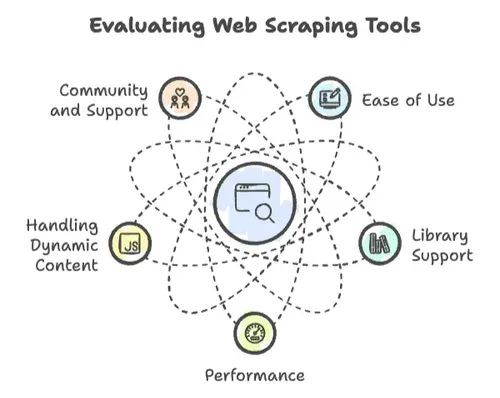

Cómo elegimos el mejor lenguaje para web scraping

Cuando hablamos de web scraping, no todos los lenguajes de programación son iguales. He visto proyectos despegar —y estrellarse— según unos pocos factores clave:

- Facilidad de uso: ¿Qué tan rápido puedes empezar? ¿La sintaxis es amable o necesitas un doctorado en informática solo para imprimir “Hello, World”?

- Soporte de librerías: ¿Hay librerías potentes para peticiones HTTP, análisis de HTML y manejo de contenido dinámico? ¿O estás reinventando la rueda?

- Rendimiento: ¿Puede manejar scraping de millones de páginas o se rinde después de unas pocas centenas?

- Manejo de contenido dinámico: A los sitios modernos les encanta JavaScript. ¿Tu lenguaje puede seguirles el ritmo?

- Comunidad y soporte: Cuando te quedas atascado —y te va a pasar—, ¿hay una comunidad que te eche una mano?

Con base en estos criterios, y después de muchas pruebas hasta altas horas de la noche, estos son los siete lenguajes que voy a cubrir:

- Python: La opción preferida tanto para principiantes como para profesionales.

- JavaScript y Node.js: El rey del contenido dinámico.

- Ruby: Sintaxis limpia, scripts rápidos.

- PHP: Simplicidad del lado del servidor.

- C++: Para cuando necesitas velocidad bruta.

- Java: Preparado para entornos empresariales y escalable.

- Go (Golang): Rápido y concurrente.

Y si estás pensando: “Shuai, yo no quiero programar nada”, quédate hasta el final para ver Thunderbit.

Web scraping con Python: la potencia fácil para principiantes

Empecemos con la favorita del público: Python. Si preguntas en una sala llena de gente de datos cuál es el mejor lenguaje de programación para web scraping, escucharás Python resonar como un cántico en un concierto de Taylor Swift.

¿Por qué Python?

- Sintaxis apta para principiantes: Puedes leer código Python en voz alta y casi suena a inglés.

- Soporte de librerías incomparable: Desde para analizar HTML, para rastreo a gran escala, para HTTP y para automatización del navegador; Python lo tiene todo.

- Comunidad enorme: Más de solo sobre web scraping.

Ejemplo de código Python: extraer el título de una página

1import requests

2from bs4 import BeautifulSoup

3response = requests.get("<https://example.com>")

4soup = BeautifulSoup(response.text, 'html.parser')

5title = soup.title.string

6print(f"Título de la página: \{title\}")Ventajas:

- Desarrollo y prototipado rápidos.

- Montones de tutoriales y respuestas a preguntas.

- Genial para análisis de datos: extrae con Python, analiza con pandas y visualiza con matplotlib.

- Las librerías siguen evolucionando: la versión 2.14 de Scrapy (enero de 2026) trajo

async/awaitnativo a todo el framework, así que la historia de asincronía ya no es solo cosa de Selenium o Playwright.

Limitaciones:

- Más lento que los lenguajes compilados para trabajos masivos.

- Manejar sitios súper dinámicos puede volverse torpe, aunque Selenium y Playwright ayudan.

- No es ideal para extraer millones de páginas a toda velocidad.

Conclusión:

Si eres nuevo en scraping o solo quieres sacar adelante el trabajo rápido, Python es el mejor lenguaje para web scraping, sin discusión. .

JavaScript y Node.js: scraping de sitios dinámicos con facilidad

Si Python es la navaja suiza, JavaScript (y Node.js) es el taladro eléctrico, especialmente para extraer datos de sitios modernos y cargados de JavaScript.

¿Por qué JavaScript/Node.js?

- Nativo para contenido dinámico: Se ejecuta en el navegador, así que puede ver lo mismo que ve el usuario, aunque la página esté construida con React, Angular o Vue.

- Asincronía por defecto: Node.js puede manejar cientos de solicitudes a la vez.

- Familiar para desarrolladores web: Si has creado una web, ya conoces algo de JavaScript.

Librerías clave:

- : Multi-navegador (Chromium, Firefox, WebKit) con esperas automáticas y proxies por contexto. Si vas a empezar un nuevo scraper en Node en 2026, esta es la opción por defecto.

- : Chrome sin interfaz mediante Chrome DevTools Protocol. Sigue siendo sólido para trabajos solo con Chrome y con menos dependencias.

- : análisis de HTML estilo jQuery para Node cuando no necesitas un navegador real.

Ejemplo de código Node.js: extraer el título de una página con Puppeteer

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('<https://example.com>', { waitUntil: 'networkidle2' });

6 const title = await page.title();

7 console.log(`Título de la página: $\{title\}`);

8 await browser.close();

9})();Ventajas:

- Maneja de forma nativa contenido renderizado con JavaScript.

- Ideal para páginas con scroll infinito, pop-ups y sitios interactivos.

- Eficiente para scraping concurrente y a gran escala.

Limitaciones:

- La programación asíncrona puede ser complicada para principiantes.

- Los navegadores headless consumen mucha memoria si ejecutas demasiados a la vez.

- Hay menos herramientas de análisis de datos que en Python.

¿Cuándo es JavaScript/Node.js el mejor lenguaje de programación para web scraping?

Cuando tu sitio objetivo es dinámico o quieres automatizar acciones del navegador. .

Ruby: sintaxis limpia para scripts rápidos de web scraping

Ruby no es solo para aplicaciones Rails y código elegante. Es una gran opción para web scraping, sobre todo si te gusta que tu código se lea como un haiku.

¿Por qué Ruby?

- Sintaxis legible y expresiva: Puedes escribir un scraper en Ruby que casi se lee tan fácil como tu lista de la compra.

- Ideal para prototipos: Rápido de escribir y fácil de ajustar.

- Librerías clave: para análisis, para automatizar la navegación.

Ejemplo de código Ruby: extraer el título de una página

1require 'open-uri'

2require 'nokogiri'

3html = URI.open("<https://example.com>")

4doc = Nokogiri::HTML(html)

5title = doc.at('title').text

6puts "Título de la página: #\{title\}"Ventajas:

- Súper legible y conciso.

- Genial para proyectos pequeños, scripts puntuales o si ya usas Ruby.

Limitaciones:

- Más lento que Python o Node.js para trabajos grandes.

- Menos librerías de scraping y menos apoyo de la comunidad para scraping.

- No es ideal para sitios con mucho JavaScript, aunque puedes usar Watir o Selenium.

Mejor encaje:

Si ya programas en Ruby o quieres hacer un script rápido, Ruby da gusto. Para scraping masivo y dinámico, mejor busca otra opción.

PHP: simplicidad del lado del servidor para extraer datos web

PHP puede parecer una reliquia de la web temprana, pero sigue muy vivo, especialmente si quieres extraer datos directamente en tu servidor.

¿Por qué PHP?

- Funciona en todas partes: La mayoría de los servidores web ya tienen PHP.

- Fácil de integrar con aplicaciones web: Extrae y muestra datos en tu sitio de una sola vez.

- Librerías clave: para HTTP, para peticiones, para automatización de navegador sin interfaz.

Ejemplo de código PHP: extraer el título de una página

1<?php

2$ch = curl_init("<https://example.com>");

3curl_setopt($ch, CURLOPT_RETURNTRANSFER, true);

4$html = curl_exec($ch);

5curl_close($ch);

6$dom = new DOMDocument();

7@$dom->loadHTML($html);

8$title = $dom->getElementsByTagName("title")->item(0)->nodeValue;

9echo "Título de la página: $title\n";

10?>Ventajas:

- Fácil de desplegar en servidores web.

- Bueno para scraping como parte de un flujo de trabajo web.

- Rápido para tareas simples de scraping del lado del servidor.

Limitaciones:

- Soporte de librerías limitado para scraping avanzado.

- No está pensado para alta concurrencia ni para scraping a escala.

- Manejar sitios con mucho JavaScript es complicado, aunque Panther ayuda.

Mejor encaje:

Si tu stack ya es PHP o quieres extraer y mostrar datos en tu sitio, PHP es una opción práctica. .

C++: scraping de alto rendimiento para proyectos a gran escala

C++ es el muscle car de los lenguajes de programación. Si necesitas velocidad bruta y control, y no te asusta un poco de trabajo manual, C++ puede llevarte lejos.

¿Por qué C++?

- Rapidísimo: Supera a la mayoría de los lenguajes en tareas ligadas a CPU.

- Control fino: Gestiona memoria, hilos y ajustes de rendimiento.

- Librerías clave: para HTTP, para análisis.

Ejemplo de código C++: extraer el título de una página

1#include <curl/curl.h>

2#include <iostream>

3#include <string>

4size_t WriteCallback(void* contents, size_t size, size_t nmemb, void* userp) {

5 std::string* html = static_cast<std::string*>(userp);

6 size_t totalSize = size * nmemb;

7 html->append(static_cast<char*>(contents), totalSize);

8 return totalSize;

9}

10int main() {

11 CURL* curl = curl_easy_init();

12 std::string html;

13 if(curl) {

14 curl_easy_setopt(curl, CURLOPT_URL, "<https://example.com>");

15 curl_easy_setopt(curl, CURLOPT_WRITEFUNCTION, WriteCallback);

16 curl_easy_setopt(curl, CURLOPT_WRITEDATA, &html);

17 CURLcode res = curl_easy_perform(curl);

18 curl_easy_cleanup(curl);

19 }

20 std::size_t startPos = html.find("<title>");

21 std::size_t endPos = html.find("</title>");

22 if(startPos != std::string::npos && endPos != std::string::npos) {

23 startPos += 7;

24 std::string title = html.substr(startPos, endPos - startPos);

25 std::cout << "Título de la página: " << title << std::endl;

26 } else {

27 std::cout << "No se encontró la etiqueta title" << std::endl;

28 }

29 return 0;

30}Ventajas:

- Velocidad imbatible para trabajos masivos de scraping.

- Excelente para integrar scraping en sistemas de alto rendimiento.

Limitaciones:

- Curva de aprendizaje pronunciada.

- Gestión manual de memoria.

- Librerías de alto nivel limitadas; no es ideal para contenido dinámico.

Mejor encaje:

Cuando necesitas extraer millones de páginas o el rendimiento es absolutamente crítico. En caso contrario, quizá pases más tiempo depurando que extrayendo datos.

Java: soluciones empresariales de web scraping

Java es el caballo de batalla del mundo empresarial. Si estás construyendo algo que deba funcionar sin parar, manejar enormes volúmenes de datos y sobrevivir a un apocalipsis zombi, Java es tu amigo.

¿Por qué Java?

- Robusto y escalable: Excelente para proyectos grandes y de larga duración.

- Tipado fuerte y buen manejo de errores: Menos sorpresas en producción.

- Librerías clave: para análisis, para automatización del navegador, para HTTP.

Ejemplo de código Java: extraer el título de una página

1import org.jsoup.Jsoup;

2import org.jsoup.nodes.Document;

3public class ScrapeTitle {

4 public static void main(String[] args) throws Exception {

5 Document doc = Jsoup.connect("<https://example.com>").get();

6 String title = doc.title();

7 System.out.println("Título de la página: " + title);

8 }

9}Ventajas:

- Alto rendimiento y concurrencia.

- Excelente para bases de código grandes y mantenibles.

- Buen soporte para contenido dinámico mediante Selenium o HtmlUnit.

Limitaciones:

- Sintaxis verbosa; requiere más configuración que los lenguajes de scripting.

- Excesivo para scripts pequeños y puntuales.

Mejor encaje:

Scraping a escala empresarial o cuando necesitas una fiabilidad y escalabilidad a prueba de balas.

Go (Golang): scraping rápido y concurrente

Go es el recién llegado, pero ya está dando mucho de qué hablar, especialmente para scraping rápido y concurrente.

¿Por qué Go?

- Velocidad de compilación: Casi tan rápido como C++.

- Concurrencia integrada: Las goroutines hacen que el scraping en paralelo sea pan comido.

- Librerías clave: para scraping, para análisis.

Ejemplo de código Go: extraer el título de una página

1package main

2import (

3 "fmt"

4 "github.com/gocolly/colly"

5)

6func main() {

7 c := colly.NewCollector()

8 c.OnHTML("title", func(e *colly.HTMLElement) {

9 fmt.Println("Título de la página:", e.Text)

10 })

11 err := c.Visit("<https://example.com>")

12 if err != nil {

13 fmt.Println("Error:", err)

14 }

15}Ventajas:

- Rapidísimo y eficiente para scraping a gran escala.

- Fácil de desplegar, con un binario único.

- Excelente para rastreo concurrente.

Limitaciones:

- Comunidad más pequeña que la de Python o Node.js.

- Menos librerías de scraping de alto nivel.

- Manejar sitios con mucho JavaScript requiere configuración adicional (Chromedp o Selenium).

Mejor encaje:

Cuando necesitas scraping a escala o Python simplemente no es lo bastante rápido. .

Comparación de los mejores lenguajes de programación para web scraping

Vamos a ponerlo todo junto. Aquí tienes una comparación lado a lado para ayudarte a elegir el mejor lenguaje para web scraping en 2026:

| Lenguaje/Herramienta | Facilidad de uso | Rendimiento | Soporte de librerías | Manejo de contenido dinámico | Mejor caso de uso |

|---|---|---|---|---|---|

| Python | Muy alta | Moderado | Excelente | Bueno (Selenium/Playwright) | Uso general, principiantes, análisis de datos |

| JavaScript/Node.js | Media | Alta | Sólido | Excelente (nativo) | Sitios dinámicos, scraping asíncrono, desarrolladores web |

| Ruby | Alta | Moderado | Decente | Limitado (Watir) | Scripts rápidos, prototipado |

| PHP | Media | Moderado | Aceptable | Limitado (Panther) | Lado del servidor, integración con apps web |

| C++ | Baja | Muy alta | Limitado | Muy limitado | Rendimiento crítico, gran escala |

| Java | Media | Alta | Bueno | Bueno (Selenium/HtmlUnit) | Entornos empresariales, servicios de larga duración |

| Go (Golang) | Media | Muy alta | En crecimiento | Moderado (Chromedp) | Scraping rápido y concurrente |

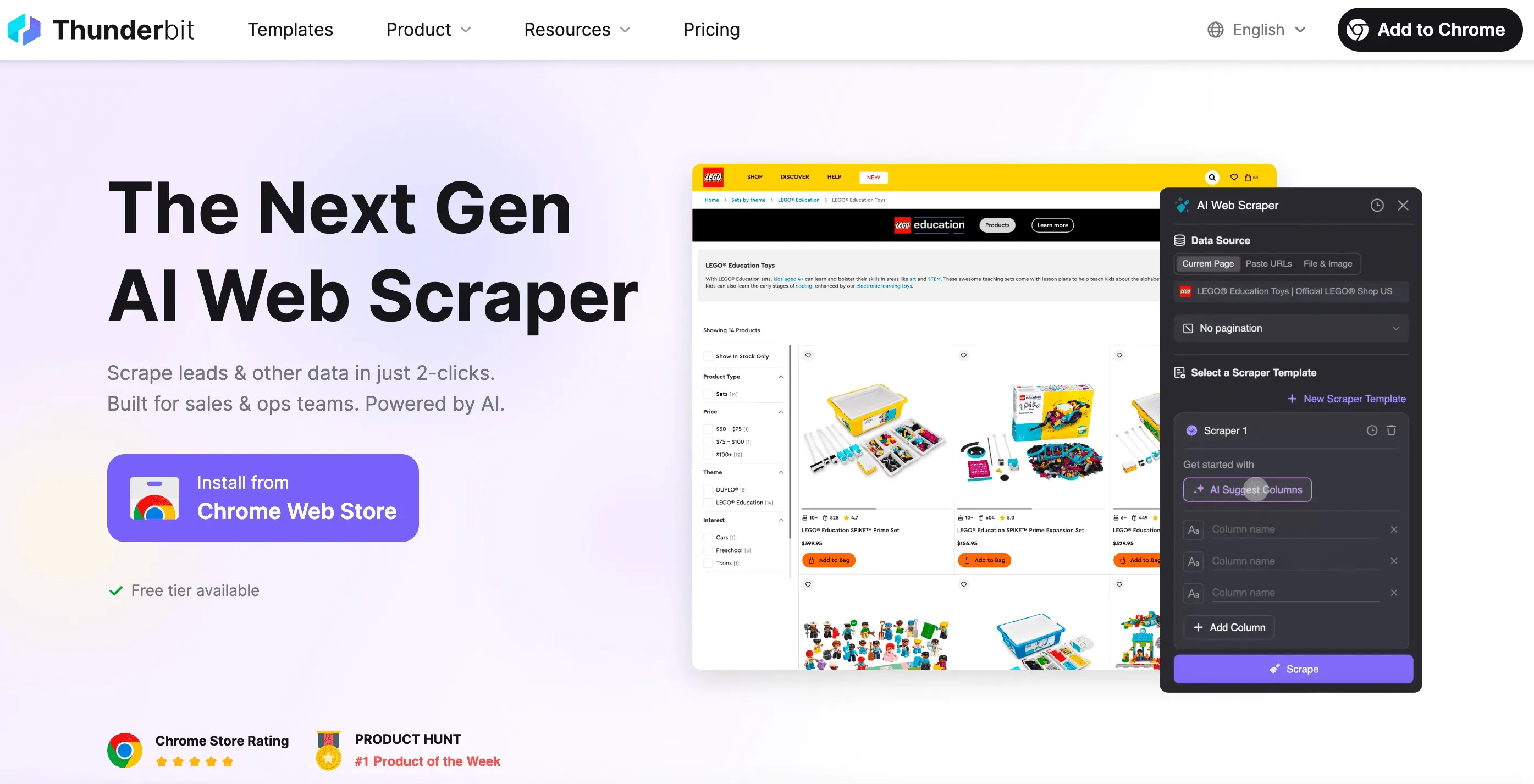

Cuándo saltarte el código: Thunderbit como solución de web scraping sin código

Vale, seamos honestos: a veces solo quieres los datos, sin el código, la depuración ni el dolor de cabeza de “¿por qué no funciona este selector?”. Ahí es donde entra .

Como cofundador de Thunderbit, quise crear una herramienta que hiciera el web scraping tan fácil como pedir comida para llevar. Esto es lo que diferencia a Thunderbit:

- Configuración en 2 clics: Solo haz clic en “AI Suggest Fields” y “Scrape”. Sin pelearte con peticiones HTTP, proxies ni trucos anti-bot.

- Plantillas inteligentes: Una sola plantilla de scraper puede adaptarse a varios diseños de página. No hace falta reescribir el scraper cada vez que cambia un sitio.

- Scraping en navegador y en la nube: Elige entre extraer en tu navegador —ideal para sitios con inicio de sesión— o en la nube, súper rápido para datos públicos.

- Maneja contenido dinámico: La IA de Thunderbit controla un navegador real, así que puede con scroll infinito, pop-ups, inicios de sesión y mucho más.

- Exporta donde quieras: Descarga a Excel, Google Sheets, Airtable, Notion o simplemente copia al portapapeles.

- Sin mantenimiento: Si un sitio cambia, solo vuelve a ejecutar la sugerencia de IA. Se acabaron las sesiones de depuración a medianoche.

- Programación y automatización: Configura scrapers para que se ejecuten según un horario, sin cron jobs ni configuración de servidor.

- Extractores especializados: ¿Necesitas emails, teléfonos o imágenes? Thunderbit también tiene extractores con un clic para eso.

¿Y lo mejor? No necesitas saber ni una sola línea de código. Thunderbit está pensado para usuarios de negocio, marketers, equipos de ventas, profesionales inmobiliarios: cualquiera que necesite datos, y los necesite rápido.

¿Quieres ver Thunderbit en acción? o visita nuestro para ver demostraciones.

Conclusión: elegir el mejor lenguaje para web scraping en 2026

El web scraping en 2026 es más accesible y más potente que nunca. Esto es lo que he aprendido tras años en las trincheras de la automatización:

- Python sigue siendo el mejor lenguaje para web scraping si quieres empezar rápido y tener montones de recursos a mano.

- JavaScript/Node.js es imbatible para extraer datos de sitios dinámicos y cargados de JavaScript.

- Ruby y PHP son geniales para scripts rápidos e integración web, especialmente si ya los usas.

- C++ y Go son tus aliados cuando necesitas velocidad y escala.

- Java es la opción habitual para proyectos empresariales y de largo plazo.

- ¿Y si quieres saltarte el código por completo? es tu arma secreta.

Antes de lanzarte, pregúntate:

- ¿Qué tan grande es mi proyecto?

- ¿Necesito manejar contenido dinámico?

- ¿Cuál es mi nivel de comodidad técnica?

- ¿Quiero construir algo o solo obtener los datos?

Prueba uno de los fragmentos de código anteriores o dale una oportunidad a Thunderbit en tu próximo proyecto. Y si quieres profundizar más, echa un vistazo a nuestro para más guías, consejos e historias reales de scraping.

Feliz scraping, y que tus datos estén siempre limpios, estructurados y a un clic de distancia.

P.D. Si alguna vez te encuentras atrapado en una madriguera de web scraping a las 2 de la madrugada, recuerda: siempre está Thunderbit. O el café. O ambos.

Preguntas frecuentes

1. ¿Cuál es el mejor lenguaje de programación para web scraping en 2026?

Python sigue siendo la mejor opción gracias a su sintaxis legible, sus librerías potentes (como BeautifulSoup, Scrapy y Selenium) y su gran comunidad. Es ideal tanto para principiantes como para profesionales, especialmente si combinas scraping con análisis de datos.

2. ¿Qué lenguaje es mejor para extraer datos de sitios web con mucho JavaScript?

JavaScript (Node.js) es la mejor opción para sitios dinámicos. Herramientas como Puppeteer y Playwright te dan control total del navegador y te permiten interactuar con contenido cargado con React, Vue o Angular.

3. ¿Existe una opción sin código para web scraping?

Sí, es un raspador web IA sin código que lo maneja todo, desde contenido dinámico hasta programación. Solo haz clic en “AI Suggest Fields” y empieza a extraer datos. Es perfecto para equipos de ventas, marketing u operaciones que necesitan datos estructurados rápidamente.

4. ¿Todavía necesito elegir un lenguaje si un agente de programación con IA puede escribir el scraper por mí?

Pregunta muy razonable en 2026. Herramientas como Claude Code, Cursor y OpenAI Codex generarán encantadas un spider de Scrapy, un script de Playwright o un crawler de Go + Colly a partir de un prompt de un solo párrafo, así que la fricción de “qué lenguaje aprendo primero” es realmente menor que hace dos años. Pero el agente sigue generando código en algún lenguaje, y tú —o quien herede el proyecto— acabarás leyéndolo, depurándolo y desplegándolo. Así que la elección sigue importando; solo que ahora importa más para el mantenimiento que para las primeras 30 líneas. Si no quieres tocar ni una línea de código, ahí encaja : se salta por completo la pregunta del lenguaje.

Más información: