La web ya no es solo un patio de recreo digital: es el mayor almacén de datos del mundo, y desde los equipos de ventas hasta los analistas de mercado están corriendo para sacarle partido. Pero seamos sinceros: intentar recopilar datos web a mano es tan entretenido como montar muebles de IKEA sin instrucciones (y con el doble de tornillos sobrantes).

A medida que las empresas dependen más de la inteligencia de mercado en tiempo real, los precios competitivos y la generación de leads, la necesidad de herramientas de rastreo de datos eficientes y fiables nunca ha sido mayor. De hecho, casi para tomar decisiones, y el mercado global de web scraping va camino de .

Si estás harto de copiar y pegar, de perder leads nuevos o simplemente quieres ver lo que es posible cuando dejas que la automatización haga el trabajo pesado, estás en el sitio correcto. Llevo años creando y probando herramientas de extracción web (y sí, liderando el equipo de ), así que sé de primera mano cómo la herramienta adecuada puede convertir horas de trabajo repetitivo en un proceso de dos clics. Tanto si eres una persona sin conocimientos de programación que busca resultados inmediatos como si eres un desarrollador que quiere control total, esta lista de las 10 mejores herramientas de rastreo de datos te ayudará a encontrar la opción ideal.

Por qué importa elegir bien las herramientas de rastreo de datos

Seamos claros: la diferencia entre una buena herramienta de rastreo de datos y una mediocre no es solo la comodidad; es una vía directa hacia el crecimiento del negocio. Cuando automatizas la extracción web, no solo ahorras tiempo (aunque un usuario de G2 comentó que había ), sino que también reduces errores, desbloqueas nuevas oportunidades y te aseguras de que tu equipo trabaje siempre con los datos más frescos y precisos. La investigación manual es lenta, propensa a errores y, cuando terminas, a menudo ya está desactualizada. Con la herramienta adecuada, puedes monitorizar competidores, seguir precios o crear listas de leads en minutos, no en días.

Un caso concreto: una empresa de cosmética usó web scraping para vigilar el stock y los precios de la competencia, . Ese es el tipo de impacto que no puedes conseguir con hojas de cálculo y esfuerzo a base de codos.

Cómo evaluamos las mejores herramientas de rastreo de datos

Con tantas opciones disponibles, elegir la herramienta de rastreo de datos adecuada puede sentirse como una cita rápida en una conferencia tecnológica. Estos son los criterios que utilicé para separar lo mejor del resto:

- Facilidad de uso: ¿Puedes empezar sin un doctorado en Python? ¿Hay una interfaz visual o asistencia con IA para quienes no programan?

- Capacidades de automatización: ¿Gestiona paginación, subpáginas, contenido dinámico y programación? ¿Puede ejecutarse en la nube para tareas grandes?

- Precio y escalabilidad: ¿Tiene un plan gratuito o una opción de entrada asequible? ¿Cómo escala el coste a medida que crecen tus necesidades de datos?

- Conjunto de funciones e integraciones: ¿Puedes exportar a Excel, Google Sheets o mediante API? ¿Incluye plantillas, programación o funciones integradas de limpieza de datos?

- Para quién es mejor: ¿Para quién está realmente pensada la herramienta: usuarios de negocio, desarrolladores o equipos empresariales?

Al final incluyo una tabla comparativa rápida para que puedas ver cómo se posiciona cada herramienta.

Ahora, vamos a ver las 10 mejores herramientas de rastreo de datos para una extracción web eficiente en 2026.

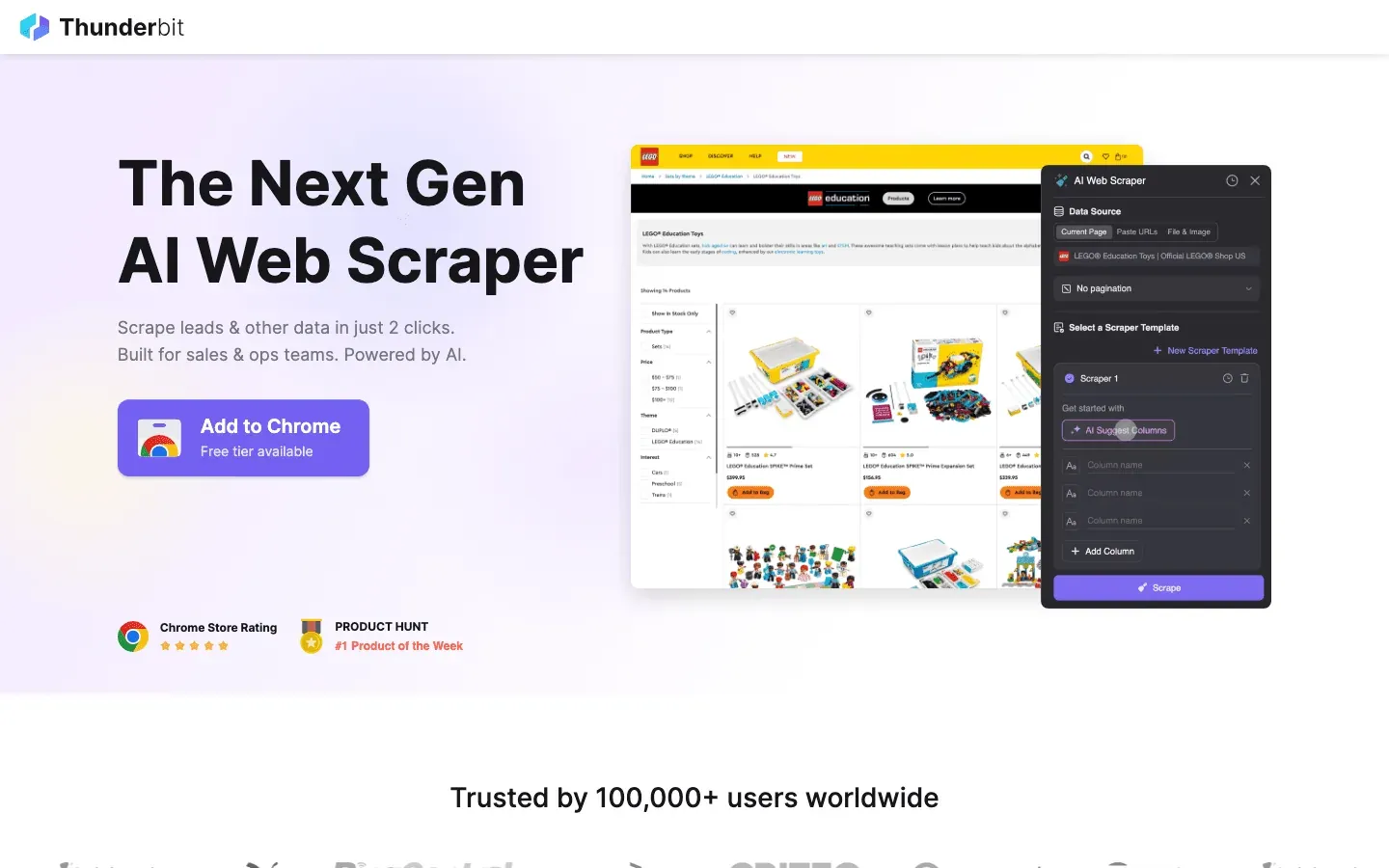

1. Thunderbit

es mi recomendación favorita para cualquiera que quiera que el rastreo de datos sea tan fácil como pedir comida a domicilio. Diseñada como una extensión de Chrome impulsada por IA, Thunderbit se centra en el scraping en 2 clics: solo pulsa “AI Suggest Fields” y deja que la IA averigüe qué hay en la página; luego haz clic en “Scrape” para obtener los datos. Sin código, sin pelearte con selectores: resultados instantáneos.

es mi recomendación favorita para cualquiera que quiera que el rastreo de datos sea tan fácil como pedir comida a domicilio. Diseñada como una extensión de Chrome impulsada por IA, Thunderbit se centra en el scraping en 2 clics: solo pulsa “AI Suggest Fields” y deja que la IA averigüe qué hay en la página; luego haz clic en “Scrape” para obtener los datos. Sin código, sin pelearte con selectores: resultados instantáneos.

¿Qué hace que Thunderbit sea una favorita para equipos de ventas, marketing y ecommerce? Está pensada para flujos de trabajo empresariales reales:

- AI Suggest Fields: La IA lee la página y recomienda las mejores columnas para extraer: nombres, precios, correos electrónicos, lo que necesites.

- Extracción de subpáginas: ¿Necesitas más detalles? Thunderbit puede visitar automáticamente cada subpágina (como fichas de producto o perfiles de LinkedIn) y enriquecer tu tabla.

- Exportación instantánea: Envía tus datos directamente a Excel, Google Sheets, Airtable o Notion. Todas las exportaciones son gratuitas.

- Plantillas con un clic: Para sitios populares (Amazon, Zillow, Instagram), usa plantillas instantáneas para obtener resultados aún más rápidos.

- Exportación de datos gratuita: No hay muro de pago para sacar tus datos.

- Extracción programada: Configura tareas recurrentes en lenguaje natural (“cada lunes a las 9 a. m.”), ideal para monitorizar precios o actualizar leads semanalmente.

Thunderbit usa un sistema de créditos (1 crédito = 1 fila), con un de hasta 6 páginas (o 10 con un impulso de prueba). Los planes de pago empiezan en 15 $/mes por 500 créditos, lo que lo hace asequible para equipos de cualquier tamaño.

Si quieres ver Thunderbit en acción, visita nuestro o el . Es la herramienta que me habría encantado tener cuando me ahogaba en la entrada manual de datos.

2. Octoparse

es una referencia importante en el mundo del rastreo de datos, especialmente para usuarios empresariales que necesitan mucha potencia. Ofrece una interfaz visual de escritorio (Windows y Mac) en la que puedes crear flujos de extracción con clics, sin necesidad de programar. Pero no te dejes engañar por la interfaz amigable: por dentro, Octoparse gestiona inicios de sesión, scroll infinito, proxies rotativos e incluso resolución de CAPTCHAs.

es una referencia importante en el mundo del rastreo de datos, especialmente para usuarios empresariales que necesitan mucha potencia. Ofrece una interfaz visual de escritorio (Windows y Mac) en la que puedes crear flujos de extracción con clics, sin necesidad de programar. Pero no te dejes engañar por la interfaz amigable: por dentro, Octoparse gestiona inicios de sesión, scroll infinito, proxies rotativos e incluso resolución de CAPTCHAs.

- Más de 500 plantillas prediseñadas: Empieza rápido con plantillas para Amazon, Twitter, LinkedIn y más.

- Extracción en la nube: Ejecuta tareas en los servidores de Octoparse, programa tareas y escala para proyectos grandes.

- Acceso a API: Integra los datos extraídos directamente en tus aplicaciones o bases de datos empresariales.

- Automatización avanzada: Maneja contenido dinámico, paginación y flujos de trabajo de varios pasos.

El plan gratuito cubre 10 tareas más un generoso límite mensual de exportación de 50.000 filas, así que es un plan realmente funcional, no solo una demo. Los planes de pago empiezan en 69 $/mes para Standard (facturación anual; unos 82 $/mes si pagas mes a mes) y 249 $/mes para Professional. La curva de aprendizaje es más pronunciada que la de Thunderbit, pero si necesitas extraer miles de páginas con fiabilidad y quieres ejecución en la nube, Octoparse sigue siendo una de las opciones más consolidadas que merece una mirada seria. Precio verificado en el 2026-05-13.

3. Scrapy

es el estándar de oro para desarrolladores que quieren control total sobre sus proyectos de rastreo de datos. Es un framework de Python de código abierto que te permite programar spiders personalizados para cualquier sitio web. Si puedes imaginarlo, puedes construirlo con Scrapy.

es el estándar de oro para desarrolladores que quieren control total sobre sus proyectos de rastreo de datos. Es un framework de Python de código abierto que te permite programar spiders personalizados para cualquier sitio web. Si puedes imaginarlo, puedes construirlo con Scrapy.

- Programación total: Escribe código Python para definir exactamente cómo rastrear y analizar cualquier sitio.

- Asíncrono y rápido: Gestiona miles de páginas en paralelo para proyectos a gran escala.

- Extensible: Añade middleware para proxies, navegadores sin interfaz o lógica personalizada.

- Comunidad sólida: Montones de tutoriales, complementos y apoyo para escenarios de scraping complicados.

Scrapy es gratuito y de código abierto, pero requiere habilidades de programación. Si tienes un equipo técnico o quieres construir una canalización personalizada, Scrapy es difícil de superar. Para quienes no programan, eso sí, la cuesta es empinada.

4. ParseHub

es una herramienta visual de web scraping sin código, perfecta para personas sin experiencia técnica que se enfrentan a sitios web complejos. Su interfaz de apuntar y hacer clic te permite seleccionar elementos, definir acciones y crear flujos de trabajo de scraping, incluso en sitios con contenido dinámico o navegación complicada.

es una herramienta visual de web scraping sin código, perfecta para personas sin experiencia técnica que se enfrentan a sitios web complejos. Su interfaz de apuntar y hacer clic te permite seleccionar elementos, definir acciones y crear flujos de trabajo de scraping, incluso en sitios con contenido dinámico o navegación complicada.

- Generador visual de flujos: Haz clic para seleccionar datos, configurar paginación y gestionar ventanas emergentes o menús desplegables.

- Gestiona contenido dinámico: Funciona con sitios con mucho JavaScript y páginas interactivas.

- Ejecuciones en la nube y programación: Ejecuta extracciones en la nube y programa tareas recurrentes.

- Exportación a CSV, Excel o mediante API: Integración sencilla con tus herramientas favoritas.

ParseHub ofrece un plan gratuito (5 proyectos), con planes de pago a partir de . Es algo más caro que algunos competidores, pero su enfoque visual lo hace accesible para analistas, marketers e investigadores que necesitan algo más que una extensión básica de Chrome.

5. Apify

es a la vez una plataforma y un mercado para el rastreo web. Ofrece una enorme biblioteca de “Actors” preconstruidos (scrapers listos para usar) para sitios populares, además de la posibilidad de crear y ejecutar tus propios crawlers personalizados en la nube.

es a la vez una plataforma y un mercado para el rastreo web. Ofrece una enorme biblioteca de “Actors” preconstruidos (scrapers listos para usar) para sitios populares, además de la posibilidad de crear y ejecutar tus propios crawlers personalizados en la nube.

- Más de 5.000 Actors listos para usar: Extrae al instante Google Maps, Amazon, Twitter y más.

- Programación personalizada: Los desarrolladores pueden usar JavaScript o Python para crear crawlers avanzados.

- Escalado en la nube: Ejecuta tareas en paralelo, programa trabajos y gestiona datos en la nube.

- API e integraciones: Conecta los resultados con tus apps, flujos de trabajo o canalizaciones de datos.

Apify te da 5 $ de crédito gratuito en la plataforma para empezar, y luego pasa a Starter por 29 $/mes, Scale por 199 $/mes y Business por 999 $/mes: cada nivel combina “crédito de plataforma + pago por uso de unidades de cómputo”, así que el uso real es lo que marca la factura. Tiene cierta curva de aprendizaje, pero si quieres tanto actores listos para usar como la posibilidad de escribir tus propios crawlers en JS o Python, Apify es una de las opciones más fuertes de esta lista. Precio verificado en el 2026-05-13.

6. Data Miner

es una extensión de Chrome diseñada para un rastreo de datos rápido y basado en plantillas. Es perfecta para usuarios de negocio que quieren extraer datos de tablas o listas sin tener que configurar nada.

es una extensión de Chrome diseñada para un rastreo de datos rápido y basado en plantillas. Es perfecta para usuarios de negocio que quieren extraer datos de tablas o listas sin tener que configurar nada.

- Biblioteca enorme de plantillas: Más de mil recetas para sitios comunes (LinkedIn, Yelp, etc.).

- Extracción con clics: Selecciona una plantilla, previsualiza los datos y exporta al instante.

- Basado en el navegador: Funciona con tu sesión actual, ideal para extraer detrás de inicios de sesión.

- Exportación a CSV o Excel: Lleva tus datos a una hoja de cálculo en segundos.

El cubre 500 páginas al mes, con planes de pago desde 20 $/mes. Es ideal para tareas pequeñas y puntuales o cuando necesitas datos ya mismo; solo no esperes que gestione trabajos masivos o automatizaciones complejas.

7. Import.io

es una plataforma de nivel empresarial para organizaciones que necesitan una integración de datos web continua y fiable. Es más que un simple crawler: es un servicio gestionado que entrega datos limpios y estructurados directamente en los sistemas de tu negocio.

es una plataforma de nivel empresarial para organizaciones que necesitan una integración de datos web continua y fiable. Es más que un simple crawler: es un servicio gestionado que entrega datos limpios y estructurados directamente en los sistemas de tu negocio.

- Extracción sin código: Configuración visual para definir qué datos extraer.

- Flujos de datos en tiempo real: Envía los datos a paneles, herramientas analíticas o bases de datos.

- Cumplimiento y fiabilidad: Gestiona rotación de IP, medidas anti-bot y cumplimiento legal.

- Servicios gestionados: El equipo de Import.io puede configurar y mantener tus scrapers.

El precio es , con una prueba gratuita de 14 días para la plataforma SaaS. Si tu negocio depende de datos web siempre actualizados (piensa en retail, finanzas o investigación de mercado), Import.io merece una mirada.

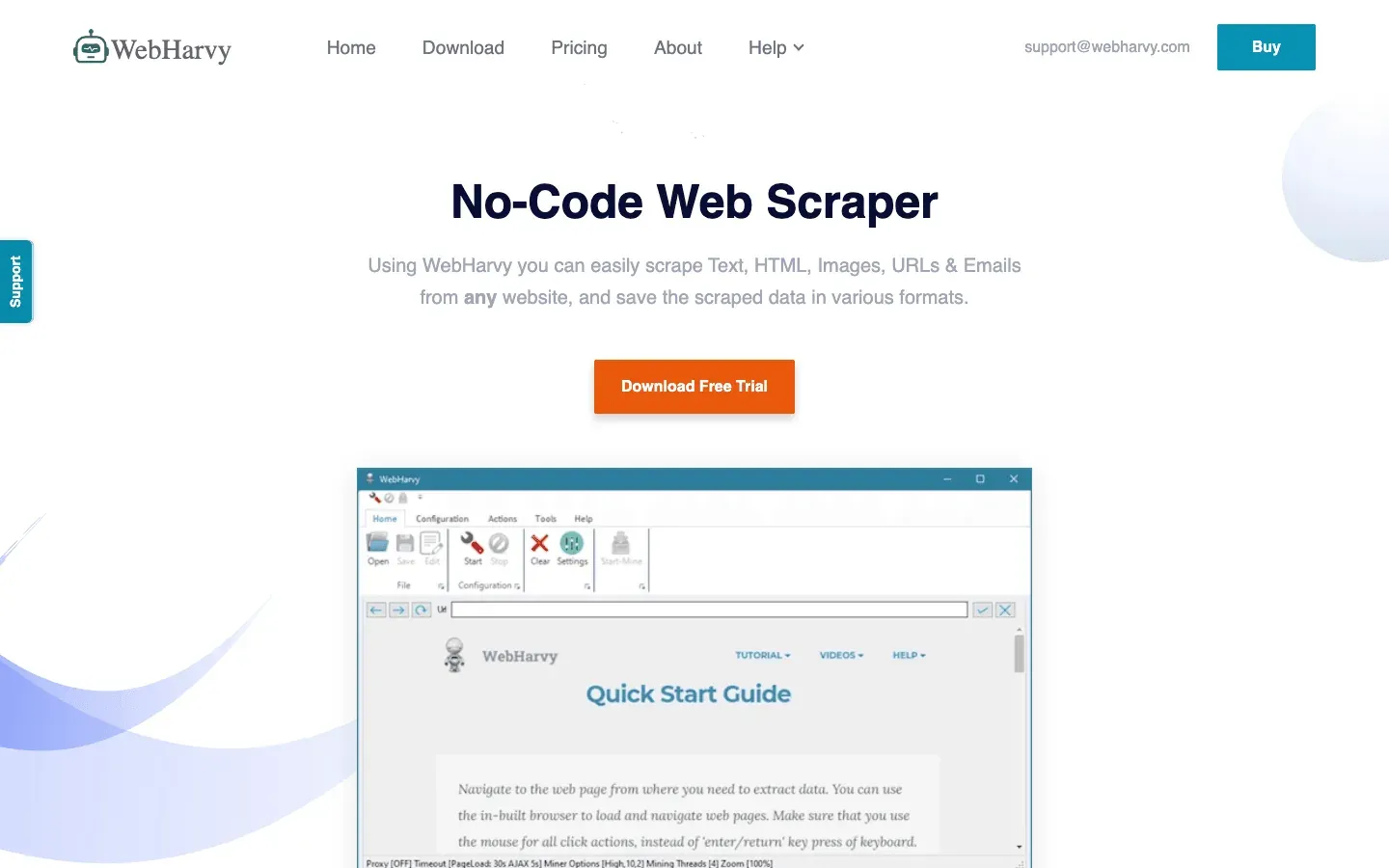

8. WebHarvy

es un scraper de escritorio para usuarios de Windows que quieren una solución de apuntar y hacer clic sin suscripción. Es especialmente popular entre pequeñas empresas y personas que prefieren un pago único.

es un scraper de escritorio para usuarios de Windows que quieren una solución de apuntar y hacer clic sin suscripción. Es especialmente popular entre pequeñas empresas y personas que prefieren un pago único.

- Detección visual de patrones: Haz clic en elementos de datos y WebHarvy detecta automáticamente patrones repetitivos.

- Gestiona texto, imágenes y más: Extrae todos los tipos de datos comunes, incluidos correos electrónicos y URL.

- Paginación y programación: Navega por sitios de varias páginas y configura extracciones programadas.

- Exportación a Excel, CSV, XML, JSON o SQL: Salida flexible para cualquier flujo de trabajo.

Una licencia para un solo usuario cuesta , lo que lo convierte en una opción rentable para uso regular; solo ten en cuenta que es exclusivo de Windows.

9. Mozenda

es una plataforma de rastreo de datos en la nube diseñada para operaciones empresariales y necesidades de datos continuas. Combina un diseñador de escritorio (Windows) con una potente ejecución y automatización en la nube.

es una plataforma de rastreo de datos en la nube diseñada para operaciones empresariales y necesidades de datos continuas. Combina un diseñador de escritorio (Windows) con una potente ejecución y automatización en la nube.

- Generador visual de agentes: Diseña rutinas de extracción con una interfaz de apuntar y hacer clic.

- Escalado en la nube: Ejecuta varios agentes en paralelo, programa trabajos y gestiona los datos de forma centralizada.

- Consola de gestión de datos: Combina, filtra y limpia conjuntos de datos después de la extracción.

- Soporte empresarial: Gestores de cuenta dedicados y servicios gestionados para equipos grandes.

El plan Pilot de autoservicio de Mozenda cuesta 500 $/mes (5.000 créditos de procesamiento, 10 agentes, 10 GB de almacenamiento), y Enterprise es bajo presupuesto personalizado. También hay una versión de prueba gratuita de 14 días con 500 créditos si quieres probarla antes de comprometerte. Mozenda es ideal para empresas que quieren datos web fiables y repetibles integrados en sus operaciones diarias; el precio es real y la plataforma espera que la tomes en serio. Precio verificado en el 2026-05-13.

10. BeautifulSoup

es la biblioteca clásica de Python para analizar HTML y XML. No es un crawler completo, pero los desarrolladores la adoran para proyectos pequeños y personalizados de scraping.

es la biblioteca clásica de Python para analizar HTML y XML. No es un crawler completo, pero los desarrolladores la adoran para proyectos pequeños y personalizados de scraping.

- Análisis HTML sencillo: Extrae fácilmente datos de páginas web estáticas.

- Funciona con Python Requests: Combínala con otras bibliotecas para obtener y rastrear contenido.

- Flexible y ligera: Perfecta para scripts rápidos o proyectos educativos.

- Comunidad enorme: Montones de tutoriales y respuestas en Stack Overflow.

BeautifulSoup es , pero tendrás que escribir el código y gestionar tú mismo la lógica de rastreo. Es ideal para desarrolladores o estudiantes que quieran entender los entresijos del web scraping.

Tabla comparativa: herramientas de rastreo de datos de un vistazo

| Herramienta | Facilidad de uso | Nivel de automatización | Precio | Opciones de exportación | Ideal para |

|---|---|---|---|---|---|

| Thunderbit | Muy fácil, sin código | Alto (IA, subpáginas) | Prueba gratuita, desde 15 $/mes | Excel, Sheets, Airtable, Notion, CSV | Ventas, marketing, ecommerce, personas sin código |

| Octoparse | Media, interfaz visual | Muy alto, nube | Gratis, 83–299 $/mes | CSV, Excel, JSON, API | Empresas, equipos de datos, sitios dinámicos |

| Scrapy | Baja (requiere Python) | Alta (personalizable) | Gratis, código abierto | Cualquiera (mediante código) | Desarrolladores, proyectos personalizados a gran escala |

| ParseHub | Alta, visual | Alta (sitios dinámicos) | Gratis, desde 189 $/mes | CSV, Excel, JSON, API | Personas sin código, estructuras web complejas |

| Apify | Media, flexible | Muy alto, nube | Gratis, 29–999 $/mes | CSV, JSON, API, almacenamiento en la nube | Desarrolladores, empresas, actores listos para usar o personalizados |

| Data Miner | Muy fácil, navegador | Baja (manual) | Gratis, 20–99 $/mes | CSV, Excel | Extracciones rápidas y puntuales, conjuntos de datos pequeños |

| Import.io | Media, gestionada | Muy alto, empresarial | Personalizado, basado en volumen | CSV, JSON, API, integración directa | Empresas, integración continua de datos |

| WebHarvy | Alta, escritorio | Media (programación) | 129 $ pago único | Excel, CSV, XML, JSON, SQL | PYMES, usuarios de Windows, scraping regular |

| Mozenda | Media, visual | Muy alto, nube | 250–450 $+/mes | CSV, Excel, JSON, nube, BD | Operaciones empresariales continuas y a gran escala |

| BeautifulSoup | Baja (requiere Python) | Baja (codificación manual) | Gratis, código abierto | Cualquiera (mediante código) | Desarrolladores, estudiantes, scripts pequeños personalizados |

Cómo elegir la herramienta de rastreo de datos adecuada para tu equipo

Elegir la mejor herramienta de rastreo de datos no consiste en encontrar la “más potente”, sino la que mejor encaja con las habilidades, necesidades y presupuesto de tu equipo. Mi consejo rápido es este:

- Personas sin código o usuarios de negocio: Empieza con Thunderbit, ParseHub o Data Miner para obtener resultados instantáneos y una configuración sencilla.

- Necesidades empresariales o a gran escala: Mira Octoparse, Mozenda o Import.io para automatización, programación y soporte.

- Desarrolladores o proyectos personalizados: Scrapy, Apify o BeautifulSoup ofrecen control total y flexibilidad.

- Con presupuesto ajustado o trabajos puntuales: WebHarvy (Windows) o Data Miner (navegador) son opciones sencillas y rentables.

Prueba siempre tus opciones favoritas con una versión gratuita en los sitios reales que quieres extraer; lo que funciona en un sitio puede no funcionar en otro. Y no olvides pensar en la integración: si necesitas tus datos en Sheets, Notion o una base de datos, asegúrate de que la herramienta lo soporte de forma nativa.

Conclusión: desbloquear valor de negocio con las mejores herramientas de rastreo de datos

Los datos web son el nuevo petróleo, pero solo si tienes la maquinaria adecuada para extraerlos y refinarlos. Con las herramientas modernas de rastreo de datos, puedes convertir horas de investigación manual en minutos de información automatizada, impulsando ventas más inteligentes, marketing más afinado y operaciones más ágiles. Tanto si estás creando listas de leads, monitorizando competidores o simplemente harto de copiar y pegar, hay una herramienta en esta lista que puede hacerte la vida mucho más fácil.

Así que revisa las necesidades de tu equipo, prueba algunas de estas herramientas y comprueba cuánto más puedes lograr cuando dejas que la automatización haga el trabajo pesado. Y si quieres ver cómo funciona el scraping con IA en 2 clics, . ¡Feliz rastreo, y que tus datos estén siempre frescos, estructurados y listos para la acción!

Preguntas frecuentes

1. ¿Qué es una herramienta de rastreo de datos y por qué necesito una?

Una herramienta de rastreo de datos automatiza el proceso de extraer información de sitios web. Ahorra tiempo, reduce errores y ayuda a los equipos a recopilar datos actualizados para ventas, marketing, investigación y operaciones, de forma mucho más eficiente que copiar y pegar manualmente.

2. ¿Qué herramienta de rastreo de datos es mejor para usuarios sin conocimientos técnicos?

Thunderbit, ParseHub y Data Miner son opciones destacadas para personas sin código. Thunderbit sobresale por su flujo de trabajo con IA en 2 clics, mientras que ParseHub ofrece un enfoque visual para sitios más complejos.

3. ¿En qué se diferencian los modelos de precios entre las herramientas de rastreo de datos?

Los precios varían mucho: algunas herramientas, como Thunderbit y Data Miner, ofrecen planes gratuitos y planes mensuales asequibles, mientras que las plataformas empresariales, como Import.io y Mozenda, usan precios personalizados o basados en volumen. Comprueba siempre si el coste de la herramienta se ajusta a tus necesidades de datos.

4. ¿Puedo usar estas herramientas para extracción de datos continua y programada?

Sí: herramientas como Thunderbit, Octoparse, Apify, Mozenda e Import.io admiten rastreos programados o recurrentes, por lo que son ideales para monitorización continua de precios, generación de leads o investigación de mercado.

5. ¿Qué debo tener en cuenta antes de elegir una herramienta de rastreo de datos?

Ten en cuenta las habilidades técnicas de tu equipo, la complejidad de los sitios que necesitas rastrear, el volumen de datos, las necesidades de integración y el presupuesto. Prueba varias herramientas con tareas reales antes de comprometerte con un plan de pago.

Para más análisis en profundidad y guías prácticas, visita el .

Más información