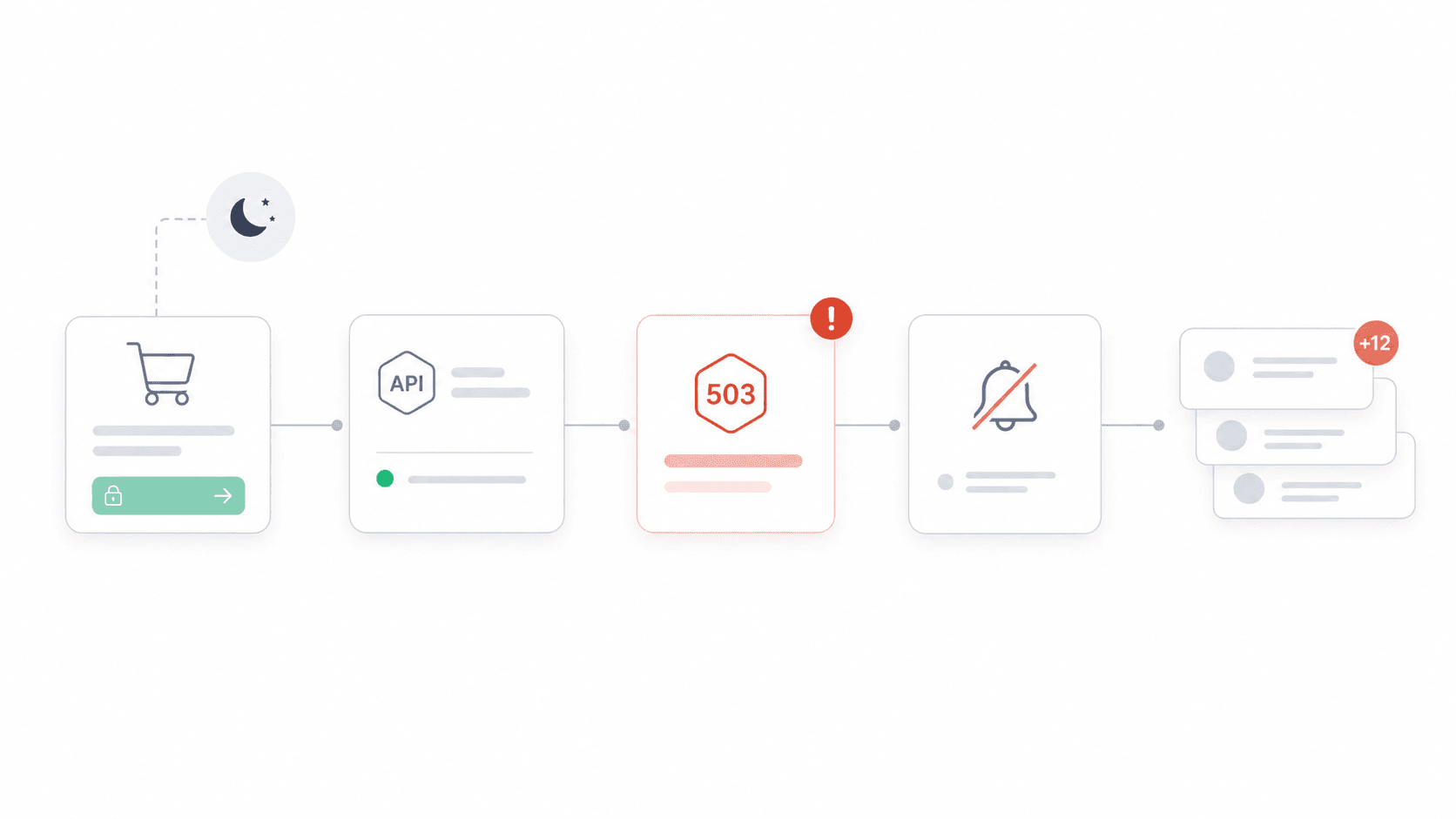

El mes pasado, la integración de Stripe de un amigo empezó a devolver errores 503 en silencio a las 11 de la noche de un viernes. Nadie se dio cuenta hasta la mañana del sábado, cuando la bandeja de soporte tenía más de 200 correos furiosos de clientes cuyos pagos habían fallado.

Esa historia no es nada rara. Un sitúa el tiempo de inactividad medio en 5.600 dólares por minuto, mientras que . La cifra real depende del tráfico, la tasa de conversión, el valor del pedido, la exposición al SLA y el coste de recuperación, pero la realidad es clara: las APIs sin supervisión son un riesgo empresarial, no solo una molestia para ingeniería. Y, como y , monitorizarlas ya no es opcional. Lo que quería hacer con esta guía es algo que no había visto en otros sitios: organizar las herramientas según tu caso de uso, evaluar la calidad de las alertas (no solo su existencia), mostrar precios reales de 2026 y medir lo rápido que puedes empezar a usarlas de verdad. No solo otra lista plana de logos.

Una cosa más: si tu trabajo con APIs implica recopilar datos web, alimentar LLMs, construir sistemas RAG, monitorizar páginas de la competencia o extraer precios y datos de productos de sitios web, la conversación sobre “herramientas API” no debería terminar en la monitorización del tiempo de actividad. También necesitas una forma fiable de convertir páginas web desordenadas en datos estructurados. Ahí es donde encaja en esta guía: no es un monitor de uptime, pero sí una de las formas más rápidas de convertir sitios web en Markdown limpio o JSON basado en esquemas mediante una API.

¿Qué es la monitorización de API y por qué debería importarle a tu equipo?

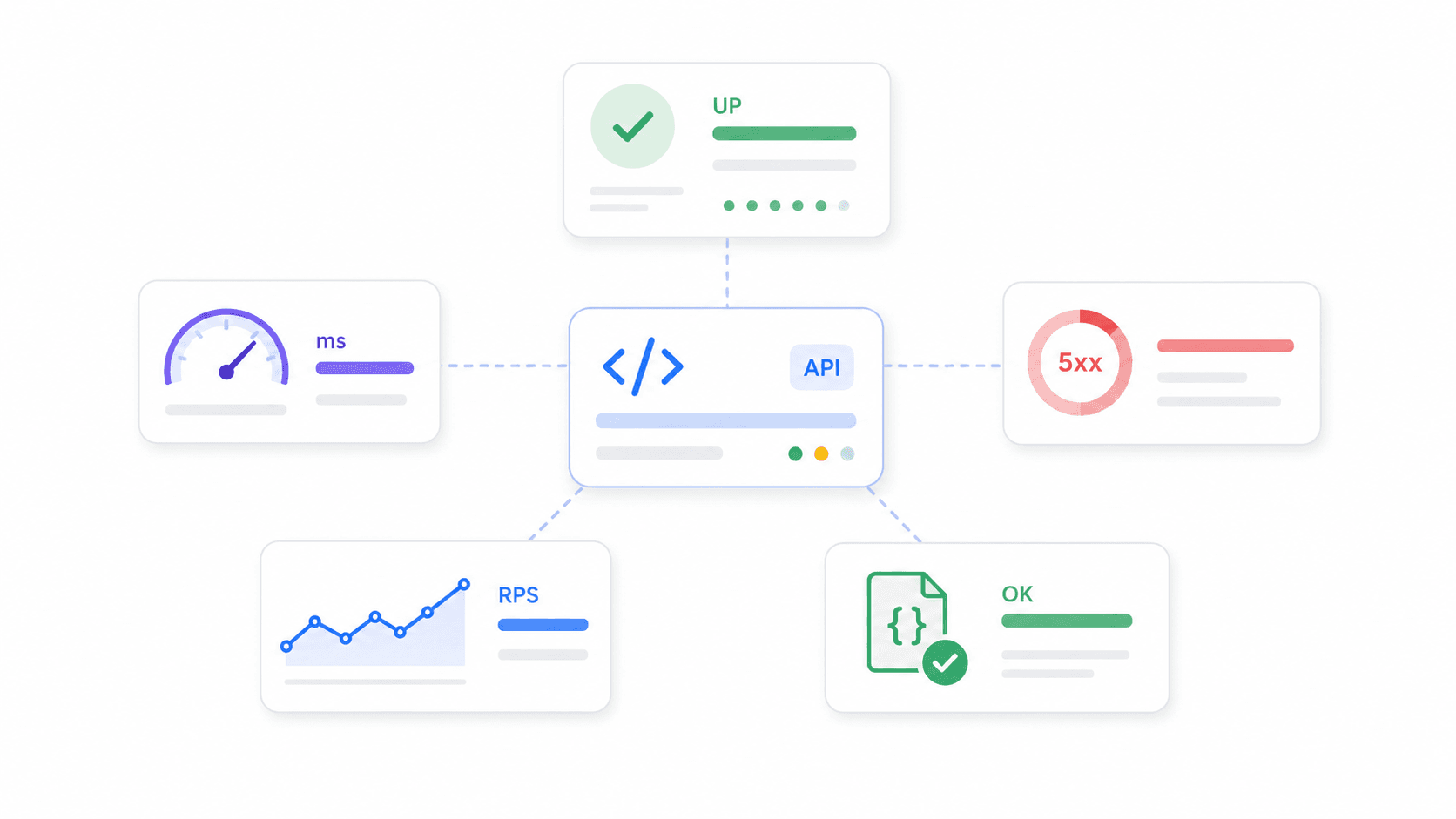

Monitorizar una API significa comprobar de forma continua que tus endpoints estén disponibles, sean rápidos y devuelvan los datos correctos. No se trata solo de “¿está el servidor arriba?”: un buen monitor valida códigos de estado HTTP, cargas de respuesta, latencia, certificados SSL, flujos de varios pasos (como inicio de sesión → búsqueda → pago) e incluso la corrección del esquema.

Es distinto de la monitorización general de sitios web (que comprueba si una página carga) y de APM (Application Performance Monitoring), que profundiza en trazas a nivel de código, consultas a bases de datos y detalles internos de ejecución. La monitorización de API está en la frontera: prueba lo que realmente experimentan tus usuarios, socios e integraciones cuando llaman a tus endpoints.

También hay una categoría relacionada que merece la pena mencionar: las APIs de datos web. Estas no monitorizan si tu propia API está sana; ayudan a tu producto o flujo de trabajo a recopilar datos externos de la web de forma fiable. Por ejemplo, puede convertir una página web en Markdown limpio, extraer campos estructurados como JSON y ejecutar trabajos por lotes sobre muchas URLs. Si tu proyecto “API” depende de datos actualizados de proveedores, páginas de productos, listados públicos, documentación o fuentes de investigación, ese tipo de API de extracción de datos puede ser tan importante operativamente como las comprobaciones de uptime.

¿Por qué deberían preocuparse los no ingenieros? Porque y . Cuando falla una pasarela de pago, un servicio de autenticación o una API de envíos, no es un problema abstracto de infraestructura: es pérdida de ingresos, contratos con socios rotos, picos en soporte y confianza erosionada. Product managers, ventas, operaciones y customer success también tienen mucho en juego.

Métricas clave a vigilar:

- Porcentaje de uptime: parte del tiempo en que un endpoint está disponible

- Tiempo de respuesta / latencia: cuánto tarda el endpoint en responder (media, p95, p99)

- Tasa de error: parte de las solicitudes que devuelven 5xx, timeouts o fallos de aserción

- Throughput: solicitudes por segundo/minuto

- Corrección: si la API devuelve los datos esperados, no solo un 200 OK

Cómo evaluamos las mejores herramientas de monitorización de API para 2026

La mayoría de los artículos sobre “las mejores herramientas de monitorización de API” solo apilan nombres de proveedores y funciones. Yo quería ser más intencional con los criterios de selección, en parte porque pasé mucho tiempo leyendo foros de desarrolladores y en parte porque el equipo de Thunderbit me ayudó a de sitios de proveedores para construir una comparación real (hablo más de ese flujo de trabajo más adelante).

Esto es lo que ponderamos:

| Criterio | Por qué importa |

|---|---|

| Facilidad de configuración / tiempo hasta la primera alerta | Los equipos pequeños necesitan cobertura hoy, no después de un proyecto de plataforma |

| Inteligencia de alertas y reducción de ruido | Si las alertas hacen ruido, los equipos las ignoran y se pierden incidentes reales |

| Generosidad del plan gratuito | Los side projects y startups tempranas suelen empezar gratis |

| Transparencia de precios | Las facturas de observabilidad pueden dispararse por hosts, usuarios, logs, ejecuciones sintéticas y entrada de datos |

| Amplitud de integraciones | Las alertas deben llegar donde el equipo ya trabaja (Slack, PagerDuty, etc.) |

| Escalabilidad y profundidad de datos | Los equipos maduros necesitan trazas, logs, APM, RBAC, SSO y retención |

| Calidad de la comunidad y del soporte | Los equipos open source necesitan ritmo de lanzamientos; los equipos enterprise necesitan SLAs |

| Capacidad de extracción de datos web | Las apps de IA, los flujos RAG y las herramientas de investigación de mercado suelen necesitar datos externos limpios, no solo uptime del endpoint |

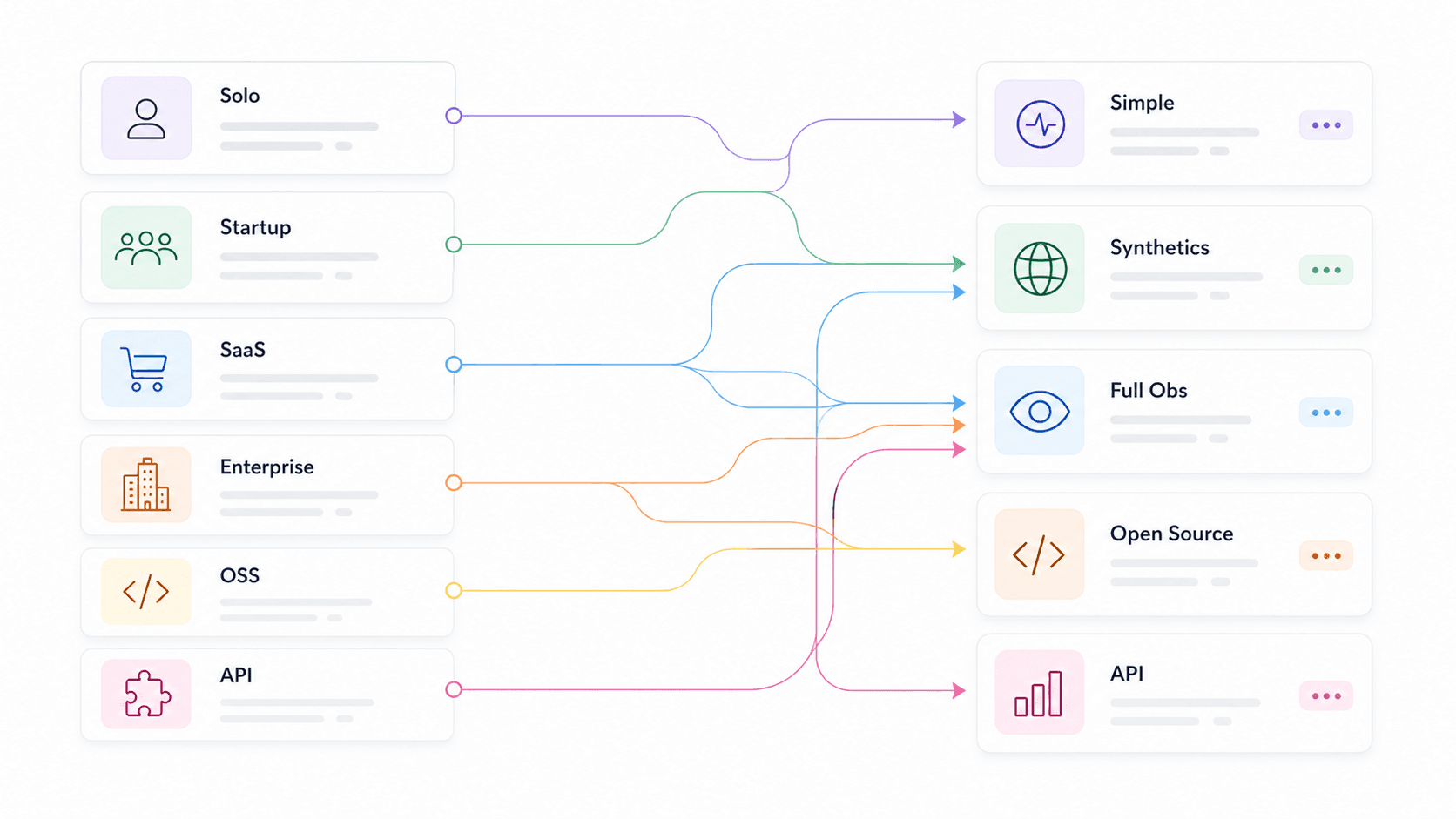

También segmentamos las recomendaciones por caso de uso —desarrollador individual, startup, e-commerce/SaaS, enterprise, purista open source, equipo de producto API y equipo de datos web/IA— para que puedas saltar directamente a tu contexto en lugar de leer 14 resúmenes de herramientas intentando adivinar cuál te aplica. encontró que y como criterios de selección, lo que confirma que no son simples extras.

Mejores herramientas de monitorización de API por caso de uso: tabla rápida

Este es el atajo. Encuentra tu fila y luego salta a las secciones de cada herramienta para el análisis completo.

| Caso de uso | Herramientas recomendadas | Diferenciador clave |

|---|---|---|

| Equipos de datos web / apps de IA | Thunderbit Open API, Moesif, Apitally | Convierte sitios web en Markdown limpio o JSON estructurado para flujos LLM, RAG, precios e investigación |

| Dev individual / proyecto paralelo | UptimeRobot, Uptime Kuma, Gatus | Gratis o autoalojado, configuración mínima, arranque rápido |

| Startup (equipo de 5–15 personas) | Checkly, Better Stack, Postman | Alertas inteligentes, configuración rápida, precio accesible, páginas de estado |

| E-commerce / SaaS | Datadog, New Relic, Moesif, Checkly | Métricas de negocio, APM/trazas, profundidad de SDK, sintéticos de varios pasos |

| Enterprise / multicloud | Datadog, New Relic, Splunk, Grafana Cloud | Trazado distribuido, cumplimiento, híbrido, RBAC/SSO |

| Puristas open source | Prometheus + Grafana, Uptime Kuma, Gatus, Uptrace | Control total, OTel nativo, sin bloqueo de proveedor |

| Equipos de producto API | Moesif, Apitally, New Relic | Uso por cliente, tendencias por endpoint, alertas de anomalías |

El patrón principal: las herramientas más rápidas de configurar suelen quedarse más cortas en analítica, mientras que las plataformas más profundas requieren más configuración y disciplina con los costes. No es un fallo: es una compensación que conviene conocer. Thunderbit juega en una liga algo distinta: es más rápido cuando la tarea consiste en convertir páginas web en datos listos para API, no en avisar a ingenieros de una caída.

Thunderbit Open API: la mejor opción para convertir sitios web en datos estructurados para API

es la API que pondría en primer lugar para equipos cuyo flujo de “monitorización” o investigación depende de datos web externos. No es una herramienta tradicional de monitorización de uptime como Checkly o UptimeRobot. En su lugar, Thunderbit convierte cualquier página web en datos limpios y estructurados que tus apps, agentes, paneles y pipelines de LLM pueden usar de verdad.

La API tiene tres flujos de trabajo principales. Distill convierte una página en Markdown limpio, listo para LLM. Extract toma un esquema y devuelve campos JSON estructurados como nombre del producto, precio, disponibilidad, tamaño de la empresa, etapa de financiación o valoración de reseñas. Batch te permite procesar hasta 100 URLs de forma asíncrona con webhooks, algo muy útil cuando monitorizas páginas de precios, catálogos de la competencia, documentación de proveedores, fuentes de noticias o grandes listas de investigación.

La razón por la que encaja en una guía de herramientas API es que muchos equipos subestiman la infraestructura que requiere “solo extrae esta página”. Los sitios pesados en JavaScript necesitan renderizado. Algunas páginas requieren georrouting. El HTML debe limpiarse de barras de navegación, anuncios, modales y texto repetitivo antes de ser útil para un LLM. Los selectores se rompen cuando cambian los diseños. La rotación de proxies, el manejo anti-bot, los reintentos, las colas y el polling de resultados pueden convertir un pequeño flujo de datos en un proyecto de mantenimiento. Thunderbit absorbe gran parte de ese trabajo detrás de una sola API.

Ideal para: desarrolladores de apps de IA, equipos RAG, operaciones de e-commerce, sales ops, growth, investigadores de mercado y desarrolladores que necesitan datos web mediante una API sin construir y mantener una pila de scraping.

Precio: , incluyendo hasta 600 páginas Distill o 30 páginas Extract, con 2 solicitudes concurrentes. Starter aparece a 16 dólares/mes en facturación anual para 60.000 unidades API/año y 30 solicitudes concurrentes. Pro aparece a 40 dólares/mes en facturación anual para 600.000 unidades API/año y 50 solicitudes concurrentes.

Velocidad de puesta en marcha: ~5–15 minutos para obtener una clave API y ejecutar una primera solicitud Distill o Extract con cURL, SDKs o .

Inconvenientes: Thunderbit no sustituye a Datadog, New Relic, Better Stack o Checkly para comprobaciones de uptime, escalado de incidentes, trazas, logs o enrutamiento de guardias. Piensa en él como la API que usas para recopilar y estructurar datos web —incluidos precios de proveedores, documentación, páginas de la competencia, listados de productos o datasets públicos—, no como el sistema que despierta a tu ingeniero de guardia.

Datadog: la mejor opción para visibilidad integral

Datadog es la herramienta que sigo viendo en stacks enterprise y SaaS de mercado medio, y con razón. No es solo monitorización de API: es una plataforma de observabilidad completa que conecta tests sintéticos de API con trazas distribuidas, logs, métricas de infraestructura y monitorización de usuarios reales en una sola vista.

En cuanto a monitorización de API, Datadog admite HTTP, SSL, DNS, WebSocket, TCP, UDP, ICMP, gRPC y . Sus aprenden patrones esperados y avisan de desviaciones en lugar de umbrales estáticos, un salto importante frente a “alerta cuando la latencia > 500 ms”. También ofrece que predicen cuándo una métrica superará un umbral, además de monitores compuestos que combinan varias condiciones.

Ideal para: equipos de e-commerce, SaaS y enterprise que necesitan una vista unificada de APIs, infraestructura, logs y trazas.

Precio: los detalles del plan gratuito varían según el producto. ; las pruebas sintéticas de API cuestan 5 dólares por cada 10.000 ejecuciones. Más de 800 integraciones.

Velocidad de puesta en marcha: ~15–30 minutos para instalar el agente y crear un test sintético básico.

Inconvenientes: puede volverse caro a escala: el “susto en la factura” es un tema recurrente en Hacker News y Reddit. La cantidad de SKUs (hosts, logs, métricas personalizadas, sintéticos, usuarios) significa que necesitas a alguien vigilando la factura, no solo los paneles. La curva de aprendizaje de la plataforma completa es real.

Checkly: la mejor opción para checks sintéticos pensados para desarrolladores

Checkly es la herramienta que le daría a un equipo de ingeniería de una startup que quiere que las comprobaciones de API vivan cerca del código. Su idea central es “monitorización como código”: defines comprobaciones de API y navegador de forma programática, las ejecutas desde ubicaciones globales, las integras con pipelines CI/CD y lo gestionas todo a través de Git.

El ángulo de calidad de alertas es muy bueno aquí. La de Checkly se presenta explícitamente como la “primera línea de defensa” contra falsos positivos: puedes configurar reintentos fijos, lineales o exponenciales, reintentos desde la misma ubicación o desde otra, y duraciones máximas de reintento antes de que salte una alerta. También distingue entre estados degradado, fallido y recuperado, lo que ayuda a reducir el ruido.

Ideal para: startups y equipos de desarrollo que quieren comprobaciones de API programables, , integración CI/CD y configuración rápida.

Precio: datos públicos recientes muestran un plan gratuito con 10 monitores de uptime, 1.000 checks de navegador y 10.000 checks de API. Starter ronda los 24 dólares/mes en facturación anual; antes de comprar.

Velocidad de puesta en marcha: ~10–20 minutos para una primera comprobación de API y un canal de alertas.

Inconvenientes: está centrado en checks sintéticos. No sustituye a APM profundo, analítica de logs ni trazado distribuido. Si necesitas correlacionar un fallo de API con un cuello de botella en la base de datos, necesitarás otra herramienta junto a esta.

UptimeRobot: la mejor opción para monitorización de uptime simple y asequible

UptimeRobot es el Honda Civic de la monitorización de API. Hace una cosa bien: creas un monitor HTTP, de palabra clave, ping, puerto, SSL o heartbeat, eliges un intervalo y recibes una alerta cuando falla. Eso es todo.

Ideal para: desarrolladores individuales, equipos pequeños, agencias o cualquiera que necesite monitorización básica de uptime y latencia sin complejidad.

Precio: . El plan Solo de pago ronda los 7 dólares/mes en facturación anual. No hace falta tarjeta para el plan gratuito. Velocidad de puesta en marcha: ~2–5 minutos, la más rápida de esta lista.

Inconvenientes: inteligencia de alertas limitada. Alertas básicas por umbral, sin detección de anomalías, sin trazado distribuido, sin analítica profunda. Si necesitas saber por qué un endpoint va lento —no solo que va lento—, UptimeRobot no te lo dirá.

Uptime Kuma: la mejor herramienta gratuita y autoalojada de monitorización de API

Uptime Kuma es la favorita de la comunidad de autoalojamiento, y las cifras de GitHub lo respaldan: , y versión 2.3.2 a mayo de 2026. Tiene licencia MIT, admite HTTP(s), palabras clave, consultas JSON, WebSocket, TCP, ping, DNS, push, Docker, varias páginas de estado y más de 90 servicios de notificación.

Ideal para: desarrolladores individuales y equipos que quieren control total, privacidad y coste SaaS recurrente cero, siempre que tengas un servidor.

Precio: gratis. El coste real es tu VM/contenedor, las copias de seguridad, las actualizaciones y asegurarte de que el propio monitor siga funcionando. Velocidad de puesta en marcha: ~5–15 minutos con Docker para una comprobación básica; 15–30 minutos con notificaciones y una página de estado más pulida.

Inconvenientes: tú te encargas del mantenimiento. Y aquí está el problema crítico: si alojas Uptime Kuma en la misma infraestructura que está monitorizando, una caída de la nube o del DNS tumba tanto tu app como tu monitor. Aloja el monitor fuera o combínalo con un check SaaS.

Better Stack: la mejor opción para responder rápido a incidentes

Better Stack (todavía llamado Better Uptime por muchos usuarios) combina monitorización de uptime con gestión de incidentes, programación de guardias, políticas de escalado y páginas de estado en una sola plataforma. Su fortaleza no está tanto en la analítica como en el flujo de trabajo de incidentes que envuelve la monitorización.

Las definen quién recibe la alerta, en qué orden y con qué retrasos, hasta que alguien la reconoce. El enrutamiento basado en metadatos envía incidentes según la severidad o la propiedad. Se integra con Slack, Teams, webhooks y Zapier.

Ideal para: startups y equipos de tamaño medio que quieren monitorización + respuesta a incidentes + páginas de estado sin unir tres herramientas separadas.

Precio: . El plan Team ronda los 29 dólares/mes en facturación anual. Velocidad de puesta en marcha: ~5–10 minutos con asistente GUI.

Inconvenientes: menos profundidad en analítica de cargas útiles de API, trazado distribuido o análisis de KPI de negocio en comparación con Datadog, New Relic o Moesif.

Prometheus + Grafana: el mejor stack open source para monitorización de API

Esta es la combinación open source estándar de la industria. recopila y almacena métricas de series temporales. (73.705 estrellas en GitHub, 3.010 colaboradores) aporta paneles y alertas. gestiona el enrutamiento, la agrupación, la deduplicación, el silenciamiento y la inhibición. Para comprobaciones de endpoints API, los equipos añaden para sondeos HTTP, HTTPS, DNS, TCP, ICMP y gRPC.

Ideal para: puristas open source, equipos de Kubernetes/SRE y organizaciones que ya están estandarizadas en métricas Prometheus.

Precio: gratis y autoalojado. tiene un plan gratuito (100.000 ejecuciones de pruebas API/mes) y planes de pago por uso.

Velocidad de puesta en marcha: 1–4 horas para un Blackbox + Prometheus + Grafana + Alertmanager básicos. Días para HA de producción y ajuste de alertas.

Inconvenientes: PromQL, YAML, relabeling, diseño de paneles, retención, almacenamiento, HA y ajuste de alertas son trabajo operativo real. La compensación recurrente es “menos interfaz, más YAML”. Este es el stack para equipos que ya piensan en métricas y quieren un plano de control único, no para equipos que quieren tener la monitorización lista antes de comer.

New Relic: la mejor opción para rendimiento de aplicaciones SaaS

New Relic combina APM, monitorización de infraestructura, logs, trazado distribuido, monitorización sintética, alertas, paneles y análisis de incidentes asistido por IA. Su plan gratuito —— es realmente generoso para equipos pequeños.

La inteligencia de alertas es donde New Relic destaca en la conversación sobre fatiga de alertas. Sus funciones de incluyen correlación de eventos, detección de anomalías, alertas predictivas, análisis de causa raíz y supresión de alertas inestables. New Relic ha publicado un ejemplo donde : una cifra concreta de reducción de ruido.

Ideal para: equipos SaaS y plataformas de e-commerce que quieren monitorización de API estrechamente integrada con trazas a nivel de aplicación, errores, throughput e impacto en usuarios.

Precio: Gratis: 100 GB/mes, 1 usuario completo. El plan de pago usa precios por usuario y por volumen de datos.

Velocidad de puesta en marcha: ~15–30 minutos para instalar el agente y completar la configuración guiada.

Inconvenientes: el precio puede volverse complejo a escala. La configuración de alertas tiene curva de aprendizaje: la plataforma es potente, pero no resulta obvia al principio.

Moesif: la mejor opción para analítica de API y métricas de negocio

Moesif no es un monitor tradicional de uptime. Es analítica de API e inteligencia de producto: entender el uso de API por cliente, endpoint, cohorte, empresa, geografía, SDK, plan y comportamiento. Si tu pregunta es “¿qué cliente está afectado?” en vez de “¿está arriba el endpoint?”, Moesif está hecho para eso.

Admite para métricas API como picos/caídas de tráfico, latencia y cambios de comportamiento. Las alertas dinámicas necesitan unos días de comportamiento de API para construir un modelo, pero una vez entrenadas detectan cambios que las reglas estáticas no ven.

Ideal para: equipos de producto API, empresas SaaS y plataformas de e-commerce que necesitan conectar el rendimiento de la API con ingresos, engagement y retención.

Precio: ; los planes de pago escalan con el volumen de eventos API. No pude rastrear por completo las cifras exactas de autoservicio en mi investigación: verifica la página actual.

Velocidad de puesta en marcha: ~20–45 minutos (la integración SDK/proxy/gateway es más profunda que un ping externo).

Inconvenientes: más centrado en analítica que en monitorización tradicional de uptime. Probablemente querrás combinar Moesif con Checkly, UptimeRobot o sintéticos de Datadog para comprobaciones externas de disponibilidad.

Splunk: la mejor opción para análisis de logs enterprise y cumplimiento

Splunk es la herramienta a la que recurres cuando la agregación de logs, la búsqueda, la correlación, la auditabilidad lista para cumplimiento y el soporte híbrido/multicloud no son negociables. cubre infraestructura, APM, sintéticos, monitorización de usuarios reales, logs y respuesta a incidentes. puede agrupar eventos relevantes en episodios y reducir el ruido entre silos de monitorización.

La propia es bastante reveladora: , y .

Ideal para: equipos enterprise y multicloud con requisitos estrictos de cumplimiento, seguridad, auditoría y búsqueda de logs.

Precio: basado en uso y muy orientado a presupuestos personalizados. Sin un plan gratuito sencillo para producción.

Velocidad de puesta en marcha: la incorporación en la nube puede ser más rápida, pero el despliegue enterprise suele llevar de días a semanas.

Inconvenientes: caro a escala. Configuración compleja. Excesivo para desarrolladores individuales y startups pequeñas.

Postman: la mejor opción para equipos que ya prueban APIs

Postman es, ante todo, una plataforma de desarrollo y pruebas de API, pero su permite a los equipos programar colecciones de Postman y ejecutarlas desde ubicaciones en la nube. El argumento más fuerte es la reutilización: si tu equipo de QA o desarrollo ya tiene colecciones de Postman con aserciones, convertirlas en monitores es el siguiente paso natural.

Ideal para: equipos de desarrollo y QA que ya usan colecciones de Postman y quieren checks programados sin comprar una herramienta sintética aparte.

Precio: existe un plan gratuito. ; bloque adicional de 50.000 llamadas por 20 dólares/mes. Verifica la , porque la oferta de Postman cambia.

Velocidad de puesta en marcha: ~10 minutos si ya existen colecciones.

Inconvenientes: las capacidades de monitorización son más ligeras que las de herramientas dedicadas como Checkly, Datadog o New Relic. Las opciones de alerta son básicas.

Otras herramientas de monitorización de API que merecen la pena

: panel de salud ligero, autoalojado y basado en configuración. , admite HTTP, ICMP, TCP, DNS, métricas compatibles con Prometheus y badges de uptime. Muy bueno para desarrolladores individuales que quieren algo más simple que Prometheus pero prefieren YAML/configuración como código antes que la interfaz de Uptime Kuma.

: herramienta más reciente centrada en analítica de tráfico API y seguimiento de calidad para startups. Afirma con alertas personalizadas sobre 14 métricas. Buena para analítica ligera de API sin adoptar una plataforma de observabilidad completa.

: monitorización integral con logs, sintéticos y visibilidad de infraestructura. . Una alternativa a Datadog de menor coste para equipos de mercado medio.

: backend nativo de OpenTelemetry para APM, trazado, métricas y logs. . No es un comprobador puro de uptime, pero es ideal para equipos que se estandarizan en OTel y quieren un backend de trazado amigable con el open source.

Hacer o comprar: ¿deberías montar tu propia monitorización de API?

“¿Me basta con escribir un script que haga ping a mis endpoints o debería usar una herramienta dedicada?”

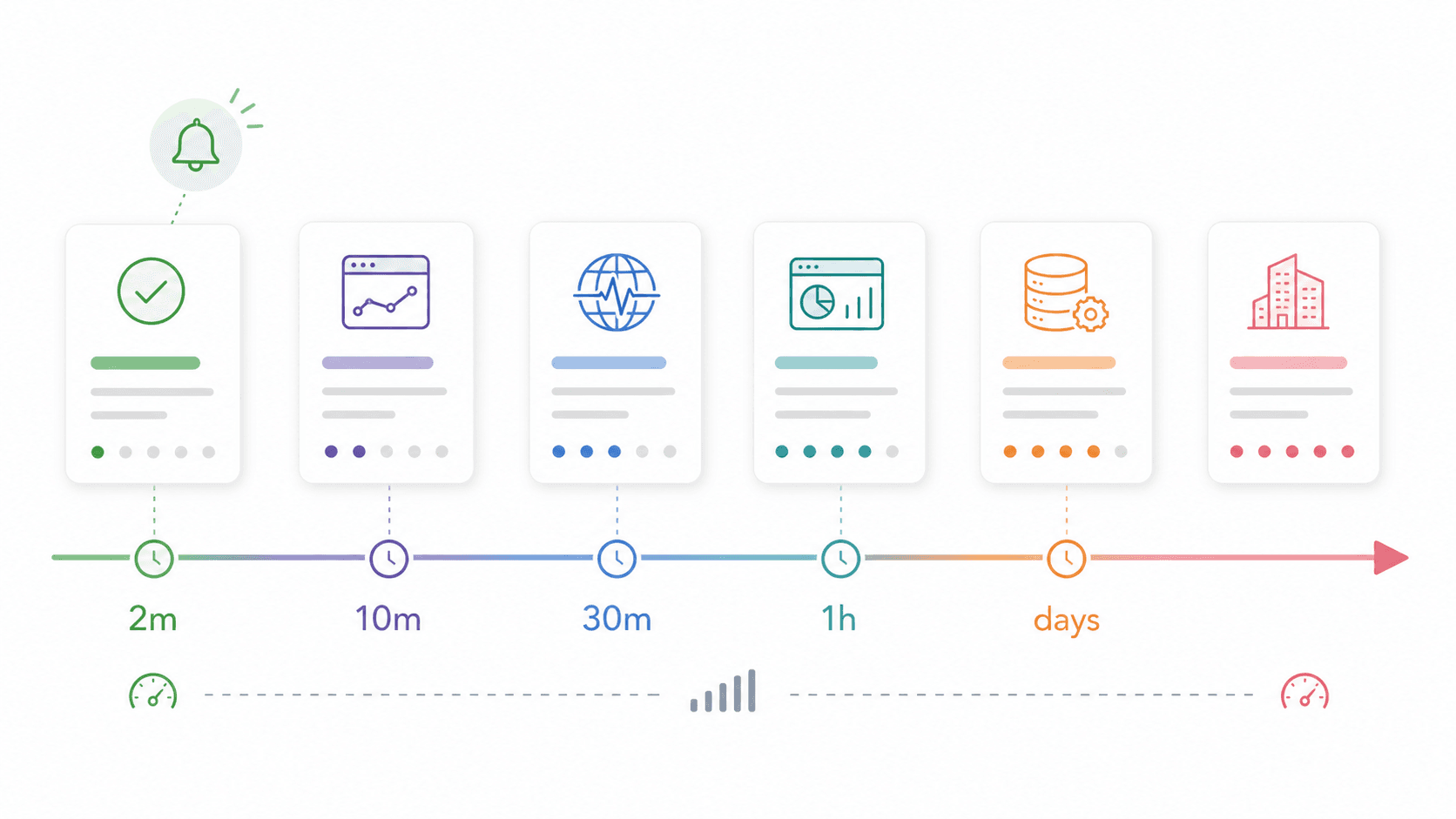

Esta pregunta aparece constantemente en foros de desarrolladores. He leído suficientes hilos de Reddit como para ver el patrón con claridad: los equipos empiezan con curl + cron, funciona bien durante un tiempo y luego cambian cuando necesitan paneles, datos históricos, comprobaciones multirregión, enrutamiento fiable de alertas o visibilidad entre equipos.

Una matriz de decisión honesta:

| Factor | Script personalizado | Herramienta especializada |

|---|---|---|

| Tiempo de configuración | 1–4 horas (básico); días (robusto) | 5–30 minutos |

| Mantenimiento | Lo mantienes tú para siempre | El proveedor gestiona las actualizaciones |

| Calidad de alertas | Básica (arriba/abajo) | Inteligente (tendencias de latencia, anomalías, reintentos) |

| Coste | Gratis (tu tiempo) | 0–500+ dólares/mes |

| Panel | Construido desde cero | Preconstruido y personalizable |

| Mejor cuando… | ≤3 endpoints, equipo muy técnico, proyecto hobby | 5+ endpoints, equipo de operaciones/producto, ingresos en juego |

La idea clave que sale de los foros: quienes construyen su propia solución suelen arrepentirse en cuanto necesitan paneles, datos históricos o visibilidad entre equipos. Y está el problema meta: “necesitas monitorización para tu monitorización”. Un monitor autoalojado, la base de datos, las copias de seguridad, la red y el proveedor de alertas también tienen que ser fiables.

Construye si tienes 2 endpoints y te gusta trastear. Compra si tienes un producto que sacar al mercado.

La misma lógica aplica a la extracción de datos web. Puedes escribir un scraper, ejecutar navegadores sin cabeza, rotar proxies, mantener selectores, limpiar HTML y construir una cola. Pero si la tarea es alimentar de forma fiable un producto API, un agente de IA o un flujo de investigación con datos web, usar suele ser más rápido que montar tu propia infraestructura de scraping.

Fatiga de alertas: por qué la calidad gana a la cantidad

Este quizá sea el criterio más infravalorado al elegir una herramienta de monitorización de API. La fatiga de alertas es lo que ocurre cuando los equipos reciben tantas alertas ruidosas, duplicadas o que no requieren acción que terminan ignorándolas todas y luego se pierden los incidentes reales.

Las cifras son llamativas. encontró que la organización mediana generaba y . La acciónabilidad mediana de los incidentes era solo del , lo que significa que menos de 1 de cada 5 incidentes derivados de alertas era realmente accionable. encontró que y que .

La mejor herramienta de monitorización es aquella cuyas alertas realmente confías. Así es como gestionan la inteligencia de alertas las distintas herramientas:

| Herramienta | Tipo de alerta | Método de reducción de ruido | Canales de alerta |

|---|---|---|---|

| Datadog | Anomalía ML, previsión, compuesta | Bandas históricas de anomalías, líneas base dinámicas, Watchdog AI | Slack, PagerDuty, Opsgenie, Teams, más de 20 |

| Checkly | Umbral + basada en degradación | Reintentos antes de disparar, reintentos desde misma/diferente ubicación | Slack, PagerDuty, Opsgenie, Teams, incident.io |

| New Relic | Agrupación de incidencias por IA, anomalía, predictiva | Correlación de eventos, supresión de flapping, contexto de causa raíz | Slack, PagerDuty, Teams, webhooks |

| Moesif | Anomalía de comportamiento | Modelos dinámicos tras varios días de comportamiento | Slack, PagerDuty, email, SMS |

| Better Stack | Uptime/incidente/guardia | Políticas de escalado, enrutamiento por propiedad, retrasos | Slack, Teams, webhooks, Zapier |

| Prometheus + Alertmanager | Alertas por reglas PromQL | Agrupación, deduplicación, silenciamiento, inhibición | Email, PagerDuty, Opsgenie, webhooks |

| Splunk | Eventos, episodios, salud de servicio | ITSI Event Analytics, agrupación de episodios, ticketing | Splunk On-Call, ServiceNow, webhooks |

| Thunderbit Open API | No es una plataforma de alertas | Úsalo con tu propio scheduler, herramienta de workflow o stack de monitorización | Webhooks para trabajos por lotes; las alertas se gestionan externamente |

Consejo práctico: empieza con menos alertas y de mayor confianza. Usa reintentos antes de disparar, confirmación multirregión, alertas por tasa de agotamiento de SLO, deduplicación y enrutamiento por propiedad. Alerta sobre impacto en el usuario y flujos críticos de negocio (fallo en checkout, fallo de autenticación, 5xx en pagos), no sobre cada síntoma interno.

Planes gratuitos y precios en 2026: lo que realmente pagas

Las páginas de precios cambian. Los planes gratuitos se modifican. Los costes ocultos (hosts, usuarios, logs, ejecuciones sintéticas, entrada de datos) pueden sorprenderte. Esta es la sección que me gustaría ver en todos los artículos de “mejores herramientas”. El resumen de 2026:

| Herramienta | Plan gratuito | Desde | ¿Se requiere tarjeta? | Mejor caso de uso gratis |

|---|---|---|---|---|

| Thunderbit Open API | 600 unidades API de uso único | ~16 dólares/mes anual | No | Extracción de datos web para LLMs, RAG, precios e investigación |

| Uptime Kuma | Ilimitado (autoalojado) | — | No | Monitorización completa, tu propio servidor |

| UptimeRobot | 50 monitores, intervalos de 5 min | ~7 dólares/mes | No | Comprobaciones básicas de uptime |

| Better Stack | 10 monitores, 1 página de estado | ~29 dólares/mes | No | Uptime de startup + página de estado |

| Checkly | 10 uptime, 10k checks API | ~24 dólares/mes | Sí | Checks sintéticos de API |

| Postman | Cuenta gratuita + cuota de monitorización | ~14 dólares/usuario/mes | No | Reutilizar colecciones existentes |

| Prometheus + Grafana | Ilimitado (autoalojado) | — | No | Métricas + visualización |

| Grafana Cloud | 100k ejecuciones de prueba API/mes | 29 dólares/mes plataforma + uso | Verificar | Prueba de sintéticos gestionados |

| New Relic | 100 GB/mes, 1 usuario completo | Por usuario + datos | En algunos planes | APM + observabilidad básica |

| Datadog | Prueba/varía según producto | 15 dólares/host/mes (Infra Pro) | A menudo sí | Evaluación full-stack |

| Moesif | Hay plan gratis/prueba disponible | Basado en volumen | Verificar | Evaluación de analítica API |

| Splunk | Hay pruebas disponibles | Basado en presupuesto | Flujo de ventas | Prueba de concepto enterprise |

| Gatus | Ilimitado (autoalojado) | — | No | Panel de estado basado en YAML |

| Apitally | Hay plan gratis/prueba disponible | Verificar | Verificar | Analítica ligera de API |

| Sematext | La prueba/gratuito varía | ~2 dólares/monitor HTTP | Verificar | Sintéticos/logs de menor coste |

| Uptrace | Gratis autoalojado | Los niveles cloud varían | Verificar | Evaluación de APM OTel |

Nota sobre costes ocultos: las herramientas autoalojadas (Uptime Kuma, Prometheus, Gatus) son “gratis” en términos de licencia, pero una VM pequeña, las copias de seguridad, el tiempo de mantenimiento y el failover externo pueden convertirse fácilmente en el coste real. En las APIs de datos web, el coste oculto suele ser otro: mantener navegadores sin cabeza, selectores rotos, grupos de proxies, soluciones anti-bot y limpieza de HTML.

Estimación para equipos pequeños: para 10 endpoints de API y 3 miembros del equipo, la ruta SaaS más barata suele ser UptimeRobot gratuito o de bajo coste, Better Stack gratis/Team, o Checkly si el volumen de ejecuciones encaja. Datadog y New Relic pueden ser asequibles para evaluación, pero la factura real depende de hosts, usuarios, logs, trazas y volumen de ejecuciones sintéticas. Si tu proyecto necesita datos web como API, las unidades API gratuitas de Thunderbit bastan para probar el flujo antes de comprometerte con un plan de pago.

Tabla de complejidad de configuración: cuánto tardas hasta la primera alerta

No he encontrado ningún artículo de la competencia que evalúe el tiempo hasta el valor: cuánto pasa desde el registro hasta recibir tu primera alerta realmente útil. Para equipos pequeños, esto importa más que la profundidad de funciones.

| Herramienta | Tiempo hasta la primera alerta | Nivel técnico necesario | Enfoque de configuración |

|---|---|---|---|

| Thunderbit Open API | ~5–15 minutos | Bajo–medio | Clave API, cURL/SDK/CLI |

| UptimeRobot | ~2–5 minutos | Bajo | GUI, añadir con un clic |

| Better Stack | ~5–10 minutos | Bajo | Asistente GUI |

| Checkly | ~10–20 minutos | Bajo–medio | Código o GUI |

| Postman | ~10 minutos (con colecciones) | Bajo–medio | Programador de colecciones |

| Uptime Kuma | ~5–30 minutos | Medio | Docker + GUI |

| Gatus | ~15–45 minutos | Medio | YAML + Docker |

| Datadog | ~15–30 minutos | Medio | Instalación del agente + GUI |

| New Relic | ~15–30 minutos | Medio | Agente + configuración guiada |

| Moesif | ~20–45 minutos | Medio | Integración SDK/proxy |

| Grafana Cloud Synthetics | ~15–45 minutos | Medio | GUI, Terraform opcional |

| Prometheus + Grafana | 1–4 horas | Medio–alto | YAML, PromQL |

| Uptrace | 30–90 minutos | Medio–alto | Integración de SDK OTel |

| Splunk | De horas a semanas | Alto | Incorporación enterprise |

Si la monitorización tiene que estar activa antes de terminar el día, empieza en la mitad superior de esa tabla. Si el objetivo es una observabilidad de plataforma duradera, planifica un proyecto aparte para la mitad inferior. Y si tu primer hito es “obtener datos limpios de estas 100 páginas web en una app”, empieza con Thunderbit antes de montar infraestructura de scraping personalizada.

Comparativa completa de las mejores herramientas de monitorización de API

Una tabla para repasar antes de decidir:

| Herramienta | Mejor caso de uso | Plan gratuito | Inteligencia de alertas | Tiempo de configuración | Alojamiento | Función destacada |

|---|---|---|---|---|---|---|

| Thunderbit Open API | Extracción de datos web/pipelines de datos API | 600 unidades API | No es una herramienta de alertas | 5–15 min | Cloud | Convierte páginas en Markdown o extrae JSON basado en esquema |

| Datadog | Enterprise/SaaS full-stack | Prueba/varía | Anomalías, previsión, IA | 15–30 min | Cloud | Correlaciona sintéticos con logs/trazas/infra |

| Checkly | Sintéticos pensados para desarrolladores | Generoso según checks | Reintentos, degradación | 10–20 min | Cloud | Monitorización como código + Playwright |

| UptimeRobot | Uptime simple | 50 monitores | Umbrales básicos | 2–5 min | Cloud | Monitor básico de bajo coste y muy rápido |

| Uptime Kuma | Gratis y autoalojado | Ilimitado | Estado/umbral básicos | 5–30 min | Autoalojado | UI limpia, sin cuota SaaS |

| Better Stack | Respuesta a incidentes/páginas de estado | 10 monitores | Escalados, enrutamiento | 5–10 min | Cloud | Monitorización + guardia + página de estado |

| Prometheus + Grafana | Stack open source de métricas | Ilimitado (autoalojado) | Agrupación de Alertmanager | 1–4 h | Autoalojado/cloud | Profundidad del ecosistema PromQL |

| New Relic | APM SaaS + checks API | 100 GB/mes, 1 usuario | Agrupación por IA, supresión de flapping | 15–30 min | Cloud | Fuerte APM + sintéticos juntos |

| Moesif | Analítica API/métricas de negocio | Gratis/prueba | Anomalías de comportamiento | 20–45 min | Cloud | Analítica del comportamiento API por cliente |

| Splunk | Logs enterprise/cumplimiento | Prueba | Episodios ITSI, AIOps | Días+ | Cloud/gestionado por el cliente | Búsqueda y gobernanza de logs enterprise |

| Postman | Equipos que ya prueban APIs | Cuenta gratuita | Alertas básicas de monitorización | 10 min | Cloud | Reutiliza colecciones de pruebas API |

Cómo Thunderbit puede acelerar la evaluación de tus herramientas de API

Divulgación completa: no es una herramienta de monitorización de API, sino un raspador web con IA y una para convertir páginas web en Markdown limpio o JSON estructurado. Eso lo hace útil en otra parte del proceso de decisión sobre herramientas de monitorización: recopilar precios de proveedores, límites de planes, afirmaciones sobre funciones, detalles de documentación y listas de integraciones antes de elegir una plataforma.

En lugar de abrir manualmente más de 10 páginas de precios de proveedores, copiar nombres de planes, límites de monitores, intervalos de comprobación, integraciones y requisitos de tarjeta en una hoja de cálculo, usamos la para extraer datos estructurados de las páginas de precios y funciones de cada herramienta. La IA de Thunderbit lee cada página y sugiere campos —nombre del plan, detalles del plan gratuito, precio de pago, integraciones compatibles— y luego estructura la salida en una hoja exportable.

Para flujos de trabajo de desarrolladores, te da la misma idea de forma programática. Usa Distill cuando quieras Markdown limpio para LLMs o RAG. Usa Extract cuando necesites campos concretos devueltos como JSON. Usa Batch cuando necesites procesar una lista de páginas de precios, URLs de documentación, páginas de producto o páginas de la competencia y recibir resultados de forma asíncrona.

El flujo de trabajo:

- Abre la página de precios de un proveedor (Datadog, Checkly, UptimeRobot, etc.)

- Haz clic en “AI Suggest Fields”: Thunderbit propone columnas basadas en el contenido de la página

- Haz clic en “Scrape”: los datos se rellenan en una tabla estructurada

- Usa el scraping de subpáginas para visitar las páginas de precios, funciones y documentación de cada proveedor

- Exporta a Google Sheets, Excel, Airtable, Notion o CSV

Para equipos que trabajan primero con API, el flujo es igual de directo:

- Obtén una clave API gratuita de Thunderbit

- Llama al endpoint Distill para obtener Markdown limpio de cualquier página pública

- Llama al endpoint Extract con descripciones de esquema para obtener JSON estructurado

- Usa endpoints Batch y webhooks para listas grandes de URLs

- Envía la salida a tu app, hoja de cálculo, warehouse, base vectorial o flujo de monitorización

Para comparar más de 10 proveedores, copiar y pegar manualmente puede llevar fácilmente 2–3 horas si incluyes subpáginas de precios, documentación e integraciones. Thunderbit redujo nuestra extracción inicial a unos 15–30 minutos, y el tiempo restante se dedicó a verificación y decisiones de criterio. Si tu equipo de operaciones, compras, investigación o producto de IA está evaluando herramientas con poco tiempo, es un atajo práctico. Puedes ver más sobre este tipo de flujo en nuestra guía de , explorar los o echar un vistazo a nuestro para ver tutoriales.

Cómo elegir la mejor herramienta de monitorización de API para tu equipo

La “mejor” herramienta de monitorización de API depende del tamaño de tu equipo, su nivel técnico, el presupuesto y qué significa un fallo para tu producto.

Un desarrollador individual no necesita Splunk. Una empresa regulada no debería depender de un cron job. Un equipo de producto API puede necesitar más analítica de clientes al estilo Moesif que pings de uptime. Un equipo de e-commerce debería priorizar comprobaciones críticas de login, búsqueda, añadir al carrito, checkout y autorización de pago. Un equipo de IA o de datos puede necesitar extracción de datos web al estilo Thunderbit antes que observabilidad completa.

Tres principios que se mantuvieron en toda mi investigación:

- Ajusta la herramienta a tu caso de uso. La tabla rápida existe por una razón: empieza por ahí.

- Prioriza la calidad de las alertas sobre la cantidad de alertas. Si tu equipo ignora las alertas, no tienes monitorización. Tienes ruido.

- No subestimes la velocidad de puesta en marcha. Un monitor que entra en producción hoy y envía alertas fiables es mejor que un plan de plataforma perfecto que deja el checkout sin vigilar durante otro mes.

Si estás comparando varias herramientas a la vez y quieres acelerar la investigación, prueba para extraer en bloque datos de proveedores en una sola hoja de cálculo. Si estás construyendo un producto API, un pipeline RAG, un agente de IA o un flujo de inteligencia de mercado que necesita datos web limpios, empieza con . No elegirá la herramienta de monitorización por ti, pero te llevará más rápido a la decisión y puede darle a tu propio producto una capa fiable de datos web.

Preguntas frecuentes sobre las mejores herramientas de monitorización de API

¿Cuál es la mejor herramienta gratuita de monitorización de API en 2026?

Para sencillez SaaS, UptimeRobot ofrece 50 monitores gratuitos con intervalos de 5 minutos y sin necesidad de tarjeta. Para control autoalojado, Uptime Kuma es open source, ilimitado y tiene una interfaz limpia con más de 90 servicios de notificación. Para equipos que quieren profundidad en métricas y ya tienen capacidad técnica, Prometheus + Grafana + Alertmanager es el mejor stack open source, aunque la configuración lleva horas, no minutos.

Si tu objetivo no es monitorizar uptime sino extraer datos web mediante una API, Thunderbit Open API tiene un plan gratuito con 600 unidades API de uso único, suficiente para probar la distilación de página a Markdown o la extracción de JSON basada en esquema antes de escalar.

¿Cuál es la diferencia entre monitorización de API y APM?

La monitorización de API comprueba desde fuera la disponibilidad del endpoint, el tiempo de respuesta, los errores y la corrección: simula lo que experimenta un usuario o una integración. APM (Application Performance Monitoring) va más al interior de la aplicación: trazas a nivel de código, consultas a bases de datos, errores de ejecución, latencia de colas y dependencias de servicios. Herramientas como Datadog y New Relic ofrecen ambas; UptimeRobot y Uptime Kuma se centran en checks externos de uptime.

Thunderbit Open API es distinto de ambos: es una API de extracción de datos web. Te ayuda a convertir sitios web externos en Markdown o JSON estructurado, algo útil para apps de LLM, flujos de investigación, inteligencia de precios y pipelines de datos.

¿Con qué frecuencia debería monitorizar mis APIs?

Las APIs de producción críticas para ingresos (checkout, auth, pagos) suelen revisarse cada 1 minuto. Las APIs internas o con poco tráfico pueden comprobarse cada 5 minutos. Pero la frecuencia por sí sola no lo es todo: usa reintentos, varias regiones y aserciones significativas para que cada comprobación sea rápida y fiable. Un check de 1 minuto que dispara falsas alarmas es peor que uno de 5 minutos en el que puedes confiar.

En flujos de extracción de datos web, la frecuencia depende de lo rápido que cambie la fuente. Las páginas de precios pueden necesitar extracción diaria o semanal. Los datos de inventario, viajes o marketplaces, que cambian rápido, pueden necesitar actualizaciones cada hora o con más frecuencia. La API Batch y los webhooks de Thunderbit son útiles cuando necesitas procesar muchas URLs según un calendario.

¿Puedo monitorizar APIs sin escribir código?

Sí. UptimeRobot, Better Stack y Uptime Kuma pueden usarse completamente a través de interfaces gráficas. Checkly admite configuración tanto por GUI como por código. Postman usa una interfaz basada en colecciones. Prometheus/Grafana suele requerir YAML y PromQL. Datadog y New Relic pueden empezar con configuración guiada, pero se vuelven más potentes con una instrumentación más profunda.

Si quieres extraer datos de sitios web sin escribir código, la extensión de Chrome de Thunderbit es la vía no-code. Si quieres automatizar ese mismo flujo desde una aplicación, ofrece a los desarrolladores endpoints Distill, Extract y Batch.

¿Cómo reduzco la fatiga de alertas de la monitorización de API?

Elige herramientas con alertas inteligentes: detección de anomalías (Datadog, New Relic), reintentos antes de disparar (Checkly), anomalías de comportamiento (Moesif) o agrupación/silenciamiento (Prometheus Alertmanager). Empieza con menos alertas y de mayor confianza, centradas en el impacto visible para el usuario. Usa alertas por tasa de agotamiento de SLO en lugar de umbrales estáticos, deduplica entre servicios, enruta por propiedad y mide la acciónabilidad: si menos del 20% de tus alertas lleva a una acción real, reduce primero el ruido.

Más información