Una búsqueda en GitHub de "amazon scraper" devuelve aproximadamente . Si la acotas a repos que han recibido commits en los últimos seis meses, bajas a unos , apenas el 20%. ¿El resto? Tutoriales abandonados, wrappers obsoletos y scripts que dejaron de funcionar en cuanto Amazon reforzó sus defensas.

He pasado mucho tiempo revisando repos de Amazon scraper, leyendo issues en GitHub y siguiendo hilos de la comunidad en Reddit y Stack Overflow. El patrón es siempre el mismo: alguien encuentra un repo popular, dedica una hora a configurarlo, lo ejecuta una vez y choca con una pared de CAPTCHAs o errores 503. La postura anti-bots de Amazon en 2026 no es la misma que hace siquiera dos años: el fingerprinting TLS, el análisis de comportamiento y la implementación agresiva de CAPTCHAs han vuelto casi inútil el viejo plan de "rotar user agents y cruzar los dedos". Esta guía cubre las prácticas que de verdad importan si quieres obtener datos fiables de Amazon desde un repo de GitHub, y qué hacer cuando tu scraper se rompe —no si se rompe—.

¿Qué es un Amazon Scraper en GitHub y por qué fallan tantos?

Un repo de Amazon scraper en GitHub suele ser un script de código abierto —normalmente en Python, Node.js o basado en Scrapy— que extrae datos estructurados de páginas de Amazon. Los objetivos de datos son los habituales: título del producto, precio, ASIN, valoraciones, número de reseñas, disponibilidad, información del vendedor, tarjetas de resultados de búsqueda y texto de reseñas.

La arquitectura suele ser bastante simple:

- Un cliente HTTP o un navegador sin interfaz carga la página.

- Un parser de HTML o JSON extrae los campos.

- Los datos se guardan en CSV, JSON o una base de datos.

Los repos suelen caer en cuatro categorías:

- Librerías ligeras de Python (p. ej., )

- Spiders de Scrapy (p. ej., )

- Automatizadores de navegador con Selenium o Playwright

- Proyectos wrapper de API que en realidad son front-ends de un servicio comercial de scraping (p. ej., )

El patrón de fallo es predecible. La mayoría de los repos se rompen porque:

- Amazon cambia el diseño de sus páginas o fragmentos HTML

- Amazon devuelve un 503 o un CAPTCHA en lugar del contenido real

- El fingerprint TLS y HTTP del scraper ya no se parece al de un navegador

- Las discrepancias de región, idioma o cabeceras activan sospechas

- Quien mantiene el proyecto se pasa a otra cosa después de resolver su caso de uso original y limitado

Tener muchas estrellas y estar "usable ahora" no es lo mismo. En la auditoría que hice para este artículo, solo unos tres de los ocho repos más visibles parecían claramente activos en 2026.

Haz una auditoría de frescura de 2026 antes de clonar cualquier repo de Amazon Scraper en GitHub

Este paso importa más para Amazon que para la mayoría de los demás objetivos. La postura defensiva de Amazon cambia más rápido que la de un sitio ecommerce típico, así que un repo que funciona bien en una web corporativa puede volverse inútil en Amazon en cuestión de semanas. Aun así, la mayoría de las listas de "best amazon scraper github" recomiendan repos sin comprobar si siguen funcionando. La gente pierde horas configurando herramientas rotas.

Cómo comprobar si un repo de GitHub sigue vivo

Antes de ejecutar git clone en nada, revisa esto:

- Fecha del último commit: cualquier cosa anterior a 6 meses es una señal de alarma importante en Amazon.

- Issues abiertos vs. tasa de respuesta: busca en la pestaña Issues términos como "captcha", "503", "blocked" y "not working". Si esos reportes se acumulan sin respuesta del mantenedor, mejor pasa de largo.

- Salud de dependencias: abre

requirements.txtopackage.json. Las librerías obsoletas (por ejemplo,requestsantigua sin soporte moderno de TLS) son una mala señal. - Cobertura de tipos de página de Amazon: ¿el repo maneja páginas de producto, resultados de búsqueda y reseñas? ¿O solo una de ellas?

- Enfoque anti-bot: cabeceras hardcodeadas sin soporte de proxy es un enfoque propio de 2023 que no sobrevivirá a 2026.

Lista de verificación de frescura para Amazon Scraper en GitHub

| Señal de frescura | Qué comprobar | Señal de alarma 🚩 |

|---|---|---|

| Fecha del último commit | Feed de commits o fecha de push del repo | Más de 6 meses de antigüedad |

| Issues abiertos | Pestaña Issues — filtra por "captcha", "503", "blocked" | Errores repetidos sin respuesta del mantenedor |

| Salud de dependencias | requirements.txt / package.json | Librerías obsoletas, sin estrategia TLS moderna |

| Cobertura de páginas de Amazon | README + ejemplos de código | Solo cubre un tipo de página (p. ej., producto, pero no búsqueda o reseñas) |

| Enfoque anti-bot | Código fuente, configuración de proxies | Solo cabeceras y cadenas UA hardcodeadas |

| Modelo de mantenimiento | ¿Es un scraper real, un tutorial o un wrapper de API comercial? | El repo es en realidad solo un front-end de un servicio de pago |

Lo que encontró realmente la auditoría

Revisé ocho repos de Amazon scraper muy visibles con estos criterios. Los resultados son poco alentadores:

| Repo / herramienta | Estrellas | Señal del último commit | Alcance | Estado en 2026 | Notas |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2.872 | 2026-04-02 | Wrapper de API gestionada de scraping | Vivo, pero no DIY | Fresco, pero en realidad es un front-end de un servicio gestionado |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | API gestionada para búsqueda, detalles y reseñas | Vivo, pero no DIY | Buena cobertura, pero es un producto API, no un scraper en bruto |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Librería ligera de Python | Vivo | El scraper directo de GitHub más claro usando curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Solo reseñas | Limitado, pero usable | Antiguo y muy específico para reseñas |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Último commit en 2023; repo con push en 2024-08-20 | Spiders de Scrapy + middleware de proxy | A nivel tutorial, envejeciendo | Útil para aprender, no como stack listo para 2026 |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | CLI de Node para búsqueda, detalles y reseñas | Alto riesgo | Cobertura amplia, pero el mantenimiento es demasiado antiguo |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | De búsqueda a CSV | Muerto para 2026 | Popular en su momento, claramente obsoleto |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Tutorial de búsqueda/producto | Muerto para 2026 | Prácticamente archivado |

Los issues públicos cuentan la misma historia. tiene un issue titulado "All requests receive captcha response." muestra "Doesn't seem to be working." tiene "Bypass Amazon protection." No son casos límite oscuros: son lo primero con lo que se topa la gente.

El manual anti-bloqueo: cómo evitar que te bloqueen con un Amazon Scraper de GitHub

Ser bloqueado es el mayor dolor de cabeza para cualquiera que use un proyecto de amazon scraper github. Consejos genéricos como "usa proxies y rota user agents" ya no bastan. La pila anti-bots de Amazon para 2025-2026 incluye fingerprinting TLS, análisis de comportamiento y despliegue agresivo de CAPTCHAs. Necesitas un enfoque por capas.

Coincidencia de fingerprint TLS: por qué requests sin modificar te hace caer en la lista negra

Esta es una de las técnicas anti-bloqueo más infravaloradas. El fingerprinting TLS funciona así: cuando tu script abre una conexión segura con Amazon, el servidor puede averiguar mucho sobre el cliente por cómo "da la mano" —los cipher suites que ofrece, el orden de las extensiones, la configuración HTTP/2. Los navegadores usan ajustes TLS y HTTP/2 relativamente fijos, y esas combinaciones se pueden identificar mediante técnicas como .

requests puro y configuraciones normales de httpx pueden copiar cabeceras, pero no copian el comportamiento TLS y HTTP/2 de Chrome. Amazon sí nota la diferencia.

aborda esto directamente. Ofrece suplantación de navegador —los objetivos compatibles incluyen chrome136, safari184 y firefox133— para que el fingerprint TLS de tu cliente HTTP coincida con el de un navegador real. La documentación advierte explícitamente que no generes cadenas JA3 aleatorias: los fingerprints del navegador son casi fijos por versión, y un patrón aleatorio sin sentido es más fácil de detectar que un fingerprint real copiado.

Los datos de la comunidad coinciden. Un confirma que el argumento impersonate es útil porque rota perfiles de navegador y mantiene alineadas las cabeceras. Otro señala que Amazon bloquea clientes según el fingerprint TLS "después de un mes o dos". Un pregunta específicamente si Amazon está haciendo fingerprinting de python-requests (spoiler: sí).

Si todavía usas requests puro como tu cliente principal para Amazon, cambia esa suposición antes de mejorar nada más.

Rotación de proxies bien hecha (no solo "usa proxies")

El objetivo de los proxies no es rotar lo máximo posible. El objetivo es que las sesiones parezcan creíbles.

Residenciales vs. datacenter: los proxies de datacenter son más baratos, pero más fáciles de detectar. Los proxies residenciales cuestan más, pero Amazon tiene muchas más dificultades para marcarlos. El parte de 4,00 USD/GB con pago por uso, y baja a 3,50 USD/GB en planes más grandes. parte de 6 USD/GB. Amazon entra en la categoría de "objetivo sofisticado", donde los proxies residenciales sí justifican la prima.

Rotación por solicitud vs. por sesión: aquí es donde la mayoría de los tutoriales se equivocan. Rotar proxies en cada solicitud mientras mantienes cookies y cabeceras constantes puede parecer menos humano, no más. El patrón más seguro:

- Mantén la navegación búsqueda → producto → reseña en la misma sesión sticky siempre que sea posible

- Cambia de sesión cuando empieces una nueva búsqueda, no en cada solicitud

- Rota entre sesiones, no aleatoriamente dentro de una sola sesión de navegación

Un señaló que las IPs estándar de ISP rindieron bastante peor que las IPs móviles en sitios ecommerce populares. Otro informó de bloqueos incluso usando user agents rotatorios y proxies residenciales, un buen recordatorio de que los proxies por sí solos no bastan.

Ritmo de solicitudes, backoff y limitación de tasa

Las páginas 503 de Amazon no son mala suerte al azar. Son retroalimentación.

Una sobre el scraping de más de 500 ASIN reportó un 503 siempre en el mismo punto, alrededor del ASIN 101, incluso con pausas. El patrón es antiguo, pero la lección sigue vigente: un volumen bruto desde una sola IP o fingerprint acaba activando defensas.

Ritmo recomendado para scrapers DIY de GitHub:

- Retrasos aleatorios entre solicitudes (no intervalos fijos, que son detectables)

- 2 a 5 segundos entre solicitudes públicas de producto para clientes HTTP simples

- Backoff exponencial tras un 503 o un CAPTCHA: retrocede de forma progresiva en vez de reintentar inmediatamente

- Menor concurrencia de la que crees que necesitas

- Registro fail-open en lugar de bucles de reintento cerrados

La mayoría de los repos de amazon scraper github no incluyen limitación de tasa integrada. Tendrás que añadirla tú.

Orquestación de cabeceras: algo más que cadenas de User-Agent

Amazon revisa todo el conjunto de cabeceras, no solo el User-Agent.

Un conjunto de cabeceras de navegador realista debería incluir:

User-AgentAcceptAccept-LanguageAccept-Encoding- hints

Sec-CH-*cuando corresponda - un comportamiento de conexión coherente con el perfil de navegador elegido

Las cabeceras deben coincidir con la configuración regional del marketplace. Un descubrió que la misma configuración de bot solo era detectada en algunos locales, y otro comentarista apuntó a cabeceras relacionadas con la región, como Accept-Language.

La regla es esta: las cabeceras, el perfil TLS/navegador y la geografía del proxy no deben contradecirse. No envíes cabeceras de Chrome con un UA de Firefox. No uses un proxy de EE. UU. con Accept-Language: de-DE.

Gestión de CAPTCHAs: cuándo resolverlos y cuándo retroceder

Encontrar un CAPTCHA significa que Amazon ya sospecha. Resolverlo no reinicia tu puntuación de confianza.

Para eventos de CAPTCHA aislados y poco frecuentes:

- El paquete de PyPI es un solucionador de CAPTCHAs de texto de Amazon escrito en puro Python, aunque su última versión es de mayo de 2023; úsalo como herramienta táctica, no como estrategia duradera

- indica un precio de 0,45 USD por cada 1.000 captchas de Amazon resueltos

Para bucles repetidos de CAPTCHA:

- Deja de resolver y empieza a retroceder

- Los CAPTCHAs repetidos significan que la sesión está quemada; resolverlos no reconstruye la confianza en el fingerprint, el historial de sesión o la reputación de la IP

- Si los CAPTCHAs se agrupan por subred de proxy, el problema está en la capa de red, no en el parser

Cuándo de verdad necesitas un navegador sin interfaz y cuándo es demasiado

La idea equivocada es usar Playwright para todo.

Buenos casos de uso de navegador:

- Resultados de búsqueda que dependen de renderizado JavaScript o de estado según la región

- Flujos de reseñas que redirigen a páginas de inicio de sesión o acceso

- Procesos en los que las cookies y el contexto del navegador importan más que la velocidad bruta

Malos casos de uso de navegador:

- Páginas públicas normales de producto

- Extracción estática de detalles de producto donde basta un cliente HTTP con aspecto de navegador

- Recuperación masiva a gran escala donde la eficiencia de cómputo importa

Empieza con el cliente más ligero que funcione. Un sobre scraping a escala describía la progresión: empezar con requests, después curl_cffi, y solo pasar a un navegador completo cuando fallen las opciones ligeras. Los navegadores sin interfaz son materialmente más lentos y consumen muchos más recursos que los clientes HTTP para scraping de páginas de producto de Amazon.

Matriz de decisión anti-bloqueo para proyectos Amazon Scraper en GitHub

| Escenario | Enfoque recomendado | Por qué |

|---|---|---|

| Páginas públicas de producto (escala pequeña) | curl_cffi + sesión residencial sticky | La ruta más barata que sigue pareciendo un navegador |

| Páginas de resultados de búsqueda | curl_cffi primero, Playwright solo si el renderizado o el estado rompen HTTP | La búsqueda depende más del estado y de la región |

| Reseñas (requiere inicio de sesión) | Modo navegador con cookies/sesión reales | El inicio de sesión y los flujos dinámicos de reseñas son más difíciles de emular con HTTP puro |

| Gran escala (5.000+ al día) | API de scraping gestionada, unlocker o plataforma no-code | El código DIY de GitHub por sí solo se convierte en un problema de infraestructura |

Cuando tu proyecto Amazon Scraper de GitHub se rompe: ten un plan B no-code

Todo scraper con experiencia mantiene un plan B.

Las actualizaciones de Amazon acabarán rompiendo cualquier repo de GitHub en el peor momento posible. Para los equipos de ecommerce, un scraper roto significa cambios de precio perdidos, datos obsoletos de la competencia y huecos en los dashboards.

Muchas personas que buscan "amazon scraper github" en realidad son usuarios de negocio —operaciones de ecommerce, marketers, investigadores de FBA— que probaron soluciones con código porque no encontraron una opción mejor. Los datos de foros también muestran frustración real con la oficial de Amazon: acceso restrictivo, datos limitados y que muchos vendedores no pueden cumplir.

Por qué los scrapers de Amazon en GitHub necesitan mantenimiento constante

La auditoría anterior lo deja claro:

- Los repos obsoletos acumulan reportes de fallos sin correcciones

- Los repos "funcionales" hablan abiertamente de medidas anti-bot en el README

- Los hilos de la comunidad se centran cada vez más en fingerprints TLS, bucles de CAPTCHA y calidad de proxies, no en selectores CSS

Para usuarios de negocio, esa carga de mantenimiento es el verdadero coste oculto. El repo es gratis. Tu tiempo depurándolo a las 2 de la mañana, no.

Thunderbit como alternativa práctica para Amazon Scraper

ofrece una que extrae título, precio, ASIN, valoraciones, marca, disponibilidad, origen del envío y URL original, sin escribir código.

En la práctica, eso se traduce en:

- Scraping en 2 clics frente a configurar entornos Python, dependencias y proxies

- Plantilla de Amazon instantánea: sin sobrecarga de IA, solo extracción con 1 clic

- Modo de scraping con navegador para páginas que requieren inicio de sesión (como las páginas de reseñas que frustran a los usuarios de scrapers de GitHub)

- Scraping en la nube para páginas públicas de producto a gran velocidad (50 páginas a la vez)

- Exportación gratis a Google Sheets, Airtable, Notion y Excel, no solo CSV/JSON

- Scraper programado para monitorización continua de precios

- La IA se adapta a los cambios de diseño: sin carga de mantenimiento para ti

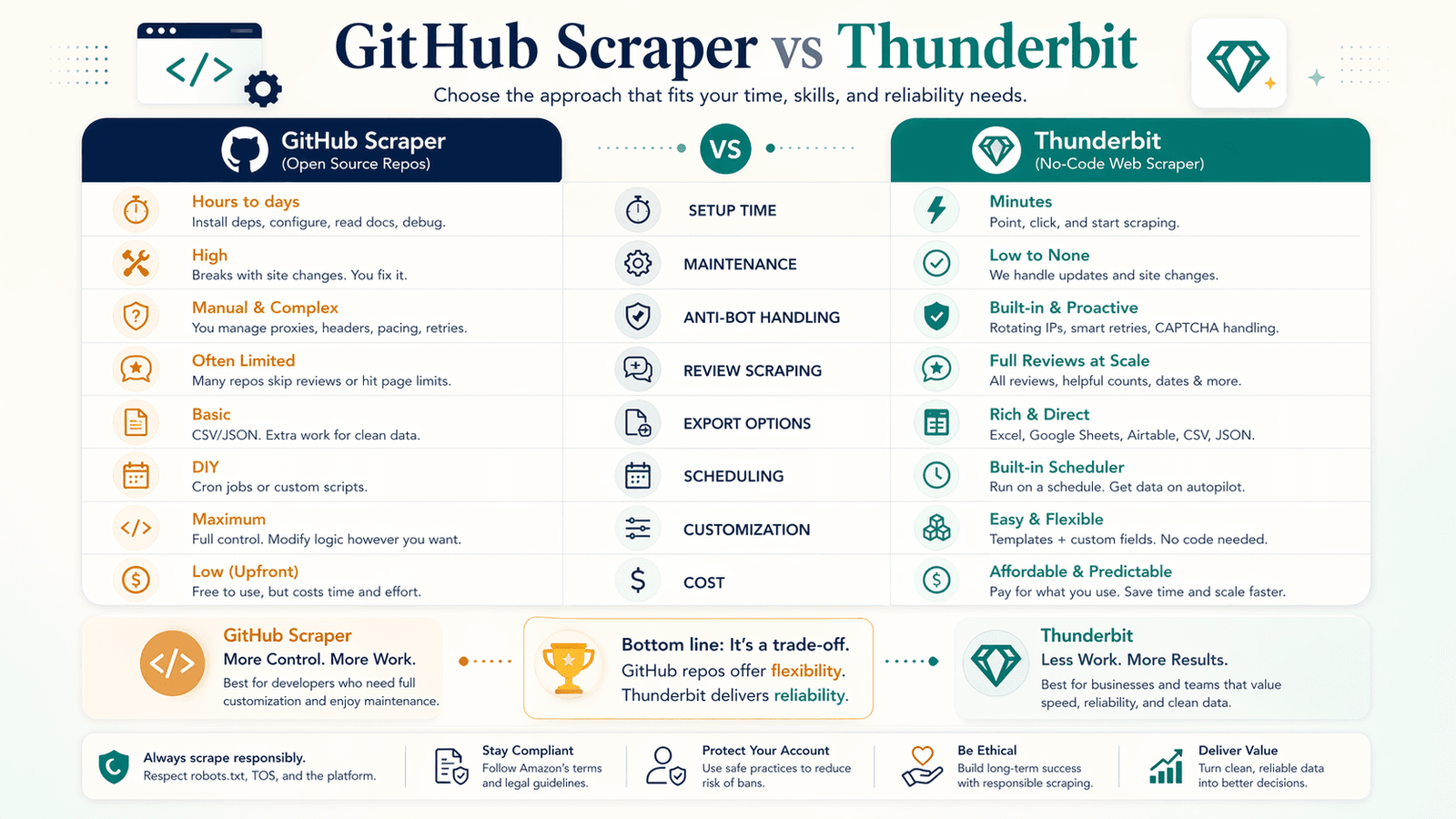

Amazon Scraper en GitHub vs. Thunderbit: comparación honesta

| Factor | Scraper de GitHub (p. ej., AmzPy) | Thunderbit |

|---|---|---|

| Tiempo de configuración | 15–60 min (Python, dependencias, proxies) | ~2 min (instalar extensión de Chrome) |

| Mantenimiento | Tú corriges las roturas | La IA se adapta a los cambios de diseño |

| Gestión anti-bot | DIY (proxies, cabeceras, TLS) | Integrada (modos nube + navegador) |

| Scraping de reseñas (con sesión iniciada) | Gestión compleja de sesiones | Modo de scraping con navegador |

| Exportación de datos | Solo CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Programación | DIY (cron, Airflow, etc.) | Scraper programado integrado |

| Personalización | Más alta | Más baja |

| Coste | Gratis (más coste de proxies) | Hay plan gratuito; basado en créditos |

La compensación honesta: los repos de GitHub ofrecen más personalización; Thunderbit ofrece más fiabilidad. Si a tu equipo le importa más el uptime que la flexibilidad, la vía no-code suele ser la opción más racional.

Mejores prácticas para scraping programado y recurrente de Amazon

La mayoría de los proyectos de amazon scraper github están pensados para ejecuciones puntuales, pero los casos reales de negocio —monitorización de precios, seguimiento de inventario, análisis de competidores— requieren scraping recurrente. Los repos de GitHub casi nunca incluyen programación de forma nativa, así que los usuarios terminan uniendo cron jobs, Airflow o flujos de trabajo en n8n.

Programación DIY para scrapers de Amazon en GitHub

La configuración mínima viable para ejecuciones recurrentes:

- Cron job en Linux o macOS para ejecutar el script según un horario

- Logs de solo append para poder depurar fallos después

- Desduplicación por ASIN + marca temporal para no almacenar datos duplicados

- Alertas de fallo (aunque sea un correo simple en caso de salida no cero) para saber cuándo una ejecución se rompe a las 3 de la mañana

Para equipos más complejos:

- n8n para automatización ligera de flujos de trabajo (se menciona con frecuencia en hilos de la comunidad)

- Airflow para pipelines programados más pesados

- Estado respaldado por base de datos si necesitas diferencias e histórico

La práctica clave no es el programador en sí, sino la gestión del estado. Haz seguimiento de la última ejecución correcta, el último conjunto de ASIN, los precios cambiados y las URL fallidas.

Programar se simplifica con Thunderbit

El de Thunderbit te permite describir el intervalo en lenguaje natural, introducir URLs y hacer clic en "Schedule". La IA convierte el lenguaje natural en una programación cron, sin configuración técnica. Para equipos de ecommerce no técnicos que monitorizan precios o lanzamientos de productos de la competencia, eso reduce de forma notable la fricción operativa.

Mejores prácticas para scrapes recurrentes de Amazon

Estas aplican uses la herramienta que uses:

- Desduplica por ASIN + ventana temporal: no guardes el mismo producto dos veces en cada ejecución

- Guarda los precios como números, no como cadenas brutas: te ahorrará limpieza después

- Añade marcas temporales de scraping a cada fila: las necesitarás para el análisis de tendencias

- Registra deltas, no solo el estado actual: "el precio bajó un 12% desde la semana pasada" es más útil que "el precio es 24,99 USD"

- Alerta solo sobre cambios significativos: que un competidor baje el precio un 15% merece notificación; una fluctuación del 0,5% es ruido

- Piensa en el almacenamiento: los archivos planos sirven para ejecuciones pequeñas; para 5.000+ ASIN diarios, considera una base de datos o una hoja en la nube

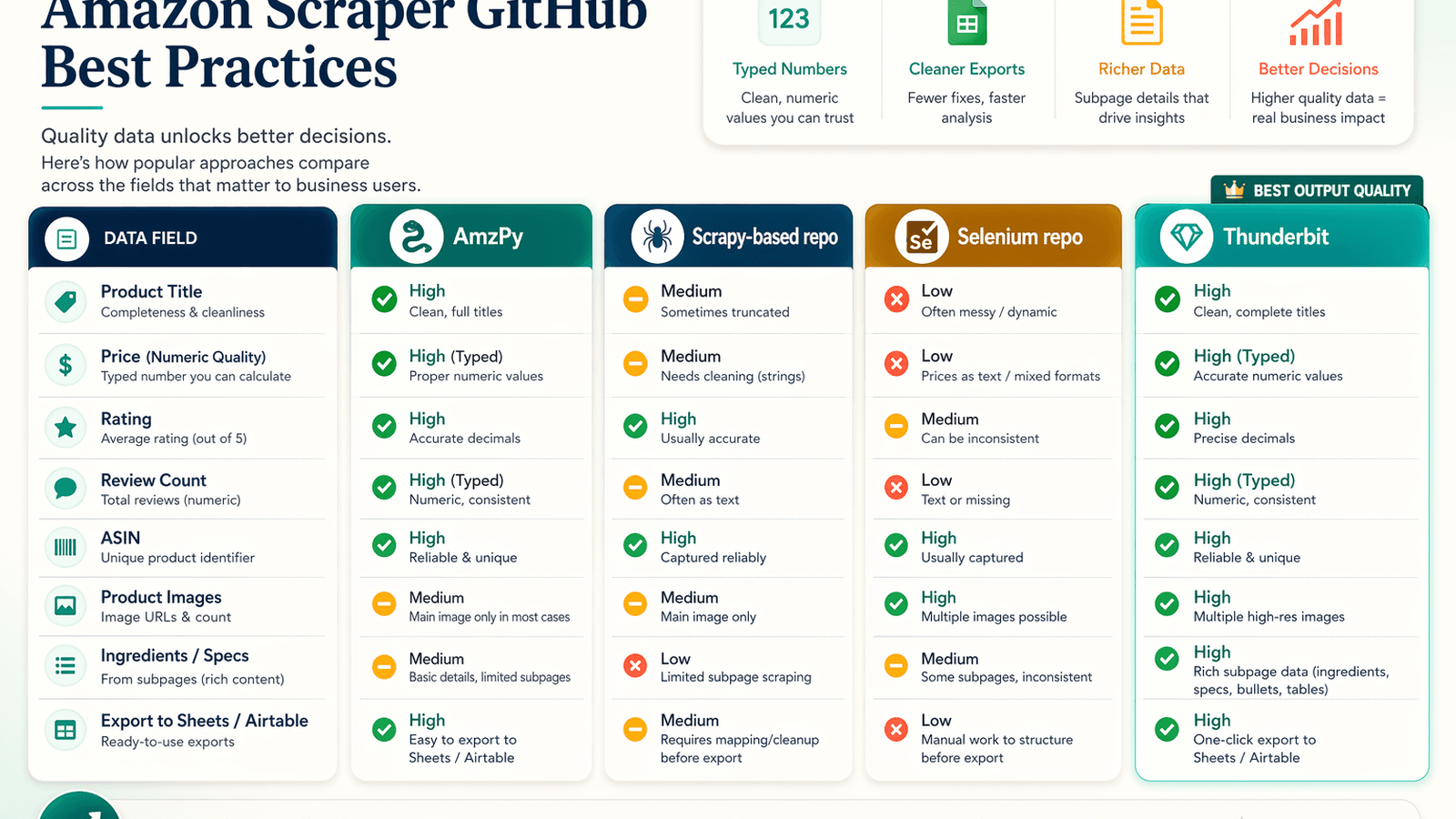

Calidad de salida lado a lado: qué devuelve realmente cada enfoque de Amazon Scraper en GitHub

Nadie compara la calidad real de salida entre repos de amazon scraper github. A los usuarios les importa muchísimo la calidad de los datos —"qué herramienta da la información más limpia y completa"—, pero tienen que clonar y probar cada repo por su cuenta. Esta sección cubre ese vacío.

Qué extraen realmente los repos populares de GitHub y qué se dejan por el camino

Basado en muestras del README, ejemplos públicos y formatos de salida documentados:

| Enfoque | Qué extrae claramente | Huecos / concesiones habituales |

|---|---|---|

| amzpy | Título, precio, moneda, URL de imagen, valoraciones, reseñas, variantes, ASIN | Orientado a páginas de producto; menos riqueza en reseñas completas y secciones de especificaciones |

| tducret/amazon-scraper-python | CSV con título, valoración, número de reseñas, URL del producto, URL de imagen, ASIN | Obsoleto, centrado en listings, historia anti-bot débil |

| python-scrapy-playbook scraper | Resultados de búsqueda, páginas de producto, reseñas, pipelines CSV/JSON | Nivel tutorial; depende de middleware de proxy externo; probablemente requiera más limpieza |

| omkarcloud/amazon-scraper | Búsqueda, categoría, detalles, mejores reseñas, muchas imágenes/vídeos/especificaciones | No es un scraper en bruto: es un servicio API gestionado |

| Plantilla Amazon de Thunderbit | Título, precio, ASIN, marca, valoración, reseñas, disponibilidad, origen del envío, enriquecimiento de subpáginas | Menos control a nivel de código que los scripts personalizados |

Tabla comparativa de calidad de salida

| Campo de datos | AmzPy | Repo basado en Scrapy | Repo con Selenium | Thunderbit |

|---|---|---|---|---|

| Título del producto | ✅ | ✅ | ✅ | ✅ |

| Precio (numérico) | ⚠️ cadena | ✅ | ⚠️ cadena | ✅ (tipo numérico) |

| Valoración | ✅ | ✅ | ✅ | ✅ |

| Número de reseñas | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Imágenes del producto | ❌ | ⚠️ solo miniatura | ✅ | ✅ (alta resolución, exportable) |

| Ingredientes/especificaciones | ❌ | ❌ | ❌ | ✅ (mediante scraping de subpáginas + IA) |

| Exportación a Sheets/Airtable | ❌ | ❌ | ❌ | ✅ gratis |

Por qué el formato de los datos importa para los usuarios de negocio

Los datos desordenados generan trabajo oculto. Incluso un scraper que funciona puede ser un fracaso operativo si:

- Los precios son cadenas con símbolos de moneda en vez de números limpios

- Los valores ausentes son incoherentes (cadena vacía vs. null vs. "N/A")

- Las imágenes son solo miniaturas de baja resolución

- Los campos de reseñas o especificaciones necesitan posprocesamiento antes del análisis

Para los equipos de operaciones de ecommerce, los datos limpios influyen directamente en la velocidad de análisis y en la toma de decisiones. La IA de Thunderbit formatea los datos por tipo —números como números, fechas como fechas, URLs como URLs— para que estén listos para usar de inmediato. Los repos de GitHub varían muchísimo en este punto, y el tiempo de limpieza se acumula rápido.

Resumen rápido: checklist de mejores prácticas para Amazon Scraper en GitHub

- Comprueba la fecha del último commit antes de clonar. Más de seis meses es una señal de alarma clara en Amazon.

- Busca issues con "captcha", "503", "blocked" y "not working" antes de configurar nada.

- Prefiere

curl_cffiu otro cliente HTTP que imite navegador frente arequestspuro. - Mantén coherentes cabeceras, perfil TLS, idioma y geografía del proxy: nada de contradicciones.

- Usa sesiones sticky para flujos de navegación; no rote cada solicitud sin pensar.

- Añade ritmo aleatorio y backoff exponencial.

- Trata los CAPTCHAs repetidos como una sesión quemada, no como un acertijo a fuerza bruta.

- Usa navegadores sin interfaz solo cuando los clientes HTTP no puedan reproducir la página de forma fiable.

- Guarda puntos de control y estado para que las ejecuciones fallidas puedan reanudarse con seguridad.

- Ten un plan B: ya sea una API gestionada o una herramienta no-code como .

Consideraciones legales y éticas para el scraping de Amazon en 2026

Unas cuantas cosas que conviene saber, brevemente.

La postura de Amazon es restrictiva y cada vez más. Las señales más claras:

- Las páginas de ayuda propias de Amazon ahora devuelven una página que dice: "To discuss automated access to Amazon data please contact api-services-support@amazon.com."

- El de Amazon desautoriza una amplia gama de rutas dinámicas, de reseñas, perfiles, listas de deseos y listados de ofertas.

- La se opone explícitamente al acceso encubierto o disfrazado de agentes, a la elusión de medidas de seguridad y a que un agente se identifique erróneamente como Google Chrome. Amazon también sobre el incidente.

- Amazon contra crawlers de OpenAI a finales de 2025.

El riesgo práctico es claramente mayor cuando pasas de páginas públicas de producto a flujos autenticados, automatización disfrazada o extracción comercial de alto volumen. Esto no es asesoramiento legal: consulta a tu equipo jurídico para tu caso concreto.

Conclusiones clave: cómo obtener datos fiables de Amazon sin que te bloqueen

En orden de importancia:

- Audita antes de clonar. Da por hecho que la mayoría de los resultados de GitHub están obsoletos, son tutoriales o wrappers de APIs comerciales.

- Mejora primero la capa de red. El fingerprinting TLS y la coherencia de sesión importan más que los selectores HTML.

- Usa sesiones residenciales sticky, no el caos aleatorio de proxies. Rota entre sesiones, no dentro de ellas.

- Ritma las solicitudes como un usuario, no como una prueba de estrés. Los retrasos aleatorios y el backoff exponencial no son negociables.

- Resuelve CAPTCHAs aislados; abandona las sesiones con desafíos repetidos. No intentes fuerza bruta sobre un fingerprint quemado.

- Ten un plan de respaldo. Amazon cambiará algo a mitad de semana y tu scraper de GitHub se romperá. Una herramienta no-code mantenida como o una API gestionada pueden mantener viva tu canalización de datos mientras depuras.

- Prioriza la calidad de salida. Los datos limpios y tipados ahorran más tiempo aguas abajo que un scraper rápido pero desordenado.

Si prefieres fiabilidad antes que personalización, Thunderbit ofrece una alternativa mantenida: revisa la o mira tutoriales en el . Los desarrolladores que quieran control total pueden usar repos de GitHub sin problema, pero solo con las prácticas anti-bloqueo y de mantenimiento que cubre esta guía.

Preguntas frecuentes

¿Es legal extraer datos de productos de Amazon con un scraper de GitHub?

Los Términos de servicio de Amazon restringen la recopilación automatizada de datos, y Amazon ha hecho cumplir esto activamente mediante cartas de cese y desistimiento y contramedidas técnicas, especialmente en 2025-2026. Extraer datos públicos de producto entra en una zona gris; hacerlo detrás de un login o disfrazar tu bot como un navegador real implica un riesgo mayor. Esto no es asesoramiento legal: consulta a tu equipo jurídico para tu caso concreto.

¿Cada cuánto fallan los repos de Amazon scraper en GitHub?

Muy a menudo. Amazon cambia los diseños de página, añade nuevas capas anti-bot y descontinúa endpoints con regularidad. En la auditoría de este artículo, solo unos 3 de los 8 repos más visibles parecían claramente funcionales en 2026. Incluso los repos "funcionando" suelen tener issues abiertos sobre CAPTCHAs y errores 503. Prepárate para depurar o actualizar tu configuración cada pocas semanas o meses.

¿Cuál es el mejor Amazon scraper en GitHub en 2026?

No hay un único ganador: depende de tu caso de uso y de tu nivel técnico. Para un scraper ligero y directo en Python, es una de las opciones más actuales. Para una cobertura más amplia mediante una API gestionada, funciona, aunque no es realmente DIY. Aplica la lista de verificación de frescura de este artículo para evaluar cualquier repo por tu cuenta antes de comprometerte.

¿Puede Thunderbit extraer datos de Amazon sin programar?

Sí. La de Thunderbit extrae título del producto, precio, ASIN, valoraciones, marca, disponibilidad y más con un solo clic. Admite modo de scraping con navegador para páginas que requieren inicio de sesión, scraping en la nube para páginas públicas a gran velocidad, scraping programado para tareas recurrentes y exportación gratuita a Google Sheets, Airtable, Notion y Excel. Puedes empezar instalando la .

¿Cómo evito que baneen mi IP al hacer scraping de Amazon?

Usa un enfoque por capas: (1) cambia de requests puro a un cliente que imite TLS como curl_cffi, (2) usa proxies residenciales con sesiones sticky en lugar de rotación aleatoria de datacenter, (3) añade ritmo aleatorio y backoff exponencial, (4) mantén coherentes todas tus cabeceras con el perfil de navegador y la región del marketplace, y (5) trata los CAPTCHAs repetidos como una señal para retirar la sesión, no como un problema que resolver indefinidamente. Para más detalle, consulta la matriz de decisión anti-bloqueo anterior en este artículo.