Αν έχεις προσπαθήσει ποτέ να στήσεις μια στοχευμένη λίστα πωλήσεων, να εντοπίσεις νέες αγορές ή να συγκρίνεις ανταγωνιστές, ξέρεις πολύ καλά πόσο πολύτιμο είναι το Google Maps. Και το πιο εντυπωσιακό είναι αυτό: με πάνω από 1,5 δισεκατομμύρια αναζητήσεις “near me” κάθε μήνα και το 76% των τοπικών χρηστών να επισκέπτεται μια επιχείρηση μέσα σε 24 ώρες (), η ανάγκη για ενημερωμένα, γεωγραφικά δεδομένα επιχειρήσεων δεν ήταν ποτέ μεγαλύτερη.

Είτε ασχολείσαι με πωλήσεις, marketing ή operations, η εξαγωγή δομημένων δεδομένων από το Google Maps μπορεί να κάνει τη διαφορά ανάμεσα σε ένα ψυχρό τηλεφώνημα και σε ένα ζεστό lead με υψηλή πιθανότητα μετατροπής.

Έχω περάσει χρόνια στο SaaS και το automation, και έχω δει από πρώτο χέρι πώς οι ομάδες αξιοποιούν Python (και πλέον AI-powered εργαλεία όπως το ) για να μετατρέψουν το Google Maps σε στρατηγικό πλεονέκτημα. Σε αυτόν τον οδηγό, θα σου δείξω ακριβώς πώς να κάνεις scraping δεδομένων από το Google Maps με Python το 2026 — βήμα βήμα, με κώδικα, συμβουλές συμμόρφωσης και σύγκριση με no-code λύσεις. Είτε είσαι προχωρημένος χρήστης Python είτε απλώς θέλεις τον πιο γρήγορο δρόμο προς αξιοποιήσιμα δεδομένα, βρίσκεσαι στο σωστό σημείο.

Τι σημαίνει να κάνεις scraping στο Google Maps με Python;

Ας ξεκινήσουμε από τα βασικά: το scraping του Google Maps με Python σημαίνει ότι εξάγεις προγραμματιστικά πληροφορίες για επιχειρήσεις — όπως ονόματα, διευθύνσεις, αξιολογήσεις, κριτικές, τηλέφωνα και συντεταγμένες — από το Google Maps, ώστε να μπορείς να τις αναλύσεις, να τις φιλτράρεις και να τις αξιοποιήσεις για επαγγελματική χρήση.

Υπάρχουν δύο βασικοί τρόποι να το κάνεις αυτό:

- Google Maps Places API: Ο επίσημος, αδειοδοτημένος τρόπος. Χρησιμοποιείς ένα API key για να στείλεις ερωτήματα στους servers της Google και να λάβεις δομημένα JSON δεδομένα. Είναι σταθερό, προβλέψιμο και ως επί το πλείστον συμβατό, αλλά έχει όρια και κόστος.

- Web scraping του HTML: Αυτοματοποιείς έναν browser (με εργαλεία όπως το Playwright ή το Selenium) για να φορτώσει το Google Maps, να εκτελέσει αναζητήσεις και να αναλύσει τη σελίδα που αποδίδεται. Είναι πιο ευέλικτο αλλά και πιο εύθραυστο — η Google αλλάζει συχνά τη δομή της σελίδας, και το scraping του HTML μπορεί να παραβιάζει τους όρους χρήσης της.

Τυπικά πεδία δεδομένων που μπορείς να εξαγάγεις:

- Όνομα επιχείρησης

- Κατηγορία/τύπος

- Πλήρης διεύθυνση (συν πόλη, πολιτεία, ταχυδρομικός κώδικας, χώρα)

- Γεωγραφικό πλάτος και μήκος

- Τηλέφωνο

- URL ιστοσελίδας

- Αξιολόγηση και πλήθος κριτικών

- Επίπεδο τιμής

- Κατάσταση επιχείρησης (ανοιχτή/κλειστή)

- Ώρες λειτουργίας

- Place ID (μοναδικό αναγνωριστικό της Google)

- URL του Google Maps

Γιατί έχει σημασία αυτό; Επειδή αυτά τα πεδία τροφοδοτούν τα πάντα: από lead generation και σχεδιασμό περιοχών μέχρι benchmarking ανταγωνιστών και έρευνα αγοράς. Το κλειδί είναι να στοχεύεις τα σωστά δεδομένα για τους επιχειρηματικούς σου στόχους — όχι να κάνεις scraping στα τυφλά.

Γιατί οι ομάδες πωλήσεων και marketing εξάγουν δεδομένα από το Google Maps με Python

Ας το κάνουμε πρακτικό. Γιατί τόσες ομάδες πωλήσεων και marketing έχουν εμμονή με τα δεδομένα του Google Maps το 2026;

- Lead Generation: Δημιούργησε υπερστοχευμένες λίστες τοπικών επιχειρήσεων, με στοιχεία επικοινωνίας και αξιολογήσεις, για καμπάνιες προσέγγισης.

- Σχεδιασμός περιοχών: Χαρτογράφησε περιοχές πωλήσεων, ζώνες παράδοσης ή service areas με βάση την πραγματική πυκνότητα και τον τύπο των επιχειρήσεων.

- Παρακολούθηση ανταγωνιστών: Παρακολούθησε τοποθεσίες, αξιολογήσεις και κριτικές ανταγωνιστών με την πάροδο του χρόνου για να εντοπίζεις τάσεις και ευκαιρίες.

- Έρευνα αγοράς: Ανάλυσε κατηγορίες επιχειρήσεων, ώρες λειτουργίας και το συναίσθημα των κριτικών για να στηρίξεις τις go-to-market στρατηγικές.

- Επιλογή τοποθεσίας: Για real estate και λιανικό εμπόριο, αξιολόγησε πιθανές τοποθεσίες με βάση τις κοντινές παροχές, την κίνηση και τον ανταγωνισμό.

Πραγματικός αντίκτυπος: Σύμφωνα με την , το 92% των ομάδων πωλήσεων σχεδιάζει να αυξήσει τις επενδύσεις σε AI/data, ενώ οι ομάδες που αξιοποιούν στοχευμένα, τοπικά δεδομένα βλέπουν ποσοστά μετατροπής έως και 8× υψηλότερα από όσους βασίζονται σε γενικές cold λίστες (). Μια μελέτη για franchise lead gen έδειξε 15 δολάρια νέου revenue για κάθε 1 δολάριο που ξοδεύεται σε λίστες leads βασισμένες στο Google Maps.

Συσχέτιση επιχειρηματικών στόχων με πεδία του Google Maps:

| Επιχειρηματικός στόχος | Απαραίτητα πεδία από το Google Maps |

|---|---|

| Λίστα τοπικών leads | όνομα, διεύθυνση, τηλέφωνο, ιστοσελίδα, κατηγορία |

| Σχεδιασμός περιοχών | όνομα, lat/lng, business_status, opening_hours |

| Benchmarking ανταγωνιστών | όνομα, rating, userRatingCount, priceLevel, reviews |

| Επιλογή τοποθεσίας | κατηγορία, lat/lng, πυκνότητα κριτικών, openingDate |

| Στοιχεία sentiment/menu | reviews, editorialSummary, photos, types |

| Προσέγγιση μέσω email/τηλεφώνου | nationalPhoneNumber, websiteUri (και μετά enrichment αν χρειάζεται) |

Ρύθμιση του Python Google Maps scraper: εργαλεία και προϋποθέσεις

Πριν ξεκινήσεις το scraping, πρέπει να στήσεις το Python περιβάλλον σου και να συγκεντρώσεις τα σωστά εργαλεία. Αυτό χρειάζεσαι το 2026:

1. Εγκατάσταση Python και απαραίτητων βιβλιοθηκών

Προτεινόμενη έκδοση Python: 3.10 ή νεότερη.

Εγκατάσταση βασικών βιβλιοθηκών:

1pip install \

2 requests==2.33.1 httpx==0.28.1 \

3 beautifulsoup4==4.14.3 lxml==6.0.3 \

4 pandas==2.3.3 \

5 selenium==4.43.0 playwright==1.58.0 \

6 googlemaps==4.10.0 google-maps-places==0.8.0 \

7 schedule==1.2.2 APScheduler==3.11.2 \

8 python-dotenv==1.2.2 tenacity==9.1.4

9playwright install chromiumΤι κάνει το καθένα:

requests,httpx: HTTP requests (κλήσεις API)beautifulsoup4,lxml: Ανάλυση HTML (για web scraping)pandas: Καθαρισμός, ανάλυση και εξαγωγή δεδομένωνselenium,playwright: Αυτοματισμός browser (για HTML scraping)googlemaps,google-maps-places: Clients για το Google Maps APIschedule,APScheduler: Προγραμματισμός εργασιώνpython-dotenv: Φόρτωση API keys με ασφάλεια από.envαρχείαtenacity: Λογική επαναπροσπάθειας για χειρισμό σφαλμάτων

2. Απόκτησε ένα Google Maps API Key (για scraping μέσω API)

- Πήγαινε στο .

- Δημιούργησε ή επίλεξε ένα project.

- Ενεργοποίησε το billing (απαιτείται, ακόμα και για χρήση free tier).

- Ενεργοποίησε το “Places API (New)” στο APIs & Services > Library.

- Πήγαινε στο Credentials > Create Credentials > API Key.

- Περίρισε το κλειδί σου σε συγκεκριμένα APIs και IPs για λόγους ασφάλειας.

- Αποθήκευσε το API key σου σε

.envαρχείο (ποτέ μην το ανεβάζεις στον κώδικα):

1GOOGLE_MAPS_API_KEY=your_actual_api_key_hereΣημείωση: Από τον Μάρτιο του 2025, η Google δεν προσφέρει πλέον το γενικό free credit των 200$/μήνα. Αντί γι’ αυτό, υπάρχουν δωρεάν μηνιαία όρια ανά API tier (δες τις ).

Πώς να εξάγετε δεδομένα από το Google Maps με Python: οδηγός βήμα προς βήμα

Ας δούμε και τις δύο βασικές προσεγγίσεις — μέσω API και με HTML scraping — ώστε να διαλέξεις αυτή που ταιριάζει στις ανάγκες σου.

Προσέγγιση 1: Χρήση του Google Maps Places API (προτεινόμενο)

Βήμα 1: Εγκατάσταση και εισαγωγή των απαραίτητων βιβλιοθηκών

1import os

2import httpx

3import pandas as pd

4from dotenv import load_dotenvΒήμα 2: Φόρτωση του API key με ασφάλεια

1load_dotenv()

2API_KEY = os.environ["GOOGLE_MAPS_API_KEY"]Βήμα 3: Δημιουργία του search query

Θα χρησιμοποιήσεις το endpoint Text Search για να βρεις επιχειρήσεις που ταιριάζουν στα κριτήριά σου.

1URL = "https://places.googleapis.com/v1/places:searchText"

2FIELD_MASK = ",".join([

3 "places.id", "places.displayName", "places.formattedAddress",

4 "places.location", "places.rating", "places.userRatingCount",

5 "places.priceLevel", "places.types",

6 "places.nationalPhoneNumber", "places.websiteUri",

7 "nextPageToken",

8])Βήμα 4: Κλήση στο API

1def text_search(query, lat, lng, radius=3000, min_rating=4.0):

2 body = {

3 "textQuery": query,

4 "minRating": min_rating, # φίλτρο από την πλευρά του server

5 "includedType": "restaurant",

6 "openNow": False,

7 "pageSize": 20,

8 "locationBias": {

9 "circle": {

10 "center": {"latitude": lat, "longitude": lng},

11 "radius": radius,

12 }

13 },

14 }

15 headers = {

16 "Content-Type": "application/json",

17 "X-Goog-Api-Key": API_KEY,

18 "X-Goog-FieldMask": FIELD_MASK, # Να το ορίζεις πάντα!

19 }

20 r = httpx.post(URL, json=body, headers=headers, timeout=30)

21 r.raise_for_status()

22 return r.json()Βήμα 5: Χειρισμός pagination και συλλογή αποτελεσμάτων

1def collect_all_results(query, lat, lng, radius=3000, min_rating=4.0):

2 results = []

3 next_page_token = None

4 while True:

5 data = text_search(query, lat, lng, radius, min_rating)

6 places = data.get('places', [])

7 results.extend(places)

8 next_page_token = data.get('nextPageToken')

9 if not next_page_token:

10 break

11 return resultsΒήμα 6: Εξαγωγή δεδομένων με Pandas

1df = pd.DataFrame(collect_all_results("coffee shops in Brooklyn", 40.6782, -73.9442))

2df.to_csv("brooklyn_coffee_shops.csv", index=False)Pro tips:

- Να ορίζεις πάντα το header

X-Goog-FieldMaskγια να ελέγχεις το κόστος. Αν ζητήσεις reviews ή photos, η τιμή ανά 1.000 requests μπορεί να ανέβει από 5$ στα 25$ (). - Χρησιμοποίησε φίλτρα από την πλευρά του server (όπως

minRating,includedType,locationBias) για να μην σπαταλάς credits σε άσχετα αποτελέσματα. - Κράτα αποθηκευμένα τα

place_idγια απο-διπλοεγγραφές και μελλοντικές ενημερώσεις.

Προσέγγιση 2: Web scraping του HTML του Google Maps (για εκπαιδευτική χρήση ή μία φορά)

Προειδοποίηση: Το Google Maps είναι single-page app. Πρέπει να χρησιμοποιήσεις browser automation (Playwright ή Selenium), και το scraping του HTML μπορεί να παραβιάζει τους όρους της Google. Χρησιμοποίησέ το για έρευνα, όχι για παραγωγική χρήση.

Βήμα 1: Εγκατάσταση του Playwright και εκκίνηση browser

1from playwright.sync_api import sync_playwright

2import time, re

3def scrape_maps(query, max_results=100):

4 with sync_playwright() as pw:

5 browser = pw.chromium.launch(headless=True)

6 ctx = browser.new_context(

7 user_agent="Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

8 locale="en-US",

9 )

10 page = ctx.new_page()

11 page.goto("https://www.google.com/maps", timeout=60_000)

12 page.fill("#searchboxinput", query)

13 page.click('button[aria-label="Search"]')

14 page.wait_for_selector('div[role="feed"]')

15 feed = page.locator('div[role="feed"]')

16 prev = 0

17 while True:

18 feed.evaluate("el => el.scrollBy(0, el.scrollHeight)")

19 time.sleep(2)

20 count = page.locator('div[role="feed"] > div > div[jsaction]').count()

21 if count == prev or count >= max_results:

22 break

23 prev = count

24 if page.locator("text=You've reached the end of the list").count():

25 break

26 rows = []

27 cards = page.locator('div[role="feed"] > div > div[jsaction]')

28 for i in range(cards.count()):

29 c = cards.nth(i)

30 name = c.locator("div.fontHeadlineSmall").inner_text() if c.locator("div.fontHeadlineSmall").count() else ""

31 rating_el = c.locator('span[role="img"]').first

32 raw = rating_el.get_attribute("aria-label") if rating_el.count() else ""

33 m = re.search(r"([\d.]+)\s+stars?\s+([\d,]+)\s+Reviews", raw or "")

34 rating = float(m.group(1)) if m else None

35 reviews = int(m.group(2).replace(",", "")) if m else None

36 rows.append({"name": name, "rating": rating, "reviews": reviews})

37 browser.close()

38 return rowsΣυμβουλές:

- Η Google αλλάζει τα CSS classes κάθε λίγες εβδομάδες, οπότε αυτός ο κώδικας πιθανόν να χρειάζεται τακτικές ενημερώσεις.

- Χρησιμοποίησε καθυστερήσεις που μοιάζουν ανθρώπινες και μην κάνεις scraping πολύ γρήγορα για να μειώσεις τον κίνδυνο αποκλεισμού.

- Μην προσπαθήσεις ποτέ να παρακάμψεις CAPTCHAs ή το SearchGuard της Google — αυτό μπορεί να σε εκθέσει σε νομικό κίνδυνο.

Απόφυγε το τυφλό scraping: πώς να στοχεύεις με ακρίβεια τα δεδομένα που χρειάζεσαι

Το να κάνεις scraping τα πάντα είναι συνταγή για χαμένο χρόνο και φουσκωμένα datasets. Δες πώς να στοχεύεις μόνο τα δεδομένα που έχουν σημασία:

- Δημιούργησε στοχευμένες λίστες URL: Χρησιμοποίησε τα φίλτρα αναζήτησης του Google Maps (κατηγορία, τοποθεσία, αξιολόγηση, open now) για να περιορίσεις τα αποτελέσματα πριν το scraping.

- Χρησιμοποίησε phrase matching: Αναζήτησε ακριβείς τύπους επιχειρήσεων ή λέξεις-κλειδιά (π.χ. “vegan bakery in Austin”).

- Φίλτρα τοποθεσίας: Όρισε πόλη, γειτονιά ή ακόμη και συντεταγμένες και ακτίνα για απόλυτη ακρίβεια.

- Φιλτράρισμα από τον server (API): Χρησιμοποίησε

minRating,includedTypeκαιlocationBiasστο body του API request. - Φιλτράρισμα από τον client (Python): Μετά το scraping, χρησιμοποίησε pandas για να φιλτράρεις επιχειρήσεις με βαθμολογία πάνω από 4.0, περισσότερες από 50 κριτικές ή συγκεκριμένες κατηγορίες.

Παράδειγμα: Φίλτρο μόνο για εστιατόρια στο Μανχάταν με βαθμολογία πάνω από 4.0

1df = pd.DataFrame(results)

2filtered = df[(df['rating'] >= 4.0) & (df['types'].apply(lambda x: 'restaurant' in x))]

3filtered.to_csv("manhattan_top_restaurants.csv", index=False)Χρήση Python βιβλιοθηκών για οργάνωση και εξαγωγή δεδομένων από το Google Maps

Μόλις κάνεις scraping τα δεδομένα σου, είναι ώρα να τα καθαρίσεις, να τα αναλύσεις και να τα εξάγεις για την ομάδα σου.

Καθαρισμός και δομή δεδομένων με Pandas

1import pandas as pd

2df = pd.read_json("brooklyn_restaurants.json")

3df = (

4 df.dropna(subset=["name", "address"])

5 .drop_duplicates(subset=["place_id"])

6 .assign(

7 name=lambda d: d["name"].str.strip(),

8 phone=lambda d: d["phone"].astype(str)

9 .str.replace(r"\D", "", regex=True)

10 .str.replace(r"^1?(\d{10})$", r"+1\1", regex=True),

11 rating=lambda d: pd.to_numeric(d["rating"], errors="coerce"),

12 user_ratings_total=lambda d: pd.to_numeric(

13 d["user_ratings_total"], errors="coerce"

14 ).fillna(0).astype("int32"),

15 )

16)Ανάλυση και σύνοψη δεδομένων

Παράδειγμα: Μέση αξιολόγηση ανά γειτονιά

1by_neighborhood = (

2 df.groupby("neighborhood", as_index=False)

3 .agg(avg_rating=("rating", "mean"),

4 n_places=("place_id", "nunique"),

5 median_reviews=("user_ratings_total", "median"))

6 .sort_values("avg_rating", ascending=False)

7)Εξαγωγή σε Excel ή CSV

1df.to_csv("brooklyn_top.csv", index=False)

2df.to_excel("brooklyn_top.xlsx", index=False, sheet_name="Top Rated")Μεγάλα datasets; Χρησιμοποίησε μορφή Parquet για μεγαλύτερη ταχύτητα και καλύτερη αποδοτικότητα χώρου:

1df.to_parquet("brooklyn_top.parquet", compression="zstd")Thunderbit: η AI-powered εναλλακτική στο Python Google Maps scraper

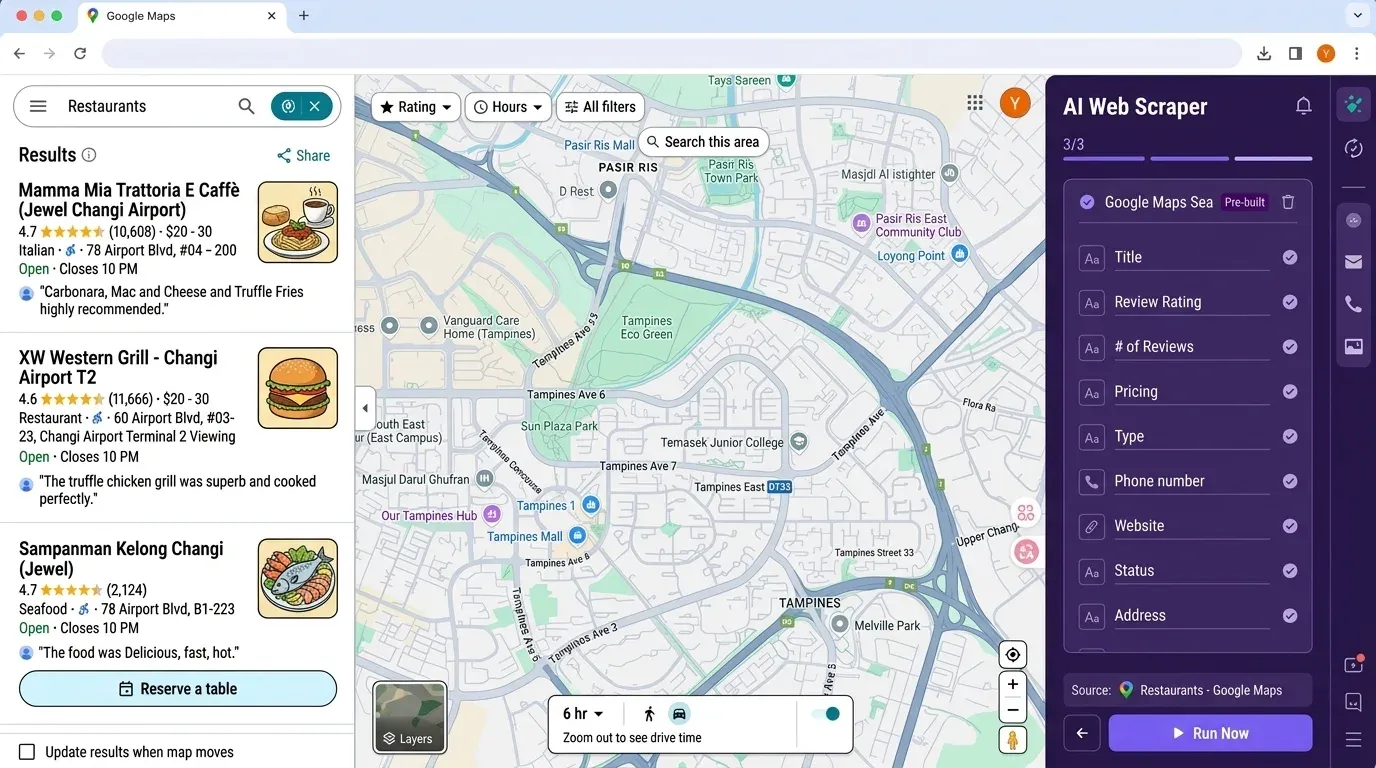

Αν σκέφτεσαι «όλο αυτό θέλει πολύ στήσιμο για μια απλή λίστα leads», δεν είσαι ο μόνος. Γι’ αυτό ακριβώς δημιουργήσαμε το — ένα AI-powered, no-code web scraper που κάνει την εξαγωγή δεδομένων από το Google Maps (και πολύ περισσότερα) τόσο εύκολη όσο μερικά κλικ.

Γιατί Thunderbit;

- Δεν χρειάζεται κώδικας ούτε API keys: Άνοιξε απλώς το , πήγαινε στο Google Maps και κάνε κλικ στο “AI Suggest Fields.”

- AI ανίχνευση πεδίων: Το AI του Thunderbit διαβάζει τη σελίδα και προτείνει τις σωστές στήλες — όνομα, διεύθυνση, αξιολόγηση, τηλέφωνο, ιστοσελίδα και άλλα.

- Scraping υποσελίδων: Θέλεις να εμπλουτίσεις τον πίνακά σου με δεδομένα από την ιστοσελίδα κάθε επιχείρησης; Το Thunderbit μπορεί να επισκεφθεί κάθε υποσελίδα και να τραβήξει επιπλέον πληροφορίες αυτόματα.

- Εξαγωγή σε Excel, Google Sheets, Airtable ή Notion: Τέλος στο μπλέξιμο με pandas — απλώς πάτησε “Export” και τα δεδομένα σου είναι έτοιμα για την ομάδα.

- Προγραμματισμένο scraping: Ρύθμισε επαναλαμβανόμενες εργασίες για να παρακολουθείς ανταγωνιστές ή να ανανεώνεις τη λίστα leads αυτόματα.

- Μηδενική συντήρηση: Το AI του Thunderbit προσαρμόζεται στις αλλαγές της σελίδας, άρα δεν χρειάζεται να διορθώνεις συνεχώς χαλασμένα scripts.

Thunderbit vs ροή εργασίας με Python:

| Βήμα | Python Scraper | Thunderbit |

|---|---|---|

| Εγκατάσταση εργαλείων | 30–60 λεπτά (Python, pip, βιβλιοθήκες) | 2 λεπτά (Chrome Extension) |

| Ρύθμιση API key | 10–30 λεπτά (Cloud Console) | Δεν χρειάζεται |

| Επιλογή πεδίων | Χειροκίνητος κώδικας, field masks | AI Suggest Fields (1 κλικ) |

| Εξαγωγή δεδομένων | Γράφεις/τρέχεις scripts, χειρίζεσαι σφάλματα | Πάτα “Scrape” |

| Εξαγωγή | pandas σε CSV/Excel | Export σε Excel/Sheets/Notion |

| Συντήρηση | Χειροκίνητες ενημερώσεις όταν αλλάζει η σελίδα | AI αυτόματη προσαρμογή |

Bonus: Το Thunderbit το εμπιστεύονται πάνω από , και το δωρεάν πλάνο επιτρέπει scraping έως 6 σελίδων (ή 10 με trial boost) χωρίς κόστος.

Συμμόρφωση: Όροι χρήσης του Google Maps και δεοντολογία στο scraping

Εδώ είναι που τα περισσότερα Python tutorials γίνονται επικίνδυνα ξεπερασμένα. Να τι πρέπει να ξέρεις το 2026:

- Το Google Maps Platform ToS §3.2.3 απαγορεύει αυστηρά το scraping, το caching ή την εξαγωγή δεδομένων εκτός των επίσημων APIs (). Η μόνη εξαίρεση: οι τιμές latitude/longitude μπορούν να αποθηκευτούν για έως 30 ημέρες· τα Place IDs μπορούν να διατηρηθούν επ’ αόριστον.

- Οι χρήστες του API δεσμεύονται συμβατικά: Αν χρησιμοποιείς API key, έχεις αποδεχτεί τους όρους της Google — ακόμη κι αν κάνεις scraping μόνο δημόσια διαθέσιμα δεδομένα.

- Η παράκαμψη τεχνικών εμποδίων (CAPTCHAs, SearchGuard) μπορεί πλέον να συνιστά πιθανή παραβίαση του DMCA §1201, με ενδεχόμενες ποινικές συνέπειες ().

- GDPR και νόμοι περί ιδιωτικότητας: Αν συλλέγεις προσωπικά δεδομένα (emails, τηλέφωνα, ονόματα χρηστών κριτικών) από το Google Maps, χρειάζεσαι νόμιμη βάση και πρέπει να σέβεσαι αιτήματα διαγραφής. Η γαλλική CNIL επέβαλε πρόστιμο €200.000 στην KASPR το 2024 για scraping επαφών από το LinkedIn ().

- Καλές πρακτικές:

- Προτίμησε το Places API όπου είναι δυνατό.

- Βάλε όρια ρυθμού στα requests (≤10 QPS για API, 1–2 req/s για HTML scraping).

- Μην παρακάμπτεις ποτέ CAPTCHAs ή τεχνικά μπλοκαρίσματα.

- Μην αναδιανέμεις προσωπικά δεδομένα που έχεις κάνει scraping.

- Σεβάσου αιτήματα opt-out και διαγραφής.

- Έλεγχε πάντα τους τοπικούς νόμους — GDPR, CCPA και άλλοι εφαρμόζονται ενεργά.

Συμπέρασμα: Αν σε απασχολεί η συμμόρφωση, μείνε στο API και μάζευε το ελάχιστο δυνατό δεδομένων. Για τους περισσότερους business users, ένα no-code εργαλείο όπως το Thunderbit μειώνει σημαντικά το ρίσκο (χωρίς API key, χωρίς αναδιανομή).

Προγραμματισμός και αυτοματοποίηση του scraping στο Google Maps με Python

Αν χρειάζεσαι συνεχώς ενημερωμένα δεδομένα — για παράδειγμα για εβδομαδιαία παρακολούθηση ανταγωνιστών ή μηνιαίες ανανεώσεις λιστών leads — η αυτοματοποίηση είναι σύμμαχός σου.

Απλός προγραμματισμός με schedule

1import schedule, time

2from my_scraper import run_job

3schedule.every().day.at("03:00").do(run_job, query="restaurants in Brooklyn")

4schedule.every(6).hours.do(run_job, query="coffee shops in Manhattan")

5while True:

6 schedule.run_pending()

7 time.sleep(30)Προγραμματισμός για production με APScheduler

1from apscheduler.schedulers.background import BackgroundScheduler

2from apscheduler.triggers.cron import CronTrigger

3sched = BackgroundScheduler(timezone="America/New_York")

4sched.add_job(

5 run_job,

6 CronTrigger(hour=3, minute=15, jitter=600), # 3:15 π.μ. ± 10 λεπτά

7 kwargs={"query": "restaurants in Brooklyn"},

8 id="brooklyn_daily",

9 max_instances=1,

10 coalesce=True,

11 misfire_grace_time=3600,

12)

13sched.start()Συμβουλές για ασφαλή αυτοματοποίηση

- Πρόσθεσε τυχαίο jitter στο πρόγραμμα για να αποφύγεις προβλέψιμα μοτίβα.

- Για HTML scraping, μην ξεπερνάς ποτέ 1–2 requests το δευτερόλεπτο.

- Για χρήση API, παρακολούθησε το quota σου και βάλε billing alerts.

- Κατέγραφε πάντα τα σφάλματα και κράτα ένα “dead-letter” αρχείο για αποτυχημένα requests.

Thunderbit bonus: Με το Thunderbit, μπορείς να προγραμματίσεις επαναλαμβανόμενα scrapes απευθείας από το UI — χωρίς κώδικα, χωρίς cron jobs, χωρίς ρύθμιση server.

Βασικά συμπεράσματα: αποδοτική, στοχευμένη και συμβατή εξαγωγή δεδομένων από το Google Maps

Ας κάνουμε μια γρήγορη ανακεφαλαίωση:

- Το Google Maps είναι η #1 πηγή δεδομένων για τοποθεσίες επιχειρήσεων, καλύπτοντας τα πάντα από lead gen μέχρι έρευνα αγοράς.

- Το scraping με Python προσφέρει ευελιξία και έλεγχο, αλλά φέρνει μαζί του setup, συντήρηση και ζητήματα συμμόρφωσης — ειδικά καθώς εντείνονται τα anti-bot μέτρα της Google και η νομική εφαρμογή.

- Η εξαγωγή μέσω API είναι η πιο ασφαλής και πιο κλιμακώσιμη λύση για τις περισσότερες ομάδες. Χρησιμοποίησε πάντα field masks και server-side φίλτρα για να ελέγχεις το κόστος.

- Το HTML scraping είναι εύθραυστο και ριψοκίνδυνο — χρησιμοποίησέ το μόνο για μία φορά ή για έρευνα, και ποτέ μην παρακάμπτεις τεχνικά εμπόδια.

- Στόχευσε τα δεδομένα σου: Χρησιμοποίησε phrase matching, φίλτρα τοποθεσίας και ροές εργασίας με pandas για να εξάγεις μόνο ό,τι χρειάζεσαι.

- Το Thunderbit είναι η ταχύτερη λύση για μη προγραμματιστές: AI-powered, χωρίς setup, άμεση εξαγωγή και ενσωματωμένος προγραμματισμός.

- Η συμμόρφωση μετράει: Σεβάσου τους όρους της Google, τους νόμους περί ιδιωτικότητας και τα όρια ρυθμού για να αποφύγεις νομικούς πονοκεφάλους.

Για περισσότερα tutorials και συμβουλές, δες το και το .

Συχνές ερωτήσεις

1. Είναι νόμιμο να κάνω scraping δεδομένων από το Google Maps με Python το 2026;

Το scraping του Google Maps μέσω του επίσημου API επιτρέπεται εντός των όρων της Google, αρκεί να σέβεσαι τα quotas και να μην αναδιανέμεις περιορισμένα δεδομένα. Το HTML scraping του Google Maps απαγορεύεται ρητά από τους όρους χρήσης της Google και ενέχει νομικό ρίσκο, ειδικά αν παρακάμπτεις τεχνικά εμπόδια ή συλλέγεις προσωπικά δεδομένα χωρίς συναίνεση. Πάντα να ελέγχεις την τοπική νομοθεσία (GDPR, CCPA κ.λπ.) και να ακολουθείς τις βέλτιστες πρακτικές συμμόρφωσης.

2. Ποια είναι η διαφορά ανάμεσα στο Google Maps API και στο web scraping του HTML;

Το API είναι σταθερό, αδειοδοτημένο και σχεδιασμένο για εξαγωγή δεδομένων, αλλά απαιτεί API key και υπόκειται σε quotas και κόστος. Το HTML scraping χρησιμοποιεί browser automation για να εξάγει δεδομένα από τη σελίδα που αποδίδεται, αλλά είναι εύθραυστο (η δομή αλλάζει συχνά), μπορεί να παραβιάζει τους όρους και είναι πιο ριψοκίνδυνο νομικά. Για τις περισσότερες επιχειρηματικές χρήσεις, το API είναι η προτεινόμενη λύση.

3. Πόσο κοστίζει η εξαγωγή δεδομένων από το Google Maps με Python το 2026;

Η τιμολόγηση του Places API της Google γίνεται ανά 1.000 requests και κυμαίνεται από 5$ (Essentials) έως 25$ (Enterprise+Atmosphere), ανάλογα με τα πεδία που ζητάς. Υπάρχουν δωρεάν μηνιαία όρια (10.000 για Essentials, 5.000 για Pro, 1.000 για Enterprise), αλλά η μεγάλης κλίμακας εξαγωγή δεδομένων μπορεί να αυξήσει το κόστος γρήγορα. Χρησιμοποίησε πάντα field masks και server-side φίλτρα για να κρατάς το κόστος υπό έλεγχο.

4. Πώς συγκρίνεται το Thunderbit με τα Python-based Google Maps scrapers;

Το Thunderbit είναι ένα no-code, AI-powered web scraper που σου επιτρέπει να εξάγεις δεδομένα από το Google Maps (και πολλά ακόμη) χωρίς προγραμματισμό, API keys ή συντήρηση. Είναι ιδανικό για ομάδες πωλήσεων και marketing που θέλουν γρήγορες, αξιόπιστες εξαγωγές σε Excel, Google Sheets, Airtable ή Notion. Για τεχνικούς χρήστες που χρειάζονται custom λογική, η Python δίνει περισσότερη ευελιξία, αλλά απαιτεί περισσότερο setup και διαχείριση συμμόρφωσης.

5. Πώς μπορώ να αυτοματοποιήσω επαναλαμβανόμενη εξαγωγή δεδομένων από το Google Maps;

Με Python, χρησιμοποίησε βιβλιοθήκες προγραμματισμού όπως το schedule ή το APScheduler για να τρέχεις τον scraper σε καθορισμένα διαστήματα (καθημερινά, εβδομαδιαία κ.λπ.). Πρόσθεσε τυχαίο jitter για να αποφύγεις τον εντοπισμό και παρακολούθησε το API quota σου. Με το Thunderbit, μπορείς να προγραμματίσεις επαναλαμβανόμενα scrapes απευθείας από το UI — χωρίς κώδικα ή ρύθμιση server.

Έτοιμος να μετατρέψεις το Google Maps στο μυστικό σου όπλο για πωλήσεις και marketing; Είτε λατρεύεις την Python είτε θέλεις την πιο γρήγορη no-code λύση, τα εργαλεία υπάρχουν ήδη το 2026. Δοκίμασε το για άμεσο, AI-powered scraping — ή σήκωσε μανίκια και βούτηξε στο API. Όπως και να το κάνεις, εύχομαι οι λίστες leads σου να είναι πάντα φρέσκες, οι εξαγωγές σου καθαρές και οι καμπάνιες σου γεμάτες από τοπικούς υποψήφιους πελάτες με υψηλή πιθανότητα μετατροπής. Καλή επιτυχία στο scraping!

Μάθε περισσότερα