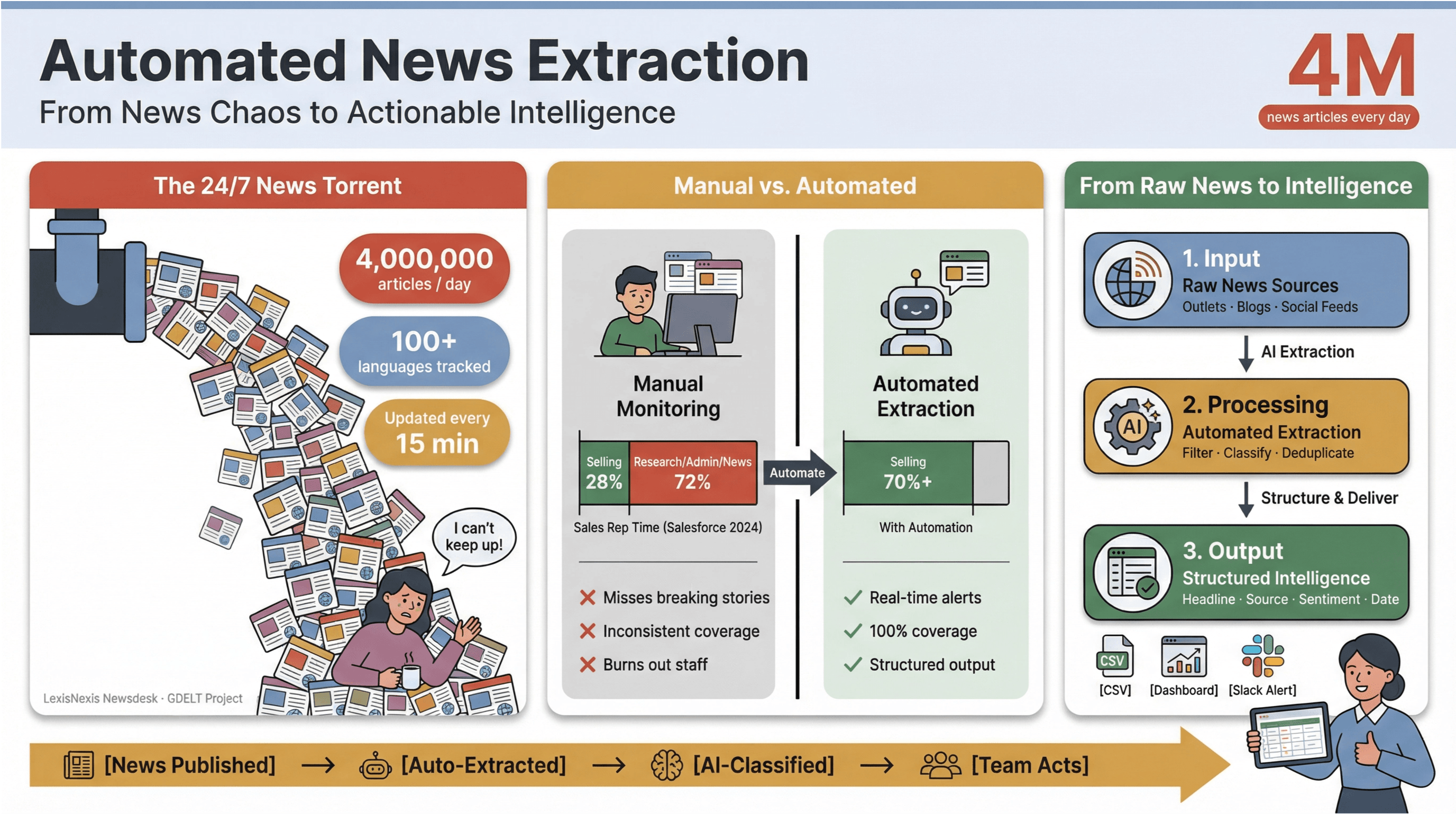

Ο ρυθμός των ψηφιακών ειδήσεων σήμερα είναι κυριολεκτικά τρελός. Κάθε λεπτό ανεβαίνουν, ανανεώνονται ή «διορθώνονται» διακριτικά χιλιάδες τίτλοι—σε μεγάλα media, εξειδικευμένα blogs και social. Για να το βάλουμε σε μέτρο, το «καταπίνει» πάνω από 4 εκατομμύρια άρθρα τη μέρα, ενώ το παρακολουθεί ειδήσεις σε 100+ γλώσσες και ανανεώνει το παγκόσμιο feed του κάθε 15 λεπτά. Αν δουλεύεις σε media, έρευνα ή business intelligence, το να προσπαθείς να τα προλάβεις όλα στο χέρι είναι σαν να προσπαθείς να αδειάσεις καράβι που μπάζει νερά… με ένα φλιτζάνι καφέ.

Το έχω δει από πρώτο χέρι: η χειροκίνητη συλλογή ειδήσεων «τρώει» ώρες και στραγγίζει τους πόρους μιας ομάδας. Οι ομάδες πωλήσεων, για παράδειγμα, περνούν λιγότερο από το ένα τρίτο της εβδομάδας τους όντως πουλώντας——και το υπόλοιπο χάνεται σε έρευνα, admin και, ναι, ατελείωτο άνοιγμα/κλείσιμο tabs με ειδήσεις. Γι’ αυτό η αυτοματοποιημένη εξαγωγή ειδήσεων έχει γίνει το «κρυφό χαρτί» των σύγχρονων ομάδων: είναι ο πιο ρεαλιστικός τρόπος να μετατρέψεις το χάος του 24/7 κύκλου ειδήσεων σε δομημένη, αξιοποιήσιμη πληροφορία—χωρίς να καίς το προσωπικό σου ή να σου ξεφεύγουν οι ιστορίες που όντως μετράνε.

Πάμε να δούμε τι σημαίνει στην πράξη η αυτοματοποιημένη εξαγωγή ειδήσεων, γιατί είναι κομβική για όποιον χρειάζεται δεδομένα ειδήσεων σε πραγματικό χρόνο και πώς στήνεις ένα ανθεκτικό, συμβατό workflow με τα καλύτερα εργαλεία (και πώς το κάνει όλη τη φάση απίστευτα απλή—ακόμα και για μη τεχνικούς, όπως η μαμά μου).

Αυτοματοποιημένη εξαγωγή ειδήσεων: Γιατί είναι απαραίτητη για τα σύγχρονα newsroom

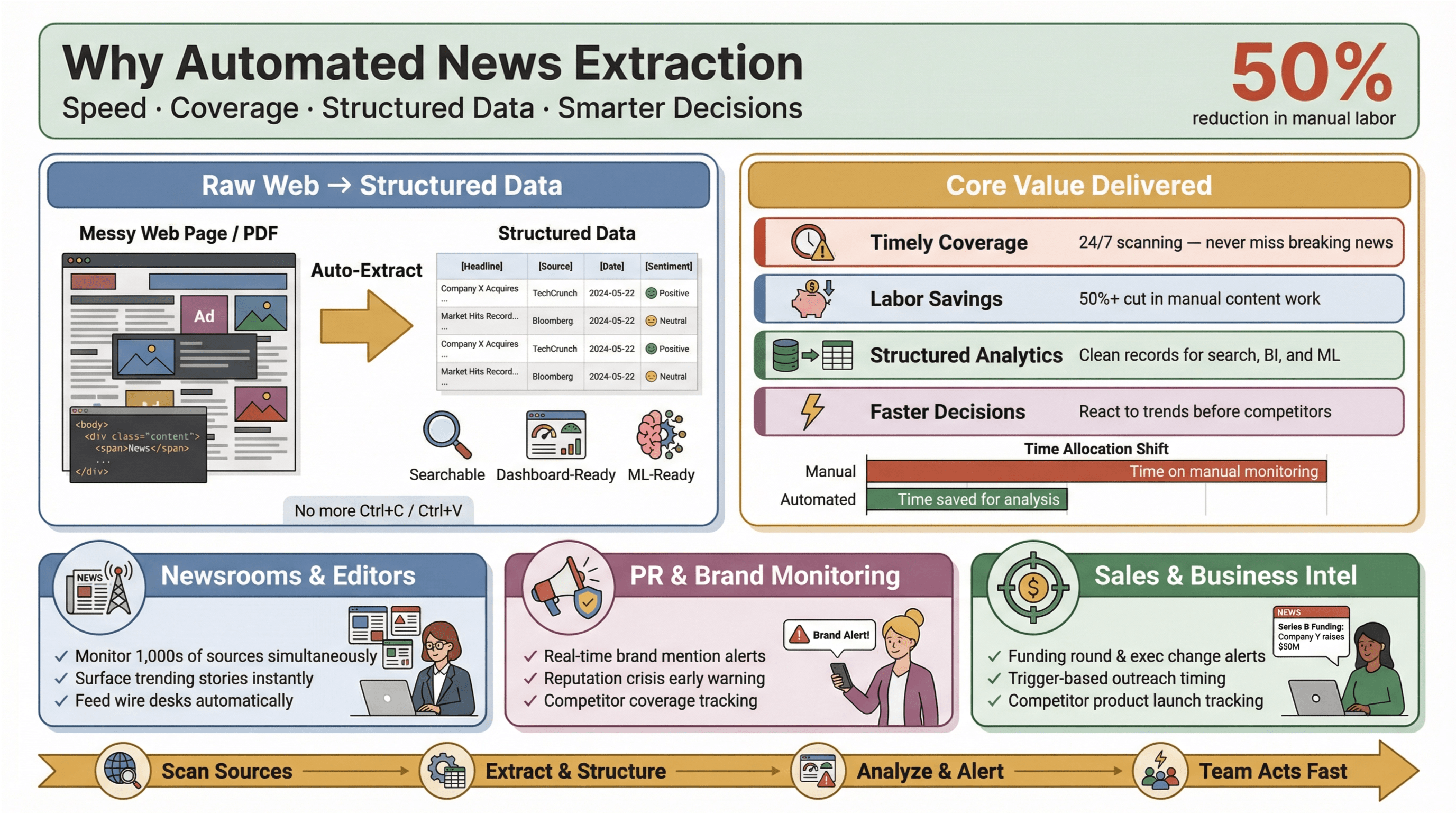

Η αυτοματοποιημένη εξαγωγή ειδήσεων είναι ακριβώς αυτό που ακούγεται: χρήση λογισμικού για να κάνεις συλλογή ειδήσεων αυτόματα και να τις μετατρέπεις σε δομημένα, αναζητήσιμα δεδομένα—δηλαδή σε γραμμές και στήλες, αντί για «χαοτικές» σελίδες ή PDF. Στην πράξη, αυτό σημαίνει ότι μπορείς να παρακολουθείς εκατοντάδες (ή και χιλιάδες) πηγές, να τραβάς βασικά πεδία όπως τίτλο, χρονική σήμανση, συντάκτη και κείμενο, και να ταΐζεις dashboards, alerts ή αναλύσεις—χωρίς να ακουμπήσεις καν Ctrl+C/Ctrl+V.

Γιατί έχει τόσο βάρος; Επειδή στο σημερινό news περιβάλλον, η ταχύτητα είναι όλα. Είτε είσαι αρχισυντάκτης, PR manager που παρακολουθεί αναφορές στο brand, είτε αναλυτής που χαρτογραφεί κινήσεις ανταγωνιστών, το να το μάθεις πρώτος μπορεί να είναι η διαφορά ανάμεσα στο να προλάβεις μια ευκαιρία και στο να τρέχεις πίσω από τις εξελίξεις. Τα εργαλεία αυτοματοποιημένης εξαγωγής επιτρέπουν ακόμη και σε μικρές ομάδες να «παίζουν μπάλα» σε επίπεδο πολύ μεγαλύτερων—μαζεύοντας δεδομένα ειδήσεων σε πραγματικό χρόνο από όλο το web, κόβοντας τη χειροκίνητη αγγαρεία και φέρνοντας στην επιφάνεια τις ιστορίες που έχουν τη μεγαλύτερη αξία.

Γιατί έχει τόσο βάρος; Επειδή στο σημερινό news περιβάλλον, η ταχύτητα είναι όλα. Είτε είσαι αρχισυντάκτης, PR manager που παρακολουθεί αναφορές στο brand, είτε αναλυτής που χαρτογραφεί κινήσεις ανταγωνιστών, το να το μάθεις πρώτος μπορεί να είναι η διαφορά ανάμεσα στο να προλάβεις μια ευκαιρία και στο να τρέχεις πίσω από τις εξελίξεις. Τα εργαλεία αυτοματοποιημένης εξαγωγής επιτρέπουν ακόμη και σε μικρές ομάδες να «παίζουν μπάλα» σε επίπεδο πολύ μεγαλύτερων—μαζεύοντας δεδομένα ειδήσεων σε πραγματικό χρόνο από όλο το web, κόβοντας τη χειροκίνητη αγγαρεία και φέρνοντας στην επιφάνεια τις ιστορίες που έχουν τη μεγαλύτερη αξία.

Και το αποτέλεσμα φαίνεται: έρευνες δείχνουν ότι η αυτοματοποίηση μπορεί να ρίξει τη χειροκίνητη δουλειά για ενημερώσεις περιεχομένου κατά τουλάχιστον 50%, απελευθερώνοντας χρόνο για ουσιαστική ανάλυση και καλύτερες αποφάσεις.

Η βασική αξία της αυτοματοποιημένης εξαγωγής ειδήσεων στον κλάδο

Ας το πάμε πρακτικά. Τι σου δίνει στην καθημερινότητα η αυτοματοποιημένη εξαγωγή ειδήσεων σε newsroom και επιχειρησιακές ομάδες;

- Έγκαιρη και ολοκληρωμένη κάλυψη: Τέλος στο να χάνεις breaking news επειδή κάποιος δεν τσέκαρε ένα feed. Τα εργαλεία σκανάρουν πηγές 24/7, ώστε να μη σου ξεφεύγει τίποτα.

- Εξοικονόμηση χρόνου και κόστους: Μικρές και μεσαίες ομάδες μπορούν να παρακολουθούν όσες πηγές παρακολουθούν και οι «μεγάλοι»—χωρίς να χρειάζονται στρατό από interns.

- Δομημένα δεδομένα για analytics: Αντί να ψάχνεις μέσα σε αδόμητα άρθρα, παίρνεις καθαρές εγγραφές έτοιμες για αναζήτηση, dashboards και machine learning.

- Πιο γρήγορες και πιο έξυπνες αποφάσεις: Τα δεδομένα ειδήσεων σε πραγματικό χρόνο σε βοηθούν να αντιδράς σε αλλαγές αγοράς, PR κρίσεις ή νέες τάσεις πριν από τους ανταγωνιστές.

Στο PR και την επικοινωνία, πλατφόρμες όπως και παρουσιάζουν την παρακολούθηση media σε πραγματικό χρόνο ως must για προστασία φήμης και άμεση αντίδραση σε αρνητική κάλυψη. Στις πωλήσεις, τα real-time alerts λειτουργούν σαν «κάρτες πλαισίου» για prospecting—π.χ. γύροι χρηματοδότησης, αλλαγές στελεχών ή λανσαρίσματα προϊόντων που σηκώνουν outreach την κατάλληλη στιγμή.

Επιλογή των σωστών εργαλείων news scraping για διαφορετικά σενάρια

Δεν είναι όλα τα εργαλεία news scraping ίδια. Η σωστή επιλογή εξαρτάται από τους στόχους σου, το τεχνικό σου επίπεδο και το είδος ειδήσεων που σε καίει. Παρακάτω ένα πλαίσιο για να διαλέξεις αυτό που σου ταιριάζει:

Αξιολόγηση ευκολίας χρήσης και προσβασιμότητας

Για τους περισσότερους επαγγελματίες και δημοσιογράφους, η ευκολία χρήσης δεν σηκώνει παζάρια. Θέλεις εργαλείο που «πιάνει» αμέσως, χωρίς κώδικα και χωρίς μπελαλίδικο στήσιμο. No-code και low-code πλατφόρμες όπως το , το και το σου επιτρέπουν να «στήνεις» scrapers οπτικά—δείχνεις, κλικάρεις, εξάγεις.

Το Thunderbit ειδικά ξεχωρίζει με τη λογική των δύο βημάτων: λες τι θες, η AI προτείνει πεδία και πατάς «Scrape». Ακόμη και μη τεχνικοί μπορούν να στήσουν pipeline δεδομένων ειδήσεων σε λίγα λεπτά, όχι σε ώρες.

Ζητήματα ασφάλειας και προστασίας δεδομένων

Με τα δεδομένα έρχεται και η ευθύνη. Τα εργαλεία news scraping συχνά ακουμπάνε ευαίσθητο περιεχόμενο, άρα ασφάλεια και συμμόρφωση πρέπει να είναι στην κορυφή. Κοίτα για:

- Κρυπτογράφηση δεδομένων (σε μεταφορά και αποθήκευση)

- Καθαρές πολιτικές απορρήτου (το Thunderbit, π.χ., αναφέρει ότι δεν πουλά δεδομένα χρηστών και προσπελαύνει μόνο το περιεχόμενο που επιλέγεις να εξάγεις)

- Λεπτομερή δικαιώματα πρόσβασης (ειδικά σε browser extensions—τσέκαρε πάντα σε τι δεδομένα έχει πρόσβαση το εργαλείο)

- Συμμόρφωση με τοπικούς νόμους (GDPR, CCPA και, για χρήστες ΕΕ, την )

Για να κοιμάσαι πιο ήσυχος, προτίμησε αξιόπιστους προμηθευτές, έλεγξε τα permissions της επέκτασης και κράτα την πρόσβαση μόνο στα απολύτως απαραίτητα.

Ταίριασμα εργαλείων με τύπους ειδήσεων και ανάγκες κλάδου

Κάποια εργαλεία «λάμπουν» σε συγκεκριμένα use cases:

- Οικονομικά: APIs όπως και δίνουν clustering, sentiment και ανίχνευση γεγονότων για οικονομικές ειδήσεις.

- Τεχνολογία & Startups: Προσαρμοσμένο scraping με Thunderbit ή Octoparse για εξειδικευμένα blogs, δελτία τύπου ή λίστες εκδηλώσεων.

- Πολιτική & Δημόσια πολιτική: Αδειοδοτημένες βάσεις όπως και δίνουν πρόσβαση σε premium πηγές και αρχεία.

Αν χρειάζεσαι παρακολούθηση σε μίγμα mainstream, niche και διεθνών πηγών—ειδικά σε sites χωρίς API—ευέλικτοι scrapers με AI όπως το Thunderbit είναι συνήθως η πιο δυνατή επιλογή.

Τα μοναδικά πλεονεκτήματα του Thunderbit για εξαγωγή δεδομένων ειδήσεων σε πραγματικό χρόνο

Πάμε να δούμε τι κάνει το να ξεχωρίζει για αυτοματοποιημένη εξαγωγή ειδήσεων—ειδικά αν θες δεδομένα ειδήσεων σε πραγματικό χρόνο χωρίς τεχνικούς πονοκεφάλους.

Το Thunderbit είναι ένα AI Web Scraper Chrome Extension φτιαγμένο για επαγγελματίες, δημοσιογράφους και αναλυτές που χρειάζονται φρέσκο, δομημένο ειδησεογραφικό περιεχόμενο από οποιοδήποτε site. Να γιατί το χρησιμοποιώ σταθερά:

- AI Suggest Fields: Το Thunderbit «διαβάζει» τη σελίδα ειδήσεων και προτείνει αυτόματα τις καλύτερες στήλες για εξαγωγή—τίτλο, ημερομηνία/ώρα, συντάκτη, περίληψη και άλλα. Χωρίς να μπλέκεις με selectors ή templates.

- Subpage Scraping: Θες ολόκληρο το άρθρο και όχι μόνο τον τίτλο; Το Thunderbit μπορεί να ανοίξει κάθε link, να εξάγει πλήρες κείμενο, οντότητες και tags και να τα ενώσει σε έναν ενιαίο, δομημένο πίνακα.

- Μαζική εξαγωγή & άμεσες ενημερώσεις: Βγάζεις τα δεδομένα ειδήσεων κατευθείαν σε Excel, Google Sheets, Airtable ή Notion με ένα κλικ. Τέλος στα μαραθώνια copy-paste και στο «μαγείρεμα» CSV.

- Scheduled Scraping: Στήσε επαναλαμβανόμενες εργασίες (ανά ώρα, καθημερινά ή σε custom διαστήματα) για να μένει το pipeline φρέσκο—τέλειο για breaking news, παρακολούθηση αγοράς ή συνεχή έρευνα.

- Προσαρμοστικότητα: Η AI του Thunderbit προσαρμόζεται σε αλλαγές layout και σε long-tail ειδησεογραφικά sites, ώστε να χαλάς λιγότερο χρόνο σε «σπασμένους» scrapers και περισσότερο στην ανάλυση.

Με πάνω από και βαθμολογία 4,8 αστέρια, το εμπιστεύονται ομάδες παγκοσμίως για PR monitoring, competitive intelligence και πολλά ακόμη.

Εντοπισμός πεδίων με AI και Subpage Scraping

Ένα από τα πιο δυνατά χαρτιά του Thunderbit είναι ο εντοπισμός πεδίων με AI. Πατάς «AI Suggest Fields» και το εργαλείο σαρώνει τη σελίδα ειδήσεων, αναγνωρίζοντας βασικά πεδία όπως τίτλο, ημερομηνία, συντάκτη και περίληψη. Μπορείς να πειράξεις ή να προσθέσεις δικά σου πεδία (π.χ. «σήμανε αυτό το άρθρο ως ‘earnings’ αν αναφέρει τριμηνιαία αποτελέσματα») και η AI του Thunderbit κάνει τα υπόλοιπα.

Το subpage scraping είναι game changer για ειδήσεις: κάνεις scrape μια αρχική/ενότητα για τίτλους και μετά αφήνεις το Thunderbit να επισκεφθεί κάθε URL άρθρου για να τραβήξει την πλήρη ιστορία, οντότητες και ακόμη και εικόνες. Έτσι παίρνεις πλήρεις, εμπλουτισμένες εγγραφές ειδήσεων—έτοιμες για αναζήτηση, dashboards ή περαιτέρω AI ανάλυση.

Μαζική εξαγωγή και άμεσες ενημερώσεις

Το Thunderbit κάνει την εξαγωγή δεδομένων ειδήσεων «μια κι έξω». Με ένα κλικ, στέλνεις το δομημένο feed σε Google Sheets, Airtable, Notion ή το κατεβάζεις ως CSV/Excel. Για ομάδες που ζουν σε spreadsheets ή BI εργαλεία, αυτό γλιτώνει απίστευτο χρόνο.

Και επειδή υποστηρίζει scheduled scraping, μπορείς να το βάλεις να τρέχει ανά ώρα, καθημερινά ή σε δικό σου πρόγραμμα—ώστε τα δεδομένα ειδήσεων να είναι πάντα up to date. Τέλος στο να περιμένεις το Google Alerts να «πιάσει» ιστορίες με καθυστέρηση ημερών.

Αντιμετώπιση λειτουργικών προκλήσεων σε λύσεις ειδήσεων πραγματικού χρόνου

Ακόμη και με τα καλύτερα εργαλεία, η εξαγωγή ειδήσεων σε πραγματικό χρόνο έχει τα ζόρια της. Δες πώς να χειριστείς τα πιο συνηθισμένα:

Διαχείριση καθυστέρησης και «φρεσκάδας» δεδομένων

- Προγραμμάτισε scrapes ανάλογα με την ταχύτητα της θεματολογίας: Για breaking news, βάλε εκτελέσεις κάθε 15–30 λεπτά (όπως ο ). Για πιο «αργές» θεματολογίες, φτάνει ανά ώρα ή καθημερινά.

- Παρακολούθησε το lag μεταξύ δημοσίευσης και λήψης: Μέτρα τη διαφορά ανάμεσα στο πότε δημοσιεύτηκε ένα άρθρο και στο πότε το «τράβηξε» το σύστημά σου. Αν ανοίγει η ψαλίδα, ψάξε για blocks ή επιβραδύνσεις.

- Κάνε επαναληπτικό scrape για «σιωπηλές» διορθώσεις: Τα άρθρα συχνά αλλάζουν μετά τη δημοσίευση. Βάλε δεύτερο scrape 24 ώρες μετά για να πιάσεις διορθώσεις ή stealth edits ().

Διαχείριση ορίων API και μεταβλητότητας πηγών

- Σεβάσου τα quotas των API: Αν δουλεύεις με news APIs, πρόσεχε τα rate limits—μοίρασε τα requests στον χρόνο και κάνε cache όπου γίνεται ().

- Αποδιπλοποίηση και canonicalization: Η ίδια είδηση εμφανίζεται συχνά σε πολλά URLs ή ενημερώνεται. Κράτα canonical URLs και χρησιμοποίησε hashes (π.χ. τίτλος + ημερομηνία) για να κόβεις τα διπλότυπα ().

- Διαχείριση δυναμικού περιεχομένου: Για sites με infinite scroll ή lazy loading, χρησιμοποίησε εργαλεία που υποστηρίζουν δυναμική απόδοση και παρακολούθησε αλλαγές layout ().

Έξυπνη ανάλυση δεδομένων ειδήσεων: Ο ρόλος της AI και του machine learning

Η εξαγωγή ειδήσεων είναι μόνο η αρχή. Η πραγματική αξία έρχεται από το πώς αναλύεις και αξιοποιείς αυτά τα δεδομένα—και εκεί η AI και το machine learning κάνουν τη διαφορά.

- Εξαγωγή οντοτήτων: Χρησιμοποίησε NLP για να εντοπίζεις πρόσωπα, οργανισμούς και τοποθεσίες που αναφέρονται σε κάθε άρθρο ().

- Ταξινόμηση θεμάτων: Αυτόματη σήμανση άρθρων ανά θέμα, συναίσθημα ή βαθμό επείγοντος—για πιο έξυπνα dashboards και alerts ().

- Ομαδοποίηση γεγονότων (event clustering): Μάζεψε διπλότυπες ή σχετικές ιστορίες από διαφορετικά μέσα, ώστε να βλέπεις τη μεγάλη εικόνα (και όχι καταιγισμό από σχεδόν ίδιους τίτλους).

- Εξατομίκευση και στόχευση: Χρησιμοποίησε δεδομένα ειδήσεων σε πραγματικό χρόνο για segmentation κοινού, καλύτερο ad targeting ή προτάσεις περιεχομένου—ανεβάζοντας engagement και ROI.

Για παράδειγμα, ομάδες PR χρησιμοποιούν real-time analytics για να εντοπίζουν κρίσεις πριν γίνουν viral, ενώ ομάδες πωλήσεων εμπλουτίζουν λίστες prospects με «trigger events» όπως γύρους χρηματοδότησης ή προσλήψεις στελεχών.

Checklist βέλτιστων πρακτικών για αυτοματοποιημένη εξαγωγή ειδήσεων

Ακολουθεί μια σύντομη λίστα-σκονάκι για να τρέχει ομαλά το pipeline εξαγωγής ειδήσεων:

| Βέλτιστη πρακτική | Γιατί έχει σημασία | Πώς εφαρμόζεται |

|---|---|---|

| Συχνός προγραμματισμός scrapes | Μειώνει την καθυστέρηση, πιάνει breaking news | Ταίριαξε τη συχνότητα με την «ταχύτητα» της θεματολογίας (π.χ. κάθε 15’ για γρήγορα beats) |

| Εξαγωγή με AI | Προσαρμόζεται σε αλλαγές layout, μειώνει τον χρόνο ρύθμισης | Εργαλεία όπως Thunderbit, Diffbot, Zyte API |

| Αποδιπλοποίηση και canonicalization | Αποφεύγει διπλές ειδοποιήσεις, κρατά καθαρά δεδομένα | Καταγραφή canonical URLs, χρήση hashes για deduplication |

| Παρακολούθηση ποιότητας εξαγωγής | Εντοπίζει ελλείψεις, drift ή αποτυχίες | Παρακολούθηση % ολοκληρωμένων εγγραφών, lag και ποσοστών σφάλματος |

| Σεβασμός νομικών/συμμορφωτικών ορίων | Μειώνει νομικό ρίσκο, χτίζει εμπιστοσύνη | Προτίμησε επίσημα APIs/feeds, έλεγξε όρους, ελαχιστοποίησε προσωπικά δεδομένα |

| Εξαγωγή σε δομημένες μορφές | Επιτρέπει downstream analytics | CSV, Excel, Sheets, Notion, Airtable |

| Επαναληπτικά scrapes για διορθώσεις | Πιάνει αλλαγές μετά τη δημοσίευση | Επανεπίσκεψη άρθρων μετά από 24h/1w (μοντέλο GDELT) |

| Ασφάλεια του pipeline | Προστατεύει ευαίσθητα δεδομένα | Κρυπτογράφηση, έλεγχοι πρόσβασης, αξιόπιστα εργαλεία |

Πώς να στήσεις ένα ανθεκτικό workflow αυτοματοποιημένης εξαγωγής ειδήσεων

Έτοιμος να φτιάξεις το δικό σου «μαύρο κουτί» για δεδομένα ειδήσεων; Ακολούθησε αυτό το βήμα-βήμα workflow:

- Καθόρισε τις πηγές σου: Κατάγραψε τα sites ειδήσεων, blogs ή APIs που θέλεις να παρακολουθείς.

- Ρύθμισε την εξαγωγή: Χρησιμοποίησε το Thunderbit ή το εργαλείο που προτιμάς για να ορίσεις πεδία (το AI Suggest Fields το κάνει πανεύκολο).

- Προγραμμάτισε scrapes: Όρισε συχνότητα ανάλογα με την ταχύτητα της θεματολογίας—ανά ώρα για breaking news, καθημερινά για πιο αργά beats.

- Εμπλουτισμός subpage: Για κάθε τίτλο, κάνε scrape το πλήρες άρθρο για κείμενο, οντότητες και tags.

- Αποδιπλοποίηση και κανονικοποίηση: Κατέγραψε canonical URLs, κάνε hash τις εγγραφές και τυποποίησε τα πεδία.

- Εξαγωγή και διασύνδεση: Στείλε δομημένα δεδομένα σε Excel, Google Sheets, Airtable ή Notion για ανάλυση.

- Παρακολούθηση και προσαρμογή: Έλεγξε την ποιότητα εξαγωγής, παρακολούθησε αλλαγές layout και προσαρμόσου.

- Συμμόρφωση: Έλεγξε όρους, σεβάσου το robots.txt και ελαχιστοποίησε προσωπικά δεδομένα.

Για να το δεις σαν διάγραμμα:

Πηγές → Εξαγωγή (AI fields) → Εμπλουτισμός subpage → Αποδιπλοποίηση → Εξαγωγή → Ανάλυση/Ειδοποιήσεις → Παρακολούθηση

Συμπέρασμα & βασικά σημεία

Η αυτοματοποιημένη εξαγωγή ειδήσεων δεν είναι πια «καλό να υπάρχει»—είναι αναγκαία για όποιον θέλει να μένει μπροστά σε έναν κόσμο όπου οι ειδήσεις «σπάνε» (και αλλάζουν) από λεπτό σε λεπτό. Με τις σωστές πρακτικές και τα κατάλληλα εργαλεία, μπορείς να μετατρέψεις τον κατακλυσμό των ψηφιακών ειδήσεων σε μια σταθερή ροή δομημένης, αξιοποιήσιμης πληροφορίας.

Βασικά σημεία:

- Η κλίμακα και η ταχύτητα των online ειδήσεων απαιτούν αυτοματοποίηση—η χειροκίνητη παρακολούθηση δεν βγαίνει.

- Τα εργαλεία αυτοματοποιημένης εξαγωγής ειδήσεων γλιτώνουν χρόνο, ρίχνουν κόστος και επιτρέπουν σε μικρές ομάδες να φτάσουν κάλυψη πολύ μεγαλύτερων οργανισμών.

- Η σωστή επιλογή εργαλείου είναι ισορροπία ανάμεσα σε ευκολία χρήσης, ασφάλεια και προσαρμοστικότητα—το Thunderbit ξεχωρίζει για την απλότητα που δίνει μέσω AI και τις επιλογές εξαγωγής σε πραγματικό χρόνο.

- Στήσε το workflow σου γύρω από φρεσκάδα δεδομένων, αποδιπλοποίηση, συμμόρφωση και έλεγχο ποιότητας για αξιόπιστα, αξιοποιήσιμα δεδομένα ειδήσεων.

- Η AI και το machine learning ξεκλειδώνουν ακόμη μεγαλύτερη αξία—με πιο έξυπνη στόχευση, εξατομίκευση και λήψη αποφάσεων.

Αν ακόμη κάνεις copy-paste τίτλους ή περιμένεις το Google Alerts να «πιάσει» τις ειδήσεις, μάλλον ήρθε η ώρα να πας ένα επίπεδο πάνω. και δες πόσο απλά μπορεί να γίνει η αυτοματοποιημένη εξαγωγή ειδήσεων. Για περισσότερες συμβουλές, workflows και αναλυτικά άρθρα, δες το .

Συχνές ερωτήσεις (FAQs)

1. Τι είναι η αυτοματοποιημένη εξαγωγή ειδήσεων και πώς λειτουργεί;

Η αυτοματοποιημένη εξαγωγή ειδήσεων είναι η διαδικασία κατά την οποία λογισμικό συλλέγει άρθρα και τα μετατρέπει σε δομημένα δεδομένα (όπως πίνακες ή JSON) για ανάλυση, αναζήτηση ή ειδοποιήσεις. Εργαλεία όπως το Thunderbit χρησιμοποιούν AI για να εντοπίζουν βασικά πεδία (τίτλο, χρονική σήμανση, συντάκτη, κείμενο) και να τα εξάγουν αυτόματα από ιστοσελίδες ή APIs.

2. Γιατί είναι τόσο σημαντικά τα δεδομένα ειδήσεων σε πραγματικό χρόνο για τις επιχειρήσεις;

Τα δεδομένα ειδήσεων σε πραγματικό χρόνο επιτρέπουν στις επιχειρήσεις να αντιδρούν άμεσα σε γεγονότα της αγοράς, PR κρίσεις ή κινήσεις ανταγωνιστών. Είτε είσαι σε πωλήσεις, PR ή έρευνα, οι ενημερωμένες ειδήσεις οδηγούν σε πιο έξυπνες και πιο γρήγορες αποφάσεις και σε ανταγωνιστικό πλεονέκτημα.

3. Πώς κάνει το Thunderbit το news scraping πιο εύκολο για μη τεχνικούς χρήστες;

Το Thunderbit δίνει μια απλή διαδικασία δύο βημάτων: περιγράφεις τι δεδομένα θέλεις και η AI προτείνει τα πεδία. Με λειτουργίες όπως subpage scraping και άμεση εξαγωγή σε Excel ή Google Sheets, ακόμη και μη τεχνικοί χρήστες μπορούν να στήσουν δυνατά pipelines δεδομένων ειδήσεων μέσα σε λίγα λεπτά.

4. Ποιες είναι οι νομικές και συμμορφωτικές παράμετροι στο news scraping;

Έλεγξε πάντα τους όρους χρήσης των sites-στόχων, προτίμησε επίσημα APIs ή feeds όταν υπάρχουν και σεβάσου τις οδηγίες του robots.txt. Απόφυγε scraping σε περιεχόμενο που απαιτεί login ή είναι paywalled χωρίς άδεια και ελαχιστοποίησε τη συλλογή προσωπικών δεδομένων για να παραμένεις συμβατός με τους νόμους περί απορρήτου.

5. Πώς διασφαλίζω ότι το workflow εξαγωγής ειδήσεων παραμένει αξιόπιστο με τον χρόνο;

Προγραμμάτισε τακτικά scrapes, παρακολούθησε την ποιότητα εξαγωγής και χρησιμοποίησε εργαλεία που προσαρμόζονται σε αλλαγές layout (όπως η AI εξαγωγή του Thunderbit). Κάνε αποδιπλοποίηση εγγραφών, μέτρα το lag μεταξύ δημοσίευσης και εξαγωγής και βάλε alerts για αποτυχίες ή ελλείποντα πεδία ώστε το pipeline να μένει «υγιές» και ενημερωμένο.

Μάθε περισσότερα