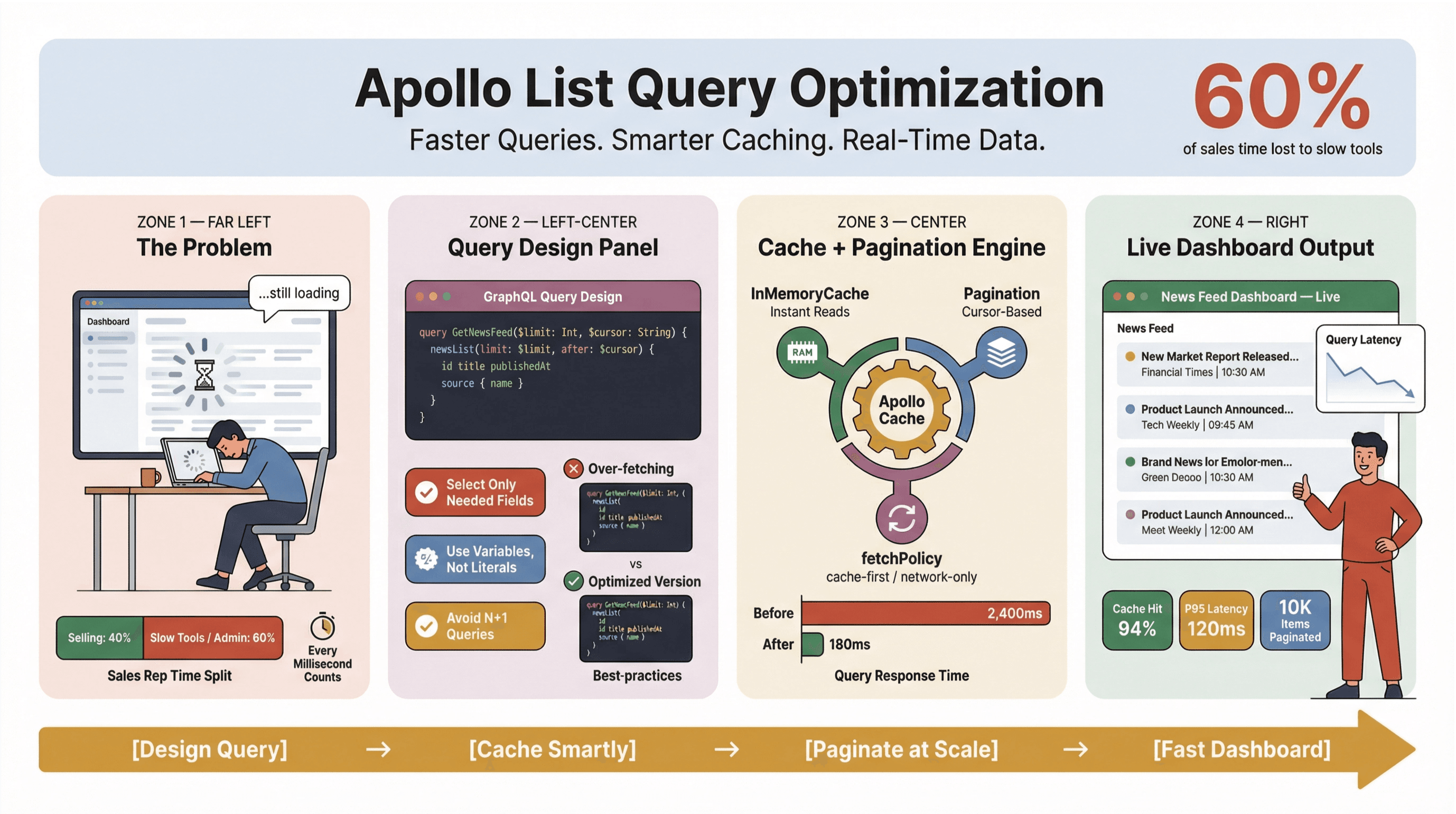

Η βελτιστοποίηση των ερωτημάτων λίστας στο apollo δεν είναι απλώς μια τεχνική «γυμναστική»—είναι δεξιότητα επιβίωσης για όποιον στηρίζεται σε δεδομένα ειδήσεων σε πραγματικό χρόνο, σε αυτοματοποιημένη εξαγωγή ειδήσεων ή σε ροές εργασίας πωλήσεων και λειτουργιών με τέρμα ρυθμούς. Έχω δει από πρώτο χέρι πώς ένα αργό ερώτημα σε λίστες apollo μπορεί να κάνει ένα κατά τα άλλα άψογο dashboard να γίνει «λαιμός μπουκαλιού»: οι ομάδες πωλήσεων να χαζεύουν το loading να γυρίζει και οι άνθρωποι των ops να ψάχνουν πρόχειρες λύσεις σε υπολογιστικά φύλλα. Σε έναν κόσμο όπου , κάθε χιλιοστό του δευτερολέπτου μετρά.

Πώς, λοιπόν, κάνεις τα list queries του Apollo Client να πετάνε—γρήγορα, αξιόπιστα και κλιμακώσιμα—ειδικά όταν κάνεις scraping ειδήσεων, παρακολουθείς leads ή τροφοδοτείς dashboards που είναι κρίσιμα για την αποστολή; Σε αυτόν τον οδηγό θα μοιραστώ τις καλύτερες πρακτικές που έχω μαζέψει (και μερικές που τις έμαθα… με τον δύσκολο τρόπο): από το πώς στήνεις τα queries, μέχρι caching, pagination, και ακόμη και το πώς κουμπώνεις no-code εργαλεία όπως το για να αυτοματοποιήσεις τη «βαριά» δουλειά της εξαγωγής ειδήσεων. Είτε είσαι developer, product manager, είτε απλώς το άτομο που όλοι δείχνουν όταν το dashboard σέρνεται, αυτό είναι το playbook σου για απόδοση λιστών στο Apollo GraphQL.

Γιατί να Βελτιστοποιήσετε τα Apollo List Queries; (apollo client list performance, optimize apollo list queries)

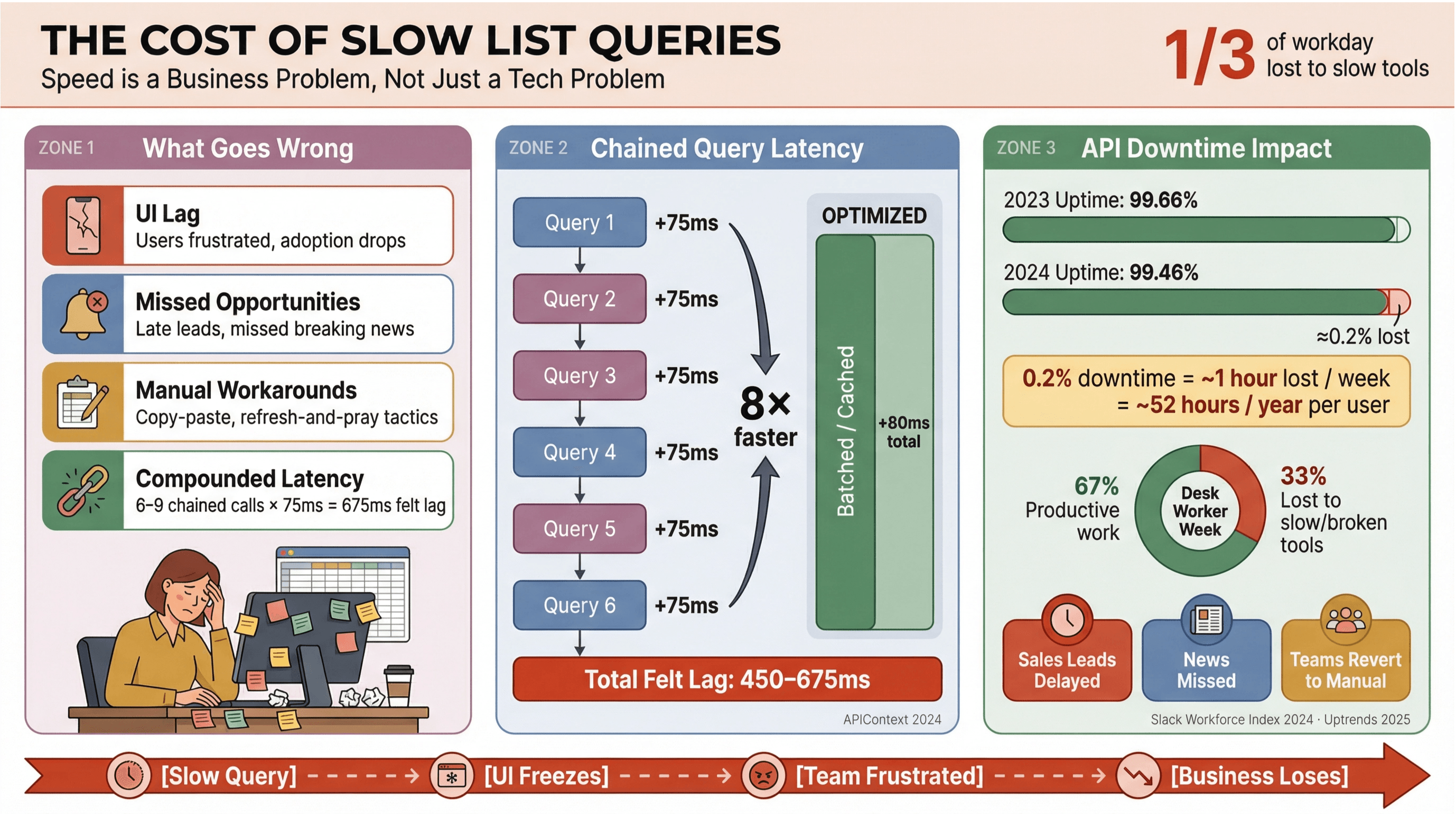

Ας το πούμε στα ίσια: κανείς δεν γουστάρει να περιμένει να φορτώσουν τίτλοι ειδήσεων ή leads πωλήσεων. Σε επιχειρησιακά περιβάλλοντα—ειδικά όταν πατάνε πάνω σε ή σε δεδομένα real-time—τα αργά apollo list queries δεν είναι απλώς «σπαστικά» για τον χρήστη· καίνε χρήμα, καθυστερούν αποφάσεις και σπρώχνουν τις ομάδες πίσω στη χειροκίνητη αγγαρεία. Ο έδειξε ότι οι εργαζόμενοι γραφείου ξοδεύουν περίπου το ένα τρίτο της ημέρας τους σε εργασίες χαμηλής αξίας, συχνά επειδή τα εργαλεία είναι αργά ή σπασμένα σε κομμάτια.

Δείτε τι παθαίνετε όταν τα list queries δεν είναι σωστά «μαζεμένα»:

- Καθυστέρηση στο UI: Ο χρήστης τρώει αναμονές, εκνευρίζεται και τελικά το εργαλείο «δεν τραβάει» σε υιοθέτηση.

- Χαμένες ευκαιρίες: Σε πωλήσεις ή παρακολούθηση ειδήσεων, ακόμη και λίγα δευτερόλεπτα μπορεί να σημαίνουν χαμένο «καυτό» lead ή breaking news.

- Χειροκίνητες παρακάμψεις: Οι ομάδες γυρνάνε σε copy-paste, spreadsheets ή τακτικές «κάνε refresh και βλέπουμε».

- Συσσωρευμένη καθυστέρηση: Κάθε αργό API call προστίθεται—αν η ροή σου πυροδοτεί 6–9 εξαρτώμενα queries, μια μέτρια καθυστέρηση 75ms ανά κλήση μπορεί να γίνει 450–675ms “αισθητή” καθυστέρηση ().

Και δεν είναι μόνο θέμα ταχύτητας. Η , με το μέσο uptime να πέφτει από 99,66% σε 99,46% μέσα σε έναν χρόνο—δηλαδή σχεδόν μία ώρα χαμένης παραγωγικότητας την εβδομάδα για εφαρμογές που βασίζονται σε λίστες. Όταν η επιχείρησή σου εξαρτάται από ειδήσεις σε πραγματικό χρόνο, αυτό είναι ρίσκο που δεν γίνεται να το προσπεράσεις.

Επιλογή Σωστής Δομής Δεδομένων και Πεδίων (apollo graphql list best practices)

Ένα από τα πιο κλασικά λάθη που βλέπω (και ναι, το έχω κάνει κι εγώ) είναι να φερόμαστε σε κάθε list query σαν να είναι detail query. Στο GraphQL μπορείς να ζητήσεις ακριβώς ό,τι χρειάζεσαι—εκμεταλλεύσου το. Το overfetching είναι ο νούμερο ένα εχθρός της απόδοσης, ειδικά σε εργαλεία scraping ειδήσεων και real-time dashboards.

Προσαρμογή Πεδίων για Αυτοματοποιημένη Εξαγωγή Ειδήσεων

Ας πούμε ότι στήνεις ένα news feed. Χρειάζεσαι όντως ολόκληρο το σώμα του άρθρου, όλα τα tags, σχόλια και βιογραφικά συγγραφέων μέσα στο list query; Πιθανότατα όχι. Δες τη διαφορά:

Αποδοτικό List Query:

1query NewsFeed($after: String, $first: Int) {

2 newsFeed(after: $after, first: $first) {

3 edges {

4 cursor

5 node {

6 id

7 title

8 url

9 sourceName

10 publishedAt

11 }

12 }

13 pageInfo { endCursor hasNextPage }

14 }

15}Μη Αποδοτικό List Query (Μην το Κάνετε):

1query NewsFeedTooHeavy($after: String, $first: Int) {

2 newsFeed(after: $after, first: $first) {

3 edges {

4 node {

5 id title url publishedAt

6 fullText

7 summary

8 entities { ... }

9 relatedArticles { ... }

10 }

11 }

12 }

13}Το πρώτο query είναι «λιτό και αποτελεσματικό»—ό,τι πρέπει για κατάταξη, φιλτράρισμα και εμφάνιση γραμμών. Το δεύτερο; Είναι detail query ντυμένο list query, τραβάει τεράστια payloads και ρίχνει την απόδοση (, ).

Pro tip: Δούλεψε με προσέγγιση δύο επιπέδων—στη λίστα φέρνεις μόνο ελαφριά πεδία και φορτώνεις «βαριά» στοιχεία (όπως πλήρες κείμενο ή NLP enrichment) μόνο όταν ο χρήστης ανοίγει ένα item ή το κάνει hover.

Αξιοποίηση του Apollo Client Cache για Ταχύτερα Queries (apollo client list performance)

Το cache του Apollo Client είναι το κρυφό σου χαρτί για γρήγορα list queries. Αν το στήσεις σωστά, μπορείς να:

- Σερβίρεις επαναλαμβανόμενα queries στο άψε-σβήσε (χωρίς network round-trips)

- Ρίξεις φορτίο σε server και κόστος API

- Έχεις ομαλή πλοήγηση πίσω/μπροστά και αλλαγές φίλτρων

Αλλά το caching δεν είναι «μαγικό ραβδί»—θέλει ρύθμιση και λίγη πειθαρχία.

Ρύθμιση Αποτελεσματικών Cache Policies

Το Apollo υποστηρίζει διάφορα :

| Policy | Τι κάνει | Καλύτερη χρήση για λίστες ειδήσεων |

|---|---|---|

| cache-first | Διαβάζει από cache, κάνει fetch από δίκτυο αν λείπει | Επιστροφή σε λίστες, αλλαγή φίλτρων, πλοήγηση πίσω/μπροστά |

| network-only | Κάνει πάντα fetch από το δίκτυο | Χειροκίνητο refresh, “τελευταίοι τίτλοι” |

| cache-and-network | Επιστρέφει πρώτα cache, μετά ενημερώνει με network response | Γρήγορο αρχικό render + ενημέρωση στο παρασκήνιο (ιδανικό για feeds) |

| no-cache | Κάνει πάντα fetch, δεν αποθηκεύει ποτέ σε cache | Εφάπαξ ευαίσθητα queries (σπάνιο για λίστες) |

Για δεδομένα ειδήσεων σε πραγματικό χρόνο, εγώ συνήθως προτιμώ το cache-and-network—σου δίνει άμεσα αποτέλεσμα και μετά κάνει ανανέωση στο background. Μόνο προσοχή στο «τρεμόπαιγμα» του UI αν τα δεδομένα αλλάζουν σειρά στο refresh ().

Συμβουλές ρύθμισης cache:

- Χρησιμοποίησε σταθερά IDs (

idή_id) για normalization (). - Ρύθμισε μέγεθος cache και garbage collection για μεγάλες λίστες ().

- Μην αποθηκεύεις τεράστια, μη-normalized blobs κάτω από

ROOT_QUERY—μπορεί να «σέρνει» όλη την εφαρμογή ().

Υλοποίηση Pagination και Περιορισμός Πλήθους Items (apollo graphql list best practices)

Αν φορτώνεις εκατοντάδες ή χιλιάδες άρθρα ή leads με τη μία, είναι σαν να ζητάς να σκάσει κάτι. Το pagination δεν είναι μόνο UX—είναι must για απόδοση.

Το Apollo υποστηρίζει τόσο όσο και pagination. Δες πώς στέκονται δίπλα-δίπλα:

| Τύπος Pagination | Πλεονεκτήματα | Μειονεκτήματα | Ιδανικό για |

|---|---|---|---|

| Offset-based | Απλό, εύκολο στην υλοποίηση | Μπορεί να παραλείψει/διπλομετρήσει items αν αλλάξουν τα δεδομένα | Αμετάβλητες ή μικρές λίστες |

| Cursor-based | Σταθερό, διαχειρίζεται καλά αλλαγές | Λίγο πιο σύνθετο | News feeds, μεγάλες λίστες |

Για τις περισσότερες real-time λίστες ειδήσεων ή leads, το cursor-based pagination είναι η πιο σωστή επιλογή. Κρατά τη λίστα «ίσια» ακόμη κι όταν μπαίνουν νέα items ή φεύγουν παλιά ().

Συμβουλές pagination στο Apollo:

- Ρύθμισε

keyArgsγια να ελέγχεις τα cache keys σε paginated fields (). - Υλοποίησε

mergefunction για να «κολλάνε» σωστά οι σελίδες στο cache. - Χρησιμοποίησε

fetchMoreγια να φέρνεις επιπλέον σελίδες χωρίς να πετάς τα προηγούμενα αποτελέσματα.

Πρακτικά Patterns Pagination για Εργαλεία Scraping Ειδήσεων

Ένα τυπικό UI για scraping ειδήσεων συνήθως θα:

- Δείχνει τους τελευταίους 20–50 τίτλους (μόνο lean fields)

- Φορτώνει κι άλλα με scroll ή κλικ σε “next page”

- Φέρνει λεπτομέρειες μόνο όταν χρειάζεται

Έτσι κρατάς το UI σβέλτο, το API «ήρεμο» και τους χρήστες σε ρυθμό.

Ενσωμάτωση του Thunderbit για Αυτοματοποιημένη Εξαγωγή Ειδήσεων

Τώρα πάμε στο ζουμί: από πού έρχονται όλα αυτά τα δομημένα δεδομένα ειδήσεων; Εδώ μπαίνει το .

Το Thunderbit είναι ένα no-code AI web scraper Chrome Extension που μπορεί να εξάγει τίτλους ειδήσεων, URLs, πηγές, συγγραφείς, ημερομηνίες δημοσίευσης, περιλήψεις και εικόνες από σχεδόν οποιοδήποτε site—χωρίς να γράψεις ούτε γραμμή κώδικα. Έχω δει ομάδες να το χρησιμοποιούν για να αυτοματοποιήσουν όλη τη διαδικασία εξαγωγής ειδήσεων, μετατρέποντας «ακατάστατες» σελίδες σε καθαρά, δομημένα δεδομένα που μπορούν να τροφοδοτήσουν κατευθείαν μια βάση δεδομένων ή ένα GraphQL API.

Συνδυάζοντας Thunderbit με Apollo για Real-Time Δεδομένα Ειδήσεων

Ένα workflow που μου αρέσει πολύ για ομάδες πωλήσεων και ops που θέλουν ενημερωμένες ειδήσεις:

- Επίπεδο Εξαγωγής: Χρησιμοποίησε το του Thunderbit για να τραβάς δομημένα δεδομένα ειδήσεων από στοχευμένα sites σε προγραμματισμένα διαστήματα.

- Επίπεδο Αποθήκευσης: Αποθήκευσε τα scraped δεδομένα σε βάση βελτιστοποιημένη για γρήγορη ανάκτηση.

- Επίπεδο GraphQL: Έκθεσε ένα list field

newsFeedκαι ένα detail fieldnewsArticle(id)μέσω του API σου. - Επίπεδο Client: Χρησιμοποίησε Apollo Client για να φέρνεις τη λίστα (lean fields, paginated) και να ζητάς λεπτομέρειες μόνο όταν χρειάζεται.

Αυτό το pipeline “scrape → store → query” σημαίνει ότι τα apollo queries δουλεύουν πάντα πάνω σε φρέσκα, δομημένα δεδομένα—χωρίς χειροκίνητο copy-paste ή εύθραυστα scripts.

Bonus: Το Thunderbit μπορεί επίσης να εμπλουτίσει τις λίστες σου με επιπλέον πεδία (όπως sentiment ή κατηγορία) μέσω των AI-powered προτάσεων πεδίων, κάνοντας το news feed σου ακόμη πιο «έξυπνο».

Οδηγός Βήμα-Βήμα: Βελτιστοποίηση Apollo List Queries

Έτοιμοι να το τρέξετε στην πράξη; Ορίστε η checklist που χρησιμοποιώ για βελτιστοποίηση apollo list queries:

-

Κάντε τα Queries Πιο «Λιτά»

- Ζητήστε μόνο τα πεδία που χρειάζονται για να αποδοθεί η λίστα (τίτλος, URL, timestamp κ.λπ.).

- Μεταφέρετε τα βαριά πεδία (πλήρες κείμενο, εικόνες, enrichment) σε detail queries.

-

Υλοποιήστε Pagination

- Προτιμήστε cursor-based pagination για μεγάλες ή δυναμικές λίστες.

- Ρυθμίστε

keyArgsκαιmergefunctions για σωστή συμπεριφορά cache.

-

Αξιοποιήστε το Apollo Cache

- Κάντε normalize τα entities με σταθερά IDs.

- Επιλέξτε το σωστό fetch policy (

cache-and-networkείναι εξαιρετικό για ειδήσεις). - Ρυθμίστε μέγεθος cache και garbage collection ανάλογα με τον όγκο δεδομένων.

-

Ενσωματώστε Αυτοματοποιημένη Εξαγωγή

- Χρησιμοποιήστε Thunderbit για να αυτοματοποιήσετε το scraping ειδήσεων και να κρατάτε τα δεδομένα φρέσκα.

- Εξάγετε δομημένα δεδομένα απευθείας στη βάση σας ή σε spreadsheet.

-

Παρακολούθηση και Επίλυση Προβλημάτων

- Χρησιμοποιήστε τα για να ελέγχετε queries, cache και απόδοση.

- Προσέξτε για μεγάλες εγγραφές στο cache, υπερβολικά watched queries και «σπασίματα» στο UI.

- Παρακολουθήστε p95/p99 latency και error rates (, ).

Παρακολούθηση και Troubleshooting της Απόδοσης Queries

Τα Devtools του Apollo είναι πραγματικά σωτήρια. Μπορείς να:

- Ελέγχεις ενεργά queries και την κατάσταση του cache

- Εντοπίζεις διπλά queries ή υπερβολικούς watchers

- Αναγνωρίζεις μεγάλα cache blobs ή θέματα normalization

Αν βλέπεις UI lag ή αργές ενημερώσεις, τσέκαρε για:

- Υπερβολικά «βαριά» list queries (κάν’ τα πιο λιτά)

- Κακό cache normalization (διόρθωσε τα IDs)

- Θέματα στο pagination merge (έλεγξε

keyArgsκαιmerge)

Και μην ξεχνάς να μετράς tail latency—όχι μόνο μέσους όρους. Εκεί κρύβεται ο πραγματικός πόνος του χρήστη.

Σύγκριση Παραδοσιακών vs. AI-Driven Προσεγγίσεων για Scraping Ειδήσεων

Ας είμαστε ειλικρινείς: παλιά, το scraping ειδήσεων σήμαινε custom scripts, headless browsers και την ευχή να μη σου αλλάξει το layout μέσα στη νύχτα. Σήμερα, με AI-driven εργαλεία όπως το Thunderbit, μπορείς να αυτοματοποιήσεις όλη τη διαδικασία—χωρίς κώδικα, χωρίς δράματα.

| Προσέγγιση | Δυνατά σημεία | Περιορισμοί για business χρήστες |

|---|---|---|

| Scripted scraping | Πλήρως παραμετροποιήσιμο, οικονομικό σε κλίμακα | Υψηλή συντήρηση, απαιτεί χρόνο μηχανικών |

| Managed scraping platforms | Γρήγορη εκκίνηση, αναλαμβάνει anti-bot handling | Θέλει ρυθμίσεις, το κόστος αυξάνει με τη χρήση |

| AI-driven extraction (Thunderbit) | Διαχειρίζεται «ακατάστατα» layouts, χωρίς κώδικα | Θέλει QA στο αποτέλεσμα, σύνδεση με το schema σας |

| No-code visual scrapers | Προσιτό σε μη μηχανικούς | Μπορεί να σπάσει με αλλαγές UI, περιορισμένη κλίμακα |

| Proxy/unlocker infra | Παράκαμψη blocks, υψηλό throughput | Θέλει ακόμη λογική εξαγωγής, ρίσκα συμμόρφωσης |

Νομική σημείωση: Το scraping δημόσιων δεδομένων είναι γενικά νόμιμο, αλλά πάντα να σέβεστε τους όρους χρήσης και τα rate limits ().

Βασικά Συμπεράσματα για Apollo GraphQL List Best Practices

Ας τα μαζέψουμε στα βασικά:

- Βελτιστοποιήστε για ταχύτητα και καθαρότητα: Κάντε τα list queries πιο λιτά, εφαρμόστε pagination και αξιοποιήστε caching.

- Η δομή μετράει: Φέρτε μόνο ό,τι χρειάζεστε—τα βαριά πεδία να πηγαίνουν σε detail queries.

- Το cache είναι σύμμαχος: Χρησιμοποιήστε normalization και fetch policies του Apollo για άμεση απόκριση.

- Αυτοματοποιήστε την εξαγωγή: Εργαλεία όπως το κάνουν το scraping ειδήσεων και τον εμπλουτισμό λιστών προσιτά σε όλους.

- Παρακολουθήστε και βελτιώνετε συνεχώς: Devtools και observability dashboards βοηθούν να πιάνετε bottlenecks νωρίς.

Για ομάδες πωλήσεων, ops και ειδήσεων, αυτά σημαίνουν λιγότερη αναμονή, περισσότερη δράση—και πολύ λιγότερα Slack μηνύματα του τύπου «γιατί σέρνεται;».

Συμπέρασμα: Επόμενα Βήματα για να Βελτιστοποιήσετε τα Apollo List Queries

Αν ακόμη τρέχεις βαριά list queries χωρίς pagination ή με cache που δεν «κουμπώνει» σωστά, τώρα είναι η ώρα για έλεγχο και αναβάθμιση. Ξεκίνα απλά: κόψε περιττά πεδία, βάλε pagination και φτιάξε το cache. Μετά, ανέβα επίπεδο ενσωματώνοντας εργαλεία αυτοματοποιημένης εξαγωγής όπως το ώστε τα δεδομένα σου να μένουν φρέσκα και αξιοποιήσιμα.

Θες να το πας πιο βαθιά; Ρίξε μια ματιά στα , στο ή μπες στο για πρακτικές συμβουλές και troubleshooting. Και αν είσαι έτοιμος να αυτοματοποιήσεις την εξαγωγή ειδήσεων, δοκίμασε το του Thunderbit—είναι πραγματικό game-changer για όποιον θέλει real-time δεδομένα χωρίς πονοκεφάλους.

Καλά queries—και μακάρι οι λίστες apollo σου να φορτώνουν πάντα πριν κρυώσει ο καφές.

FAQs

1. Γιατί τα Apollo list queries επιβραδύνουν σε real-time dashboards ειδήσεων ή πωλήσεων;

Τα list queries γίνονται αργά όταν φέρνουν υπερβολικά πολλά δεδομένα, δεν έχουν pagination ή δεν αξιοποιούν σωστά το cache. Σε ροές υψηλής συχνότητας όπως το news monitoring, ακόμη και μικρές καθυστερήσεις συσσωρεύονται, προκαλώντας UI lag και απώλεια παραγωγικότητας.

2. Ποιος είναι ο καλύτερος τρόπος να δομήσω Apollo list queries για αυτοματοποιημένη εξαγωγή ειδήσεων;

Ζήτησε μόνο τα πεδία που χρειάζονται για να εμφανιστεί η λίστα (π.χ. τίτλος, URL, timestamp). Μετέφερε τα βαριά πεδία (όπως πλήρες κείμενο ή εικόνες) σε detail queries και κάνε paginate τα αποτελέσματα ώστε τα payloads να μένουν μικρά και γρήγορα.

3. Πώς βελτιώνει το cache του Apollo Client την απόδοση των λιστών;

Το cache κρατά δεδομένα που έχουν ήδη ανακτηθεί, επιτρέποντας άμεσες απαντήσεις σε επαναλαμβανόμενα queries. Με σωστό normalization και κατάλληλα fetch policies (όπως cache-and-network), οι λίστες μπορούν να γίνουν πολύ πιο γρήγορες και να πέσει το φορτίο του server.

4. Πώς μπορεί να βοηθήσει το Thunderbit στο scraping ειδήσεων και στην ενσωμάτωση με Apollo;

Το Thunderbit είναι ένα no-code AI web scraper που εξάγει δομημένα δεδομένα ειδήσεων από οποιοδήποτε site. Μπορείς να το χρησιμοποιήσεις για να αυτοματοποιήσεις την εξαγωγή και μετά να τροφοδοτήσεις αυτά τα δεδομένα στη βάση σου ή στο GraphQL API σου για χρήση με Apollo Client.

5. Ποια εργαλεία μπορώ να χρησιμοποιήσω για monitoring και troubleshooting της απόδοσης των Apollo list queries;

Τα σου επιτρέπουν να επιθεωρείς queries, κατάσταση cache και απόδοση σε πραγματικό χρόνο. Συνδύασέ τα με observability dashboards (όπως New Relic ή Uptrends) για να παρακολουθείς latency και error rates και να βελτιώνεις τον σχεδιασμό των queries για βέλτιστα αποτελέσματα.

Θες περισσότερες συμβουλές για web scraping, αυτοματοποίηση και real-time ροές δεδομένων; Δες το για αναλύσεις, tutorials και τα νεότερα στην παραγωγικότητα με AI.

Μάθετε Περισσότερα