Η πρόσληψη προγραμματιστή για web scraping παλιότερα ήταν κάτι αρκετά «ψαγμένο»—μια κίνηση που την έκαναν κυρίως data scientists ή, άντε, κανένας marketer με τεχνικό υπόβαθρο. Φτάνοντας στο 2025, όμως, είναι σαν κάθε ομάδα πωλήσεων, operations ή marketing που συζητάω να ψάχνει πρόσληψη προγραμματιστή web scraping, έναν freelance ειδικός στο web scraping ή έναν ειδικός εξαγωγής δεδομένων από το web. Και είναι λογικό: το web είναι η μεγαλύτερη—και πιο χαοτική—βάση δεδομένων στον πλανήτη, και η πίεση να μετατρέψουμε αυτό το χάος σε χρήσιμη πληροφορία ανεβαίνει συνεχώς. Το έχω δει από πρώτο χέρι: η σωστή (ή η λάθος) πρόσληψη μπορεί να εκτοξεύσει ή να «τινάξει στον αέρα» ένα project—μερικές φορές με τρόπο που δεν το περιμένεις.

Η αγορά του web scraping και της εξαγωγής δεδομένων τρέχει με τρελούς ρυθμούς, με τις παγκόσμιες δαπάνες να προβλέπεται ότι θα τετραπλασιαστούν μέσα στην επόμενη δεκαετία (). Αλλά με τα sites να αλλάζουν συνέχεια, τις άμυνες κατά των bots να γίνονται όλο και πιο «έξυπνες» και τους business χρήστες να ζητάνε πιο καθαρά δεδομένα—και μάλιστα χτες—το να διαλέξεις τον σωστό άνθρωπο (ή το σωστό εργαλείο) είναι πιο κρίσιμο από ποτέ. Είτε είσαι ιδρυτής, team lead ή απλώς ο «τυχερός» που του έκατσε το data κομμάτι, πάμε βήμα-βήμα να δούμε πώς γίνεται η πρόσληψη προγραμματιστή για web scraping—και πότε ίσως να μη χρειάζεσαι κανέναν.

Τι κάνει ένας προγραμματιστής Web Scraping;

Ένας προγραμματιστής web scraping είναι ουσιαστικά η «γέφυρα» ανάμεσα στην άγρια δύση του internet και στα τακτοποιημένα spreadsheets που χρειάζεται η ομάδα σου για να δουλέψει. Η αποστολή του: να μετατρέπει σελίδες που αλλάζουν και είναι γεμάτες «θόρυβο» σε δομημένα, αξιόπιστα datasets—π.χ. CSV, JSON ή απευθείας ροές σε βάση δεδομένων. Και όχι, δεν είναι απλώς «γράφω ένα script». Το ζουμί είναι να συνεχίζει να δουλεύει όταν το site αλλάξει, να χειρίζεται σελιδοποίηση, υποσελίδες, anti-bot εμπόδια και όλες τις παραξενιές του σύγχρονου web ().

Συνήθεις αρμοδιότητες:

- Έλεγχος/ανάλυση web σελίδων για να επιλεγεί η σωστή μέθοδος εξαγωγής (HTML scraping, κλήσεις API, headless browsers)

- Διαχείριση δυναμικού περιεχομένου, απόδοσης JavaScript και ροών login

- Διαχείριση σελιδοποίησης και εμπλουτισμού μέσω υποσελίδων (π.χ. συλλογή λίστας προϊόντων και επίσκεψη σε κάθε σελίδα προϊόντος για περισσότερες λεπτομέρειες)

- Εξαγωγή «καθαρών» δεδομένων έτοιμων για ανάλυση (CSV, JSON, βάση δεδομένων ή απευθείας διασύνδεση)

- Ρύθμιση monitoring, retries και ειδοποιήσεων όταν κάτι «σπάσει» (γιατί θα σπάσει)

- Τεκμηρίωση προδιαγραφών δεδομένων, ορισμών πεδίων και προγράμματος ανανέωσης

Οι freelance ειδικοί στο web scraping μπαίνουν συνήθως για εφάπαξ δουλειές, πολύ συγκεκριμένους στόχους ή γρήγορα prototypes. Οι in-house ειδικοί εξαγωγής δεδομένων από το web λάμπουν όταν η εξαγωγή δεδομένων είναι βασική, συνεχόμενη λειτουργία—π.χ. καθημερινή παρακολούθηση τιμών, lead generation ή τροφοδότηση εσωτερικού dashboard ().

Για μη τεχνικές ομάδες, αυτοί οι ρόλοι είναι χρυσάφι: μετατρέπουν ώρες ατελείωτου copy-paste σε αυτοματοποιημένες ροές, ώστε αναλυτές και πωλητές να ασχολούνται με αυτά που φέρνουν πραγματικό αποτέλεσμα.

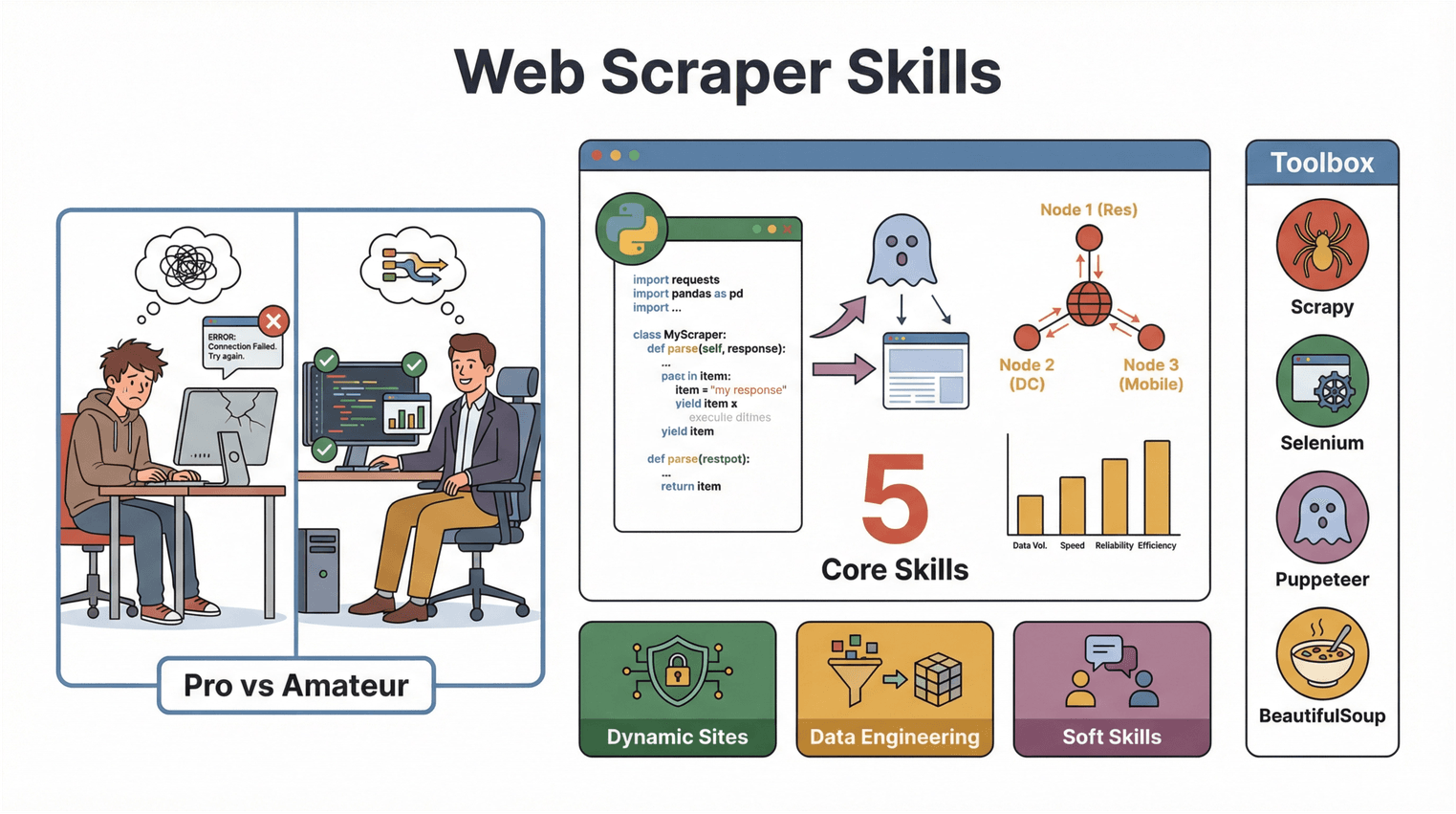

Βασικές δεξιότητες και εμπειρία που πρέπει να αναζητήσετε όταν προσλαμβάνετε προγραμματιστή Web Scraping

Δεν είναι όλοι οι scrapers ίδιοι. Με τα χρόνια έχω δει προγραμματιστές που γράφουν ένα script σε ένα απόγευμα—αλλά δεν μπορούν να το κρατήσουν «όρθιο» ούτε μια εβδομάδα. Αυτά είναι που ξεχωρίζουν τους επαγγελματίες από τους αρχάριους:

- Προχωρημένες προγραμματιστικές δεξιότητες: Η Python είναι η πιο κλασική επιλογή, αλλά JavaScript, Node.js ή και Go παίζουν επίσης πολύ. Ψάξε εμπειρία με βιβλιοθήκες όπως BeautifulSoup, Scrapy, Selenium ή Puppeteer.

- Εμπειρία με εργαλεία web scraping: Το να είναι άνετος/η τόσο με code-based λύσεις όσο και με no-code εργαλεία (όπως το ) είναι μεγάλο ατού. Οι καλοί ξέρουν πότε συμφέρει εργαλείο και πότε χρειάζεται κάτι από το μηδέν.

- Διαχείριση δυναμικών και «προστατευμένων» sites: Τα σημερινά sites πατάνε σε JavaScript και anti-bot άμυνες. Ο άνθρωπός σου πρέπει να χειρίζεται headless browsers, proxies, CAPTCHAs και session management.

- Νοοτροπία data engineering: Δεν φτάνει να «τραβήξεις» δεδομένα—ο καθαρισμός, η αφαίρεση διπλοεγγραφών, οι έλεγχοι εγκυρότητας και η σωστή δομή είναι εξίσου σημαντικά.

- Soft skills: Επικοινωνία, προσοχή στη λεπτομέρεια και ικανότητα επίλυσης προβλημάτων. Θες κάποιον που ρωτάει για να ξεκαθαρίσει, όχι κάποιον που λέει απλώς «ναι, έγινε».

Λίστα ελέγχου τεχνικών δεξιοτήτων

Μια γρήγορη λίστα για το πρώτο ξεσκαρτάρισμα υποψηφίων:

| Απαραίτητες δεξιότητες | Επιθυμητές δεξιότητες |

|---|---|

| Python (ή JS/Node) | Εμπειρία με cloud πλατφόρμες scraping |

| Ανάλυση HTML/CSS/DOM | Εξοικείωση με containerization (Docker) |

| Διαχείριση σελιδοποίησης & υποσελίδων | Ρύθμιση monitoring, logging και alerts |

| Anti-bot στρατηγικές (proxies, throttling) | Ενσωμάτωση σε data pipelines (ETL, APIs) |

| Έλεγχος εγκυρότητας δεδομένων & QA | Επίγνωση συμμόρφωσης και ιδιωτικότητας |

| Εμπειρία με εργαλεία όπως Thunderbit, Octoparse | Εμπειρία με AI-assisted extraction |

Ένα έξτρα συν: υποψήφιοι που ξέρουν να αξιοποιούν εργαλεία όπως το συχνά παραδίδουν πιο γρήγορα και με λιγότερη ανάγκη για συντήρηση—ειδικά σε καθημερινές business ανάγκες.

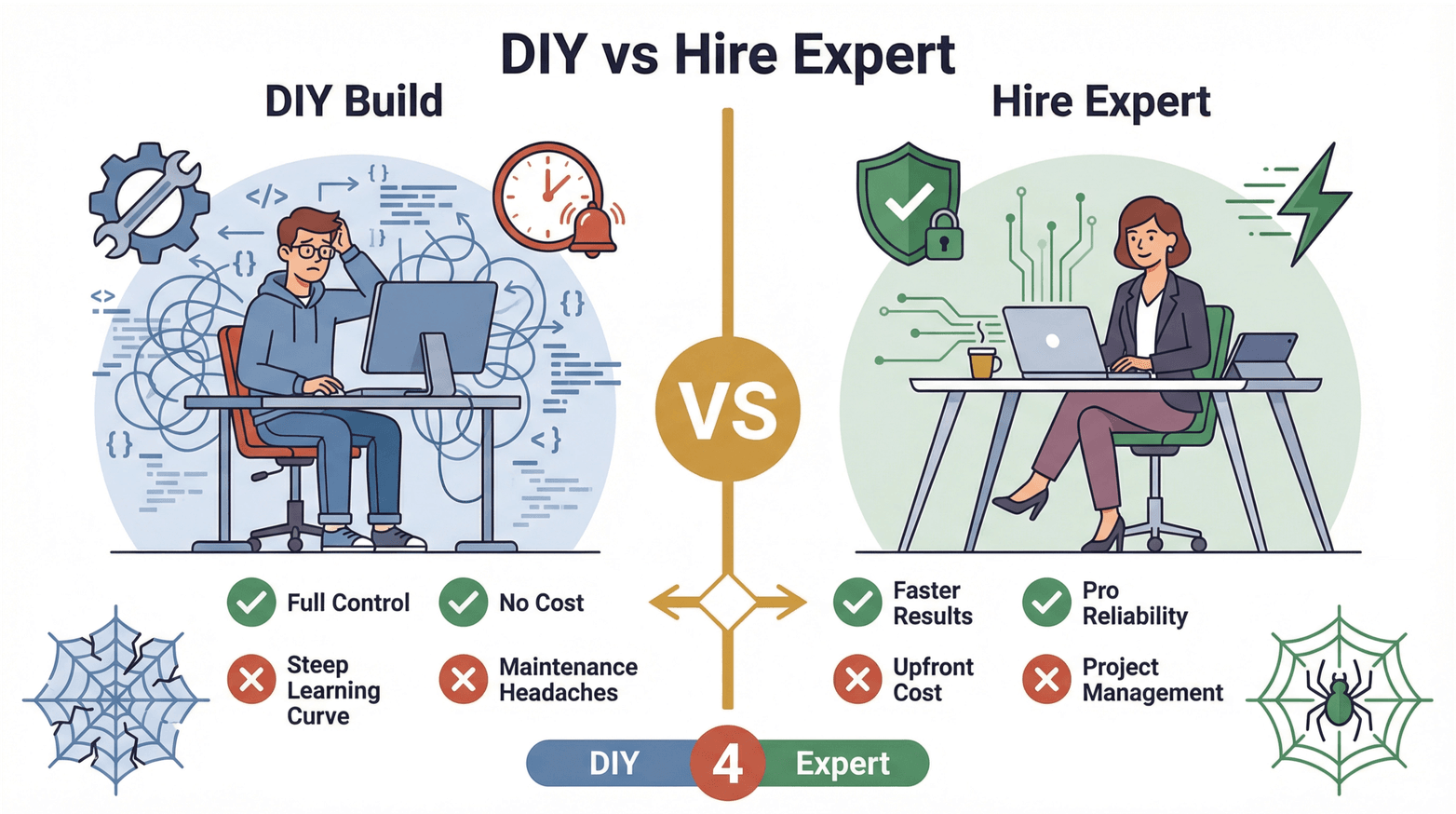

DIY vs. πρόσληψη ειδικού Web Scraping: σύγκριση κόστους και αποδοτικότητας

Το μεγάλο δίλημμα: να το κάνεις μόνος σου ή να φέρεις έναν freelance ειδικό; Πάμε πρακτικά.

DIY (Do It Yourself):

- Πλεονεκτήματα: Απόλυτος έλεγχος, μηδενικό εξωτερικό κόστος, καλό για να μάθεις.

- Μειονεκτήματα: Απότομη καμπύλη εκμάθησης, τρώει χρόνο, συντήρηση-πονοκέφαλος, και πολύ εύκολα υποτιμάς την πολυπλοκότητα.

Πρόσληψη Freelance ειδικού στο Web Scraping:

- Πλεονεκτήματα: Πιο γρήγορη παράδοση, αξιοπιστία επαγγελματικού επιπέδου, μικρότερος κίνδυνος να «σπάσει» με αλλαγές στο site, πρόσβαση σε εξειδικευμένη τεχνογνωσία.

- Μειονεκτήματα: Αρχικό κόστος, χρειάζεται project management, και καμιά φορά η επικοινωνία μπορεί να στραβώσει.

Πίνακας σύγκρισης κόστους:

| Προσέγγιση | Τυπικό κόστος | Χρόνος παράδοσης | Συντήρηση |

|---|---|---|---|

| DIY | Ο χρόνος σας (κόστος ευκαιρίας) | Από ημέρες έως εβδομάδες (αν μαθαίνετε) | Εσείς αναλαμβάνετε όλα τα break/fix |

| Freelance (ωριαία) | $20–$40/ώρα (upwork.com) | 1–2 εβδομάδες για τα περισσότερα έργα | Μπορείτε να συμφωνήσετε συνεχή υποστήριξη |

| Freelance (fixed) | $500–$5,000+ (upwork.com) | 1–4 εβδομάδες, ανάλογα με το scope | Η συντήρηση μπορεί να χρεώνεται επιπλέον |

| In-house πρόσληψη | $100k+/έτος (glassdoor.com) | Συνεχής | Πλήρης ιδιοκτησία (και κόστος) |

Πότε βγάζει νόημα το DIY; Αν έχεις τεχνικό υπόβαθρο, το project είναι απλό και δεν σε πειράζει να πειραματιστείς. Για οτιδήποτε business-critical, μεγάλης κλίμακας ή με συχνές αλλαγές, ένας ειδικός συνήθως κάνει απόσβεση πολύ γρήγορα.

Πότε να επιλέξετε ειδικό εξαγωγής δεδομένων από το web

Σκέψου να προσλάβεις ειδικό όταν:

- Πρέπει να κάνεις scraping σε σύνθετα, δυναμικά ή προστατευμένα sites

- Τα δεδομένα είναι κρίσιμα για την επιχείρηση ή πρέπει να ανανεώνονται συχνά

- Χρειάζεται διασύνδεση με άλλα συστήματα (CRM, βάσεις δεδομένων, APIs)

- Υπάρχουν θέματα συμμόρφωσης, ιδιωτικότητας ή νομικές παράμετροι

- Θες να γλιτώσεις τον πόνο της συνεχούς συντήρησης και του troubleshooting

Για γρήγορες, εφάπαξ εξαγωγές ή απλή δημιουργία λιστών, ένα εργαλείο όπως το μπορεί να σε καλύψει μια χαρά.

Πού να βρείτε και να προσλάβετε προγραμματιστές Web Scraping και freelance ειδικούς

Υπάρχουν αρκετοί δρόμοι για να βρεις ταλέντο στο web scraping, αλλά κάθε πλατφόρμα έχει τα «κουσούρια» και τα δυνατά της.

- : Η μεγαλύτερη «δεξαμενή» υποψηφίων, από junior μέχρι πολύ έμπειρους. Μπορείς να πας με ωριαία ή fixed-price και να δουλέψεις με milestones για να μειώσεις ρίσκο.

- : Καλό για projects με σφιχτό budget και ξεκάθαρα παραδοτέα. Τα milestone payments βοηθούν να βλέπεις πρόοδο και να είσαι καλυμμένος.

- : Πιο «premium» επιλογή με pre-vetted ταλέντο. Ταιριάζει αν θες να αναθέσεις το vetting και δέχεσαι υψηλότερο κόστος.

- Fiverr: Καλύτερο για μικρές, πολύ συγκεκριμένες δουλειές (“gigs”). Θέλει προσοχή σε σύνθετα ή μακροχρόνια projects.

Συμβουλές για φιλτράρισμα υποψηφίων:

- Ψάξε προφίλ με ξεκάθαρη εμπειρία σε web scraping (όχι απλώς «Python developer»)

- Κοίτα σχετική εμπειρία στον κλάδο σου (π.χ. ecommerce, real estate, B2B leads)

- Δες portfolio και ζήτα δείγματα έργων ή αποσπάσματα κώδικα

- Διάβασε προσεκτικά αξιολογήσεις και κριτικές

Συμβουλές για screening και συνέντευξη

Μην μένεις μόνο στα λόγια. Έτσι προτιμώ να αξιολογώ υποψηφίους:

Κρίσιμες ερωτήσεις:

- Μπορείτε να μου περιγράψετε ένα πρόσφατο project web scraping που παραδώσατε; Ποιες ήταν οι δυσκολίες;

- Πώς χειρίζεστε sites με JavaScript ή anti-bot προστασίες;

- Ποια είναι η διαδικασία σας για να διασφαλίζετε ποιότητα και αξιοπιστία δεδομένων;

- Πώς τεκμηριώνετε τη δουλειά σας για παράδοση (handover) ή μελλοντική συντήρηση;

- Ποια είναι η λίστα συμμόρφωσης που ακολουθείτε πριν ξεκινήσετε ένα νέο project;

Πρακτικές δοκιμές:

- Δώστε ένα δείγμα site με δομή λίστας + σελίδας λεπτομερειών. Ζητήστε CSV με εμπλουτισμένα δεδομένα.

- Ζητήστε ένα σύντομο “data contract” (ορισμοί πεδίων, υποχρεωτικότητα, πρόγραμμα ανανέωσης) πριν ξεκινήσει ο κώδικας.

- Ζητήστε ένα μικρό demo scraping σε πίνακα με έντονη χρήση JavaScript.

Πώς το Thunderbit μειώνει την εξάρτησή σας από προγραμματιστές Web Scraping

Ένα μικρό insider tip: οι περισσότεροι business χρήστες δεν χρειάζονται custom scraper με κώδικα για κάθε project. Εργαλεία όπως το έχουν αλλάξει το παιχνίδι για μη τεχνικές ομάδες.

Το Thunderbit είναι ένα που σου επιτρέπει να εξάγεις δομημένα δεδομένα από σχεδόν οποιοδήποτε site με λίγα κλικ. Απλώς περιγράφεις τι θες, πατάς “AI Suggest Fields” και η AI του Thunderbit κάνει τα υπόλοιπα. Υποστηρίζει και scraping υποσελίδων, σελιδοποίηση, και εξαγωγή απευθείας σε Excel, Google Sheets, Airtable ή Notion.

Γιατί αυτό μετράει στην πρόσληψη; Γιατί το Thunderbit κόβει δραστικά τα projects που όντως χρειάζονται προγραμματιστή. Για ομάδες πωλήσεων, ecommerce και research, συχνά είναι πιο γρήγορο (και πιο οικονομικό) να χρησιμοποιήσουν Thunderbit για συνηθισμένες εξαγωγές, λίστες leads ή παρακολούθηση τιμών. Κράτα τη «βαριά» μηχανική για τα πραγματικά δύσκολα.

Thunderbit vs. παραδοσιακές προσεγγίσεις Web Scraping

Ας βάλουμε δίπλα-δίπλα τη ροή εργασίας του Thunderbit με την πρόσληψη freelance ειδικού:

| Παράγοντας | Thunderbit | Freelance ειδικός |

|---|---|---|

| Χρόνος setup | Λεπτά (χωρίς κώδικα) | Ημέρες έως εβδομάδες |

| Κόστος | Δωρεάν επίπεδο, μετά $15–$249/μήνα (Thunderbit Pricing) | $500–$5,000+ ανά project |

| Συντήρηση | Η AI προσαρμόζεται στις αλλαγές του site | Απαιτούνται χειροκίνητες ενημερώσεις |

| Επιλογές εξαγωγής | Excel, Sheets, Airtable, Notion, CSV, JSON | Διαφέρει (συχνά CSV/JSON) |

| Υποσελίδες/Σελιδοποίηση | Ενσωματωμένα, σε 2 κλικ | Απαιτείται custom κώδικας |

| Ιδανικό για | Γρήγορες, συχνές, «ελαφριές» εργασίες | Σύνθετα, μεγάλης κλίμακας, custom integrations |

Πότε να προσλάβετε οπωσδήποτε προγραμματιστή; Όταν μιλάμε για κρίσιμα pipelines, «δύσκολους στόχους» (π.χ. sites με login ή δυνατές άμυνες) ή όταν χρειάζεστε custom integrations και monitoring.

Διαχείριση επιτυχημένων outsourced έργων Web Scraping

Η πρόσληψη του σωστού ανθρώπου είναι μόνο το ξεκίνημα. Η σωστή διαχείριση είναι αυτή που κρατάει το έργο σε τροχιά (και σε γλιτώνει από το κλασικό «πού είναι τα δεδομένα μου;»).

Καλές πρακτικές:

- Ορίστε ξεκάθαρο “data contract” από την αρχή: Λίστα με όλα τα απαιτούμενα πεδία, τύπους δεδομένων, συχνότητα ανανέωσης και κριτήρια αποδοχής ().

- Χρησιμοποιήστε milestones και escrow: Σπάστε το έργο σε στάδια (δείγμα dataset, πλήρης εκτέλεση, προγραμματισμένη εκτέλεση, monitoring) και αποδεσμεύστε πληρωμές μόνο όταν παραδίδεται κάθε στάδιο ().

- Βάλτε «πύλες» QA: Βεβαιωθείτε ότι τα δεδομένα είναι χωρίς διπλοεγγραφές, ελεγμένα και έτοιμα για το επιχειρησιακό σας σενάριο.

- Προβλέψτε συντήρηση: Οι scrapers χαλάνε. Συμφωνήστε retainer ή πλάνο συντήρησης αν τα δεδομένα είναι κρίσιμα.

- Τεκμηριώστε τα πάντα: Ζητήστε README, runbook και γνωστούς τρόπους αποτυχίας. Η καλή τεκμηρίωση σε γλιτώνει από ακριβές εκπλήξεις αργότερα.

Συμβουλές επικοινωνίας και συνεργασίας

- Τακτικά check-ins: Εβδομαδιαίες ενημερώσεις ή demos κρατάνε όλους στην ίδια σελίδα.

- Κοινά εργαλεία διαχείρισης έργου: Trello, Asana ή Google Docs για tracking προόδου και feedback.

- Σαφείς διαδρομές κλιμάκωσης: Συμφωνήστε από πριν πώς θα λύνονται εμπόδια ή προβλήματα.

- Ενθαρρύνετε τις ερωτήσεις: Οι καλύτεροι freelancers ζητάνε διευκρινίσεις νωρίς και συχνά.

Νομικά, ηθικά και θέματα συμμόρφωσης όταν προσλαμβάνετε προγραμματιστή Web Scraping

Το web scraping δεν είναι πια «ξέφραγο αμπέλι». Υπάρχουν πραγματικές νομικές και ηθικές παράμετροι—ειδικά γύρω από προσωπικά δεδομένα, όρους χρήσης και anti-bot προστασίες.

Βασικά σημεία:

- Δημόσια δεδομένα ≠ κάνω ό,τι θέλω: Ακόμη και η συλλογή δημόσιων δεδομένων μπορεί να έχει νομικό ρίσκο, ειδικά αν παρακάμπτετε τεχνικά εμπόδια ή αγνοείτε όρους χρήσης ().

- Οι νόμοι ιδιωτικότητας μετράνε: GDPR, CCPA και άλλοι κανονισμοί απαιτούν τεκμηρίωση σκοπού, ελαχιστοποίηση επιπτώσεων και σεβασμό opt-outs ().

- Checklist συμμόρφωσης: Περιορίστε το scraping σε εγκεκριμένα sites και τύπους δεδομένων, αποφύγετε ευαίσθητα/προσωπικά δεδομένα εκτός αν επιτρέπεται ρητά, τεκμηριώστε τη διαδικασία και χειριστείτε με ασφάλεια τα credentials ().

- Διαφάνεια: Ξεκαθαρίστε στον προγραμματιστή τις απαιτήσεις συμμόρφωσης και περάστε τες μέσα στο statement of work.

Εργαλεία όπως το Thunderbit βοηθούν, γιατί εστιάζουν σε δημόσια, επιχειρησιακά χρήσιμα δεδομένα και κάνουν πιο εύκολη την τεκμηρίωση του τι συλλέγεις και γιατί.

Οδηγός βήμα-βήμα: Πώς να προσλάβετε προγραμματιστή Web Scraping

Έτοιμοι να το τρέξετε; Ορίστε μια απλή, πρακτική διαδικασία:

- Ορίστε τις ανάγκες σας: Τι δεδομένα χρειάζεστε; Από ποια sites; Πόσο συχνά; Σε ποια μορφή;

- Συντάξτε “data contract”: Απαιτούμενα πεδία, τύποι δεδομένων, συχνότητα ανανέωσης και κριτήρια αποδοχής.

- Επιλέξτε πλατφόρμα πρόσληψης: Upwork, Freelancer, Toptal ή Fiverr—ανάλογα με budget, χρονοδιάγραμμα και ανάγκη vetting.

- Δημοσιεύστε το project: Γίνετε συγκεκριμένοι για παραδοτέα, προθεσμίες και απαιτήσεις συμμόρφωσης.

- Κάντε screening: Χρησιμοποιήστε τη λίστα και τις ερωτήσεις παραπάνω. Ζητήστε δείγμα δουλειάς ή ένα μικρό πληρωμένο test.

- Συμφωνήστε milestones: Σπάστε το έργο σε λογικά στάδια με σαφή outputs.

- Διαχειριστείτε το έργο: Τακτικά check-ins, QA gates και κοινά εργαλεία για παρακολούθηση.

- Προβλέψτε συντήρηση: Πώς θα γίνονται updates, διορθώσεις και αλλαγές.

- Τεκμηριώστε τα πάντα: README, runbook και ξεκάθαρη διαδικασία παράδοσης.

Και μην το ξεχνάς: για πολλές καθημερινές εργασίες μπορεί να μη χρειάζεται πρόσληψη—δοκίμασε πρώτα το και δες αν σε καλύπτει.

Συμπέρασμα & βασικά σημεία

Η πρόσληψη προγραμματιστή web scraping δεν είναι πια προνόμιο μόνο των tech γιγάντων—είναι απαραίτητη για κάθε ομάδα που θέλει να μετατρέψει web δεδομένα σε επιχειρησιακή αξία. Με την αγορά web scraping και data extraction να μεγαλώνει με πάνω από , τα «διακυβεύματα» (και η πολυπλοκότητα) είναι πιο ψηλά από ποτέ.

Τι έχει τη μεγαλύτερη σημασία:

- Ψάξτε δυνατές προγραμματιστικές δεξιότητες, πραγματική εμπειρία scraping και νοοτροπία data engineering.

- Χρησιμοποιήστε πλατφόρμες όπως Upwork, Freelancer και Toptal για εύρεση και αξιολόγηση—αλλά τρέξτε το έργο με καθαρά συμβόλαια, milestones και QA gates.

- Για γρήγορες, επαναλαμβανόμενες δουλειές, εργαλεία όπως το γλιτώνουν χρόνο, χρήμα και άγχος—χωρίς κώδικα.

- Βάλτε συμμόρφωση, ιδιωτικότητα και τεκμηρίωση στο κέντρο.

- Τα καλύτερα αποτελέσματα έρχονται με ξεκάθαρες προσδοκίες, συχνή επικοινωνία και προσαρμογή καθώς τα sites (αναπόφευκτα) αλλάζουν.

Πριν προχωρήσεις σε πρόσληψη, σκέψου: είναι εφάπαξ ανάγκη, επαναλαμβανόμενη διαδικασία ή κρίσιμο pipeline; Μερικές φορές, η πιο έξυπνη κίνηση είναι να δώσεις στην ομάδα σου εύχρηστα εργαλεία—και να κρατήσεις τη «βαριά δουλειά» για όταν πραγματικά χρειάζεται.

Θες να δεις πόσα μπορείς να κάνεις χωρίς να προσλάβεις προγραμματιστή; και δοκίμασέ το. Και για περισσότερα tips γύρω από web scraping, αυτοματοποίηση δεδομένων ή το στήσιμο ενός σύγχρονου data stack, ρίξε μια ματιά στο .

Συχνές ερωτήσεις (FAQs)

1. Ποια είναι η διαφορά ανάμεσα σε freelance ειδικό web scraping και in-house ειδικό εξαγωγής δεδομένων από το web;

Ο freelance ειδικός συνήθως προσλαμβάνεται για συγκεκριμένα, βραχυπρόθεσμα έργα ή «δύσκολους»/εξειδικευμένους στόχους, ενώ ο in-house ειδικός διαχειρίζεται συνεχόμενα, κρίσιμα για την επιχείρηση pipelines και integrations.

2. Πόσο κοστίζει να προσλάβω προγραμματιστή web scraping;

Οι freelancers συνήθως χρεώνουν $20–$40/ώρα ή $500–$5,000+ ανά project, ανάλογα με την πολυπλοκότητα. Οι in-house ρόλοι μπορεί να κοστίζουν $100k+ ετησίως. Εργαλεία όπως το Thunderbit λειτουργούν με συνδρομή από $15/μήνα.

3. Ποιες δεξιότητες πρέπει να αναζητήσω όταν προσλαμβάνω προγραμματιστή web scraping;

Αναζητήστε ισχυρές προγραμματιστικές δεξιότητες (Python, JS), εμπειρία σε δυναμικά sites και anti-bot στρατηγικές, γνώση data engineering και εξοικείωση τόσο με λύσεις κώδικα όσο και με no-code εργαλεία όπως το Thunderbit.

4. Πότε να χρησιμοποιήσω εργαλείο όπως το Thunderbit αντί να προσλάβω προγραμματιστή;

Το Thunderbit είναι ιδανικό για γρήγορες, συχνές ή εφάπαξ εξαγωγές, lead generation ή παρακολούθηση τιμών—ειδικά όταν θέλετε δομημένες εξαγωγές και ελάχιστο setup. Προσλάβετε προγραμματιστή για σύνθετα, κρίσιμα ή ιδιαίτερα προσαρμοσμένα projects.

5. Ποια νομικά ή θέματα συμμόρφωσης πρέπει να λάβω υπόψη όταν προσλαμβάνω για web scraping;

Σεβαστείτε πάντα τους όρους χρήσης των sites, τους νόμους ιδιωτικότητας (όπως GDPR/CCPA) και αποφύγετε τη συλλογή ευαίσθητων ή προσωπικών δεδομένων χωρίς ρητή άδεια. Τεκμηριώστε τη διαδικασία και βεβαιωθείτε ότι ο προγραμματιστής ακολουθεί βέλτιστες πρακτικές συμμόρφωσης.

Έτοιμοι να πετύχει το επόμενο data project σας; Ξεκινήστε με σωστό πλάνο, σωστούς ανθρώπους και σωστά εργαλεία—και θα εκπλαγείτε με το πόσα περισσότερα μπορείτε να κάνετε.

Μάθετε περισσότερα