Το προηγούμενο τρίμηνο, η ομάδα operations μας ξόδευε 40 ώρες την εβδομάδα κάνοντας copy-paste δεδομένα ανταγωνιστών σε υπολογιστικά φύλλα. Αυτό το τρίμηνο, χρειάζονται 20 λεπτά.

Η διαφορά; Αυτοματοποιημένα εργαλεία web scraping. Από εργαλεία για προγραμματιστές, έχουν εξελιχθεί σε κάτι που μπορεί να στήσει οποιοσδήποτε πωλητής ή marketer μέσα στο μεσημεριανό του διάλειμμα.

Χτίζω SaaS και εργαλεία αυτοματοποίησης εδώ και χρόνια (και ναι, είμαι συνιδρυτής του ). Η σοδειά εργαλείων του 2026 είναι η πιο δυνατή μέχρι σήμερα — AI-native, αυτοεπιδιορθούμενα και πραγματικά χρήσιμα για μη τεχνικούς ανθρώπους.

Παρακάτω είναι 10 εργαλεία που αξιολόγησα ο ίδιος, συγκριμένα ανά χρήση και επίπεδο δεξιοτήτων.

Γιατί τα Αυτοματοποιημένα Εργαλεία Web Scraping Έχουν Σημασία για τους Επιχειρηματικούς Χρήστες

Ας το παραδεχτούμε: οι μέρες που αντιγράφαμε και επικολλούσαμε χειροκίνητα δεδομένα από ιστότοπους έχουν τελειώσει (εκτός αν απολαμβάνετε επαναλαμβανόμενους τραυματισμούς από καταπόνηση και υπαρξιακό τρόμο). Τα αυτοματοποιημένα εργαλεία web scraping έχουν γίνει απολύτως κρίσιμα για επιχειρήσεις κάθε μεγέθους. Στην πραγματικότητα, , και το web scraping αποτελεί βασικό κομμάτι αυτής της στρατηγικής.

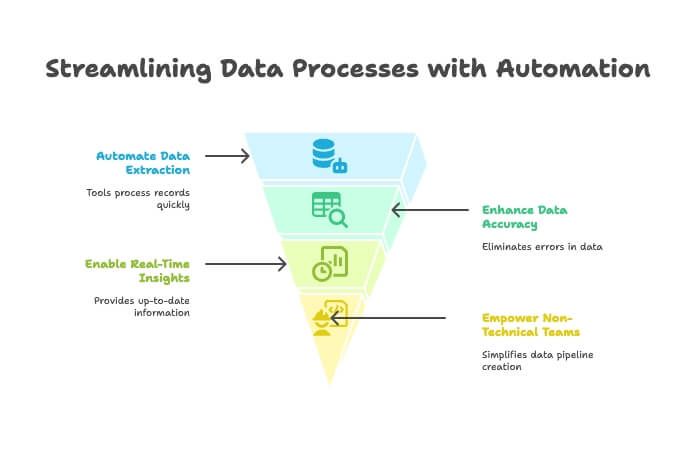

Να γιατί αυτά τα εργαλεία είναι τόσο πολύτιμα:

- Εξοικονόμηση χρόνου και μείωση χειροκίνητης εργασίας: Τα αυτοματοποιημένα scrapers μπορούν να επεξεργαστούν χιλιάδες εγγραφές μέσα σε λίγα λεπτά, απελευθερώνοντας την ομάδα σας για εργασίες μεγαλύτερης αξίας. Ένας χρήστης εργαλείου ανέφερε ότι εξοικονόμησε «εκατοντάδες ώρες» αυτοματοποιώντας τη συλλογή δεδομένων ().

- Καλύτερη ακρίβεια δεδομένων: Τέλος τα τυπογραφικά λάθη και οι παραλειπόμενες καταχωρήσεις. Η αυτοματοποιημένη εξαγωγή σημαίνει καθαρότερα και πιο αξιόπιστα δεδομένα.

- Ταχύτερη λήψη αποφάσεων: Με ροές δεδομένων σε πραγματικό χρόνο, μπορείτε να παρακολουθείτε ανταγωνιστές, να ελέγχετε τιμές ή να δημιουργείτε λίστες leads χωρίς να περιμένετε την μηνιαία αναφορά του ασκούμενου.

- Δυνατότητα για μη τεχνικές ομάδες: Χάρη σε no-code και AI-driven εργαλεία, ακόμη και όσοι νομίζουν ότι το «XPath» είναι στάση γιόγκα μπορούν πλέον να χτίσουν ροές δεδομένων web ().

Δεν είναι περίεργο ότι , και σχεδόν το 80% λέει πως ο οργανισμός του δεν θα μπορούσε να λειτουργήσει αποτελεσματικά χωρίς αυτά. Το 2026, αν δεν αυτοματοποιείτε τη συλλογή δεδομένων σας, πιθανότατα αφήνετε χρήματα — και insights — πάνω στο τραπέζι.

Πώς Επιλέξαμε τα Καλύτερα Αυτοματοποιημένα Εργαλεία Web Scraping

Με την αγορά του λογισμικού web scraping να προβλέπεται ότι , η επιλογή του σωστού εργαλείου μοιάζει με ψώνια για παπούτσια σε κατάστημα με 10.000 επιλογές. Να πώς το έκανα πιο στενό:

- Ευκολία χρήσης: Μπορεί ένας μη προγραμματιστής να ξεκινήσει γρήγορα; Υπάρχει απότομη καμπύλη εκμάθησης;

- Δυνατότητες AI: Χρησιμοποιεί το εργαλείο AI για αυτόματη ανίχνευση πεδίων δεδομένων, διαχείριση δυναμικών ιστότοπων ή σας επιτρέπει να περιγράψετε τις ανάγκες σας σε απλά αγγλικά;

- Εξαγωγή δεδομένων και ενσωμάτωση: Πόσο εύκολα μπορείτε να περάσετε τα δεδομένα σας σε Excel, Google Sheets, Airtable, Notion ή το CRM σας;

- Τιμολόγηση: Υπάρχει δωρεάν δοκιμή; Είναι τα επί πληρωμή πλάνα προσιτά για ιδιώτες και μικρές ομάδες ή απευθύνονται μόνο σε επιχειρήσεις;

- Κλιμάκωση: Μπορεί το εργαλείο να χειριστεί τόσο μικρές εφάπαξ εργασίες όσο και μεγάλες, προγραμματισμένες εξαγωγές;

- Στοχευμένος χρήστης: Είναι φτιαγμένο για επιχειρηματικούς χρήστες, για προγραμματιστές ή και για τους δύο;

- Μοναδικά πλεονεκτήματα: Τι είναι αυτό που το κάνει να ξεχωρίζει από τον ανταγωνισμό;

Έχω συμπεριλάβει εργαλεία για κάθε επίπεδο δεξιοτήτων — από το «θέλω απλώς ένα spreadsheet» μέχρι το «θέλω να σαρώσω ολόκληρο το internet». Πάμε στη λίστα.

1. Thunderbit: Το AI-Powered Εργαλείο Web Scraper για Όλους

Ας ξεκινήσω με το εργαλείο που ξέρω καλύτερα — γιατί, καλά, η ομάδα μου κι εγώ το χτίσαμε για να λύσει ακριβώς τα προβλήματα που έχω δει επανειλημμένα να αντιμετωπίζουν οι επιχειρηματικοί χρήστες. Το δεν είναι το κλασικό scraper τύπου «drag-and-drop» ή «γράψε μόνος σου selector». Είναι ένας AI-powered βοηθός δεδομένων που σου επιτρέπει να περιγράψεις τι θέλεις, και μετά κάνει αυτός όλη τη βαριά δουλειά — χωρίς κώδικα, χωρίς πειράγματα με XPath, χωρίς δάκρυα.

Γιατί το Thunderbit Είναι στην Κορυφή της Λίστας

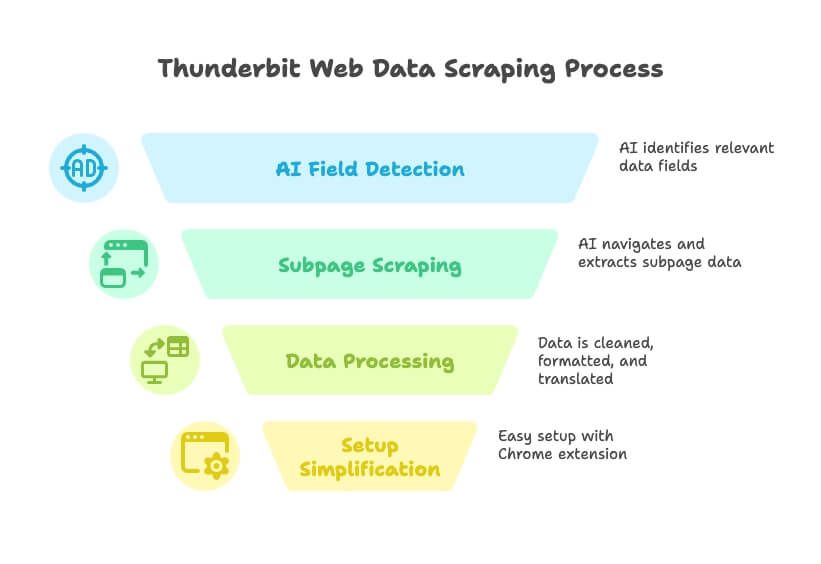

Το Thunderbit είναι το πιο κοντινό πράγμα που έχω δει στο «μετατροπή οποιουδήποτε ιστότοπου σε βάση δεδομένων». Να πώς λειτουργεί:

- Οδηγείται από φυσική γλώσσα: Πες απλώς στο Thunderbit ποια δεδομένα χρειάζεσαι («Θέλω όλα τα ονόματα εταιρειών, τα emails και τα τηλέφωνα από αυτόν τον κατάλογο») και το AI θα ανιχνεύσει αυτόματα τα σχετικά πεδία.

- Προτάσεις πεδίων με AI: Με ένα κλικ, το Thunderbit διαβάζει τη σελίδα και προτείνει τις καλύτερες στήλες προς εξαγωγή — τέλος το μάντεμα και η δοκιμή-λάθος.

- Scraping υποσελίδων και πολλαπλών επιπέδων: Χρειάζεσαι λεπτομέρειες από την υποσελίδα κάθε καταχώρησης; Το Thunderbit μπορεί να ακολουθήσει τα links, να συλλέξει τις επιπλέον πληροφορίες και να τις προσθέσει στον πίνακά σου.

- Καθαρισμός, μετάφραση και ταξινόμηση δεδομένων: Το Thunderbit δεν απλώς τραβά ακατέργαστα δεδομένα — μπορεί να τα καθαρίσει, να τα μορφοποιήσει, να τα μεταφράσει και ακόμη και να κατηγοριοποιήσει πεδία καθώς τα συλλέγει.

- Χωρίς πονοκέφαλο ρύθμισης: Εγκατέστησε την , πάτησε «AI Suggest Fields» και κάνεις scraping σε λιγότερο από ένα λεπτό.

- Δωρεάν δοκιμή και χαμηλό κόστος: Πλούσιο δωρεάν πακέτο (scrape έως 6 σελίδες δωρεάν), με επί πληρωμή πλάνα από μόλις $9/μήνα. Λιγότερα από όσα ξοδεύω εγώ σε καφέ μέσα σε μια εβδομάδα.

Το Thunderbit είναι φτιαγμένο για ομάδες πωλήσεων, marketing και operations που χρειάζονται δεδομένα — γρήγορα. Χωρίς κώδικα, χωρίς plugins, χωρίς εκπαίδευση. Είναι σαν να έχεις έναν ασκούμενο δεδομένων που όντως ακούει και ποτέ δεν παραπονιέται.

Τα Χαρακτηριστικά που Ξεχωρίζουν στο Thunderbit

- Scraping με AI: Το AI καταλαβαίνει τη δομή της σελίδας, προσαρμόζεται σε αλλαγές διάταξης και χειρίζεται αυτόματα την σελιδοποίηση και τις υποσελίδες ().

- Άμεση εξαγωγή δεδομένων: Στείλε τα αποτελέσματά σου απευθείας σε Excel, Google Sheets, Airtable, Notion ή κατέβασέ τα ως CSV/JSON.

- Εκτέλεση στο cloud ή τοπικά: Τρέξε τα scrapes στο cloud για ταχύτητα και κλίμακα ή στον browser σου αν χρειάζεται να χρησιμοποιήσεις το login/session σου.

- Προγραμματισμένο scraping: Ρύθμισε επαναλαμβανόμενες εργασίες για να κρατάς τα δεδομένα σου φρέσκα — ιδανικό για παρακολούθηση τιμών ή τακτικές ενημερώσεις leads.

- Χωρίς ανάγκη συντήρησης: Το AI του Thunderbit προσαρμόζεται στις αλλαγές των ιστότοπων, ώστε να ξοδεύεις λιγότερο χρόνο διορθώνοντας σπασμένα scrapers ().

Για ποιον είναι; Για όποιον θέλει να πάει από το «χρειάζομαι αυτά τα δεδομένα» στο «ορίστε το spreadsheet σου» μέσα σε λίγα λεπτά — ειδικά για μη τεχνικούς χρήστες. Με και βαθμολογία 4,9★, το Thunderbit γίνεται γρήγορα η πρώτη επιλογή για ομάδες επιχειρήσεων που θέλουν αποτελέσματα, όχι πονοκεφάλους.

Θέλεις να το δεις στην πράξη; Δες το ή περιηγήσου σε περισσότερους .

2. Clay: Ο Αυτοματισμός Εμπλουτισμού Δεδομένων Συναντά το Web Scraping

Το Clay είναι σαν σουγιάς ελβετικού τύπου για ομάδες growth. Δεν είναι απλώς ένα web scraper — είναι ένα spreadsheet αυτοματοποίησης που συνδέεται με περισσότερες από 50 ζωντανές πηγές δεδομένων (σκέψου Apollo, LinkedIn, Crunchbase) και χρησιμοποιεί ενσωματωμένο AI για να εμπλουτίζει leads, να γράφει emails προσέγγισης και να βαθμολογεί υποψήφιους πελάτες.

- Αυτοματοποίηση ροών εργασίας: Κάθε γραμμή είναι ένα lead, κάθε στήλη μπορεί να τραβήξει δεδομένα ή να ενεργοποιήσει μια ενέργεια. Θέλεις να κάνεις scrape μια λίστα εταιρειών, να την εμπλουτίσεις με προφίλ στο LinkedIn και να στείλεις ένα εξατομικευμένο email; Το Clay το κάνει.

- Ενσωμάτωση AI: Χρησιμοποιεί GPT-4 για να γράφει icebreakers, να συνοψίζει bios και άλλα.

- Ενσωματώσεις: Συνδέεται εγγενώς με HubSpot, Salesforce, Gmail, Slack και άλλα.

- Τιμολόγηση: Ξεκινά περίπου στα $99/μήνα για το professional πλάνο, με δωρεάν δοκιμή για ελαφριά χρήση.

Ιδανικό για: Outbound sales, growth hackers και marketers που θέλουν να χτίσουν custom lead pipelines — συνδυάζοντας scraping, εμπλουτισμό και outreach σε ένα μέρος. Είναι ισχυρό, αλλά έχει καμπύλη εκμάθησης αν είσαι νέος στα εργαλεία αυτοματοποίησης ().

3. Bardeen: Browser-Based Εργαλείο Web Scraper για Αυτοματοποίηση Ροών Εργασίας

Το Bardeen είναι σαν να έχεις ένα browser robot που μπορεί να κάνει scrape δεδομένα και να αυτοματοποιεί επαναλαμβανόμενες web εργασίες — όλα από μια επέκταση Chrome.

- No-code αυτοματοποίηση: Πάνω από 500 «Playbooks» για scraping, συμπλήρωση φορμών, μετακίνηση δεδομένων μεταξύ εφαρμογών και άλλα.

- AI Command Builder: Περιέγραψε την εργασία σου σε απλά αγγλικά και το Bardeen χτίζει τη ροή εργασίας.

- Ενσωματώσεις: Λειτουργεί με Notion, Trello, Slack, Salesforce και πάνω από 100 άλλες εφαρμογές.

- Τιμολόγηση: Δωρεάν για ελαφριά χρήση (100 automation credits/μήνα), με επί πληρωμή πλάνα από $99/μήνα για ομάδες.

Ιδανικό για: Power users και ομάδες go-to-market που θέλουν να αυτοματοποιήσουν scraping και ενέργειες παρακολούθησης σε πολλαπλές εφαρμογές. Προσφέρει μεγάλη ευελιξία, αλλά οι αρχάριοι ίσως βρουν την καμπύλη εκμάθησης λίγο απότομη ().

4. Bright Data: Αυτοματοποιημένα Εργαλεία Web Scraping Εταιρικού Επιπέδου

Το Bright Data (πρώην Luminati) είναι τα βαριά μηχανήματα του web scraping — σκέψου παγκόσμια δίκτυα proxy, προχωρημένα APIs και τη δυνατότητα να κάνεις crawl χιλιάδες σελίδες την ημέρα.

- Κλίμακα enterprise: Πάνω από 100 εκατομμύρια IPs, Web Scraper IDE, Web Unlocker για παράκαμψη anti-bot μέτρων.

- Προσαρμόσιμο: Φτιάξτε σύνθετες, μεγάλης κλίμακας εξαγωγές με υψηλή αξιοπιστία.

- Τιμολόγηση: Ξεκινά από $499/μήνα για το Web Scraper IDE, με μικρότερα “micro” πακέτα διαθέσιμα.

Ιδανικό για: Μεγάλες επιχειρήσεις, data aggregators και προχωρημένους χρήστες που χρειάζονται στιβαρές, κλιμακούμενες λύσεις. Αν κάνεις crawl χιλιάδες σελίδες καθημερινά και πρέπει να αποφύγεις μπλοκαρίσματα IP, το Bright Data είναι φτιαγμένο για σένα ().

5. Octoparse: Οπτικό Εργαλείο Web Scraper για Ενδιάμεσους Χρήστες

Το Octoparse είναι ένα δημοφιλές no-code εργαλείο με οπτικό περιβάλλον point-and-click — ιδανικό για χρήστες που θέλουν δύναμη χωρίς προγραμματισμό.

- Διεπαφή drag-and-drop: Κάνε κλικ στα στοιχεία για να ορίσεις τι θα εξαχθεί, να χειριστείς logins, σελιδοποίηση και άλλα.

- Πρότυπα: Πάνω από 500 έτοιμα πρότυπα για συνηθισμένους ιστότοπους (Amazon, Twitter κ.ά.).

- Cloud scraping: Τρέξε εργασίες στους servers του Octoparse, προγραμμάτισε εξαγωγές και χρησιμοποίησε εναλλαγή IP.

- Τιμολόγηση: Δωρεάν πλάνο με περιορισμούς· τα επί πληρωμή πλάνα ξεκινούν από $119/μήνα.

Ιδανικό για: Μη προγραμματιστές και data analysts που θέλουν ένα ικανό scraper χωρίς να γράψουν κώδικα. Εξαιρετικό για παρακολούθηση τιμών, καταλόγους προϊόντων και ερευνητικά projects ().

6. : Πλατφόρμα Εξαγωγής Δεδομένων για Επιχειρήσεις

Το είναι ένα από τα OG του web scraping, που πλέον έχει εξελιχθεί σε μια πλήρους κλίμακας πλατφόρμα εξαγωγής δεδομένων.

- Εξαγωγή με point-and-click: Χειρίζεται logins, dropdowns και διαδραστικά στοιχεία.

- Βασισμένο στο cloud: Επεξεργαστείτε χιλιάδες URLs ταυτόχρονα, προγραμματίστε εξαγωγές και αποκτήστε πρόσβαση σε APIs.

- Εστίαση σε enterprise: Χρησιμοποιείται για παρακολούθηση τιμών, έρευνα αγοράς και δημιουργία συνόλων δεδομένων για machine learning.

- Τιμολόγηση: Starter πλάνο στα $199/μήνα, Standard στα $599/μήνα, Advanced στα $1.099/μήνα.

Ιδανικό για: Μεσαίες έως μεγάλες επιχειρήσεις και ομάδες δεδομένων που χρειάζονται αξιόπιστες, συντηρούμενες λύσεις για μεγάλα έργα. Πιθανότατα υπερβολικό για hobby projects, αλλά πραγματικό θηρίο για ανάγκες επιχειρησιακής κλίμακας ().

7. Parsehub: Ευέλικτο Εργαλείο Web Scraper με Οπτικό Editor

Το Parsehub είναι μια desktop εφαρμογή (Windows, Mac, Linux) που σας επιτρέπει να χτίζετε scrapers κάνοντας κλικ μέσα από το περιβάλλον ενός ιστότοπου.

- Οπτική ροή εργασίας: Επιλέξτε στοιχεία, ρυθμίστε κανόνες εξαγωγής και χειριστείτε logins, dropdowns και ατελείωτο scroll.

- Δυνατότητες cloud: Τρέξτε scrapes στο cloud, προγραμματίστε εργασίες και χρησιμοποιήστε πρόσβαση μέσω API.

- Τιμολόγηση: Δωρεάν επίπεδο για μικρές εργασίες· τα επί πληρωμή πλάνα ξεκινούν από $149/μήνα.

Ιδανικό για: Ερευνητές, μικρές επιχειρήσεις ή άτομα που θέλουν περισσότερο έλεγχο από μια επέκταση browser, αλλά δεν είναι έτοιμοι να γράψουν τον δικό τους scraper ().

8. Common Crawl: Ανοιχτά Δεδομένα Web για AI και Έρευνα

Το Common Crawl δεν είναι εργαλείο με την κλασική έννοια — είναι ένα τεράστιο ανοιχτό σύνολο δεδομένων από web crawl, που ενημερώνεται κάθε μήνα.

- Κλίμακα: ~400 TB δεδομένων web, που καλύπτουν δισεκατομμύρια web pages.

- Δωρεάν και ανοιχτό: Δεν χρειάζεται να τρέξετε δικό σας crawler.

- Απαιτούνται τεχνικές δεξιότητες: Θα χρειαστείτε big data εργαλεία και αρκετές μηχανολογικές γνώσεις για να φιλτράρετε και να αναλύσετε τα δεδομένα.

Ιδανικό για: Data scientists και engineers που χτίζουν μοντέλα AI ή κάνουν έρευνα μεγάλης κλίμακας. Αν χρειάζεστε γενικό web κείμενο ή αρχεία μεγάλης χρονικής διάρκειας, είναι πραγματικό χρυσωρυχείο ().

9. Crawly: Ελαφρύ Αυτοματοποιημένο Εργαλείο Web Scraping για Startups

Το Crawly (της Diffbot) είναι ένας cloud-based, AI-powered crawler που μπορεί να συλλέξει δεδομένα από εκατομμύρια ιστότοπους και να επιστρέψει δομημένα αποτελέσματα — χωρίς να χρειάζονται κανόνες parsing.

- Εξαγωγή με AI: Χρησιμοποιεί machine vision και NLP για να αναγνωρίζει και να εξάγει περιεχόμενο.

- Πρόσβαση μέσω API: Κάντε query στα συλλεγμένα δεδομένα και ενσωματώστε τα με analytics ή βάσεις δεδομένων.

- Τιμολόγηση: Επίπεδο enterprise· επικοινωνήστε για τιμή.

Ιδανικό για: Startups και ομάδες με κάποιες τεχνικές δεξιότητες που χρειάζονται εξαγωγή web δεδομένων μεγάλης κλίμακας και με ευφυΐα, χωρίς να χτίσουν δικά τους scrapers ().

10. Apify: Φιλικό για Προγραμματιστές Εργαλείο Web Scraper με Marketplace

Το Apify είναι μια cloud πλατφόρμα όπου μπορείτε να χτίσετε τα δικά σας scrapers («Actors») ή να χρησιμοποιήσετε μια βιβλιοθήκη από έτοιμα community scrapers.

- Ευελιξία για προγραμματιστές: Υποστηρίζει scraping με JavaScript/Python, headless Chrome, διαχείριση proxies και προγραμματισμό.

- Marketplace: Μεγάλη βιβλιοθήκη έτοιμων scrapers για συνηθισμένους ιστότοπους.

- Τιμολόγηση: Δωρεάν επίπεδο με $5/μήνα σε credits· τα επί πληρωμή πλάνα ξεκινούν από $49/μήνα.

Ιδανικό για: Προγραμματιστές και τεχνικά καταρτισμένους analysts που θέλουν πλήρη έλεγχο και κλιμάκωση. Ακόμη και μη προγραμματιστές μπορούν να χρησιμοποιήσουν έτοιμους Actors για συνηθισμένες εργασίες ().

Πίνακας Σύγκρισης Αυτοματοποιημένων Εργαλείων Web Scraping

| Εργαλείο | Ευκολία χρήσης | Δυνατότητες AI | Τιμή (από) | Στοχευμένος χρήστης | Μοναδικά πλεονεκτήματα |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Φυσική γλώσσα, AI Suggest Fields, scraping υποσελίδων | $9/μήνα | Μη τεχνικοί επιχειρηματικοί χρήστες | Ρύθμιση σε 2 κλικ, χωρίς κώδικα, άμεση εξαγωγή, δωρεάν δοκιμή |

| Clay | ★★★★☆ | Εμπλουτισμός με AI, GPT-4 | $99/μήνα | Growth/sales ops | Spreadsheet αυτοματοποίησης, εμπλουτισμός, outreach |

| Bardeen | ★★★★☆ | AI command builder | $99/μήνα | Power users, GTM ομάδες | Browser RPA, 500+ playbooks, βαθιές ενσωματώσεις |

| Bright Data | ★★☆☆☆ | Εναλλαγή proxy, anti-bot AI | $499/μήνα | Επιχειρήσεις, προγραμματιστές | Κλίμακα, αξιοπιστία, παγκόσμια proxies |

| Octoparse | ★★★★☆ | Οπτική ανίχνευση AI | $119/μήνα | Analysts, non-coders | Drag-and-drop, πρότυπα, cloud scraping |

| Import.io | ★★★☆☆ | Διαδραστικοί εξαγωγείς | $199/μήνα | Επιχειρήσεις, ομάδες δεδομένων | Ταυτόχρονη εκτέλεση, προγραμματισμός, API, υποστήριξη |

| Parsehub | ★★★★☆ | Οπτικές ροές εργασίας | $149/μήνα | Ερευνητές, μικρομεσαίες επιχειρήσεις | Desktop app, χειρίζεται δυναμικούς ιστότοπους |

| Common Crawl | ★☆☆☆☆ | N/A (μόνο dataset) | Δωρεάν | Data scientists, engineers | Τεράστιο ανοιχτό dataset, αρχεία web κλίμακας internet |

| Crawly | ★★☆☆☆ | Εξαγωγή με AI | Προσαρμοσμένη/Enterprise | Startups, τεχνικές ομάδες | Με AI, χωρίς κανόνες parsing, πρόσβαση API |

| Apify | ★★★★☆ | Marketplace Actors | $49/μήνα | Προγραμματιστές, τεχνικοί analysts | Κατασκευή/marketplace, cloud αυτοματοποίηση, ευελιξία |

Πώς να Επιλέξετε το Σωστό Εργαλείο Web Scraper για τις Ανάγκες σας

Η επιλογή του καλύτερου αυτοματοποιημένου εργαλείου web scraping εξαρτάται από το μέγεθος της ομάδας σας, τις τεχνικές δεξιότητες και τους επιχειρηματικούς στόχους σας. Να ο σύντομος οδηγός μου:

- Για μη τεχνικούς χρήστες (Πωλήσεις, Marketing, Operations): Προτιμήστε το . Είναι φτιαγμένο για εσάς — χωρίς κώδικα, χωρίς ρύθμιση, μόνο αποτελέσματα. Ιδανικό για δημιουργία leads, παρακολούθηση τιμών και γρήγορα data projects.

- Για ομάδες που έχουν εμμονή με την αυτοματοποίηση: Το Clay και το Bardeen ξεχωρίζουν αν θέλετε να συνδυάσετε scraping με εμπλουτισμό, outreach ή αυτοματοποίηση ροών εργασίας.

- Για επιχειρήσεις και προγραμματιστές: Το Bright Data, το και το Apify είναι οι καλύτερες επιλογές για έργα μεγάλης κλίμακας και υψηλής προσαρμοστικότητας.

- Για ερευνητές και analysts: Το Octoparse και το Parsehub προσφέρουν οπτικές διεπαφές και ισχυρές δυνατότητες χωρίς να χρειάζεται να γράψετε κώδικα.

- Για έργα AI και data science: Το Common Crawl και το Crawly παρέχουν τεράστια datasets και εξαγωγή με AI για όσους θέλουν να χτίσουν ή να εκπαιδεύσουν μοντέλα.

Ρωτήστε τον εαυτό σας: θέλετε να ξεκινήσετε μέσα σε λίγα λεπτά ή χρειάζεστε να χτίσετε μια προσαρμοσμένη λύση enterprise επιπέδου; Αν δεν είστε σίγουροι, ξεκινήστε με μια δωρεάν δοκιμή — τα περισσότερα εργαλεία προσφέρουν μία.

Η Μοναδική Αξία του Thunderbit: AI Assistant για Επιχειρηματικά Δεδομένα

Ανάμεσα σε όλα αυτά τα εργαλεία, το Thunderbit ξεχωρίζει ως το μόνο που λειτουργεί πραγματικά σαν «AI assistant» για web scraping και μετασχηματισμό δεδομένων. Δεν πρόκειται απλώς για τη συλλογή δεδομένων — πρόκειται για τη μετατροπή ακατάστατων ιστότοπων σε καθαρές, δομημένες πληροφορίες, χωρίς τεχνικά εμπόδια.

- Διεπαφή φυσικής γλώσσας: Περιγράψτε τις ανάγκες σας σε απλά αγγλικά και το Thunderbit αναλαμβάνει τα υπόλοιπα.

- Πλήρης αυτοματοποίηση ροής εργασίας: Από την εξαγωγή μέχρι τον καθαρισμό, τη μετάφραση και την εξαγωγή — το Thunderbit καλύπτει όλη τη διαδικασία.

- Ιδανικό για γρήγορα πειράματα: Θέλετε να επικυρώσετε μια νέα αγορά, να φτιάξετε λίστα leads ή να παρακολουθείτε ανταγωνιστές; Το Thunderbit είναι το ταχύτερο και πιο οικονομικό σημείο εκκίνησης.

Είναι σαν να έχετε έναν data analyst ενσωματωμένο στον browser σας — έναν που ποτέ δεν ζητά αύξηση και δεν παίρνει άδεια.

Συμπέρασμα: Ξεκινήστε πιο Έξυπνα με το Σωστό Αυτοματοποιημένο Εργαλείο Web Scraping

Το τοπίο του scraping το 2026 δεν θυμίζει σε τίποτα αυτό που υπήρχε πριν από δύο χρόνια. Αυτοεπιδιορθούμενα AI scrapers, LLM-native pipelines και πραγματικά χρήσιμα no-code εργαλεία έχουν αλλάξει το παιχνίδι. Είτε είστε solo founder, μια ευέλικτη sales ομάδα ή enterprise data scientist, υπάρχει σε αυτή τη λίστα ένα εργαλείο που ταιριάζει στις ανάγκες σας. Το κλειδί είναι να αντιστοιχίσετε τη ροή εργασίας και τις δεξιότητές σας στη σωστή πλατφόρμα — ώστε να σταματήσετε να παλεύετε με τον κώδικα και να αρχίσετε να ξεκλειδώνετε insights.

Αν είστε έτοιμοι να αφήσετε πίσω το χειροκίνητο copy-paste και να ξεκινήσετε πιο έξυπνα, και δείτε πόσο εύκολο μπορεί να είναι το web scraping. Ή εξερευνήστε τις άλλες επιλογές παραπάνω ανάλογα με τους στόχους σας. Σε κάθε περίπτωση, το μέλλον των data-driven επιχειρήσεων ανήκει σε όσους αυτοματοποιούν.

Θέλετε να μάθετε περισσότερα; Δείτε το για αναλύσεις σε βάθος, tutorials και tips για να αξιοποιήσετε στο έπακρο τα web δεδομένα σας. Καλά scrapes — και θυμηθείτε, μακάρι τα δεδομένα σας να είναι πάντα καθαρά και τα scrapers σας να μη χαλάνε ποτέ (αλλά αν χαλάσουν, αφήστε το AI να το χειριστεί).

Συχνές Ερωτήσεις

1. Γιατί τα αυτοματοποιημένα εργαλεία web scraping είναι σημαντικά για τους επιχειρηματικούς χρήστες το 2026;

Τα αυτοματοποιημένα εργαλεία web scraping απλοποιούν τη συλλογή δεδομένων, εξοικονομώντας χρόνο και μειώνοντας τη χειροκίνητη εργασία. Βελτιώνουν την ακρίβεια των δεδομένων, υποστηρίζουν τη λήψη αποφάσεων σε πραγματικό χρόνο και δίνουν τη δυνατότητα σε μη τεχνικές ομάδες να εξάγουν και να χρησιμοποιούν δεδομένα web χωρίς να γράφουν κώδικα. Αυτά τα εργαλεία είναι πλέον κρίσιμα για τις λειτουργίες πωλήσεων, marketing και operations.

2. Τι κάνει το Thunderbit διαφορετικό από άλλα εργαλεία web scraping;

Το Thunderbit χρησιμοποιεί AI ώστε οι χρήστες να περιγράφουν σε απλά αγγλικά ποια δεδομένα θέλουν. Ανιχνεύει αυτόματα τα πεδία δεδομένων, χειρίζεται υποσελίδες και σελιδοποίηση και εξάγει τα αποτελέσματα άμεσα σε πλατφόρμες όπως το Excel και το Airtable. Είναι σχεδιασμένο για μη τεχνικούς χρήστες και προσφέρει ισχυρές δυνατότητες όπως καθαρισμό δεδομένων και προγραμματισμένο scraping σε χαμηλή τιμή.

3. Ποιο εργαλείο είναι καλύτερο για μεγάλης κλίμακας enterprise scraping projects;

Το Bright Data και το είναι ιδανικά για enterprise χρήση. Προσφέρουν λειτουργίες όπως εναλλαγή proxy, anti-bot μέτρα, ταυτόχρονη εκτέλεση σε μεγάλη κλίμακα και πρόσβαση σε API, καθιστώντας τα κατάλληλα για οργανισμούς που χρειάζεται να επεξεργάζονται χιλιάδες web pages με αξιοπιστία και κλίμακα.

4. Υπάρχουν εργαλεία που συνδυάζουν scraping με αυτοματοποίηση και outreach;

Ναι, εργαλεία όπως το Clay και το Bardeen όχι μόνο κάνουν scrape web δεδομένα, αλλά τα ενσωματώνουν και σε ροές εργασίας. Το Clay εμπλουτίζει leads και αυτοματοποιεί το outreach, ενώ το Bardeen επιτρέπει στους χρήστες να αυτοματοποιούν εργασίες browser και ροές εργασίας με AI-driven playbooks.

5. Ποια είναι η καλύτερη επιλογή για χρήστες χωρίς τεχνικό υπόβαθρο;

Το Thunderbit ξεχωρίζει για μη τεχνικούς χρήστες χάρη στη διεπαφή φυσικής γλώσσας, το AI-driven στήσιμο και την ευκολία χρήσης. Δεν απαιτεί κώδικα ή ρύθμιση και είναι ιδανικό για επιχειρηματικούς χρήστες που χρειάζονται γρήγορα, αξιόπιστα δεδομένα χωρίς τεχνική πολυπλοκότητα.