Μια αναζήτηση στο GitHub για "amazon scraper" επιστρέφει περίπου . Αν περιορίσουμε τα αποτελέσματα σε repos που έγιναν push τους τελευταίους έξι μήνες, πέφτουμε περίπου στα — μόλις 20%. Τα υπόλοιπα; Εγκαταλελειμμένα tutorials, παρωχημένα wrappers και scripts που σταμάτησαν να λειτουργούν τη στιγμή που η Amazon σκλήρυνε την άμυνά της.

Έχω περάσει πολύ χρόνο ψάχνοντας σε repos για Amazon scraper, διαβάζοντας GitHub issues και παρακολουθώντας συζητήσεις στην κοινότητα στο Reddit και στο Stack Overflow. Το μοτίβο είναι σταθερό: κάποιος βρίσκει ένα δημοφιλές repo, ξοδεύει μία ώρα για να το στήσει, το τρέχει μία φορά και πέφτει πάνω σε ένα τείχος από CAPTCHA ή σφάλματα 503. Η αμυντική στρατηγική της Amazon το 2026 δεν είναι ίδια με εκείνη ακόμη και πριν από δύο χρόνια — το TLS fingerprinting, η ανάλυση συμπεριφοράς και η επιθετική χρήση CAPTCHA έχουν κάνει το παλιό playbook «γύρνα τα user agents και εύχεσαι να πάνε όλα καλά» σχεδόν άχρηστο. Αυτός ο οδηγός καλύπτει τις βέλτιστες πρακτικές που έχουν πραγματική σημασία αν θέλετε αξιόπιστα δεδομένα Amazon από ένα GitHub repo, και τι να κάνετε όταν — όχι αν — χαλάσει ο scraper σας.

Τι είναι ένα Amazon Scraper στο GitHub (και γιατί αποτυγχάνουν τόσα πολλά;)

Ένα Amazon scraper GitHub repo είναι συνήθως ένα script ανοιχτού κώδικα — συνήθως βασισμένο σε Python, Node.js ή Scrapy — που εξάγει δομημένα δεδομένα από σελίδες της Amazon. Οι στόχοι δεδομένων είναι γνώριμοι: τίτλος προϊόντος, τιμή, ASIN, αξιολογήσεις, αριθμός κριτικών, διαθεσιμότητα, πληροφορίες πωλητή, κάρτες αποτελεσμάτων αναζήτησης και κείμενο κριτικών.

Η αρχιτεκτονική είναι συνήθως απλή:

- Ένας HTTP client ή ένα headless browser ανακτά τη σελίδα.

- Ένας parser για HTML ή JSON εξάγει τα πεδία.

- Τα δεδομένα αποθηκεύονται σε CSV, JSON ή σε μια βάση δεδομένων.

Τα repos γενικά χωρίζονται σε τέσσερις κατηγορίες:

- Ελαφριές βιβλιοθήκες Python (π.χ. )

- Scrapy spiders (π.χ. )

- Browser automators με Selenium ή Playwright

- Projects τύπου API wrapper που στην πράξη είναι front-ends για εμπορική υπηρεσία scraping (π.χ. )

Το μοτίβο αποτυχίας είναι προβλέψιμο. Τα περισσότερα repos χαλάνε επειδή:

- Η Amazon αλλάζει τη διάταξη της σελίδας ή τα HTML fragments της

- Η Amazon επιστρέφει 503 ή CAPTCHA αντί για πραγματικό περιεχόμενο

- Το TLS και το HTTP fingerprint του scraper δεν μοιάζει πια με browser

- Ασυμφωνίες σε locale, γλώσσα ή headers προκαλούν υποψίες

- Ο maintainer προχωρά παρακάτω αφού λύσει το αρχικό, στενό use case του

Τα πολλά stars και το «χρήσιμο αυτή τη στιγμή» είναι δύο πολύ διαφορετικά πράγματα. Στον έλεγχο που έκανα για αυτό το άρθρο, μόνο περίπου τρία από τα οκτώ ευρέως εμφανιζόμενα repos έμοιαζαν ξεκάθαρα ενεργά το 2026.

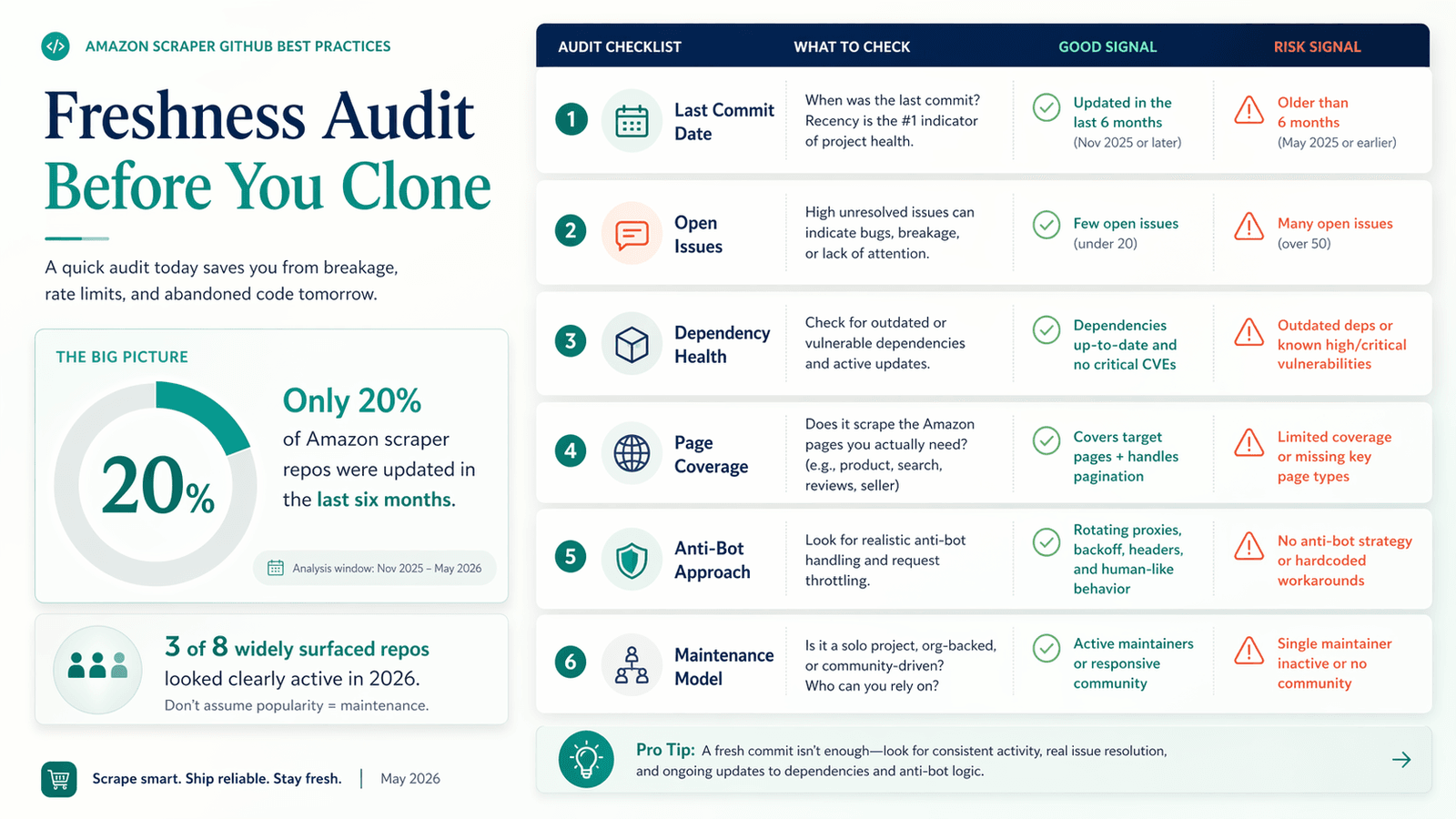

Κάντε έλεγχο φρεσκάδας για το 2026 πριν κάνετε clone οποιοδήποτε Amazon Scraper GitHub repo

Αυτό το βήμα έχει μεγαλύτερη σημασία για την Amazon από ό,τι για τους περισσότερους άλλους στόχους. Η αμυντική στάση της Amazon αλλάζει πιο γρήγορα από ένα τυπικό ecommerce site, οπότε ένα repo που δουλεύει άψογα σε έναν brochure website μπορεί να γίνει άχρηστο στην Amazon μέσα σε λίγες εβδομάδες. Κι όμως, οι περισσότερες λίστες του τύπου «best amazon scraper github» προτείνουν repos χωρίς να ελέγχουν αν συνεχίζουν να λειτουργούν. Οι χρήστες χάνουν ώρες στήνοντας χαλασμένα εργαλεία.

Πώς να δείτε αν ένα GitHub repo είναι ακόμη ζωντανό

Πριν κάνετε git clone οτιδήποτε, περάστε από αυτά τα checks:

- Ημερομηνία τελευταίου commit: Οτιδήποτε παλαιότερο από 6 μήνες είναι σοβαρό προειδοποιητικό σημάδι για την Amazon.

- Ανοιχτά issues vs. ρυθμός απαντήσεων: Αναζητήστε στην καρτέλα Issues λέξεις όπως "captcha", "503", "blocked" και "not working". Αν αυτές οι αναφορές συσσωρεύονται χωρίς απαντήσεις από τον maintainer, απομακρυνθείτε.

- Υγεία εξαρτήσεων: Ανοίξτε το

requirements.txtή τοpackage.json. Παρωχημένες βιβλιοθήκες (π.χ. παλιάrequestsχωρίς σύγχρονη διαχείριση TLS) είναι κόκκινη σημαία. - Κάλυψη τύπων σελίδων Amazon: Το repo χειρίζεται σελίδες προϊόντων, αποτελέσματα αναζήτησης ΚΑΙ κριτικές; Ή μόνο ένα από αυτά;

- Προσέγγιση anti-bot: Σταθερά headers χωρίς υποστήριξη proxy είναι προσέγγιση επιπέδου 2023 που δεν θα αντέξει το 2026.

Checklist φρεσκάδας για Amazon Scraper GitHub

| Σήμα φρεσκάδας | Τι να ελέγξετε | Κόκκινη σημαία 🚩 |

|---|---|---|

| Ημερομηνία τελευταίου commit | Feed commit ή ημερομηνία push του repo | Παλαιότερο από 6 μήνες |

| Ανοιχτά issues | Καρτέλα Issues — φιλτράρετε για "captcha," "503," "blocked" | Επαναλαμβανόμενες αστοχίες χωρίς απαντήσεις από maintainer |

| Υγεία εξαρτήσεων | requirements.txt / package.json | Παρωχημένες βιβλιοθήκες, χωρίς σύγχρονη στρατηγική TLS |

| Κάλυψη σελίδων Amazon | README + παραδείγματα κώδικα | Χειρίζεται μόνο έναν τύπο σελίδας (π.χ. προϊόντα αλλά όχι αναζήτηση ή κριτικές) |

| Προσέγγιση anti-bot | Πηγαίος κώδικας, ρυθμίσεις proxy | Μόνο σταθερά headers και strings UA |

| Μοντέλο συντήρησης | Είναι πραγματικός scraper, tutorial ή commercial API wrapper; | Το repo είναι ουσιαστικά front-end για επί πληρωμή υπηρεσία |

Τι έδειξε στην πράξη ο έλεγχος

Έλεγξα οκτώ ευρέως εμφανιζόμενα Amazon scraper repos με αυτά τα κριτήρια. Τα αποτελέσματα είναι απογοητευτικά:

| Repo / Tool | Stars | Σήμα τελευταίου commit | Εύρος | Κατάσταση 2026 | Σημειώσεις |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2.872 | 2026-04-02 | Managed scraper API wrapper | Ζωντανό, αλλά όχι DIY | Φρέσκο, αλλά στην πραγματικότητα είναι front-end σε managed service |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | Managed API για αναζήτηση, λεπτομέρειες, κριτικές | Ζωντανό, αλλά όχι DIY | Καλή κάλυψη, αλλά είναι προϊόν API, όχι raw scraper |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Ελαφριά βιβλιοθήκη Python | Ζωντανό | Το πιο καθαρό direct GitHub scraper με χρήση curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Μόνο κριτικές | Στενό αλλά χρήσιμο | Παλιό και πολύ εξειδικευμένο στις κριτικές |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Τελευταίο commit 2023; repo pushed 2024-08-20 | Scrapy spiders + proxy middleware | Επίπεδο tutorial, γηρασμένο | Χρήσιμο για μάθηση, όχι έτοιμο 2026 stack |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | Node CLI για αναζήτηση, λεπτομέρειες, κριτικές | Υψηλού ρίσκου | Ευρεία κάλυψη, αλλά η συντήρηση είναι υπερβολικά παλιά |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Search to CSV | Νεκρό για το 2026 | Ιστορικά δημοφιλές, ξεκάθαρα παρωχημένο |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Tutorial για αναζήτηση/προϊόν | Νεκρό για το 2026 | Ουσιαστικά αρχειακό |

Τα δημόσια issues λένε την ίδια ιστορία. Το έχει issue με τίτλο "All requests receive captcha response." Το έχει το "Doesn't seem to be working." Το έχει το "Bypass Amazon protection." Δεν πρόκειται για σπάνιες, ακραίες περιπτώσεις — είναι τα πρώτα προβλήματα που συναντούν οι χρήστες.

Το playbook κατά των αποκλεισμών: πώς να μην μπλοκαριστείτε με ένα Amazon scraper από το GitHub

Ο αποκλεισμός είναι το μεγαλύτερο πρόβλημα για όποιον χρησιμοποιεί ένα amazon scraper github project. Γενικές συμβουλές όπως «χρησιμοποίησε proxies και κάνε rotation στα user agents» δεν αρκούν πια. Το anti-bot stack της Amazon το 2025-2026 περιλαμβάνει TLS fingerprinting, ανάλυση συμπεριφοράς και επιθετική χρήση CAPTCHA. Χρειάζεστε μια πολυεπίπεδη προσέγγιση.

Ταίριασμα TLS fingerprint: γιατί τα απλά requests σας φέρνουν αποκλεισμό

Αυτή είναι μία από τις πιο παραγνωρισμένες τεχνικές κατά των αποκλεισμών. Το TLS fingerprinting λειτουργεί έτσι: όταν το script σας ανοίγει μια ασφαλή σύνδεση με την Amazon, ο server μπορεί να καταλάβει πολλά για τον client από τον τρόπο που «σφίγγει το χέρι» — τα cipher suites που προτείνονται, τη σειρά των extensions, τις ρυθμίσεις HTTP/2. Οι browsers χρησιμοποιούν σχετικά σταθερές ρυθμίσεις TLS και HTTP/2, και αυτά τα σύνολα μπορούν να γίνουν fingerprint μέσω τεχνικών όπως τα .

Τα απλά requests και τα συνηθισμένα setups httpx μπορούν να αντιγράψουν headers, αλλά δεν αντιγράφουν τη συμπεριφορά TLS και HTTP/2 που μοιάζει με Chrome. Η Amazon βλέπει τη διαφορά.

Το το αντιμετωπίζει άμεσα. Παρέχει browser impersonation — οι υποστηριζόμενοι στόχοι περιλαμβάνουν chrome136, safari184 και firefox133 — ώστε το TLS fingerprint του HTTP client να ταιριάζει με πραγματικό browser. Η τεκμηρίωση προειδοποιεί ρητά να μη δημιουργείτε τυχαία JA3 strings: τα browser fingerprints είναι ως επί το πλείστον σταθερά ανά έκδοση, και η τυχαία ανοησία εντοπίζεται πιο εύκολα από ένα αντιγραμμένο πραγματικό fingerprint.

Τα δεδομένα της κοινότητας ταιριάζουν. Ένα επιβεβαιώνει ότι το argument impersonate είναι χρήσιμο επειδή κάνει rotation στα browser profiles και κρατά τα headers ευθυγραμμισμένα. Ένα άλλο σημειώνει ότι η Amazon μπλοκάρει clients βάσει TLS fingerprint «μετά από περίπου έναν ή δύο μήνες». Ένα ρωτά συγκεκριμένα αν η Amazon κάνει fingerprinting στο python-requests (spoiler: ναι).

Αν χρησιμοποιείτε ακόμη τα απλά requests ως πρώτο client για την Amazon, αλλάξτε αυτή την υπόθεση πριν αλλάξετε οτιδήποτε άλλο.

Σωστό proxy rotation (όχι απλώς «χρησιμοποιήστε proxies»)

Ο σκοπός των proxies δεν είναι να κάνετε rotation όσο το δυνατόν πιο συχνά. Ο σκοπός είναι οι συνεδρίες να φαίνονται πειστικές.

Residential vs. datacenter: Τα datacenter proxies είναι φθηνότερα, αλλά πιο εύκολα ανιχνεύσιμα. Τα residential proxies κοστίζουν περισσότερο, αλλά είναι πολύ δυσκολότερο για την Amazon να τα επισημάνει. Η ξεκινά από $4,00/GB pay-as-you-go, έως $3,50/GB σε μεγαλύτερα πλάνα. Η ξεκινά από $6/GB. Η Amazon ανήκει στην κατηγορία «σύνθετος στόχος», όπου τα residential proxies αξίζουν την προσαύξηση τιμής.

Rotation ανά αίτημα vs. ανά συνεδρία: Εδώ είναι που τα περισσότερα tutorials κάνουν λάθος. Το να αλλάζετε proxy σε κάθε αίτημα ενώ κρατάτε cookies και headers σταθερά μπορεί να μοιάζει λιγότερο ανθρώπινο, όχι περισσότερο. Το πιο ασφαλές μοτίβο:

- Κρατήστε τη ροή αναζήτηση → προϊόν → κριτική στην ίδια sticky session όπου γίνεται

- Αλλάξτε session όταν ξεκινάτε μια νέα διαδρομή αναζήτησης, όχι σε κάθε αίτημα

- Κάντε rotation μεταξύ sessions, όχι τυχαία μέσα στην ίδια συνεδρία περιήγησης

Ένας σημείωσε ότι οι συνηθισμένες ISP IPs δεν τα πήγαν ούτε κατά διάνοια τόσο καλά όσο οι mobile IPs σε δημοφιλή ecommerce sites. Ένα άλλο ανέφερε αποκλεισμό ακόμη και με rotating user agents και residential proxies — καλή υπενθύμιση ότι τα proxies από μόνα τους δεν αρκούν.

Ρυθμός αιτημάτων, backoff και rate limiting

Οι σελίδες 503 της Amazon δεν είναι τυχαία κακή τύχη. Είναι feedback.

Ένα για scraping περισσότερων από 500 ASIN ανέφερε 503 στο ίδιο σημείο κάθε φορά, περίπου στο ASIN 101, ακόμη και με sleeps. Το μοτίβο είναι παλιό, αλλά το μάθημα παραμένει επίκαιρο: μεγάλος όγκος από ένα IP ή ένα fingerprint τελικά ενεργοποιεί τις άμυνες.

Καλός ρυθμός για DIY GitHub scrapers:

- Τυχαίες καθυστερήσεις μεταξύ αιτημάτων, όχι σταθερά διαστήματα, που ανιχνεύονται εύκολα

- 2 έως 5 δευτερόλεπτα μεταξύ δημόσιων αιτημάτων προϊόντων για απλούς HTTP clients

- Exponential backoff μετά από 503 ή CAPTCHA — υποχωρήστε προοδευτικά αντί να ξαναδοκιμάζετε αμέσως

- Χαμηλότερη ταυτόχρονη εκτέλεση από ό,τι νομίζετε ότι χρειάζεστε

- Fail-open logging αντί για σφιχτούς βρόχους επανάληψης

Τα περισσότερα amazon scraper github repos δεν έχουν ενσωματωμένο rate limiting. Θα χρειαστεί να το προσθέσετε μόνοι σας.

Ορχήστρωση headers: κάτι περισσότερο από strings User-Agent

Η Amazon ελέγχει ολόκληρο το set των headers, όχι μόνο το User-Agent.

Ένα ρεαλιστικό set headers browser θα πρέπει να περιλαμβάνει:

User-AgentAcceptAccept-LanguageAccept-EncodingSec-CH-*hints όταν ταιριάζει- Συμπεριφορά σύνδεσης συνεπή με το επιλεγμένο browser profile

Τα headers πρέπει να ταιριάζουν με το locale του marketplace. Ένας βρήκε ότι το ίδιο bot setup εντοπιζόταν μόνο σε ορισμένα locales, με έναν άλλο σχολιαστή να δείχνει headers που σχετίζονται με την περιοχή, όπως το Accept-Language.

Ο κανόνας: headers, TLS/browser profile και γεωγραφία proxy δεν πρέπει να αντιφάσκουν μεταξύ τους. Μη στέλνετε Chrome headers με Firefox UA. Μη χρησιμοποιείτε US proxy με Accept-Language: de-DE.

Χειρισμός CAPTCHA: πότε να το λύσετε και πότε να κάνετε πίσω

Αν φτάσατε σε CAPTCHA, η Amazon ήδη υποψιάζεται. Η λύση του δεν μηδενίζει το trust score σας.

Για μεμονωμένα CAPTCHA χαμηλής συχνότητας:

- Το πακέτο PyPI είναι ένας καθαρά Python λύτης text CAPTCHA της Amazon, αν και η τελευταία έκδοσή του είναι από τον Μάιο του 2023 — αντιμετωπίστε το ως τακτικό εργαλείο, όχι ως ανθεκτική στρατηγική

- Το αναφέρει Amazon Captcha στα $0,45 ανά 1.000 λύσεις

Για επαναλαμβανόμενους βρόχους CAPTCHA:

- Σταματήστε να το λύνετε και αρχίστε να κάνετε back off

- Τα επαναλαμβανόμενα CAPTCHA σημαίνουν ότι η συνεδρία έχει καεί — η επίλυση δεν ξαναχτίζει εμπιστοσύνη στο fingerprint, στο ιστορικό session ή στη φήμη του IP

- Αν τα CAPTCHA συγκεντρώνονται σε συγκεκριμένο proxy subnet, το πρόβλημα είναι στο network layer, όχι στον parser

Πότε χρειάζεστε πραγματικά headless browser (και πότε είναι υπερβολή)

Η λάθος παρόρμηση είναι να τρέχετε Playwright για τα πάντα.

Καλά use cases για browser:

- Αποτελέσματα αναζήτησης που εξαρτώνται από rendering JavaScript ή από κατάσταση που επηρεάζεται από locale

- Ροές κριτικών που ανακατευθύνουν σε login ή sign-in pages

- Workflows όπου τα cookies και το browser context έχουν μεγαλύτερη σημασία από την καθαρή ταχύτητα

Κακά use cases για browser:

- Συνήθεις δημόσιες σελίδες προϊόντων

- Εξαγωγή στατικών λεπτομερειών προϊόντος όπου αρκεί ένας HTTP client με browser-like συμπεριφορά

- Μαζική ανάκτηση μεγάλης κλίμακας όπου μετρά η αποδοτικότητα compute

Ξεκινήστε με τον πιο ελαφρύ client που δουλεύει. Ένα για scraping σε κλίμακα περιέγραψε την πορεία: ξεκινήστε με requests, μετά curl_cffi, και πηγαίνετε σε πλήρη browser μόνο όταν οι πιο ελαφριές επιλογές αποτύχουν. Τα headless browsers είναι ουσιαστικά πιο αργά και πιο απαιτητικά σε πόρους από τους HTTP clients για scraping σελίδων προϊόντων Amazon.

Πίνακας αποφάσεων anti-ban για Amazon Scraper GitHub projects

| Σενάριο | Προτεινόμενη προσέγγιση | Γιατί |

|---|---|---|

| Δημόσιες σελίδες προϊόντων (μικρή κλίμακα) | curl_cffi + sticky residential session | Η πιο οικονομική διαδρομή που εξακολουθεί να μοιάζει με browser |

| Σελίδες αποτελεσμάτων αναζήτησης | curl_cffi πρώτα, Playwright μόνο αν το rendering ή η κατάσταση χαλάει το HTTP | Η αναζήτηση είναι πιο stateful και πιο ευαίσθητη στο locale |

| Κριτικές (απαιτείται login) | Λειτουργία browser με πραγματικά cookies/session | Η σύνδεση και οι δυναμικές ροές κριτικών είναι πιο δύσκολο να προσομοιωθούν μόνο με HTTP |

| Μεγάλη κλίμακα (5k+ ημερησίως) | Managed scraper API, unlocker ή no-code platform | Ο DIY GitHub κώδικας μόνος του γίνεται πρόβλημα υποδομής |

Όταν το Amazon Scraper GitHub project σας χαλάει: έχετε σχέδιο εφεδρείας χωρίς κώδικα

Κάθε έμπειρος scraper κρατά ένα Plan B.

Οι ενημερώσεις της Amazon τελικά θα χαλάσουν οποιοδήποτε GitHub repo, συνήθως στην πιο ακατάλληλη στιγμή. Για ecommerce ομάδες, ένας χαλασμένος scraper σημαίνει χαμένες αλλαγές τιμών, παρωχημένα δεδομένα ανταγωνιστών και κενά στα dashboards.

Πολλοί άνθρωποι που ψάχνουν "amazon scraper github" είναι στην πραγματικότητα business users — ecommerce ops, marketers, ερευνητές FBA — που δοκίμασαν λύσεις με κώδικα επειδή δεν έβρισκαν καλύτερες επιλογές. Τα δεδομένα των φόρουμ δείχνουν επίσης πραγματική απογοήτευση με το επίσημο της Amazon: περιοριστική πρόσβαση, περιορισμένα δεδομένα και που πολλοί πωλητές δεν μπορούν να καλύψουν.

Γιατί οι GitHub Amazon scrapers χρειάζονται συνεχή συντήρηση

Ο παραπάνω έλεγχος το κάνει ξεκάθαρο:

- Τα παρωχημένα repos συσσωρεύουν αναφορές σφαλμάτων χωρίς διορθώσεις

- Τα repos που «δουλεύουν» μιλούν πλέον ανοιχτά για anti-bot μέτρα στο README

- Οι συζητήσεις της κοινότητας επικεντρώνονται όλο και περισσότερο σε TLS fingerprints, βρόχους CAPTCHA και ποιότητα proxy — όχι σε CSS selectors

Για τους business users, αυτό το βάρος συντήρησης είναι το πραγματικό κρυφό κόστος. Το repo είναι δωρεάν. Ο χρόνος σας για να το αποσφαλματώσετε στις 2 το πρωί δεν είναι.

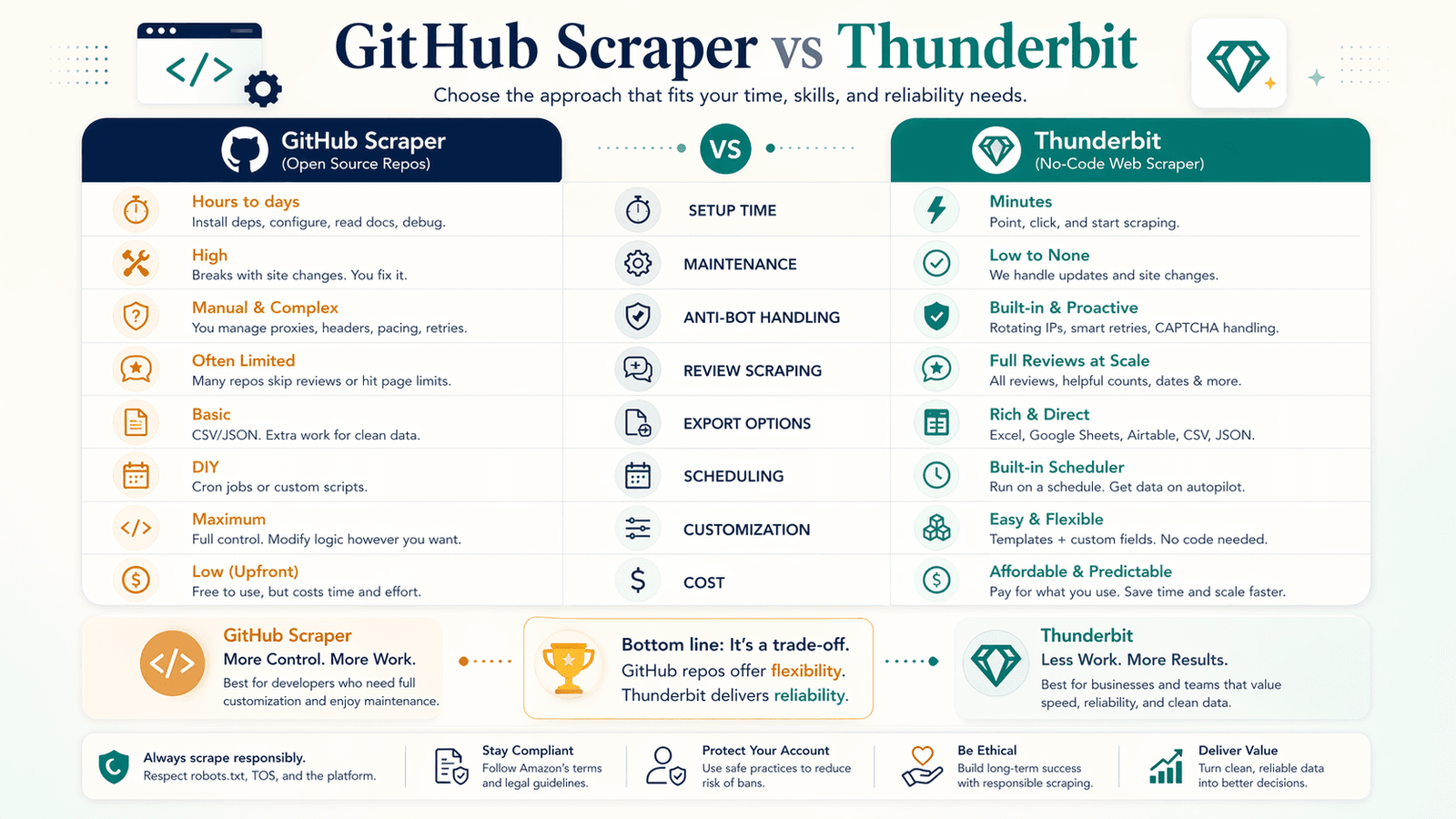

Το Thunderbit ως πρακτική εναλλακτική για Amazon scraper

Το προσφέρει ένα που εξάγει τίτλο, τιμή, ASIN, αξιολογήσεις, brand, διαθεσιμότητα, προέλευση αποστολής και αρχικό URL — χωρίς να γράψετε κώδικα.

Πώς μοιάζει αυτό στην πράξη:

- Scraping με 2 κλικ αντί για ρύθμιση περιβαλλόντων Python, εξαρτήσεων και proxy configs

- Άμεσο Amazon template — χωρίς έξτρα AI overhead, μόνο εξαγωγή με 1 κλικ

- Λειτουργία browser scraping για σελίδες που απαιτούν login (όπως οι σελίδες κριτικών που ταλαιπωρούν τους χρήστες GitHub scrapers)

- Cloud scraping για δημόσιες σελίδες προϊόντων με ταχύτητα (50 σελίδες τη φορά)

- Δωρεάν export σε Google Sheets, Airtable, Notion, Excel — όχι μόνο CSV/JSON

- Scheduled scraper για συνεχή παρακολούθηση τιμών

- Η AI προσαρμόζεται σε αλλαγές διάταξης — μηδενικό βάρος συντήρησης για εσάς

GitHub Amazon Scraper vs. Thunderbit: ειλικρινής σύγκριση

| Παράγοντας | GitHub Scraper (π.χ. AmzPy) | Thunderbit |

|---|---|---|

| Χρόνος ρύθμισης | 15–60 λεπτά (Python, εξαρτήσεις, proxies) | ~2 λεπτά (εγκατάσταση Chrome extension) |

| Συντήρηση | Εσείς διορθώνετε τα σπασίματα | Η AI προσαρμόζεται σε αλλαγές διάταξης |

| Διαχείριση anti-bot | DIY (proxies, headers, TLS) | Ενσωματωμένη (cloud + browser modes) |

| Scraping κριτικών (logged-in) | Πολύπλοκη διαχείριση session | Λειτουργία browser scraping |

| Εξαγωγή δεδομένων | Μόνο CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Προγραμματισμός | DIY (cron, Airflow κ.λπ.) | Ενσωματωμένο scheduled scraper |

| Προσαρμογή | Υψηλότερη | Χαμηλότερη |

| Κόστος | Δωρεάν (συν κόστος proxies) | Διαθέσιμο δωρεάν πλάνο. Σύστημα με credits |

Το ειλικρινές trade-off: τα GitHub repos προσφέρουν μεγαλύτερη προσαρμογή, ενώ το Thunderbit προσφέρει μεγαλύτερη αξιοπιστία. Αν η ομάδα σας νοιάζεται περισσότερο για uptime παρά για ευελιξία, η no-code διαδρομή είναι συνήθως η πιο λογική επιλογή.

Βέλτιστες πρακτικές για προγραμματισμένο και επαναλαμβανόμενο Amazon scraping

Τα περισσότερα amazon scraper github projects φτιάχνονται για μεμονωμένες εκτελέσεις, αλλά τα πραγματικά business use cases — παρακολούθηση τιμών, έλεγχος αποθεμάτων, ανάλυση ανταγωνισμού — απαιτούν επαναλαμβανόμενα scrapes. Τα GitHub repos σχεδόν ποτέ δεν περιλαμβάνουν ενσωματωμένο scheduling, αφήνοντας τους χρήστες να στήνουν μόνοι τους cron jobs, Airflow ή n8n workflows.

DIY scheduling για GitHub Amazon scrapers

Η ελάχιστα βιώσιμη ρύθμιση για επαναλήψεις:

- Cron job σε Linux ή macOS για να τρέχει το script σε πρόγραμμα

- Append-only logs ώστε να μπορείτε να κάνετε debug τις αποτυχίες εκ των υστέρων

- Απο-διπλοποίηση με βάση ASIN + timestamp ώστε να μην αποθηκεύετε διπλά δεδομένα

- Ειδοποιήσεις αποτυχίας (ακόμη και απλό email σε non-zero exit) ώστε να ξέρετε πότε κάτι χάλασε στις 3 το πρωί

Για πιο σύνθετες ομάδες:

- n8n για ελαφρύ workflow automation (αναφέρεται συχνά σε συζητήσεις της κοινότητας)

- Airflow για βαρύτερα scheduled pipelines

- State με βάση database αν χρειάζεστε diffs και ιστορικό

Η βασική βέλτιστη πρακτική δεν είναι ο scheduler καθαυτός — είναι η διαχείριση κατάστασης. Καταγράψτε το τελευταίο επιτυχημένο run, το τελευταίο ASIN set, τις μεταβολές τιμών και τα URLs που απέτυχαν.

Πιο απλό scheduling με το Thunderbit

Το του Thunderbit σας επιτρέπει να περιγράψετε το διάστημα με απλά αγγλικά, να εισαγάγετε URLs και να κάνετε κλικ στο "Schedule." Η AI μετατρέπει τη φυσική γλώσσα σε cron schedule — χωρίς τεχνική ρύθμιση. Για μη τεχνικές ecommerce ομάδες που παρακολουθούν τιμές ή λανσαρίσματα προϊόντων ανταγωνιστών, αυτό σημαίνει ουσιαστική μείωση του λειτουργικού κόστους.

Βέλτιστες πρακτικές για επαναλαμβανόμενα Amazon scrapes

Ισχύουν όποιο εργαλείο κι αν χρησιμοποιείτε:

- Απο-διπλοποίηση με παράθυρο ASIN + timestamp — μην αποθηκεύετε το ίδιο προϊόν δύο φορές ανά run

- Αποθηκεύετε τις τιμές ως αριθμούς, όχι ως raw strings — γλιτώνετε καθάρισμα αργότερα

- Προσθέτετε timestamps scraping σε κάθε γραμμή — θα τα χρειαστείτε για ανάλυση τάσεων

- Παρακολουθείτε μεταβολές, όχι μόνο την τρέχουσα κατάσταση — το «η τιμή έπεσε 12% από την περασμένη εβδομάδα» είναι πιο χρήσιμο από το «η τιμή είναι $24,99»

- Ειδοποιήσεις για ουσιαστικές αλλαγές — πτώση τιμής ανταγωνιστή κατά 15% αξίζει ειδοποίηση· μια διακύμανση 0,5% είναι θόρυβος

- Σκεφτείτε την αποθήκευση δεδομένων — τα flat files αρκούν για μικρές εκτελέσεις· για 5k+ ASINs ημερησίως, σκεφτείτε βάση δεδομένων ή cloud spreadsheet

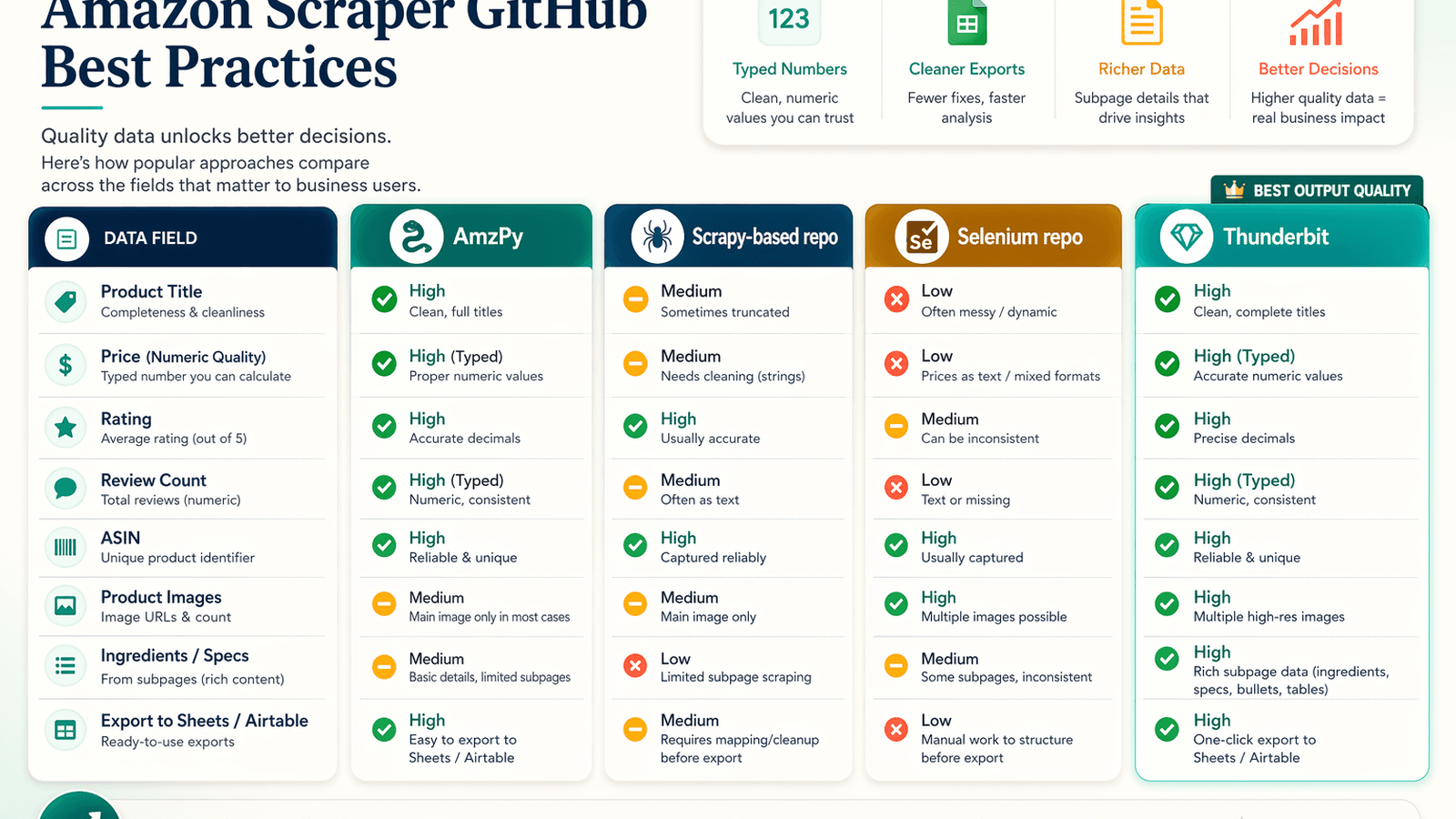

Σύγκριση ποιότητας αποτελέσματος: τι επιστρέφει στην πράξη κάθε προσέγγιση Amazon Scraper GitHub

Κανείς δεν συγκρίνει την πραγματική ποιότητα εξόδου ανάμεσα σε amazon scraper github repos. Οι χρήστες ενδιαφέρονται βαθιά για την ποιότητα δεδομένων — «ποιο εργαλείο δίνει τα πιο καθαρά, πιο πλήρη δεδομένα» — αλλά πρέπει να κάνουν μόνοι τους clone και δοκιμές σε κάθε repo. Αυτή η ενότητα καλύπτει αυτό το κενό.

Τι εξάγουν πραγματικά τα δημοφιλή GitHub repos (και τι χάνουν)

Με βάση δείγματα README, δημόσια παραδείγματα και τεκμηριωμένες μορφές εξόδου:

| Προσέγγιση | Τι εξάγει καθαρά | Συνηθισμένα κενά / ανταλλάγματα |

|---|---|---|

| amzpy | Τίτλος, τιμή, νόμισμα, URL εικόνας, αξιολογήσεις, κριτικές, variants, ASIN | Προσανατολισμένο σε σελίδες προϊόντων· λιγότερο πλούσιο σε πλήρεις κριτικές / ενότητες προδιαγραφών |

| tducret/amazon-scraper-python | CSV με τίτλο, βαθμολογία, αριθμό κριτικών, product URL, image URL, ASIN | Παρωχημένο, εστιασμένο σε listings, αδύναμη ιστορία anti-bot |

| python-scrapy-playbook scraper | Αποτελέσματα αναζήτησης, σελίδες προϊόντων, κριτικές, pipelines CSV/JSON | Επίπεδο tutorial· βασίζεται σε εξωτερικό proxy middleware· πιθανόν να χρειαστεί περισσότερο καθάρισμα |

| omkarcloud/amazon-scraper | Αναζήτηση, κατηγορία, λεπτομέρειες, κορυφαίες κριτικές, πολλές εικόνες/βίντεο/προδιαγραφές | Δεν είναι raw scraper — είναι managed API service |

| Thunderbit Amazon template | Τίτλος, τιμή, ASIN, brand, βαθμολογία, κριτικές, διαθεσιμότητα, προέλευση αποστολής, enrichment υποσελίδων | Λιγότερος έλεγχος σε επίπεδο κώδικα από τα custom scripts |

Πίνακας σύγκρισης ποιότητας εξόδου

| Πεδίο δεδομένων | AmzPy | Repo βασισμένο σε Scrapy | Repo Selenium | Thunderbit |

|---|---|---|---|---|

| Τίτλος προϊόντος | ✅ | ✅ | ✅ | ✅ |

| Τιμή (αριθμητική) | ⚠️ string | ✅ | ⚠️ string | ✅ (τύπος αριθμού) |

| Βαθμολογία | ✅ | ✅ | ✅ | ✅ |

| Αριθμός κριτικών | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Εικόνες προϊόντος | ❌ | ⚠️ μόνο thumbnail | ✅ | ✅ (υψηλής ανάλυσης, εξαγώγιμες) |

| Συστατικά/προδιαγραφές | ❌ | ❌ | ❌ | ✅ (μέσω scraping υποσελίδων + AI) |

| Export σε Sheets/Airtable | ❌ | ❌ | ❌ | ✅ δωρεάν |

Γιατί η μορφοποίηση δεδομένων έχει σημασία για τους business users

Τα ακατάστατα δεδομένα δημιουργούν κρυφή εργασία. Ακόμη κι ένας επιτυχημένος scraper μπορεί να είναι επιχειρησιακή αποτυχία αν:

- Οι τιμές είναι strings με σύμβολα νομίσματος αντί για καθαρούς αριθμούς

- Οι ελλείπουσες τιμές είναι ασυνεπείς (κενή συμβολοσειρά vs. null vs. "N/A")

- Οι εικόνες είναι μόνο χαμηλής ανάλυσης thumbnails

- Τα πεδία κριτικών ή προδιαγραφών χρειάζονται post-processing πριν την ανάλυση

Για τις ομάδες ecommerce ops, τα καθαρά δεδομένα επηρεάζουν άμεσα την ταχύτητα ανάλυσης και τη λήψη αποφάσεων. Η AI του Thunderbit μορφοποιεί τα δεδομένα ανά τύπο — αριθμούς ως αριθμούς, ημερομηνίες ως ημερομηνίες, URLs ως URLs — ώστε να είναι έτοιμα προς χρήση αμέσως. Τα GitHub repos διαφέρουν πολύ σε αυτό το σημείο, και ο χρόνος καθαρισμού αυξάνεται γρήγορα.

Γρήγορο checklist: βέλτιστες πρακτικές Amazon Scraper GitHub

- Ελέγξτε την ημερομηνία τελευταίου commit πριν κάνετε clone. Παλαιότερο από έξι μήνες είναι σοβαρή προειδοποίηση για την Amazon.

- Αναζητήστε issues για "captcha," "503," "blocked" και "not working" πριν τη ρύθμιση.

- Προτιμήστε

curl_cffiή άλλον HTTP client που μιμείται browser αντί για απλάrequests. - Κρατήστε headers, TLS profile, γλώσσα και γεωγραφία proxy συνεπή — χωρίς αντιφάσεις.

- Χρησιμοποιήστε sticky sessions για ροές περιήγησης· μην κάνετε blind rotation σε κάθε αίτημα.

- Προσθέστε τυχαίο ρυθμό και exponential backoff.

- Αντιμετωπίστε τα επαναλαμβανόμενα CAPTCHA ως καμένη συνεδρία, όχι ως γρίφο για brute-force.

- Χρησιμοποιήστε headless browsers μόνο όταν οι HTTP clients δεν μπορούν να αναπαράγουν αξιόπιστα τη σελίδα.

- Αποθηκεύστε checkpoints και state ώστε οι αποτυχημένες εκτελέσεις να συνεχίζονται με ασφάλεια.

- Έχετε σχέδιο εφεδρείας — είτε αυτό είναι managed API είτε ένα no-code εργαλείο όπως το .

Νομικές και ηθικές παραμέτρους για Amazon scraping το 2026

Λίγα πράγματα που αξίζει να γνωρίζετε, συνοπτικά.

Η στάση της Amazon είναι περιοριστική και γίνεται όλο και περισσότερο. Τα ισχυρότερα σημάδια:

- Οι δικές της σελίδες βοήθειας της Amazon επιστρέφουν πλέον μια που λέει: "To discuss automated access to Amazon data please contact api-services-support@amazon.com."

- Το της Amazon απαγορεύει ένα ευρύ φάσμα δυναμικών διαδρομών, διαδρομών κριτικών, προφίλ, wishlist και offer-listing.

- Η αντιτίθεται ρητά στην κρυφή ή συγκαλυμμένη πρόσβαση από agents, στην παράκαμψη μέτρων ασφαλείας και στην ψευδή αναγνώριση ενός agent ως Google Chrome. Η Amazon επίσης για το περιστατικό.

- Η Amazon απέναντι σε crawlers της OpenAI στα τέλη του 2025.

Ο πρακτικός κίνδυνος είναι σαφώς μεγαλύτερος όταν περνάτε από δημόσιες σελίδες προϊόντων σε authenticated flows, συγκαλυμμένο automation ή εμπορική εξαγωγή μεγάλου όγκου. Αυτό δεν αποτελεί νομική συμβουλή — συμβουλευτείτε τη νομική σας ομάδα για τη δική σας περίπτωση.

Βασικά συμπεράσματα: αξιόπιστα δεδομένα Amazon χωρίς αποκλεισμό

Με σειρά προτεραιότητας:

- Κάντε audit πριν κάνετε clone. Υποθέστε ότι τα περισσότερα αποτελέσματα στο GitHub είναι παρωχημένα, tutorials ή wrappers γύρω από εμπορικά APIs.

- Αναβαθμίστε πρώτα το network layer. Το TLS fingerprinting και η συνοχή της συνεδρίας μετράνε περισσότερο από τα HTML selectors.

- Χρησιμοποιήστε sticky residential sessions, όχι τυχαίο χάος από proxies. Κάντε rotation μεταξύ sessions, όχι μέσα σε αυτές.

- Ρυθμίστε τα αιτήματα όπως ένας χρήστης, όχι όπως stress test. Οι τυχαίες καθυστερήσεις και το exponential backoff δεν είναι διαπραγματεύσιμα.

- Λύνετε τα μεμονωμένα CAPTCHA· εγκαταλείπετε τις συνεδρίες με επαναλαμβανόμενα challenges. Μην επιχειρείτε brute-force σε καμένο fingerprint.

- Έχετε fallback. Η Amazon θα αλλάξει κάτι μέσα στην εβδομάδα και ο GitHub scraper σας θα χαλάσει. Ένα συντηρούμενο no-code εργαλείο όπως το ή ένα managed API μπορεί να κρατήσει ζωντανό το pipeline δεδομένων ενώ εσείς κάνετε debugging.

- Δώστε προτεραιότητα στην ποιότητα εξόδου. Καθαρά, τυποποιημένα δεδομένα σας γλιτώνουν περισσότερο χρόνο downstream από έναν γρήγορο αλλά ακατάστατο scraper.

Αν θέλετε αξιοπιστία αντί για προσαρμογή, το Thunderbit προσφέρει μια συντηρούμενη εναλλακτική — δείτε το ή παρακολουθήστε tutorials στο . Οι developers που θέλουν πλήρη έλεγχο μπορούν απολύτως να χρησιμοποιήσουν GitHub repos — αλλά μόνο με τις πρακτικές anti-ban και συντήρησης που καλύπτονται σε αυτόν τον οδηγό.

Συχνές ερωτήσεις

Είναι νόμιμο να κάνω scraping δεδομένων προϊόντων Amazon με scraper από το GitHub;

Οι Όροι Χρήσης της Amazon περιορίζουν τη συλλογή δεδομένων με αυτοματοποίηση, και η Amazon έχει επιβάλει ενεργά αυτόν τον περιορισμό μέσω επιστολών cease-and-desist και τεχνικών αντιμέτρων (ιδίως το 2025-2026). Το scraping δημόσια διαθέσιμων δεδομένων προϊόντων βρίσκεται σε γκρίζα ζώνη· το scraping πίσω από login ή η μεταμφίεση του bot σας σε πραγματικό browser ενέχουν μεγαλύτερο ρίσκο. Αυτό δεν αποτελεί νομική συμβουλή — συμβουλευτείτε τη νομική σας ομάδα για τη συγκεκριμένη χρήση σας.

Πόσο συχνά χαλάνε τα GitHub repos για Amazon scraper;

Πολύ συχνά. Η Amazon αλλάζει διατάξεις σελίδων, προσθέτει νέες στρώσεις anti-bot και καταργεί endpoints σε τακτική βάση. Στον έλεγχο για αυτό το άρθρο, μόνο περίπου 3 από τα 8 ευρέως εμφανιζόμενα repos λειτουργούσαν ξεκάθαρα το 2026. Ακόμη και τα repos που «δουλεύουν» έχουν συχνά ανοιχτά issues για CAPTCHA και σφάλματα 503. Περιμένετε να κάνετε troubleshooting ή να ενημερώνετε το setup σας κάθε λίγες εβδομάδες έως μήνες.

Ποιο είναι το καλύτερο Amazon scraper στο GitHub το 2026;

Δεν υπάρχει ένας ξεκάθαρος νικητής — εξαρτάται από το use case και την τεχνική σας άνεση. Για έναν ελαφρύ, άμεσο Python scraper, το είναι μία από τις πιο ενημερωμένες επιλογές. Για ευρύτερη κάλυψη μέσω managed API, το λειτουργεί, αλλά δεν είναι πραγματικά DIY. Εφαρμόστε το checklist φρεσκάδας αυτού του άρθρου για να αξιολογήσετε μόνοι σας οποιοδήποτε repo πριν δεσμευτείτε.

Μπορεί το Thunderbit να κάνει scraping Amazon χωρίς κώδικα;

Ναι. Το του Thunderbit εξάγει τίτλο προϊόντος, τιμή, ASIN, αξιολογήσεις, brand, διαθεσιμότητα και πολλά ακόμη με ένα μόνο κλικ. Υποστηρίζει λειτουργία browser scraping για σελίδες που απαιτούν login, cloud scraping για δημόσιες σελίδες με ταχύτητα, scheduled scraping για επαναλαμβανόμενες εργασίες και δωρεάν export σε Google Sheets, Airtable, Notion και Excel. Μπορείτε να ξεκινήσετε εγκαθιστώντας το .

Πώς αποφεύγω να μου μπλοκάρουν το IP όταν κάνω scraping στην Amazon;

Χρησιμοποιήστε πολυεπίπεδη προσέγγιση: (1) περάστε από τα απλά requests σε client που μιμείται TLS, όπως το curl_cffi, (2) χρησιμοποιήστε residential proxies με sticky sessions αντί για τυχαίο datacenter rotation, (3) προσθέστε τυχαίο ρυθμό και exponential backoff, (4) κρατήστε το πλήρες set headers συνεπές με το browser profile και το locale του marketplace, και (5) θεωρήστε τα επαναλαμβανόμενα CAPTCHA σήμα ότι πρέπει να εγκαταλείψετε τη συνεδρία, όχι γρίφο που θα λύνετε επ’ άπειρον. Για περισσότερες λεπτομέρειες, δείτε τον πίνακα αποφάσεων anti-ban νωρίτερα στο άρθρο.