Jeg skulle holde øje med 200+ nyhedskilder for at spotte trending artikler. Manuelt? Det er ærligt talt et fuldtidsjob. En klassisk scraper til nyhedsartikler? Den gik i stykker hver eneste gang et site lige lavede en lille layout-ændring.

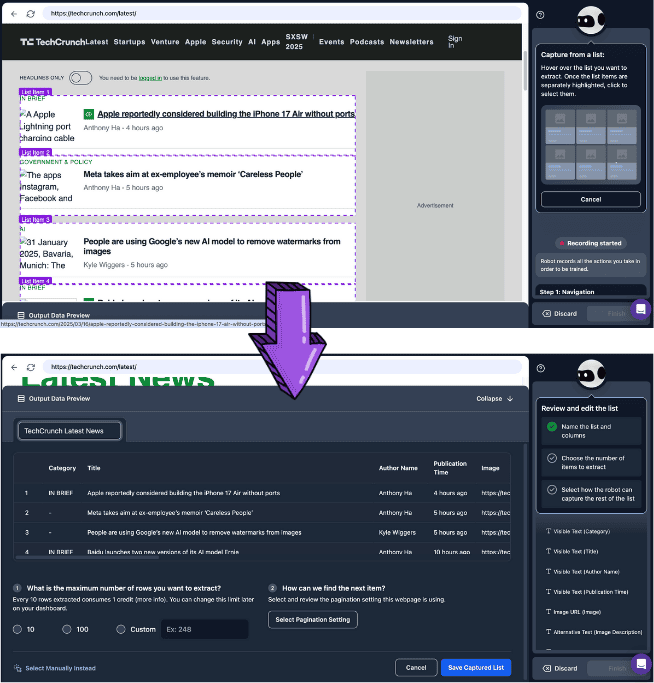

Så testede jeg AI-drevne artikel-scraper-løsninger. Ét klik, pænt strukturerede data, og nul bøvl med CSS-selectors. Forskellen var nat og dag.

Hvis du er journalist, SEO-specialist eller researcher og skal hente artikler i stor skala, kan den her sammenligning spare dig for en masse trial-and-error. Jeg har prøvet både traditionelle no-code værktøjer og AI-løsninger — her er det, der faktisk virker i praksis.

TL;DR

| Fordele | Ulemper | Bedst til | |

|---|---|---|---|

| AI Article Scraper | - Kan scrape flere websites med høj præcision - Fjerner automatisk støj - Tilpasser sig ændringer i webstruktur - Understøtter dynamisk indlæsning af indhold - Lavere omkostning til datarensning | - Højere beregningsomkostning - Længere behandlingstid - Nogle sider kan kræve manuel hjælp - Kan udløse anti-scraping-mekanismer | - Scraping af komplekse eller dynamiske sites (fx nyhedsportaler, sociale medier) - Dataindsamling i stor skala |

| Traditionel no-code Article Scraper | - Hurtig eksekvering - Lavere pris - Lavt forbrug af server- og lokale ressourcer - Høj grad af kontrol | - Kræver hyppig vedligeholdelse ved ændringer i webstruktur - Kan ikke scrape flere sites på én gang - Kan ikke håndtere dynamisk indhold - Høj omkostning til datarensning | - Hurtig scraping i stor skala af simple, statiske websider - Begrænsede compute-ressourcer og stramt budget |

Hvad er en Article Scraper? Hvorfor er en AI Article Scraper vigtig?

En er en type , der kan finde og hente info som titler, forfattere, udgivelsesdatoer, brødtekst, keywords, billeder og videoer fra nyhedssites — og samle det i strukturerede formater som JSON, CSV eller Excel.

bygger typisk på for at trække indhold ud fra en sides -struktur. Men den metode har nogle ret tydelige begrænsninger:

- Mangler generalisering: Forskellige webstrukturer kræver forskellige pr. site, og så snart strukturen ændrer sig, stopper de ofte med at virke — hvilket betyder løbende vedligehold og opdateringer.

- Svært ved dynamisk indhold: Mange sites loader indhold via AJAX eller JavaScript, som ikke kan hente direkte.

- Begrænset databehandling: kan som regel kun hente rå -fragmenter — uden efterfølgende rensning, formatering, semantisk analyse eller sentiment-analyse.

Her kommer ind i billedet.

Her kommer ind i billedet.

-

Teknologien bruger LLM til at forstå websider, hvilket giver:

- Intelligent genkendelse: Spotter titler, forfattere, resuméer og hovedindhold.

- Automatisk fjernelse af støj: Skelner mellem hovedindhold og navigation, annoncer og relaterede artikler — bedre datakvalitet og mere effektiv scraping.

- Robusthed over for ændringer: Selv hvis struktur eller styling ændrer sig, kan AI ofte fortsætte via semantisk forståelse og visuelle signaler.

- Kan bruges på tværs af sites: I modsætning til kan AI-scrapere ofte bruges på mange forskellige sites uden manuel finjustering.

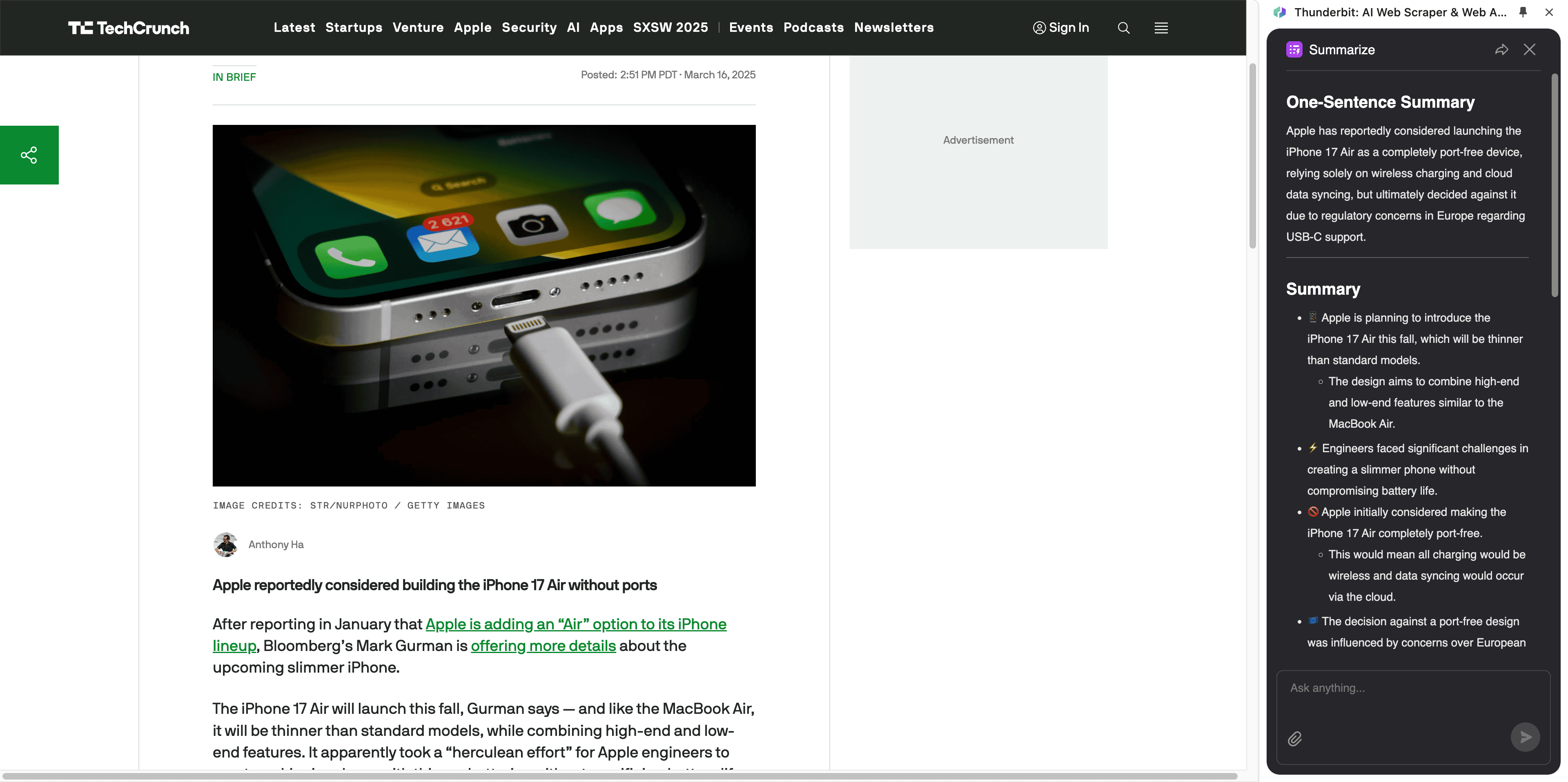

- Kobling til NLP og deep learning: Kan også klare opgaver som oversættelse, opsummering og sentiment-analyse.

Hvad kendetegner den bedste Article Scraper i 2026?

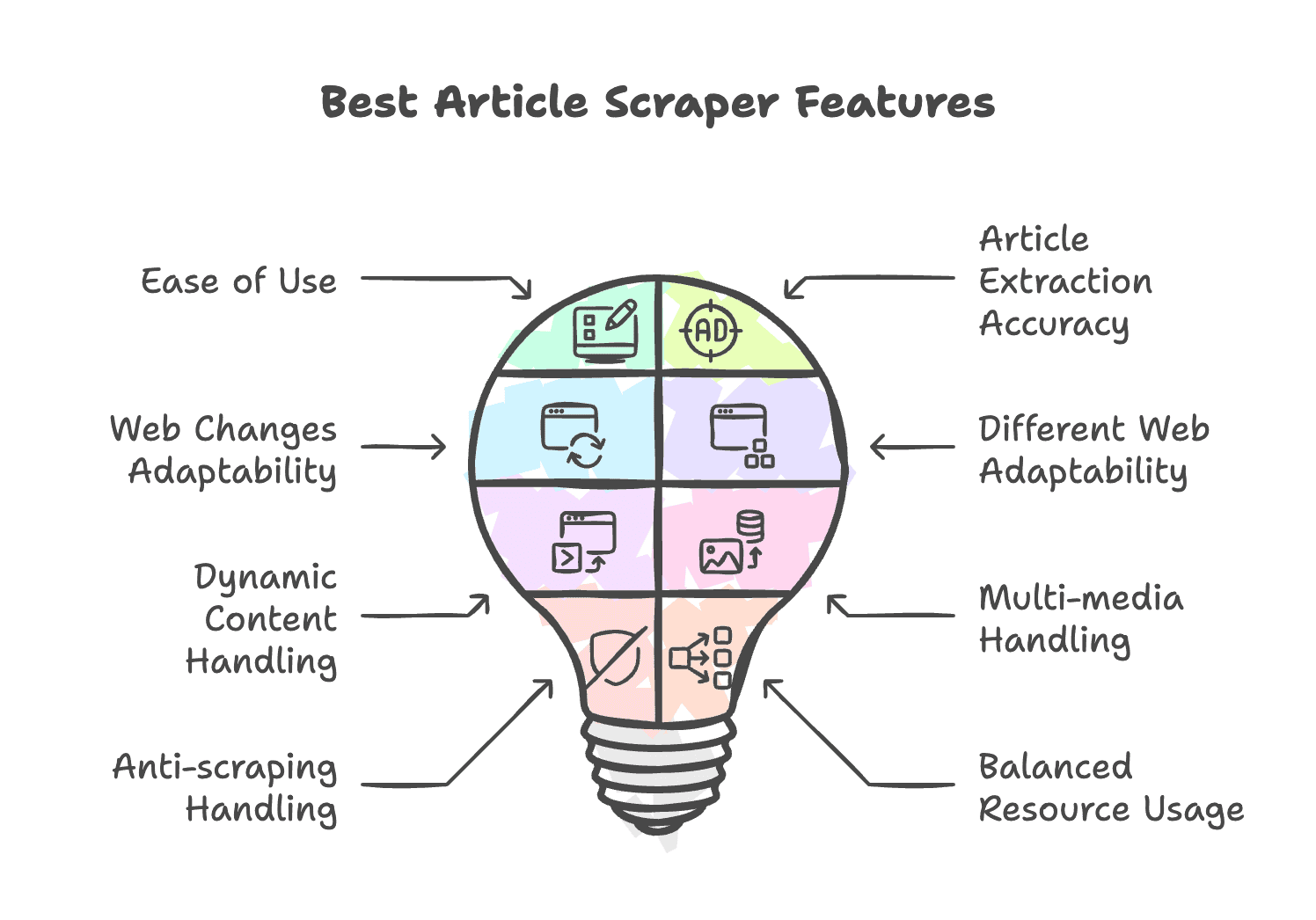

En virkelig stærk article scraper handler om at ramme den rigtige balance mellem performance, pris, brugervenlighed, fleksibilitet og skalerbarhed. Her er de vigtigste kriterier, når du skal vælge den bedste article scraper i 2026:

- Brugervenlighed: Et intuitivt interface, hvor du ikke behøver kode.

- Præcision i artikeludtræk: Finder de rigtige felter uden annoncer og navigation.

- Tilpasning til webændringer: Kan håndtere ændringer i struktur eller styling uden konstant vedligehold.

- Tilpasning på tværs af websites: Fungerer på mange forskellige webstrukturer.

- Håndtering af dynamisk indhold: Understøtter JavaScript- eller AJAX-indlæsning.

- Multimedie-understøttelse: Genkender billeder, video og lyd.

- Håndtering af anti-scraping: IP-rotation, CAPTCHA-løsninger og proxies til at omgå blokeringer.

- Balanceret ressourceforbrug: Bruger ikke unødigt meget hukommelse og compute.

De bedste Article & News Scraper-værktøjer — overblik

| Værktøjer | Nøglefunktioner | Bedst til | Pris |

|---|---|---|---|

| Thunderbit | AI-drevet scraper; færdige templates; understøtter scraping af pdf, billeder & docs; avanceret databehandling | Ikke-tekniske brugere, der skal scrape flere niche-sites | 7 dages gratis prøveperiode, fra $9/md (årsplan) |

| WebScraper.io | Browser-extension; understøtter dynamisk indhold; mangler proxy-integration | Brugere, der ikke arbejder med komplekse sider eller avancerede behov | 7 dages gratis prøveperiode, fra $40/md (årsplan) |

| Browse.ai | No-code scraper og monitor; pre-built robots; virtuel browser; flere pagination-metoder; stærke integrationer | Virksomheder med behov for scraping af komplekse sites i stor skala | $19/md (årsplan) |

| Octoparse | No-code scraper baseret på CSS selector; auto-detect og genererer scraping-flow; pre-built article scraper templates; virtuel browser; anti-anti-scraping | Teams, der skal scrape komplekse sites | Fra $99/md (årsplan) |

| Bardeen | Bred web-automatisering; pre-built templates; no-code scraper; tæt integration med workspace | GTM-teams, der vil indbygge artikel-scraping i eksisterende workflows | 7 dages gratis prøveperiode, fra $99/md (årsplan) |

| PandaExtract | Brugervenligt UI; automatisk detektion og labeling | Hurtig one-click udtræk uden tung opsætning | $49 LTD |

Den mest kraftfulde AI Article Scraper til business-brugere

- Fordele:

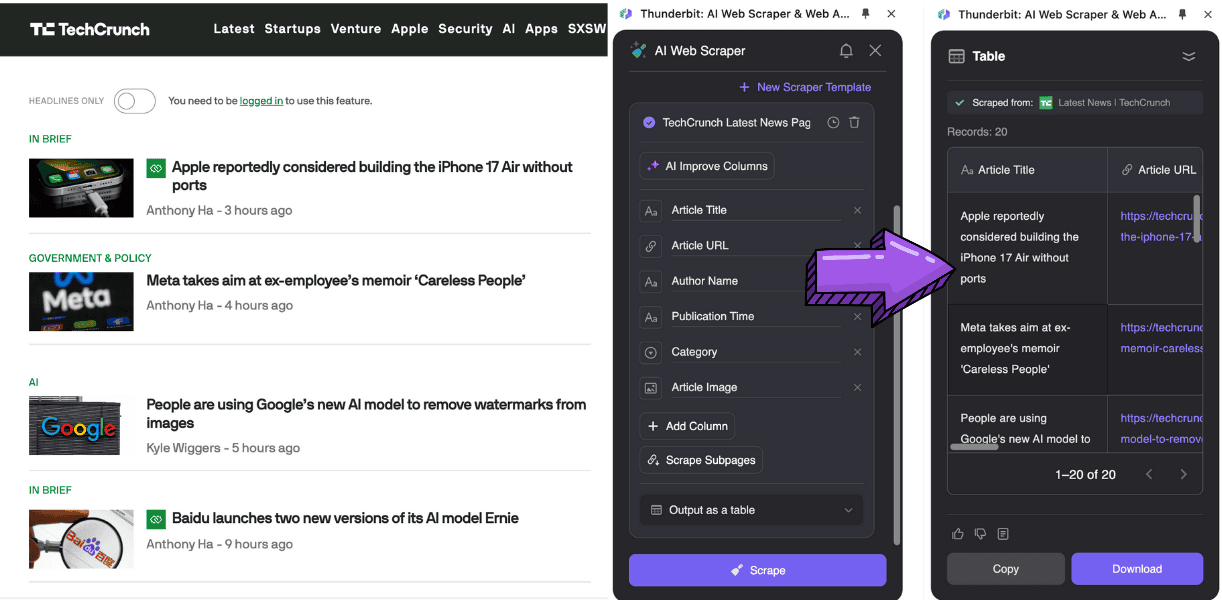

- Bruger naturligt sprog til at få AI til at genkende og analysere webindhold — uden CSS selectors

- AI-assisteret databehandling, inkl. formatkonvertering, , klassificering, oversættelse og tagging

- til one-click scraping af artikellister og fulde artikler

- Ulemper:

- Findes i øjeblikket kun som

- Ikke ideel til scraping i ekstrem stor skala

- Langsommere ved scraping af mange sider, men kan køre i baggrunden for hurtigere samlet workflow

En AI-drevet Article Scraper til enterprise-brug

Browse.ai

- Fordele:

- No-code article scraper og monitor

- Understøtter virtuel browser, så man lettere undgår at trigge anti-scraping

- Mange pre-built scraping-robots til one-click scraping af bl.a. , , m.fl.

- Tæt integration med platforme som og til at koble værktøjer sammen

- Ulemper:

- Deep extract kræver ofte to robots, hvilket gør opsætningen mere kompleks

- CSS selectors er ikke altid præcise nok til niche-sites

- Dyrt — passer bedst til løbende scraping i stor skala

En no-code scraper til mindre dataudtræk

PandaExtract

- Fordele:

- Finder automatisk artikellister og detaljer i et brugervenligt interface

- Kan udtrække lister, detaljer, emails og billeder — velegnet til mindre, struktureret scraping

- Engangsbetaling med livstidsadgang

- Ulemper:

- Kun som browser-extension — kan ikke køre i cloud

- Gratisversionen understøtter kun kopiering, ikke eksport til CSV, JSON osv.

En “out-of-the-box” Article Scraper til organisationer

Octoparse

- Fordele:

- No-code article scraper med auto-detect, der genkender webstruktur og genererer scraping-workflow

- Mange pre-built article scraper templates, klar til brug

- Virtuel browser med IP-rotation, CAPTCHA-løsninger og proxies til at omgå anti-scraping

- Ulemper:

- Auto-detect bygger stadig på CSS selector-logik, så præcisionen er middel

- Avancerede funktioner kræver indlæring og tekniske kompetencer

- Høj pris ved scraping i stor skala

Den mest komplette automatisering til GTM-teamet

Bardeen

- Fordele:

- No-code article scraper, der bruger LLM til one-click automatisering

- Integrerer med 100+ apps, bl.a. , og

- Stærke web-automationsværktøjer til AI-analyse efter scraping

- God til at indbygge scraping i eksisterende workflows

- Ulemper:

- Afhænger meget af pre-built playbooks; custom workflows kræver ofte trial-and-error

- Selvom det er no-code, kan kompleks automatisering kræve tid at lære for ikke-tekniske brugere

- Opsætning af subpage extract er kompleks

- Meget dyr

En letvægts Article Scraper til hurtig dataudtræk

Webscraper.io

- Fordele:

- No-code scraper med point-and-click interface

- Understøtter dynamisk indlæsning af indhold

- Cloud-baseret drift

- Integrerer med , og

- Ulemper:

- Ingen pre-built templates — kræver, at du bygger sitemap selv

- Stejlere læringskurve for brugere, der ikke kender CSS selectors

- Pagination og subpage extraction kan være besværligt at sætte op

- Cloud-versionen er dyr

Mere avancerede løsninger til ingeniører

Hvis du har teknisk baggrund, findes der også . De giver typisk:

- Fleksibilitet: Direkte API-kald til custom scraping, inkl. dynamisk rendering og IP-rotation

- Skalerbarhed: Kan indgå i egne datapipelines til enterprise-behov med høj frekvens og store datamængder

- Lavere vedligeholdelse: Du slipper ofte for selv at håndtere proxy pools og anti-scraping-strategier, hvilket sparer driftstid

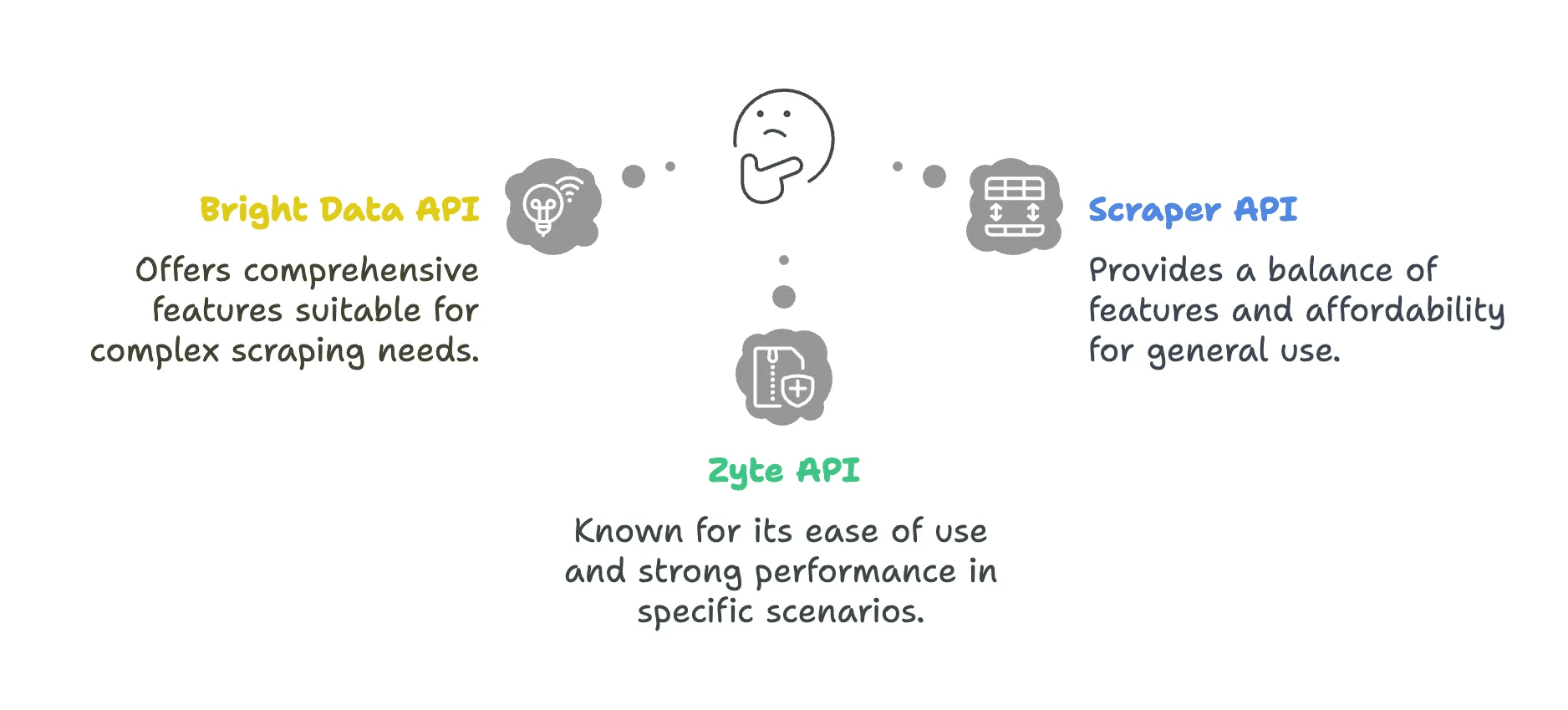

API-løsninger — overblik

| API | Fordele | Ulemper |

|---|---|---|

| Bright Data API | - Meget stort proxy-netværk (72M+ IP’er i 195 lande) - Avanceret geo-targeting helt ned på by/ZIP-niveau - Solid Proxy Manager til IP-rotation | - Langsommere svartider (22,08s i snit) - Høj pris, mindre egnet til små teams - Stejlere læringskurve ved opsætning |

| ScraperAPI | - Lavere startniveau fra $49 - Autoparse til automatisk dataudtræk - Web UI player til test | - Tager ofte betaling for blokerede requests - Begrænsede muligheder for JavaScript-rendering - Omkostninger kan stige med premium-parametre |

| Zyte API | - AI-parsing - Tager ikke betaling for fejlede requests | - Højere startomkostning (~$450/md) - Credits overføres ikke fra måned til måned |

- Bright Data Web Scraper API

- Fordele:

- Dækker 195 lande med 72M+ residential IP’er, understøtter automatisk IP-rotation og geo-simulering — godt til sites med hård anti-scraping (fx , )

- Understøtter JavaScript-dynamisk indlæsning og kan tage page snapshots

- Ulemper:

- Høj pris (afregnes pr. request og båndbredde) — lav værdi for små projekter

- Fordele:

- Scraper API

- Fordele:

- Globalt netværk med 40M proxies, automatisk skift mellem datacenter/residential IP, omgår Cloudflare-verifikation og kan integrere tredjeparts CAPTCHA-løsninger (fx )

- Strukturerede endpoints og asynkrone scrapere for højere hastighed

- Ulemper:

- Ekstra betaling for dynamisk rendering; begrænset støtte til komplekse AJAX-sites

- Fordele:

- Zyte API

- Fordele:

- AI-drevet automatisk webdataudtræk — du slipper for at udvikle og vedligeholde regler pr. site

- Fleksibel pay-as-you-go-pris

- Ulemper:

- Avancerede funktioner (fx session handling og scriptable browser) kræver indlæring

- Fordele:

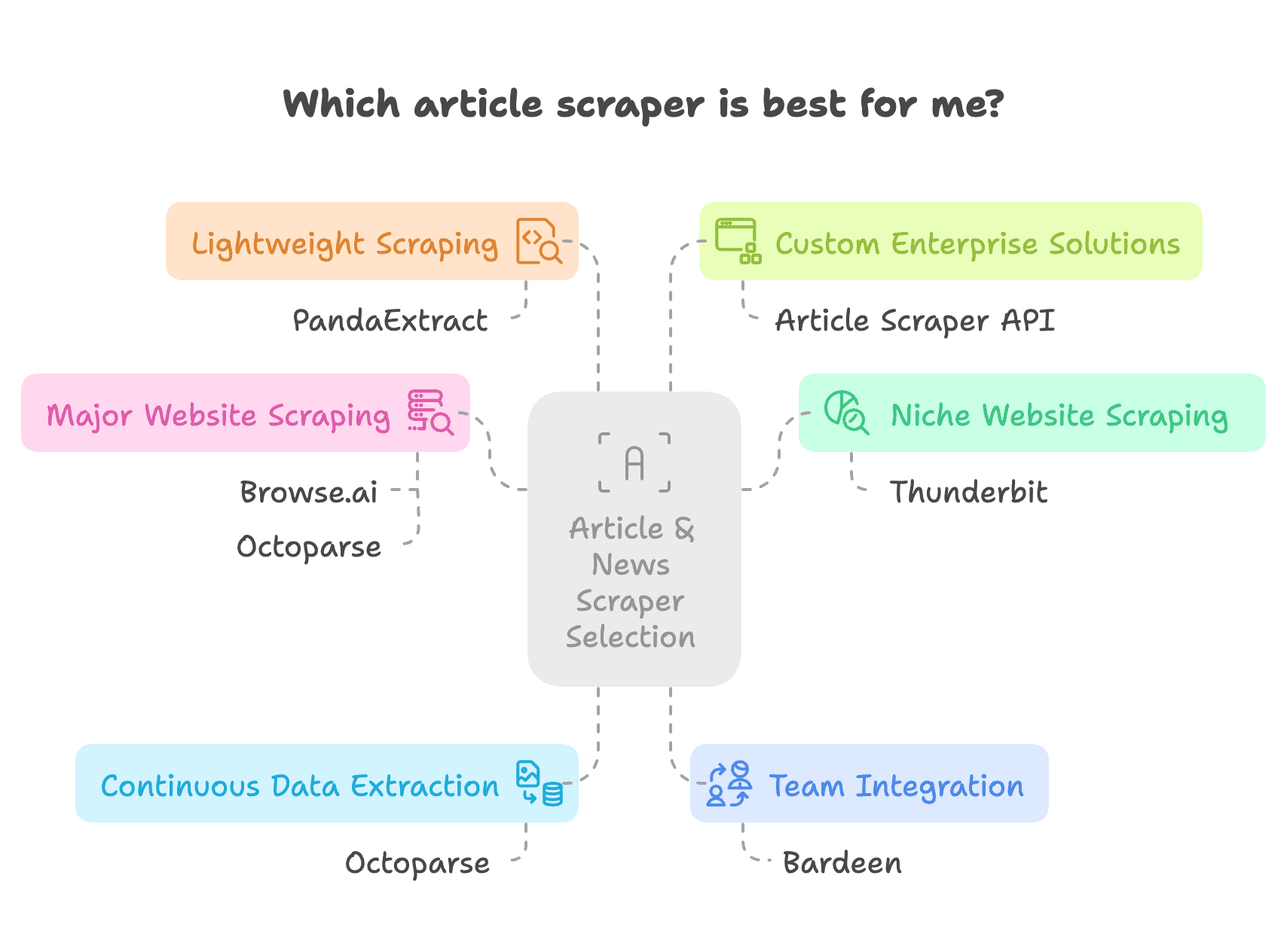

Sådan vælger du din Article & News Scraper

Når du vælger en article & news scraper, giver det mening at tage udgangspunkt i dit behov, dit tekniske niveau og dit budget.

- Hvis du skal scrape mange niche-sites uden at bygge en scraper til hver side, og budgettet kan bære det, er det stærkeste valg. Den bygger ikke på , men bruger AI til at forstå webstrukturen og gør det nemt at lave AI-analyse efter scraping. For Thunderbit AI ligner websites hinanden, så den kan fange hele artikler mere præcist.

- Skal du scrape nyheder og artikler fra store sites som eller , har du brug for stærke anti-scraping-funktioner og pre-built templates, fx Browse.ai eller Octoparse. Men en Chrome extension som er ofte den bedste løsning: Scraping-processen minder om almindelig browsing og kopiering, og du kan bruge login uden tung opsætning.

- Har du behov for kontinuerlig scraping i stor skala, er værktøjer med planlægning (scheduling) som Octoparse ofte et bedre match.

- Til teams og nem integration i eksisterende workflows er Bardeen oplagt, fordi platformen rækker længere end artikel-scraping og tilbyder bred web-automatisering.

- Vil du have en let og hurtig løsning til mindre dataudtræk uden at bruge tid på at lære et nyt værktøj, så vælg en point-and-click scraper som PandaExtract.

- Har du teknisk baggrund eller bygger en enterprise-løsning, så overvej API-værktøjer eller at bygge din egen scraper som supplement til disse .

Konklusion

Denne artikel gennemgik, hvad article & news scrapers er, og hvilke forretningsscenarier de passer til. er baseret på og kræver typisk kendskab til web og — især når du skal noget mere avanceret. Den nye generation af bygger derimod på AI’s semantiske forståelse og visuelle genkendelse og slår ofte på robusthed over for layoutændringer, generalisering på tværs af sites, håndtering af dynamisk indhold samt efterfølgende datarensning og analyse.

Artiklen listede også seks nyttige article & news scrapers samt API-værktøjer til udviklere og sammenlignede deres fordele/ulemper, passende dataskala, webkrav og målgrupper. Når du vælger løsning til article & news scraping, handler det om at finde det match, der passer til dine behov — og samtidig holde balancen mellem performance og omkostninger.

FAQs

1. Hvad er en AI article scraper, og hvordan fungerer den?

- Bruger AI til at analysere og udtrække indhold fra websider uden CSS selectors.

- Finder titler, forfattere, udgivelsesdatoer og hovedindhold med høj præcision.

- Fjerner automatisk annoncer, navigationsmenuer og andre irrelevante elementer.

- Tilpasser sig ændringer i webstruktur og kan bruges på tværs af forskellige websites.

2. Hvad er fordelene ved en AI-drevet article scraper frem for traditionelle scrapere?

- Kan udtrække indhold fra mange websites med ét værktøj.

- Håndterer dynamisk indhold, inkl. JavaScript- og AJAX-sider.

- Kræver mindre manuel opsætning og vedligehold end CSS-baserede scrapere.

- Tilbyder ekstra funktioner som opsummering, oversættelse og sentiment-analyse.

3. Kan jeg bruge Thunderbit til AI article scraping uden kodeerfaring?

- Ja. Thunderbit er lavet til ikke-tekniske brugere med et enkelt no-code interface.

- AI registrerer automatisk og udtrækker artikelindhold.

- Du får pre-built templates til hurtig og effektiv scraping.

- Data kan eksporteres til flere formater som CSV, JSON og Google Sheets.

Læs mere: