“Du kan have data uden information, men du kan ikke have information uden data.” — *

Nye estimater tyder på, at der er over websites på internettet, og at der bliver lagt omkring 2 millioner nye opslag op hver dag. Det enorme hav af data rummer værdifulde indsigter, som kan hjælpe med beslutninger, men der er et problem: omkring af det er ustruktureret, hvilket betyder, at det skal bearbejdes, før det for alvor kan bruges. Det er her webscraping-værktøjer kommer ind i billedet og bliver afgørende for alle, der vil udnytte online data.

Hvis du er ny inden for webscraping, kan begreber som og godt virke lidt afskrækkende. Men i AI’ens tidsalder er de udfordringer meget nemmere at komme udenom. Nutidens AI-drevne scraping-værktøjer kan hjælpe dig i gang, uden at du behøver dyb teknisk viden. De gør det muligt at indsamle og bearbejde data hurtigt, og der kræves ingen kodningsfærdigheder.

De bedste Web Scraping-værktøjer og software

- til en brugervenlig AI web scraper med de bedste resultater

- til overvågning i realtid og masseudtræk af data

- til no-code automatisering med omfattende app-integrationer

- til mere professionel visuel webscraping

- til kraftfuld no-code scraping, der undgår IP-blokering og bot-detektion

- til avanceret AI-drevet dataudtræks-API og knowledge graphs

Prøv AI til webscraping

Prøv det! Du kan klikke, udforske og køre workflowet, mens du ser med.

Hvordan fungerer webscraping?

Webscraping handler i bund og grund om at hente data fra websites. Du giver et værktøj et sæt instruktioner, og så går det i gang med at trække tekst, billeder eller det, du har brug for, ind i en tabel fra en webside. Det kan bruges til alt fra at følge priser på e-handelswebsites til at indsamle forskningsdata eller bare bygge et solidt Excel-ark eller Google Sheets.

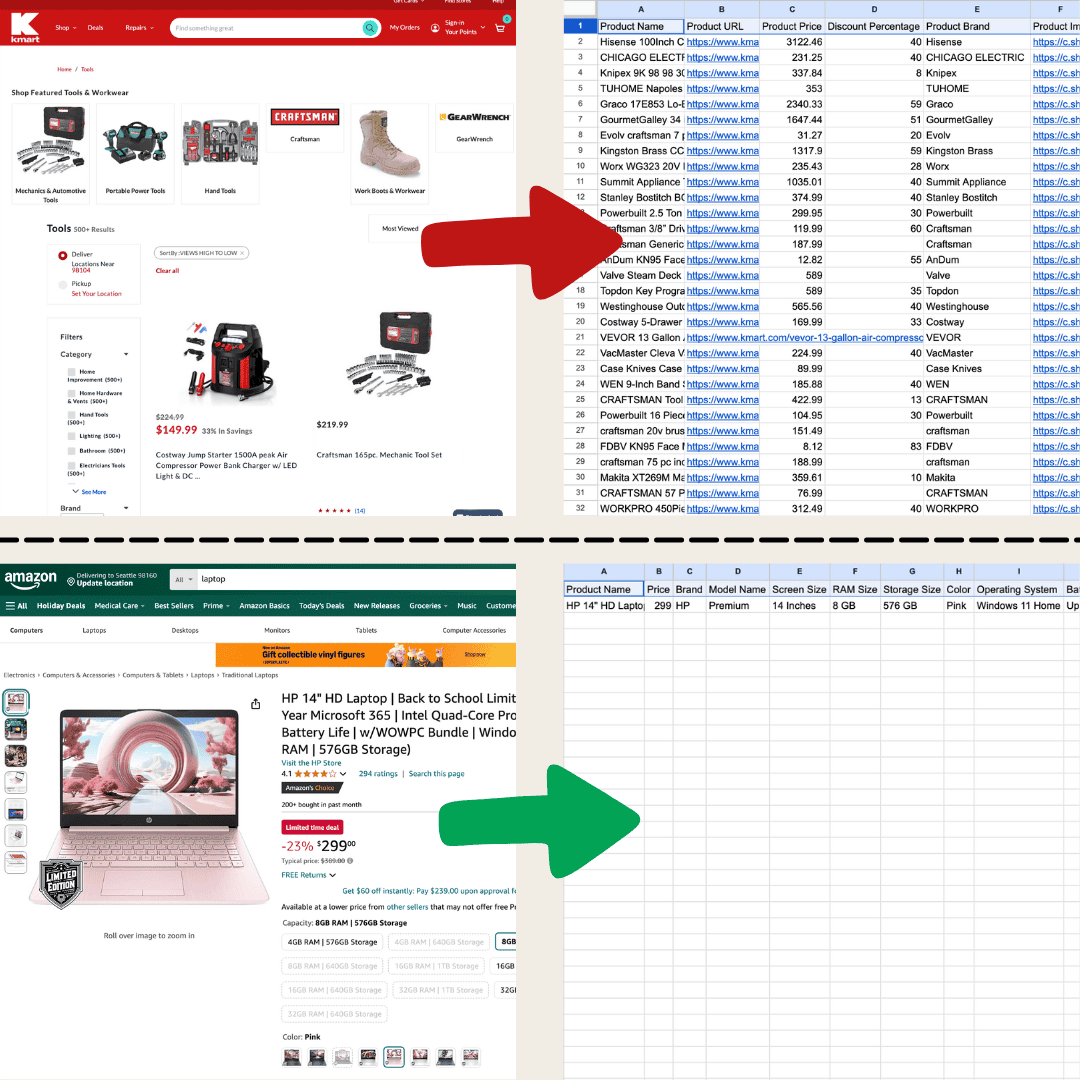

Jeg lavede dette med Thunderbit ved hjælp af AI Web Scraper.

Jeg lavede dette med Thunderbit ved hjælp af AI Web Scraper.

Der er flere måder at gøre det på. På det mest grundlæggende niveau kunne du bare selv kopiere og indsætte, men det er meget arbejde, hvis der er store datamængder. Derfor bruger de fleste én af tre metoder: traditionelle webscrapere, AI webscrapere eller specialkode.

Traditionelle webscrapere fungerer ved at sætte specifikke regler for, hvilke data der skal hentes, baseret på sidens struktur. Du kan for eksempel indstille den til at hente produktnavne eller priser fra bestemte HTML-tags. De fungerer bedst på websites, der ikke ændrer sig særligt ofte, fordi selv små layoutændringer betyder, at du må ind og justere din scraper.

Det tager lang tid at lære at bruge en traditionel scraper, og du skal sandsynligvis igennem snesevis af klik, før det er sat op.

Det tager lang tid at lære at bruge en traditionel scraper, og du skal sandsynligvis igennem snesevis af klik, før det er sat op.

AI webscrapere betyder i praksis: ChatGPT læser hele website’et og udtrækker derefter indhold baseret på det, du har brug for. Den kan håndtere dataudtræk, oversættelse og opsummering på samme tid. De bruger naturlig sprogbehandling til at analysere og forstå website’ets layout, hvilket gør dem bedre til at håndtere ændringer på sitet. Hvis website’et for eksempel flytter lidt rundt på sine sektioner, kan en AI web scraper ofte tilpasse sig uden, at du behøver at ændre noget. Derfor er de rigtig gode til websites, der kræver meget vedligeholdelse, eller som har mere komplekse strukturer.

AI web scraperen er nem at komme i gang med og giver dig detaljerede data på bare få klik!

AI web scraperen er nem at komme i gang med og giver dig detaljerede data på bare få klik!

Hvilken skal du vælge? Det kommer an på. Hvis du er tryg ved at rode med kode eller har brug for at indsamle store datamængder fra et populært website, kan traditionelle scrapere være meget effektive. Men hvis du er ny til webscraping eller vil have noget, der kan følge med website-opdateringer, er AI webscrapere som regel det bedste valg. Se tabellen herunder for mere konkrete scenarier!

| Scenarie | Bedste valg |

|---|---|

| Let scraping på sider som kataloger, shoppingwebsites eller ethvert website med en liste | AI Web Scraper |

| Siden indeholder færre end 200 rækker data, og det tager for lang tid at bygge en scraper med en traditionel web scraper | AI Web Scraper |

| De data, du skal scrape, skal have et bestemt format for at kunne uploades et andet sted. For eksempel: scraping af kontaktoplysninger til upload i HubSpot. | AI Web Scraper |

| Udbredte websites i stor skala, såsom titusindvis af Amazon-produktpages eller boligannoncer på Zillow. | Traditionel Web Scraper |

De bedste Web Scraping-værktøjer og software på et øjeblik

| Værktøj | Pris | Nøglefunktioner | Fordele | Ulemper |

|---|---|---|---|---|

| Thunderbit | Fra $9/måned, gratis plan tilgængelig | AI web scraper, registrerer og formaterer data automatisk, understøtter flere formater, eksport med ét klik, brugervenligt interface. | Kodefri, AI-support, integrationer med apps som Google Sheets | Storskalascraping kan være langsomt, avancerede funktioner kan koste mere |

| Browse AI | Fra $48.75/måned, gratis plan tilgængelig | No-code interface, overvågning i realtid, masseudtræk af data, workflow-integration. | Brugervenlig, integrerer med Google Sheets og Zapier | Komplekse sider kræver ekstra opsætning, bulk scraping kan give timeouts |

| Bardeen AI | Fra $60/måned, gratis plan tilgængelig | No-code automatisering, integrerer med 130+ apps, MagicBox gør opgaver til workflows. | Omfattende integrationer, skalerbar til virksomheder | Stejl læringskurve for nye brugere, tidskrævende opsætning |

| Web Scraper | Gratis til lokal brug, $50/måned for cloud | Visuel oprettelse af opgaver, understøtter dynamiske sites (AJAX/JavaScript), cloud scraping. | Fungerer godt til dynamiske sites | Kræver teknisk viden for den bedste opsætning |

| Octoparse | Starter ved $119/måned, gratis plan tilgængelig | No-code scraping, automatisk registrering af sideelementer, cloud scraping med planlagte opgaver, skabelonbibliotek til almindelige websites. | Kraftfulde funktioner til dynamiske sites, håndterer begrænsninger | Komplekse sites kræver indlæring |

| Diffbot | Fra $299/måned | Dataudtræks-API, regel-fri API, NLP til ustruktureret tekst, omfattende knowledge graph. | Stærkt AI-udtræk, omfattende API-integration | Læringskurve for ikke-tekniske brugere, opsætningstid |

Den bedste Web Scraper i AI’ens tidsalder

Thunderbit er et kraftfuldt og brugervenligt AI-webautomationsværktøj, der gør det muligt for brugere uden kodningsfærdigheder nemt at udtrække og organisere data. Med sin forenkler Thunderbits data scraping — brugere kan hurtigt hente webdata uden manuelt at arbejde med web-elementer eller opsætte individuelle scrapere til forskellige sidelayouts.

Nøglefunktioner

- AI-drevet fleksibilitet: Thunderbits AI Web Scraper registrerer og formaterer webdata automatisk, så du slipper for CSS-selectors.

- Den nemmeste scraping-oplevelse: Alt, du skal gøre, er at klikke på “AI foreslå kolonne” og derefter klikke på “Scrape” på den side, du vil udtrække data fra. Det er det hele.

- Understøttelse af forskellige dataformater: Thunderbit kan scrape URLs og billeder og vise de indsamlede data i flere formater.

- Automatiseret databehandling: Thunderbits AI kan omformatere data undervejs, herunder opsummere, kategorisere og oversætte dem til det ønskede format.

- Nem dataeksport: Eksportér data til Google Sheets, Airtable eller Notion med ét klik, så datahåndteringen bliver enklere.

- Brugervenligt interface: Et intuitivt interface gør det tilgængeligt for brugere på alle niveauer.

Pris

Thunderbit tilbyder niveauopdelte planer, fra $9 om måneden for 5.000 credits. Den går helt op til $199 for 240.000 credits. Ved årsplanen får du også alle credits på én gang.

Fordele:

- Stærk AI-support gør dataudtræk og databehandling enklere.

- Kodefri og tilgængelig for brugere på alle niveauer.

- Perfekt til let scraping såsom kataloger, shoppingwebsites osv.

- Høj integrationskapacitet til direkte eksport til populære apps.

Ulemper:

- Storskaladata-scraping kan tage lidt tid for at sikre nøjagtighed.

- Visse avancerede funktioner kræver måske et betalt abonnement.

Vil du vide mere? Start med at , eller se med Thunderbit.

Bedste Web Scraper til dataovervågning og masseudtræk

Browse AI

Browse AI er et robust no-code-værktøj til data scraping, designet til at hjælpe brugere med at udtrække og overvåge data uden at skrive kode. Browse AI har nogle AI-funktioner, men det er ikke helt på niveau med egentlig AI scraping. Når det er sagt, gør det stadig opstarten lettere for brugerne.

Nøglefunktioner

- No-code interface: Gør det muligt for brugere at oprette skræddersyede workflows med enkle klik.

- Overvågning i realtid: Bruger bots til at følge ændringer på websider og levere opdateret information.

- Masseudtræk af data: Kan håndtere op til 50.000 dataposter på én gang.

- Workflow-integration: Kobler flere bots sammen til mere kompleks databehandling.

Pris

Starter ved $48.75 om måneden, inklusive 2.000 credits. Der findes en gratis plan, som giver 50 credits om måneden, så du kan prøve de grundlæggende funktioner.

Fordele:

- Har integrationer med Google Sheets og Zapier.

- Færdigbyggede bots gør almindelige dataudtræksopgaver enklere.

Ulemper:

- Kan kræve ekstra opsætning på komplekse sider.

- Hastigheden ved bulk scraping kan variere og føre til timeouts.

Bedste Web Scraper til workflow-integration

Bardeen AI

Bardeen AI er et no-code-automatiseringsværktøj, der er designet til at strømline workflows ved at forbinde forskellige apps. Selvom det bruger AI til at skabe skræddersyet automatisering, mangler det den fleksibilitet, som et fuldt AI-scraping-værktøj har.

Nøglefunktioner

- No-code automatisering: Giver brugerne mulighed for at opsætte workflows med klik.

- MagicBox: Beskriver opgaver i almindeligt sprog, som Bardeen AI omsætter til workflows.

- Bredt udvalg af integrationer: Integrerer med over 130 apps, herunder Google Sheets, Slack og LinkedIn.

Pris

Starter ved $60 om måneden med 1.500 credits (omkring 1.500 datarækker). En gratis plan giver 100 credits om måneden til at prøve de grundlæggende funktioner.

Fordele:

- Omfattende integrationsmuligheder understøtter mange forskellige forretningsbehov.

- Fleksibelt og skalerbart for virksomheder i alle størrelser.

Ulemper:

- Nye brugere kan have brug for tid til at lære hele platformen at kende.

- Den indledende opsætning kan være tidskrævende.

Bedste visuelle Web Scraper til erfarne brugere

Web Scraper

Ja, du læste rigtigt: værktøjet hedder “Web Scraper”. Web Scraper er en populær browserudvidelse til Chrome og Firefox, som gør det muligt at udtrække data uden kode og giver en visuel måde at oprette scraping-opgaver på. Du kan dog godt komme til at bruge et par dage på at se og lære af vejledningerne ovenfor, før du mestrer værktøjet fuldt ud. Hvis du vil gøre scraping let for hjernen, så vælg AI Web Scraper.

Nøglefunktioner

- Visuel oprettelse: Giver brugerne mulighed for at opsætte scraping-opgaver ved at klikke på web-elementer.

- Understøttelse af dynamiske websites: Kan håndtere AJAX-forespørgsler og JavaScript på dynamiske sites.

- Cloud scraping: Planlæg opgaver via Web Scraper Cloud til periodisk scraping.

Pris

Gratis til lokal brug; betalte planer starter ved $50/måned for cloud-funktioner.

Fordele:

- Fungerer godt til dynamiske sites.

- Gratis til lokal brug.

Ulemper:

- Kræver teknisk viden for optimal opsætning.

- Der kræves grundig testning ved ændringer.

Bedste Web Scraper til at undgå IP-blokering og bot-detektion

Octoparse

Octoparse er et alsidigt værktøj for mere tekniske brugere, der vil indsamle og overvåge specifikke webdata uden kode — ideelt til store datamængder. Octoparse kører ikke via brugerens browser; i stedet bruger det cloud-servere til data scraping. Derfor kan det tilbyde forskellige metoder til at omgå IP-blokering og visse former for bot-detektion på websites.

Nøglefunktioner

- No-code drift: Brugere kan oprette scraping-opgaver uden at skrive kode, hvilket gør det tilgængeligt for brugere med forskellige tekniske niveauer.

- Smart autodetektion: Registrerer automatisk sidedata og identificerer hurtigt de elementer, der kan scrapes, hvilket gør opsætningen enklere.

- Cloud scraping: Understøtter 24/7 cloud-data scraping med planlagte scraping-opgaver for fleksibel dataindsamling.

- Omfattende skabelonbibliotek: Tilbyder hundredvis af forudindstillede skabeloner, så brugerne hurtigt kan få adgang til data fra populære websites uden kompleks opsætning.

Pris

Octoparses prisplan starter ved $119 om måneden og inkluderer 100 opgaver. Der findes også en gratis plan med 10 opgaver om måneden til at teste de grundlæggende funktioner.

Fordele:

- Kraftfulde funktioner understøtter scraping af dynamiske sites med høj tilpasningsevne.

- Giver løsninger til at håndtere scraping-begrænsninger og problemer med dynamisk indhold.

Ulemper:

- Komplekse websitestrukturer kan kræve mere tid til opsætning.

- Nye brugere kan have brug for tid til at lære metoderne.

Bedste Web Scraper til avanceret AI-drevet dataudtræks-API

Diffbot

Diffbot er et avanceret værktøj til udtræk af webdata, som bruger AI til at omdanne ustruktureret webindhold til strukturerede data. Med kraftfulde API’er og en knowledge graph hjælper Diffbot brugerne med at udtrække, analysere og administrere information fra internettet, velegnet til forskellige brancher og anvendelser.

Nøglefunktioner

- Dataudtræks-API: Diffbot tilbyder en regel-fri API til dataudtræk, så brugerne blot kan angive en URL for automatisk dataudtræk, uden at skulle opsætte skræddersyede regler for hvert website.

- API til naturlig sprogbehandling: Udtrækker strukturerede entiteter, relationer og sentiment fra ustruktureret tekst og hjælper brugerne med at bygge deres egne knowledge graphs.

- Knowledge graph: Diffbot har en af de største knowledge graphs og forbinder omfattende entitetsdata, herunder oplysninger om personer og organisationer.

Pris

Diffbots prisplan starter ved $299 om måneden og inkluderer 250.000 credits (svarende til cirka 250.000 API-baserede sideudtræk).

Fordele:

- Stærke regel-frie dataudtræksfunktioner med høj tilpasningsevne.

- Omfattende API-integrationer, der gør det nemt at koble til eksisterende systemer.

- Understøtter data scraping i stor skala og er velegnet til enterprise-niveau.

Ulemper:

- Den indledende opsætning kan kræve lidt indlæring for ikke-tekniske brugere.

- Brugerne skal skrive et program for at kalde API’et og bruge det.

Hvad kan du bruge scrapere til?

Hvis du er ny inden for webscraping, får du her et par populære anvendelser, som kan hjælpe dig i gang. Mange bruger scrapere til at hente Amazon-produktlister, trække ejendomsdata fra Zillow eller indsamle virksomhedsoplysninger fra Google Maps. Men det er kun begyndelsen — du kan bruge Thunderbit til at indsamle data fra næsten ethvert website, strømline opgaver og spare tid i din daglige arbejdsgang. Uanset om det er til research, prisovervågning eller opbygning af databaser, åbner webscraping op for utallige måder at få internettets data til at arbejde for dig.

FAQ

-

Er webscraping lovligt?

Webscraping er typisk lovligt, men du skal følge website’ets vilkår for brug og tage hensyn til, hvilken type data der tilgås. Gennemgå altid de relevante politikker og overhold de juridiske retningslinjer.

-

Skal jeg kunne programmere for at bruge webscraping-værktøjer?

De fleste af de værktøjer, der er nævnt her, kræver ikke programmeringsfærdigheder, men værktøjer som Octoparse og Web Scraper kan give bedre resultater, hvis brugeren har grundlæggende forståelse for webstrukturer og en programmeringsmæssig tankegang.

-

Findes der gratis webscraping-værktøjer?

Ja, gratis værktøjer som BeautifulSoup, Scrapy og Web Scraper er tilgængelige, og nogle værktøjer tilbyder også gratis planer med begrænset funktionalitet.

-

Hvilke udfordringer er mest almindelige ved webscraping?

Almindelige udfordringer omfatter håndtering af dynamisk indhold, CAPTCHA’er, IP-blokering og komplekse HTML-strukturer. Avancerede værktøjer og teknikker kan effektivt løse disse problemer.

Lær mere:

-

Brug AI til at arbejde uden anstrengelse.