كنت محتاج أتابع أكثر من 200 مصدر إخباري عشان أرصد المقالات الترند. يدويًا؟ يعني شغل 풀타임 حرفيًا. وبـ أداة استخراج تقليدية؟ كانت بتنهار كل ما موقع يغيّر 디자인 أو layout.

بعدها جرّبت أدوات أداة استخراج المقالات بالذكاء الاصطناعي. 클릭 واحدة، بيانات مرتّبة ونظيفة، وبدون محددات CSS. الفرق كان واضح جدًا من أول تجربة.

لو أنت صحفي، أو خبير SEO، أو باحث وتحتاج تسحب مقالات على نطاق واسع، فالمقارنة دي بتوفّر عليك وقت كبير من التجربة والخطأ. جرّبت أدوات بدون كود التقليدية وأدوات مدعومة بالذكاء الاصطناعي — وإليك اللي فعلاً يشتغل.

TL;DR

| الإيجابيات | السلبيات | الأفضل لـ | |

|---|---|---|---|

| أداة استخراج المقالات بالذكاء الاصطناعي | - يمكنها استخراج البيانات من عدة مواقع بدقة عالية - تزيل التشويش تلقائيًا - تتكيف مع تغيّر بنية الصفحات - تدعم تحميل المحتوى الديناميكي - تكلفة تنظيف البيانات أقل | - تكلفة حوسبة أعلى - وقت معالجة أطول - بعض الصفحات قد تحتاج تدخلاً يدويًا - قد تُفعّل آليات منع الاستخراج | - استخراج مواقع معقدة أو ديناميكية (مثل بوابات الأخبار ووسائل التواصل) - جمع بيانات على نطاق واسع |

| أداة استخراج المقالات التقليدية بدون كود | - تنفيذ سريع - تكلفة أقل - استهلاك منخفض لموارد الخادم والجهاز - تحكم أعلى | - صيانة متكررة بسبب تغيّر بنية المواقع - لا تستخرج عدة مواقع دفعة واحدة - لا تتعامل جيدًا مع المحتوى الديناميكي - تكلفة تنظيف البيانات أعلى | - استخراج سريع وعلى نطاق كبير لصفحات ثابتة وبسيطة - موارد حوسبة محدودة أو ميزانية مقيدة |

ما هي أداة استخراج المقالات؟ ولماذا تهم أدوات استخراج المقالات بالذكاء الاصطناعي؟

أداة هي نوع من يقدر يلقط معلومات زي العناوين، أسماء الكتّاب، تواريخ النشر، المحتوى، الكلمات المفتاحية، الصور والفيديوهات من مواقع الأخبار، وبعدها يرتّبها لك في صيغ منظمة مثل JSON أو CSV أو Excel.

غالبًا بتعتمد على عشان تسحب المحتوى حسب بنية داخل الصفحة. بس الأسلوب ده فيه مشاكل واضحة:

- ضعف القابلية للتعميم: كل موقع يحتاج محددات CSS خاصة، وأي تغيير بسيط في بنية الصفحة ممكن يكسّر الاستخراج ويخلّيك ترجع تعمل 업데이트 كل شوية.

- صعوبة التعامل مع المحتوى الديناميكي: مواقع كثيرة بتستخدم AJAX أو JavaScript لتحميل المحتوى، وده محددات CSS ما تقدرش تجيبه مباشرة.

- قدرات معالجة محدودة: محددات CSS بتلقط أجزاء من HTML وخلاص—بدون تنظيف، أو تنسيق، أو فهم دلالي، أو تحليل مشاعر.

وهنا يجي دور .

وهنا يجي دور .

-

التقنية دي بتعتمد على نماذج لغوية كبيرة (LLM) لفهم صفحات الويب، وبتديك مزايا مثل:

- تعرّف ذكي: يميّز العنوان والكاتب والملخص والمحتوى الأساسي بشكل smart.

- إزالة التشويش تلقائيًا: يفصل المحتوى الرئيسي عن القوائم والإعلانات والمقالات المقترحة—وده يرفع جودة البيانات ويخلّي الشغل أنضف.

- التكيف مع تغيّرات المواقع: حتى لو تغيّر الستايل أو البنية، الذكاء الاصطناعي يكمّل لأنه بيعتمد على الفهم الدلالي والسمات البصرية.

- التعميم عبر مواقع متعددة: بعكس ، تقدر تطبّق نفس الأداة على مواقع مختلفة بدون تعديل يدوي مزعج.

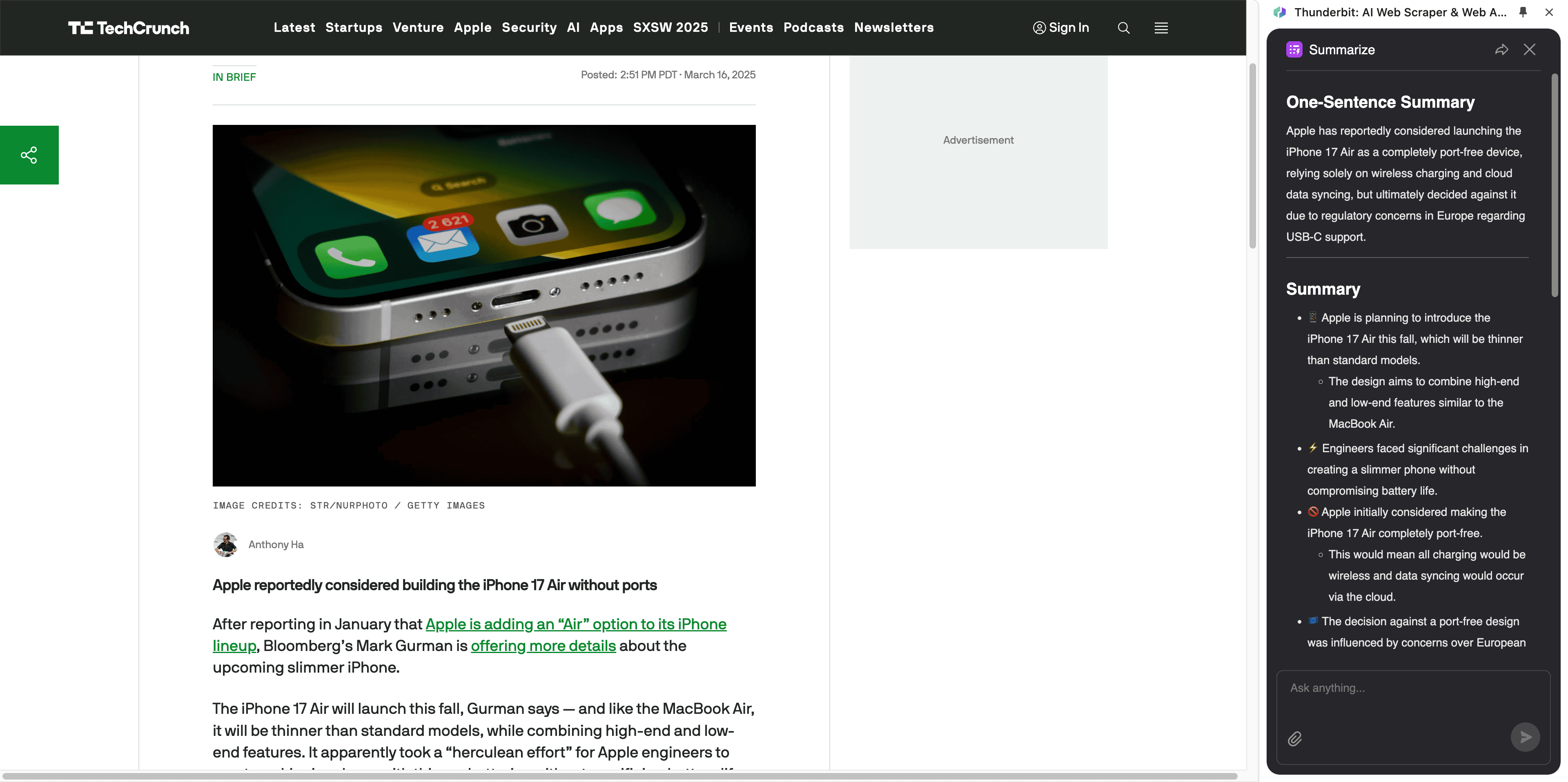

- الدمج مع NLP والتعلم العميق: عشان تعمل حاجات زي الترجمة، التلخيص، وتحليل المشاعر.

ما الذي يجعل أداة استخراج المقالات الأفضل في 2026؟

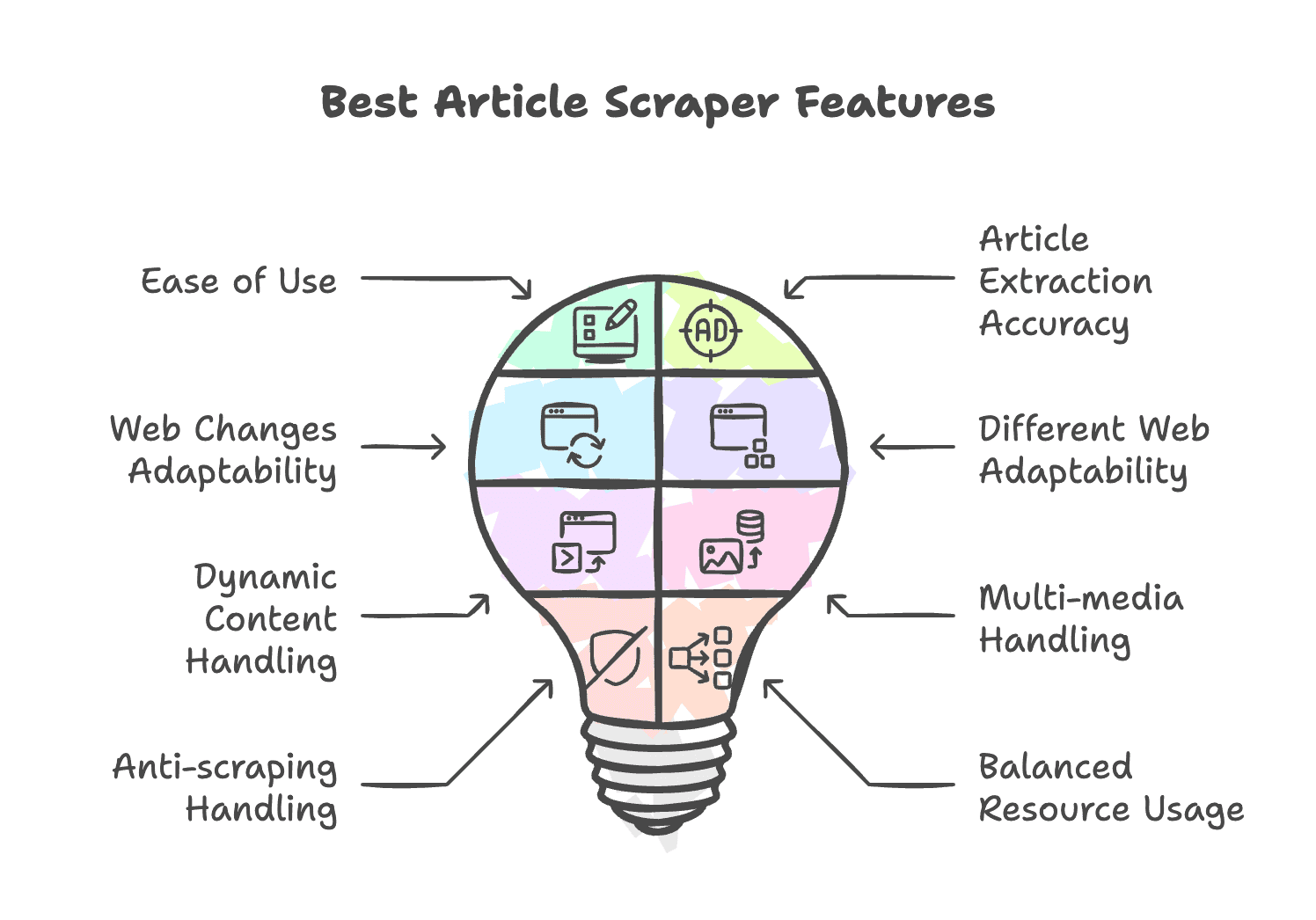

أفضل أداة لاستخراج المقالات هي اللي توازن بين الأداء والتكلفة وسهولة الاستخدام والمرونة وقابلية التوسع. ودي أهم المعايير اللي تركز عليها في 2026:

- سهولة الاستخدام: واجهة واضحة وما تحتاجش كود.

- دقة استخراج المقالات: تلتقط المهم وتسيب الإعلانات والتنقل.

- التكيف مع تغيّرات المواقع: تتأقلم تلقائيًا مع تغيّر البنية أو التصميم بدون صيانة مستمرة.

- التوافق مع مواقع مختلفة: تشتغل على هياكل ويب متعددة.

- التعامل مع المحتوى الديناميكي: دعم تحميل JavaScript أو AJAX.

- التعامل مع الوسائط المتعددة: فهم الصور والفيديو والصوت.

- مواجهة أنظمة منع الاستخراج: تدوير IP وحلول CAPTCHA واستخدام البروكسي لتجاوز القيود.

- توازن استهلاك الموارد: بدون ما يشفط الذاكرة أو موارد الحوسبة بشكل مبالغ فيه.

أفضل أدوات استخراج المقالات والأخبار بنظرة سريعة

| الأدوات | الميزات الأساسية | الأفضل لـ | التسعير |

|---|---|---|---|

| Thunderbit | أداة استخراج مدعومة بالذكاء الاصطناعي؛ قوالب جاهزة؛ دعم استخراج PDF والصور والمستندات؛ قدرات متقدمة لمعالجة البيانات | مستخدمون غير تقنيين يحتاجون لاستخراج بيانات من عدة مواقع متخصصة | تجربة مجانية 7 أيام، من 9$ شهريًا (خطة سنوية) |

| WebScraper.io | إضافة للمتصفح؛ دعم للمحتوى الديناميكي؛ يفتقر لدمج البروكسي | من لا يتعاملون مع صفحات معقدة أو ميزات متقدمة | تجربة مجانية 7 أيام، من 40$ شهريًا (خطة سنوية) |

| Browse.ai | Web Scraper بدون كود مع مراقبة؛ روبوتات جاهزة؛ متصفح افتراضي؛ طرق متعددة للتصفح عبر الصفحات؛ تكاملات قوية | شركات تحتاج استخراجًا معقدًا وعلى نطاق كبير | 19$ شهريًا (خطة سنوية) |

| Octoparse | أداة بدون كود تعتمد على محددات CSS؛ اكتشاف تلقائي وبناء سير عمل للاستخراج؛ قوالب جاهزة لاستخراج المقالات؛ متصفح افتراضي؛ آليات لمقاومة منع الاستخراج | أعمال تحتاج استخراج مواقع معقدة | من 99$ شهريًا (خطة سنوية) |

| Bardeen | أتمتة ويب شاملة؛ قوالب جاهزة؛ استخراج بدون كود؛ تكامل سلس مع أدوات العمل | فرق GTM التي تريد دمج استخراج المقالات داخل سير العمل الحالي | تجربة مجانية 7 أيام، من 99$ شهريًا (خطة سنوية) |

| PandaExtract | واجهة سهلة؛ اكتشاف وتسمية تلقائيان | من يريد استخراجًا سريعًا بنقرة واحدة دون إعدادات معقدة | 49$ شراء لمرة واحدة |

أقوى أداة استخراج مقالات بالذكاء الاصطناعي لمستخدمي الأعمال

- الإيجابيات:

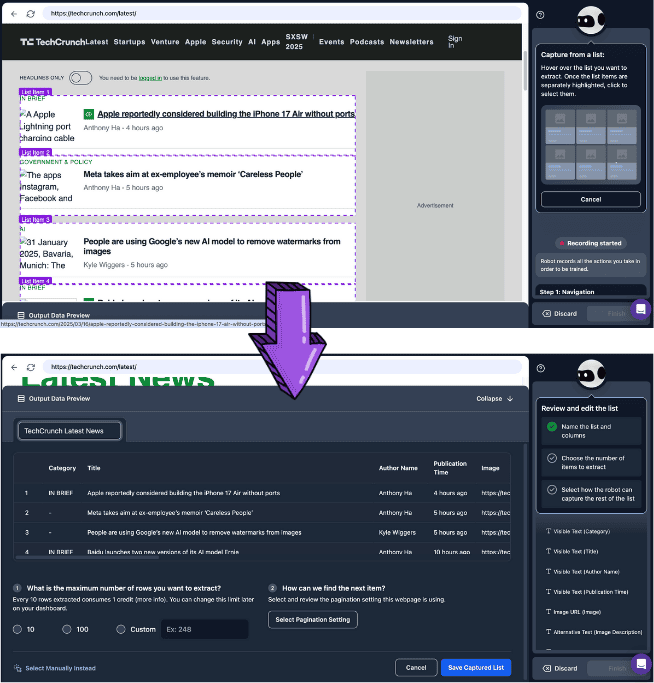

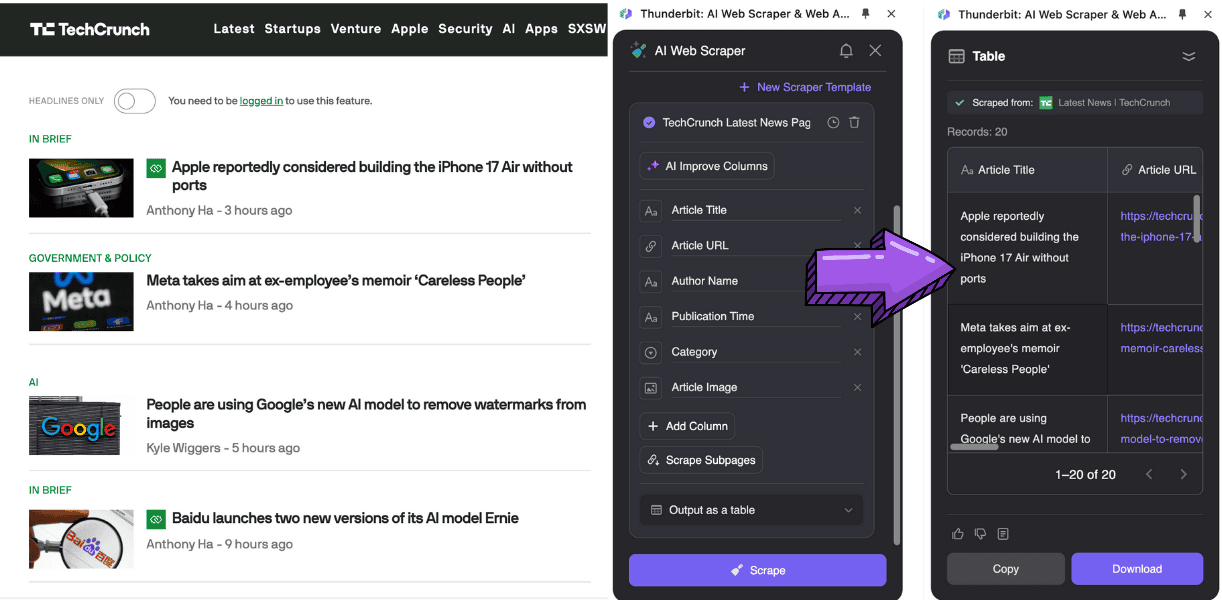

- يستخدم اللغة الطبيعية لاستدعاء الذكاء الاصطناعي للتعرّف على معلومات الويب وتحليلها دون الحاجة لمحددات CSS

- تحليل بيانات بمساعدة الذكاء الاصطناعي، بما في ذلك تحويل الصيغ، ، التصنيف، الترجمة، وإضافة الوسوم

- لاستخراج قوائم المقالات ومحتواها بنقرة واحدة

- السلبيات:

- متاح حاليًا فقط كـ

- غير مناسب لاستخراج البيانات على نطاق ضخم جدًا

- أبطأ عند استخراج صفحات متعددة، لكنه يستطيع العمل في الخلفية لتسريع النتائج

أداة استخراج مقالات بالذكاء الاصطناعي للاستخدام المؤسسي

Browse.ai

- الإيجابيات:

- أداة استخراج ومراقبة للمقالات بدون كود

- يدعم تشغيل متصفح افتراضي لتقليل احتمالية تفعيل أنظمة منع الاستخراج

- عدد كبير من روبوتات استخراج المقالات الجاهزة لاستخراج و و وغيرها بنقرة واحدة

- تكامل عميق مع منصات مثل و لربط الأدوات

- السلبيات:

- استخدام الاستخراج العميق يتطلب إنشاء روبوتين، ما يجعل العملية أكثر تعقيدًا

- محددات CSS ليست دقيقة بما يكفي للمواقع المتخصصة

- مكلف، ومناسب أكثر لمهام استخراج مستمرة وعلى نطاق كبير

أداة بدون كود لاستخراج بيانات على نطاق صغير

PandaExtract

- الإيجابيات:

- يتعرف تلقائيًا على قوائم المقالات وتفاصيلها عبر واجهة سهلة

- يستخرج القوائم والتفاصيل والبريد الإلكتروني والصور، مناسب لاستخراج بيانات منظمة على نطاق صغير

- دفع لمرة واحدة لاستخدام مدى الحياة

- السلبيات:

- متاح فقط كإضافة متصفح ولا يعمل على السحابة

- النسخة المجانية تدعم النسخ فقط ولا تدعم التصدير إلى CSV أو JSON وغيرها

أداة استخراج مقالات جاهزة للاستخدام داخل المؤسسات

Octoparse

- الإيجابيات:

- أداة استخراج مقالات بدون كود مع اكتشاف تلقائي للتعرّف على بنية الويب وتوليد سير عمل للاستخراج

- قوالب كثيرة جاهزة لاستخراج المقالات ويمكن استخدامها مباشرة

- يستخدم متصفحًا افتراضيًا مع تدوير IP وحلول CAPTCHA وبروكسي لتجاوز أنظمة منع الاستخراج

- السلبيات:

- الاكتشاف التلقائي ما زال يعتمد على منطق محددات CSS ودقته متوسطة

- الميزات المتقدمة تتطلب تعلمًا ومهارات تقنية

- مكلف عند استخراج البيانات على نطاق كبير

أكثر منصة أتمتة شمولاً لفريق GTM

Bardeen

- الإيجابيات:

- أداة استخراج مقالات بدون كود تستخدم LLM لأتمتة بنقرة واحدة

- تتكامل مع أكثر من 100 تطبيق، بما في ذلك و و

- أدوات أتمتة ويب قوية لتحليل البيانات بالذكاء الاصطناعي بعد الاستخراج

- ممتازة لدمج الاستخراج داخل سير العمل الحالي

- السلبيات:

- تعتمد كثيرًا على Playbooks الجاهزة، أما سير العمل المخصص فيحتاج تجارب متعددة

- رغم أنها منصة بدون كود، قد يحتاج غير التقنيين وقتًا لفهم الأتمتة المعقدة وإعدادها

- إعداد استخراج الصفحات الفرعية معقد

- مرتفعة التكلفة جدًا

أداة خفيفة لاستخراج المقالات لالتقاط البيانات فورًا

Webscraper.io

- الإيجابيات:

- أداة بدون كود بواجهة تعتمد على النقر والاختيار

- تدعم تحميل المحتوى الديناميكي

- تشغيل سحابي

- تتكامل مع و و

- السلبيات:

- لا توجد قوالب جاهزة، ويتطلب إنشاء Sitemap مخصص

- منحنى تعلم لمن لا يعرفون محددات CSS

- إعداد التصفح عبر الصفحات واستخراج الصفحات الفرعية قد يكون معقدًا

- النسخة السحابية مكلفة

حلول أكثر تقدمًا للمهندسين

لو عندك خلفية تقنية، تقدر تروح لخيار . النوع ده من الحلول عادة يقدّم:

- مرونة: استدعاءات API مباشرة لاستخراج مخصص، مع دعم العرض الديناميكي وتدوير IP

- قابلية توسع: تدمجه داخل data pipeline مخصص يناسب احتياجات المؤسسات عالية التردد وعلى نطاق كبير

- تكلفة صيانة أقل: بدون ما تدير proxy pools أو استراتيجيات منع الاستخراج بنفسك، وده يوفّر وقت تشغيل كثير

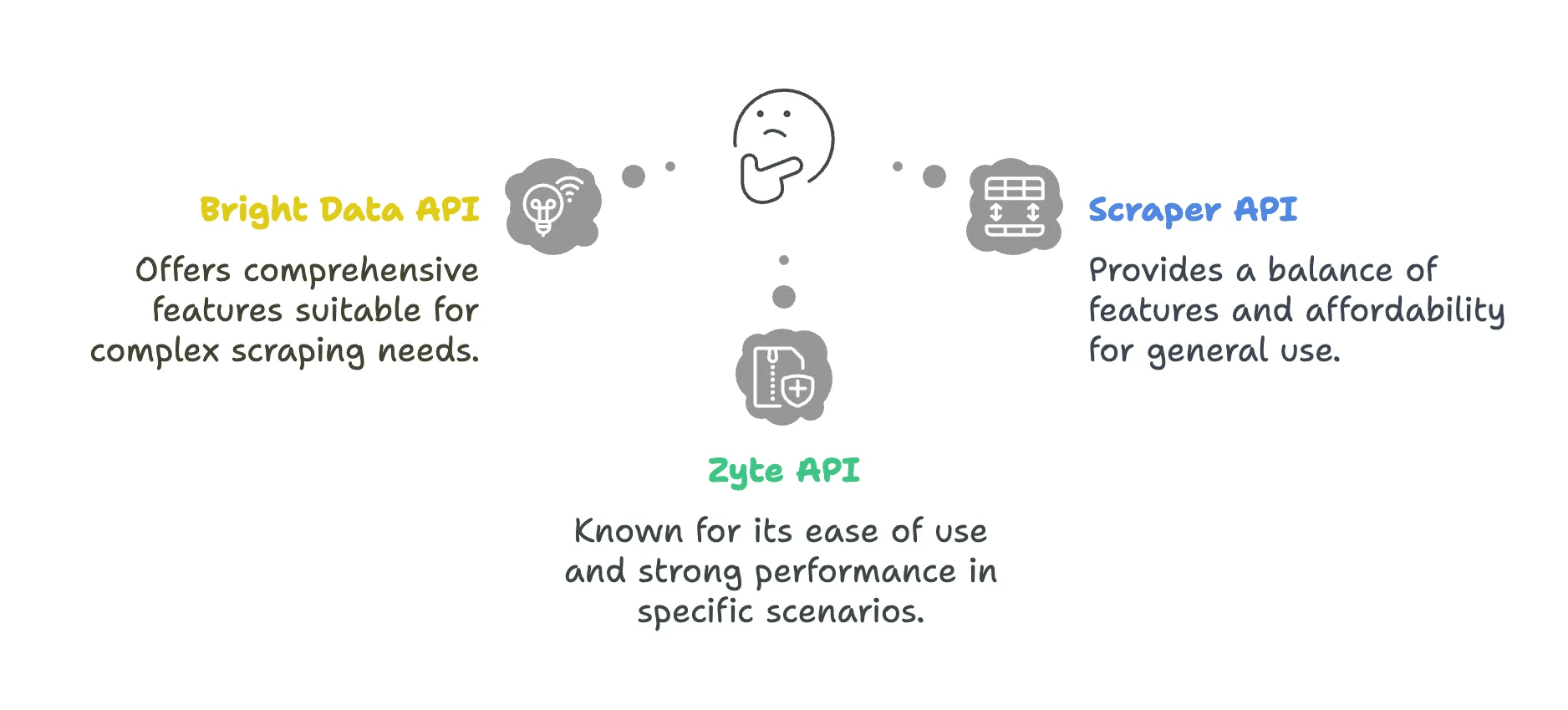

نظرة سريعة على حلول API

| API | الإيجابيات | السلبيات |

|---|---|---|

| Bright Data API | - شبكة بروكسي ضخمة (أكثر من 72 مليون IP عبر 195 دولة) - استهداف جغرافي متقدم حتى مستوى المدينة/الرمز البريدي - Proxy Manager قوي لتدوير IP | - زمن استجابة أبطأ (متوسط 22.08 ثانية) - تسعير مرتفع لا يناسب الفرق الصغيرة - إعدادات أكثر تعقيدًا وتحتاج خبرة |

| ScraperAPI | - نقطة دخول أقل تبدأ من 49$ - ميزة Autoparse لاستخراج البيانات تلقائيًا - واجهة ويب للاختبار | - غالبًا يتم احتساب الطلبات المحجوبة - ميزات عرض JavaScript محدودة - قد ترتفع التكلفة مع المعلمات المميزة |

| Zyte API | - قدرات تحليل مدعومة بالذكاء الاصطناعي - لا يفرض رسومًا على الطلبات الفاشلة | - تكلفة ابتدائية أعلى (~450$ شهريًا) - الرصيد لا يُرحّل من شهر لآخر |

- Bright Data Web Scraper API

- الإيجابيات:

- يغطي 195 دولة مع أكثر من 72 مليون IP سكني، ويدعم تدوير IP تلقائيًا ومحاكاة الموقع الجغرافي، مناسب للمواقع ذات القيود الصارمة (مثل و)

- يدعم تحميل المحتوى الديناميكي عبر JavaScript والتقاط لقطات للصفحات

- السلبيات:

- تكلفة مرتفعة (محاسبة حسب الطلب وعرض النطاق)، وقيمة أقل للمشاريع الصغيرة

- الإيجابيات:

- Scraper API

- الإيجابيات:

- 40 مليون بروكسي عالمي، تبديل تلقائي بين IP لمراكز البيانات والسكني، تجاوز تحقق Cloudflare، ودمج حلول CAPTCHA خارجية (مثل )

- نقاط نهاية منظمة وأدوات استخراج غير متزامنة لسرعة أعلى

- السلبيات:

- تكلفة إضافية لعرض الصفحات الديناميكية، ودعم محدود لمواقع AJAX المعقدة

- الإيجابيات:

- Zyte API

- الإيجابيات:

- استخراج تلقائي لبيانات الويب بالذكاء الاصطناعي دون تطوير وصيانة قواعد استخراج لكل موقع

- تسعير مرن حسب الاستخدام

- السلبيات:

- الميزات المتقدمة (مثل إدارة الجلسات والمتصفح القابل للبرمجة) تتطلب تعلمًا

- الإيجابيات:

كيف تختار أداة استخراج المقالات والأخبار المناسبة؟

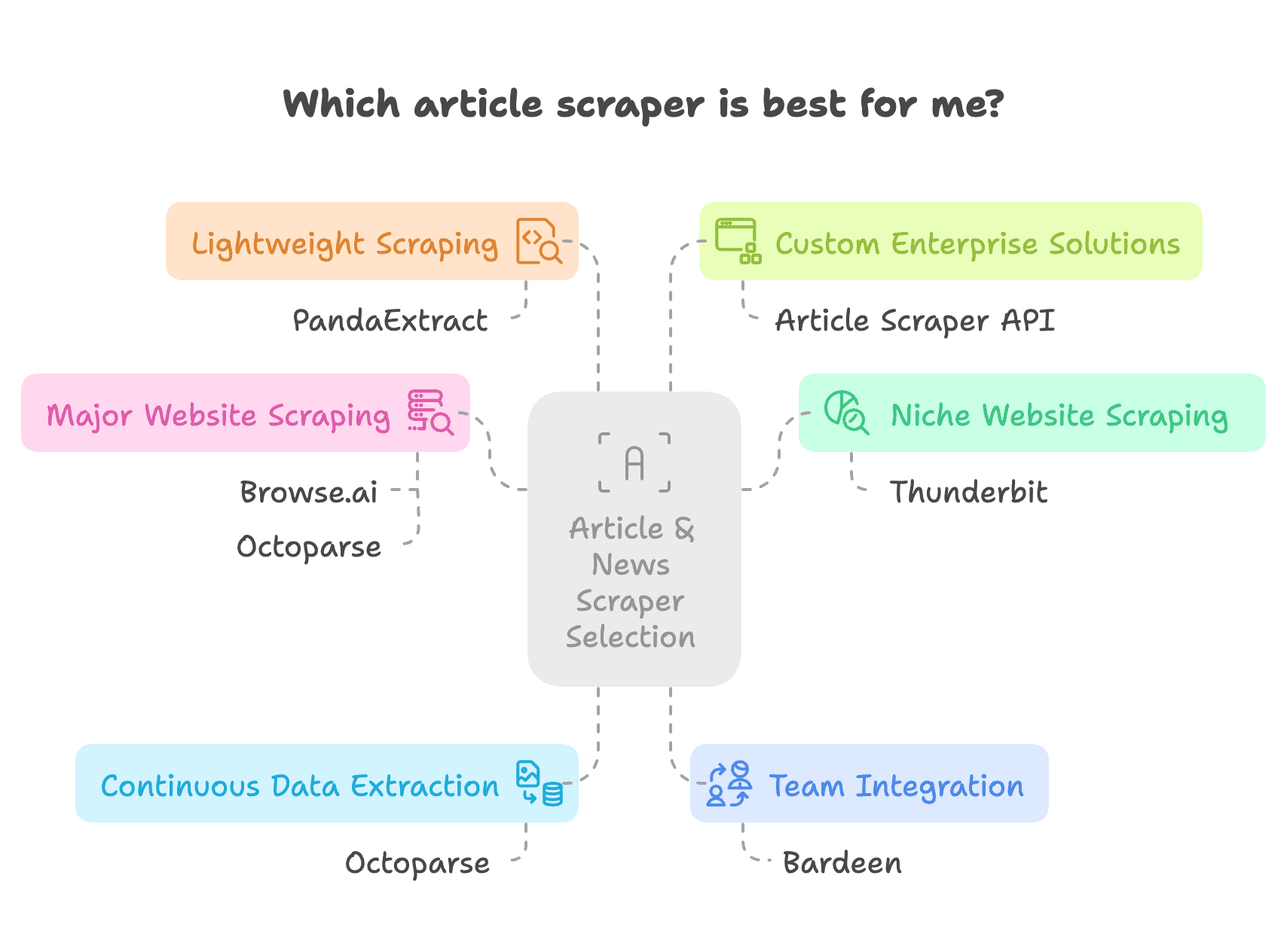

وأنت تختار أداة استخراج مقالات الأخبار، فكّر بشكل عملي: احتياجات شغلك، خبرتك التقنية، والميزانية اللي تقدر عليها.

- لو تحتاج تسحب من مواقع متخصصة كثيرة بدون ما تبني أداة لكل صفحة، ومعاك ميزانية، فـ غالبًا هو الخيار الأفضل. لأنه ما يعتمد على CSS selectors، بل يستخدم الذكاء الاصطناعي لفهم بنية الصفحة، وكمان يتيح تحليل بعد الاستخراج. بالنسبة لـ Thunderbit AI كل المواقع تقريبًا نفس الفكرة، وده يساعده يلقط المقال كامل بدقة.

- لو بتستهدف مواقع كبيرة زي أو ، غالبًا تحتاج أداة قوية ضد منع الاستخراج ومعها templates جاهزة زي Browse.ai أو Octoparse. ومع ذلك، الخيار الأفضل كثيرًا يكون إضافة Chrome مثل : لأن الاستخراج بيكون قريب من التصفح والنسخ الطبيعي، وكمان تقدر تستخدم تسجيل الدخول بدون إعدادات معقدة.

- لو تحتاج استخراج مستمر وعلى نطاق كبير، الأدوات اللي فيها scheduling زي Octoparse تكون أنسب.

- لو شغلك فريق وتحتاج تكامل سلس مع workflow الحالي، Bardeen خيار قوي لأنه يتجاوز فكرة الاستخراج لأتمتة ويب كاملة.

- لو تبغى أداة خفيفة تسحب كمية صغيرة بسرعة وبدون learning curve، اختَر أداة click-and-select زي PandaExtract.

- لو عندك خلفية تقنية أو تبني نظام مؤسسي، فكّر في API tools أو بناء حل خاص جنب .

الخلاصة

المقال ده قدّم فكرة أدوات استخراج المقالات والأخبار وسيناريوهات استخدامها في الأعمال. تعتمد على ، وده يتطلب معرفة بـ وCSS، خصوصًا في الحالات المتقدمة. أما الجيل الجديد من فيعتمد على الفهم الدلالي والتعرّف البصري، ويتفوّق على في التكيّف مع تغيّر بنية المواقع، والتعميم عبر مواقع متعددة، والتعامل مع المحتوى الديناميكي، وكمان تنظيف البيانات وتحليلها بعد الاستخراج.

كمان استعرضنا ست أدوات مفيدة لاستخراج المقالات والأخبار، بالإضافة إلى أدوات API للمطورين، مع مقارنة الإيجابيات والسلبيات وحجم البيانات المناسب وطبيعة المواقع والفئات المستهدفة. في النهاية، لو ناوي تدخل مجال استخراج المقالات والأخبار، اختَر الحل اللي يناسب احتياجك مع موازنة الأداء والتكلفة.

الأسئلة الشائعة

1. ما هي أداة استخراج المقالات بالذكاء الاصطناعي وكيف تعمل؟

- تستخدم الذكاء الاصطناعي لتحليل صفحات الويب واستخراج المحتوى دون الحاجة لمحددات CSS.

- تحدد العناوين والكتّاب وتواريخ النشر والمحتوى الرئيسي بدقة عالية.

- تزيل الإعلانات وقوائم التنقل والعناصر غير المهمة تلقائيًا.

- تتكيف مع تغيّرات بنية المواقع وتعمل عبر مواقع مختلفة.

2. ما فوائد استخدام أداة استخراج مقالات بالذكاء الاصطناعي مقارنة بالأدوات التقليدية؟

- يمكنها استخراج المحتوى من عدة مواقع باستخدام أداة واحدة.

- تتعامل مع المحتوى الديناميكي بما في ذلك صفحات JavaScript وAJAX.

- تحتاج إعدادًا وصيانة أقل مقارنة بأدوات تعتمد على CSS.

- توفر ميزات إضافية مثل التلخيص والترجمة وتحليل المشاعر.

3. هل يمكنني استخدام Thunderbit لاستخراج المقالات بالذكاء الاصطناعي دون مهارات برمجية؟

- نعم، صُمم Thunderbit للمستخدمين غير التقنيين بواجهة بسيطة بدون كود.

- يستخدم الذكاء الاصطناعي لاكتشاف محتوى المقالات واستخراجه تلقائيًا.

- يوفر قوالب جاهزة لاستخراج سريع وفعّال.

- يتيح تصدير البيانات إلى صيغ متعددة مثل CSV وJSON وGoogle Sheets.

اعرف المزيد: