如果你用 Python 写过网页数据采集,肯定有过这种体验:上一秒还在顺利抓取商品价格或客户名单,下一秒脚本就被封,IP 被拉黑,满屏验证码让人崩溃。到了 2025 年,这已经不只是小插曲,而是每个靠公开网页数据吃饭的销售、市场、运营每天都要面对的“家常便饭”。

更扎心的是:其实都栽在反爬机制上,比如 IP 封禁和验证码,差不多有 经常被这些东西卡住。现在,机器人流量几乎占了互联网一半,网站的反爬手段也越来越狠。但别慌——不管你是 Python 老炮还是想偷懒的新手,这篇文章都会教你怎么避开封禁、巧用代理,甚至用 AI 工具比如 让数据采集效率直接起飞。

Python 网页爬虫如何避免被封:基础知识

先来点基础。网页爬虫其实就是自动化收集网站数据。Python 是最常用的语言——都用 Python 工具来搞数据。但网站可不喜欢机器人。为啥?因为自动请求太多会拖慢服务器、盗内容,甚至让竞争对手捡便宜。

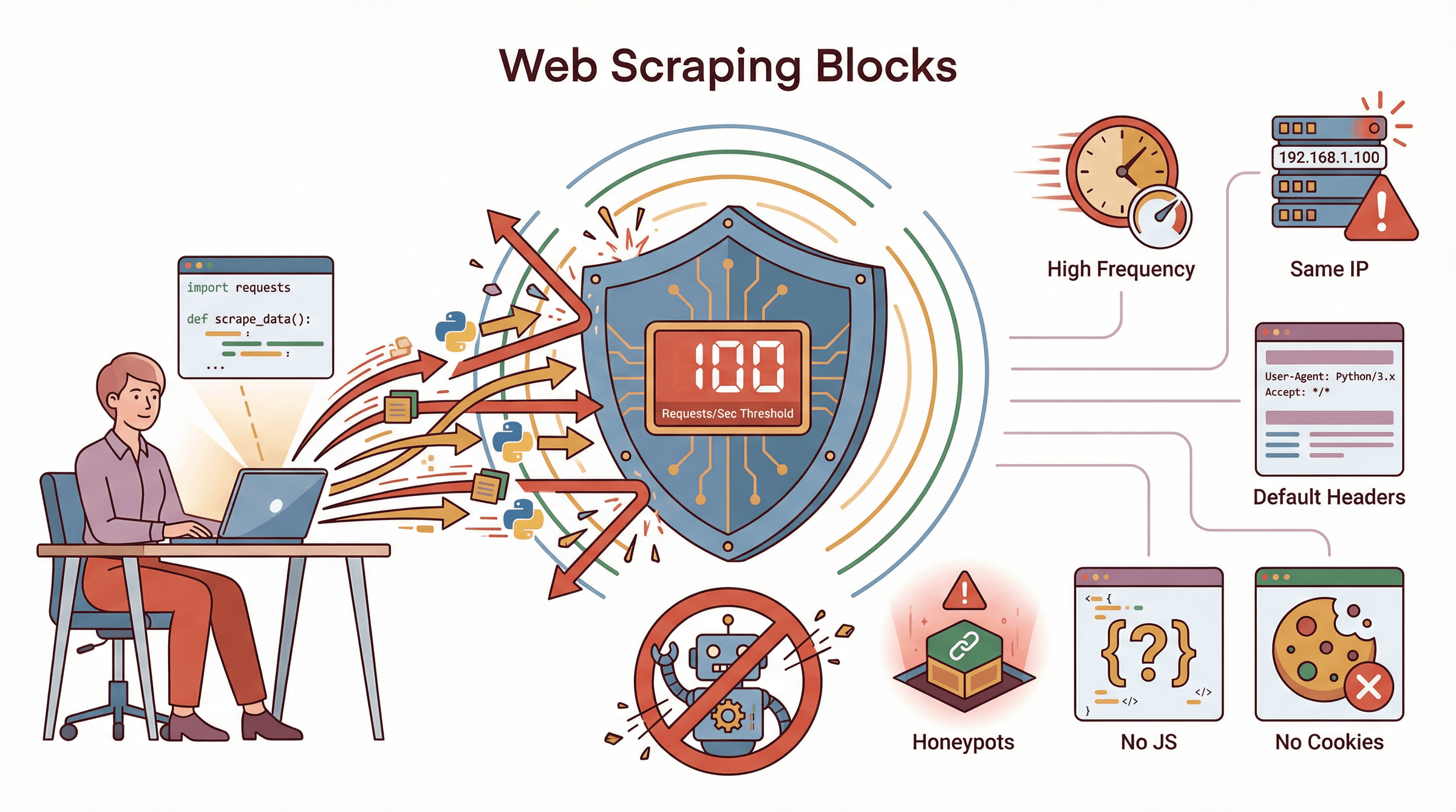

常见的反爬手段有哪些?

- IP 封禁和限流: 同一个 IP 请求太频繁,分分钟被封或限速。

- 验证码(CAPTCHA): 让你证明“你不是机器人”的谜题,连人都烦。

- User-Agent 和 Header 检查: 脚本用默认 “python-requests/2.x”,等于自曝身份。

- JavaScript 检查和浏览器指纹: 有些网站要求运行 JS 或检测浏览器。

- 蜜罐陷阱: 隐藏的链接或表单,只有机器人才会点。

不注意这些,Python 脚本很容易就被“403 Forbidden”请出门。

为什么 Python 爬虫要避免 IP 被封

被封不只是技术问题,更是业务风险。想象一下,销售团队拿不到新客户,定价分析师错过竞争对手降价,市场调研数据不全——这可不只是烦,直接影响业绩。

具体来说:

| 应用场景 | 实际案例 | 被封风险 | 稳定爬取的好处 |

|---|---|---|---|

| 销售线索挖掘 | 爬取名录或领英联系人 | 名单不全,错失商机 | 持续获取最新线索,助力销售拓展 |

| 价格监控 | 每天跟踪竞争对手价格 | 数据滞后,错过价格变动 | 实时掌握市场价格,快速响应 |

| 竞品分析 | 抓取产品详情或评论 | 信息盲区,错过新品发布 | 全面洞察竞争格局,优化策略 |

| 市场调研与 SEO | 汇总新闻、论坛或搜索结果 | 结论偏差,分析师时间浪费 | 数据全面及时,分析更有价值 |

对,网页数据已经是业务的核心资产。

网站如何识别并封禁 Python 爬虫:常见触发点

Python 爬虫最容易因为什么被封?常见原因有:

Python 爬虫最容易因为什么被封?常见原因有:

- 请求频率太高: 人类不会每秒点 100 个页面,机器人一眼就被识破。

- IP 重复用: 所有请求都来自同一个 IP,尤其是数据中心 IP,很容易被拉黑。

- 默认请求头: 用 Python 默认 user-agent 或缺少 headers,直接暴露身份。

- 没有 Cookies 或会话: 真实用户会有 cookies,机器人没有就很可疑。

- 不执行 JavaScript: 爬虫不会跑 JS,可能漏数据或被检测。

- 无视 Robots.txt: 虽然不是技术封禁,但很容易被关注。

- 踩到蜜罐: 点了隐藏链接或填了隐形表单,直接被封。

新手常犯的错包括:请求太密集、不轮换代理、忘了随机 user-agent 和延迟。我见过有人一秒钟给 NASDAQ 发几千请求,结果整个学校 IP 段都被封了。

用 Python 代理防止 IP 被封

这时候,代理就是救命稻草。代理就像中转站,把你的请求伪装成来自别的 IP。对网站来说,流量看起来是分散的。

代理类型

- 数据中心代理: 便宜、速度快,但容易被识别。适合低风险采集。

- 住宅代理: 真正的家庭宽带 IP,难封但慢、贵。

- 轮换代理: 每次请求自动换 IP,适合大规模采集。

- 移动代理: 用手机运营商 IP,只有极难搞的网站才用。

大多数商业采集,轮换住宅代理是首选——信任度高,变化快,不容易被封。

在 Python Requests、Selenium、Beautiful Soup 中集成代理

实操来了,怎么在 Python 脚本里用代理?

Requests 示例:

1import requests

2proxy = "http://USERNAME:PASSWORD@PROXY_IP:PORT"

3proxies = {"http": proxy, "https": proxy}

4headers = {"User-Agent": "Mozilla/5.0 ..."}

5response = requests.get("https://target-website.com/data", proxies=proxies, headers=headers)

6html = response.textBeautiful Soup 示例:

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3data_items = soup.find_all('div', class_='item')Selenium 示例:

1from selenium import webdriver

2proxy = "PROXY_IP:PORT"

3chrome_options = webdriver.ChromeOptions()

4chrome_options.add_argument(f'--proxy-server=http://{proxy}')

5driver = webdriver.Chrome(options=chrome_options)

6driver.get("https://target-website.com")用轮换代理的话,可以循环代理池,或者用第三方服务自动切换。记得代理失效要捕获异常,换下一个重试。

代理管理与轮换最佳实践

- 代理池要大: 代理越多越好,每次请求或每批都要切换。

- 监控代理健康: 失效代理要及时剔除,失败请求自动重试。

- 别让单一代理扛所有流量: 请求要分散。

- 地理定位要对: 目标网站在哪国,就用对应国家的代理。

- 混合代理类型: 先用数据中心代理,遇到封禁再切住宅代理。

- 远离免费代理: 慢、不稳定、容易被拉黑。

- 遵守服务商限额: 别把代理额度用爆。

代理管理其实很考验细节。但就算代理做得再好,也不是万能的。

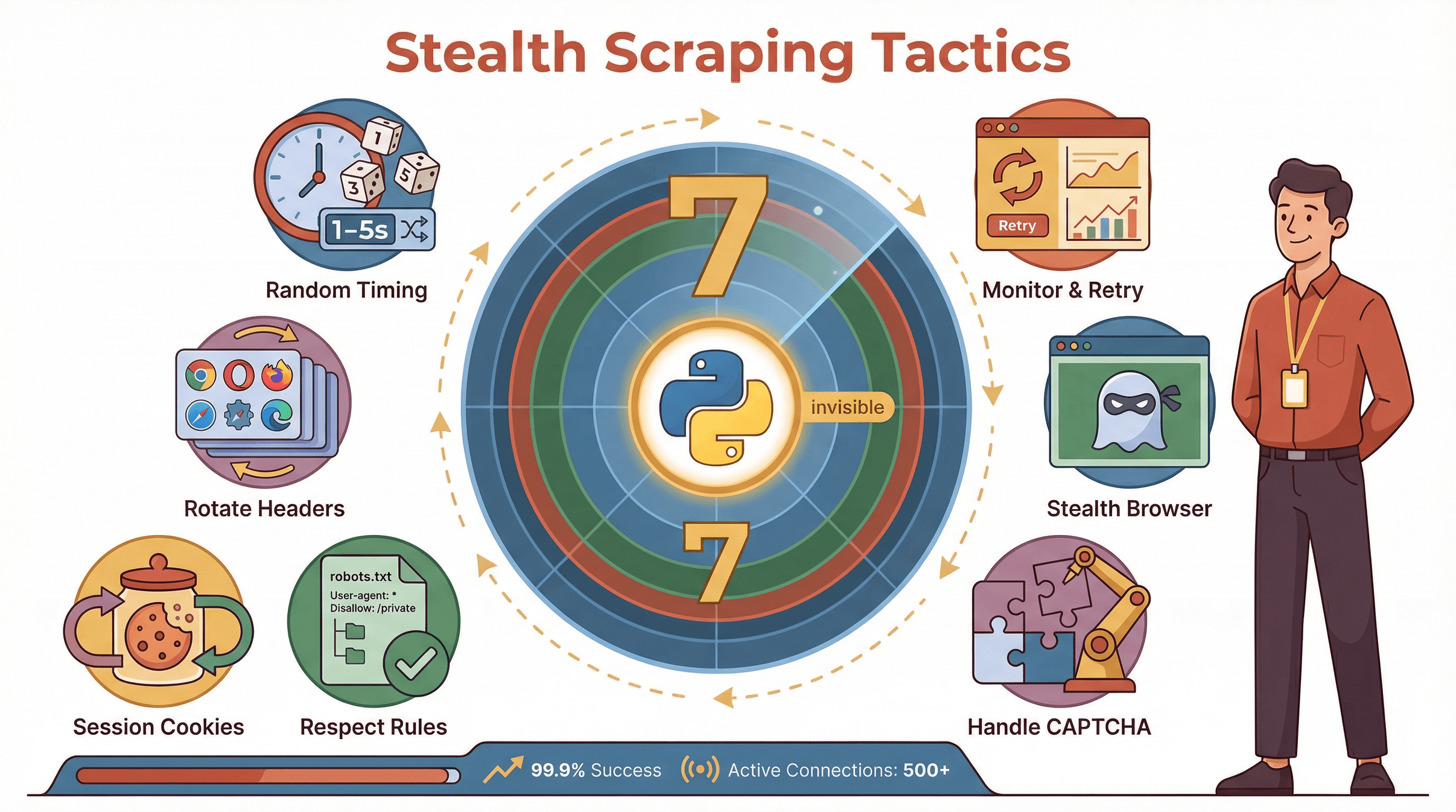

代理之外:Python 防封进阶技巧

想更隐蔽?在代理基础上还可以叠加这些方法:

想更隐蔽?在代理基础上还可以叠加这些方法:

- 请求时间随机化: 不要固定间隔发请求,随机延迟(比如 1–5 秒)。

- 轮换 User-Agent 和请求头: 用真实浏览器的 user-agent 列表,Accept-Language、Referer 等也要随机。

- 用会话和 Cookies: 保持 cookies,模拟真实用户。

- 遵守 Robots.txt,遇到错误要降速: 收到 429 或 503 错误要减速。

- 处理验证码: 集成验证码识别服务,或者遇到验证码时换代理重试。

- 隐身无头浏览器: 用 undetected-chromedriver 或 Playwright 的隐身插件。

- 监控与重试: 记录日志,监控失败率,自动切换代理重试。

Python 有很多好用的库,比如 fake-useragent、requests.Session()、隐身浏览器插件等。

提升效率:AI 工具 vs. 传统 Python 代理爬虫

重点来了。如果你不想折腾代理、请求头、反封禁这些细节,AI 工具 就是你的新捷径。

Thunderbit 是一款 AI 网页爬虫 Chrome 插件,只要两步点击就能从任意网站提取数据——不用写代码、不用配代理、不用维护。只要点“AI 智能识别字段”,AI 会自动分析页面结构,帮你选好要抓取的内容,然后一键“抓取”。代理、反封禁、翻页、子页面采集全都自动搞定。

来对比下两种方式:

| 对比维度 | Python 爬虫(代理) | Thunderbit AI 网页爬虫 |

|---|---|---|

| 上手时间 | 数小时(写代码、配代理、解析) | 几分钟(点一点就好) |

| 技术门槛 | 高(需懂代码、HTTP、代理) | 低(任何人都能用) |

| 防封能力 | 手动(代理、请求头需自己轮换) | 自动(AI+内置代理管理) |

| 维护成本 | 持续维护(代码、代理都要更新) | 极低(AI 自动适配,模板持续更新) |

| 翻页/子页面 | 需手写代码实现 | 一键搞定,AI 自动处理 |

| 数据导出 | 手动(代码导出 CSV、Excel) | 一键导出到 Sheets、Excel、Notion、Airtable |

| 扩展性 | 取决于你的服务器和代理池 | 高(云端并发爬取,多页面同时进行) |

| 成本 | 代理费用+开发时间 | 免费套餐,付费也很实惠 |

| 稳定性 | 不确定(依赖个人配置) | 高(专为商业用户优化) |

Thunderbit 特别适合非技术团队,或者只想快速拿到数据的用户。

实操演示:用 Thunderbit 无障碍抓取数据

我平时用 Thunderbit 抓那些对 Python 脚本不友好的网站,流程很简单:

- 安装 Thunderbit Chrome 插件: 。

- 打开目标网站: 有需要可以先登录,Thunderbit 会继承你的浏览器会话。

- 点击“AI 智能识别字段”: Thunderbit 自动扫描页面,推荐可提取的字段(比如“名称”、“价格”、“邮箱”等)。

- 点击“抓取”: Thunderbit 把数据整理成结构化表格。

- 处理翻页: 开启“抓取所有页面”,Thunderbit 会自动翻页并汇总数据。

- 采集子页面: 用“抓取子页面”功能,进入详情页补充更多字段。

- 导出数据: 一键导出到 Google Sheets、Excel、Notion 或 Airtable。

Thunderbit 会自动帮你搞定所有反封禁细节——IP 轮换、请求节奏控制,甚至能自动应对简单验证码。对大多数商业用户来说,几乎不用操心。

Thunderbit 如何处理翻页与子页面采集

Thunderbit 不只抓首页内容,还能:

- 模拟真人滚动和点击: 针对无限滚动或“下一页”按钮,Thunderbit 会以真人速度浏览。

- 保持会话: 登录后,Thunderbit 会在多页面间保持登录状态。

- 分布式采集: 云端模式下,Thunderbit 可并发抓取多页面,每个页面用不同 IP。

- 动态内容处理: Thunderbit 能执行 JavaScript,确保所有异步加载的数据都能采集到。

- 子页面采集: 可自动点击每个详情页,抓取更多字段并合并到主表。

在网站看来,这就像一群真实用户在正常浏览,而不是机器人刷屏。

Python 代理法与 Thunderbit:商业用户如何选择?

到底哪种方式适合你?快速对比:

| 对比项 | Python + 代理 | Thunderbit |

|---|---|---|

| 上手速度 | 配置慢 | 结果即得 |

| 维护成本 | 高(代码、代理都要管) | 低(AI 自动适配,模板自动更新) |

| 技术门槛 | 需开发者 | 任何人都能用 |

| 被封风险 | 中(不小心就被封) | 低(AI+代理自动防封) |

| 成本 | 代理费+开发时间 | 免费套餐,付费仅 $15/月起 |

| 适用场景 | 定制化、复杂爬取 | 销售、市场、调研团队 |

如果你喜欢折腾、需要高度定制,Python+代理依然很强大。但对大多数商业用户来说,Thunderbit 能极大提升效率,省去代理和反封禁的烦恼。

总结:聪明抓取,事半功倍

我的经验总结(也是我希望早有人告诉我的):

- 代理是 Python 爬虫防封的核心,但管理起来很麻烦。

- 灵活的防封技巧(比如随机延迟、请求头轮换、会话保持)能大幅提升成功率。

- AI 工具如 Thunderbit 把代理、防封、翻页、子页面、导出等繁琐环节全自动化,让你专注于数据本身。

- 选对工具很重要: 追求速度和稳定,Thunderbit 是首选;喜欢代码和自定义,Python+代理依然值得。

想体验高效抓取? 试试吧。更多实用技巧,欢迎关注 。

祝你抓取顺利,IP 永不被封,数据永远新鲜!

常见问题解答

1. Python 网页爬虫最常被封的原因是什么?

最常见的原因是同一 IP 请求太多,或者用默认请求头暴露了“机器人”身份。网站很快就会识别并封禁或限流。

2. 代理如何帮助 Python 爬虫防止 IP 被封?

代理能让请求看起来像是不同用户发的,尤其是轮换代理,对大规模采集特别有效。

3. Python 代理管理有哪些最佳实践?

代理池要大、频繁轮换、监控失效、别用免费代理、代理地区要和目标网站匹配,请求时间和请求头都要随机。

4. Thunderbit 如何无需手动配置代理就防封?

Thunderbit 自动轮换代理、控制请求节奏,并集成多种防封技术。AI 会模拟真实用户行为,自动处理翻页和子页面,一键导出数据,无需写代码。

5. 商业数据采集该选 Python 还是 Thunderbit?

如果你是开发者、需求复杂,Python+代理灵活性高。但对大多数销售、市场、调研团队来说,Thunderbit 更快、更省心、更靠谱。

想体验更聪明的抓取?,告别被封困扰。

延伸阅读