打开终端,输入一条命令,就能看到原始网页数据源源不断地涌出来——这种感觉总有种不过时的酷。对开发者和技术型重度用户来说, 就像那根魔法棒:它是一个看起来不起眼的命令行工具,却默默运行在数十亿台设备上,从云服务器到你的智能冰箱都少不了它。即使到了 2026 年,市面上已经有各种炫目的无代码和 AI 抓取工具,使用 cURL 进行网页抓取依然是任何追求速度、控制力和脚本化能力的人首选的方法。

我多年一直在做自动化工具,也一直帮团队处理网页数据,所以在需要抓页面、调试 API,或者快速验证抓取流程时,我还是会优先用 cURL。在这篇指南里,我会带你完整走一遍 cURL 网页抓取教程,既讲基础,也讲进阶技巧——包括真实的命令示例、实用建议,以及 cURL 擅长什么、又会卡在哪里的清晰判断。如果你更像是业务用户,不想碰命令行,我也会告诉你如何用我们的 AI 网页爬虫 ,只需两次点击,就能从“我需要这些数据”变成“这是我的表格”——完全不用写代码。

我多年一直在做自动化工具,也一直帮团队处理网页数据,所以在需要抓页面、调试 API,或者快速验证抓取流程时,我还是会优先用 cURL。在这篇指南里,我会带你完整走一遍 cURL 网页抓取教程,既讲基础,也讲进阶技巧——包括真实的命令示例、实用建议,以及 cURL 擅长什么、又会卡在哪里的清晰判断。如果你更像是业务用户,不想碰命令行,我也会告诉你如何用我们的 AI 网页爬虫 ,只需两次点击,就能从“我需要这些数据”变成“这是我的表格”——完全不用写代码。

让我们开始,看看为什么 cURL 到了 2026 年依然适合做网页抓取、如何高效使用它,以及什么时候该换上更强大的工具。

什么是 cURL?使用 cURL 进行网页抓取的基础

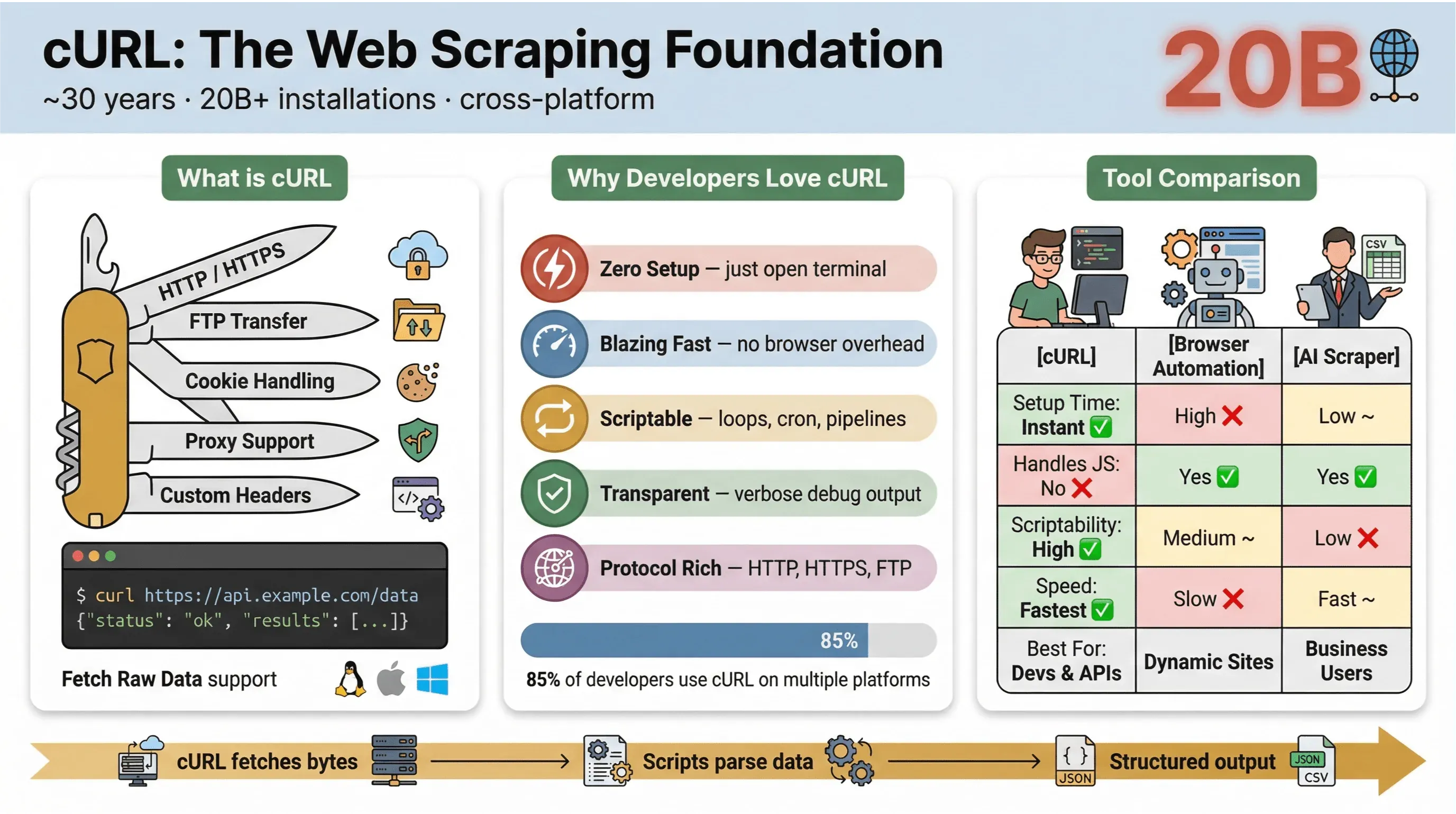

从本质上说, 是一个通过 URL 传输数据的命令行工具和库。它已经存在将近 30 年了(没错,真的),无处不在——内嵌在操作系统里、为脚本提供动力,还悄悄在超过 中处理数据传输。如果你曾经为了抓取网页、测试 API 或下载文件而敲过一条命令,那你大概率已经用过 cURL。

cURL 之所以在网页抓取领域这么受欢迎,原因主要有这些:

cURL 之所以在网页抓取领域这么受欢迎,原因主要有这些:

- 轻量且跨平台: 可运行在 Linux、macOS、Windows,甚至嵌入式设备上。

- 协议支持丰富: 支持 HTTP、HTTPS、FTP 等多种协议。

- 脚本化能力强: 非常适合自动化、定时任务和胶水代码。

- 无需交互: 专为非交互式使用而设计,非常适合批处理和流水线。

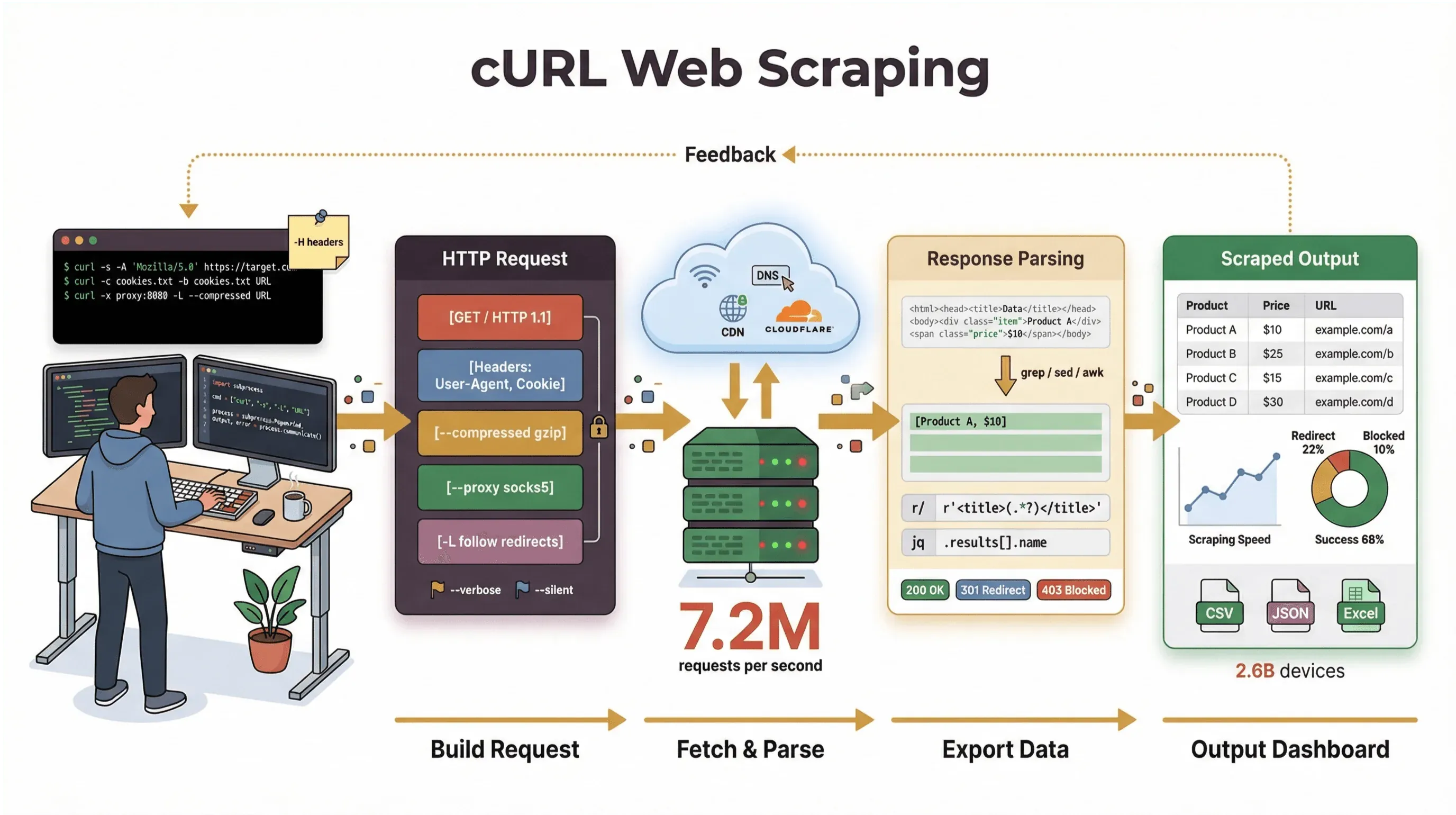

但要说清楚:cURL 的主要职责是获取原始数据——HTML、JSON、图片,等等。它不会替你解析、渲染或整理这些数据。你可以把 cURL 理解为网页抓取的“第一公里”:它把字节带给你,但把它们变成结构化信息,还是得靠其他工具(比如 Python 脚本、grep/sed/awk,或者 AI 网页爬虫)。

如果你想看官方文档,可以看看 。

为什么要用 cURL 做网页抓取?(cURL 网页抓取教程)

既然市面上已经有这么多新工具,为什么开发者和技术用户还是会不断回到 cURL?原因如下:

- 几乎零配置: 不用安装额外依赖,打开终端就能用。

- 速度快: 不用等浏览器加载,立刻就能抓数据。

- 脚本化能力强: 可以轻松循环处理 URL、自动发送请求、串联命令。

- 协议和功能支持丰富: 轻松处理 Cookie、代理、重定向、自定义请求头等。

- 透明度高: 通过 verbose/debug 输出,你能看清每一步到底发生了什么。

在 中,85.7% 的受访者表示会使用 cURL 命令行工具,96.2% 表示在 Linux 上使用它——Linux 依然是 cURL 最主要的使用平台,而且领先幅度很大。

--- 它依然是处理 HTTP 请求、快速抓取数据和排查问题的瑞士军刀。

下面是 cURL 与其他抓取方式的快速对比:

| 功能 | cURL | 浏览器自动化(例如 Selenium) | AI 网页爬虫(例如 Thunderbit) |

|---|---|---|---|

| 设置时间 | 即时 | 较高 | 较低 |

| 脚本化能力 | 高 | 中等 | 低(无需代码) |

| 处理 JavaScript | 否 | 是 | 是(Thunderbit:通过浏览器) |

| Cookie/会话支持 | 手动 | 自动 | 自动 |

| 数据结构化 | 手动(之后再解析) | 手动(之后再解析) | AI/模板驱动 |

| 最适合 | 开发者、快速抓取 | 复杂、动态网站 | 业务用户、结构化导出 |

简单来说:cURL 在快速、可脚本化的数据抓取方面几乎无可匹敌,尤其适合静态页面、API,或者你想自动化简单流程的时候。但一旦你需要解析复杂 HTML、处理 JavaScript,或者导出结构化数据,就该用更专业的工具了。

入门:cURL 网页抓取命令示例

我们直接上手。下面会一步一步介绍如何用 cURL 完成基本的网页抓取任务。

使用 cURL 获取原始 HTML

最简单的场景:抓取网页的 HTML。

1curl https://books.toscrape.com/这条命令会抓取 的首页,这是一个公开的网页抓取演示站点。你会在终端里看到原始 HTML 输出——留意像 <title> 这样的标签,或者 “In stock.” 这样的片段。

将输出保存到文件

想把 HTML 保存下来,之后再解析?用 -o 参数:

1curl -o page.html https://books.toscrape.com/这样你就会得到一个包含完整 HTML 内容的 page.html 文件。非常适合后续分析,或者交给其他工具继续解析。

使用 cURL 发送 POST 请求

需要提交表单或和 API 交互?POST 请求可以用 -d 参数。下面是一个使用 的例子,它是专门用于 HTTP 测试的网站:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"你会收到一个 JSON 响应,其中会回显你提交的数据——非常适合测试和快速验证原型。

查看请求头并调试

有时候你想看响应头,或者调试请求过程:

-

只看请求头(HEAD 请求):

1curl -I https://books.toscrape.com/ -

输出正文时同时包含响应头:

1curl -i https://httpbin.org/get -

详细/调试输出:

1curl -v https://books.toscrape.com/

这些参数能帮你看清底层到底发生了什么——排查问题时尤其重要。

下面是这些命令的速查表:

| 任务 | 命令示例 | 说明 |

|---|---|---|

| 获取 HTML | curl URL | 将 HTML 输出到终端 |

| 保存到文件 | curl -o file.html URL | 将输出写入文件 |

| 查看请求头 | curl -I URL 或 curl -i URL | -I 只看 HEAD,-i 会在正文中包含请求头 |

| 发送表单数据 | curl -d "a=1&b=2" URL | 发送表单编码数据 |

| 调试请求/响应 | curl -v URL | 显示更详细的请求/响应信息 |

想看更多示例,可以查阅 。

进阶:使用 cURL 进行高级网页抓取(cURL 网页抓取)

当你熟悉了基础用法后,cURL 还能提供一整套适合复杂抓取任务的高级功能。

处理 Cookie 和会话

很多网站需要 Cookie 来维持登录会话或跟踪用户。用 cURL,你可以保存并在不同请求之间复用 Cookie:

1# 登录后保存 Cookie

2curl -c cookies.txt https://example.com/login

3# 后续请求使用 Cookie

4curl -b cookies.txt https://example.com/account这样就能模拟浏览器会话,并访问登录后才能看到的页面(前提是没有 JavaScript 验证)。

伪装 User-Agent 和自定义请求头

有些网站会根据你的 User-Agent 或请求头返回不同内容。默认情况下,cURL 会把自己标识为“curl/VERSION”,这可能触发拦截或返回不同页面。要模拟浏览器,可以这样做:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/你还可以设置自定义请求头,比如语言偏好:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/这样能帮助你获取真实浏览器会看到的内容。

使用代理进行网页抓取

如果你需要通过代理路由请求(用于地理位置测试或避免 IP 封禁)?可以使用 -x 参数:

1curl -x http://proxy.example.org:4321 https://remote.example.org/不过一定要负责任地使用代理,并遵守网站的服务条款。

自动化多页抓取

想抓取多个页面,比如分页商品列表?可以用一个简单的 shell 循环:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-$\{p\}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-$\{p\}.html"

4 sleep 1

5done这会抓取 Books to Scrape 目录中的第 2 到第 5 页,并分别保存到不同文件中。(第 1 页就是首页。)

使用 cURL 进行网页抓取的局限:你需要知道的事

虽然我很喜欢 cURL,但它并不是万能钥匙。它的短板主要在这里:

- 不能执行 JavaScript: cURL 不能处理需要 JavaScript 才能渲染内容,或者需要解决反爬挑战的页面()。

- 需要手动解析: 你拿到的是原始 HTML 或 JSON,通常还得靠额外脚本或工具自己解析。

- 会话处理能力有限: 复杂的登录、令牌或多步骤表单很快就会变得很麻烦。

- 没有内置数据结构化: cURL 不会把网页自动变成行、表格或电子表格。

- 容易受反爬检测影响: 现在很多网站都用高级机器人防护(JavaScript、指纹识别、验证码),而这些 cURL 根本绕不过去()。

下面是一个快速对比表:

| 局限 | 仅用 cURL | 现代抓取工具(例如 Thunderbit) |

|---|---|---|

| JavaScript 支持 | 否 | 是 |

| 数据结构化 | 手动 | 自动(AI/模板) |

| 会话处理 | 手动 | 自动 |

| 绕过反爬 | 有限 | 更高级(基于浏览器/AI) |

| 易用性 | 技术型 | 非技术型 |

对于静态页面和 API,cURL 非常出色;但如果目标网站更动态或有防护,就该升级到更完整的工具链了。

Thunderbit vs. cURL:非技术用户最适合的网页抓取方式

现在我们来聊聊 ,我们的 AI 网页爬虫 Chrome 扩展。如果你是销售、市场或运营人员,只想把网站数据直接导进 Excel、Google Sheets 或 Notion,而不想碰命令行,Thunderbit 就是专门为你设计的。

下面是 Thunderbit 和 cURL 的对比:

| 功能 | cURL | Thunderbit |

|---|---|---|

| 用户界面 | 命令行 | 点选式(Chrome 扩展) |

| AI 字段推荐 | 否 | 是(AI 读取页面并建议列) |

| 处理分页/子页面 | 手动编写脚本 | 自动(AI 检测并抓取) |

| 数据导出 | 手动(解析 + 保存) | 直接导出到 Excel、Google Sheets、Notion、Airtable |

| JavaScript/受保护页面 | 否 | 是(基于浏览器抓取) |

| 无需代码 | 否(需要脚本) | 是(人人都能用) |

| 免费额度 | 始终免费 | 免费可抓取最多 6 个页面(试用加成后可达 10 个) |

使用 Thunderbit 时,你只需要打开扩展,点击“AI 推荐字段”,然后让 AI 自己判断要提取哪些数据。你可以抓取表格、列表、商品详情,甚至自动访问子页面。之后,再把数据直接导出到你常用的业务工具里——不用解析,也不用头疼。

Thunderbit 深受全球 信赖,尤其受到销售、电商和房地产团队欢迎,因为他们需要快速拿到结构化数据。

想试试?。

结合 cURL 和 Thunderbit:更灵活的网页抓取策略

如果你是技术用户,其实没必要只选一个工具。实际上,很多团队会把 cURL 和 Thunderbit 一起用,以获得最大灵活性:

- 用 cURL 做原型验证: 先快速测试接口、查看请求头、理解网站的响应方式。

- 用 Thunderbit 扩展规模: 当你需要结构化数据、多页抓取或可重复的工作流时,就切换到 Thunderbit,点选抓取并直接导出。

下面是一个市场调研的示例流程:

- 先用 cURL 抓取几个页面,查看 HTML 结构。

- 找出你想要的数据字段(例如商品名称、价格、评论)。

- 打开 Thunderbit,点击“AI 推荐字段”,让 AI 帮你配置爬虫。

- 抓取所有页面(包括子页面或分页列表),并导出到 Google Sheets。

- 分析、分享并据此行动——完全不需要手动解析。

下面是一个快速决策表:

| 场景 | 用 cURL | 用 Thunderbit | 两者都用 |

|---|---|---|---|

| 快速获取 API 或静态页面 | ✅ | ||

| 需要表格中的结构化数据 | ✅ | ||

| 调试请求头/Cookie | ✅ | ||

| 抓取动态/重 JavaScript 页面 | ✅ | ||

| 构建可重复的无代码流程 | ✅ | ||

| 先做原型,再扩展规模 | ✅ | ✅ | 混合工作流 |

使用 cURL 进行网页抓取的常见挑战与坑点

在你开始大规模使用 cURL 之前,先看看现实里会遇到的挑战:

- 反爬系统: 现在很多网站都使用高级防护(JavaScript 挑战、验证码、指纹识别),cURL 无法绕过()。

- 数据质量问题: HTML 变化、字段缺失或布局不一致,都可能让脚本失效。

- 维护成本: 网站每改一次,你可能都得更新解析逻辑。

- 法律与合规风险: 抓取前一定要查看网站的服务条款、robots.txt,以及相关法律。公开数据并不等于可以随意使用(、)。

- 规模限制: cURL 很适合小任务,但如果要做大规模抓取,你就得自己处理代理、速率限制和错误处理。

排查问题与保持合规的建议:

- 先从有授权或演示站点开始,比如 。

- 尊重速率限制,不要猛烈轰炸接口。

- 除非你有合法依据,否则不要抓取个人数据。

- 如果遇到 JavaScript 或验证码拦截,可以考虑换成像 Thunderbit 这样的浏览器型工具。

分步总结:如何使用 cURL 抓取网站

下面是使用 cURL 进行网页抓取的速查清单:

- 确定目标 URL: 先从静态页面或 API 端点开始。

- 抓取页面:

curl URL - 保存输出到文件:

curl -o file.html URL - 查看请求头/调试:

curl -I URL、curl -v URL - 发送 POST 数据:

curl -d "a=1&b=2" URL - 处理 Cookie/会话:

curl -c cookies.txt ...、curl -b cookies.txt ... - 设置自定义请求头/User-Agent:

curl -A "..." -H "..." URL - 跟随重定向:

curl -L URL - 使用代理(如有需要):

curl -x proxy:port URL - 自动化多页抓取: 使用 shell 循环或脚本。

- 解析并结构化数据: 按需使用额外工具/脚本。

- 如果需要结构化、无代码抓取或动态页面,就切换到 Thunderbit。

结论与关键收获:选择合适的网页抓取工具

使用 cURL 进行网页抓取,在 2026 年对技术用户来说依然是非常有价值的技能——尤其适合快速抓取数据、快速验证原型和自动化任务。cURL 的速度、脚本化能力和普及程度,让它成为每个开发者工具箱里的必备项。但随着网页越来越动态、越来越受保护,以及业务用户越来越希望无需代码就能获得结构化数据,像 这样的工具正在重新定义可能性。

关键收获:

- 在静态页面、API 和快速原型验证中使用 cURL——尤其适合你想要完全控制流程的时候。

- 当你需要结构化数据、处理动态/重 JavaScript 页面,或者想要无代码、适合业务场景的流程时,切换到 Thunderbit(或类似的 AI 网页爬虫)。

- 把两者结合起来能获得最大的灵活性:先用 cURL 验证原型,再用 Thunderbit 放大和结构化数据。

- 始终负责任地抓取——尊重网站条款、速率限制和法律边界。

想看看网页抓取能有多简单?,亲自体验 AI 驱动的数据提取。如果你想了解更多,欢迎查看 ,那里有更多教程、技巧和行业洞察。你可能还会喜欢:

祝你抓取顺利——愿你的数据永远干净、结构化,而且只需一条命令(或一次点击)就能到手。

常见问题

1. cURL 能处理由 JavaScript 渲染的网页吗?

不能,cURL 无法执行 JavaScript。它只会获取服务器返回的原始 HTML。如果某个页面需要 JavaScript 才能渲染内容,或者需要解决反爬挑战,cURL 就无法访问这些数据。这种情况下,请使用像 这样的浏览器型工具。

2. 如何把 cURL 的输出直接保存到文件?

使用 -o 参数:curl -o filename.html URL。这会把响应正文写入文件,而不是显示在终端里。

3. cURL 和 Thunderbit 做网页抓取有什么区别?

cURL 是一个用于获取原始网页数据的命令行工具,非常适合技术用户和自动化。Thunderbit 是一个 AI 驱动的 Chrome 扩展,专为想从任意网站提取结构化数据、处理动态页面并直接导出到 Excel 或 Google Sheets 等工具的业务用户设计——无需代码。

4. 用 cURL 抓取网站合法吗?

根据近期的法院判决,抓取公开数据在美国通常是合法的,但你仍然要查看网站的服务条款、robots.txt 和相关法律。不要在未经许可的情况下抓取个人或受保护数据,并尊重速率限制和伦理规范(、)。

5. 什么时候该从 cURL 切换到像 Thunderbit 这样的更高级工具?

如果你需要抓取动态/重 JavaScript 页面,希望把数据结构化到电子表格里,或者更偏好无代码工作流,Thunderbit 会是更好的选择。cURL 适合快速、技术型任务;Thunderbit 则更适合业务场景和可重复的数据提取。

想了解更多网页抓取技巧和教程,请访问 或查看我们的 。