互联网发展得飞快,简直比我对咖啡的热情还要猛。到了 2026 年,网页数据采集早就不是什么极客专属技能,而是商业智能、AI 训练和自动化的核心环节。无论你是想追踪市场风向、训练新一代大模型,还是盯着竞争对手的价格动态,结构化、实时的网页数据需求都达到了新高度。在这场数据淘金热里,Python 依然是最受欢迎的主力军。凭借庞大的生态圈和简单易懂的语法,Python 成了网页爬虫领域的首选,无论是写个小脚本还是做企业级爬虫项目都能轻松搞定。

但问题来了:选对 python 网页爬虫包,往往决定了项目能不能顺利推进。我见过不少团队因为工具选错,几天都没突破反爬机制,或者在解析乱七八糟的 HTML 时浪费了大量时间,其实用更智能的库几分钟就能解决。作为一个长期深耕 SaaS、自动化和 AI 的从业者(还打造了 让爬虫变得更简单),我为你整理了 2026 年最值得关注的 12 款 python 网页爬虫包——每个工具都有自己的独门绝技、适用场景和实用小技巧。接下来,咱们一起找到最适合你下一个数据项目的“神器”。

为什么选对 python 网页爬虫包这么关键

说真的,并不是所有网页爬虫项目都长一个样。有时候你只需要从静态页面抓几个商品价格,有时候却要和 JavaScript 密集型网站“斗智斗勇”。选对工具能帮你省下大把时间,减少出错,还能有效避开反爬机制或 HTML 结构混乱等常见坑。

Python 在网页爬虫领域的火爆绝非偶然。像 requests 和 urllib3 这样的库每月下载量都超过 ,几乎所有主流爬虫工具都优先支持 Python。但“能力越大,责任越大”:选错工具,项目进度可能比拨号上网还慢;选对工具,数据采集效率高到你咖啡还没凉就搞定。

我们如何评选最佳 python 网页爬虫包

我可不是随便在 PyPI 排行榜上“蒙”出来的。每个包我都从以下几个维度认真评估:

- 性能与并发:能不能高效抓上百甚至上千页面?

- 易用性:新手友好吗?还是得计算机博士才能上手?

- HTML 解析能力:能不能搞定结构混乱的页面?支持 XPath/CSS 选择器吗?数据提取顺不顺手?

- 动态内容支持:能不能应对 JavaScript 渲染的页面,还是只能抓静态内容?

- 社区与文档:有活跃的用户和详细的文档吗?还是只能在 Stack Overflow“自救”?

- 最佳应用场景:适合写小脚本、批量爬取,还是两者兼顾?

此外,我还参考了开发者的真实反馈、最新性能测试,以及自己在实战中的踩坑经验。现在,咱们来逐个认识这些强力选手。

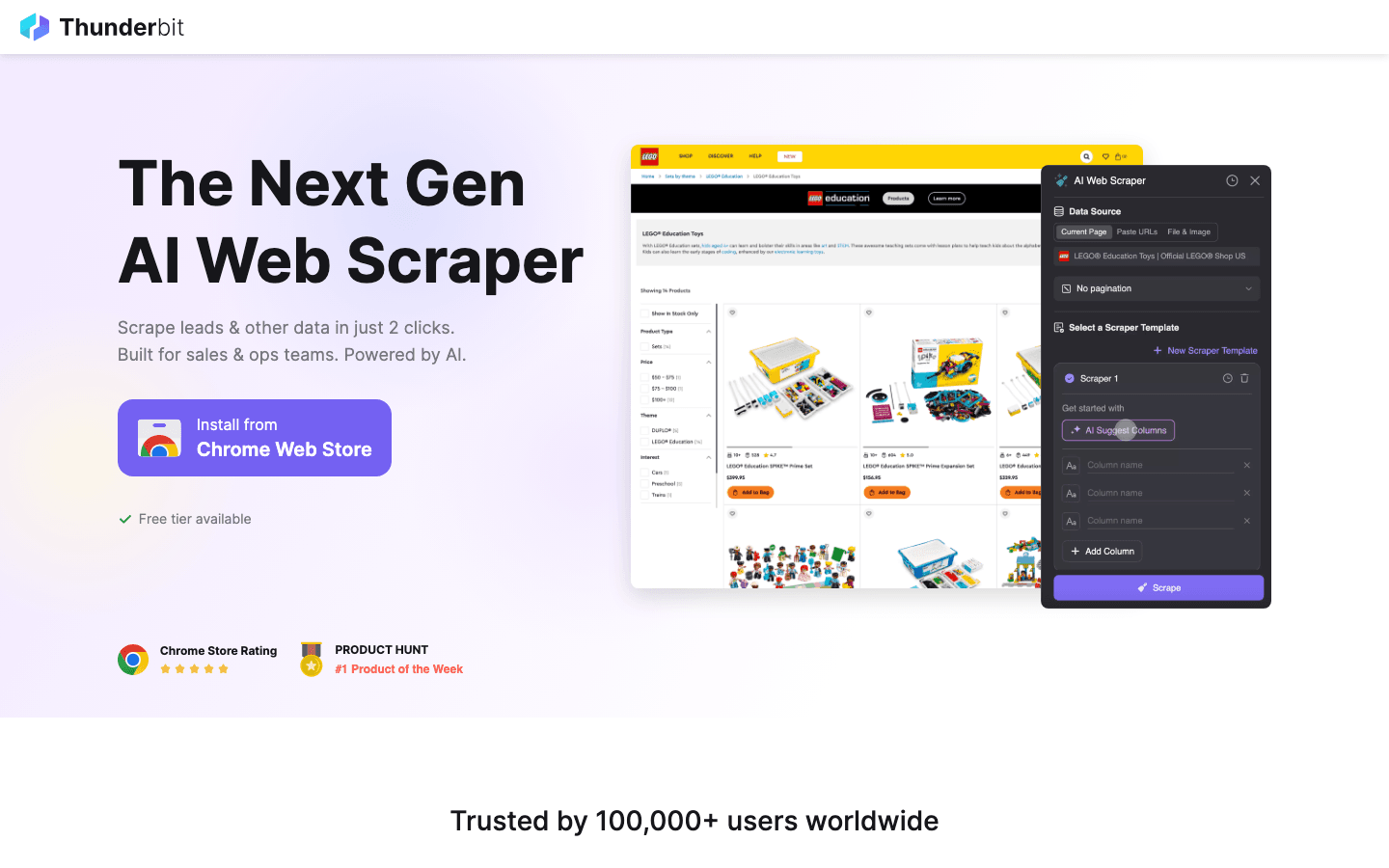

1. Thunderbit

并不是传统意义上的 Python 库,而是一款 AI 驱动的 Chrome 扩展,彻底改变了网页爬虫的玩法。对于追求高效、精准和智能的 Python 开发者来说,Thunderbit 是不可多得的利器。它最大亮点就是:你只需用自然语言告诉 AI 你想要什么数据,剩下的字段推荐、子页面跳转、分页处理,甚至导出到 Excel、Google Sheets、Notion 或 Airtable,全都自动帮你搞定。

并不是传统意义上的 Python 库,而是一款 AI 驱动的 Chrome 扩展,彻底改变了网页爬虫的玩法。对于追求高效、精准和智能的 Python 开发者来说,Thunderbit 是不可多得的利器。它最大亮点就是:你只需用自然语言告诉 AI 你想要什么数据,剩下的字段推荐、子页面跳转、分页处理,甚至导出到 Excel、Google Sheets、Notion 或 Airtable,全都自动帮你搞定。

Thunderbit 特别适合处理结构混乱、数据复杂的网页,比如目录、商品列表,或者 HTML 结构“千奇百怪”的网站。它的 AI 字段推荐功能能自动识别页面内容,智能生成最佳字段;子页面爬取还能自动访问详情页,丰富你的数据集。如果你厌倦了反爬机制的困扰,Thunderbit 还支持浏览器本地和云端爬取,轻松应对各种场景。

Python 开发者喜欢用 Thunderbit 快速原型开发、线索挖掘和市场调研。你可以直接把它导出的数据接入 Python 数据管道,甚至通过 API 实现自动化爬取。虽然不是传统的代码库,但它已经成了希望减少编码、专注数据分析用户的首选。

核心功能:

- AI 智能字段推荐与数据提取

- 支持子页面、分页、PDF/图片等多种内容

- 一键导出 CSV、Excel、Google Sheets、Notion、Airtable

- 无需编程,适合零基础用户和追求效率的 Python 开发者

- 免费版可用,付费方案灵活扩展

适用场景: 线索挖掘、市场调研、快速原型、复杂或结构混乱网页的数据采集。

2. Beautiful Soup

是 Python HTML 解析领域的“元老级”工具。如果你刚入门,或者只需要从静态网页提取数据,Beautiful Soup 是你的好帮手。它特别擅长处理结构混乱的 HTML(俗称“标签汤”),让你轻松应对“不按套路出牌”的网站。

是 Python HTML 解析领域的“元老级”工具。如果你刚入门,或者只需要从静态网页提取数据,Beautiful Soup 是你的好帮手。它特别擅长处理结构混乱的 HTML(俗称“标签汤”),让你轻松应对“不按套路出牌”的网站。

API 简单易用,比如 .find()、.select()、.text 等,配合 requests 抓取网页非常顺畅。底层可选不同解析器(如 lxml 速度快,html5lib 兼容性强)。文档详细,社区庞大。

核心功能:

- 直观、Python 风格的 HTML/XML 解析 API

- 能优雅处理结构不规范的页面

- 支持多种解析器,兼顾速度与兼容性

- 社区活跃,教程丰富

适用场景: 快速脚本、静态页面爬取、新手入门。

3. Scrapy

是大规模自动化爬虫的“王者”。如果你需要批量抓取上百上千页面、管理数据管道或定时任务,Scrapy 是你的不二之选。基于 Twisted 引擎,Scrapy 支持异步高效爬取、数据清洗管道、内置导出 JSON、CSV 或数据库。

是大规模自动化爬虫的“王者”。如果你需要批量抓取上百上千页面、管理数据管道或定时任务,Scrapy 是你的不二之选。基于 Twisted 引擎,Scrapy 支持异步高效爬取、数据清洗管道、内置导出 JSON、CSV 或数据库。

Scrapy 可扩展性强,支持代理、缓存,甚至通过 Splash 或 Selenium 集成有限的 JavaScript 渲染。学习曲线比 Beautiful Soup 陡峭,但如果你想做大规模数据采集,Scrapy 是值得深入掌握的框架。

核心功能:

- 异步高性能爬取

- 内置数据清洗与存储管道

- 多格式导出(JSON、CSV、数据库)

- 社区庞大,插件丰富

适用场景: 大规模、定时爬取项目,数据管道,追求速度与稳定性的用户。

4. Selenium

是抓取 JavaScript 动态网站和交互式页面的首选工具。它能自动化真实浏览器(如 Chrome、Firefox),模拟点击、滚动、表单提交等用户操作。只要数据是 JS 渲染出来的,Selenium 都能搞定。

是抓取 JavaScript 动态网站和交互式页面的首选工具。它能自动化真实浏览器(如 Chrome、Firefox),模拟点击、滚动、表单提交等用户操作。只要数据是 JS 渲染出来的,Selenium 都能搞定。

缺点是速度较慢、资源消耗大——每次爬取都要运行完整浏览器,无法像 Scrapy 那样高并发。但遇到其他工具无能为力的场景,Selenium 往往是“救命稻草”。

核心功能:

- 全浏览器自动化(支持 Chrome、Firefox、Edge 等)

- 处理 JS 渲染内容和复杂交互

- 支持无头模式,提升效率

- 社区成熟,文档详尽

适用场景: 动态网站、交互式页面、自动化登录、处理验证码等复杂操作。

5. PyQuery

把 jQuery 风格的语法带到 Python,让 HTML 解析对有 JS 基础的开发者来说非常亲切。它基于高效的

把 jQuery 风格的语法带到 Python,让 HTML 解析对有 JS 基础的开发者来说非常亲切。它基于高效的 lxml 解析器,支持用 CSS 选择器(如 $('div.classname'))快速定位元素。

PyQuery 适合快速原型开发,代码简洁易读。对于复杂查询,比 Beautiful Soup 更高效,也能与异步工具或 Selenium 结合,扩展更多高级用法。

核心功能:

- jQuery 风格选择器与语法

- 基于 lxml,解析速度快

- 适合 JS 转 Python 的开发者

- 支持链式调用,查询简洁

适用场景: 快速原型、jQuery 爱好者、追求简洁代码的开发者。

6. LXML

是 Python 领域解析 HTML/XML 的“速度之王”。基于 C 语言的

是 Python 领域解析 HTML/XML 的“速度之王”。基于 C 语言的 libxml2 和 libxslt,以高性能和强大的 XPath/CSS 选择器支持著称。处理大文档或复杂查询时,lxml 是最佳选择。

可单独使用,也能作为 Beautiful Soup 或 PyQuery 的底层解析器。API 稍显进阶,但对于大规模任务,速度和灵活性绝对值得。

核心功能:

- Python 中最快的解析速度

- 完全支持 XPath 和 CSS 选择器

- 高效处理大体量、复杂文档

- 可独立使用或作为其他库的解析器

适用场景: 高性能解析、大规模爬取、需要高级查询的项目。

7. Requests

是 Python 发起 HTTP 请求的“标配”。API 简洁直观,抓取网页只需一行

是 Python 发起 HTTP 请求的“标配”。API 简洁直观,抓取网页只需一行 requests.get(url)。支持 cookies、会话、JSON 解码等常用功能。

虽然 Requests 是同步的(每次请求需等待返回),但对于小型脚本和简单爬取任务非常合适。常与 Beautiful Soup 或 lxml 搭配使用,构成经典爬虫组合。

核心功能:

- 简单、Python 风格的 HTTP 请求 API

- 支持 cookies、会话、重定向

- 与解析库无缝集成

- 社区庞大,文档丰富

适用场景: 简单脚本、静态页面爬取、新手快速上手。

8. MechanicalSoup

是一款轻量级库,能自动化简单的浏览器交互,比如表单填写、多步登录等,无需启动完整浏览器。它基于

是一款轻量级库,能自动化简单的浏览器交互,比如表单填写、多步登录等,无需启动完整浏览器。它基于 requests 和 Beautiful Soup,速度远快于 Selenium,适合不依赖大量 JS 的网站。

如果你需要登录、提交表单或简单页面跳转(且网站不是很动态),MechanicalSoup 是很好的折中方案。

核心功能:

- 自动化表单填写与页面导航

- 基于 Requests 和 Beautiful Soup

- 轻量高效,无浏览器负担

- 易用,适合中等交互需求

适用场景: 需要登录或表单提交的网站、简单自动化任务、想避免 Selenium 资源消耗的用户。

9. Aiohttp

是异步高并发 HTTP 请求的利器。如果你需要快速并发抓取上百页面,aiohttp 能让你同时发起多个请求,大幅缩短总耗时。某次测试中,抓取 50 页只需 3 秒,而同步 requests 需 16 秒()。

是异步高并发 HTTP 请求的利器。如果你需要快速并发抓取上百页面,aiohttp 能让你同时发起多个请求,大幅缩短总耗时。某次测试中,抓取 50 页只需 3 秒,而同步 requests 需 16 秒()。

用 aiohttp 需要写 async def 和 await 代码,但对于大规模任务,速度提升非常明显。

核心功能:

- 异步 HTTP 客户端/服务端框架

- 支持会话、cookies、HTTP/2

- 并发请求大幅提速

- 可与异步解析库集成

适用场景: 高速大规模爬取、API 批量采集、熟悉异步编程的开发者。

10. Twisted

是驱动 Scrapy 的事件驱动网络引擎。虽然本身不是爬虫库,但高级用户可直接用 Twisted 构建自定义爬虫、处理非 HTTP 协议或实现超高并发爬虫。

是驱动 Scrapy 的事件驱动网络引擎。虽然本身不是爬虫库,但高级用户可直接用 Twisted 构建自定义爬虫、处理非 HTTP 协议或实现超高并发爬虫。

Twisted 功能强大,但学习曲线较陡,适合需要高度定制或从零开发框架的场景。

核心功能:

- 支持 HTTP、WebSocket、SSH 等多种协议的事件驱动网络

- 支持 SSL、并发、自定义协议

- Scrapy 异步引擎的基础

- 灵活性极高,适合高级用例

适用场景: 自定义协议、开发爬虫框架、需要极致控制的高级用户。

11. Grab

是一站式爬虫工具包,集成了 HTTP 请求、解析、自动化、代理轮换和验证码处理。和 Scrapy 类似,但更易上手,内置代理、缓存和异步爬虫。

是一站式爬虫工具包,集成了 HTTP 请求、解析、自动化、代理轮换和验证码处理。和 Scrapy 类似,但更易上手,内置代理、缓存和异步爬虫。

Grab 的亮点是 Grab:Spider 系统,能用 multicurl 并发发起上千请求。如果你想要比 Scrapy 更简单的全能方案,Grab 值得一试。

核心功能:

- 内置代理、UA 轮换、缓存

- 异步爬虫系统,高并发

- 支持 XPath 解析,模块化架构

- 适合大规模生产环境

适用场景: 一站式爬虫、代理密集型任务、追求强大功能但不想折腾 Scrapy 的用户。

12. Urllib3

是许多 Python HTTP 客户端(如 Requests)的底层引擎。它支持连接池、线程安全、重试机制和对 HTTP 连接的精细控制。大多数开发者间接使用它,但如果你追求极致性能或要开发更高层库,urllib3 是首选。

是许多 Python HTTP 客户端(如 Requests)的底层引擎。它支持连接池、线程安全、重试机制和对 HTTP 连接的精细控制。大多数开发者间接使用它,但如果你追求极致性能或要开发更高层库,urllib3 是首选。

虽然不如 Requests 友好,但稳定可靠,适合进阶开发者。

核心功能:

- 连接池与线程安全

- 精细控制 HTTP 连接

- 作为众多库的基础

- 高性能,适合重复请求

适用场景: 自定义 HTTP 客户端、多线程爬虫、开发 Python HTTP 底层库。

对比表:主流 python 网页爬虫包一览

| 包名 | 易用性 | 性能表现 | 动态内容支持 | 解析能力 | 社区/文档 | 最佳应用场景 |

|---|---|---|---|---|---|---|

| Thunderbit | ★★★★☆ (界面/AI) | 快速 (云/本地) | 支持 (AI) | 智能字段、子页面 | 新兴 (AI 热潮) | 线索挖掘、市场调研、零代码用户 |

| Beautiful Soup | ★★★★★ (极易上手) | 中等 | 不支持 | HTML/XML,容错强 | 超大 | 静态页面、新手入门 |

| Scrapy | ★★☆☆☆ (进阶) | ★★★★★ (极高) | 插件支持 | CSS/XPath、管道 | 大型活跃 | 大规模、定时爬取 |

| Selenium | ★★☆☆☆ (中等) | ★☆☆☆☆ (较慢) | 支持 (全功能) | DOM/JS 全面 | 成熟 | JS 动态、交互网站 |

| PyQuery | ★★★★☆ (jQuery) | 快速 (lxml) | 不支持* | jQuery 选择器 | 一般 | 快速原型、jQuery 开发者 |

| LXML | ★★★☆☆ (进阶) | ★★★★★ (最快) | 不支持 | XPath/CSS、XML | 一般 | 大文档、高级查询 |

| Requests | ★★★★★ (极易上手) | ★★☆☆☆ (同步) | 不支持 | HTTP、JSON | 超大 | 简单脚本、静态页面 |

| MechanicalSoup | ★★★★☆ (易用) | ★★☆☆☆ (同步) | 不支持 | 表单、导航 | 小型 | 登录流程、表单自动化 |

| Aiohttp | ★★☆☆☆ (异步) | ★★★★★ (并发) | 不支持 | 异步 HTTP | 大型 (异步) | 高速并发爬取 |

| Twisted | ★☆☆☆☆ (复杂) | ★★★★★ (自定义) | 不支持 | 网络协议 | 小众 | 自定义框架、高级用户 |

| Grab | ★★★☆☆ (模块化) | ★★★★☆ (异步) | 不支持 | 代理、XPath | 小型 | 一站式、代理/验证码密集型 |

| Urllib3 | ★★★★☆ (底层) | ★★★★☆ (池化) | 不支持 | HTTP、连接池 | 超大 | 自定义客户端、多线程爬虫 |

*PyQuery 可与 Selenium 结合处理动态网站。

如何选择适合你的 python 网页爬虫包

到底该选哪款工具?这里有一份速查表:

- 静态页面、小型任务或新手入门: 推荐 Requests + Beautiful Soup。

- 大规模、定时或生产级爬取: Scrapy 或 Grab(全能型)。

- JS 动态或交互网站: Selenium(或者想要 AI 零代码体验可以选 Thunderbit)。

- 高速并发爬取: Aiohttp(适合熟悉异步编程的同学)。

- 表单自动化或登录流程: MechanicalSoup(简单网站),Selenium(复杂 JS)。

- 高级解析或大文档处理: LXML 或 PyQuery。

- 自定义网络协议或底层开发: Twisted。

- 快速原型、线索挖掘、结构混乱数据: Thunderbit。

当然,灵活组合也很常见——比如用 Selenium 渲染页面,再交给 Beautiful Soup 或 PyQuery 解析。

总结:用对 Python 工具,让网页爬虫如虎添翼

2026 年的网页爬虫比以往更强大、更不可或缺。选对 python 爬虫包,你就能把互联网的“杂乱无章”转化为企业、科研或创新项目的高价值数据。不管你是资深开发者还是刚入门的数据爱好者,这份清单里总有一款适合你。

想体验 AI 驱动、零代码的爬虫?。如果你还想了解更多技巧、深度解析和实用教程,欢迎关注 ,掌握最新的网页爬虫、自动化和数据工作流。

祝你爬虫顺利——愿你的选择器总能命中目标,代理永不失效,数据像你的代码一样干净!

常见问题

1. 新手最适合用哪款 python 网页爬虫包?

对于大多数新手, 搭配 是最简单的入门组合。API 直观、教程丰富,能胜任大部分静态页面采集。

2. 如何用 Python 抓取 JS 动态网站?

可以用 自动化真实浏览器,或者试试 ,AI 驱动、零代码,轻松应对动态内容。大规模需求可以用 Scrapy 搭配 Splash 或 Selenium。

3. 哪个包适合大规模、高速爬取?

专为大规模异步爬取设计。如果你追求更高速度且熟悉异步编程, 是并发请求的首选。

4. 这些包可以组合使用吗?

当然可以!很多开发者用 Requests 或 Selenium 抓取页面,再用 Beautiful Soup、lxml 或 PyQuery 解析。Thunderbit 导出的数据也能直接接入 Python 脚本做进一步分析。

5. Thunderbit 是 Python 库还是独立工具?

Thunderbit 是一款 AI 驱动的 Chrome 扩展和平台,不是传统 Python 库。但它导出的 CSV、Excel、Sheets、Notion、Airtable 等格式可无缝接入 Python 数据管道,是 Python 开发者的强力助手。

想在网页爬虫领域保持领先?欢迎订阅 ,关注 ,获取更多实用指南、对比和自动化技巧。

延伸阅读