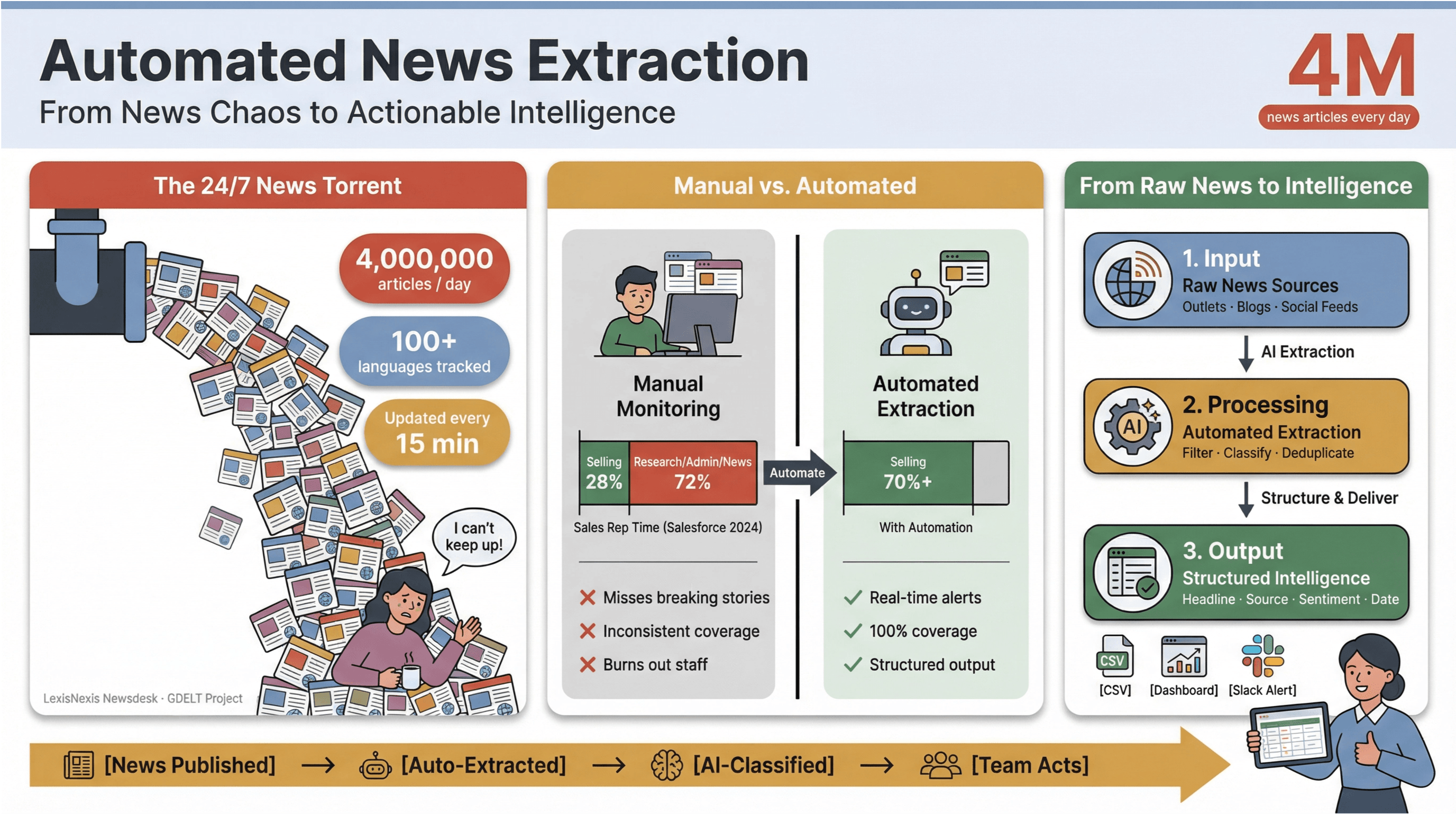

如今数字新闻的节奏快到让人有点“崩溃”。几乎每一分钟,都有成千上万条标题被发布、更新,甚至悄悄改动——来源包括主流媒体、垂直博客,还有社交信息流。举个直观的例子, 每天要吞吐超过 400 万篇新闻;而 能追踪覆盖 100+ 种语言 的新闻,并且每 15 分钟 刷新一次全球数据流。对媒体从业者、研究人员或商业情报团队来说,想靠人工跟上这股信息洪流,简直像拿咖啡杯去舀一艘正在进水的船——怎么舀都舀不完。

我亲眼见过手动盯新闻到底有多耗时、又多“吃”团队资源。销售团队一周里真正用于“卖”的时间不到三分之一——Salesforce 的数据是——剩下的时间都被调研、行政事务,以及没完没了地切换新闻标签页给吞掉了。也正因如此,自动化新闻提取成了现代团队的“隐藏王牌”:它能把 24/7 新闻周期的混乱,直接变成结构化、可执行的情报——既不把员工逼到崩溃,也不漏掉最关键的报道。

下面我们会深入聊聊:自动化新闻提取到底是什么、为什么对需要实时新闻数据的人至关重要,以及如何用最佳工具搭建一个稳定且合规的工作流(也会讲讲 怎么把流程做得出奇简单——就算是我妈这种非技术用户也能轻松上手)。

自动化新闻提取:为什么现代新闻机构离不开它

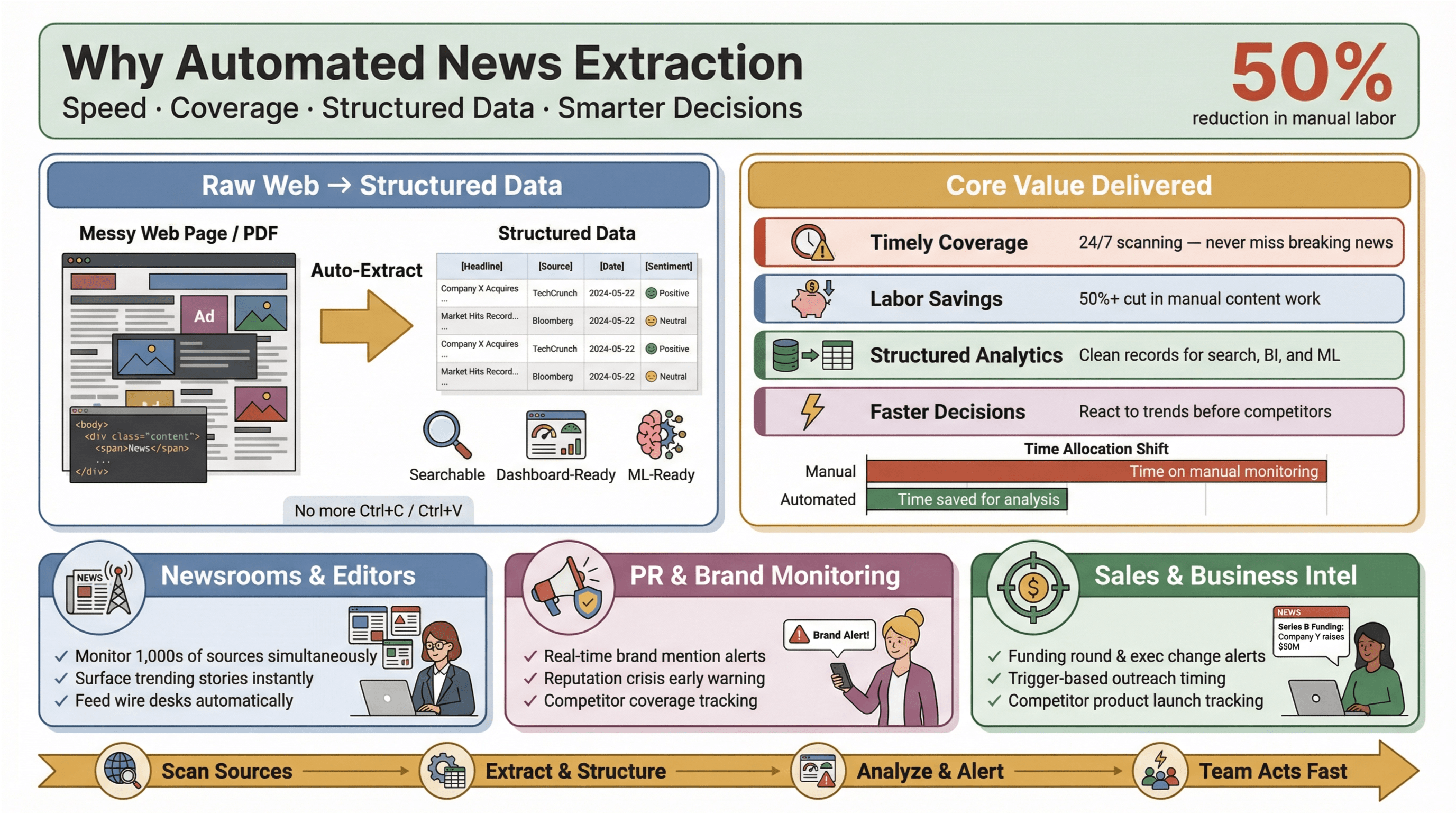

自动化新闻提取,顾名思义,就是用软件 自动采集新闻内容,并把它转换成结构化、可检索的数据——把杂乱的网页或 PDF,变成“行和列”的表格数据。在实际应用里,这意味着你可以同时监控数百(甚至数千)个来源,提取标题、时间戳、作者、正文等关键字段,并把数据送进仪表盘、告警系统或后续分析流程——全程不再需要 Ctrl+C / Ctrl+V。

为什么这很重要?因为在当下的新闻环境里,速度就是一切。无论你是新闻编辑、需要盯品牌提及的公关负责人,还是追踪竞品动态的商业分析师,“先知道”往往决定了你是抓住机会,还是只能事后补课。自动化提取工具让小团队也能“以小博大”——从全网获取实时新闻数据,显著减少人工负担,并把真正重要的内容优先呈现出来。

而且效果是实打实的:研究显示,自动化能将内容更新相关的人工工作量 至少减少 50%,把时间还给分析与决策。

自动化新闻提取在新闻行业的核心价值

说点更落地的:自动化新闻提取到底能为新闻机构和业务团队带来什么?

- 及时且全面的覆盖: 不再因为忘了看某个源而错过突发新闻。自动化工具 24/7 扫描信息源,让你随时掌握动态,不怕漏看。

- 节省人力与成本: 中小团队也能监控与大机构同等数量的来源——无需雇一堆实习生来“搬砖”。

- 为分析准备好的结构化数据: 不用在非结构化文章里翻找,你拿到的是干净、可直接用于搜索、看板和机器学习的记录。

- 更快、更聪明的决策: 实时新闻数据让你能在竞争对手之前,对市场变化、公关危机或新趋势做出反应。

以公关与传播为例, 和 都把实时媒体监测定位为“护住声誉、快速应对负面报道”的关键能力。对销售来说,实时新闻提醒可以变成拓客的“情境卡片”——比如融资、管理层变动、产品发布等触发事件,帮助你在最合适的时机发起触达。

不同场景下如何选择合适的新闻抓取工具

新闻抓取工具并不都一样。选对工具取决于你的目标、技术熟悉度,以及你关注的新闻类型。下面这套框架可以帮你快速对上号:

评估易用性与可访问性

对大多数业务用户和记者来说,易用性真的没得谈。你需要的是开箱即用、无需写代码、也不必复杂配置的工具。像 、 和 这类无代码/低代码平台,支持可视化搭建爬虫——点一点、选一选就能提取数据,属于“人人都能上手”的那种。

尤其是 Thunderbit 的 两步流程 很突出:先描述你想要什么数据,让 AI 自动建议字段,然后点击“Scrape”即可。非技术用户也能在几分钟内搭好新闻数据管道,而不是折腾几个小时还没搞定。

安全与数据隐私考量

数据越强大,责任越重大。新闻抓取工具可能会接触到敏感内容,因此 安全与合规 必须放在第一位。建议重点关注:

- 数据加密(传输中与静态存储)

- 清晰的隐私政策(例如 Thunderbit 明确表示不出售用户数据,并且只访问你选择抓取的内容)

- 细粒度权限控制(尤其是浏览器扩展,务必查看它能访问哪些数据)

- 遵守本地法规(GDPR、CCPA,以及欧盟用户需关注 )

想更安心的话,优先选口碑好的供应商,核对扩展权限,并把访问范围控制在“必要最小化”,别一上来就“全开”。

按新闻类型与行业需求匹配工具

有些工具在特定新闻领域更擅长,选对会更“贴合”:

- 金融: 与 等 API 提供聚类、情绪分析与事件检测,适合金融新闻场景。

- 科技与创业: 用 Thunderbit 或 Octoparse 做定向抓取,更适合盯垂直博客、新闻稿或活动列表。

- 政治与政策: 与 这类授权数据库能访问高质量付费源与历史档案。

如果你需要同时覆盖主流、垂直与国际来源(包括没有 API 的网站),更灵活、AI 驱动的爬虫(如 Thunderbit)通常更合适,适配面更广。

Thunderbit 在实时新闻数据提取上的独特优势

接下来聊聊为什么 会成为自动化新闻提取的优选——尤其适合想要 实时新闻数据、又不想被技术细节折磨到头大的人。

Thunderbit 是一款 AI 网页爬虫 Chrome 扩展,面向需要从任意网站获取最新、结构化新闻内容的业务用户、记者与分析师。它之所以成为我的常用工具,主要因为:

- AI Suggest Fields: Thunderbit 会读取新闻页面并自动推荐最适合提取的列——标题、时间、作者、摘要等,无需手动调选择器或模板,省掉一堆“手工活”。

- 子页面抓取: 只抓标题不够?Thunderbit 可以逐条打开新闻链接,提取正文、实体、标签,并合并成一张结构化表。

- 批量导出与即时更新: 一键导出到 Excel、Google Sheets、Airtable 或 Notion,告别复制粘贴和 CSV 折腾。

- 定时爬虫: 支持按小时、按天或自定义间隔定时运行,让数据持续保持新鲜,适合突发新闻、市场监测与长期研究。

- 适应性强: Thunderbit 的 AI 更能应对页面布局变化与长尾站点,减少“爬虫坏了要修”的时间,把精力留给分析。

它在全球拥有超过 且评分 4.8 星,被广泛用于公关监测、竞品情报等场景。

AI 驱动的字段识别与子页面抓取

Thunderbit 的一大亮点是 AI 驱动的字段识别。点击 “AI Suggest Fields”,它就会扫描新闻页面,自动识别标题、日期、作者、摘要等关键字段。你也可以微调或新增自定义字段(例如:“如果提到季度业绩,就把文章标记为‘财报’”),剩下的交给 AI 处理,整体体验很“顺”。

子页面抓取对新闻场景尤其关键:先在首页或栏目列表抓取标题,再让 Thunderbit 逐条访问文章 URL,提取完整正文、实体,甚至图片。最终你得到的是 更完整、更丰富的新闻记录——可直接用于搜索、看板或下游 AI 分析。

批量导出与即时更新

Thunderbit 让导出变得非常省心。一键即可把结构化新闻流发送到 Google Sheets、Airtable、Notion,或下载为 CSV/Excel。对长期泡在表格或 BI 工具里的团队来说,这能省下大量时间。

同时,借助 定时爬虫,你可以设置每小时、每天或自定义频率自动运行,确保新闻数据始终最新。不必再等 Google Alerts 慢半拍、甚至晚几天才收录。

解决实时新闻数据方案中的运营挑战

即便工具再好,实时新闻提取也会遇到一些常见难题。下面是应对思路:

管理延迟与数据新鲜度

- 按新闻“速度”设置抓取频率: 突发新闻建议每 15–30 分钟跑一次(对齐 )。节奏较慢的领域,每天或每小时即可。

- 监控发布时间与抓取时间的差值: 记录文章发布到被系统抓取的延迟。如果延迟变大,可能是被拦截或抓取变慢。

- 针对“静默修改”二次抓取: 新闻常在发布后更新。建议 24 小时后再抓一次,以捕捉更正或悄悄改动()。

处理 API 限制与来源差异

- 遵守 API 配额: 使用新闻 API 时要关注限流,尽量分散请求并做缓存(参考 )。

- 去重与规范化: 同一新闻可能对应多个 URL,或被更新后产生新版本。抓取 canonical URL,并用哈希(如 标题+日期)避免重复(参考 )。

- 应对动态内容: 对无限滚动或懒加载站点,选择支持动态渲染的工具,并持续关注布局变化(参考 )。

智能新闻数据分析:AI 与机器学习的作用

把新闻抓下来只是第一步。真正的价值在于 分析并据此行动——这正是 AI 与机器学习的强项,能把“信息”变成“洞察”。

- 实体抽取: 用 NLP 提取文章中的人物、组织与地点等实体(参考 )。

- 主题分类: 自动按主题、情绪或紧急程度打标签,让看板与告警更聪明(参考 )。

- 事件聚类: 将不同媒体的重复或相关报道聚合起来,帮助你看到“全局”,而不是被相似标题淹没。

- 个性化与定向: 用实时新闻数据做受众分层、优化广告定向或内容推荐,提升互动与 ROI。

例如,公关团队会用实时新闻分析提前发现潜在危机;销售团队则会用融资、招聘高管等“触发事件”来丰富线索并提升转化。

自动化新闻提取最佳实践清单

下面是一份便于快速对照的清单,帮助你的新闻提取管道长期稳定运行,不至于三天两头“掉链子”:

| 最佳实践 | 为什么重要 | 如何落地 |

|---|---|---|

| 高频定时抓取 | 降低数据延迟,捕捉突发新闻 | 按新闻节奏设置频率(例如快节奏领域每 15 分钟一次) |

| 使用 AI 驱动提取 | 适应页面改版,减少配置成本 | 选择 Thunderbit、Diffbot、Zyte API 等工具 |

| 去重与规范化 | 避免重复告警,保证数据干净 | 采集 canonical URL,用哈希做去重 |

| 监控提取质量 | 及时发现字段缺失、漂移或失败 | 跟踪完整记录占比、延迟与错误率 |

| 遵守法律与合规边界 | 降低法律风险,维护信任 | 优先官方 API/Feed,审阅条款,尽量少采集个人数据 |

| 导出为结构化格式 | 便于下游分析 | CSV、Excel、Sheets、Notion、Airtable |

| 针对编辑做二次抓取 | 捕捉发布后的修改 | 24 小时/1 周后回访文章(参考 GDELT 模型) |

| 加固数据链路安全 | 保护敏感数据 | 加密、访问控制、选择可信工具 |

搭建稳定的自动化新闻提取工作流

想把新闻数据做成自己的“黑盒系统”?可以按下面步骤搭建,照着做基本不会踩大坑:

- 确定信息源: 列出要监控的新闻网站、博客或 API。

- 配置提取规则: 用 Thunderbit 或其他工具定义字段(用 AI Suggest Fields 会非常省事)。

- 设置抓取频率: 按新闻节奏安排——突发新闻按小时甚至更频繁,慢节奏领域按天即可。

- 子页面补全: 对每条标题抓取全文正文、实体与标签。

- 去重与标准化: 采集 canonical URL、对记录做哈希、统一字段格式。

- 导出与集成: 把结构化数据送到 Excel、Google Sheets、Airtable 或 Notion 做分析。

- 监控与迭代: 跟踪提取质量,关注页面改版并及时调整。

- 保持合规: 审阅条款、遵守 robots.txt,并尽量减少个人数据采集。

如果用流程图来理解:

Sources → Extraction (AI fields) → Subpage enrichment → Deduplication → Export → Analysis/Alerts → Monitoring

结论与关键要点

自动化新闻提取早已不只是“锦上添花”,而是任何想在“新闻每分钟都在变化”的世界里保持领先的必备能力。遵循最佳实践并选对工具,你就能把数字新闻的“消防水龙头”变成稳定输出的结构化情报流,节奏更顺畅。

关键要点:

- 在线新闻的规模与速度决定了必须自动化,人工监控根本跟不上。

- 自动化新闻提取能节省时间、降低成本,让小团队也能拥有接近大机构的覆盖能力。

- 选工具要在易用性、安全性与适应性之间取得平衡——Thunderbit 以 AI 驱动的简单操作与实时导出能力脱颖而出。

- 工作流要围绕新鲜度、去重、合规与质量监控来设计,才能持续产出可靠、可执行的新闻数据。

- AI 与机器学习能进一步放大价值,实现更聪明的定向、个性化与决策支持。

如果你还在复制粘贴标题,或等 Google Alerts 慢慢追上进度,是时候升级了。,亲自体验自动化新闻提取可以有多简单。想看更多技巧、工作流与深度解析,也可以访问 。

常见问题(FAQs)

1. 什么是自动化新闻提取?它如何工作?

自动化新闻提取是指用软件采集新闻文章,并将其转换为结构化数据(如表格或 JSON),用于分析、检索或告警。像 Thunderbit 这样的工具会用 AI 自动识别关键字段(标题、时间戳、作者、正文等),并从网页或 API 中自动提取。

2. 为什么实时新闻数据对企业如此重要?

实时新闻数据能帮助企业快速响应市场事件、公关危机或竞争对手动作。无论你在销售、公关还是研究岗位,新闻越新,你的决策就越快、越准,也更容易领先竞争对手。

3. Thunderbit 如何让非技术用户更轻松地做新闻抓取?

Thunderbit 的流程非常简单:先描述你想要的数据,再让 AI 自动建议字段。配合子页面抓取与一键导出到 Excel/Google Sheets 等功能,即使不懂技术,也能在几分钟内搭建稳定的新闻数据管道。

4. 新闻抓取有哪些法律与合规注意事项?

务必查看目标网站的服务条款;能用官方 API 或 Feed 时优先使用;遵守 robots.txt 指令。未经许可不要抓取需要登录或付费墙的内容,并尽量减少个人数据采集,以符合隐私法规要求。

5. 如何确保新闻提取工作流长期稳定可靠?

定期抓取、监控提取质量,并选择能适应页面改版的工具(例如 Thunderbit 的 AI 驱动提取)。同时做好去重,跟踪发布时间与抓取时间的延迟,并为失败或字段缺失设置告警,确保管道健康、数据持续更新。

了解更多