网页数据抓取已经从以前的小众技能,变成了销售、运营、市场调研等领域不可或缺的核心能力。随着网络数据量的爆发式增长——全球数据生成量在2019到2023年间激增了近193%(),难怪现在有81%的企业把数据当作决策的“核心”。但现实是,95%的组织都觉得处理非结构化数据(比如杂乱的HTML)特别头疼。我见过不少团队被无休止的复制粘贴折磨,只为了把网页信息整理进表格——相信我,这绝对不是高效的做法。

这时候,Python 的 BeautifulSoup 就能大显身手了。在这篇实操教程里,我会带你一步步用 BeautifulSoup 实现网页数据抓取,并给出一个可以直接用在业务场景的 Python Beautiful Soup 示例。而且,为了让你效率翻倍,我还会演示如何把 BeautifulSoup 和我们的 AI 网页爬虫 结合起来,让你的数据抓取流程更快、更规范,无论你有没有编程基础都能轻松上手。

什么是 BeautifulSoup?为什么用它做网页爬虫?

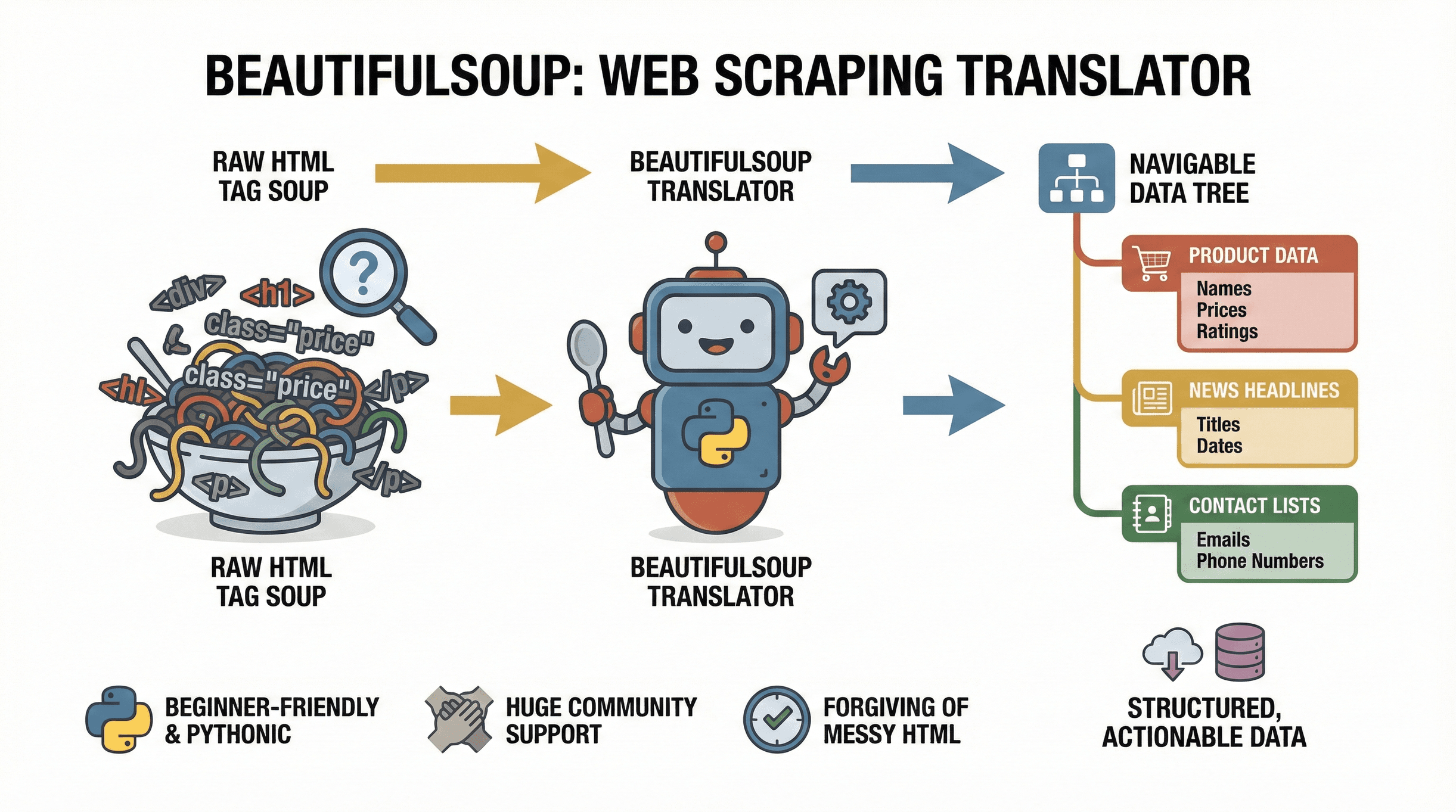

先来了解下基础。 是一个 Python 库,专门用来解析 HTML 和 XML 文档。你可以把它想象成“网页翻译官”:它能把网页的“标签乱炖”变成一棵清晰的树状结构,让你轻松定位、提取和处理所需数据。不管是抓取电商网站的商品价格、收集新闻标题,还是批量采集企业名录,BeautifulSoup 都是把网页内容转成结构化数据的利器。

先来了解下基础。 是一个 Python 库,专门用来解析 HTML 和 XML 文档。你可以把它想象成“网页翻译官”:它能把网页的“标签乱炖”变成一棵清晰的树状结构,让你轻松定位、提取和处理所需数据。不管是抓取电商网站的商品价格、收集新闻标题,还是批量采集企业名录,BeautifulSoup 都是把网页内容转成结构化数据的利器。

为什么它这么受欢迎?首先,它对新手非常友好。BeautifulSoup 能容忍各种不规范的 HTML(毕竟网上的网页大多都不太规整),而且语法简洁,几行代码就能搞定数据抓取。它还有庞大的用户社区和丰富的教程资源,遇到问题随时都能找到答案。

BeautifulSoup 常见的应用场景包括:

- 抓取电商页面的商品名称、价格、评分等信息

- 提取新闻网站的标题、作者、发布时间

- 解析表格或名录(比如公司列表、联系人信息)

- 批量收集邮箱、电话号码等联系方式

- 监控网页更新(比如价格变动、新职位发布等)

只要你的数据存在于静态 HTML 页面,BeautifulSoup 就是网页爬虫的好帮手。

BeautifulSoup 做网页爬虫的独特优势

市面上 Python 网页爬虫库不少——为什么要选 BeautifulSoup?它的优势如下:

- 简单易用: BeautifulSoup 轻量级、上手快,无需搭建复杂框架,也不用写一堆模板代码,非常适合新手或临时性的小型抓取任务。

- 容错性强: 能处理各种格式混乱、结构不规范的 HTML。

- 灵活自由: 不强制你用特定的爬取架构,直接传入 HTML 就能提取需要的数据。

- 易于集成: 能和

requests(网页请求)、csv(数据保存)、pandas(数据分析)等 Python 库无缝配合。

和其他工具对比:

| 工具 | 最适合场景 | 优点 | 缺点 |

|---|---|---|---|

| BeautifulSoup | 静态 HTML 解析、新手入门 | 简单、快速上手、容错强、灵活 | 不适合处理大量 JavaScript 动态页面 |

| Scrapy | 大规模、异步任务 | 功能强大、可扩展性高、内置爬取机制 | 学习曲线陡峭、配置较多 |

| Selenium | 动态内容、JS 渲染页面 | 能与 JS 交互、可自动化表单、点击按钮等操作 | 速度慢、资源消耗大 |

如果你刚入门,或者只需要快速解析静态网页,BeautifulSoup 就像网页爬虫界的“瑞士军刀” ()。遇到复杂或动态网页,可以结合 Selenium 或 Scrapy,但 BeautifulSoup 是学习网页爬虫的最佳起点。

配置 Python 环境,安装 BeautifulSoup

准备好动手了吗?下面是环境搭建流程:

-

安装 Python: 去 下载最新版。

-

创建虚拟环境(可选但推荐):

1python -m venv venv 2source venv/bin/activate # Windows 用 venv\Scripts\activate -

安装 BeautifulSoup 及依赖库:

1pip install beautifulsoup4 requests lxml html5libbeautifulsoup4:核心库requests:用来获取网页内容lxml或html5lib:更快、更稳定的 HTML 解析器

-

常见问题排查:

- 如果提示“pip not found”,试试

pip3或py -m pip。 - Mac/Linux 可能需要加

sudo。 - Windows 用户请确保 Python 已加入 PATH。

- 如果提示“pip not found”,试试

测试环境是否配置成功:

1from bs4 import BeautifulSoup

2import requests

3html = requests.get("http://example.com").text

4soup = BeautifulSoup(html, "html.parser")

5print(soup.title)如果输出 <title>Example Domain</title>,说明环境没问题()。

Python Beautiful Soup 实战示例

下面用一个真实案例演示 python beautiful soup 的用法。假设你想抓取某新闻网站的最新头条:

1. 获取网页内容

1import requests

2from bs4 import BeautifulSoup

3url = "https://www.bbc.com/news"

4response = requests.get(url)

5html = response.text2. 解析 HTML

1soup = BeautifulSoup(html, "html.parser")3. 分析网页结构

打开浏览器开发者工具(右键→检查),找到包含新闻标题的标签。很多新闻网站的标题都在 <h3> 标签里,并带有特定 class。

例如:

1<h3 class="gs-c-promo-heading__title">Headline Title</h3>4. 提取数据

1headlines = soup.find_all("h3", class_="gs-c-promo-heading__title")

2for h in headlines:

3 print(h.get_text(strip=True))这样就能打印出页面上的所有新闻标题。

5. 保存数据到 CSV

把这些标题保存下来,方便后续分析:

1import csv

2with open("headlines.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.writer(file)

4 writer.writerow(["headline"])

5 for h in headlines:

6 writer.writerow([h.get_text(strip=True)])现在你就有了一个可以直接导入 Excel 或 Google Sheets 的 CSV 文件。

如何分析 HTML 结构,高效提取数据

写代码前,务必先分析网页的 HTML 结构。方法如下:

- 打开开发者工具: 右键页面,选择“检查”。

- 定位数据元素: 鼠标悬停查看哪些标签包含你需要的信息(比如标题、价格、作者等)。

- 记录标签和 class: 关注如

class="product-title"或id="main-content"这类唯一标识。 - 测试选择器: 用 BeautifulSoup 的

.find()、.find_all()或.select()方法精准定位元素。

小技巧:用 soup.prettify() 在 Python 控制台打印出格式化的 HTML,方便阅读。

用 BeautifulSoup 提取并结构化数据

比如你想同时抓取博客页面的标题和作者:

1articles = soup.find_all("article")

2data = []

3for article in articles:

4 title = article.find("h2").get_text(strip=True)

5 author = article.find("span", class_="author").get_text(strip=True)

6 data.append({"title": title, "author": author})这样你就得到了一个字典列表,方便导出 CSV 或进一步分析。

提取链接、图片等属性也很简单:

1for link in soup.find_all("a"):

2 print(link.get("href"))提取图片:

1for img in soup.find_all("img"):

2 print(img.get("src"))数据导出:从 Python 到 Excel 或 CSV

数据结构化后,导出也很方便。用 csv 模块:

1import csv

2with open("articles.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.DictWriter(file, fieldnames=["title", "author"])

4 writer.writeheader()

5 for row in data:

6 writer.writerow(row)如果你喜欢 pandas:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv("articles.csv", index=False)

4df.to_excel("articles.xlsx", index=False)建议始终用 UTF-8 编码,避免出现乱码,尤其是处理多语言数据时。

案例:用 BeautifulSoup 抓取新闻网站数据

下面以抓取新闻网站文章标题、作者和发布时间为例,演示 python beautiful soup 的实际应用。

假设你想抓取 的文章数据:

1import requests

2from bs4 import BeautifulSoup

3import csv

4url = "https://edition.cnn.com/world"

5response = requests.get(url)

6soup = BeautifulSoup(response.content, "html.parser")

7articles = soup.find_all("article")

8data = []

9for article in articles:

10 title_tag = article.find("h3")

11 date_tag = article.find("span", class_="date")

12 author_tag = article.find("span", class_="author")

13 title = title_tag.get_text(strip=True) if title_tag else ""

14 date = date_tag.get_text(strip=True) if date_tag else ""

15 author = author_tag.get_text(strip=True) if author_tag else ""

16 data.append({"title": title, "date": date, "author": author})

17with open("cnn_articles.csv", "w", newline='', encoding="utf-8") as file:

18 writer = csv.DictWriter(file, fieldnames=["title", "date", "author"])

19 writer.writeheader()

20 for row in data:

21 writer.writerow(row)这段代码会抓取最新文章的标题、日期和作者,并保存为 CSV 文件。你可以用这些数据做竞品监控、趋势分析或内容研究,灵活应用于各种业务场景。

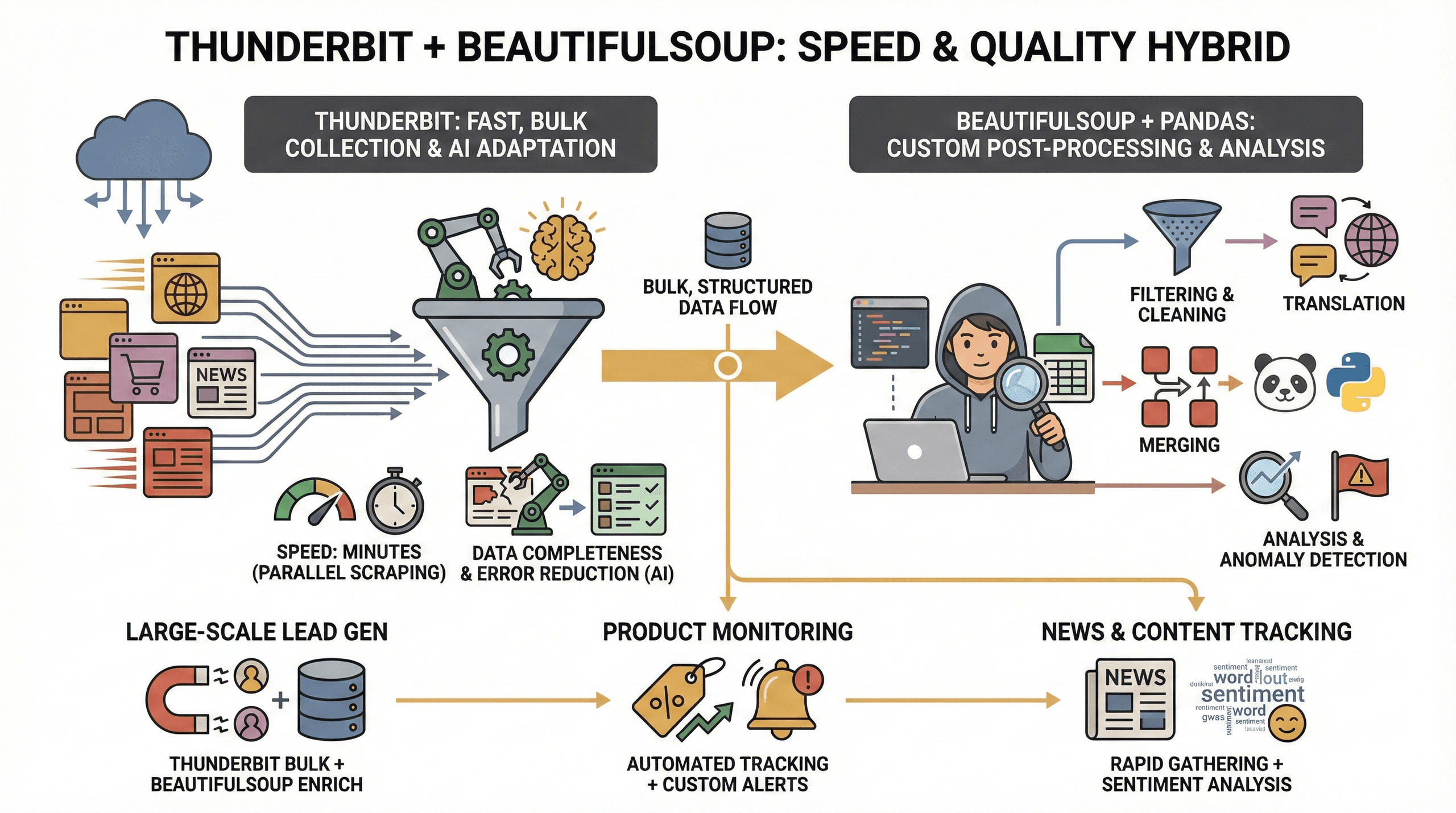

提升效率:BeautifulSoup 搭配 Thunderbit 的混合工作流

接下来聊聊怎么让你的数据抓取流程更高效。 是一款基于 AI 的网页爬虫 Chrome 插件,让数据提取变得更智能、更省心。用 Thunderbit,你可以:

- AI 智能字段识别: Thunderbit 自动分析页面,推荐可提取的数据字段,无需手动查找 HTML 或调整选择器。

- 抓取子页面: 能自动跟踪子链接(比如商品详情页、文章页),丰富你的数据集。

- 一键导出: 数据可直接导出到 Excel、Google Sheets、Airtable 或 Notion。

- 支持分页抓取: 能处理多页数据(包括无限滚动页面)。

- 定时任务: 支持定时自动抓取,数据实时更新。

我常用的混合流程如下:

- 用 Thunderbit 起步: 打开目标网站,点击 Thunderbit 图标,让“AI 智能字段”自动识别所需列(比如标题、作者、日期)。

- 导出数据: 下载为 CSV 或直接同步到 Google Sheets。

- 用 BeautifulSoup 做深度处理: 如果需要更复杂的分析(比如文本清洗、去重、和其他数据源合并),可以把导出的 CSV 用 Python 加载,再用 BeautifulSoup 或 pandas 进行后续处理。

这种组合方式兼具 Thunderbit 的高效与 AI 智能识别,以及 BeautifulSoup 的灵活自定义。

为什么要同时用 Thunderbit 和 BeautifulSoup?速度与数据质量兼得

为什么推荐两者结合?我的经验是:

为什么推荐两者结合?我的经验是:

- 速度提升: Thunderbit 支持云端并发抓取(最多可同时处理50个页面),几分钟就能拿到大批量数据。

- 数据完整性: Thunderbit 的 AI 能适应网页结构变化,即使遇到复杂页面也能提取到结构化数据,减少字段遗漏。

- 降低报错率: 不用担心 class 名变动导致脚本失效,Thunderbit 每次都会重新分析页面。

- 自定义后处理: 需要更高级的数据处理(比如筛选、翻译、数据合并)时,BeautifulSoup 和 pandas 让你拥有完全的灵活性。

这种混合方案特别适合:

- 大规模获客: 用 Thunderbit 批量抓取,再用 BeautifulSoup 精细清洗和补充数据。

- 商品监控: Thunderbit 负责重复性抓取,BeautifulSoup 用于趋势分析或异常检测。

- 新闻内容追踪: Thunderbit 快速收集文章,Python 负责情感分析或关键词提取。

BeautifulSoup 网页爬虫常见问题与解决方案

网页爬虫并非总是一帆风顺,常见问题及应对方法如下:

- 动态内容: 如果网站用 JavaScript 加载数据(比如无限滚动、AJAX),单靠 BeautifulSoup 抓不到。这时可以用 Selenium 或 Thunderbit 的浏览器模式。

- 反爬机制: 有些网站会屏蔽自动请求。可以试试自定义 User-Agent、增加请求间隔,或者用 Thunderbit 云端抓取绕过简单封锁。

- HTML 结构变动: 脚本突然失效,多半是网页结构变了。重新检查页面并更新选择器。Thunderbit 的 AI 能自动适应。

- 数据缺失: 提取前先判断元素是否存在,避免直接用

.get_text()报错。获取属性时用.get()替代[],防止 KeyError。 - 编码问题: 保存文件时用 UTF-8 编码,避免乱码。

最后,记得遵守网站的 robots.txt 和服务条款,文明抓取,做一个有礼貌的爬虫。

总结与核心要点

用 BeautifulSoup 做网页爬虫,是当今数据驱动时代最实用的技能之一。本文主要内容回顾:

- BeautifulSoup 是解析静态 HTML、用 Python 提取结构化数据的首选工具。

- 环境搭建 简单,只需安装 Python、pip 和几个库。

- 分析 HTML 结构 是精准抓取数据的关键。

- 导出为 CSV/Excel,让数据立刻可用于业务分析。

- 结合 Thunderbit,享受 AI 字段识别、极速抓取和一键导出,适合企业用户和零基础小白。

- 混合工作流(Thunderbit 批量采集,BeautifulSoup 深度处理)兼顾速度、数据质量和灵活性。

如果你想提升网页爬虫技能,不妨两种工具都试试:先用 BeautifulSoup 写个简单脚本,再体验下 的高效。更多实用教程,欢迎访问 。

祝你抓取顺利,数据永远干净、结构清晰、随时可用!

常见问题解答

1. 什么是 BeautifulSoup?它能做什么?

BeautifulSoup 是一个 Python 库,用于解析 HTML 和 XML 文档。它能帮你从网页中提取数据,并转化为列表、表格等结构化格式,非常适合网页爬虫项目。

2. BeautifulSoup 和 Selenium、Scrapy 有什么区别?

BeautifulSoup 轻量易用,适合静态 HTML 页面。Selenium 更适合抓取动态、JavaScript 渲染的网站,Scrapy 是功能强大的大规模异步爬虫框架。BeautifulSoup 是新手和小型任务的首选。

3. BeautifulSoup 和 Thunderbit 可以一起用吗?

当然可以。Thunderbit 能用 AI 快速识别并提取网页字段,BeautifulSoup 则适合对导出数据做自定义处理或深度分析。

4. 用 BeautifulSoup 做网页爬虫常见难点有哪些?

常见问题包括处理动态内容、应对反爬机制、适应 HTML 结构变化等。利用 Thunderbit 的 AI 功能或浏览器模式,可以解决不少难题。

5. 如何把 BeautifulSoup 抓取的数据导出为 Excel 或 CSV?

可以用 Python 自带的 csv 模块或 pandas 库,将提取的数据写入 CSV 或 Excel 文件。建议用 UTF-8 编码,确保多语言兼容。

想亲自体验?赶快下载 ,开启高效网页爬虫之旅。更多教程和技巧,欢迎访问 。

延伸阅读