网络上的数据多到爆。如果你做业务、搞技术,或者只是单纯好奇,大概率都想过:能不能一次性从网站上批量抓取信息,而不是花整个下午复制粘贴。更关键的是,到 2025 年,几乎一半的互联网流量都来自抓取网页数据的机器人,超过70% 的数字化企业依赖公开网页数据做市场洞察和业务运营()。不过,虽然大家对网页数据的需求暴涨,真正把数据提取出来的过程却常常让人头大——尤其是现在这些动态、由 JavaScript 驱动的网站。

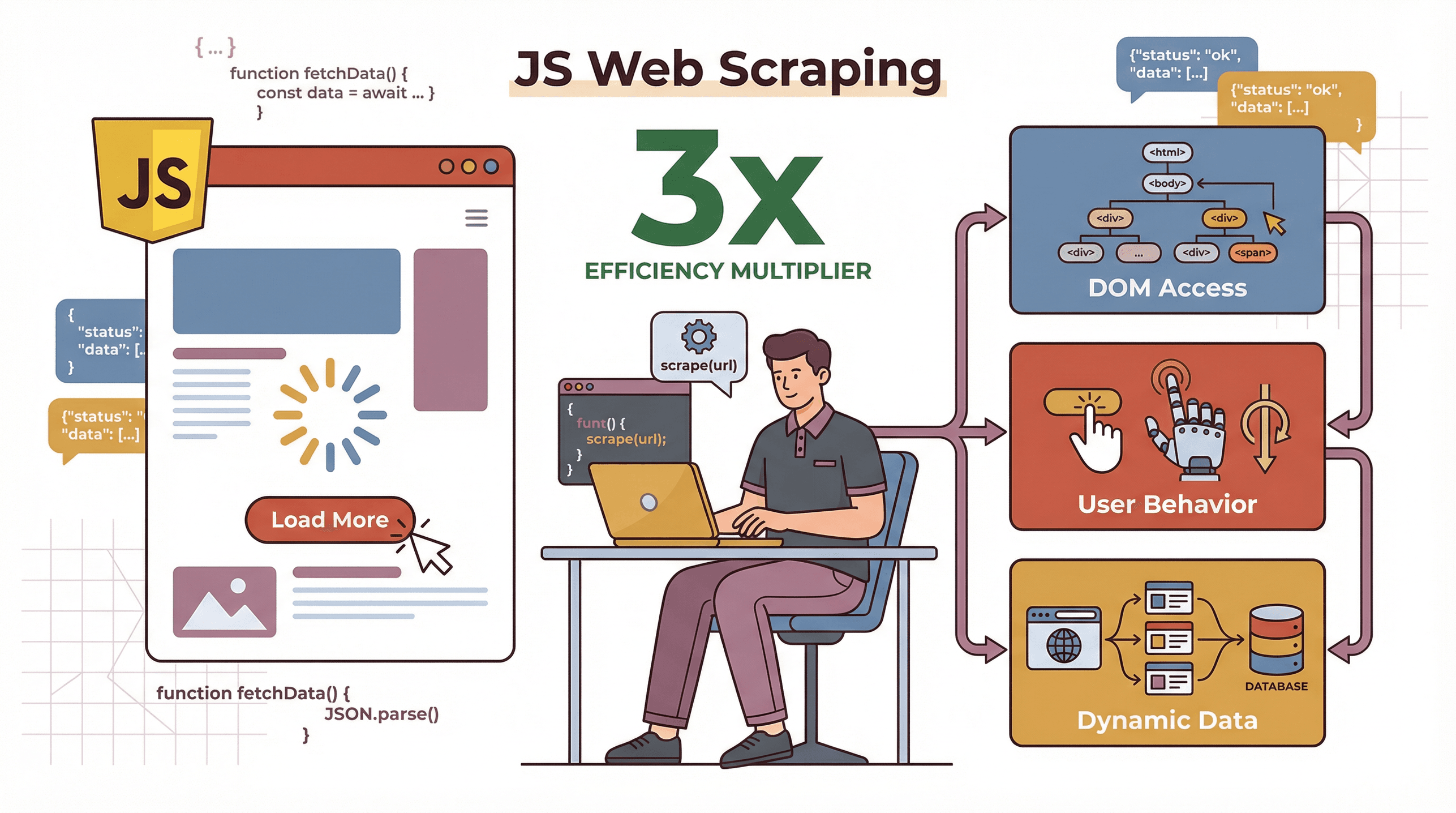

这就是 JavaScript 派上用场的地方。作为网页的“母语”,JavaScript 天然就擅长处理那些老式爬虫搞不定的动态交互页面。不管你是想自动化做研究的开发者、正在整理潜在客户名单的销售,还是只是喜欢折腾的技术爱好者,这篇指南都会带你从零了解如何构建一个 JavaScript 网页爬虫——从基础到进阶技巧,甚至还会教你如何直接用像 这样的 AI 工具跳过代码。

JavaScript 爬虫基础:什么是用 JavaScript 做网页抓取?

先从基础说起。网页抓取,就是自动从网站中提取信息的过程。你可以把它想象成一个超快的助手:能访问成百上千个页面,把你需要的数据复制出来,再整理成整齐的表格——而且还不会抱怨手腕酸。

JavaScript 爬虫,顾名思义,就是用 JavaScript 编写的网页爬虫。JavaScript 爬虫主要有两种运行方式:

- 在浏览器中: 直接在浏览器控制台运行脚本,或者用浏览器扩展抓取你正在查看的页面数据。

- 服务器端(Node.js): 在浏览器外使用 JavaScript(借助 Node.js)获取网页、解析内容,并以程序化方式提取数据。

这对商务用户有什么意义?网页抓取能支持很多场景:从线索开发(从目录里提取联系人),到价格监控(跟踪竞争对手),再到市场研究(收集评论、新闻或趋势)。实际上,48% 的网页抓取用户都来自电商行业()。只要你能在浏览器里看到它,JavaScript 爬虫大概率就能帮你抓到。

为什么要用 JavaScript 做网页抓取?现代网站的关键优势

那为什么要用 JavaScript 抓数据,尤其是数据科学圈里 Python 明明更受欢迎?秘诀就在于:现代网站本身就是由 JavaScript 驱动的。它们会动态加载内容、在页面加载后再请求数据,而且经常需要用户交互,比如点“加载更多”或滚动页面。JavaScript 爬虫可以:

那为什么要用 JavaScript 抓数据,尤其是数据科学圈里 Python 明明更受欢迎?秘诀就在于:现代网站本身就是由 JavaScript 驱动的。它们会动态加载内容、在页面加载后再请求数据,而且经常需要用户交互,比如点“加载更多”或滚动页面。JavaScript 爬虫可以:

- 处理动态内容: 因为 JavaScript 就是运行在你浏览器里的语言,它能看到并交互那些只有脚本执行后才出现的内容。

- 模拟真实用户行为: 像 Puppeteer 这样的工具可以自动完成点击、滚动,甚至登录,就像真人操作一样。

- 原生操作 DOM: JavaScript 能直接访问并操作页面结构,因此更容易精准提取你需要的数据。

JavaScript 和其他语言相比表现如何?来看个快速对比:

| 因素 | JavaScript(Node.js) | Python | PHP |

|---|---|---|---|

| 动态内容 | 非常强——浏览器原生运行,特别适合 JS 密集型网站 | 需要额外工具(Selenium/Playwright)处理动态内容 | 有限 |

| 速度/并发 | 很高——异步模型,可并行获取多个页面 | 不错,但并发通常要靠 asyncio/Scrapy | 更慢,也不常用 |

| 易用性 | 中等——Web 开发者上手自然,但异步会让新手踩坑 | 对初学者更友好,教程也很多 | 基础,灵活性较弱 |

| 浏览器自动化 | 一流(Puppeteer、Playwright) | 不错(Selenium、Playwright) | 少见 |

| 最适合 | 动态、交互式或单页应用网站;Web 开发流程 | 数据分析、静态网站、快速脚本 | 简单静态网站 |

如果你的目标网站是单页应用,或者需要滚动、点击后才加载数据,那么 JavaScript 往往就是最合适的工具()。

搭建你的第一个 JavaScript 爬虫:工具与环境

准备动手了吗?下面我们来搭一个基础的 JavaScript 抓取环境——不用任何框架。

-

安装 Node.js

从 下载并安装 Node.js。它能让你在浏览器外运行 JavaScript。 -

初始化项目

打开终端,运行:1mkdir my-scraper 2cd my-scraper 3npm init -y -

安装必要的库

你需要:- 或

node-fetch用于 HTTP 请求 - 用于解析 HTML(可以理解为:服务器端的 jQuery)

1npm install axios cheerio - 或

-

检查目标网站

打开 Chrome DevTools(右键 > 检查),找到包含你所需数据的 HTML 元素。记下它们的 class、ID 或标签。

下面是一段简单的入门脚本:

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapePage(url) {

4 try {

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const pageTitle = $('head > title').text();

8 console.log("页面标题:", pageTitle);

9 } catch (err) {

10 console.error("抓取失败:", err);

11 }

12}

13scrapePage('https://example.com');用 node scrape.js 运行后,你就会看到页面标题被打印出来。几行代码就能做到这样,已经很不错了!

构建一个基础的 JavaScript 网页爬虫:分步实战

现在我们做点更实用的。假设你想从 这个经典练习网站抓取书名和价格。

步骤 1:检查页面

每本书都在一个 <article class="product_pod"> 里面。标题位于 <h3><a title="Book Title"></a></h3>,价格位于 <p class="price_color">。

步骤 2:编写爬虫

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapeBooks() {

4 const url = 'http://books.toscrape.com/';

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const books = [];

8 $('article.product_pod').each((i, elem) => {

9 const title = $(elem).find('h3 a').attr('title');

10 const price = $(elem).find('.price_color').text();

11 books.push({ title, price });

12 });

13 console.log(books);

14}

15scrapeBooks();这段脚本会获取页面、解析 HTML、遍历每本书并提取标题和价格。输出结果?一个整洁的书籍对象数组:

1[

2 { "title": "A Light in the Attic", "price": "£51.77" },

3 { "title": "Tipping the Velvet", "price": "£53.74" }

4]步骤 3:扩展到分页

想抓取多页内容?找到“下一页”链接,循环遍历页面,每次更新 URL。再多写一点代码,你就能把整个网站都抓下来。

更进一步:用 JavaScript 处理动态内容和用户交互

接下来就是最有意思、也最容易让人抓狂的部分:动态内容。很多现代网站不会把所有数据都放进初始 HTML 里,而是会在页面加载后通过 JavaScript 再加载,或者需要你点击按钮、滚动页面才能看到更多内容。

Cheerio 和 Axios 看不到这些内容——它们只能获取原始 HTML。要抓取动态网站,你需要像 这样的无头浏览器。

用 Puppeteer 做高级 JavaScript 网页爬取

Puppeteer 让你可以用代码控制 Chrome(或 Chromium)。你可以:

- 打开页面

- 等待元素加载完成

- 点击按钮、填写表单、滚动页面

- 在所有脚本运行完后提取内容

下面是一段简单的 Puppeteer 脚本:

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com', { waitUntil: 'networkidle0' });

6 await page.waitForSelector('.dynamic-content');

7 const data = await page.evaluate(() => {

8 return Array.from(document.querySelectorAll('.dynamic-content'))

9 .map(el => el.textContent.trim());

10 });

11 console.log(data);

12 await browser.close();

13})();你甚至可以自动登录、点击“加载更多”按钮,或者通过程序化滚动页面并等待新内容出现,来处理无限滚动()。

Thunderbit:让 JavaScript 抓取更简单、更强大

说实话:从零写爬虫很强大,但它需要时间、技术能力和持续维护。这也是为什么我这么喜欢 ——我们这款 AI 驱动的 Chrome 扩展,把网页抓取变成了两步就能搞定的事情。

Thunderbit 专为商务用户打造,不需要写代码。它的工作方式如下:

- AI 推荐字段: 点一下按钮,Thunderbit 的 AI 会扫描页面,并推荐最适合提取的列,比如“产品名称”“价格”“邮箱”等。

- 两步抓取: 检查推荐字段后点击“抓取”,Thunderbit 就会把所有数据抓下来——还能自动处理分页和子页面。

- 子页面与分页处理: 需要更多详情?Thunderbit 可以顺着链接进入子页面(比如产品详情页或个人资料页),并把这些数据合并进你的表格里。

- 云端或浏览器模式: 你可以在浏览器里抓取(适合已登录页面),也可以用 Thunderbit 的云端模式提速(一次最多 50 个页面)。

- 免费、结构化导出: 你的数据可以免费导出到 Excel、Google Sheets、Airtable、Notion、CSV 或 JSON,不管抓多少都一样免费。

Thunderbit 实战:从数据提取到导出

假设你想从企业名录中提取联系方式:

- 安装 Thunderbit()。

- 打开名录页面。

- 点击“AI 推荐字段”。 Thunderbit 的 AI 会建议诸如“姓名”“电话”“公司”之类的列。

- 点击“抓取”。 Thunderbit 会收集所有数据,甚至跨多个页面。

- 导出到 Sheets 或 Excel。 完成。

原本要花几个小时,甚至需要开发者才能做的事,现在几分钟就能搞定。由于 Thunderbit 使用 AI,它对网站布局变化也更有韧性——网站一更新,不会再动不动就把脚本弄坏()。

下面看看传统 JavaScript 抓取和 Thunderbit 的对比:

| 标准 | 手动 JS 爬虫 | 高级 JS(Puppeteer) | Thunderbit AI 爬虫 |

|---|---|---|---|

| 所需技能 | 编程 | 高级编程 | 不需要(点点鼠标即可) |

| 动态内容 | 有限 | 非常强 | 内置支持 |

| 搭建时间 | 每个网站数小时 | 数小时到数天 | 几秒到几分钟 |

| 维护成本 | 高 | 高 | 低(AI 会自适应) |

| 导出方式 | 自定义代码 | 自定义代码 | 一键导出到 Excel/Sheets 等 |

| 成本 | 免费(但非常耗时) | 免费(但耗硬件和时间) | 有免费版,之后 $15/月起 |

进阶技巧:使用 JavaScript 库处理复杂网页抓取

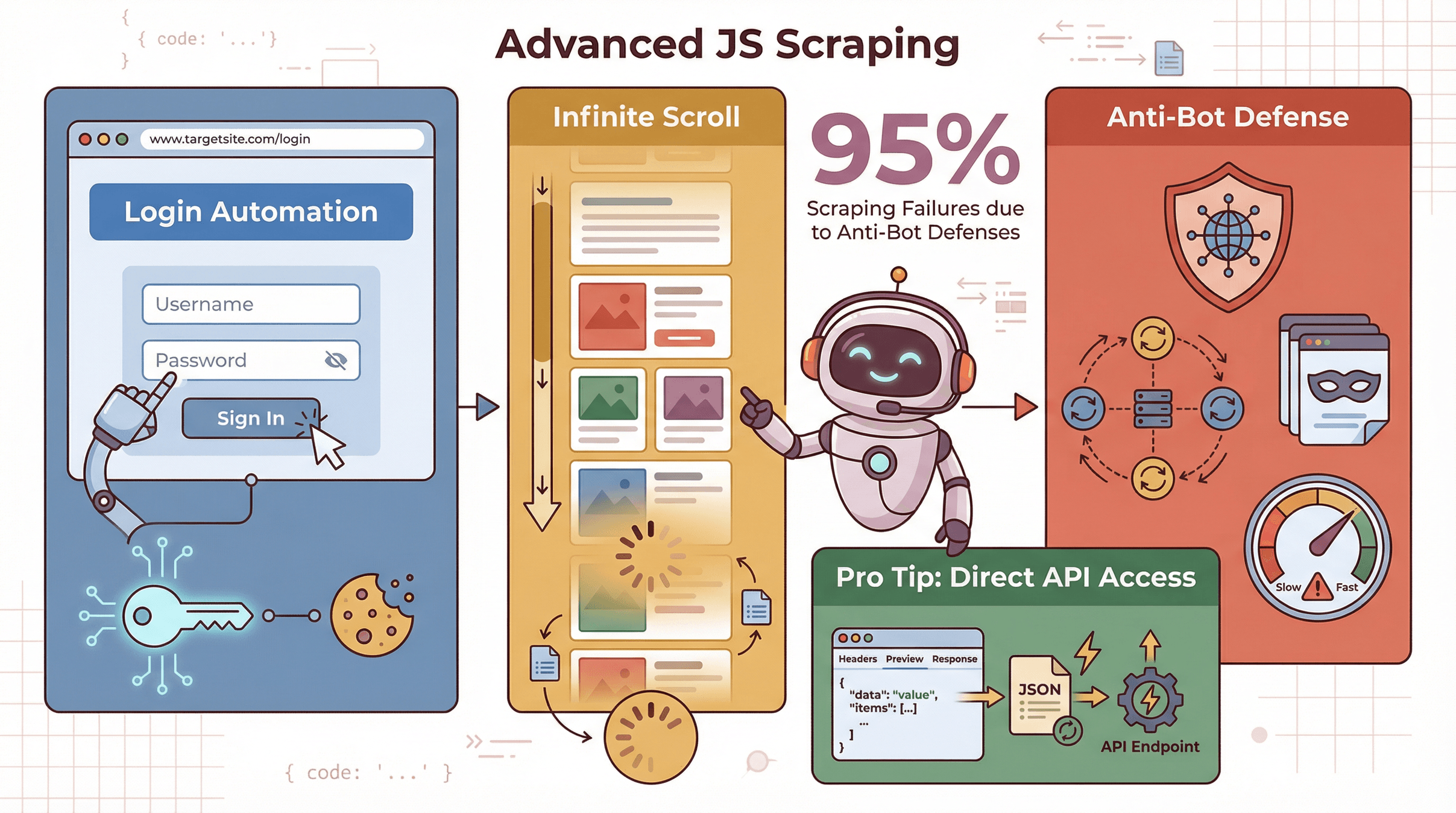

有时候你需要做得更多——比如抓取登录后才能看到的数据、处理无限滚动,或者绕开反爬机制。

有时候你需要做得更多——比如抓取登录后才能看到的数据、处理无限滚动,或者绕开反爬机制。

- 登录/会话: 借助 Puppeteer,你可以通过填写表单并点击按钮来自动登录,然后以已登录用户身份抓取数据。

- 无限滚动: 用程序滚动页面,等待新内容加载,再重复执行,直到所有数据都出来()。

- 反爬措施: 使用代理、轮换 user agent,并限制请求频率,避免被封。超过95% 的抓取失败都和反机器人防护有关()。

专业建议: 有时候你甚至可以完全跳过浏览器,直接找到网站隐藏的 API 端点(在 DevTools 的 Network 面板里查看)。如果能直接获取 JSON 数据,你的爬虫会快得多。

优化并维护你的 JavaScript 网页爬虫

写出爬虫只是成功了一半,真正让它稳定运行才是另一半。

- 异步处理: 使用 async/await 并并行获取页面(但别把服务器压垮)。

- 批量处理: 分批处理数据,避免内存问题。

- 错误处理: 捕获错误、重试失败请求,并记录日志方便调试。

- 分页处理: 检测“下一页”链接或按钮,并循环遍历页面。

- 选择器稳定性: 使用唯一的 ID 或 class;避免那种页面一改版就失效的脆弱选择器。

- 监控: 如果你的爬虫开始返回空数据或报错,及时设置提醒。

最佳实践: 抓取从来都不是“设好就不用管了”。你要为定期更新和监控做好准备()。

对比 JavaScript 抓取方案:传统方式 vs Thunderbit

下面给商务用户一个快速对比:

| 方式 | 见效速度 | 所需技能 | 能否处理动态内容 | 维护成本 | 导出方式 | 扩展性 |

|---|---|---|---|---|---|---|

| 手动 JS(Cheerio) | 慢 | 编程 | 否 | 高 | 自己写代码导出 | 适合静态页面 |

| 高级 JS(Puppeteer) | 中等 | 编程+ | 是 | 高 | 自己写代码导出 | 单页速度较慢 |

| Thunderbit | 快 | 不需要 | 是(AI 驱动) | 低 | 一键导出到 Sheets/CSV | 云端或浏览器 |

对大多数商务用户来说,Thunderbit 是最快把“我需要这些数据”变成“这是我的表格”的方式。

结论与核心要点

在如今这个数据驱动的世界里,构建一个 JavaScript 网页爬虫是一项超能力。我的收获和建议如下:

- 先从简单开始: 静态网站用 Cheerio 和 Axios。

- 需要时再上进阶: 动态、交互式或需要登录的网站用 Puppeteer。

- 用 AI 工具省时间: 对大多数商务需求来说, 能让你跳过代码,几分钟内拿到结果。

- 把维护计划好: 网站会变,你的爬虫也要能适应。

- 始终合规抓取: 尊重网站条款,不要压垮服务器,并负责任地使用数据。

如果你想体验一下不用头疼也能抓取数据的感觉,欢迎,看看它有多简单。如果你想进一步深入,也可以去看看 ,那里有更多指南、技巧和真实案例。

祝你抓取顺利,也愿你的选择器永远独一无二!

常见问题

1. 什么是 JavaScript 网页爬虫?

JavaScript 网页爬虫是用 JavaScript 编写的程序(或脚本),可以自动从网站中提取数据。它既可以在浏览器中运行,也可以在服务器端(使用 Node.js)运行,尤其擅长处理动态、JavaScript 密集型网站。

2. 为什么网页抓取要选 JavaScript 而不是 Python?

JavaScript 是网页的语言,因此特别适合抓取那些动态加载内容或需要用户交互的网站。Python 很适合静态网站和数据分析,但处理动态内容时通常需要额外工具。

3. 构建 JavaScript 爬虫需要哪些工具?

静态网站:Node.js、Axios(或 fetch)和 Cheerio。动态网站:再加上 Puppeteer 或 Playwright 做无头浏览器自动化。如果你想无代码抓取,可以试试 。

4. Thunderbit 如何简化网页抓取?

Thunderbit 使用 AI 自动识别并提取任意网站的数据。你只需要点击“AI 推荐字段”,再点击“抓取”,然后导出数据就行——完全不需要编写代码或折腾选择器。

5. 网页抓取合法吗,符合伦理吗?

只要负责任地使用,网页抓取就是合法的——只抓取公开可访问的数据,遵守网站条款,不要压垮服务器。不要在未获得同意的情况下抓取个人数据,并始终以合乎伦理的方式使用数据。

想看 JavaScript 抓取的实际演示?去看看 Thunderbit 的 学教程,或者到 了解更多。

了解更多