有句话说得好:“数据是新时代的石油。”但说真的,如果你还在手动复制粘贴网页内容,那就像拿着小勺子去挖油田。在现在这个数据驱动的社会,团队每天光是找资料就要花掉 ,普通上班族一周要复制粘贴 。难怪大家都觉得被重复的手工活压得喘不过气。

这也是为什么学会用 Python 做网站数据抓取,对销售、运营、调研团队来说能带来质的飞跃。Python 的网页爬虫工具能把原本要花好几个小时的繁琐工作,变成几行代码——或者,如果你和我一样不想写代码,也可以直接用 这样的 AI 网页爬虫工具,点几下鼠标就能搞定。不管你是数据小白还是老司机,下面就来聊聊为什么要用 Python 抓网页、能做什么、怎么做(以及 Thunderbit 怎么让一切变得更简单)。

为什么选 Python 来抓网页?

说到网页抓取,Python 基本就是首选。这不仅仅因为它“火”,更因为它就像聚会里那个既会带零食、又会组织活动、还会照顾大家的朋友。

Python 的优势主要有:

- 上手快: Python 语法简单直白,没学过编程也能很快写出爬虫脚本。

- 库多好用: Python 有 、、、 等一堆强大库,能应对各种抓取场景,无论是静态页面还是需要自动化操作的网页。

- 社区活跃: 遇到问题,Stack Overflow 上总能找到答案。各种文档教程也很全,遇到坑有人帮你填。

- 集成灵活: Python 能和其他工具无缝配合,比如结合 这类 AI 平台,实现更智能的数据提取,或者自动化、定时、批量处理抓取结果。

和 JavaScript、R 这些语言比起来,Python 学习门槛更低,对网页抓取的支持也更完善。正如业内大佬说的:“Python 就是网页抓取界的瑞士军刀——多面手,靠谱又高效。”

基础流程:用 Python 抓网页的步骤

我们来拆解下用 Python 抓网页的基本流程。不管是抓单页还是全站,通常都包括这些环节:

| 步骤 | 主要操作 | Python 库示例 |

|---|---|---|

| 1. 发送网页请求 | 获取目标页面的 HTML | requests.get() |

| 2. 解析 HTML | 分析页面结构 | BeautifulSoup() |

| 3. 提取数据 | 抓取所需信息(如标题、价格等) | soup.find_all() |

| 4. 保存/导出数据 | 将结果存为 CSV、Excel 或数据库 | csv、pandas 或 openpyxl |

看起来很简单对吧?但实际操作时,遇到分页、动态内容、页面结构经常变这些问题,难度就上来了。这时候,Thunderbit 这种工具就能帮你一键解决,AI 自动识别字段,省时又省力。

Python 网页抓取常用库盘点

Python 生态里有不少适合不同场景的爬虫库,下面简单介绍几位主力选手:

BeautifulSoup:轻量级 HTML 解析神器

非常适合新手,解析静态 HTML、提取数据都很顺手。

- 优点: 简单易用,适合小项目。

- 局限: 不适合批量爬多页面或处理大量 JS。

- 典型场景: 抓静态电商页面的商品列表。

Scrapy:大规模爬取的强力框架

是专业爬虫的首选,支持多页面爬取、自动跟踪链接、批量导出数据。

- 优点: 高效、可扩展,能搞定复杂流程(比如分页、子页面)。

- 局限: 学习曲线稍陡,配置略复杂。

- 典型场景: 全站抓大型电商网站的所有商品和分类。

Selenium:搞定动态内容和交互操作

适合需要模拟用户操作(比如登录、点按钮)或依赖 JS 渲染的网站。

- 优点: 能自动化浏览器,处理动态内容。

- 局限: 速度慢,占资源多。

- 典型场景: 抓需要登录或交互的仪表盘数据。

Requests:网页请求的基础工具

是发 HTTP 请求的好帮手,常和 BeautifulSoup 搭配用。

- 优点: 简单好用,支持 cookies 和会话。

- 局限: 不能渲染 JS。

- 典型场景: 下载 HTML 给 BeautifulSoup 解析。

提升效率:用 Thunderbit + Python 抓网页

说个小秘密:即使我很喜欢 Python,也不想每次都写代码来抓数据。这时候, 就特别香——它是基于 AI 的 Chrome 扩展,无需写代码,谁都能用。

Thunderbit 专为追求效率的商业用户设计,具备 AI 字段智能识别、子页面抓取、数据一键导出到 Excel 或 Google Sheets 等功能,简直就是把 Python 脚本和数据分析师合体了。

Thunderbit 2 步抓取 VS 传统 Python 手动编程

我们来对比下传统 Python 流程和 Thunderbit 的操作体验:

| 任务 | Python 脚本方式 | Thunderbit AI 网页爬虫方式 |

|---|---|---|

| 环境搭建 | 安装 Python、pip、相关库 | 安装 Chrome 扩展 |

| 页面结构分析 | 用浏览器开发者工具,手动写选择器 | 点击“AI 字段智能识别” |

| 编写提取代码 | 编写并调试 Python 代码 | 点击“抓取” |

| 处理分页 | 写循环、管理 URL | UI 中启用“分页抓取” |

| 数据导出 | 用代码导出 CSV/Excel | 一键导出到 Sheets/Excel/Notion/Airtable |

| 维护更新 | 页面变动需手动修改代码 | AI 自动适应页面变化 |

用 Thunderbit,几乎所有网站都能两步抓取——不用写代码、不用模板、不用担心维护。如果有更复杂的需求,也可以用 Python 对 Thunderbit 的结果做自动化处理、定时任务等。

Thunderbit 和 Python 脚本的混合玩法

更有意思的是,你可以用 Python 控制或定时调度 Thunderbit 的抓取任务。比如:

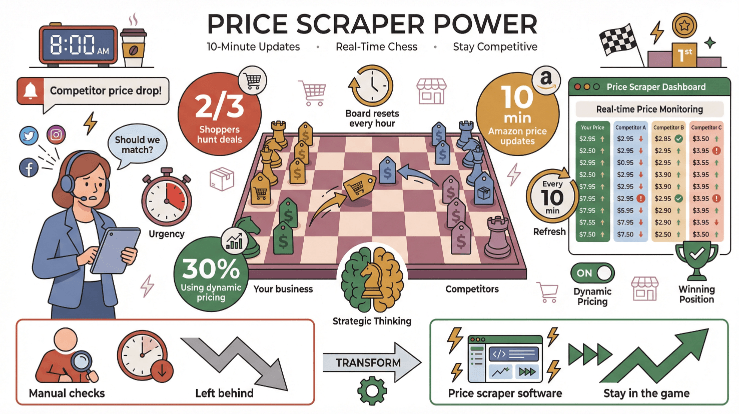

- 定时启动 Thunderbit(比如每天监控价格)

- 用 pandas 或 scikit-learn 清洗、分析导出的数据

- 把 Thunderbit 抓到的数据和其他来源整合,做更深入的数据分析或机器学习

这种混合玩法,既有 Thunderbit 的高效易用,又能发挥 Python 的强大自动化和数据处理能力。

分步实操:用 Python 抓网站数据

准备好动手了吗?下面是适合新手的 Python 网页抓取详细流程。

步骤 1:搭建 Python 环境

先确保你装好了 Python。推荐用 或 管理环境。

1# 如果没有 pip,先装 pip

2python -m ensurepip --upgrade

3# 创建虚拟环境(推荐)

4python -m venv myenv

5source myenv/bin/activate # Windows 下用 myenv\Scripts\activate

6# 安装需要的库

7pip install requests beautifulsoup4 pandas步骤 2:获取网页内容

用 Requests 库下载目标页面的 HTML。

1import requests

2url = 'https://example.com/products'

3response = requests.get(url)

4if response.status_code == 200:

5 html = response.text

6else:

7 print("页面获取失败:", response.status_code)排查建议: 如果遇到 403 或 404 错误,看看是不是网站屏蔽了爬虫,或者需要设置 headers/cookies。

步骤 3:解析 HTML 并提取数据

用 BeautifulSoup 解析 HTML,提取你想要的内容。

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3products = soup.find_all('div', class_='product-item')

4data = []

5for product in products:

6 name = product.find('h2').get_text(strip=True)

7 price = product.find('span', class_='price').get_text(strip=True)

8 data.append({'name': name, 'price': price})小技巧: 用浏览器的“检查元素”功能,快速定位 HTML 标签和类名。

步骤 4:保存并导出数据

用 pandas 导出结果为 CSV 文件,方便后续分析或分享。

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv('products.csv', index=False)如果用 Thunderbit,只要点“导出到 Google Sheets”或“下载 CSV”,完全不用写代码。

进阶玩法:用 Python & Thunderbit 实现自动化和规模化抓取

基础掌握后,你可以进一步自动化和扩展抓取任务:

- 处理分页: Python 里循环翻页或跟踪“下一页”链接;Thunderbit 里直接启用分页抓取,AI 自动搞定。

- 抓取子页面: Python 需要写代码跟踪链接,Thunderbit 支持子页面抓取,自动丰富数据。

- 定时抓取: Python 可以用 schedule 库或定时任务,Thunderbit 内置定时器,支持周期性抓取(比如每天监控价格)。

- 多源数据整合: 合并多个网站抓取的数据,做更深入的市场分析或竞品监控。

真实案例: 某电商团队用 Thunderbit 监控 10 个竞品网站的价格,设置每日定时抓取,数据自动导出到 Google Sheets,分析效率提升 ,再也不用熬夜做表了。

数据伦理与隐私:用 Python 合规抓取

能力越大,责任越大。合规抓取要注意:

- 遵守 robots.txt 和服务条款: 先查查网站是否允许抓取,不确定时主动沟通。

- 控制请求频率: 不要高频访问,注意礼貌抓取,别给服务器添麻烦。

- 避免抓取个人隐私数据: 没有授权别采集敏感或私人信息,遵守 GDPR 等数据法规。

- 明确身份: 设置 user-agent,说明抓取用途,保持透明。

- 尊重数据删除请求: 如果有人要求移除数据,及时响应。

Thunderbit 通过限制抓取速度、支持登录抓取、以及数据清洗等功能,帮你合规操作。更多建议可以参考 。

从原始数据到洞察:用抓取数据做分析和机器学习

抓到的数据只是起点。结合 Python 和 Thunderbit,你可以:

- 数据清洗与格式化: 用 pandas 去重、修正错别字、统一格式。

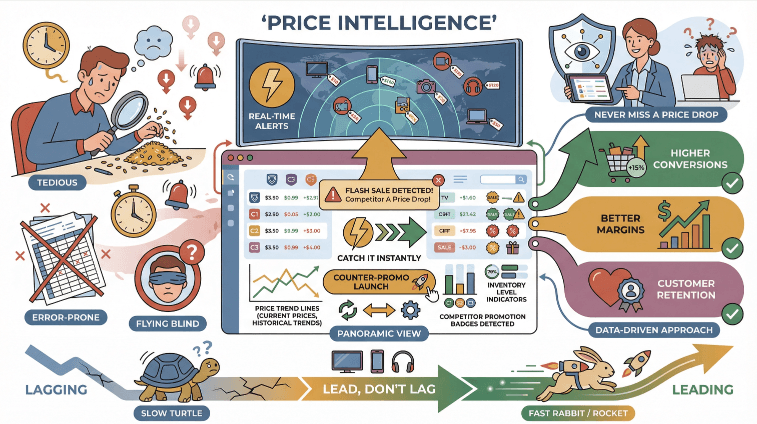

- 趋势分析: 跟踪竞品价格、分析评论情感、洞察市场变化。

- 机器学习建模: 用 scikit-learn 做情感分析、价格预测、客户分群等。

- 自动化报告: 实时生成数据看板或预警提醒。

案例: 某产品团队抓取了数千条用户评论,用 Python 清洗数据,再用 Thunderbit 的 AI 自动标注情感,最终获得了有价值的产品优化和营销洞察。

总结与要点回顾

来简单回顾下:

- Python 是网页抓取的理想选择,因为它简单易用、库强大、社区活跃。

- Thunderbit 让抓取变得人人可用,AI 无代码工具自动识别字段、支持子页面导航。

- Python + Thunderbit 解锁高级自动化,能做定时任务、数据处理、集成业务流程。

- 始终合规抓取: 遵守网站政策、隐私法规和伦理规范。

- 让原始数据变成业务价值: 用抓取数据做分析、报告或机器学习。

想提升数据能力?可以试试用 Python 抓网站,或者直接体验 。更多实用技巧和教程,欢迎访问 。

常见问题解答

1. 用 Python 抓网页合法吗?

只要遵守网站服务条款、robots.txt 和数据隐私法规,网页抓取是合法的。千万别未经许可抓取个人或敏感信息。

2. 不会编程,怎么最简单抓网站数据?

提供无代码、AI 驱动的 Chrome 扩展,两步就能抓任意网站数据,完全不用编程。

3. 动态网站用哪个 Python 库抓?

需要渲染 JavaScript 或交互操作的网站,推荐用 。静态页面用 和 就够了。

4. 怎么自动化网页抓取任务?

可以用 Python 的定时任务(比如 cron 或 schedule 库),Thunderbit 也自带定时抓取功能。

5. 网站结构变了怎么办?

传统 Python 脚本遇到页面变动要手动改选择器或解析逻辑。Thunderbit 的 AI 能自动适应,大大减少维护成本。

祝你抓取顺利,数据干净、结构清晰、随时可用!

延伸阅读