说实话:第一次尝试从一个大型网站里把每个 URL 都抓出来时,我心里还想,“这能有多难?”结果几个小时后,我还在一页一页地点击、把链接复制粘贴到表格里,开始怀疑自己的人生选择。如果你也曾经尝试过找出网站上的所有页面——不管是做内容审计、整理潜在客户名单,还是竞品研究——你就知道这种痛苦。它既繁琐,又容易出错,说到底,就是在浪费你的时间和能力。

但好消息是:你不用再用最笨的方法了。像 这样的 AI 工具正在改变企业用户的工作方式,让你能在几分钟内而不是几天内,找出一个域名下的所有 URL。事实上,使用 AI 驱动网页爬虫工具的公司,在数据收集任务上可节省,有些甚至比手动方式。这不只是一个数据,而是把你生命中的几个小时,甚至几天,重新还给你。

所以,让我们来看看为什么找出网站上的所有页面这么难,为什么 GPT 或 Claude 这类通用 AI 模型帮不上太多忙,以及像 Thunderbit 这样的专业 AI 智能体如何让这个过程变得轻松。没错,我还会带你走一遍完整步骤,即使你不会写代码,也能把需要的每个 URL 提取出来。

为什么找出域名下的所有 URL 这么难

现实就是:网站本来就不是为了给你一份整整齐齐的页面清单而设计的。它们是给访客看的,不是给想一次性找出网站上的所有页面的人看的。这个任务之所以麻烦,原因有很多:

- 手动复制粘贴噩梦: 逐个点击每个菜单、列表和目录,把 URL 一个个复制到表格里,最后大概率不是得腱鞘炎,就是漏掉一半页面。

- 分页和无限滚动: 很多网站会把内容拆成多页,或者你一往下滚动就自动加载更多结果。漏点一下“下一页”按钮,或者没滚到足够深的位置,你就会错过整段内容。

- 页面结构不统一: 有些页面的链接展示方式是这样,另一些页面又是那样。要把这些都理清楚,简直像做噩梦。

- 隐藏页或孤立页: 并不是每个页面都会从主导航里直接链接出来。有些页面藏得很深,只能通过站点地图或站内搜索找到。

- 人为错误: 你要复制的页面越多,出错的可能性就越大——重复 URL、拼写错误,或者干脆漏掉某些内容。

如果你面对的是一个有几百甚至几千个页面的网站呢?那就更别想手动做了。手动提取根本无法扩展。正如某个数据团队所说,只要不是特别简单的场景,。

“找出网站上的所有页面”到底是什么意思?

在进入解决方案之前,我们先把目标说清楚。

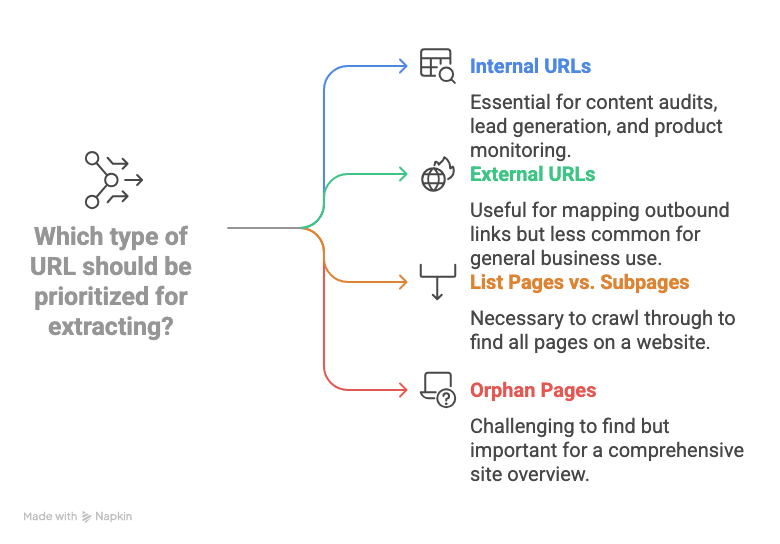

- 站内 URL: 指的是指向同一域名下页面的链接(比如 /about-us 或 /products/widget-123)。对于大多数业务场景——内容审计、获客、产品监控——站内 URL 才是主要目标。

- 站外 URL: 指向其他网站的链接。通常,除非你是在整理外链,否则并不需要这些。

- 列表页与子页面: 很多网站都有“中心页”或“列表页”(比如分类页、博客归档页、目录页),它们会链接到详情页(比如产品页或个人资料页)。如果你真的想找出网站上的所有页面,就需要一路爬过这些列表,把它们链接出去的每个子页面都抓出来。

- 孤立页: 这些页面不会从任何明显的位置链接出来。有时你可以通过站点地图或站内搜索把它们找出来,但它们很容易被漏掉。

所以,当我们说要找出一个域名下的所有 URL时,我们的意思是:获取每个站内页面的 URL,从首页到最深层的产品页或文章页,最好还能整理成你能直接使用的格式,比如表格。

传统方法:如何找出域名下的所有 URL

传统做法有几种,但每一种都有自己的麻烦:

手动复制粘贴和浏览器工具

这就是“暴力解法”:点击每个链接,复制每个 URL,粘贴到表格里,然后祈祷自己没有漏掉什么。有些人会用浏览器扩展从当前页面抓取所有链接,但你仍然得对每个页面重复操作,而且分页或隐藏区域还得靠你自己处理。对于五页的网站还行,规模再大就不现实了。

使用站内搜索和站点地图

- Google 的 site: 搜索: 在 Google 里输入 site:yourdomain.com,你会看到一堆已被收录的页面。但 Google 只会展示它已经收录的内容(通常最多大约 1,000 条结果),所以新页面、隐藏页面或质量较低的页面都会被漏掉。也承认,这并不是完整解决方案。

- XML 站点地图: 很多网站都有 /sitemap.xml,用来列出重要 URL。很好——前提是这个站点地图是最新的,而且包含了所有页面。但并不是每个网站都有,某些网站还会把站点地图拆成多个文件。孤立页往往也不会被放进去。

技术型爬虫和脚本

- SEO 工具(比如 Screaming Frog): 这类工具会像搜索引擎一样爬站,然后吐出一份 URL 列表。它们很强,但需要配置,有时大站还要付费许可证。

- Python 脚本(比如 Scrapy): 开发者可以写脚本来抓取和提取 URL。可说实话,如果你不熟悉代码,这条路基本走不通。而且网站布局一变,脚本就容易失效,所以你总是在追着改。

结论: 传统方法要么太手工,要么不完整,要么技术门槛太高,不适合大多数企业用户。很多人中途放弃,原因就在这。

为什么通用 AI 模型无法完整自动化 URL 提取

你可能会想:“我不能直接让 ChatGPT 或 Claude 帮我找出网站上的所有页面吗?”要是这么简单就好了。现实是这样的:

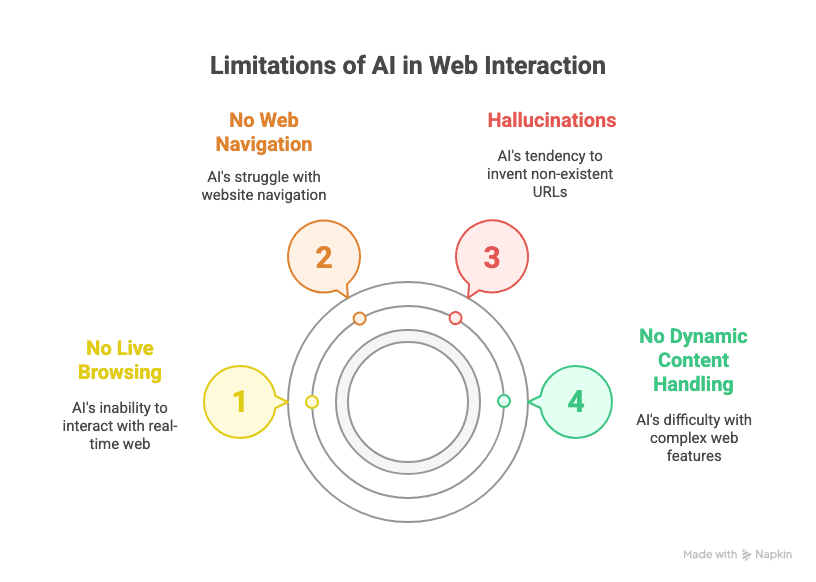

- 不能实时浏览: 像 GPT 或 Claude 这样的通用 AI 模型,并不能真正实时浏览网页。它们看不到网站当前的状态——只能根据训练数据,或者你粘贴给它们的内容来工作。

- 不会网页导航: 即使启用了插件或浏览功能,LLM 也不知道怎么点“下一页”,怎么处理无限滚动,或者怎么系统性地跟随网站上的每个链接。

- 幻觉问题: 你让通用 AI 给出某个域名下的所有 URL,它经常会编出一些看起来很合理、实际上根本不存在的链接。(我见过它给从来没有 /about-us 页面的网站硬生生编出这个地址。)

- 无法处理动态内容: 通过 JavaScript 加载内容、需要登录,或者导航结构复杂的网站,对通用 LLM 来说基本都超出能力范围。

正如 所说:“如果你想抓取成百上千个页面……只靠 ChatGPT 远远不够。”你需要的是专门为这项工作打造的工具。

垂直型 AI 智能体才是未来(这为什么重要)

这里就轮到我在 SaaS 和自动化领域的经验发挥作用了:垂直型 AI 智能体——也就是专门为某个领域打造的 AI 工具,比如网页数据提取——才是让企业任务获得稳定、可扩展结果的唯一方式。为什么?

- 通用 LLM 很适合写作或搜索,但它们很容易“幻觉”,也无法稳定处理企业所需的多步骤、可重复工作流。

- 企业级 SaaS 工具需要自动化大量重复、结构化的任务。 这正是垂直型 AI 智能体的强项——它们就是为把一件事做好而生,而且错误更少。

- 各行业都有例子: Thunderbit 用于网页数据提取,Devin AI 用于软件开发,Alta 用于销售自动化,Infinity Learn 的 IL VISTA 用于教育,Rippling 用于人力资源,Harvey 用于法律……还有很多。

简单来说:如果你想可靠地找出网站上的所有页面,你需要的是专门干这件事的垂直型 AI 智能体,而不是一个通用聊天机器人。

认识 Thunderbit:人人都能用的 AI URL 提取工具

这就是 登场的地方。作为一款 AI 网页爬虫 Chrome 扩展,Thunderbit 是为企业用户设计的——不用写代码,不用技术配置,直接出结果。它的不同之处在于:

- 自然语言界面: 你只要描述想要的内容(比如“列出这个网站上的所有页面 URL”),Thunderbit 的 AI 就会帮你想办法提取。

- AI 自动识别字段: Thunderbit 会扫描页面并自动建议列名(比如“页面 URL”)——不用折腾 CSS 选择器或 XPath。

- 支持分页和无限滚动: Thunderbit 可以自动点击“下一页”或者向下滚动,这样你就不会漏掉任何页面。

- 子页面导航: 需要深入一层吗?Thunderbit 也可以继续跟进子页面链接,把那里的数据一起抓下来。

- 结构化导出: 你可以一键把结果直接导出到 Google Sheets、Excel、Notion、Airtable 或 CSV,而且免费。

- 无需编程: 只要你会浏览网站,就能用 Thunderbit。就这么简单。

而且因为 Thunderbit 是垂直型 AI 智能体,它天生就为了稳定性和可重复性而设计——非常适合需要反复自动化同类任务的企业用户。

分步教程:如何用 Thunderbit 找出域名下的所有 URL

准备好看看它怎么工作了吗?下面是一个不需要技术背景的完整操作流程,教你提取所需的每个 URL。

1. 安装 Thunderbit Chrome 扩展

第一步很简单:。它可以在 Chrome、Edge、Brave 和其他 Chromium 浏览器上运行。建议把它固定到工具栏,方便随时使用。

2. 打开目标列表页或目录页

访问你想从中提取 URL 的网站。可以是首页、站点地图、目录页,或者任何一个链接到你关心页面的列表页。

3. 启动 Thunderbit 并设置字段

点击 Thunderbit 图标打开扩展,新建一个爬虫模板。真正的魔法从这里开始:

- 点击 “AI 自动识别字段”。Thunderbit 的 AI 会扫描页面并建议列名——留意像“页面 URL”“链接”之类的字段。

- 如果没有看到你想要的那个字段,就直接新增一列,命名为“页面 URL”(或者任何你觉得合理的名字)。Thunderbit 的 AI 能识别这些术语,并把它们映射到正确的数据。

4. 需要的话,开启分页或滚动

如果你的目标页面有多页内容(比如“第 1 页、第 2 页、第 3 页……”或者“加载更多”按钮),就在 Thunderbit 里启用分页:

- 网站有“下一页”按钮时,切换到 “点击分页” 模式;如果是滚动到页面底部会自动加载更多内容,则切换到 “无限滚动” 模式。

- Thunderbit 会提示你选择“下一页”按钮或滚动区域——你只要点一下,剩下的交给 AI。

5. 开始抓取并检查结果

点击 “抓取” 按钮。Thunderbit 会爬完整个页面序列,把它找到的每个 URL 都收集起来。你会在扩展里看到结果直接填充成表格。对于大型网站,这可能需要几分钟,但还是比手动操作快得多。

6. 导出你的 URL 列表

抓取完成后,点击 导出。你可以把数据直接发送到:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

导出是免费的,而且会保留所有格式。不再需要反复复制粘贴。

将 Thunderbit 与其他 URL 提取方案进行比较

| 方法 | 易用性 | 准确性与覆盖范围 | 可扩展性 | 导出选项 |

|---|---|---|---|---|

| 手动复制粘贴 | 很痛苦 | 低(很容易漏) | 没有 | 手动(Excel 等) |

| 浏览器链接提取器 | 单页还行 | 中等 | 较差 | 手动 |

Google site: 搜索 | 简单 | 中等(不完整) | 上限约 1,000 条 | 手动 |

| XML 站点地图 | 简单(如果有) | 好(如果是最新的) | 好 | 手动/脚本 |

| SEO 工具(Screaming Frog) | 偏技术 | 高 | 高(付费) | CSV、Excel |

| Python 脚本(Scrapy 等) | 非常技术化 | 高 | 高 | 自定义 |

| Thunderbit | 非常简单 | 非常高 | 高 | Google Sheets、CSV 等 |

Thunderbit 把专业爬虫的准确性和规模,与浏览器扩展的易用性结合到了一起。无需代码,无需配置,直接出结果。

附加功能:用 Thunderbit 提取的不只是 URL

更有意思的地方来了。Thunderbit 不只是抓 URL,你还可以提取:

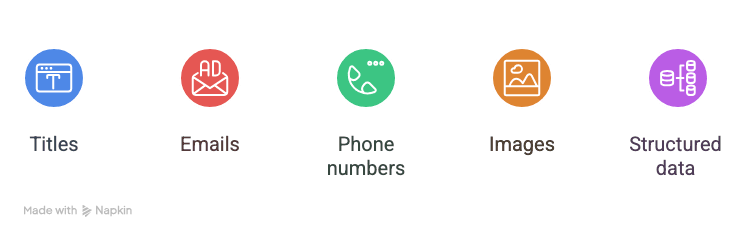

- 标题

- 邮箱

- 电话号码

- 图片

- 页面上的任何结构化数据

比如,如果你在做潜在客户名单,你可以让 Thunderbit 一次性抓下目录中每条记录的个人资料 URL、姓名、邮箱和电话号码。若你在做产品审计,可以提取产品 URL、名称、价格和库存状态。Thunderbit 甚至支持,这样它可以点进每个链接并从里面提取详细信息。

而且,Thunderbit 的邮箱和电话号码提取器完全免费。这对销售和市场团队来说非常实用。

核心要点:如何借助 AI 找出网站上的所有页面

我们来总结一下:

- 用手动工具或通用工具从域名里提取所有 URL,很难。

- GPT 这类通用 AI 模型无法处理网页导航、分页或动态内容。

- 像 Thunderbit 这样的垂直型 AI 智能体,是为网页数据提取量身打造的——稳定、可重复,而且企业用户很容易上手。

- Thunderbit 让流程变得很简单: 安装扩展、用 AI 识别字段、启用分页、抓取、导出。无需代码,毫不费力。

- 你提取的不只是 URL: 标题、邮箱、电话号码等等都可以拿到——非常适合获客、审计或研究。

如果你已经厌倦了复制粘贴链接,或者被技术型爬虫折腾得够呛,。它有免费套餐,你可以亲自看看它能帮你省下多少时间(和精神消耗)。

如果你还想了解 Thunderbit 还能帮你做什么——比如、,或者——可以去看看 ,那里有更多指南和技巧。

准备好把手工采集数据的时间还给自己了吗? 网页数据提取的未来属于垂直型 AI 智能体,而 Thunderbit 正在走在最前面。试试看吧,让你下一次的审计、潜在客户名单或研究项目,成为最轻松的一次。

延伸阅读

P.S. 如果你哪天又想手动复制粘贴 1,000 个 URL,请记住:现在已经有 AI 能干这件事了。你的手腕(还有你的老板)都会感谢你。