互联网发展得比我早上的咖啡还快——而且我喝咖啡可不算慢。到了2026年,网页数据提取早就不是极客们的小众玩法,而是销售线索挖掘、电商价格监控、市场调研、房产分析等场景的核心武器。,选对合适的库或工具,能让你彻底摆脱重复劳动,轻松搞定一大堆有用数据——比同行快一步。

有意思的是,2026年的网页爬虫库真是百花齐放,从零代码的AI浏览器插件,到面向开发者的专业框架应有尽有。不管你是想把客户名单导进Excel的销售,还是要追踪500个SKU的运营,还是喜欢用Python自定义爬虫的技术达人,总有一款适合你。作为在SaaS和自动化圈子里摸爬滚打多年的老司机(熬夜无数),我帮你梳理了2026年最值得关注的十大网页爬虫库,还会教你怎么选到最省心的那一款。

2026年,什么样的网页爬虫库才算“强大”?

在正式上榜单前,先聊聊选网页爬虫库时真正该关注的几个点。以我的经验,2026年最受欢迎的工具一般都具备这些特质:

- 易用性: 非技术人员能不能几分钟就上手?还是得精通Python才行?

- 动态内容处理能力: 能不能抓取现代、JavaScript驱动的网站?遇到复杂页面会不会“卡壳”?

- 语言与平台支持: 支持你常用的开发语言(比如Python、JavaScript、Java)吗?能不能直接在浏览器用?

- 可扩展性: 能不能轻松处理上百、上千页面的数据?

- 集成与导出: 能不能无缝对接Excel、Google Sheets、Notion或者你的数据管道?

- AI与自动化: 2026年,能用自然语言直接操作的AI工具特别受欢迎,尤其适合不想写代码的业务用户。

现实中,企业团队最看重的就是速度、准确率和极简配置。你花在修修补补爬虫或调代码上的时间越少,行动就越快。随着AI和浏览器自动化的普及,哪怕没有技术背景,也能轻松搞定过去只有开发者才能完成的数据抓取任务()。

好了,直接进入正题。

2026年十大强大网页爬虫库推荐

- :浏览器内零代码、AI驱动的网页爬虫

- :Python下简单高效的HTML解析与数据清洗

- :大规模、高速爬取与数据管道框架

- :浏览器自动化,专治动态、JS重的网站

- :Python下极速的XML/HTML解析

- :Python版jQuery选择器,轻松选取HTML元素

- :Python一站式HTTP、HTML解析与JS渲染

- :Python自动化表单与简单浏览器操作

- :Node.js下无头Chrome自动化

- :Java下强大的HTML解析库

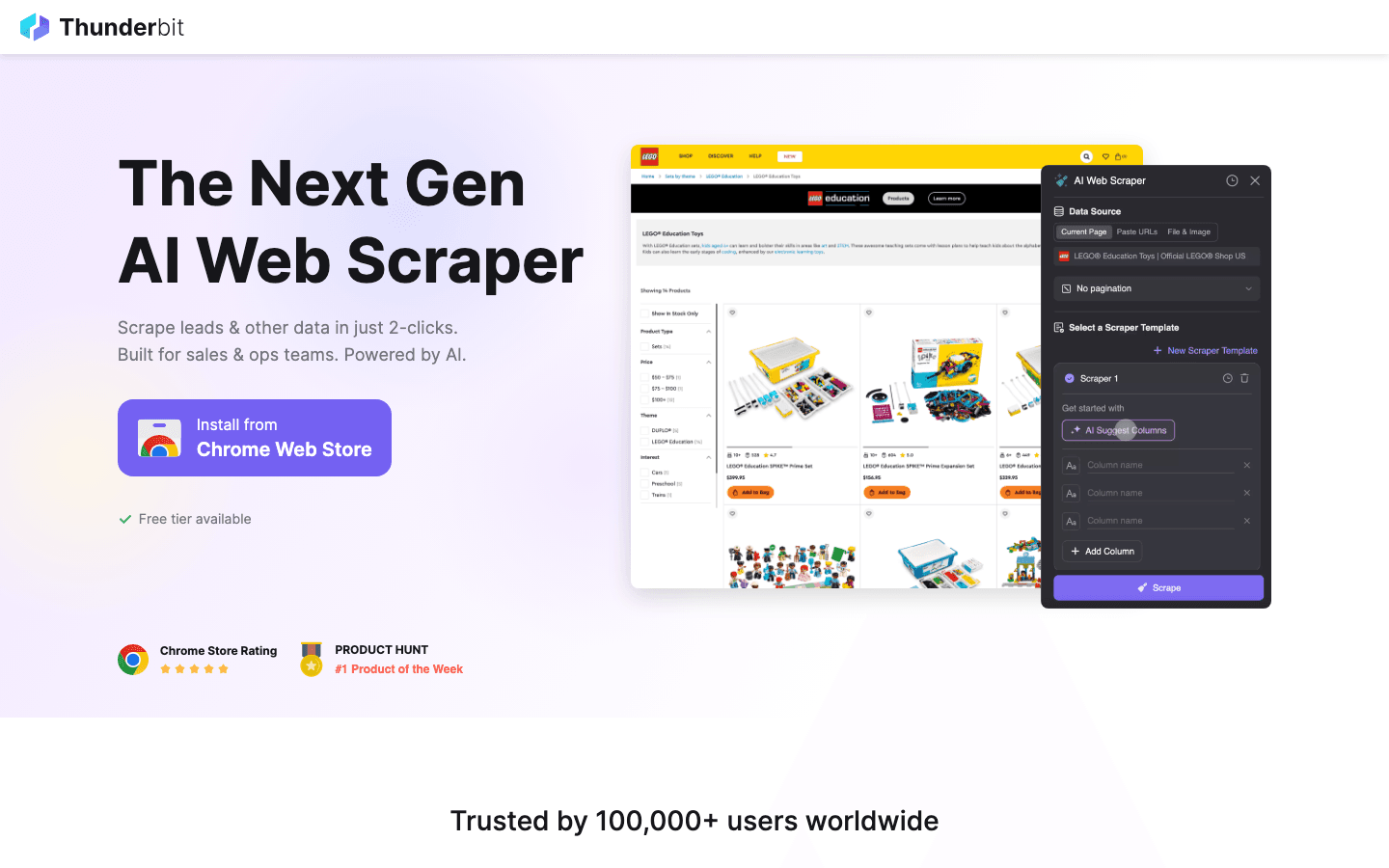

1. Thunderbit

是我最推荐给零基础用户的网页数据抓取工具。这款只要用自然语言描述需求(比如“提取本页所有商品名称、价格和图片”),AI就能自动识别并完成抓取。无需模板,无需配置——只需点一下“AI 智能识别字段”,有需要还能微调,然后一键“抓取”。

Thunderbit 2026年脱颖而出的原因:

- 零代码、自然语言操作: 任何人都能用——销售、运营、市场、房产等,无需Python基础。

- AI 智能识别字段: AI自动分析页面,推荐最优提取字段。

- 子页面抓取: 需要更详细信息?Thunderbit能自动访问每个子页面(比如商品详情、个人资料页),自动补全表格()。

- 热门网站一键模板: 支持Amazon、Zillow、Shopify等主流平台,点一下就能抓。

- 导出到Excel、Google Sheets、Notion、Airtable: 数据直接流向团队常用工具。

- 支持34种语言: 全球团队都能用。

- 云端/本地浏览器双模式: 云端适合公开网站,速度极快;浏览器模式可处理登录等场景。

Thunderbit已经获得全球3万+用户信赖,免费版可抓取6页(试用还能提升到10页)。想体验现代网页爬虫的便捷,这里绝对是最佳起点。

2. Beautiful Soup

是数据分析师和科学家们的心头好,尤其擅长解析“脏乱”HTML。如果你遇到标签混乱、格式奇怪的网页,Beautiful Soup绝对是你的救星。

Beautiful Soup 的优势:

- 处理不规范HTML: 擅长清洗和提取“烂页面”数据()。

- 易学易用: Python新手也能快速上手。

- 灵活组合: 可与Requests等HTTP库配合,结合lxml提升速度。

- 典型场景: 快速数据提取、网页数据清洗、小型脚本集成。

如果你主要处理静态页面或需要整理杂乱HTML,Beautiful Soup是稳妥之选。

3. Scrapy

是Python领域的“重型选手”,专为大规模爬取和数据管道而生。如果你要抓取成千上万页面、自动跟踪链接、批量处理数据,Scrapy就是为你量身打造的。

Scrapy 受欢迎的原因:

- 高度模块化: 可自定义复杂爬虫、数据管道和中间件()。

- 适合大型项目: 市场调研、竞品分析等大规模数据抓取首选。

- 异步高效: 性能优异,速度快。

- 社区活跃: 插件丰富,教程多,支持好。

Scrapy学习曲线稍微陡一点,但面对大项目,它绝对是效率神器。

4. Selenium

是浏览器自动化的首选工具,广泛用于网页测试和需要登录、点击、弹窗处理等复杂交互的爬取场景。遇到JavaScript重、动态性强的网站,Selenium能模拟真实用户操作()。

Selenium 的亮点:

- 自动化真实浏览器: 支持Chrome、Firefox、Safari、Edge等主流浏览器。

- 处理登录、弹窗、用户操作: 适合需要认证或多步操作的网站。

- 多语言支持: Python、Java、C#等。

- 最佳应用场景: 防爬机制强、需模拟用户行为的网站。

虽然比HTTP类库“重”一些,但有时候你确实需要一个“真人”浏览器。

5. lxml

是Python下性能极高的XML/HTML解析库。如果你追求极致速度(比如要解析成千上万的大型文档),lxml几乎无可匹敌()。

lxml 的优势:

- 速度极快: 在大文件处理上远超大多数Python解析器。

- 功能强大: 同时支持XML和HTML,易与其他工具集成。

- 适合场景: 批量处理大数据集,结合Beautiful Soup或Scrapy提升能力。

大规模爬取或处理超大文件时,lxml是必备利器。

6. PyQuery

把jQuery的选择器语法带到了Python。如果你喜欢用$('.class')选元素,PyQuery让你在Python脚本里也能这么玩()。

PyQuery 的亮点:

- jQuery风格选择器: 前端开发者上手无压力。

- 代码简洁易读: 复杂选择一行搞定。

- 底层集成lxml: 性能高效。

- 适合场景: 需要快速、类jQuery操作HTML的Python项目。

是前端转数据抓取的理想桥梁。

7. Requests-HTML

是一款集HTTP请求、HTML解析、JS渲染于一体的Python库。

Requests-HTML 的特色:

- 一站式解决方案: 抓取页面、解析HTML、渲染JavaScript全搞定。

- 新手友好: 适合小型或中等规模爬取项目。

- 适合场景: 快速脚本、部分动态内容网站、追求简洁的用户。

刚入门或需要灵活应对小型任务时,Requests-HTML非常合适。

8. MechanicalSoup

是基于Beautiful Soup和Requests的Python库,专注于自动化表单填写和简单浏览器交互。适合登录、填写表单、导航等基础流程()。

MechanicalSoup 的优势:

- 自动化表单与登录: 轻松抓取需认证的数据。

- API简洁: 新手易上手。

- 适合场景: 重复性浏览器任务、简单流程、无需全功能浏览器自动化的场合。

虽然不如Selenium强大,但轻量易用,满足基础需求绰绰有余。

9. Puppeteer

是Node.js下控制无头Chrome/Chromium的利器,深受需要抓取JS重、交互性强网站的开发者青睐()。

Puppeteer 的强项:

- 全功能浏览器自动化: 点击、滚动、表单填写、模拟用户操作。

- 动态内容处理: 适合JS渲染数据的网站。

- 适合场景: 电商、社交媒体、传统爬虫难以应对的现代网站。

如果你是JS开发者,或需应对“现代网页”,Puppeteer必不可少。

10. Jsoup

是Java领域解析HTML的标杆,堪称Java版Beautiful Soup()。

Java团队为何青睐Jsoup:

- API简洁强大: 几行代码即可提取、操作数据。

- 处理杂乱HTML: 能解析格式混乱的网页。

- 适合场景: Java业务系统或后端集成爬虫。

如果你的技术栈是Java,Jsoup就是不二之选。

网页爬虫库对比表

下面是10大爬虫库的横向对比:

| 库名称 | 语言 | 易用性 | 动态内容支持 | AI/零代码 | 典型应用场景 | 最佳适用人群 |

|---|---|---|---|---|---|---|

| Thunderbit | Chrome 插件 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 是 | 销售、运营、调研、房产等 | 非技术用户、业务团队 |

| Beautiful Soup | Python | ⭐⭐⭐⭐ | ⭐ | 否 | HTML解析、数据清洗 | Python新手、分析师 |

| Scrapy | Python | ⭐⭐⭐ | ⭐⭐ | 否 | 大规模爬取、数据管道 | 开发者、大数据项目 |

| Selenium | 多语言 | ⭐⭐ | ⭐⭐⭐⭐⭐ | 否 | 浏览器自动化、登录抓取 | 测试、动态网站爬取 |

| lxml | Python | ⭐⭐⭐ | ⭐ | 否 | 极速解析、大文件处理 | 高级用户、大数据集 |

| PyQuery | Python | ⭐⭐⭐⭐ | ⭐ | 否 | jQuery风格选择 | 前端开发、简洁脚本 |

| Requests-HTML | Python | ⭐⭐⭐⭐ | ⭐⭐ | 否 | 快速脚本、JS渲染 | 新手、小型项目 |

| MechanicalSoup | Python | ⭐⭐⭐⭐ | ⭐⭐ | 否 | 表单自动化、登录抓取 | 简单浏览器任务 |

| Puppeteer | Node.js | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | 否 | JS重网站、自动化 | JS开发、动态网页爬取 |

| Jsoup | Java | ⭐⭐⭐⭐ | ⭐ | 否 | Java下HTML解析 | Java团队、后端集成 |

如何为你的企业选择合适的网页爬虫库?

那到底该怎么选?根据我多年的踩坑经验,给你几点建议:

- 非技术或业务用户: 首选Thunderbit。AI/零代码方案让你几分钟就能出结果,团队只想要Excel或Sheets数据时,别自找麻烦。

- Python开发者: 小型任务选Beautiful Soup、Requests-HTML,大型项目用Scrapy,配合lxml或PyQuery更强大。

- 需要登录或动态内容? Selenium(多语言)或Puppeteer(Node.js)最合适。

- Java团队: 集成爬虫选Jsoup。

- 自动化表单或简单流程? MechanicalSoup轻量易用。

选型关键因素:

- 技术水平: Thunderbit等零代码工具适合非技术团队,开发者则更喜欢代码库的灵活性。

- 数据复杂度: 静态页面用Beautiful Soup或Jsoup,动态/JS重网站选Selenium或Puppeteer。

- 规模需求: Scrapy、lxml适合大规模高效爬取。

- 集成能力: Thunderbit可直接导出到Sheets、Notion、Airtable,极大提升业务效率。

想了解更多选型建议?可以参考。

总结:用对工具,释放网页数据价值

2026年的网页爬虫早就不是程序员或数据科学家的专属。AI驱动、零代码工具的普及,让每个团队——无论销售还是调研——都能轻松挖掘网页数据金矿。选对爬虫库,一年能为你节省数百小时(),提升数据准确率,让企业真正领先一步。

我的建议?先明确你的需求——速度、规模、技术门槛——多试几款工具。Thunderbit免费版是入门的好选择,想深入折腾也有Beautiful Soup、Scrapy等开源库可选。

想了解更多?欢迎浏览获取更多实用指南,或订阅我们的观看实操演示。

祝你抓数顺利,数据永远干净、结构清晰、随时可用!

常见问题

1. 2026年对非技术用户最友好的网页爬虫库是哪款?

是非技术用户首选。它的AI Chrome插件支持用自然语言描述需求,无需写代码即可抓取数据。

2. 哪个库最适合抓取JavaScript重或动态网站?

(Node.js)和 (多语言)最适合抓取动态、JS渲染的网站。它们能自动化真实浏览器,处理复杂交互。

3. Beautiful Soup和Scrapy有何区别?

适合解析单页或小型项目,尤其是HTML结构混乱的页面。 则是构建大规模爬虫和处理海量数据的完整框架。

4. 可以直接导出抓取数据到Google Sheets或Notion吗?

可以—— 支持一键导出到Google Sheets、Notion、Airtable和Excel。大多数代码库则需自行编写导出逻辑。

5. 如何为企业选择合适的网页爬虫库?

需综合考虑技术能力、目标网站复杂度、数据量和集成需求。Thunderbit等零代码工具适合业务团队,开发者则可选Scrapy、Beautiful Soup或Puppeteer等库以获得更高自由度。

延伸阅读