上个季度,我们运营团队每周要花 40 个小时,把竞品数据从网页一条条复制进表格;但这个季度,只要 20 分钟就搞定。

差别就在于:自动化网页爬虫工具。它们早就不是“程序员专属玩具”了,现在连销售、市场同事都能趁着午饭时间把流程搭起来,直接跑起来。

我做 SaaS 和自动化工具很多年了(没错,我也是 的联合创始人)。2026 这一波工具,真的是我见过最能打的一代——AI 原生、带自我修复能力,而且对非技术用户也是真的友好。

下面这 10 款我都亲自上手测过,并且按使用场景和上手门槛做了对比。

为什么自动化网页爬虫工具对业务团队至关重要

说句大实话:手动从网站复制粘贴数据的时代已经过去了(除非你真的享受重复劳动带来的手腕酸痛和精神内耗)。自动化网页爬虫工具已经成了各类企业的“刚需”。事实上,,而网页数据采集就是其中非常关键的一环。

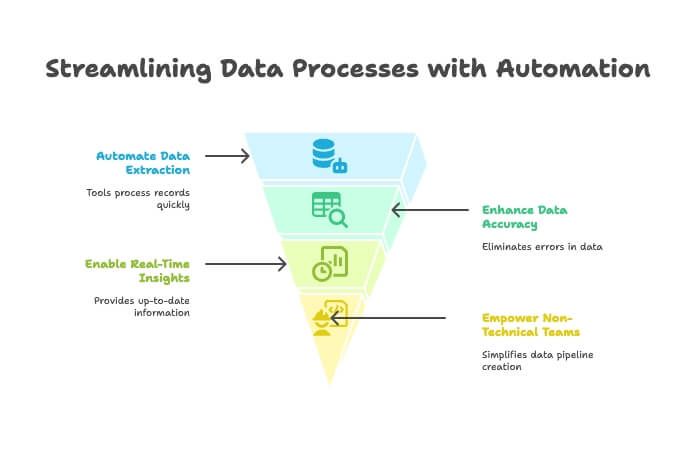

这些工具之所以值钱,核心原因在于:

- 节省时间、减少手工劳动: 自动化爬虫能在几分钟内处理成千上万条记录,让团队把精力留给更高价值的工作。有用户反馈,通过自动化采集数据每周能省下“数百小时”()。

- 提升数据准确性: 不用再担心手动录入的错别字、漏填、格式乱飞;自动提取的数据更干净、更稳定。

- 加速决策: 有了实时数据,你可以随时盯竞品、跟价格、搭线索名单,不必再等“每月实习生报告”。

- 让非技术团队也能上手: 借助无代码与 AI 驱动工具,就算把“XPath”当成瑜伽动作的人,也能把网页数据管道搭起来()。

难怪有调查显示,,其中近 80% 认为没有这些数据,组织会很难高效运转。到了 2026,如果你还没把数据抓取自动化,很可能就是把钱和洞察都白白留在桌面上。

我们如何挑选最佳自动化网页爬虫工具

网页爬虫软件市场预计到 2032 年将。在这么多选择里挑工具,就像走进一家摆着一万双鞋的店——看得人眼花缭乱。我的筛选标准是:

- 易用性: 非开发者能不能快速上手?学习成本高不高?

- AI 能力: 能否用 AI 自动识别字段、搞定动态页面,或支持用自然语言描述需求?

- 导出与集成: 数据能否顺畅进 Excel、Google Sheets、Airtable、Notion 或 CRM?

- 价格: 有没有免费试用?付费方案对个人/小团队友不友好,还是只面向企业?

- 可扩展性: 能否同时覆盖一次性小任务与大规模、可定时的采集?

- 目标用户: 更偏业务用户、开发者,还是两边都照顾?

- 独特优势: 它凭什么能从同类里脱颖而出?

我把不同门槛的工具都放进来了——从“我只想要一张表”到“我想把整个互联网都爬一遍”。下面进入清单。

1. Thunderbit:人人都能用的 AI 网页爬虫工具

先从我最熟悉的工具聊起——毕竟它就是我和团队为了长期解决业务用户痛点而做的。 不是传统那种“拖拽配置”或“自己写选择器”的爬虫,而更像一位 AI 数据助手:你用人话讲清楚想要什么,它就把脏活累活全包了——无需代码、不用折腾 XPath,也不用抓狂。

为什么 Thunderbit 排在第一

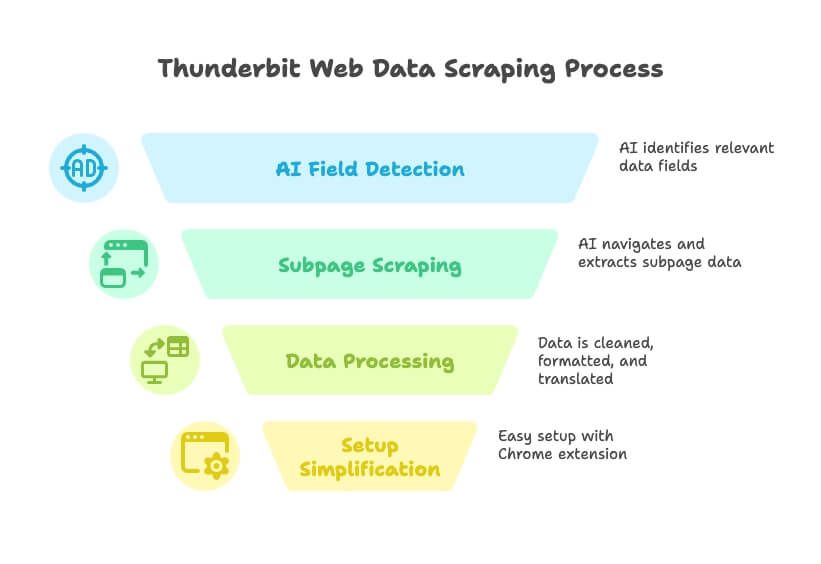

Thunderbit 是我见过最接近“把任何网站变成数据库”的工具。它的工作方式是:

- 自然语言驱动: 直接告诉 Thunderbit 你要什么数据(比如“把这个目录里的公司名称、邮箱和电话都抓出来”),AI 会自动识别对应字段。

- AI Suggest Fields: 一键读页面并推荐最合适的提取列,告别反复试错。

- 子页面与多层级抓取: 需要点进每条列表的详情页补信息?Thunderbit 能自动进去抓取并回填到表格。

- 数据清洗、翻译与分类: 不只是“抓原始文本”,还能在抓取过程中顺手做格式整理、翻译,甚至字段分类。

- 几乎零配置: 安装 ,点一下 “AI Suggest Fields”,一分钟内就能开始抓取。

- 可免费试用、成本低: 免费额度很大方(最多可免费抓取 6 个页面),付费方案 $9/月起——比我一周咖啡钱还便宜。

Thunderbit 面向销售、市场与运营团队:要数据、要快、不要学习成本。无需写代码、无需装一堆插件、也不需要培训。就像请了个数据实习生——而且特别听话、从不抱怨。

Thunderbit 的亮点功能

- AI 驱动抓取: AI 能理解页面结构、适应布局变化,并自动处理翻页与子页面()。

- 即时导出: 结果可直接发到 Excel、Google Sheets、Airtable、Notion,或下载为 CSV/JSON。

- 云端或本地运行: 要更快更大规模就跑云端;要用登录态/会话就用浏览器本地跑。

- 定时爬虫: 设置周期任务,持续更新数据——特别适合价格监控或线索定期刷新。

- 几乎免维护: 网站改版也不怕,Thunderbit 的 AI 会自适应,减少“修爬虫”的时间()。

适合谁? 任何想在几分钟内从“我需要这些数据”到“给你表格”的人——尤其是非技术用户。Thunderbit 已拥有与 4.9★ 评分,正在成为业务团队追求“结果而非折腾”的首选。

想看实际效果?可以去 或浏览更多 。

2. Clay:把自动化数据补全与网页抓取合在一起

Clay 很像增长团队的“瑞士军刀”。它不只是网页爬虫,更像一张能自动化的表格:可连接 50+ 实时数据源(比如 Apollo、LinkedIn、Crunchbase),并用内置 AI 做线索补全、撰写外联邮件、给潜客打分。

- 工作流自动化: 每一行是一条线索,每一列都能拉取数据或触发动作。想抓公司名单、补全 LinkedIn 信息、再发个性化邮件?Clay 可以一条龙。

- AI 集成: 使用 GPT-4 写破冰句、总结简介等。

- 集成能力: 原生连接 HubSpot、Salesforce、Gmail、Slack 等。

- 价格: 专业版约 $99/月起,提供轻量免费试用。

适合谁? 外呼销售、增长黑客、市场团队:希望把“抓取 + 补全 + 外联”做成自定义线索流水线的人。功能很强,但如果你不熟悉自动化工具,上手会有一定学习成本()。

3. Bardeen:面向工作流自动化的浏览器端网页爬虫工具

Bardeen 就像一个“浏览器机器人”,通过 Chrome 扩展就能抓取数据,并把重复的网页操作自动化。

- 无代码自动化: 500+ “Playbooks”,覆盖抓取、填表、跨应用搬运数据等。

- AI 指令构建器: 用自然语言描述任务,Bardeen 自动生成流程。

- 集成: 支持 Notion、Trello、Slack、Salesforce 等 100+ 应用。

- 价格: 轻量使用免费(每月 100 自动化积分),团队付费 $99/月起。

适合谁? 高阶用户与 GTM 团队:希望把抓取与后续动作(同步、提醒、跟进)串起来的人。灵活度很高,但新手可能会觉得门槛略陡()。

4. Bright Data:企业级自动化网页爬虫工具

Bright Data(原 Luminati)属于网页抓取里的“重型装备”——全球代理网络、强大的 API,以及每天抓取成千上万页面的能力。

- 企业级规模: 超过 1 亿 IP、Web Scraper IDE、Web Unlocker 用于绕过反爬机制。

- 高度可定制: 可构建复杂的大规模抓取任务,稳定性强。

- 价格: Web Scraper IDE $499/月起,也有更小的“micro”套餐。

适合谁? 大型企业、数据聚合商、需要高并发与抗封锁能力的高级用户。如果你每天要抓几千页并且必须避免 IP 被封,Bright Data 就是为你设计的()。

5. Octoparse:适合进阶用户的可视化网页爬虫工具

Octoparse 是很受欢迎的无代码工具,提供可视化点选界面——适合想要更强能力但不想写代码的人。

- 拖拽/点选界面: 点击网页元素定义提取内容,可处理登录、翻页等。

- 模板: 500+ 现成模板,覆盖常见网站(Amazon、Twitter 等)。

- 云端抓取: 可在 Octoparse 服务器运行任务、定时执行,并支持 IP 轮换。

- 价格: 有免费版但限制较多;付费 $119/月起。

适合谁? 非程序员与数据分析师:想要一款够强的爬虫但不写代码。适用于价格监控、商品列表、研究项目等()。

6. :面向企业的数据抓取平台

算是网页抓取领域的“老牌选手”,现在已经发展成完整的数据抽取平台。

- 点选式抽取: 支持登录、下拉框与交互元素。

- 云端能力: 可并发处理大量 URL、定时抓取,并提供 API。

- 企业定位: 常用于价格监控、市场研究、构建机器学习数据集。

- 价格: Starter $199/月,Standard $599/月,Advanced $1,099/月。

适合谁? 中大型企业与数据团队:需要稳定、可维护、适合大任务的解决方案。对个人小项目可能偏重,但对业务级需求非常强()。

7. Parsehub:带可视化编辑器的灵活网页爬虫工具

Parsehub 是桌面应用(Windows/Mac/Linux),通过在网站上点选操作来构建爬虫。

- 可视化流程: 选择元素、设置规则,可处理登录、下拉框与无限滚动。

- 云端功能: 支持云端运行、定时任务与 API。

- 价格: 小任务有免费档;付费 $149/月起。

适合谁? 研究人员、小企业或个人:想比浏览器扩展更可控,但又不想自己写爬虫代码的人()。

8. Common Crawl:面向 AI 与研究的开放网页数据

Common Crawl 严格来说不是传统“工具”,而是一份超大规模的开放网页爬取数据集,每月更新。

- 规模: 约 400TB 网页数据,覆盖数十亿页面。

- 免费开放: 不用自己搭爬虫也能拿到全网级数据。

- 需要技术能力: 需要大数据工具与工程能力来筛选、解析。

适合谁? 数据科学家与工程师:用于训练 AI 模型或做大规模研究。如果你需要通用网页文本或长期归档,它就是宝藏()。

9. Crawly:适合初创团队的轻量自动化网页爬虫工具

Crawly(Diffbot 出品)是云端、AI 驱动的爬虫,可从数百万网站抓取数据并直接返回结构化结果——无需手写解析规则。

- AI 抽取: 结合机器视觉与 NLP 识别并提取内容。

- API 访问: 可查询采集数据并接入分析系统或数据库。

- 价格: 企业级,需联系报价。

适合谁? 有一定技术能力的初创团队:需要大规模、智能化的数据抽取,但不想从零搭建爬虫体系()。

10. Apify:开发者友好的网页爬虫工具与市场

Apify 是一个云平台,你可以自己构建爬虫(称为 “Actors”),也可以直接用社区提供的大量现成爬虫。

- 开发者灵活性: 支持 JavaScript/Python 抓取、无头 Chrome、代理管理与定时任务。

- 市场: 拥有丰富的现成爬虫库,覆盖常见网站。

- 价格: 免费档每月含 $5 额度;付费 $49/月起。

适合谁? 开发者与技术型分析师:需要完全掌控与可扩展性的人。非程序员也能通过现成 Actors 完成常见任务()。

自动化网页爬虫工具对比表

| 工具 | 易用性 | AI 功能 | 起步价格 | 目标用户 | 独特优势 |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | 自然语言、AI Suggest Fields、子页面抓取 | $9/月 | 非技术业务用户 | 两步上手、零代码、即时导出、可免费试用 |

| Clay | ★★★★☆ | AI 补全、GPT-4 | $99/月 | 增长/销售运营 | 自动化表格、线索补全、外联 |

| Bardeen | ★★★★☆ | AI 指令构建器 | $99/月 | 高阶用户、GTM 团队 | 浏览器 RPA、500+ Playbooks、深度集成 |

| Bright Data | ★★☆☆☆ | 代理轮换、反爬 AI | $499/月 | 企业、开发者 | 规模化、稳定性、全球代理 |

| Octoparse | ★★★★☆ | 可视化 AI 识别 | $119/月 | 分析师、非程序员 | 拖拽点选、模板、云端抓取 |

| Import.io | ★★★☆☆ | 交互式抽取器 | $199/月 | 企业、数据团队 | 高并发、定时、API、支持服务 |

| Parsehub | ★★★★☆ | 可视化流程 | $149/月 | 研究人员、中小企业 | 桌面应用、擅长动态网站 |

| Common Crawl | ★☆☆☆☆ | 不适用(仅数据集) | 免费 | 数据科学家、工程师 | 超大开放数据集、全网级归档 |

| Crawly | ★★☆☆☆ | AI 抽取 | 定制/企业 | 初创团队、技术团队 | AI 驱动、无需解析规则、API 访问 |

| Apify | ★★★★☆ | Actor 市场 | $49/月 | 开发者、技术分析师 | 可自建/可复用、云端自动化、灵活度高 |

如何根据需求选择合适的网页爬虫工具

选哪款自动化网页爬虫工具,主要看团队规模、技术能力和业务目标。我的快速建议是:

- 非技术用户(销售/市场/运营): 优先选 。它就是为你们这种“要结果、要快、别折腾”的需求设计的——零代码、零配置、直接出表。特别适合获客、价格监控和快速数据项目。

- 热衷自动化的团队: 如果你想把抓取和补全、外联或工作流自动化打通,Clay 和 Bardeen 会更亮眼。

- 企业与开发者: Bright Data、 和 Apify 更适合大规模、强定制的项目。

- 研究人员与分析师: Octoparse 与 Parsehub 提供可视化界面和强功能,不写代码也能做复杂抓取。

- AI 与数据科学项目: Common Crawl 与 Crawly 更适合需要海量数据或 AI 抽取能力、用于建模/训练的人。

你可以先问自己:你是想几分钟内就跑起来,还是要搭企业级定制方案?不确定的话,从免费试用开始通常最稳——大多数工具都给试用。

Thunderbit 的独特价值:面向业务数据的 AI 助手

在这些工具里,Thunderbit 最不一样的点在于:它真的更像一位“AI 助手”,不只负责网页抓取,还负责把网页上的混乱信息变成可用的结构化数据和洞察,而且几乎没有技术门槛。

- 自然语言交互: 用中文/英文把需求讲清楚,剩下交给 Thunderbit。

- 全流程自动化: 从抽取到清洗、翻译再到导出,一条链路直接打通。

- 适合快速验证: 不管是验证新市场、搭线索名单还是监控竞品,Thunderbit 都是最快、成本最低的起点。

它就像把数据分析师塞进了浏览器里——不要求加薪,也不休假。

结语:选对自动化网页爬虫工具,效率从此不一样

2026 年的网页抓取生态,和两年前已经完全不是一个玩法:带自我修复能力的 AI 爬虫、LLM 原生的数据管道、真正好用的无代码工具,直接把规则改写了。无论你是独立创业者、小而精的销售团队,还是企业级数据科学团队,这份清单里都能找到适合你的选择。关键在于:把你的工作流和技能水平匹配到正确的平台——别再和代码死磕,把时间用来挖洞察。

如果你准备告别手动复制粘贴、开始更聪明地采集数据,可以先,体验网页抓取到底能有多简单;也可以按目标选择上面其他方案。无论如何,数据驱动的未来属于那些懂得自动化的人。

想继续深入?欢迎阅读 ,里面有更系统的拆解、教程与实战技巧,帮你把网页数据用到极致。也祝你:数据永远干净、爬虫永不断线(真断了也别慌,让 AI 来修)。

常见问题(FAQs)

1. 为什么 2026 年自动化网页爬虫工具对业务用户很重要?

自动化网页爬虫工具能把数据采集流程标准化与自动化,大幅节省时间、减少手工操作;同时提升数据准确性,支持实时决策,并让非技术团队无需写代码也能获取并使用网页数据。对销售、市场与运营来说,这类工具已经是关键基础设施。

2. Thunderbit 和其他网页爬虫工具最大的区别是什么?

Thunderbit 通过 AI 让用户用自然语言描述想要的数据;它会自动识别字段、处理子页面与翻页,并能一键导出到 Excel、Airtable 等平台。它面向非技术用户设计,同时提供数据清洗与定时爬虫等能力,并且价格门槛更低。

3. 哪款工具更适合企业级的大规模抓取项目?

Bright Data 与 更适合企业场景:提供代理轮换、反爬能力、大规模并发与 API 接入,适用于需要稳定处理成千上万网页的组织。

4. 有没有把抓取、自动化和外联结合在一起的工具?

有。Clay 与 Bardeen 不仅能抓取网页数据,还能把数据接入工作流:Clay 侧重线索补全与外联自动化;Bardeen 则通过 AI 驱动的 Playbooks 自动化浏览器任务与跨应用流程。

5. 完全没有技术背景的人,最推荐哪种选择?

Thunderbit 对非技术用户最友好:自然语言交互、AI 自动配置、上手简单,无需编码或复杂设置。非常适合希望快速、稳定拿到数据、又不想面对技术复杂度的业务用户。