网络上的数据多到爆炸,说真的——没人有时间一条条复制粘贴,去处理上千个商品列表或竞品价格页。如果你用的是 Linux(我大多数自动化和开发工作也都在 Linux 上做),你一定知道这个平台对数据驱动团队有多强大。事实上,,而且。但问题也就在这里:想找到一款真正适合你工作流的 Linux 网页爬虫——不管你是非技术业务用户,还是硬核开发者——都像大海捞针。

所以我整理了这份 2026 年最值得关注的 18 款 Linux 网页爬虫工具 深度盘点。从像 这样的 AI 驱动、无代码方案(没错,就是我和团队做的这个),到 Scrapy、Beautiful Soup 这类经典开发框架,这份清单能帮你更快选出最适合自己的 Linux 网页爬虫,省去反复试错的麻烦。

为什么 Linux 网页爬虫工具对业务用户很重要

说实话:手动收集数据就是效率杀手。研究显示,依赖复制粘贴的团队每周都会浪费好几个小时,错误率还会接近 5%——这几乎注定会带来昂贵的失误和错失机会()。Linux 具备稳定性、安全性和灵活性,是运行需要 24/7 持续工作的爬虫的首选平台——无论你是在桌面电脑、服务器还是云端运行。

Linux 网页爬虫工具的常见业务场景:

- 线索挖掘: 销售团队抓取目录、社交媒体或点评网站中的最新联系人,省去人工筛选的苦差事()。

- 价格监控: 电商团队自动拉取竞品价格和库存数据,让自家定价始终保持竞争力。

- 竞品研究: 市场和运营团队跟踪产品上新、用户评价和 SEO 关键词,不再“盲飞”。

- 市场情报: 分析师汇总新闻、论坛和社交数据,实时捕捉趋势变化。

- 工作流自动化: 某些工具(尤其是 AI 驱动工具)甚至能直接在你的 Linux 机器上自动化网页工作流,比如填表或导航仪表盘。

最棒的是:合适的 Linux 网页爬虫工具不仅能让开发者受益,也能让非技术用户轻松获取并利用网页数据,做出更快、更聪明的业务决策。

我们是如何筛选出最适合 Linux 的网页爬虫的

并不是所有爬虫都一样,尤其是在 Linux 上。我主要看这些标准:

- Linux 兼容性: 这里的每款工具都能原生运行于 Linux、通过浏览器使用,或可借助简单的替代方案(如 Wine 或云端访问)。

- 易用性: 从自然语言 AI 提示到可视化点选界面,我优先选择能让非程序员快速出结果的工具——但也没有忽略想要完全控制权的高级用户。

- 数据抓取能力: 能否处理动态内容、分页、子页面以及不同类型的数据?能否扛住反爬机制?

- 扩展性与自动化: 定时任务、云端抓取、分布式爬取——这些都是严肃数据项目的必备项。

- 集成与导出: CSV、Excel、Google Sheets、API——如果数据导不出来,再强也没意义。

- 价格与授权: 免费、开源或付费——从个人创始人到企业团队,各种预算都能找到合适方案。

- 社区与支持: 活跃的用户群、完善的文档和及时的支持,遇到问题时差别非常大。

我也结合了真实用户反馈、行业评测,以及自己亲手使用这些工具的经验。我们开始看清单吧。

1. Thunderbit

是我最推荐给业务用户的 Linux 网页爬虫,因为它真的很好上手。作为一款,它在 Linux 上运行得非常顺畅(只要打开 Chrome 或 Chromium 就行),还能让你只用两次点击就从任何网站抓取数据。

是我最推荐给业务用户的 Linux 网页爬虫,因为它真的很好上手。作为一款,它在 Linux 上运行得非常顺畅(只要打开 Chrome 或 Chromium 就行),还能让你只用两次点击就从任何网站抓取数据。

Thunderbit 的亮点:

- 自然语言提示: 只要描述你想要什么(比如“提取这个页面上所有商品名称和价格”),Thunderbit 的 AI 就会自动理解并完成剩下的工作。

- AI 推荐字段: 点一下,Thunderbit 就会扫描页面并建议列和数据类型,不需要手动选字段。

- 子页面与分页抓取: 需要更多详情?Thunderbit 可以自动访问每个子页面(比如商品详情页),并为你的表格补充更多信息。

- 云端或本地抓取: 云端一次可抓取最多 50 个页面;如果网站需要登录,也可以使用浏览器模式。

- 即时导出: 一键导出到 Excel、Google Sheets、Airtable、Notion、CSV 或 JSON——始终免费。

- 额外工具: 一键提取邮箱、电话号码和图片。AI 自动填表甚至还能帮你自动填写表单。

价格: 免费版可抓取 6–10 个页面,付费方案从 每月 15 美元,500 行 起()。用户很喜欢它“几乎没有学习成本”,而且能把“几个小时的工作压缩成几分钟”()。如果任务量很大,可能需要拆成多次运行,但对大多数业务场景来说,它能省下非常多时间。

Linux 兼容性: 100%。只要在你的 Linux 桌面或服务器上运行 Chrome/Chromium 即可。

适合人群: 非技术业务用户(销售、市场、运营),想要最快、最简单的上手体验。

2. Scrapy

是 Python 开发者的黄金标准,适合想要一个 灵活、可扩展的 Linux 网页爬虫 的人。它是开源的,速度极快(异步爬取),既能处理简单抓取,也能应对大规模分布式爬取。

是 Python 开发者的黄金标准,适合想要一个 灵活、可扩展的 Linux 网页爬虫 的人。它是开源的,速度极快(异步爬取),既能处理简单抓取,也能应对大规模分布式爬取。

主要功能:

- 异步高速爬取——非常适合抓取成千上万个页面。

- 高度可扩展: 支持代理、验证码等插件。

- 与 Python 数据栈无缝集成: 可输出到 JSON、CSV、数据库或 pandas。

- 支持 cookies、会话和自动限速。

价格: 100% 免费且开源。

Linux 兼容性: 原生支持(可通过 pip 安装)。在服务器和容器中都运行良好。

适合人群: 构建自定义、大规模爬虫的开发者。

提醒: 对非程序员来说有一定学习门槛,但如果你会 Python,Scrapy 很难被超越。

3. Beautiful Soup

是一个轻量级 Python 库,用于解析 HTML 和 XML。它很适合快速、临时性的抓取,或者清理杂乱网页内容。

是一个轻量级 Python 库,用于解析 HTML 和 XML。它很适合快速、临时性的抓取,或者清理杂乱网页内容。

主要功能:

- 简单、易懂的 API——非常适合初学者。

- 与 requests 搭配使用效果很好,用于获取网页内容。

- 能优雅处理损坏的 HTML。

价格: 免费且开源。

Linux 兼容性: 100%(纯 Python)。

适合人群: 做小型到中型抓取或解析任务的开发者和数据科学家。

局限: 不支持 JavaScript 或动态内容——如果需要这类功能,可以和 Selenium 或 Puppeteer 结合使用。

4. Selenium

是经典的浏览器自动化框架。它能控制 Chrome、Firefox 或其他浏览器,用来抓取动态的、重 JavaScript 的网站。

是经典的浏览器自动化框架。它能控制 Chrome、Firefox 或其他浏览器,用来抓取动态的、重 JavaScript 的网站。

主要功能:

- 自动操作真实浏览器——可以像人一样登录、点击、滚动和交互。

- 支持 Python、Java、C# 等多种语言。

- 支持无头模式,适合在 Linux 服务器上运行。

价格: 免费且开源。

Linux 兼容性: 完整支持(只需要安装对应的浏览器驱动)。

适合人群: 测试工程师、抓取开发者,以及任何需要模拟用户行为的人。

提醒: 它比纯 HTTP 爬虫更耗资源、速度也更慢,但有时这是拿到数据的唯一办法。

5. Puppeteer

是 Google 出品的 Node.js 库,用于控制无头 Chrome/Chromium。它有点像 Selenium,但提供了现代化的 JavaScript API,并且与 Chrome 的各项功能结合得更紧密。

是 Google 出品的 Node.js 库,用于控制无头 Chrome/Chromium。它有点像 Selenium,但提供了现代化的 JavaScript API,并且与 Chrome 的各项功能结合得更紧密。

主要功能:

- 执行 JavaScript、处理动态内容,还能截图。

- 速度快、稳定,对 Node.js 开发者也很友好。

- 可拦截网络请求并屏蔽不需要的资源。

价格: 免费且开源。

Linux 兼容性: 会自动安装 Chromium,默认就是无头运行。

适合人群: 抓取现代 Web 应用或单页网站的开发者。

6. Octoparse

是一款无代码网页爬虫,带有拖拽式界面和大量预制模板。虽然桌面应用只支持 Windows/Mac,但 Linux 用户可以通过浏览器访问它的云平台,或者用 Wine 运行 Windows 版。

是一款无代码网页爬虫,带有拖拽式界面和大量预制模板。虽然桌面应用只支持 Windows/Mac,但 Linux 用户可以通过浏览器访问它的云平台,或者用 Wine 运行 Windows 版。

主要功能:

- 100+ 即用型抓取模板,覆盖 Amazon、eBay、Zillow 等网站。

- 可视化工作流设计器——点一点、拖一拖就能搭建爬虫。

- 云端抓取和定时任务——让 Octoparse 的服务器帮你干重活。

- 可导出到 Excel、CSV、JSON 和数据库。

价格: 免费版(功能受限),付费方案从 每月 75–89 美元 起。

Linux 兼容性: 可通过云端/网页访问;桌面应用可通过 Wine 运行。

适合人群: 需要快速获取电商或市场数据的非程序员。

7. PhantomJS

是一款无头 WebKit 浏览器,曾经是轻量级浏览器自动化的首选。它现在已经停止维护,但在 Linux 上仍可用于旧项目或简单任务。

是一款无头 WebKit 浏览器,曾经是轻量级浏览器自动化的首选。它现在已经停止维护,但在 Linux 上仍可用于旧项目或简单任务。

主要功能:

- 可用 JavaScript 编写脚本。

- 能处理一定程度的 JavaScript,并可截图/PDF。

- 不需要图形界面。

价格: 免费且开源。

Linux 兼容性: 原生二进制可用。

适合人群: 旧项目,或无法安装 Chrome 的环境。

注意: 已经不再维护——现代网站可能不太兼容。

8. ParseHub

是一款可视化、跨平台网页爬虫,并提供原生 Linux 应用。它非常适合不写代码、但又想抓取复杂动态网站的用户。

是一款可视化、跨平台网页爬虫,并提供原生 Linux 应用。它非常适合不写代码、但又想抓取复杂动态网站的用户。

主要功能:

- 点选式界面——选择元素,用可视化方式构建工作流。

- 可处理动态内容、地图、无限滚动等场景。

- 支持云端执行和定时任务。

- 可导出到 CSV、JSON,或通过 API 导出。

价格: 免费计划(5 个项目),付费方案从 每月 189 美元 起。

Linux 兼容性: 支持 Linux、Windows、Mac 原生应用。

适合人群: 想要可控但不想写代码的分析师和半技术用户。

9. Kimurai

是一个 Ruby 网页抓取框架,可在 Linux 上原生运行。它有点像 Scrapy,但面向 Ruby 开发者。

是一个 Ruby 网页抓取框架,可在 Linux 上原生运行。它有点像 Scrapy,但面向 Ruby 开发者。

主要功能:

- 支持多浏览器: 无头 Chrome、Firefox、PhantomJS 或纯 HTTP。

- 异步处理,支持高并发。

- 用于编写爬虫的 Ruby DSL 很简洁。

价格: 免费且开源。

Linux 兼容性: 100%(Ruby)。

适合人群: Ruby 开发者,或需要自定义高并发抓取的 Rails 团队。

10. Apify

是一个基于云的网页抓取平台,提供开源 SDK 和一个现成“Actors”市场。你可以在 Linux 机器上运行爬虫,也可以在云端运行。

是一个基于云的网页抓取平台,提供开源 SDK 和一个现成“Actors”市场。你可以在 Linux 机器上运行爬虫,也可以在云端运行。

主要功能:

- 提供 Node.js、Python 等 SDK。

- 有可直接使用的爬虫市场。

- 支持云端执行、定时任务和 API 集成。

价格: 有免费层,云端用量按实际使用计费。

Linux 兼容性: CLI/SDK 可在 Linux 上运行;云平台可通过浏览器访问。

适合人群: 想把自定义开发和现成云基础设施结合起来的开发者。

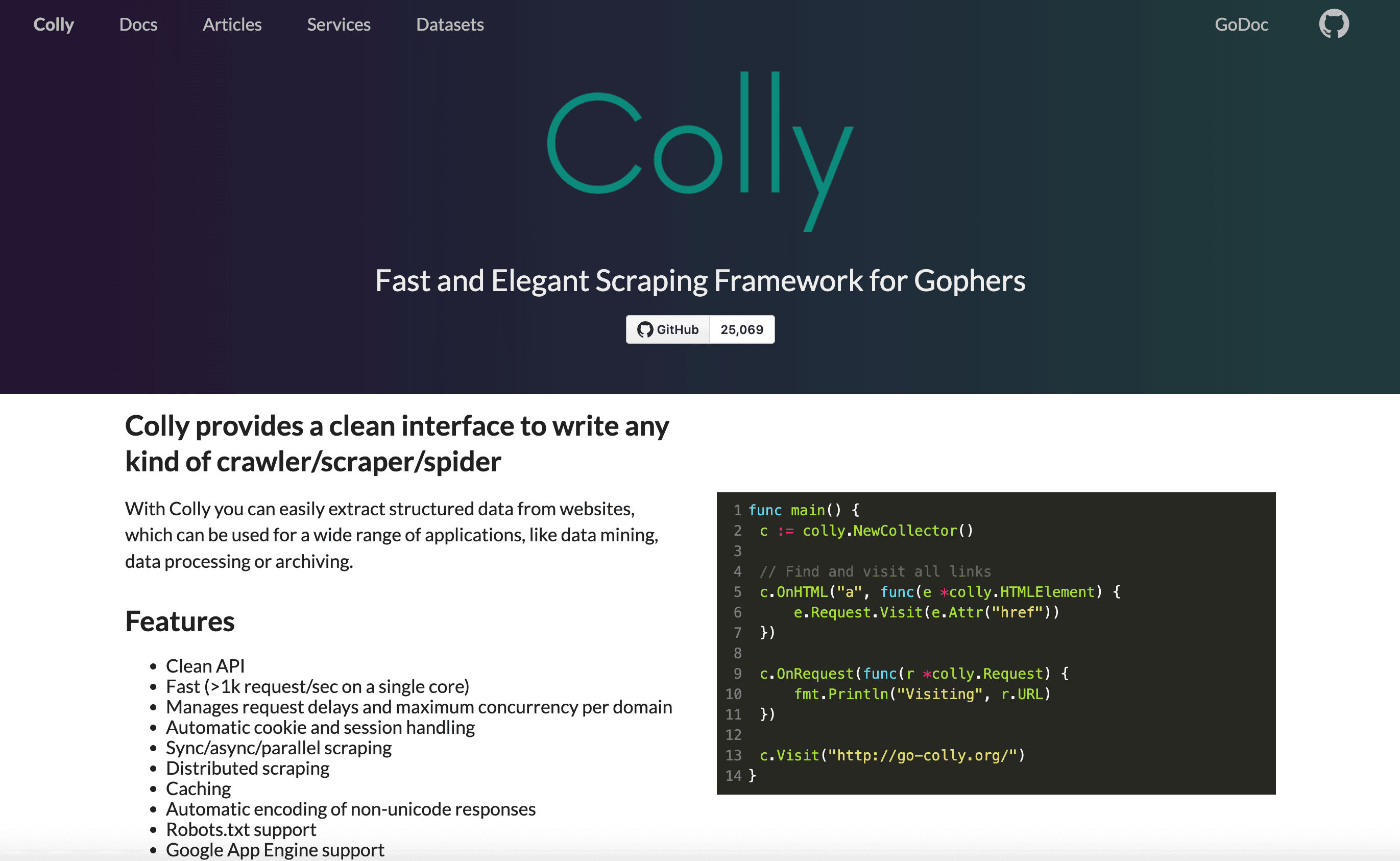

11. Colly

是一个基于 Go 的网页抓取框架,主打速度和效率。如果你是 Go 开发者,这就是你的工具。

是一个基于 Go 的网页抓取框架,主打速度和效率。如果你是 Go 开发者,这就是你的工具。

主要功能:

- 超高速并发抓取——单核每秒可处理 1,000+ 请求。

- 礼貌爬取(遵守 robots.txt)、会话/ Cookie 管理。

- 内存占用低。

价格: 免费且开源。

Linux 兼容性: 原生 Go 二进制。

适合人群: 需要高性能抓取的 Go 开发者。

12. PySpider

是一个带 Web 界面的 Python 爬虫系统。你可以直接在浏览器里管理、调度和监控爬取任务。

是一个带 Web 界面的 Python 爬虫系统。你可以直接在浏览器里管理、调度和监控爬取任务。

主要功能:

- 基于 Web 的脚本编写和监控界面。

- 支持分布式爬取、调度和重试。

- 可与数据库和消息队列集成。

价格: 免费且开源。

Linux 兼容性: 专为 Linux 部署设计。

适合人群: 通过 Web 界面管理多个抓取项目的团队。

13. WebHarvy

是一款面向 Windows 的可视化点选式爬虫,但 Linux 用户可以通过 Wine 运行。它以模式识别能力和一次性购买模式著称。

是一款面向 Windows 的可视化点选式爬虫,但 Linux 用户可以通过 Wine 运行。它以模式识别能力和一次性购买模式著称。

主要功能:

- 浏览并点击即可选取数据——无需编程。

- 可自动识别列表模式。

- 可导出到 CSV、JSON、XML、SQL。

价格: 约 139 美元的一次性授权。

Linux 兼容性: 可在 Wine 或虚拟机中运行。

适合人群: 想要快速、可视化爬虫的初学者或独立专业人士。

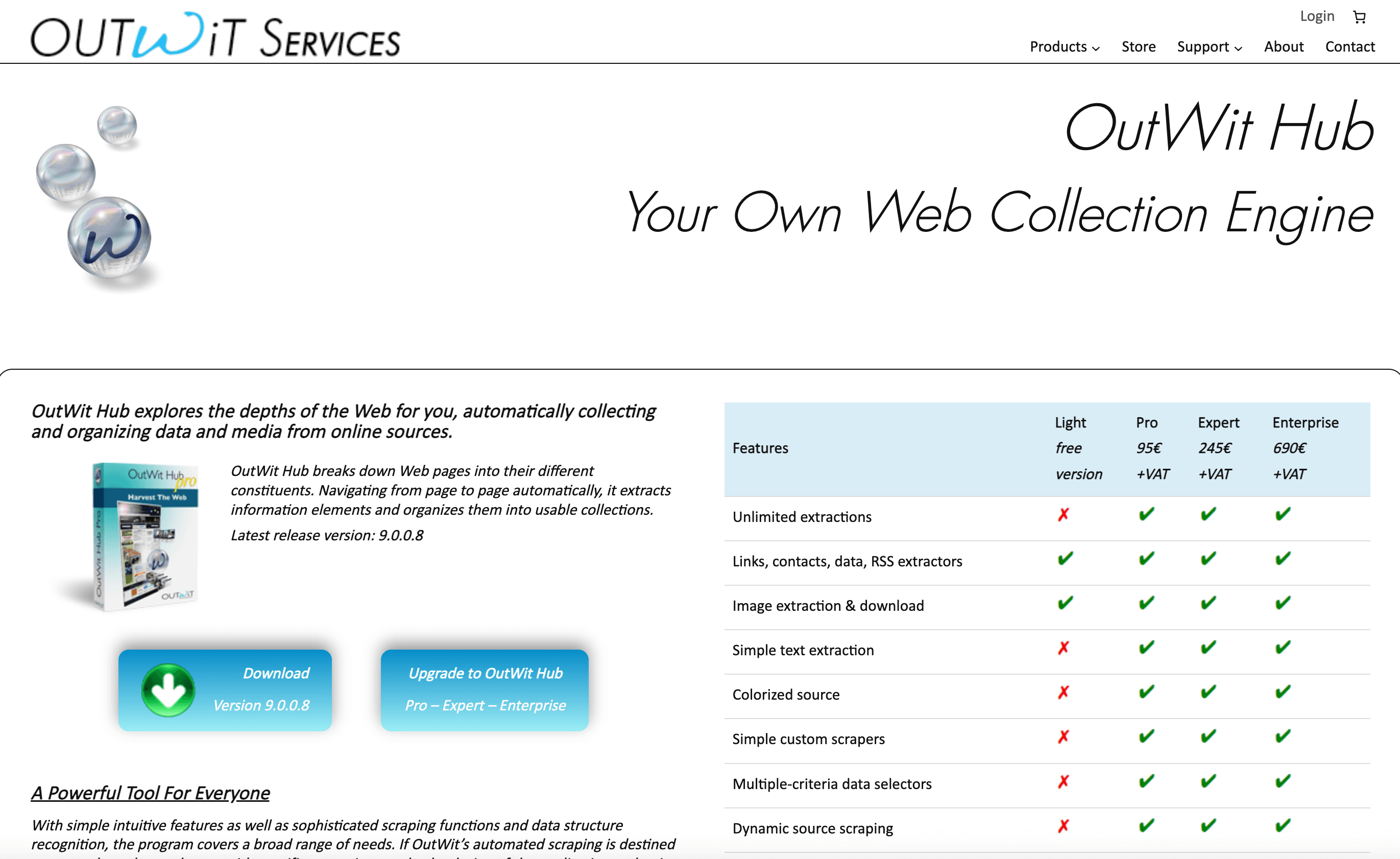

14. OutWit Hub

是一款用于网页抓取的原生 Linux 图形界面应用。它可以自动识别数据模式,并提供强大的提取与自动化功能。

是一款用于网页抓取的原生 Linux 图形界面应用。它可以自动识别数据模式,并提供强大的提取与自动化功能。

主要功能:

- 自动识别链接、图片、表格、邮箱等内容。

- 提供脚本编辑器,支持自定义提取。

- 支持宏自动化和定时任务。

价格: 免费版(功能受限),Pro 授权约 50–100 美元。

Linux 兼容性: 支持 Linux、Windows、Mac 原生应用。

适合人群: 有一定技术倾向、但不写代码、想用桌面图形界面的用户。

15. Portia

是 Scrapinghub 推出的一款开源可视化网页爬虫。它在浏览器中运行,允许你通过标注页面来训练爬虫。

是 Scrapinghub 推出的一款开源可视化网页爬虫。它在浏览器中运行,允许你通过标注页面来训练爬虫。

主要功能:

- 基于浏览器的可视化提取界面。

- 可与 Scrapy 集成,用于自定义项目。

- 开源且可扩展。

价格: 免费且开源。

Linux 兼容性: 基于浏览器;可在任何操作系统上使用。

适合人群: 想要开源、可视化抓取,并可与 Scrapy 集成的用户。

16. Content Grabber

是一款面向 Windows 的企业级可视化爬虫,但也可以通过 Wine 或虚拟化在 Linux 上运行。

是一款面向 Windows 的企业级可视化爬虫,但也可以通过 Wine 或虚拟化在 Linux 上运行。

主要功能:

- 可视化编辑器 + C# 脚本,支持高级逻辑。

- 多代理管理和定时任务。

- 可与数据库、API 等集成。

价格: 授权费用高达数千美元;服务器版从每月 69 美元起。

Linux 兼容性: 通过 Wine 或虚拟机运行。

适合人群: 管理大量抓取项目的代理商和大型团队。

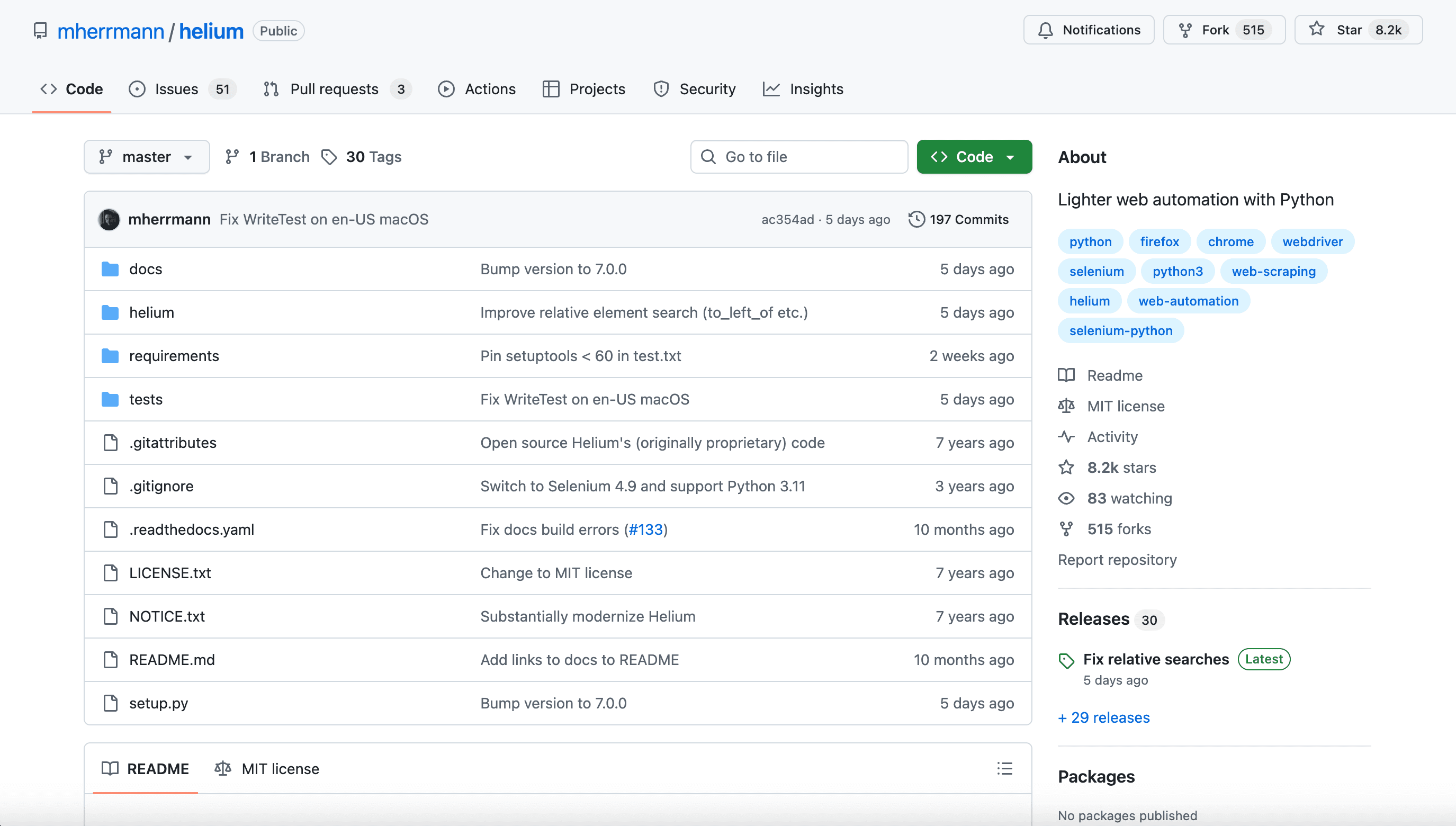

17. Helium

是一个简化 Selenium 自动化的 Python 库。它的目标是让浏览器脚本写起来更像人类思维。

是一个简化 Selenium 自动化的 Python 库。它的目标是让浏览器脚本写起来更像人类思维。

主要功能:

- 直观命令,例如

click("Login")或write("email")。 - 可自动操作 Chrome 和 Firefox。

- 非常适合快速脚本和自动化任务。

价格: 免费且开源。

Linux 兼容性: 可在 Linux 上使用(基于 Selenium)。

适合人群: 觉得 Selenium 太繁琐的 Python 用户。

18. Dexi.io

是一个基于云的数据提取与自动化平台。它可通过浏览器访问,因此 Linux 用户无需安装任何软件即可使用。

是一个基于云的数据提取与自动化平台。它可通过浏览器访问,因此 Linux 用户无需安装任何软件即可使用。

主要功能:

- 用于抓取和自动化的可视化工作流设计器。

- 支持定时任务、数据转换和 API 集成。

- 具备企业级扩展性和支持能力。

价格: 起价每月 119 美元(Standard 方案);更大规模可选择更高级别方案。

Linux 兼容性: 网页应用——可在任何操作系统上使用。

适合人群: 需要可扩展、集成化网页数据提取的专业人士和企业。

Linux 网页爬虫工具速览对比表

| 工具 | 类型 / 主要功能 | 适合人群 | 价格 | Linux 兼容性 |

|---|---|---|---|---|

| Thunderbit | AI Chrome 扩展、两步抓取、子页面、云端/本地 | 非技术业务用户 | 免费,起价每月 15 美元 | ✔ Linux 上的 Chrome |

| Scrapy | Python 框架、异步、CLI、高度可扩展 | 开发者、大规模自定义爬虫 | 免费 | ✔ 原生 |

| Beautiful Soup | Python 库、简单的 HTML/XML 解析 | 开发者、数据科学家、小任务 | 免费 | ✔ 原生 |

| Selenium | 浏览器自动化、重 JS 网站 | 测试、开发者、动态内容 | 免费 | ✔ 原生 |

| Puppeteer | Node.js、无头 Chrome、JS 渲染 | Node 开发者、现代 Web 应用 | 免费 | ✔ 原生 |

| Octoparse | 无代码、拖拽、云端模板 | 非程序员、电商 | 免费,起价每月 75 美元 | ◐ 云端/Wine |

| PhantomJS | 无头 WebKit、可脚本化 JS | 旧项目、轻量级、无需 Chrome | 免费 | ✔ 原生 |

| ParseHub | 可视化、跨平台、点选式 | 分析师、半技术用户 | 免费,起价每月 189 美元 | ✔ 原生 |

| Kimurai | Ruby 框架、多浏览器、异步 | Ruby 开发者、高并发 | 免费 | ✔ 原生 |

| Apify | 云平台、SDK、市场 | 开发者、混合式自定义/云端 | 免费层、按用量计费 | ✔ 原生/云端 |

| Colly | Go 框架、快速、并发 | Go 开发者、高性能 | 免费 | ✔ 原生 |

| PySpider | Python、Web UI、调度、分布式 | 团队、多项目 | 免费 | ✔ 原生 |

| WebHarvy | 可视化、模式识别、一次性授权 | 初学者、独立专业人士 | 约 139 美元一次性 | ◐ Wine/VM |

| OutWit Hub | 原生 GUI、自动识别数据、脚本 | 非程序员、桌面图形界面 | 免费版,Pro 50–100 美元 | ✔ 原生 |

| Portia | 开源、可视化、基于浏览器 | 开源用户、Scrapy 集成 | 免费 | ✔ 浏览器 |

| Content Grabber | 企业级、可视化、脚本、多代理 | 代理商、大型团队 | $$$,起价每月 69 美元 | ◐ Wine/VM |

| Helium | Python、简化版 Selenium、直观 API | Python 用户、快速自动化 | 免费 | ✔ 原生 |

| Dexi.io | 云端、可视化工作流、调度、API | 企业、可扩展自动化 | 起价每月 119 美元 | ✔ 浏览器 |

如何为 Linux 选择合适的网页爬虫:关键考虑因素

选工具的核心,就是看它是否符合你的需求和技能:

- 技术水平: 非程序员应该优先考虑 Thunderbit、ParseHub、Octoparse 或 OutWit Hub。开发者则可以借助 Scrapy、Puppeteer、Colly 或 Kimurai 获得更强能力。

- 数据复杂度: 静态页面用 Beautiful Soup 或 Colly 就足够快也足够简单。面对动态、重 JavaScript 的网站,你需要 Selenium、Puppeteer,或者支持 JS 的可视化工具。

- 规模与频率: 一次性任务用无代码工具或云端爬虫就可以。对于定时、规模化爬取,选择 Scrapy、PySpider 或 Apify 更合适。

- 集成需求: 如果你需要导出到 Excel、Sheets 或数据库,要先确认工具能否顺畅接入你的工作流。

- 预算: 对开发者来说,免费和开源方案非常多;对业务用户来说,Thunderbit 和 ParseHub 提供了相对亲民的入门门槛,而企业团队则可能更适合投资 Dexi.io 或 Content Grabber。

- 支持与社区: 开源工具拥有庞大的社区;商业工具则通常提供专门支持。

实用建议: 不要怕把多个工具组合起来用。你可以先用 Thunderbit 做原型验证和识别数据模式,再切换到 Scrapy 做生产级爬取;或者先用 Selenium 登录并获取会话 cookie,再交给 Colly 或 Scrapy 做高速抓取。

结语:找到你 2026 年最适合的 Linux 网页爬虫工具

到了 2026 年,Linux 用户在网页爬虫工具上的选择真的非常多。无论你想要的是一款几分钟就能出结果的无代码 AI 工具(Thunderbit)、一个强大的开发框架(Scrapy、Colly),还是一个企业级平台(Dexi.io),总有一款 Linux 网页爬虫能匹配你的需求和工作流。

核心结论:

- Linux 是现代数据基础设施的基石——大多数顶级爬虫都能原生运行,或者通过浏览器运行。

- AI 和无代码工具正在让业务用户也能轻松做网页抓取。

- 开发者框架在灵活性、速度和规模上依然占据主导。

- 先试再买——大多数工具都提供免费层或试用。

准备开始了吗? 或查看 ,获取更多关于网页抓取、自动化和数据驱动增长的指南。

常见问题

1. 如果我不会写代码,Linux 上最容易上手的网页爬虫是什么?

是非技术用户的首选。它作为 Chrome 扩展运行在 Linux 上,使用 AI 自动完成一切,只需两次点击就能抓取数据。

2. 哪款 Linux 网页爬虫最适合大规模、自定义项目?

是开发者的首选。它速度快、可扩展性强,而且高度可定制——非常适合大规模、周期性爬取。

3. 在 Linux 上可以抓取重 JavaScript 或动态网站吗?

可以!使用 或 控制真实浏览器并提取动态内容。ParseHub 和 Thunderbit 这类可视化工具也支持动态网站。

4. 有没有适合业务使用的免费 Linux 网页爬虫工具?

当然有。Scrapy、Beautiful Soup、Selenium、Colly、PySpider 和 Kimurai 都是免费且开源的。Thunderbit 和 ParseHub 也提供适合小规模任务的免费层。

5. 我该如何在无代码和代码型 Linux 爬虫之间做选择?

如果你想要速度和简单性,就选无代码方案(Thunderbit、ParseHub、Octoparse)。如果你需要灵活性、自动化,或者要和其他系统集成,代码型工具(Scrapy、Puppeteer、Colly)会更适合你。

祝你抓取顺利——愿你基于 Linux 的数据项目跑得比全新安装的 Ubuntu 还顺。想看更多网页抓取技巧,可以访问 ,或者订阅我们的 学习实操教程。

了解更多