每天线上大约会发布 200 万到 300 万篇新闻文章。想把这些数据结构化地收集起来——标题、日期、来源、全文——难度差不多跟不看说明书组装家具一样。

我在 一直负责自动化工具的开发和测试。到了 2026 年,新闻爬取这个领域有点特别:机会很大,但坑也不少。Google 早在 2011 年就关掉了官方 News API,新闻网站的反爬措施也越来越强(Cloudflare、CAPTCHA、JavaScript 渲染墙),而且页面布局三天两头变,周一还能用的爬虫,到周三就可能报废。与此同时,从公关、销售到学术研究者和 AI 工程师,大家对结构化新闻数据的需求却比以往更强。

所以我挑了 15 款新闻爬取工具,从 API、无代码平台到开源库逐个测试。目标很简单:给你一份在价格、维护成本、正文提取质量和真实使用场景匹配度上都经过统一标准比较的指南,这类内容在别的文章里很少见。

2026 年,什么样的新闻爬虫才算出色?

大多数“最佳新闻爬虫”类文章都会直接跳过评测标准,所以我先把自己到底怎么测说清楚。很多文章只是把功能列出来就结束了。但做了这么多年爬取基础设施之后,我发现业务用户真正关心的标准其实很具体,而且经常被忽略。

下面是我用的评估框架:

| 标准 | 我的评估内容 |

|---|---|

| 方式 | API、无代码浏览器工具,还是开源库 |

| 反爬处理 | 代理轮换、CAPTCHA 识别、无头浏览器支持 |

| 正文提取 | 能否去掉广告/侧边栏/导航,只返回文章正文? |

| 元数据输出 | 作者、日期、图片、来源 URL、分类 |

| 导出格式 | CSV、JSON、Google Sheets、Airtable、Notion 等 |

| 分页 / 批量支持 | 能否处理多页结果和批量 URL? |

| 维护成本 | 网站布局变化时会不会坏?AI 自适应还是基于选择器? |

| 每 1,000 条结果的标准化成本 | 按统一口径比较价格(含免费层) |

| 最适合的场景 | 公关监控、线索挖掘、学术研究、LLM 流水线等 |

其中有两个标准需要特别说明。每 1,000 条结果的标准化成本很重要,因为不同厂商的计费方式完全不一样——有的按额度,有的按请求,有的按搜索,有的按行数。要是不先标准化,你就等于拿苹果和潜艇比价格。另一个是 维护成本,这也是我从用户那里听到最多的痛点。论坛里反复出现同样的抱怨:“新闻网站特别爱在每周二把我的爬虫搞坏。”我把每个工具分成三档:

- 🟢 低维护: AI 自适应或全托管 API —— 页面改版不会弄坏你的流程

- 🟡 中维护: 能处理反爬,但你的提取逻辑仍可能失效

- 🔴 高维护: 基于选择器 —— 网站一变,你就得手动修

哪种新闻爬虫适合你?决策矩阵

爬虫推荐文章几乎总把所有读者都当成同一种人,而这正是问题所在。追踪品牌提及的公关经理,和搭建 RAG 流水线的 Python 开发者,需求完全不是一回事。所以在完整榜单之前,先看这个快速框架:

| 使用场景 | 最佳方式 | 推荐工具 |

|---|---|---|

| 每日新闻简报(非技术人员) | 无代码浏览器工具或 RSS | Thunderbit、Octoparse、ParseHub |

| 大规模公关 / 媒体监控 | 带提醒的新闻 API | Newscatcher、Webz.io、Newsdata.io |

| 从新闻中提取销售线索 | 带子页面补充的 AI 爬虫 | Thunderbit(子页面爬取 + 邮箱/电话提取)、Apify |

| 学术研究 / 语料构建 | 开源库 | Newspaper4k |

| LLM 流水线 / RAG 摄取 | 转 Markdown 的 API | Thunderbit API、ScraperAPI |

| 竞品情报 / 价格监控 | 定时爬取 | Thunderbit(定时爬虫)、Bright Data |

你已经知道自己属于哪一类了吗?可以直接跳过去看对应部分。不然下面的完整拆解应该能帮到你。

15 款最佳新闻爬虫一览

下面是总对比表——价格按最低付费档位折算成每 1,000 条结果的成本,维护难度按三档标准评级。

| 工具 | 类型 | 免费层 | 每 1K 结果成本(估算) | 反爬 | 正文提取 | 维护 | 最适合场景 |

|---|---|---|---|---|---|---|---|

| Thunderbit | 无代码 AI(Chrome 扩展 + 云端) | 每月 6 页免费 | ~$3–$15 | 强(浏览器 + 云端模式) | 是(AI + 子页面) | 🟢 低 | 业务团队、线索挖掘、每日监控 |

| SerpApi | API | 每月 250 次搜索 | ~$15 | 强(专注 SERP) | 否(仅摘要) | 🟢 低 | Google News SERP 仪表盘 |

| ScraperAPI | API | 每月 1,000 积分 | ~$1–$5 | 强(代理 + JS 渲染) | 否(原始 HTML) | 🟡 中 | 想要反爬基础设施的开发者 |

| Newsdata.io | 新闻 API | 每天 200 次请求 | ~$5–$15 | 不适用(托管 API) | 部分(高级版) | 🟢 低 | 结构化新闻元数据 |

| Apify | 云平台 | $5 免费额度 | ~$1–$6 | 强 | 取决于 actor | 🟡 中 | 自定义云端工作流 |

| Oxylabs | 企业级 API | 2,000 结果试用 | ~$0.50–$2 | 非常强 | 部分 | 🟢 低 | 企业级 SERP + 网页数据 |

| ScrapingBee | API | 试用额度 | ~$2–$5 | 强(无头 Chrome) | 部分(基础) | 🟡 中 | JS 很重的新闻网站 |

| Scrapingdog | SERP API | 1,000 积分 | ~$0.10–$0.50 | 强 | 否(SERP 数据) | 🟢 低 | 预算型 SERP 监控 |

| Bright Data | 企业平台 | 1,000 次请求试用 | ~$0.30–$0.50 | 非常强 | 是(News Scraper) | 🟢 低 | 大规模企业新闻数据 |

| Octoparse | 无代码桌面端 + 云端 | 免费计划有限 | ~$5–$10(折算) | 强 | 是(借助模板) | 🟡 中 | 可视化无代码爬取 |

| ParseHub | 无代码桌面端 | 5 个项目,每次运行 200 页 | ~$5–$12(折算) | 中等 | 是(借助配置) | 🔴 高 | 初学者、小型项目 |

| Newscatcher | 新闻 API | 无公开免费层 | 定制(企业版) | 不适用(托管 API) | 是(NLP 增强) | 🟢 低 | 公关/媒体监控 |

| Webz.io | 新闻数据平台 | 无自助免费层 | 定制(企业版) | 不适用(托管数据流) | 是(全文 + 元数据) | 🟢 低 | 历史档案、LLM 训练 |

| Newspaper4k | 开源 Python | 免费 | $0(+ 服务器成本) | 无 | 是(专为此设计) | 🔴 高 | 开发者、语料构建 |

| HasData | SERP API | 免费积分 | ~$0.25–$0.60 | 强 | 否(SERP 数据) | 🟢 低 | 预算型新闻 SERP 接口 |

快速结论:Scrapingdog 和 HasData 是按请求计费里最便宜的 API 选项。Thunderbit 和 Newspaper4k 在正文干净度上最强,而且路线完全不同。Bright Data 和 Oxylabs 则属于企业级天花板。担心维护麻烦?那就优先选 🟢 级工具。

1. Thunderbit——最适合业务团队的无代码 AI 新闻爬虫

是我和团队专门为解决“我需要这个网站的数据,但我不想写代码,也不想维护选择器”这个问题做的工具。用在新闻爬取里,流程简单得不能再简单:打开新闻页面,点击 AI Suggest Fields,查看 Thunderbit 提议的字段(标题、日期、来源、URL、摘要——它会读取页面结构并判断有哪些内容),然后点 Scrape。

是我和团队专门为解决“我需要这个网站的数据,但我不想写代码,也不想维护选择器”这个问题做的工具。用在新闻爬取里,流程简单得不能再简单:打开新闻页面,点击 AI Suggest Fields,查看 Thunderbit 提议的字段(标题、日期、来源、URL、摘要——它会读取页面结构并判断有哪些内容),然后点 Scrape。

有几个功能让 Thunderbit 在新闻场景里特别强:

- AI 自适应提取: 不需要写或维护 CSS 选择器。AI 每次都会重新读取当前页面布局,这意味着新闻网站改版时(它们总会改),你的爬虫也不会坏。

- 子页面爬取: 在抓完文章链接列表后,你可以点 Scrape Subpages,逐篇访问文章并提取完整正文、作者、发布日期和图片。这样拿到的是干净的文章内容,而不只是标题。

- 字段 AI 提示词: 你可以按列给 AI 下指令——比如“只提取正文,排除导航和广告”或者“把这篇文章的情绪分类为正面、中性或负面”。这在无代码工具里并不常见,对新闻分析特别有用。

- 浏览器爬取 vs 云端爬取: 浏览器模式使用你自己的会话(适合屏蔽云端 IP 的网站),云端模式则可以一次处理最多 50 页,速度更快。

- 定时爬虫: 用自然语言设置每日或每周爬取任务——非常适合持续新闻监控。

- 随处导出: 支持 Excel、CSV、Google Sheets、Airtable、Notion。

价格与限制

Thunderbit 提供免费层(每月 6 页)和 10 页试用。付费方案按年计费的话,起步大约是 ,包含 500 积分(1 积分 = 1 行)。浏览器模式需要安装 Chrome 扩展。AI 功能会消耗积分,所以如果你要处理成千上万篇文章,就需要付费方案——但对大多数做每日监控或每周研究的业务团队来说,成本并不高。

维护: 🟢 低。AI 每次都会重新读取页面。

最适合: 不懂技术、但想要每日新闻数据的销售、公关和运营团队,不想自己搭建或维护爬虫。

如果你想更深入了解 Thunderbit 如何实现,可以看看我们的指南。

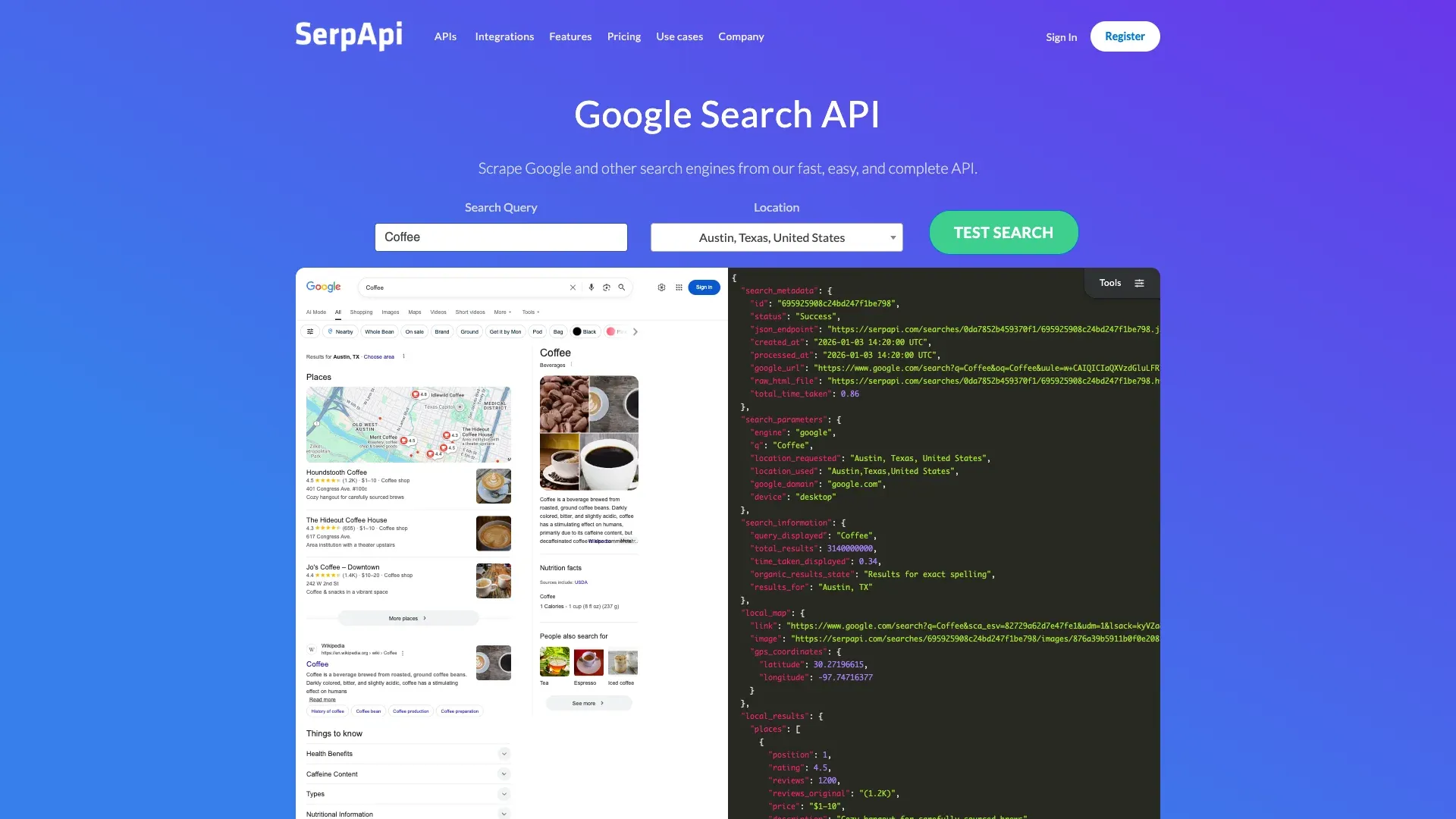

2. SerpApi——最适合结构化 Google News SERP 数据

是一个专门面向 SERP 的 API,可以返回 Google News 结果的结构化 JSON。如果你的需求是“给我某个关键词在 Google News 里的排名结果,要结构化、能直接放进仪表盘”,SerpApi 非常合适。它会返回标题、来源、日期、摘要和缩略图——但不会返回全文。你还需要额外一步(或者另一个工具)才能拿到真正的文章正文。

是一个专门面向 SERP 的 API,可以返回 Google News 结果的结构化 JSON。如果你的需求是“给我某个关键词在 Google News 里的排名结果,要结构化、能直接放进仪表盘”,SerpApi 非常合适。它会返回标题、来源、日期、摘要和缩略图——但不会返回全文。你还需要额外一步(或者另一个工具)才能拿到真正的文章正文。

核心功能:

- 从 Google News SERP 返回结构化 JSON

- 反检测由他们端负责(专注 SERP)

- 支持多个 Google News 地区和语言

价格: 每月 250 次搜索的免费层。付费计划从每月 75 美元起,包含 5,000 次搜索——折算下来大约每 1,000 条结果 15 美元。

限制: 只返回摘要。如果你需要全文,SerpApi 只是第一步,不是完整流水线。

维护: 🟢 低(托管 API,他们负责处理 Google 的变化)。

最适合: 构建新闻监控仪表盘,或把 SERP 数据喂给分析工具的开发者。

3. ScraperAPI——带代理轮换的高性价比爬取 API

是一个通用爬取 API,不是专门做新闻的,但抓新闻页面很好用。它的核心价值在于代理轮换、JavaScript 渲染和 CAPTCHA 处理——这些反爬基础设施,不然你都得自己搭。

是一个通用爬取 API,不是专门做新闻的,但抓新闻页面很好用。它的核心价值在于代理轮换、JavaScript 渲染和 CAPTCHA 处理——这些反爬基础设施,不然你都得自己搭。

核心功能:

- 使用住宅 IP 和数据中心 IP 的代理轮换

- 动态新闻网站的 JavaScript 渲染

- CAPTCHA 处理

- 返回原始 HTML——文章内容需要你自己解析

价格: 每月 1,000 积分的免费层(另有试用额度)。JS 渲染每次请求会消耗更多积分。付费计划从每月 49 美元起。标准化后,按是否使用 JS,成本大约在每 1,000 次请求 1–5 美元。

限制: 没有内置文章解析。你拿到的是 HTML,不是干净文本。做文章提取时,需要搭配 Newspaper4k 或自己的解析器。

维护: 🟡 中(反爬由它处理,但提取逻辑得你自己维护)。

最适合: 想要反爬基础设施、但不想自己搭代理网络的开发者。

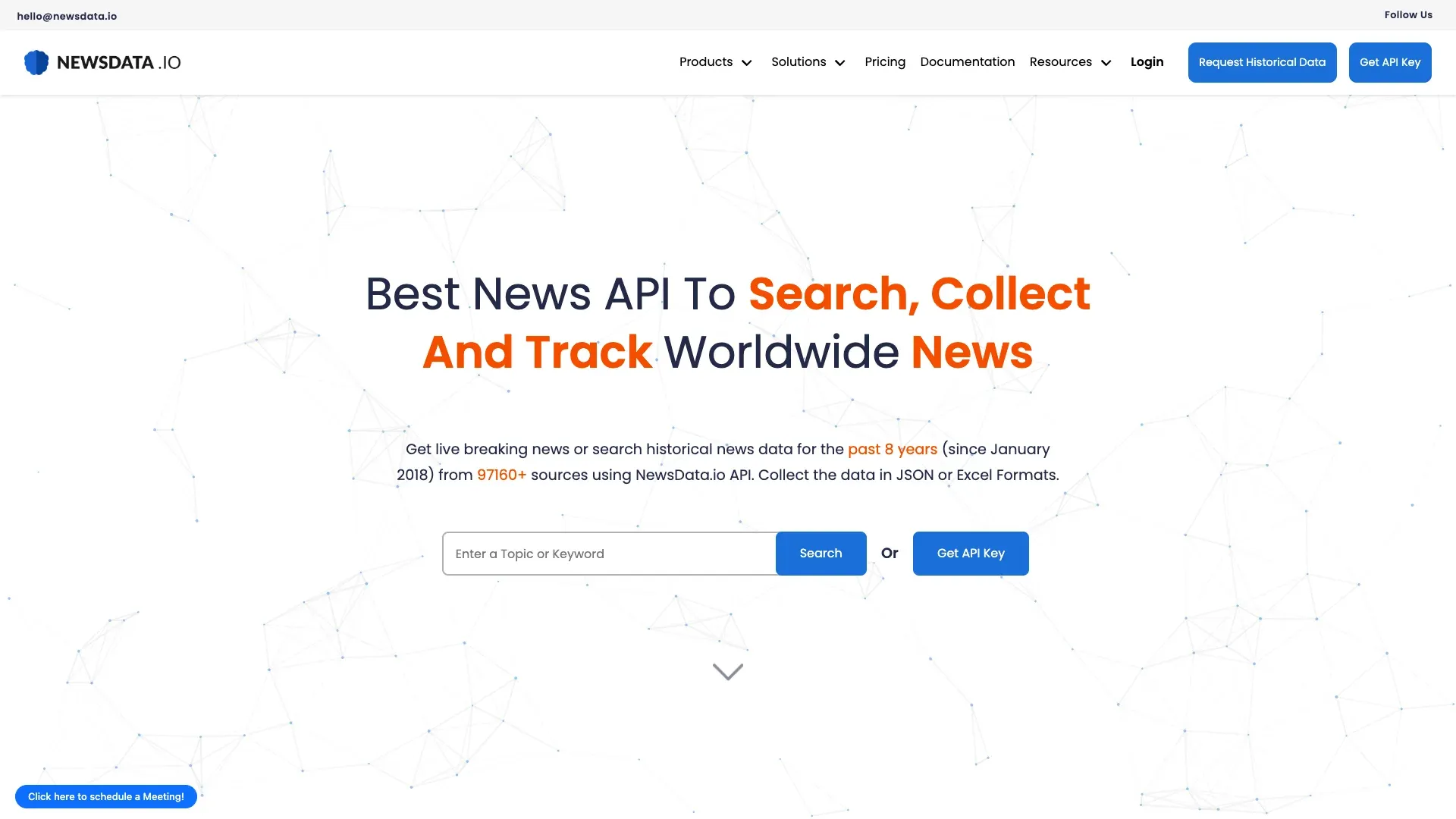

4. Newsdata.io——最适合结构化元数据的专用新闻 API

是一个专为新闻打造的 API,覆盖 。它返回结构化数据——标题、描述、来源、日期、分类、情绪——高级套餐还支持完整文章内容。

是一个专为新闻打造的 API,覆盖 。它返回结构化数据——标题、描述、来源、日期、分类、情绪——高级套餐还支持完整文章内容。

核心功能:

- 可按关键词、分类、语言、国家 / 地区查询

- 内置情绪分析

- 历史新闻档案(付费方案)

- 不需要自己维护爬取基础设施

价格: 免费层每天 200 次请求,字段有限。付费方案可解锁完整内容和历史数据。每 1,000 条结果的成本取决于套餐,通常在 5–15 美元区间。

限制: 只覆盖它自己索引到的来源——你不能随便给一个 URL 就让它“帮我爬这个”。如果某个小众媒体不在索引里,你就找不到它。

维护: 🟢 低(全托管新闻 API)。

最适合: 需要结构化新闻元数据、又不想管理任何爬取基础设施的团队。

5. Apify——最适合自定义新闻爬取流程的云平台

是一个基于 actor 的云平台,提供 Google News、特定媒体和通用文章提取的预制爬虫。它在无代码和完全自定义开发之间,位置卡得很舒服。

是一个基于 actor 的云平台,提供 Google News、特定媒体和通用文章提取的预制爬虫。它在无代码和完全自定义开发之间,位置卡得很舒服。

核心功能:

- 面向 Google News、文章提取等的预制 actor

- 支持 JavaScript 渲染和无头浏览器执行

- 云端执行与定时任务

- 导出为 JSON、CSV、Excel、XML 等格式

价格: 免费方案赠送 。付费档位为每月 49、499 和 999 美元。每 1,000 条结果成本取决于 actor——新闻爬取 actor 大约在 1–6 美元。

限制: 预制 actor 由社区维护,新闻网站改版时可能会坏。相比纯无代码工具,它需要更多配置。

维护: 🟡 中(网站变化时,actor 可能需要更新)。

最适合: 想要云端执行、并且愿意挑选和配置市场 actor 的团队。

6. Oxylabs——最适合企业级爬取基础设施

是一家企业级爬取服务商,拥有 1 亿+ 代理池、CAPTCHA 处理和浏览器渲染。他们的 SERP Scraper API 可带地理定位抓取 Google News 结果,Web Scraper API 则适用于任意新闻页面。

是一家企业级爬取服务商,拥有 1 亿+ 代理池、CAPTCHA 处理和浏览器渲染。他们的 SERP Scraper API 可带地理定位抓取 Google News 结果,Web Scraper API 则适用于任意新闻页面。

核心功能:

- 大规模代理基础设施,支持地理定位

- 用于 Google News 的 SERP Scraper API

- 适用于任意 URL 的 Web Scraper API

- JSON/CSV 输出,大规模并发请求

价格: SERP 数据从每月 49 美元起。高流量企业可定制报价。最多可试用 2,000 条结果。

限制: 对小团队来说太贵了。主要面向大规模业务。

维护: 🟢 低(全托管企业级 API)。

最适合: 需要大流量、支持地理定位、并且重视企业级稳定性的公司。

7. ScrapingBee——最适合 JavaScript 很重的新闻网站

是一个专注 JavaScript 渲染、并支持真实浏览器执行的爬取 API。如果你要抓的新闻网站内容是靠客户端 JS 加载的(现代网站很多都是这样),ScrapingBee 表现不错。

是一个专注 JavaScript 渲染、并支持真实浏览器执行的爬取 API。如果你要抓的新闻网站内容是靠客户端 JS 加载的(现代网站很多都是这样),ScrapingBee 表现不错。

核心功能:

- 带代理轮换的无头 Chrome

- CAPTCHA 处理

- 某些页面支持基础的“文章提取”功能

- 返回原始 HTML、JSON 或类似 Markdown 的输出

价格: 方案从 起。按额度计费,JS 渲染更贵。提供试用额度。

限制: 和 AI 驱动方案相比,文章提取功能比较基础。主要还是返回 HTML——大多数工作流仍然需要你自己解析。

维护: 🟡 中(反爬由它处理,但提取需要你配置)。

最适合: 抓取 JS 很重的新闻网站、又不想自己维护无头浏览器的开发者。

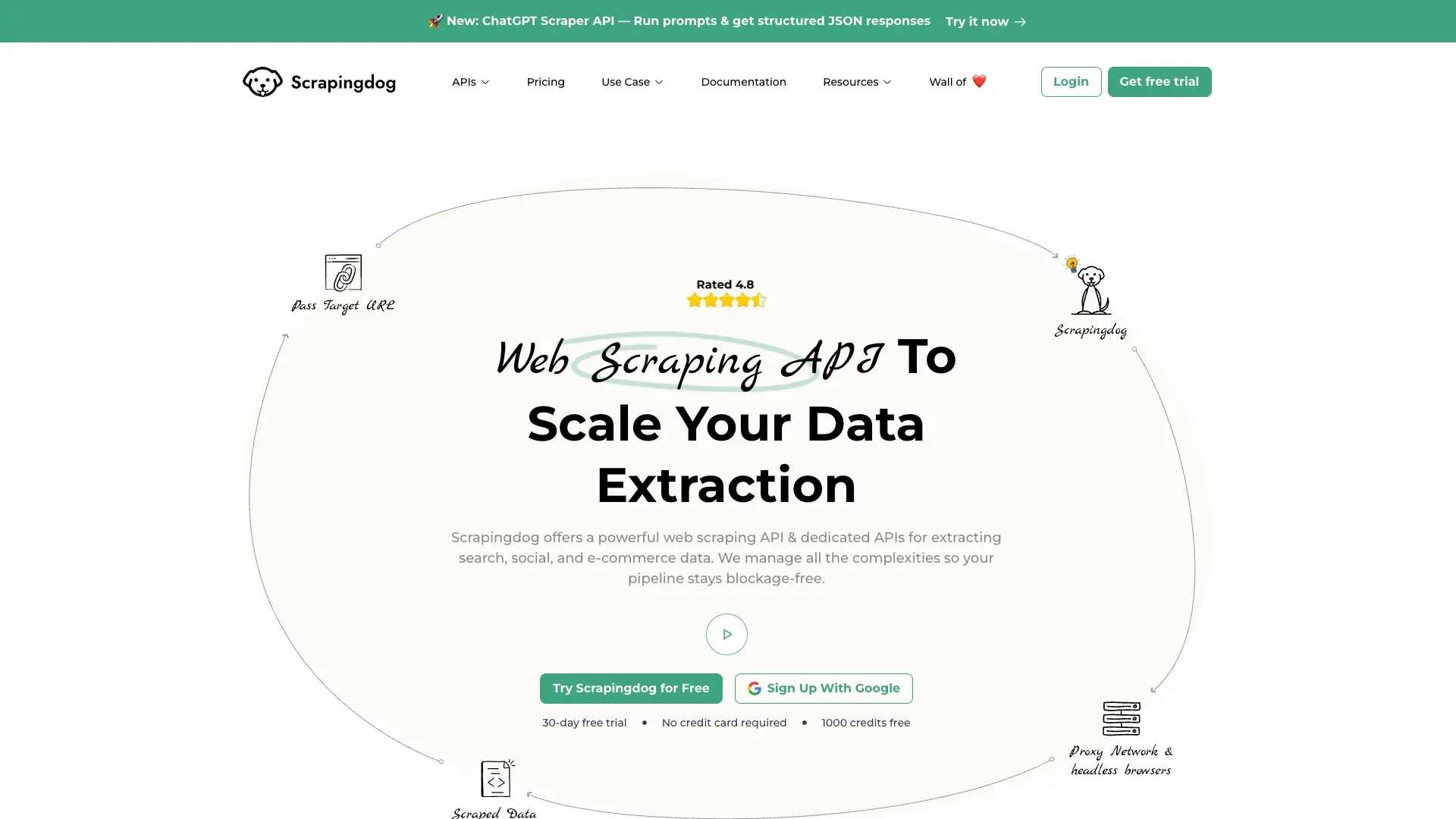

8. Scrapingdog——最适合新闻的平价 SERP API

是一个预算型 SERP API,带专门的 Google News 接口。实测响应很快(每次请求大约 2 秒),而且在这份榜单里,它的 API 价格最有竞争力。

是一个预算型 SERP API,带专门的 Google News 接口。实测响应很快(每次请求大约 2 秒),而且在这份榜单里,它的 API 价格最有竞争力。

核心功能:

- 专用 Google News 接口

- 结构化 JSON 输出(标题、来源、日期、摘要)

- 响应速度快

价格: 每月 40 美元可获得 40 万次请求——折算大约每 1,000 条结果 0.10 美元,便宜得惊人。免费层有 1,000 积分。

限制: 只返回 SERP 数据(标题、摘要),不返回全文。和 SerpApi 是同样的取舍,但价格便宜很多。

维护: 🟢 低(托管 SERP API)。

最适合: 预算有限、但需要大规模 Google News SERP 数据的开发者。

9. Bright Data——最适合大规模企业新闻数据

是企业级重量选手。他们的平台包括专门的 News Scraper 产品、超大规模代理基础设施、CAPTCHA 处理、浏览器渲染,以及向 S3、Snowflake 等下游系统投递数据的能力。

是企业级重量选手。他们的平台包括专门的 News Scraper 产品、超大规模代理基础设施、CAPTCHA 处理、浏览器渲染,以及向 S3、Snowflake 等下游系统投递数据的能力。

核心功能:

- 专门的 News Scraper 产品

- 预制数据集和实时采集

- 自动代理管理和 CAPTCHA 处理

- 定时采集与告警

- 导出到 JSON、CSV、NDJSON、S3、Snowflake、GCS、Azure、SFTP

价格: 按量付费大约从 起。也提供企业定制方案。支持 1,000 次请求试用。

限制: 价格结构复杂,还有最低承诺量。主要是给企业预算设计的。

维护: 🟢 低(企业托管,可靠性高)。

最适合: 需要大规模、可靠新闻数据管道的大型组织。

10. Octoparse——最适合新闻页面的可视化无代码爬虫

Octoparse 是一款桌面应用,提供可视化点选式工作流构建器。它为常见新闻网站准备了模板,支持分页和无限滚动,还提供定时运行的云端执行。

Octoparse 是一款桌面应用,提供可视化点选式工作流构建器。它为常见新闻网站准备了模板,支持分页和无限滚动,还提供定时运行的云端执行。

核心功能:

- 可视化点选式工作流构建器

- 预制新闻网站模板

- 带定时任务的云端执行

- IP 轮换和自动 CAPTCHA 处理

- 导出到 Excel、CSV、JSON、数据库、Google Sheets

价格: 免费计划包含 10 个任务和每月 5 万次导出。付费方案从每月约 89 美元起。

限制: 基于选择器的提取意味着,新闻网站一改版,爬虫就可能坏。需要手动修复——而新闻网站改版很频繁。

维护: 🟡 中(模板有帮助,但选择器仍可能失效)。

最适合: 想要可视化无代码构建器、并且不介意偶尔维护模板的用户。

11. ParseHub——最适合初学者的免费无代码方案

ParseHub 是一款可视化点选式爬虫,免费计划相当慷慨。它能处理 JavaScript 渲染内容,适合一次性研究项目或小规模新闻提取。

ParseHub 是一款可视化点选式爬虫,免费计划相当慷慨。它能处理 JavaScript 渲染内容,适合一次性研究项目或小规模新闻提取。

核心功能:

- 可视化元素选择(无需编码)

- 支持 JavaScript 渲染页面

- 导出为 CSV/JSON

- 免费层:5 个项目,每次运行 200 页

价格: 免费计划包含 5 个项目和每次运行 200 页。付费方案从每月 189 美元起。

限制: 基于 CSS 选择器,所以布局一变,爬虫经常会坏。可扩展性有限,而且比 API 工具更慢。Reddit 和论坛用户普遍提到它学习曲线较陡,也比较脆弱。

维护: 🔴 高(选择器经常失效,没有 AI 自适应)。

最适合: 做小型、一次性新闻研究项目的初学者,想要一个免费的起点。

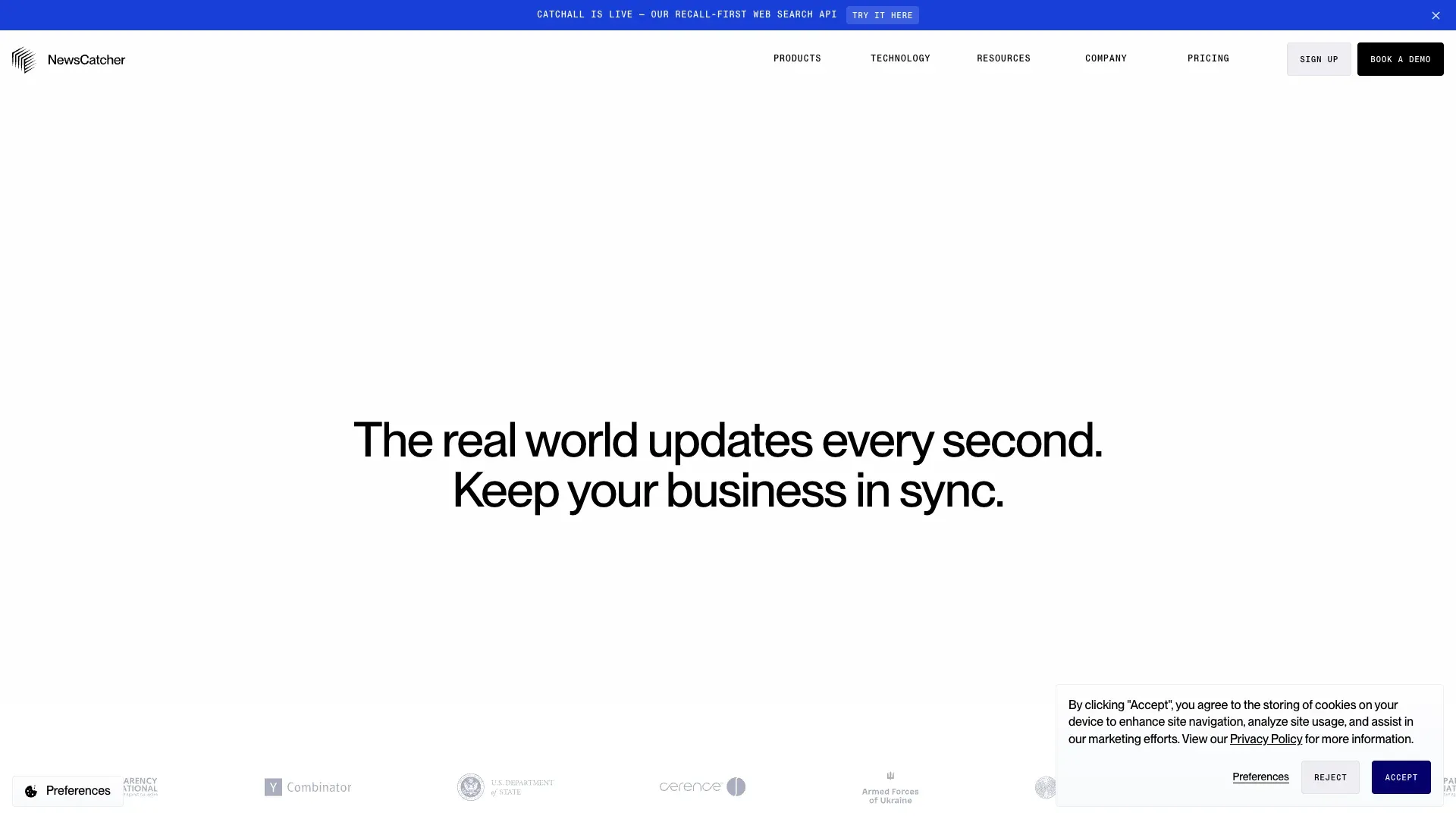

12. Newscatcher——最适合公关和媒体监控的新闻 API

是一个专门做新闻聚合的 API,覆盖 。它专为媒体监控、公关追踪和趋势分析而设计,带有情绪、摘要、实体提取等 NLP 增强字段。

是一个专门做新闻聚合的 API,覆盖 。它专为媒体监控、公关追踪和趋势分析而设计,带有情绪、摘要、实体提取等 NLP 增强字段。

核心功能:

- 覆盖 70,000+ 来源

- NLP 增强:情绪、摘要、实体提取、去重、聚类

- 可按关键词、主题、来源、语言、国家 / 地区查询

- 支持历史档案访问

价格: 企业定价(定制报价)。没有公开免费层可直接试用,不过可按需申请试用。

限制: 面向企业的定价,小团队可能负担不起。没有自助式免费层。

维护: 🟢 低(全托管 API)。

最适合: 中大型公司的公关和媒体监控团队。

13. Webz.io——最适合历史新闻档案和 LLM 训练数据

是一个新闻数据平台,拥有海量历史档案——数十亿篇文章,可追溯多年。它同时提供实时数据流和历史数据访问,并以结构化 JSON 输出,包含全文、元数据和各种增强信息。

是一个新闻数据平台,拥有海量历史档案——数十亿篇文章,可追溯多年。它同时提供实时数据流和历史数据访问,并以结构化 JSON 输出,包含全文、元数据和各种增强信息。

核心功能:

- 历史档案中有数十亿篇文章

- 实时数据流和历史数据访问

- 提供带结构化元数据的全文

- 受到 AI/ML 团队欢迎,常用于训练数据集和 RAG 流水线

价格: 企业/定制定价(按数据量计费)。新闻没有自助免费层。

限制: 不适合普通用户,只有企业定价。

维护: 🟢 低(全托管数据流)。

最适合: 构建训练数据集的 AI/ML 团队,以及需要深度历史新闻档案的企业团队。

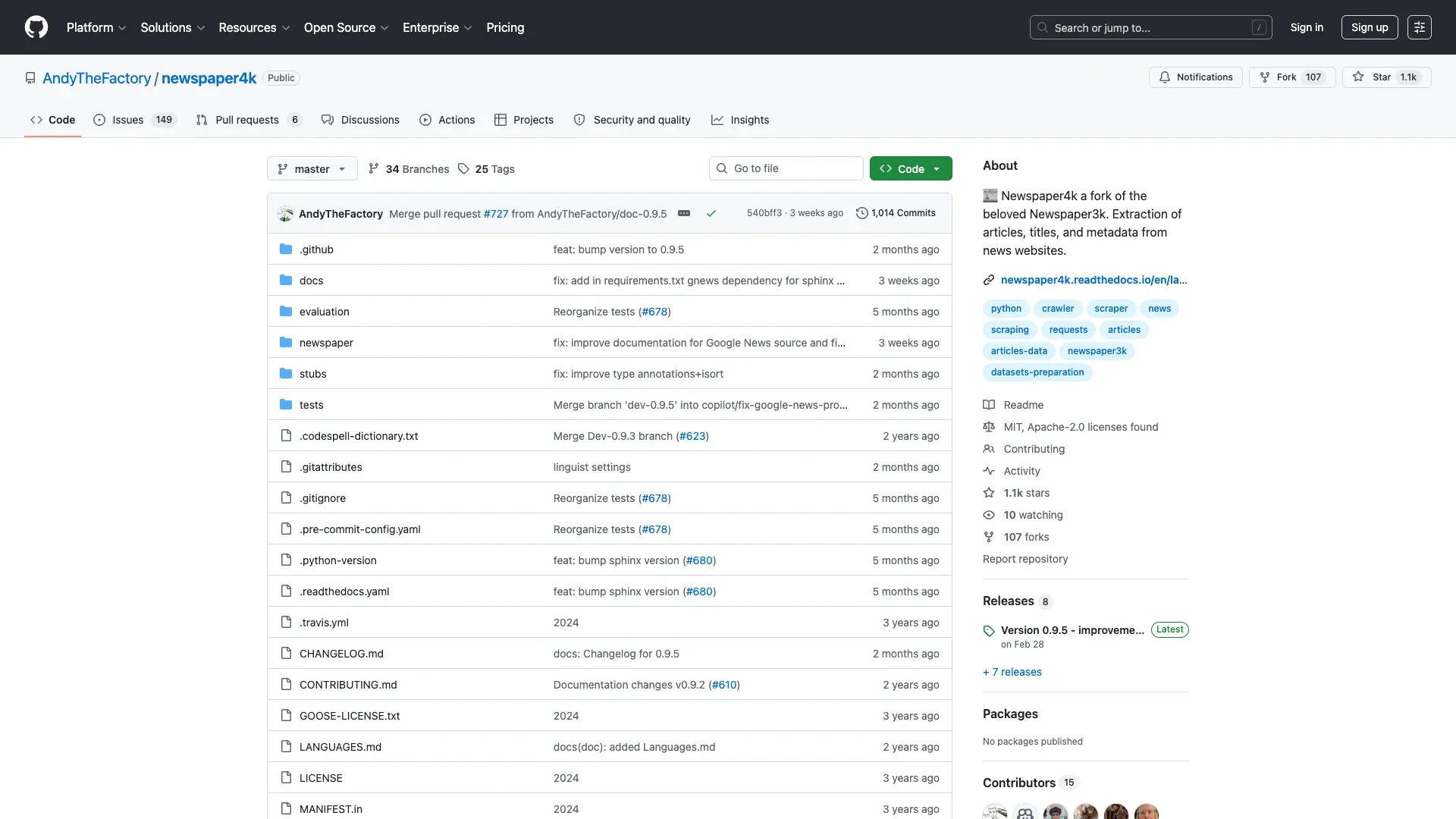

14. Newspaper4k——最适合文章提取的开源库

是一个 Python 库(Newspaper3k 的继任者),专门用来提取干净的文章内容。它会去掉广告、侧边栏和导航,只保留文章本体:标题、正文、作者、发布日期、图片、关键词和摘要。

是一个 Python 库(Newspaper3k 的继任者),专门用来提取干净的文章内容。它会去掉广告、侧边栏和导航,只保留文章本体:标题、正文、作者、发布日期、图片、关键词和摘要。

核心功能:

- 提取干净的文章正文,去除噪音

- 返回标题、作者、发布日期、图片、关键词、摘要

- 完全免费、开源

- 适合静态 HTML 页面的轻量快速处理

价格: 免费。但你需要自己的服务器、代理基础设施和开发时间。

限制: 没有内置反爬处理。在动态很强 / JS 渲染很重的新闻网站上容易失效。需要 Python 知识,以及除基础提取外的自定义流水线。网站 HTML 结构一变,你就得自己修。

维护: 🔴 高(网站 HTML 变化时容易坏,需要手动修复)。

最适合: 想在文章解析上拥有最大控制权的 Python 开发者,自建新闻提取流水线。

15. HasData——带新闻接口的平价 SERP API

是一个带专用 Google News 接口的 SERP API。它以有竞争力的价格返回结构化 JSON 新闻结果。

是一个带专用 Google News 接口的 SERP API。它以有竞争力的价格返回结构化 JSON 新闻结果。

核心功能:

- 专用 Google News 接口

- 结构化 JSON 输出

- 每次请求响应时间约 3–4 秒

- 提供测试用免费积分

价格: 从 起(1 次新闻请求消耗 5 积分 = 4 万次请求)。折算下来大约每 1,000 条结果 0.25–0.60 美元。

限制: 只返回 SERP 数据(标题、摘要),不返回全文。

维护: 🟢 低(托管 SERP API)。

最适合: 需要 Google News SERP 数据、又不想支付 SerpApi 那么高价格的预算型团队。

值得注意的模式

把这 15 款工具完整测完之后,有几个模式特别明显。

SERP API(SerpApi、Scrapingdog、HasData)非常适合结构化标题数据,但一旦你需要全文,它们就会卡住。专用新闻 API(Newsdata.io、Newscatcher、Webz.io)把元数据问题解决得很好,但不能抓任意 URL。无代码工具(Thunderbit、Octoparse、ParseHub)让你可以灵活抓任意页面——但维护情况差异很大。而 Newspaper4k 能提供最干净的文章提取,只要你愿意自己搭和维护流水线。

API vs 无代码 vs 开源:每 1,000 篇文章的真实成本

很少有人把这三大类放在一起做统一标准比较。下面直接算账:

| 方式 | 搭建时间 | 每 1K 篇文章成本 | 维护 | 最适合 |

|---|---|---|---|---|

| 开源(Newspaper4k) | 几小时到几天 | $0(但要算服务器 + 开发时间) | 🔴 高 | 有自定义需求的开发者 |

| 新闻 API(Newsdata.io、Newscatcher、Webz.io) | 几分钟 | $5–$50+ | 🟢 低 | 结构化数据、历史档案 |

| 爬取 API(ScraperAPI、ScrapingBee、Oxylabs) | 30 分钟 | $1–$5 | 🟡 中 | 想要反爬处理的开发者 |

| 无代码 AI(Thunderbit、Octoparse、ParseHub) | 2 分钟 | $3–$15 | 🟢–🟡 | 业务用户、非技术团队 |

“免费”开源工具的隐性成本其实是开发者时间。一名高级开发者每月花 4 小时修一个坏掉的 Newspaper4k 流水线?那一点都不免费,反而很贵。

另一方面,Webz.io 和 Newscatcher 这类企业 API 维护成本低,但只有规模足够大时,价格才算得过来。

对我接触的大多数业务团队来说,最合适的选择要么是像 Thunderbit 这样的无代码 AI 工具,用来做灵活的临时爬取;要么是专用新闻 API,用于结构化、持续性的监控。

维护问题:为什么大多数新闻爬虫都会坏,以及哪些不会

这一部分值得单独拿出来说。

这几乎是我在论坛、支持工单和用户交流里看到的头号抱怨。新闻网站会频繁改版——有时甚至每周都改。基于 CSS 选择器或 XPath 搭建的爬虫,今天还能完美运行,明天就可能抓回一堆垃圾。

下面看看这 15 款工具在维护层面的表现:

| 维护级别 | 工具 | 网站变化时会发生什么 |

|---|---|---|

| 🟢 低(AI 自适应或托管 API) | Thunderbit、SerpApi、Newsdata.io、Newscatcher、Webz.io、Scrapingdog、HasData、Oxylabs、Bright Data | AI 会重新读取页面,或者由 API 提供商处理。你几乎不用动。 |

| 🟡 中(模板 + 代理) | ScraperAPI、ScrapingBee、Apify、Octoparse | 反爬由它们处理,但你的提取逻辑或 actor / 模板 可能需要更新。 |

| 🔴 高(基于选择器) | ParseHub、Newspaper4k | 网站一变,你的爬虫就坏。你得手动修选择器或解析规则。 |

Thunderbit 的方式特别值得强调:因为 AI 每次运行时都会重新读取当前页面结构,所以没有硬编码选择器需要维护。我亲眼见过用户连续几个月抓同一批新闻源,哪怕网站做了版面调整,也完全不用改配置。这就是你做每日新闻简报或每周竞品报告时最需要的稳定性。

干净正文:哪些新闻爬虫真的能去噪?

“我拿到数据了,但全是广告、导航菜单和侧边栏垃圾。”这大概占我看到的新闻爬取支持问题里的五分之三。

下面是实话实说的拆分:

| 干净正文能力 | 工具 |

|---|---|

| 开箱即用就能返回干净正文 | Newspaper4k、Thunderbit(配合子页面爬取 + 字段 AI 提示词)、Newsdata.io(高级版)、Webz.io、Bright Data(News Scraper)、Newscatcher |

| 只返回标题 / 摘要(没有全文) | SerpApi、Scrapingdog、HasData、Oxylabs(SERP 模式) |

| 返回原始 HTML(需自行解析) | ScraperAPI、ScrapingBee |

| 取决于配置 | Apify、Octoparse、ParseHub |

Newspaper4k 是去噪的标准答案,尤其适合常规新闻页面——它就是为这个工作而生的。但它需要 Python,而且在 JS 很重的网站上会失效。

Thunderbit 的字段 AI 提示词则相当于无代码版本:你可以按列告诉 AI“只提取正文,排除导航和广告”,它在提取时还可以顺手帮你做标注、分类或摘要。对于想要干净正文、但又不想写代码的团队来说,这是我找到的最实用方案。

如果你对 AI 驱动提取和传统方法的差别感兴趣,我们关于的文章讲得更深入。

负责任地爬取新闻:法律和伦理基础

我看过的竞争文章里,没有一篇认真聊这个问题——这确实是个值得补上的空白,尤其是对企业读者来说。

robots.txt: 一定要检查。很多大型新闻网站会明确禁止抓取某些路径。负责任的工具(包括 Thunderbit)支持基于浏览器的爬取,能尊重会话上下文,但在大规模执行前,你还是应该先看一下网站的 robots.txt。

服务条款: 为内部研究提取元数据(标题、日期、URL)和重新发布完整受版权保护文章之间,有本质区别。前者通常风险较低;后者可能会带来真正的法律风险。像 和 这样的最新案例说明,法律环境还在变化中。

最佳实践: 有官方 API 就优先用官方 API(Google News RSS、Newsdata.io、Newscatcher)。合理缓存。限制请求频率。绝不要绕过付费墙。本榜单里的不少工具——包括 Thunderbit、ScraperAPI 和 Bright Data——都提供了内置限速或更注重伦理的爬取功能,帮助你守住边界。

本文仅供信息参考,不构成法律建议。如果你要做企业级规模爬取,请咨询法务团队。

Thunderbit 如何融入你的新闻爬取流程

因为 Thunderbit 就是我团队做的,所以我比任何人都清楚它在新闻爬取中的优势和局限。下面说说真实流程是什么样。

业务用户的典型流程如下:

- 在 Chrome 中打开一个新闻页面(Google News 结果、某个媒体首页、主题搜索页)。

- 点击 Thunderbit 扩展,然后点 AI Suggest Fields。Thunderbit 会读取页面并建议字段——标题、日期、来源、URL、摘要、图片等。

- 按需调整列。 想做情绪分类?加一列字段 AI 提示词,比如“把情绪分类为正面、中性或负面”。只想抓某个分类的文章?加一个筛选提示词。

- 点击 Scrape。 选择浏览器模式(使用你的会话,适合屏蔽云端 IP 的网站)或云端模式(更快,一次最多处理 50 页)。

- Scrape Subpages,逐个访问文章 URL,提取完整正文、作者、发布日期和图片。

- 导出 到 Excel、CSV、、Airtable 或 Notion。

对于持续监控,定时爬虫可以让你用自然语言设定每日或每周运行(例如“每个工作日早上 8 点”)。而且 Thunderbit 支持 ,做国际新闻监控也很顺手。

Thunderbit 不太适合的情况是:以最低单价大规模抓取每月数百万篇文章——在那种场景下,Bright Data 或 Webz.io 这类企业 API 更划算。还有,如果你需要把深度 NLP 增强(实体提取、聚类、去重)直接内置在 API 响应里,Newscatcher 就是为这个设计的。

你可以通过 免费试用 Thunderbit——不用信用卡。

如何选择合适的新闻爬虫

这是我根据测试全部 15 款工具整理出的速查表:

- 非技术型业务用户,想要每日新闻数据? 从 Thunderbit 开始。两次点击、无需代码、AI 自动处理布局变化。

- 开发者在搭建监控流水线? 想要 SERP 数据就用 SerpApi 或 Scrapingdog。想要带反爬处理的原始 HTML,就用 ScraperAPI 或 ScrapingBee。

- 企业团队,需要规模和可靠性? Bright Data 或 Oxylabs。

- 公关团队,要追踪成千上万来源的品牌提及? Newscatcher 或 Newsdata.io。

- 研究者,要构建文本语料库? Newspaper4k(如果你会 Python)或者 Thunderbit 的子页面爬取(如果不会)。

- AI 工程师,要喂给 RAG 流水线? Thunderbit API 或 Webz.io,拿干净、结构化的文章文本。

- 预算紧张? API 选 Scrapingdog,无代码选 Thunderbit 免费层,开源选 Newspaper4k。

合适的工具取决于你的维护容忍度、预算和技术能力。不确定?先从免费层试起——这些工具大多都有——看看哪个流程最贴合你的实际情况。

更多选择和对比,可以看我们整理的合集,了解更广泛的市场。如果你想在决定工具之前先弄明白,那篇指南也是个不错的起点。

结论

2026 年的新闻爬取已经不算难题了——关键是为你的场景选对工具,数据自然就会流动起来。一刀切的推荐时代已经过去。SERP API 很适合标题,但不会给你正文。专用新闻 API 在结构化元数据方面很强,但不能抓任意 URL。像 Thunderbit 这样的无代码 AI 工具兼顾灵活性和低维护,而开源库则能给你控制权,只是要拿周末来换。

我的真诚建议是:先确定你需要的是标题、全文,还是增强后的元数据——再把它和你能承受的维护级别及预算对应起来。如果你想看看现代、AI 自适应的新闻爬取是什么样子,而且不想写一行代码,。我想你会惊讶于自己几次点击就能完成多少事情。

祝你爬取顺利——愿你的正文永远干净,选择器永不失效,导出文件总能落到正确的表格里。

常见问题

1. 对非技术用户来说,最好的新闻爬虫是什么?

Thunderbit 是非技术用户最强的选择。它的 AI 驱动、两步点击流程不需要编码或 CSS 选择器。AI 会自动读取页面结构、建议提取字段,并在布局变化时自适应——所以你几乎不用维护任何东西。它还可以直接导出到 Google Sheets、Airtable 和 Notion。

2. 新闻爬虫能拿到全文吗,还是只能拿到标题?

这要看工具。像 SerpApi、Scrapingdog 和 HasData 这类 SERP API 只返回标题和摘要。Newsdata.io、Webz.io 这类专用新闻 API 在高级套餐中可返回全文。Thunderbit 这样的无代码工具可以通过子页面爬取提取全文,而 Newspaper4k 则是专门为 Python 中的干净文章提取而设计的。决定前一定要确认工具返回的是原始 HTML、摘要,还是干净正文。

3. 网站改版后,新闻爬虫会坏吗?

基于选择器的工具(ParseHub、Octoparse、Newspaper4k、自定义 Scrapy 流水线)在新闻网站改版时经常失效——而新闻网站确实经常改。像 Thunderbit 这样的 AI 自适应工具每次都会重新读取页面结构,所以布局变化不会弄坏流程。托管 API(SerpApi、Newsdata.io、Newscatcher)则由它们自己处理变化。如果你担心维护成本,优先看对比表里标为 🟢 低 的工具。

4. 大规模爬取新闻,最便宜的方式是什么?

如果是基于 API 的爬取,Scrapingdog 的单次成本最低(起步约每 1,000 条结果 0.10 美元)。如果是无代码爬取,Thunderbit 的免费层适合小项目,付费计划从每月约 9 美元起。开源方案里 Newspaper4k 是免费的——但要把开发者时间和服务器成本算进去,这些开销会涨得很快。

5. 抓取新闻网站合法吗?

出于内部研究目的,抓取公开可访问的数据通常风险较低,但重新发布完整受版权保护文章可能带来法律风险。开始抓取前,一定要查看网站的 robots.txt 和服务条款。能用官方 API 就用官方 API,尊重速率限制,绝不要绕过付费墙。像 hiQ v. LinkedIn 和 Meta v. Bright Data 这样的近期案例说明,法律环境仍在变化中。企业级规模抓取请咨询法务团队。

了解更多