如今,几乎一半的互联网流量都来自机器人。其中大多数都在大规模抓取链接、数据和 URL。如果你还在手动操作,那你已经落后了。

我测试了 12 款链接提取工具——从 AI 驱动的 Chrome 扩展到 Python 库——想看看当你需要快速抓取成千上万个 URL 时,哪些工具真的能交付结果。

下面是我的发现。

为什么链接提取器很重要

说实话:网上的数据已经多到爆炸,而企业都在争分夺秒地把这些杂乱信息变成可执行的洞察。 和 现在已经是这些团队的关键工具,它们可以帮助你:

- 生成潜在客户:销售团队可以在几分钟内从目录或领英中提取公司主页链接,然后把这些 URL 输入到工具中去抓取联系方式。再也不用无止境地点击了。

- 聚合内容并提升 SEO:营销人员可以收集博客中的所有文章 URL,监控竞争对手的反向链接,或审计网站结构中的失效链接。

- 监控竞争对手并做市场研究:运营团队可以自动收集新产品、定价页面或新闻稿的链接——轻松掌握竞争动态。

- 自动化工作流并节省时间:现代链接爬虫可以处理批量 URL、抓取子页面,并将数据导出为结构化格式(CSV、Excel、Google Sheets、Notion,等等)。这意味着你不必再反复复制粘贴,也不用费力清理乱糟糟的文本文件。

考虑到,手动处理根本行不通。合适的链接提取器就像一个永远不会累、不会漏链、也不会要求喝咖啡休息的超级助手。

我们如何挑选最佳链接提取器

市面上的工具太多了,挑选合适的链接提取器就像在科技大会上快速约会——每个人都说自己是“那个对的人”,但真正能交付的没几个。以下是我筛选出前 12 名的标准:

- 易用性:不会写代码的人能不能在不懂复杂正则的情况下上手?无代码和低代码方案会加分。

- 批量与多层级抓取:能不能一次处理成百上千个 URL?会不会自动抓取子页面并跟随链接?

- 导出与集成:能不能导出到 CSV、Excel、Google Sheets、Notion、Airtable,或者通过 API?人工操作越少越好。

- 用户类型与灵活性:它是给商业用户、分析师还是开发者用的?有些工具面向所有人,有些则更垂直。

- 高级功能:AI 识别、定时任务、云端扩展、数据清洗,以及常见网站模板。

- 价格与扩展性:免费额度、按量付费,还是企业版?我会看你花的钱能得到什么。

我把浏览器扩展到企业平台都算进来了,所以无论你是独立创业者,还是财富 500 强的数据团队,都能找到合适方案。

Thunderbit:最适合商业用户的智能链接提取器

先从最强的开始。 是我做链接提取时的首选推荐,不只是因为我参与了它的开发。Thunderbit 是一款 ,专为想要快速拿到结果的商业用户设计。

Thunderbit 为什么突出?它就像一个真的会听你指挥的 AI 实习生。你只要用自然语言描述你想要什么(比如“抓取这个页面上所有的产品链接和价格”),Thunderbit 的 AI 就会把剩下的事搞定。你不需要折腾选择器,也不用写脚本。

但它不止于此:

- 支持批量 URL:你可以粘贴一个 URL,也可以一次导入几百个,Thunderbit 都能一口气处理。

- 支持子页面导航:如果你需要先从列表页抓取链接,再逐个进入详情页抓取更多 URL,Thunderbit 的多层级抓取逻辑都能覆盖。

- 结构化导出:链接提取完成后,你可以重命名字段、分类整理,并直接导出到 Google Sheets、Notion、Airtable、Excel 或 CSV。不用再为后处理头疼。

Thunderbit 受到全球 3 万多名用户信任,从销售团队、房产经纪人到独立电商卖家都有在用。没错,它还有 (可抓取最多 6 个页面,或者在试用加成下抓取 10 个),所以你可以放心试用。

Thunderbit 的亮点功能

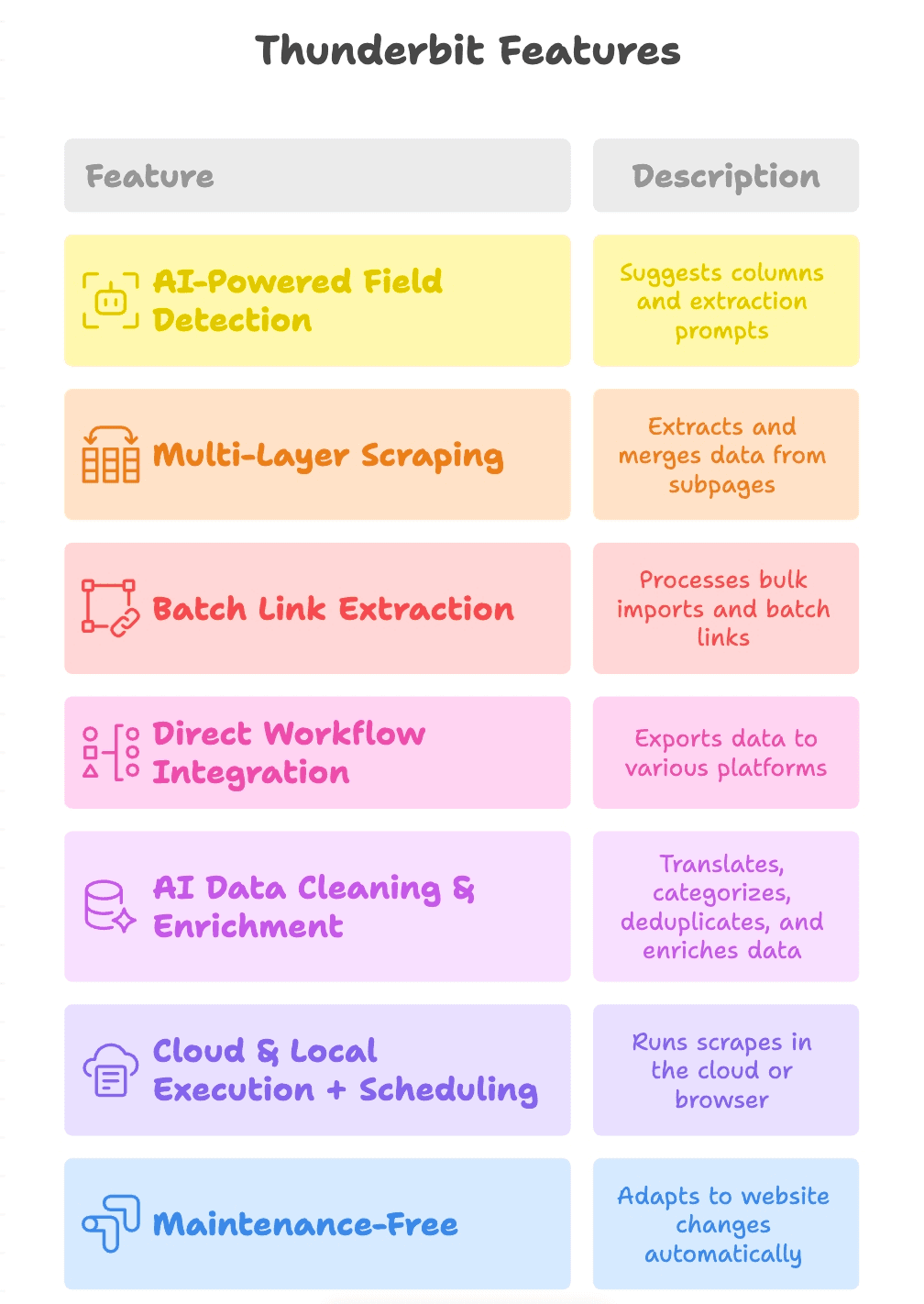

下面来看看 Thunderbit 到底强在哪里:

- AI 驱动的字段识别:只要点击“AI 建议字段”,Thunderbit 就会读取页面,自动建议列名(例如“产品链接”“PDF URL”“联系邮箱”),甚至会为每个字段生成提取提示词。

- 多层级抓取:Thunderbit 可以从主页面跟随链接进入子页面(例如产品详情页或 PDF 下载页),再提取更多链接,并把所有结果合并成一张表。

- 批量链接提取:不管你是在抓取单页还是上千个页面,Thunderbit 都能轻松处理批量导入和批量链接提取。

- 直接对接工作流:结果可以导出到 Google Sheets、Notion、Airtable,或者下载为 CSV/Excel。数据会直接到你团队需要的地方。

- AI 数据清洗与增强:Thunderbit 在抓取时就能帮你翻译、分类、去重,甚至补全数据——让输出结果开箱即用,而不是一堆原始垃圾数据。

- 云端与本地执行 + 定时任务:你可以在云端运行以获得更快速度,也可以在浏览器中运行以适配需要登录的网站。还能设置重复任务,保持数据持续更新。

- 免维护:Thunderbit 的 AI 会随着网站变化自动适配,这样你就不用花太多时间修修补补失效爬虫,而是把时间用在拿结果上。

Octoparse:人人都能上手的无代码链接爬虫

是无代码抓取领域的经典产品。它是一款桌面应用(Windows/Mac),界面可视化,点点就能用。你加载一个网页,点击想要的链接,Octoparse 就会帮你完成剩下的工作。

- 非常适合新手:无需编码。只要点击、提取、完成。

- 支持分页与动态内容:Octoparse 可以点击“下一页”按钮、滚动页面,甚至登录网站。

- 云端抓取与定时任务:付费方案支持云端运行任务和定期调度。

- 导出选项丰富:可将数据下载为 CSV、Excel、JSON,或推送到数据库。

它的免费方案对小任务很慷慨(最多 10 个任务、每月 50,000 行),但重度用户还是需要付费方案(起价约 75 美元/月)。

Apify:适合自定义工作流的灵活 URL 提取器

是网页抓取界的瑞士军刀。它既提供预构建的“actors”(抓取工具)市场,也支持你用 JavaScript 或 Python 自己写脚本。

- 预构建且可定制:可以直接使用社区 actor 完成常见任务,也可以为自定义工作流自己开发。

- 批量与定时抓取:可以把多个 URL 排队,平行运行任务,并设置重复抓取。

- API 优先:导出到 JSON、CSV、Excel 或 Google Sheets,并集成到你的数据管道中。

- 按量付费:每月有免费额度,之后按使用量计费。

Apify 非常适合半技术团队和开发者,尤其是那些既想要灵活性,又想要扩展能力的人。

Bright Data URL Scraper:企业级链接抓取方案

是为需要大规模抓取的企业打造的。他们的 Data Collector 提供预设的 URL Scraper,适合高频高量任务。

- 可承载超大规模:可以抓取成千上万甚至数百万页面,并配有强大的代理基础设施来避免封锁。

- 预设模板:电商、社交、房地产等领域都有现成爬虫。

- 企业级功能:合规工具、专家支持,以及高级反封锁能力。

- 价格:起价约 350 美元可处理 10 万次页面加载,明显是面向大企业的。

如果你是初创公司,这可能有点杀鸡用牛刀。但如果是关键业务、高频大规模抓取,Bright Data 就是个性能怪兽。

WebHarvy:点选式视觉链接提取器

是一款 Windows 桌面应用,你只要在内置浏览器里点击链接,就能开始抓取。

- 极其简单:点击一个链接,WebHarvy 就会自动高亮所有相似元素供你提取。

- 支持正则表达式:内置常见任务模式,无需编码。

- 可导出到 Excel、CSV、JSON、XML、SQL:很适合希望把数据导出为熟悉格式的商业用户。

- 一次性授权:付一次钱,永久使用。

非常适合小企业、研究人员,或者任何想要不用编程就快速拿到链接的人。

Web Scraper(Chrome 扩展):在浏览器里快速抓取链接

是一款免费、开源的工具,可以把你的浏览器变成爬虫。

- 定义站点地图:告诉它如何导航以及抓取什么内容。

- 支持分页与多层级爬取:可抓取分类、子分类和详情页。

- 导出到 CSV/XLSX:直接在浏览器里下载数据。

- 社区模板:有很多热门网站共享的站点地图。

它非常适合快速的一次性任务,也适合预算有限的学生和小团队。

ScraperAPI:面向开发者的可扩展链接爬虫

专为想要大规模获取网页、但又不想操心代理、封锁或 CAPTCHA 的开发者而设计。

- API 驱动:发送一个 URL,就能拿回 HTML 或抓取后的数据。

- 支持规模化与反机器人机制:内置代理轮换、JS 渲染和 CAPTCHA 解决能力。

- 可与你的代码集成:可配合 Python、Node.js 或任意语言使用。

- 定价:有免费额度(约 1000 次 API 调用),之后按请求付费。

它很适合自定义爬虫,或者当你需要在大规模场景下兼顾稳定性和速度时使用。

ParseHub:带高级选择能力的可视化链接爬虫

是一款桌面应用(Windows、Mac、Linux),可以让你通过可视化方式构建抓取项目。

- 高级选择与导航:点击、循环、条件提取链接——即使是动态元素或隐藏元素也能处理。

- 支持嵌套页面:先抓分类页,再抓详情页,然后提取更多链接。

- 可导出到 CSV、Excel、JSON:付费方案还支持云端运行和 API 访问。

- 免费方案:5 个项目,每次运行最多 200 个页面。

ParseHub 很受想要强大功能但又不想写代码的营销人员和研究人员欢迎。

Scrapy:适合开发者的 Python 链接提取器

是 Python 开发者追求完全控制时的黄金标准。

- 代码优先:构建自定义 spider,以任意规模抓取并提取链接。

- 支持分布式爬取:高效、异步、可高度定制。

- 可导出到 CSV、JSON、XML 或数据库:输出完全由你掌控。

- 开源且免费:但你需要自己管理运行环境。

如果你熟悉 Python,Scrapy 的能力几乎就是天花板级别。

Diffbot:面向结构化数据的 AI 链接爬虫

是网页抓取里的“AI 大脑”。它会分析页面并返回结构化数据——包括链接——而无需手动配置。

- 自动内容识别:输入一个 URL,就能返回结构化数据(文章、产品、链接等)。

- Crawlbot 与知识图谱:可以抓取整个网站,或查询其庞大的网页索引。

- API 驱动:可与 BI 工具或数据管道集成。

- 企业定价:起价约 299 美元/月,但你付出的每一分钱都能看见价值。

它最适合希望获得干净、结构化数据、又不想自己维护爬虫的企业。

Cheerio:轻量级 Node.js 链接爬虫

是一款快速、类似 jQuery 的 HTML 解析器,适用于 Node.js。

- 速度极快:几毫秒内就能解析 HTML。

- 语法熟悉:如果你懂 jQuery,上手 Cheerio 就很自然。

- 非常适合静态页面:不渲染 JS,但特别适合服务端渲染内容。

- 开源且免费:可搭配 axios 或 fetch 发请求。

适合构建自定义脚本的开发者,尤其是那些既要速度又要简单的人。

Puppeteer:用于高级链接抓取的浏览器自动化工具

是一个用于以无头模式控制 Chrome 的 Node.js 库。

- 完整浏览器自动化:像真实用户一样加载页面、点击、滚动和交互。

- 支持动态内容与登录:对 JavaScript 重度依赖的网站或复杂工作流特别适合。

- 精细控制:等待元素、截图、拦截网络请求都可以。

- 开源且免费:但资源消耗更高,速度也比轻量工具慢。

当你需要从那些不太配合基础爬虫的网站中抓取链接时,就该用 Puppeteer。

一眼看懂:哪款链接提取器更适合你?

下面是这 12 款工具的快速对比:

| 工具 | 最适合 | 批量与子页面支持 | 数据导出选项 | 价格 |

|---|---|---|---|---|

| Thunderbit | 非程序员、商业用户 | 是(AI、多层级) | Excel、CSV、Sheets、Notion、Airtable | 免费试用,约 9 美元/月起 |

| Octoparse | 无代码用户、分析师 | 是 | CSV、Excel、JSON、云存储 | 免费版,约 75 美元/月 |

| Apify | 半技术用户、开发者 | 是 | CSV、JSON、通过 API 导出到 Sheets | 免费额度,按量计费 |

| Bright Data | 企业 | 是(高容量) | 通过 API 导出 CSV、JSON、NDJSON | 约 350 美元/10 万页面 |

| WebHarvy | 非程序员、桌面用户 | 是 | Excel、CSV、JSON、XML、SQL | 付费授权 |

| Web Scraper 扩展 | 任何人,快速/免费 | 是 | CSV、XLSX | 免费、开源 |

| ScraperAPI | 开发者、API 用户 | 是 | JSON(通过 API 返回 HTML) | 免费 1000 次请求,付费套餐 |

| ParseHub | 非程序员、高级用户 | 是 | CSV、Excel、JSON、API | 5 个免费项目,付费版可选 |

| Scrapy | 开发者、Python 用户 | 是 | CSV、JSON、XML、数据库 | 免费、开源 |

| Diffbot | 企业、AI 场景 | 是(AI 抓取) | JSON(通过 API 返回结构化数据) | 约 299 美元/月起 |

| Cheerio | 开发者、Node.js | 是(自定义代码) | 自定义(JSON 等) | 免费、开源 |

| Puppeteer | 开发者、复杂网站 | 是(完整自动化) | 自定义(脚本输出) | 免费、开源 |

如何为你的业务选择合适的链接爬虫

那么,该怎么选?这是我的速查表:

- 不会写代码? 从 Thunderbit、Octoparse、ParseHub、WebHarvy,或者 Web Scraper 扩展开始。

- 需要自定义工作流? Apify、ScraperAPI 或 Cheerio 都非常适合开发者。

- 企业级规模? Bright Data 或 Diffbot 就是为你准备的。

- Python 或 Node.js 开发者? Scrapy(Python)或 Cheerio/Puppeteer(Node.js)都能给你完全控制权。

- 想直接导出到 Sheets/Notion? Thunderbit 是你的最佳选择。

把工具和你的技术水平、数据量以及集成需求匹配起来就行。大多数工具都有免费试用,所以大胆试一试。

Thunderbit 在 2026 年链接提取中的独特价值

再回到 Thunderbit 真正与众不同的地方:

- AI 驱动的简单性:你只需要用通俗英文描述需求,Thunderbit 的 AI 就会完成其余工作。

- 多层级抓取:从主页面提取链接,再进入子页面,继续抓取更多 URL——整个流程一次搞定。

- 批量导入与批处理:粘贴数百个 URL,批量提取链接,并立即导出结构化数据。

- 工作流集成:可直接导出到 Google Sheets、Notion、Airtable,或下载为 CSV/Excel。

- 零维护:Thunderbit 的 AI 会随着网站变化自动适配,所以你不用总是修复失效爬虫。

Thunderbit 弥合了“只是在抓数据”和“拿到真正能用的数据”之间的差距。它是我多年前在被手动数据任务淹没时就希望拥有的工具。

结论:更聪明地抓取链接,提升你的工作流

网页数据是业务增长的燃料,而合适的链接提取器就是你的引擎。无论你是在搭建潜在客户名单、监控竞争对手,还是自动化研究工作,这里总有一款工具能匹配你的需求和技能水平。

如果你想看看现代链接提取到底长什么样,。我觉得你会惊讶于自己只用几个点击就能完成这么多事。如果 Thunderbit 不是完全适合你的那一款,也可以试试这份清单里的其他工具——现在正是把枯燥工作自动化、把精力放在真正重要事情上的最佳时机。

祝你抓取顺利——也愿你的链接永远干净、结构清晰、随时可用。如果你想更深入了解网页爬取,可以去看看 获取更多指南和技巧。

常见问题

1. 为什么链接提取器如此重要?

如今,几乎一半的互联网流量都来自机器人,而企业又在积极抓取数据,因此链接提取器对于把网络上的混乱信息转化为可执行洞察至关重要。它们能自动化潜在客户开发、内容聚合、SEO 审计和竞争对手监控等任务,节省大量时间和精力。

2. Thunderbit 相比其他链接提取器有什么突出之处?

Thunderbit 使用 AI 简化抓取流程——你只需要用自然语言描述目标,它就会处理剩下的事情。它支持批量输入 URL、多层级抓取、智能字段识别,以及无缝导出到 Google Sheets 和 Notion 等平台。它非常适合不懂代码、但又想获得强大结果的商业用户。

3. 有没有适合开发者和自定义工作流的链接提取工具?

有。Apify、ScraperAPI、Cheerio、Puppeteer 和 Scrapy 都是面向开发者的工具。它们支持脚本编写、API 集成,并且足够灵活,可应对复杂抓取任务、大规模作业和高级自动化需求。

4. 哪些工具最适合没有编程经验的用户?

Thunderbit、Octoparse、ParseHub、WebHarvy,以及 Web Scraper Chrome 扩展,都是非技术用户的首选。这些工具提供可视化界面、预置模板和 AI 驱动功能,让每个人都能轻松提取链接。

5. 我该如何为自己的需求选择合适的链接提取器?

先考虑你的技术能力、数据量和导出需求。不会写代码的人可以优先选择 Thunderbit 或 Octoparse,而开发者可能更喜欢 Scrapy 或 Puppeteer。企业用户则可以考虑 Bright Data 或 Diffbot 来满足大规模需求。记得先试试免费版,看看哪款最适合你。