如今,网页早就不只是一个数字游乐场——它其实是全球最大的数据库。从销售团队到市场分析师,大家都在争先恐后地从中挖掘价值。但说实话:手动收集网页数据,体验大概就像不看说明书拼 IKEA 家具一样,除了费劲,还会多出一堆螺丝。

随着企业越来越依赖实时市场情报、竞品定价和线索获取,对高效、可靠的数据爬虫工具的需求前所未有地迫切。事实上,近 来推动决策,而全球网页爬虫市场也有望在 。

如果你已经受够了复制粘贴、总是错过新线索,或者只是想看看把重复工作交给自动化之后能轻松到什么程度,那你来对地方了。我花了很多年构建和测试网页提取工具(没错,我也带领着 团队),所以我很清楚,选对工具能把几小时的苦力活变成两次点击就搞定的轻松体验。无论你是想快速出结果的非技术用户,还是希望完全掌控流程的开发者,这份 10 款最佳数据爬虫工具清单都能帮你找到合适的选择。

为什么选择合适的数据爬虫工具很重要

说到底:好用的数据爬虫工具和普通工具之间的差别,不只是方便而已——它直接影响业务增长。自动化网页提取时,你省下的不只是时间(虽然一位 G2 评审提到自己),还会减少错误、释放新机会,并确保团队始终用上最新、最准确的数据。手动调研既慢又容易出错,而且等你做完时,信息往往已经过时了。有了合适的工具,你只需要几分钟就能监控竞品、追踪价格或整理线索名单,而不是几天。

一个典型案例:某美妆零售商利用网页爬虫监控竞品库存和定价, 。这种效果,光靠表格和苦干是做不到的。

我们如何评估最佳数据爬虫工具

可选项太多,挑数据爬虫工具就像在科技大会上快速相亲。以下是我用来筛选优胜者的标准:

- 易用性: 不会 Python 也能上手吗?有没有可视化界面或 AI 辅助给非技术用户?

- 自动化能力: 能处理分页、子页面、动态内容和定时任务吗?大任务能否在云端运行?

- 价格与扩展性: 有没有免费档或负担得起的入门方案?随着数据需求增长,价格如何变化?

- 功能与集成: 能导出到 Excel、Google Sheets,或者通过 API 使用吗?有没有模板、定时或内置数据清洗功能?

- 适合谁: 这款工具主要是给业务用户、开发者,还是企业团队设计的?

文末我还附了一张快速对比表,方便你直接看出各工具的差异。

现在,让我们进入 2026 年最适合高效网页提取的 10 款最佳数据爬虫工具。

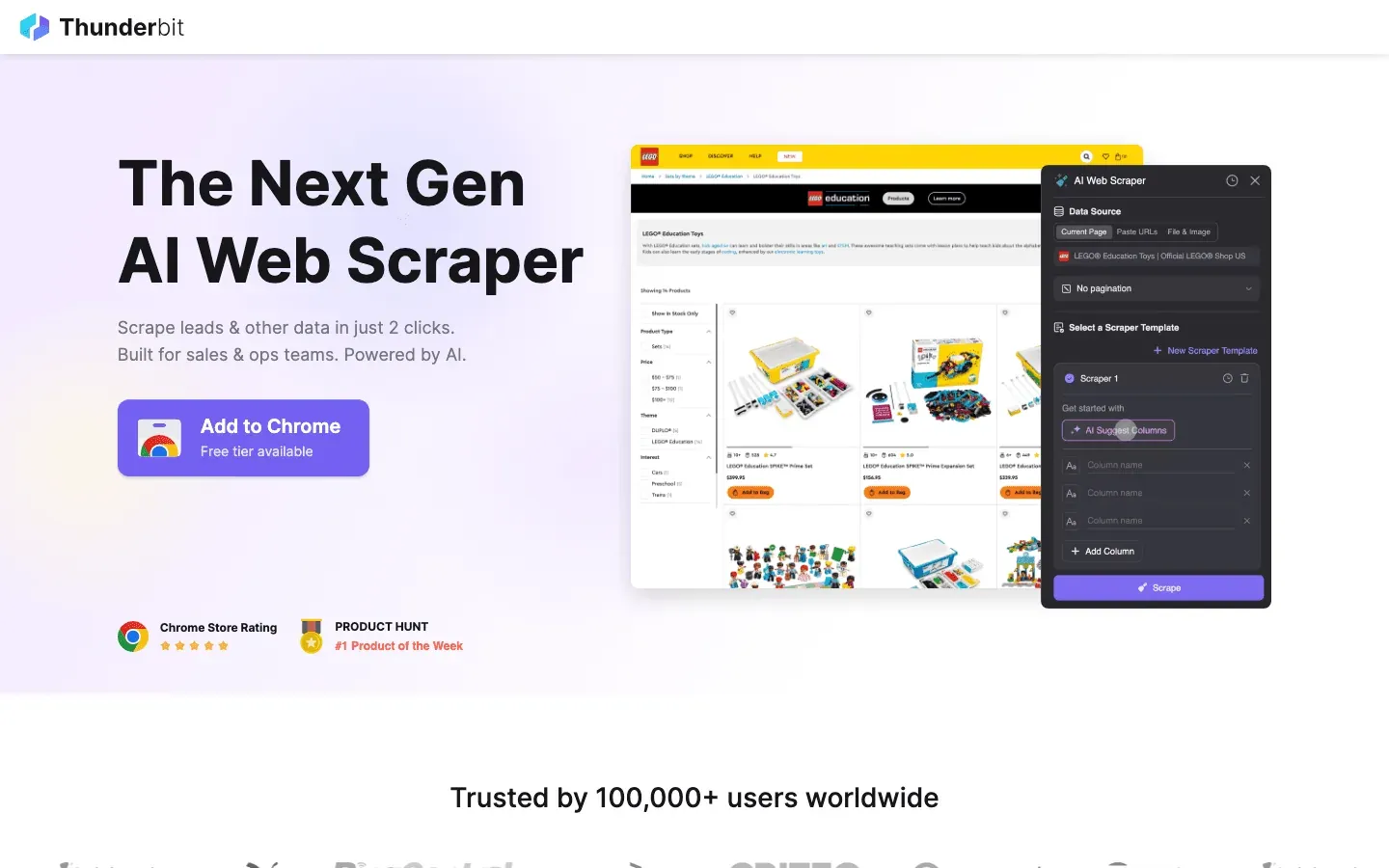

1. Thunderbit

是我最推荐给任何想把数据爬取做得像点外卖一样简单的工具。Thunderbit 作为一款 AI 驱动的 Chrome 扩展,核心就是 2 步抓取:先点“AI 建议字段”,让 AI 自动判断页面内容;再点“抓取”把数据提取下来。无需编码,也不用折腾选择器,结果立刻就有。

是我最推荐给任何想把数据爬取做得像点外卖一样简单的工具。Thunderbit 作为一款 AI 驱动的 Chrome 扩展,核心就是 2 步抓取:先点“AI 建议字段”,让 AI 自动判断页面内容;再点“抓取”把数据提取下来。无需编码,也不用折腾选择器,结果立刻就有。

Thunderbit 为什么这么受销售、营销和电商团队欢迎?因为它就是为真实业务流程而设计的:

- AI 建议字段: AI 会读取页面并推荐最适合提取的列——姓名、价格、邮箱,应有尽有。

- 子页面抓取: 需要更多详情?Thunderbit 可以自动访问每个子页面(比如商品详情页或领英资料页)并丰富你的表格。

- 即时导出: 直接把数据推送到 Excel、Google Sheets、Airtable 或 Notion。所有导出都是免费的。

- 一键模板: 对于热门网站(Amazon、Zillow、Instagram),可以直接使用现成模板,速度更快。

- 免费数据导出: 导出数据没有付费墙。

- 定时抓取: 用自然语言设置重复任务(比如“每周一早上 9 点”)——非常适合价格监控或每周更新线索。

Thunderbit 采用积分制(1 积分 = 1 行),并提供一个,最多可抓取 6 个页面(试用加赠后可达 10 个)。付费方案从每月 15 美元起,包含 500 积分,适合各种规模的团队。

如果你想看看 Thunderbit 实际怎么用,可以看看我们的 或 。这就是我当年被手动录入数据淹没时,最希望自己能拥有的工具。

2. Octoparse

是数据爬取领域的重量级选手,尤其适合需要强大能力的企业用户。它提供可视化桌面界面(Windows 和 Mac),你可以通过点选方式搭建提取流程,无需编程。别被它友好的界面骗了:在底层,Octoparse 能处理登录、无限滚动、轮换代理,甚至 CAPTCHA 识别。

是数据爬取领域的重量级选手,尤其适合需要强大能力的企业用户。它提供可视化桌面界面(Windows 和 Mac),你可以通过点选方式搭建提取流程,无需编程。别被它友好的界面骗了:在底层,Octoparse 能处理登录、无限滚动、轮换代理,甚至 CAPTCHA 识别。

- 500+ 预置模板: 可直接使用 Amazon、Twitter、领英等网站模板快速上手。

- 云端抓取: 在 Octoparse 服务器上运行任务、安排定时,并轻松扩展大项目。

- API 访问: 可将抓取数据直接集成到业务应用或数据库中。

- 高级自动化: 支持动态内容、分页和多步骤流程。

免费方案包含 10 个任务,以及相当宽裕的每月 50,000 行导出上限,所以它是真正能干活的免费层,而不只是试用噱头。付费方案从 Standard 每月 69 美元起(按年付费;若按月付费约 82 美元/月),Professional 为每月 249 美元。它的学习曲线比 Thunderbit 更陡,但如果你需要稳定抓取成千上万的页面,并且希望在云端执行,Octoparse 依然是值得认真考虑的老牌选择。价格已于 2026-05-13 依据 核实。

3. Scrapy

是开发者在数据爬取项目中追求完全控制权时的黄金标准。它是一个开源 Python 框架,可以让你为任何网站编写自定义爬虫。如果你能想到,就能用 Scrapy 做出来。

是开发者在数据爬取项目中追求完全控制权时的黄金标准。它是一个开源 Python 框架,可以让你为任何网站编写自定义爬虫。如果你能想到,就能用 Scrapy 做出来。

- 完全可编程: 用 Python 代码精确定义如何抓取和解析任何网站。

- 异步且快速: 可并行处理成千上万的页面,适合大规模项目。

- 可扩展: 可添加代理、中间件、无头浏览器或自定义逻辑。

- 社区强大: 有大量教程、插件,以及对复杂抓取场景的支持。

Scrapy 免费且开源,但需要一定编程能力。如果你有技术团队,或者想搭建自定义数据管道,Scrapy 几乎很难被超越。不过对非技术用户来说,上手门槛确实不低。

4. ParseHub

是一款可视化、无需代码的网页爬取工具,非常适合面对复杂网站的非技术用户。它的点选式界面可以让你选择元素、定义操作并构建抓取流程,即使网站包含动态内容或复杂导航也没问题。

是一款可视化、无需代码的网页爬取工具,非常适合面对复杂网站的非技术用户。它的点选式界面可以让你选择元素、定义操作并构建抓取流程,即使网站包含动态内容或复杂导航也没问题。

- 可视化流程构建器: 通过点击选择数据、设置分页,并处理弹窗或下拉菜单。

- 支持动态内容: 可用于大量 JavaScript 驱动的网站和交互式页面。

- 云端运行与定时: 可在云端执行抓取并安排重复任务。

- 导出到 CSV、Excel 或通过 API: 可轻松集成到你喜欢的工具中。

ParseHub 提供免费方案(5 个项目),付费方案起价约为 。它比一些竞品贵一点,但可视化方式让分析师、营销人员和研究人员更容易上手,适合那些需要比普通 Chrome 扩展更强能力的人。

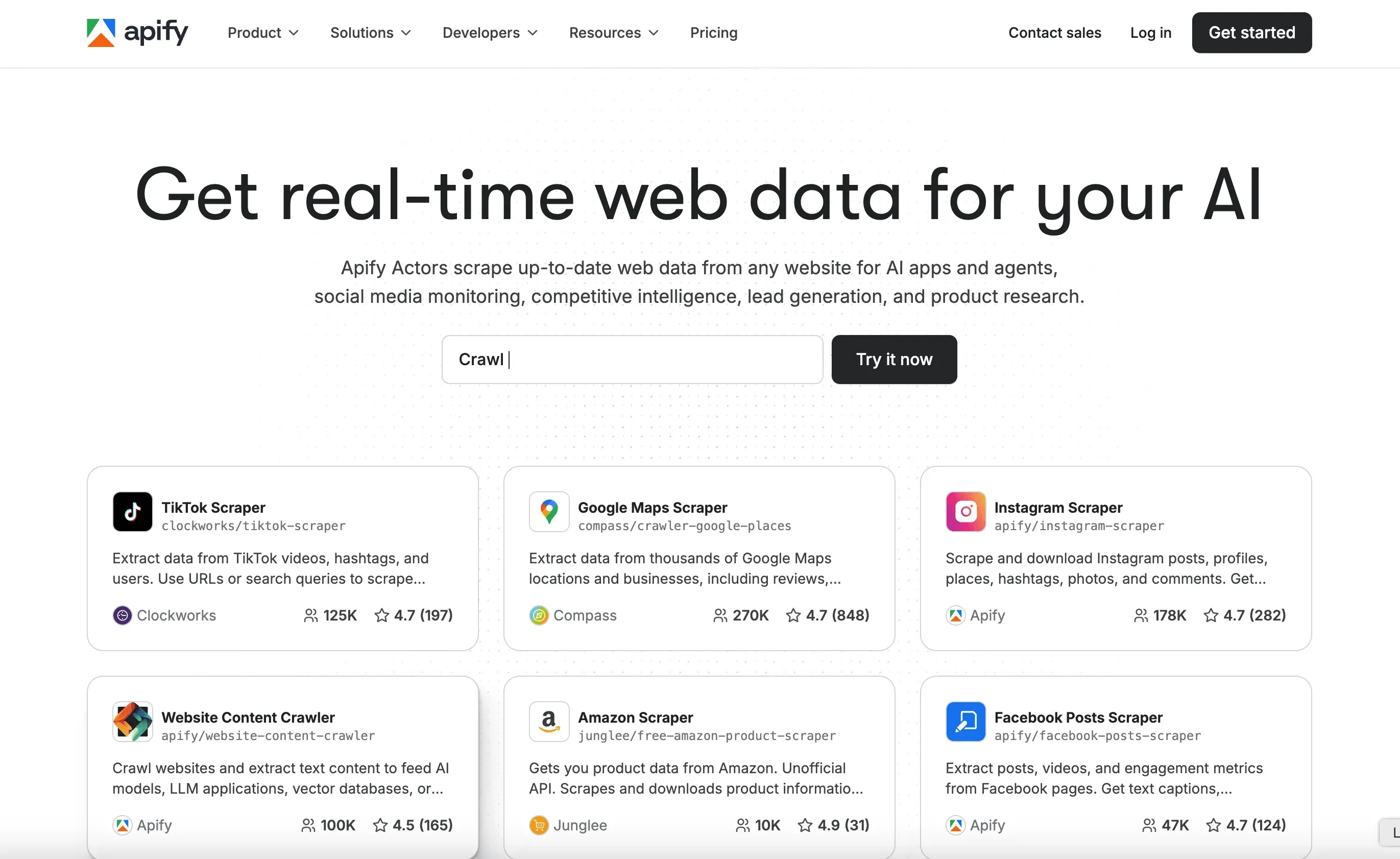

5. Apify

既是平台,也是网页爬取市场。它提供庞大的预构建 “Actors”(即现成爬虫)库,适用于热门网站,同时也支持你在云端构建并运行自己的自定义爬虫。

既是平台,也是网页爬取市场。它提供庞大的预构建 “Actors”(即现成爬虫)库,适用于热门网站,同时也支持你在云端构建并运行自己的自定义爬虫。

- 5,000+ 现成 Actors: 可立即抓取 Google Maps、Amazon、Twitter 等网站。

- 自定义脚本: 开发者可使用 JavaScript 或 Python 构建高级爬虫。

- 云端扩展: 可并行运行任务、安排定时,并在云端管理数据。

- API 与集成: 可将结果接入应用、工作流或数据管道。

Apify 一开始会赠送 5 美元的平台额度,之后分别提供 Starter(29 美元/月)、Scale(199 美元/月)和 Business(999 美元/月)等方案——每个档位都是“平台额度 + 按计算单元使用量付费”,所以账单真的会随着使用情况变化。它有一定学习曲线,但如果你既想要即用型 actors,又想用 JS 或 Python 编写自己的爬虫,Apify 依然是这份榜单里最强的选择之一。价格已于 2026-05-13 依据 核实。

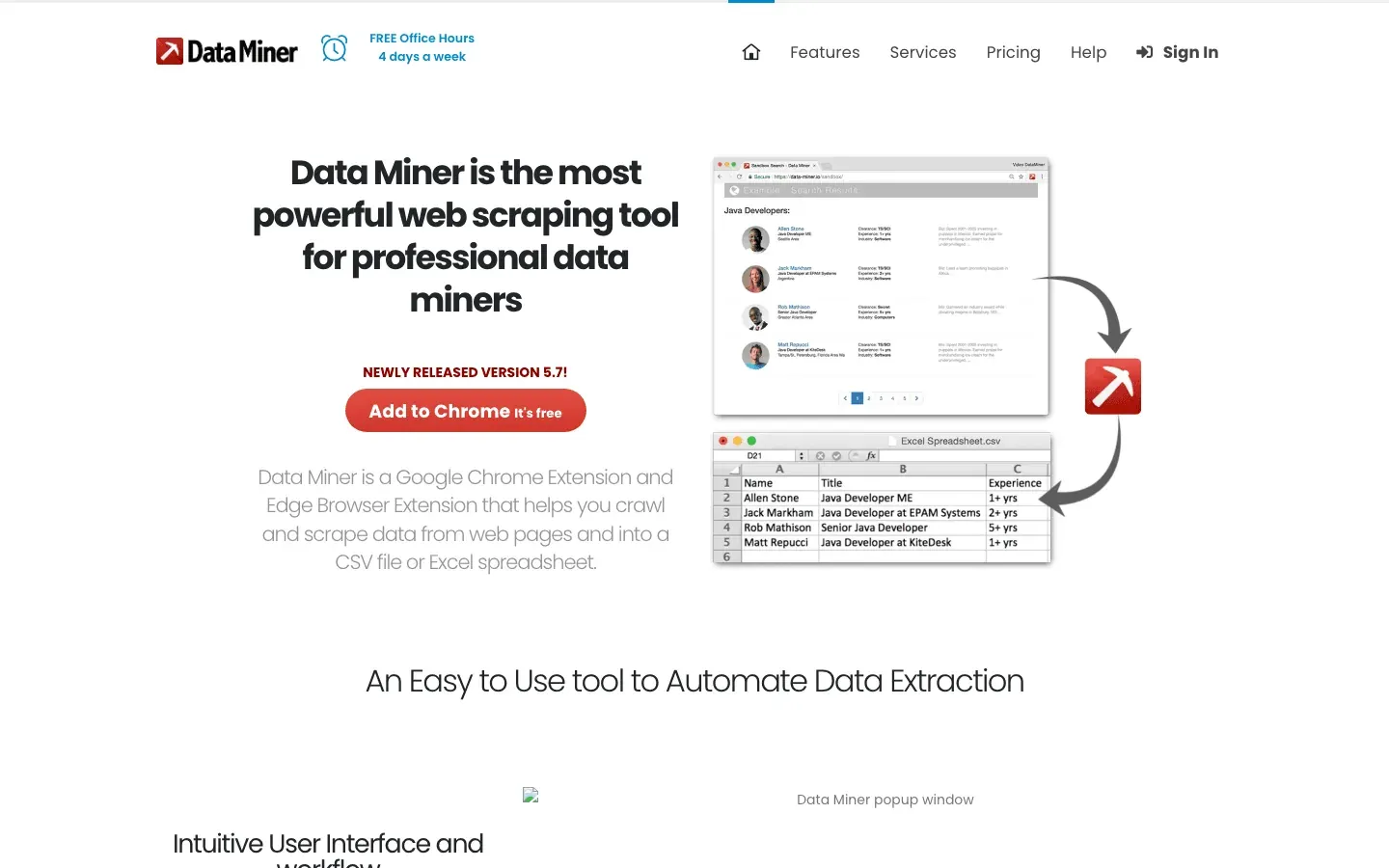

6. Data Miner

是一款面向快速、模板化数据爬取的 Chrome 扩展。它非常适合希望不做任何设置,就能从表格或列表中提取数据的业务用户。

是一款面向快速、模板化数据爬取的 Chrome 扩展。它非常适合希望不做任何设置,就能从表格或列表中提取数据的业务用户。

- 海量模板库: 超过一千个常见网站配方(如领英、Yelp 等)。

- 点选式提取: 选择模板、预览数据,然后立即导出。

- 基于浏览器: 基于你当前的会话运行,非常适合带登录态的抓取。

- 导出到 CSV 或 Excel: 几秒钟就能把数据放进表格。

包含每月 500 页,付费方案从每月 20 美元起。它最适合小型、一次性任务,或者你现在就需要数据的场景——但别指望它能处理超大规模任务或复杂自动化。

7. Import.io

是一个企业级平台,适合需要持续、可靠地集成网页数据的组织。它不只是爬虫,更是一项托管服务,能把干净、结构化的数据直接送进你的业务系统。

是一个企业级平台,适合需要持续、可靠地集成网页数据的组织。它不只是爬虫,更是一项托管服务,能把干净、结构化的数据直接送进你的业务系统。

- 无需代码提取: 通过可视化方式定义要抓取的数据。

- 实时数据流: 可将数据流式送入仪表盘、分析工具或数据库。

- 合规与可靠性: 处理 IP 轮换、反爬措施和法律合规要求。

- 托管服务: Import.io 团队可以帮你搭建并维护爬虫。

价格采用,SaaS 平台提供 14 天免费试用。如果你的业务依赖始终最新的网页数据(比如零售、金融或市场研究),Import.io 值得一看。

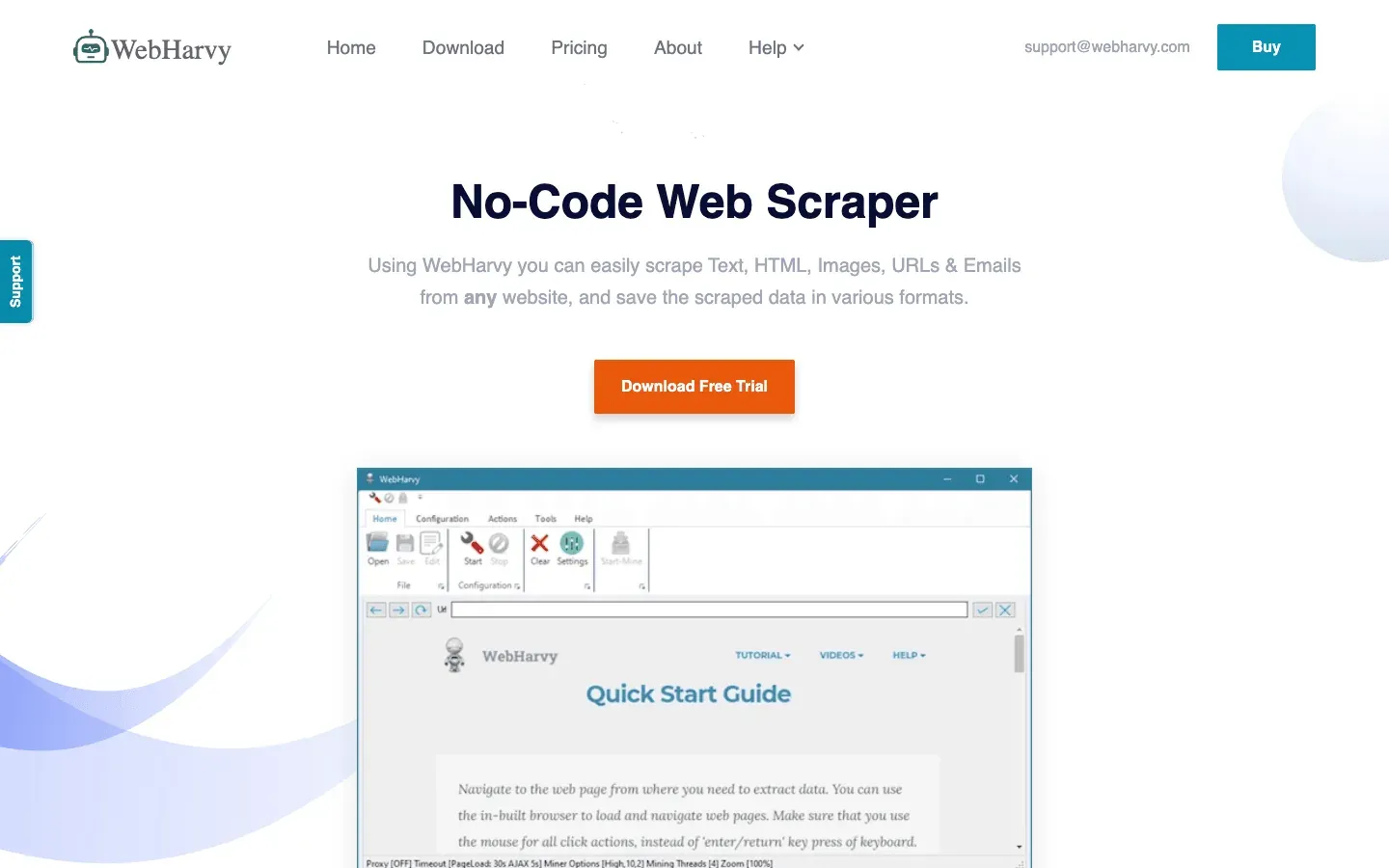

8. WebHarvy

是一款面向 Windows 用户的桌面爬虫,提供点选式方案,而且不需要订阅。它尤其受中小企业和偏好一次性购买的个人用户欢迎。

是一款面向 Windows 用户的桌面爬虫,提供点选式方案,而且不需要订阅。它尤其受中小企业和偏好一次性购买的个人用户欢迎。

- 可视化模式识别: 点击数据元素后,WebHarvy 会自动识别重复模式。

- 支持文本、图片等更多类型: 可提取包括邮箱和 URL 在内的常见数据类型。

- 分页与定时: 可浏览多页网站并设置定时抓取。

- 导出到 Excel、CSV、XML、JSON 或 SQL: 输出格式灵活,适配各种流程。

单用户许可证,对于经常使用的人来说性价比很高——只是要注意,它仅支持 Windows。

9. Mozenda

是一款基于云端的数据爬取平台,面向业务运营和持续的数据需求。它把桌面设计器(Windows)与强大的云端执行和自动化结合在一起。

是一款基于云端的数据爬取平台,面向业务运营和持续的数据需求。它把桌面设计器(Windows)与强大的云端执行和自动化结合在一起。

- 可视化 Agent 构建器: 通过点选界面设计提取流程。

- 云端扩展: 可并行运行多个 agent、安排任务并集中管理数据。

- 数据管理控制台: 提取后可对数据集进行合并、筛选和清洗。

- 企业支持: 为大型团队提供专属客户经理和托管服务。

Mozenda 的自助 Pilot 方案为每月 500 美元(5,000 处理积分、10 个 agent、10GB 存储),Enterprise 需要询价。如果你想先试试再决定,也有 14 天免费 Trial 方案,包含 500 积分。Mozenda 最适合那些希望把稳定、可重复的网页数据深度融入日常运营的公司——价格并不便宜,而且平台也默认你是认真来用的。价格已于 2026-05-13 依据 核实。

10. BeautifulSoup

是经典的 Python HTML 和 XML 解析库。它不是完整的爬虫框架,但深受开发者喜爱,特别适合小规模、定制化的抓取项目。

是经典的 Python HTML 和 XML 解析库。它不是完整的爬虫框架,但深受开发者喜爱,特别适合小规模、定制化的抓取项目。

- 简单的 HTML 解析: 可轻松从静态网页中提取数据。

- 可与 Python Requests 配合: 可结合其他库进行抓取和请求。

- 灵活且轻量: 适合快速脚本或教学项目。

- 社区庞大: 有大量教程和 Stack Overflow 相关解答。

BeautifulSoup,但你需要自己写代码并处理爬取逻辑。它最适合想弄懂网页爬取底层原理的开发者或学习者。

对比表:数据爬虫工具一览

| 工具 | 易用性 | 自动化水平 | 价格 | 导出选项 | 最适合 |

|---|---|---|---|---|---|

| Thunderbit | 非常简单,无需代码 | 高(AI、子页面) | 免费试用,起价 15 美元/月 | Excel、Sheets、Airtable、Notion、CSV | 销售、营销、电商、非技术用户 |

| Octoparse | 中等,可视化界面 | 很高,云端 | 免费,83–299 美元/月 | CSV、Excel、JSON、API | 企业、数据团队、动态网站 |

| Scrapy | 低(需要 Python) | 高(可定制) | 免费,开源 | 任意(通过代码) | 开发者、大规模定制项目 |

| ParseHub | 高,可视化 | 高(动态网站) | 免费,起价 189 美元/月 | CSV、Excel、JSON、API | 非技术用户、复杂网页结构 |

| Apify | 中等,灵活 | 很高,云端 | 免费,29–999 美元/月 | CSV、JSON、API、云存储 | 开发者、企业、现成或自定义 actors |

| Data Miner | 非常简单,浏览器内使用 | 低(手动) | 免费,20–99 美元/月 | CSV、Excel | 快速一次性提取、小型数据集 |

| Import.io | 中等,托管式 | 很高,企业级 | 定制,按量计费 | CSV、JSON、API、直接集成 | 企业、持续数据集成 |

| WebHarvy | 高,桌面端 | 中等(定时) | 129 美元一次性 | Excel、CSV、XML、JSON、SQL | 中小企业、Windows 用户、常规抓取 |

| Mozenda | 中等,可视化 | 很高,云端 | 250–450+ 美元/月 | CSV、Excel、JSON、云端、数据库 | 持续性、大规模业务运营 |

| BeautifulSoup | 低(需要 Python) | 低(手动编码) | 免费,开源 | 任意(通过代码) | 开发者、学习者、小型定制脚本 |

如何为你的团队选择合适的数据爬虫工具

选择最好的数据爬虫工具,不是看谁“最强”,而是看谁最适合你团队的技能、需求和预算。我的快速建议如下:

- 非技术用户或业务用户: 先试 Thunderbit、ParseHub 或 Data Miner,上手快,结果也来得快。

- 企业或大规模需求: 看看 Octoparse、Mozenda 或 Import.io,它们在自动化、定时和支持方面更强。

- 开发者或定制项目: Scrapy、Apify 或 BeautifulSoup 提供完全控制和灵活性。

- 预算有限或一次性任务: WebHarvy(Windows)或 Data Miner(浏览器)更省钱,也更简单。

一定要用真实目标网站做免费试用测试——在一个网站上好用的工具,在另一个网站上未必行得通。别忘了考虑集成:如果你需要把数据送进 Sheets、Notion 或数据库,务必确认工具开箱即用就支持这些功能。

结论:用最佳数据爬虫工具释放商业价值

网页数据就是新的石油,但前提是你得有合适的机器把它提取并提纯。借助现代数据爬虫工具,你可以把数小时的手动调研变成几分钟的自动化洞察——为更聪明的销售、更精准的营销和更灵活的运营提供动力。无论你是在整理线索名单、追踪竞品,还是单纯厌倦了复制粘贴,这份清单里总有一款工具能让你的工作轻松不少。

所以,看看你团队的需求,试试这些工具,感受一下当自动化替你完成重活时,你能做成多少事。如果你想看看 AI 驱动的 2 步抓取到底是什么样子,。祝你抓取顺利——也愿你的数据始终新鲜、结构化,并随时可用。

常见问题

1. 什么是数据爬虫工具,为什么我需要它?

数据爬虫工具会自动从网站提取信息。它能节省时间、减少错误,并帮助团队更高效地收集用于销售、营销、研究和运营的最新数据——远比手动复制粘贴高效得多。

2. 哪款数据爬虫工具最适合非技术用户?

Thunderbit、ParseHub 和 Data Miner 是非技术用户的热门选择。Thunderbit 的 2 步 AI 工作流最突出,而 ParseHub 则为更复杂的网站提供了可视化方案。

3. 不同数据爬虫工具的定价模式有什么区别?

定价差异很大:有些工具(如 Thunderbit 和 Data Miner)提供免费档和实惠的月付方案,而企业平台(如 Import.io 和 Mozenda)则采用定制化或按量计费。一定要确认工具的成本是否与你的数据需求匹配。

4. 我可以把这些工具用于持续、定时的数据提取吗?

可以——像 Thunderbit、Octoparse、Apify、Mozenda 和 Import.io 都支持定时或重复抓取,非常适合持续的价格监控、线索获取或市场研究。

5. 在选择数据爬虫工具之前,我应该考虑什么?

请考虑团队的技术能力、目标网站的复杂度、数据量、集成需求和预算。在购买付费方案前,先用真实任务测试几款工具。

想看更多深度解析和实用指南,可以访问 。

了解更多