在 GitHub 上搜索“amazon scraper”,大约会返回 。如果再筛选最近六个月有推送的仓库,就只剩下约 ——连 20% 都不到。剩下的是什么?废弃教程、过时的封装层,还有 Amazon 一加强防护就立刻失效的脚本。

我花了不少时间翻查 Amazon 爬虫仓库、阅读 GitHub issue,并跟踪 Reddit 和 Stack Overflow 上的社区讨论。模式非常一致:有人找到一个热门仓库,花一小时把环境搭好,跑一次,然后就撞上一堆 CAPTCHA 或 503 错误。到了 2026 年,Amazon 的反爬策略早就不是两年前那一套了——TLS 指纹识别、行为分析和更激进的 CAPTCHA 投放,让过去那种“换个 User-Agent,然后祈祷有用”的做法几乎失灵。这篇指南会讲清楚:如果你想从 GitHub 仓库里稳定拿到 Amazon 数据,真正该关注哪些最佳实践,以及当(不是如果)你的爬虫挂掉时该怎么处理。

GitHub 上的 Amazon 爬虫是什么?为什么这么多都会失败?

GitHub 上的 Amazon 爬虫仓库,通常是一个开源脚本——一般基于 Python、Node.js 或 Scrapy——用于从 Amazon 页面提取结构化数据。常见目标数据包括:商品标题、价格、ASIN、评分、评论数、库存状态、卖家信息、搜索结果卡片,以及评论文本。

整体架构通常很直接:

- HTTP 客户端或无头浏览器抓取页面。

- HTML 或 JSON 解析器提取字段。

- 数据保存为 CSV、JSON 或数据库。

这类仓库通常分成四类:

- 轻量级 Python 库(例如 )

- Scrapy 爬虫(例如 )

- Selenium 或 Playwright 浏览器自动化工具

- API 封装项目,本质上是某个商业抓取服务的前端(例如 )

失败模式也很可预测。大多数仓库都会失效,通常是因为:

- Amazon 改了页面布局或 HTML 片段

- Amazon 返回 503 或 CAPTCHA,而不是正常内容

- 爬虫的 TLS 和 HTTP 指纹不再像真实浏览器

- 地区、语言或请求头不匹配,触发了风控

- 维护者在解决原本狭窄的用例后就不再更新

高 star 数和“现在还能用”是两回事。按我为这篇文章做的审查,公开可见度较高的 8 个仓库里,只有大约 3 个在 2026 年看起来仍然明显活跃。

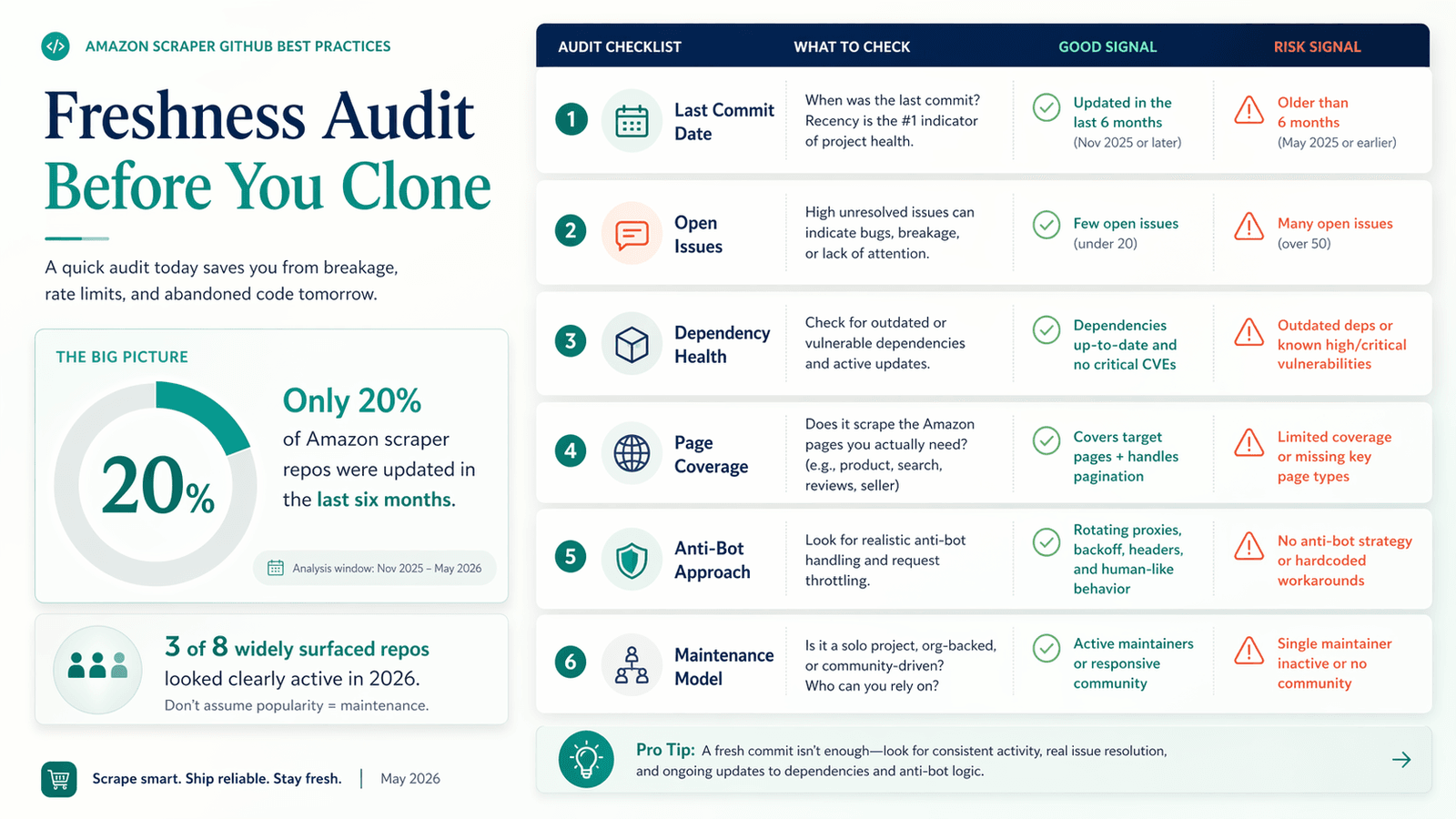

在克隆任何 Amazon 爬虫 GitHub 仓库之前,先做一次 2026 新鲜度审查

这一步对 Amazon 来说,比对大多数其他目标都更重要。Amazon 的防护策略变化速度比普通电商网站快得多,所以一个在宣传页网站上能正常工作的仓库,几周后就可能在 Amazon 上完全失效。然而,大多数“最佳 amazon scraper github”列表都会推荐仓库,却不会检查它们是否还真的能跑。用户因此浪费大量时间去搭一个已经坏掉的工具。

如何判断一个 GitHub 仓库还活着

在 git clone 之前,先检查以下内容:

- 最后一次提交时间: 如果超过 6 个月没动,在 Amazon 这类场景里就是强烈警告信号。

- 开放 issue 与响应率: 在 Issues 里搜“captcha”“503”“blocked”“not working”。如果这些问题堆了一堆,却没有维护者回应,就别碰了。

- 依赖健康度: 打开

requirements.txt或package.json。过时的库(例如没有现代 TLS 处理的旧requests)是危险信号。 - Amazon 页面类型覆盖: 仓库是否同时支持商品页、搜索结果和评论页?还是只支持其中一种?

- 反爬策略: 只写死请求头、没有代理支持,这还是 2023 年的做法,撑不到 2026 年。

Amazon 爬虫 GitHub 新鲜度检查清单

| 新鲜度信号 | 检查什么 | 红旗 🚩 |

|---|---|---|

| 最后提交时间 | 提交记录或仓库推送日期 | 超过 6 个月 |

| 开放 issue | Issues 标签页——筛选“captcha”“503”“blocked” | 反复失效,却没有维护者回复 |

| 依赖健康度 | requirements.txt / package.json | 库已过时,没有现代 TLS 策略 |

| Amazon 页面覆盖范围 | README + 代码示例 | 只处理一种页面类型(例如只支持商品页,不支持搜索或评论) |

| 反爬策略 | 源代码、代理配置 | 只写死请求头和 UA 字符串 |

| 维护模式 | 它是真爬虫、教程,还是商业 API 封装? | 仓库其实只是付费服务的前端 |

这次审查实际发现了什么

我按这些标准检查了 8 个广泛可见的 Amazon 爬虫仓库。结果并不乐观:

| 仓库 / 工具 | Star 数 | 最后提交信号 | 范围 | 2026 状态 | 备注 |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2,872 | 2026-04-02 | 托管爬虫 API 封装 | 还活着,但不是 DIY | 很新,但本质上是托管服务前端 |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | 搜索、详情、评论的托管 API | 还活着,但不是 DIY | 覆盖面不错,但它是 API 产品,不是原始爬虫 |

| theonlyanil/amzpy | ~110 | 2026-02-26 | 轻量级 Python 库 | 还活着 | 最清晰的直接 GitHub 爬虫,使用了 curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | 仅评论 | 范围窄,但还能用 | 很旧,而且高度聚焦评论 |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | 最后提交在 2023 年;仓库推送于 2024-08-20 | Scrapy 爬虫 + 代理中间件 | 教程级,且在老化 | 适合学习,不适合 2026 开箱即用 |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | Node CLI,支持搜索、详情、评论 | 高风险 | 覆盖面广,但维护太久没更新 |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | 搜索到 CSV | 2026 年已失效 | 历史上很热门,但明显过时 |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | 搜索/商品教程 | 2026 年已失效 | 基本可视为归档项目 |

公开 issue 也讲的是同一个故事。 有一个 issue 标题叫“所有请求都返回 captcha 响应”。 有“看起来不能用了”。 里则是“绕过 Amazon 防护”。这些都不是小众边缘问题——而是用户最先碰到的坑。

反封禁操作手册:如何避免使用 GitHub 上的 Amazon 爬虫时被封

被拦截,是使用 amazon scraper github 项目的人最大的痛点。像“用代理并轮换 User-Agent”这样的通用建议,已经不够用了。Amazon 在 2025–2026 年的反机器人栈里包括 TLS 指纹识别、行为分析和更激进的 CAPTCHA 投放。你需要的是分层策略。

TLS 指纹匹配:为什么原生 requests 很容易被封

这是最容易被忽视的反封禁技巧之一。TLS 指纹识别的工作方式是这样的:当你的脚本与 Amazon 建立安全连接时,服务器可以通过握手方式看出很多客户端特征——比如提供了哪些加密套件、扩展的顺序、HTTP/2 设置等。浏览器的 TLS 和 HTTP/2 设置相对固定,这些组合可以通过 等技术识别出来。

普通的 requests 和常见的 httpx 配置可以伪造请求头,但无法复制 Chrome 式的 TLS 和 HTTP/2 行为。Amazon 能看出差别。

直接解决了这个问题。它支持浏览器模拟——支持的目标包括 chrome136、safari184 和 firefox133——让你的 HTTP 客户端的 TLS 指纹与真实浏览器一致。文档还明确警告不要生成随机 JA3 字符串:浏览器指纹通常按版本固定,随机拼出来的乱值反而比真实复制的指纹更容易被发现。

社区数据也与此一致。一篇关于 curl_cffi + Amazon 的 证实,impersonate 参数很有用,因为它可以轮换浏览器配置文件,并保持请求头一致。另一篇 提到,Amazon 大约会在“一两个月后”开始基于 TLS 指纹封禁客户端。 则直接在问 Amazon 是否在给 python-requests 做指纹识别(答案:是)。

如果你现在还把原生 requests 当作 Amazon 的首选客户端,先升级这个认知,再升级其他任何东西。

正确的代理轮换方式(不是简单地“用代理”)

代理的重点不是尽可能频繁地轮换,而是让会话看起来可信。

住宅代理 vs. 数据中心代理: 数据中心代理更便宜,但也更容易被识别。住宅代理更贵,但 Amazon 更难封。 起价为 4.00 美元/GB 按量付费,大套餐可降到 3.50 美元/GB。 起价为 6 美元/GB。Amazon 属于“高复杂度目标”这一类,住宅代理值得付溢价。

按请求轮换 vs. 按会话轮换: 这也是很多教程讲错的地方。每次请求都换代理,但 cookies 和请求头保持不变,反而可能更不像真人。更安全的模式是:

- 尽可能让搜索 → 商品 → 评论的浏览过程保持在同一个粘性会话里

- 开始新的搜索旅程时再切换会话,而不是每个请求都切

- 在会话之间轮换,而不是在单个浏览会话里随机乱跳

一位 指出,在热门电商网站上,标准 ISP IP 的表现远不如移动 IP。另一篇 也提到,即使用了轮换 User-Agent 和住宅代理还是会被封——这再次说明,代理本身远远不够。

请求节奏、退避与限速

Amazon 的 503 页面不是随机倒霉,而是反馈信号。

一篇关于抓取 500+ ASIN 的 提到,即使有 sleep,每次都会在大约第 101 个 ASIN 的位置稳定出现 503。这个模式虽然老,但结论仍然适用:同一 IP 或同一指纹的原始请求量最终会触发防护。

DIY GitHub 爬虫的最佳节奏建议:

- 请求之间使用随机延迟(不要固定间隔,固定间隔很容易被识别)

- 简单 HTTP 客户端抓公开商品页时,每次请求间隔 2 到 5 秒

- 遇到 503 或 CAPTCHA 后做指数退避——逐步放慢,而不是立刻重试

- 并发数要低于你直觉里“需要的值”

- 使用失败开放式日志记录,不要死磕紧密重试循环

大多数 amazon scraper github 仓库都没有内置限速,你需要自己补上。

请求头编排:不只是 User-Agent 字符串

Amazon 检查的是整套请求头,而不只是 User-Agent。

一个像样的浏览器请求头集合应该包括:

User-AgentAcceptAccept-LanguageAccept-Encoding- 适当情况下的

Sec-CH-*提示 - 与所选浏览器配置文件一致的连接行为

请求头还要与市场地区相匹配。一位 发现,同一套机器人配置只在部分地区被识别出来,另一位评论者则指出了 Accept-Language 之类的地区相关请求头。

原则是:请求头、TLS/浏览器配置文件、代理地理位置三者不能互相打架。不要用 Chrome 头却配 Firefox UA。也不要用美国代理,却发送 Accept-Language: de-DE。

CAPTCHA 处理:什么时候该解,什么时候该退避

遇到 CAPTCHA,说明 Amazon 已经起疑心了。即使你把它解掉,信任分数也不会自动重置。

对于偶发、低频的 CAPTCHA:

- 这个 PyPI 包是纯 Python 的 Amazon 文本 CAPTCHA 解决方案,不过它最新版本还是 2023 年 5 月——把它当战术工具,而不是长期方案

- 给 Amazon Captcha 的报价是每 1,000 次解答 0.45 美元

对于反复出现的 CAPTCHA 循环:

- 别继续解了,开始退避

- 反复出现的 CAPTCHA 说明这个会话已经废了——你解题并不能重新建立对指纹、会话历史或 IP 声誉的信任

- 如果 CAPTCHA 集中出现在某个代理子网,问题在网络层,而不是解析器

什么时候真的需要无头浏览器,什么时候又是过度设计

错误的直觉是:所有场景都直接上 Playwright。

适合用浏览器的场景:

- 依赖 JavaScript 渲染或地区状态的搜索结果页

- 会跳转到登录/签到页面的评论流程

- cookie 和浏览器上下文比原始速度更重要的工作流

不适合用浏览器的场景:

- 普通公开商品页

- 只要像浏览器的 HTTP 客户端就足够的静态商品详情提取

- 需要大规模批量抓取、而计算效率很关键的场景

先从能工作的最轻客户端开始。一篇关于大规模抓取的 里提到的演进路径很典型:先用 requests,再用 curl_cffi,只有轻量方案失败后才上完整浏览器。对 Amazon 商品页抓取来说,无头浏览器在速度和资源占用上都明显更重。

Amazon 爬虫 GitHub 项目的反封禁决策矩阵

| 场景 | 推荐方案 | 原因 |

|---|---|---|

| 公开商品页(小规模) | curl_cffi + 粘性住宅会话 | 成本最低,同时还足够像浏览器 |

| 搜索结果页 | 先用 curl_cffi,只有渲染或状态导致 HTTP 失效时才用 Playwright | 搜索页状态更多,也更依赖地区 |

| 评论页(需登录) | 浏览器模式 + 真实 cookies/会话 | 登录和动态评论流程比裸 HTTP 更难模拟 |

| 大规模(每天 5k+) | 托管爬虫 API、解锁服务,或无代码平台 | 只靠 DIY GitHub 代码,最终会变成基础设施问题 |

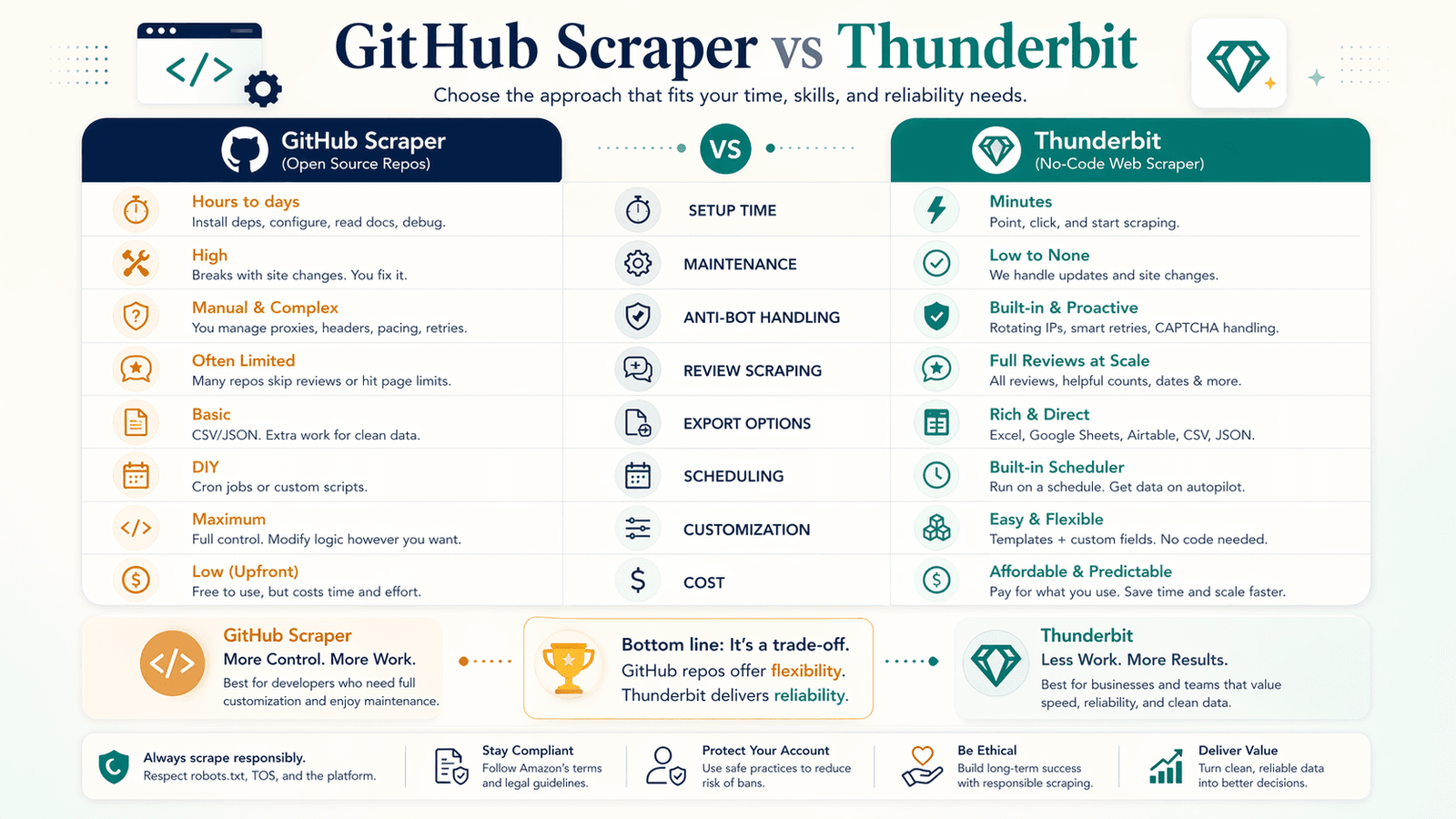

当你的 Amazon 爬虫 GitHub 项目失效时:准备一个无代码备选方案

有经验的爬虫用户都会留一套 Plan B。

Amazon 的更新迟早会在最糟糕的时间点把任何 GitHub 仓库搞坏。对电商团队来说,爬虫一挂,就意味着错过价格变化、竞品数据陈旧,以及仪表盘出现空洞。

很多搜索“amazon scraper github”的人其实是业务用户——电商运营、营销人员、FBA 研究者——他们尝试写代码方案,是因为找不到更好的选择。社区数据也显示,大家对 Amazon 官方的 很不满:访问限制多、数据量有限,而且还有很多卖家无法满足的 。

为什么 GitHub 上的 Amazon 爬虫需要持续维护

上面的审查已经把问题讲得很清楚:

- 过时仓库会堆积失效报告,却没人修

- “还能用”的仓库,现在甚至会在 README 里直接谈反爬措施

- 社区讨论的重点越来越偏向 TLS 指纹、CAPTCHA 循环和代理质量,而不是 CSS 选择器

对业务用户来说,这种维护负担才是真正隐藏的成本。仓库本身是免费的,但你凌晨 2 点花在调试上的时间不是免费的。

Thunderbit 作为实用的 Amazon 爬虫替代方案

提供了一个 ,无需写代码,就能提取标题、价格、ASIN、评分、品牌、库存状态、发货地和原始 URL。

实际使用起来,大概是这样:

- 2 步抓取,不用搭 Python 环境、装依赖、配代理

- 即用型 Amazon 模板——没有 AI 开销,1 次点击即可提取

- 浏览器抓取模式,适用于需要登录的页面(比如让 GitHub 爬虫用户头疼的评论页)

- 云端抓取,可以高速处理公开商品页(一次 50 页)

- 免费导出到 Google Sheets、Airtable、Notion、Excel,不只是 CSV/JSON

- 定时爬虫,持续监控价格变化

- AI 自动适配布局变化——你不用自己维护

GitHub Amazon 爬虫 vs. Thunderbit:诚实对比

诚实地说,取舍很清楚:GitHub 仓库可定制性更强;Thunderbit 更稳定。如果你的团队更在乎稳定运行而不是灵活度,无代码方案通常更合理。

Amazon 定时与周期性抓取的最佳实践

大多数 amazon scraper github 项目都是为一次性运行设计的,但真实业务场景——价格监控、库存跟踪、竞品分析——需要反复抓取。GitHub 仓库几乎从不原生支持调度,用户只能自己拼接 cron、Airflow 或 n8n 工作流。

GitHub Amazon 爬虫的 DIY 调度

一个最低可用的周期任务方案应该包括:

- 在 Linux 或 macOS 上用 cron 任务 按计划运行脚本

- 使用只追加日志,方便事后排查失败原因

- 按 ASIN + 时间戳 去重,避免存重复数据

- 设置失败告警(哪怕只是非零退出时发一封邮件),这样凌晨 3 点任务挂掉时你能知道

更复杂的团队可以考虑:

- n8n:轻量工作流自动化(社区讨论里经常提到)

- Airflow:更重型的定时流水线

- 数据库驱动状态管理:如果你需要差异对比和历史记录

关键最佳实践不是调度器本身,而是状态管理。要跟踪上一次成功运行、上一批 ASIN、变更价格和失败 URL。

用 Thunderbit 让调度更简单

Thunderbit 的 让你可以用自然语言描述间隔、输入 URL,然后点击“安排”。AI 会把自然语言转换成 cron 调度——无需任何技术配置。对于不做工程的电商团队来说,这会大幅减少运营负担。

周期性 Amazon 抓取的最佳实践

不管你用什么工具,这些原则都适用:

- 按 ASIN + 时间窗口 去重——每次运行不要把同一个商品存两次

- 把价格存成数字,不要存原始字符串——后续清洗更轻松

- 给每一行都加上抓取时间戳——做趋势分析时会用到

- 记录变化量,不只是当前状态——“价格比上周跌了 12%”比“价格是 24.99 美元”更有用

- 关注有意义的变化——竞品降价 15% 值得提醒;0.5% 的波动只是噪音

- 想好数据存储方式——小规模可用平面文件;每天 5k+ ASIN 时,考虑数据库或云表格

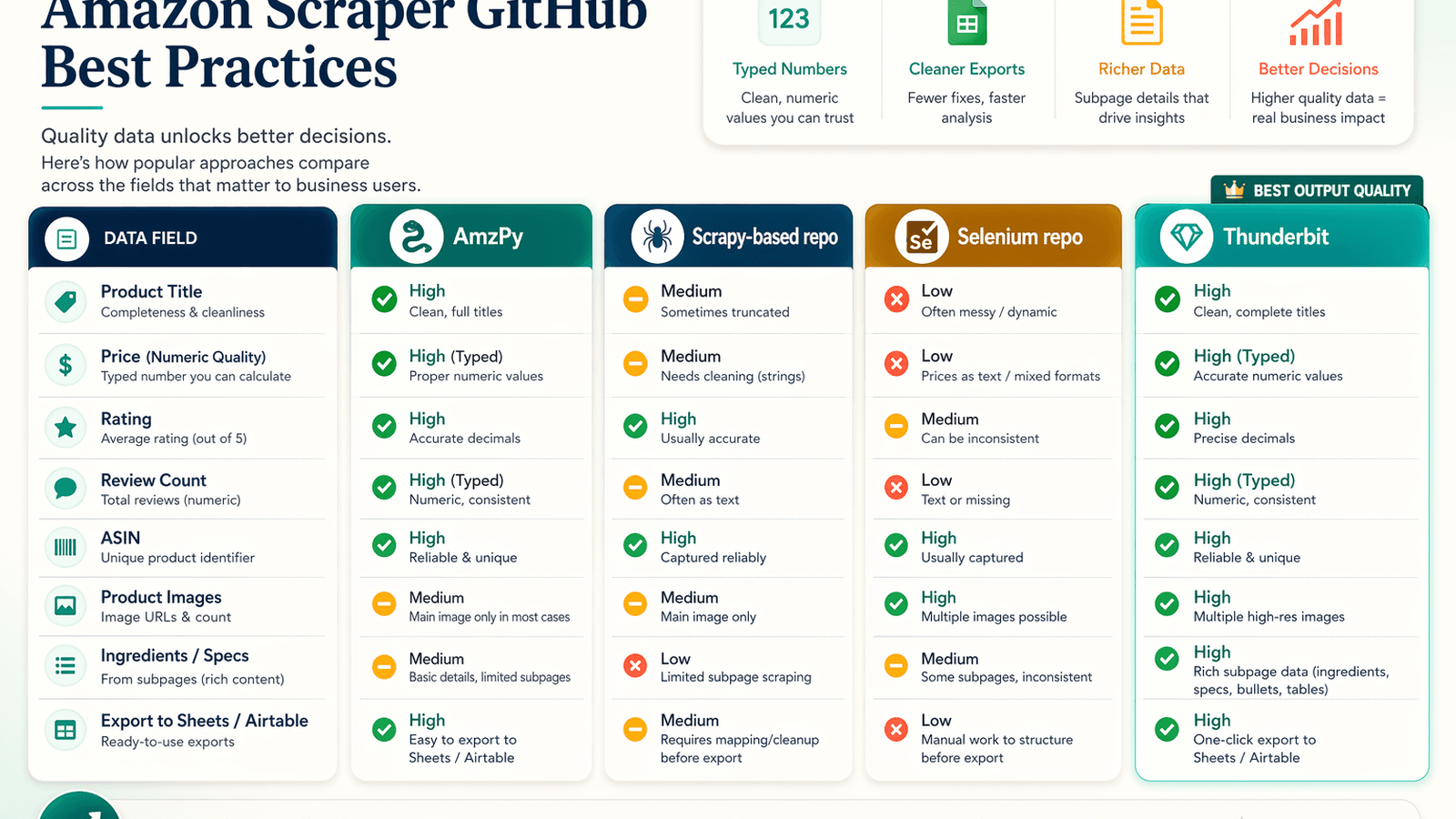

横向对比输出质量:不同 Amazon 爬虫 GitHub 方案到底返回什么

几乎没人真正横向比较各个 amazon scraper github 仓库的输出质量。用户非常在意数据质量——“哪个工具给的数据最干净、最完整”——但往往只能自己逐个克隆测试。这个部分就是来补这个空白的。

常见 GitHub 仓库实际提取了什么,又漏了什么

基于 README 示例、公开样例和文档化输出格式:

This paragraph contains content that cannot be parsed and has been skipped.

输出质量对比表

This paragraph contains content that cannot be parsed and has been skipped.

为什么数据格式对业务用户很重要

脏数据会制造隐性劳动。即使爬虫成功了,如果出现以下情况,它在运营上也可能算失败:

- 价格是带货币符号的字符串,而不是干净的数字

- 缺失值格式不统一(空字符串、null、还是“NA”)

- 图片只有低分辨率缩略图

- 评论字段或规格字段需要后处理才能分析

对电商运营团队来说,干净的数据会直接影响分析速度和决策效率。Thunderbit 的 AI 会按类型格式化数据——数字就是数字,日期就是日期,URL 就是 URL——所以拿到手就能直接用。GitHub 仓库在这方面差异很大,清洗时间会很快累积起来。

快速参考:Amazon 爬虫 GitHub 最佳实践清单

- 克隆前先看最后提交时间。 超过 6 个月,在 Amazon 场景里就是强警告。

- 先搜 issue,找“captcha”“503”“blocked”“not working”,再开始搭建。

- 优先使用

curl_cffi或其他能模拟浏览器的 HTTP 客户端,而不是原生requests。 - 保持请求头、TLS 配置、语言和代理地理位置一致——不要互相矛盾。

- 浏览流程用粘性会话;不要每个请求都盲目轮换。

- 加入随机节奏 和指数退避。

- 把反复出现的 CAPTCHA 视为会话已废,而不是硬解谜题。

- 只有在 HTTP 客户端无法稳定复现页面时,才使用无头浏览器。

- 保存检查点和状态,这样失败后才能安全续跑。

- 准备备选方案——无论是托管 API,还是像 这样的无代码工具。

2026 年 Amazon 抓取的法律与伦理注意事项

有几件事值得简要说明。

Amazon 的态度是限制性的,而且越来越严格。最强烈的信号包括:

- Amazon 自己的帮助页面现在会返回一个 ,写着:“如需讨论对 Amazon 数据的自动化访问,请联系 api-services-support@amazon.com。”

- Amazon 的 禁止了大量动态页、评论页、个人资料页、愿望清单页和商品列表页路径。

- Amazon 在 中,明确反对隐蔽或伪装的代理访问、规避安全措施,以及把代理伪装成 Google Chrome。Amazon 也就此 。

- Amazon 在 2025 年末 。

当你从公开商品页转向需要认证的流程、伪装自动化或大规模商业抓取时,实际风险会明显升高。这不是法律意见——你应就自己的具体情况咨询法律团队。

核心结论:如何拿到可靠的 Amazon 数据,同时避免被封

按重要性排序:

- 先审查,再克隆。 假设大多数 GitHub 结果都已经过时,或者只是教程、商业 API 的封装层。

- 先升级网络层。 TLS 指纹识别和会话一致性,比 HTML 选择器更重要。

- 用粘性的住宅会话,不要随机乱轮换代理。 在会话之间轮换,不要在会话内部乱换。

- 把请求节奏做得像真人,而不是压力测试。 随机延迟和指数退避是必须项。

- 孤立 CAPTCHA 可以解;反复被挑战的会话就该放弃。 不要硬刚一个已经废掉的指纹。

- 准备备选方案。 Amazon 可能会在周中改点东西,你的 GitHub 爬虫就会坏掉。像 这样的维护型无代码工具,或者托管 API,可以在你排查问题时先把数据管道撑住。

- 优先关注输出质量。 干净、类型明确的数据,比速度快但脏乱的爬虫更能节省下游时间。

如果你更看重稳定性,而不是可定制性,Thunderbit 提供了一个维护完善的替代方案——可以看看 ,或者在 观看教程。想要完全控制流程的开发者当然也可以使用 GitHub 仓库——但前提是要遵循本文讲到的反封禁和维护实践。

常见问题

用 GitHub 爬虫抓 Amazon 商品数据合法吗?

Amazon 的服务条款限制自动化数据采集,而且 Amazon 已经通过停止侵权函和技术对抗手段积极执行这些限制(尤其是在 2025–2026 年)。抓取公开可访问的商品数据处于灰色地带;抓取登录后数据,或者把机器人伪装成真实浏览器,风险更高。这不是法律意见——请针对你的具体场景咨询法务团队。

Amazon 爬虫 GitHub 仓库多久会坏一次?

很频繁。Amazon 会定期改页面布局、增加新的反爬层、废弃旧接口。按本文审查结果,广泛可见的 8 个仓库里,到了 2026 年只有大约 3 个还能明确正常工作。即使是“还能用”的仓库,issue 里也常常有关于 CAPTCHA 和 503 错误的报告。你要做好每隔几周到几个月就得排查或更新一次的准备。

2026 年 GitHub 上最好的 Amazon 爬虫是什么?

没有唯一答案——这取决于你的场景和技术熟练度。如果你想要轻量、直接的 Python 爬虫, 是较新的选择之一。如果你想通过托管 API 获得更广覆盖, 可以用,但它并不是真正的 DIY。建议先用本文的“新鲜度检查清单”自己评估,再决定要不要投入。

Thunderbit 能不写代码抓 Amazon 吗?

可以。Thunderbit 的 只需点击一次,就能提取商品标题、价格、ASIN、评分、品牌、库存状态等信息。它支持需要登录页面的浏览器抓取模式、公开页面的云端高速抓取、定时抓取,以及免费导出到 Google Sheets、Airtable、Notion 和 Excel。你可以先安装 开始使用。

抓取 Amazon 时,怎样避免 IP 被封?

要用分层策略:(1)把原生 requests 换成像 curl_cffi 这种支持 TLS 模拟的客户端;(2)使用带粘性会话的住宅代理,而不是随机轮换数据中心代理;(3)加入随机节奏和指数退避;(4)让完整请求头与浏览器配置文件和市场地区保持一致;(5)把反复出现的 CAPTCHA 视为会话该退场的信号,而不是无限解题。更多细节可以看本文前面的反封禁决策矩阵。