每一款 AI 网页爬虫在产品演示里看起来都很惊艳。可一旦你把它丢到一个真正启用了 Cloudflare 防护的网站上,它就会返回一道验证页,还一本正经地告诉你它找到了 47 条商品列表。

过去几个月里,我一直在为 Thunderbit 团队评估各种爬虫工具。我看到社区里最常见的挫败感,始终来自演示效果和生产稳定性之间的巨大落差。一位 Reddit 用户把这点总结得很到位: 仅在网页爬虫这个类别里,,再加上几十种 Chrome 扩展、API 服务商和 actor 市场,选择悖论真的存在。所以我测试了其中 12 款。

这篇文章会从生产环境标准来评估 12 款 AI 网页爬虫工具:反爬处理、可扩展性、结构化输出质量、成本效率、对动态网站的支持,以及开发者灵活性。不看功能清单,不看营销截图,只看演示结束后到底什么能真正跑起来。

为什么大多数 AI 网页爬虫一过演示就失效

这个套路非常固定。工具官网会展示它从一个简单的商品列表页里干净地抓出几列数据。你装上后拿去测一个有防护的电商站,结果通常只会得到下面这些情况之一:

- 返回一个包含 Cloudflare 验证页的

200 OK响应,而不是实际数据 - 前 5 页结果都正常,之后就悄无声息地失败,或者开始乱编行数据

- 今天提取完全正确,网站下周做了个小改版,选择器就全坏了

这不是边缘案例,这就是常态。

正如一位从业者在 :“爬虫返回 200,但内容是 Cloudflare 验证页,你的代理去分析它,然后开始胡编,你甚至都不知道为什么。”

根本问题在于架构。大多数演示展示的是在干净公开页面上的解析层,而真正出问题的往往是抓取层。生产环境的网站会加入反机器人防护、动态渲染、嵌套详情页、无限滚动、登录状态、地区差异和不断变化的页面结构。

一款工具在产品演示里看起来再好,也可能在第一个真正的客户流程里直接崩掉。

所以这篇文章不是按功能清单评估,而是按生产可用性来判断每款工具。我使用的六个标准是:

| 标准 | 重要原因 |

|---|---|

| 反爬/CAPTCHA 处理 | 受保护的网站在提取质量之前就可能先卡死 |

| 超越演示后的可扩展性 | 批量任务和并发运行会暴露真实的运行上限 |

| 结构化输出质量 | 用户需要的是干净的 JSON/CSV,而不是还得手动清洗的原始 HTML |

| Token/成本效率 | AI 提取的成本可能比爬取本身还高 |

| 对动态/重 JS 网站的支持 | 现代页面需要渲染后的 DOM,而不是静态 HTML |

| 无代码与 API 的灵活性 | 销售团队和数据工程师的需求并不一样 |

如果你想先快速了解过去两年网页爬取市场发生了什么变化,在一个个对比工具之前,Browserless 的这场分享很适合作为背景铺垫。

AI 在爬取流程里到底帮得上什么,哪些地方帮不上

这个市场里一直有个误解:所谓“AI 网页爬虫”就是 AI 从头到尾包办一切。社区里的共识其实非常清晰:。有位用户说得很直白:“你用 AI 去读网页截图,不是用 AI 去写爬虫本身。”

爬取流程有三个不同层级,AI 在每一层的价值差异很大:

爬取与获取:基础设施层

这一层负责真正发出请求:代理、无头浏览器、会话管理、验证码处理、重试。AI 在这里几乎帮不上什么实质性忙。你仍然需要代理池、浏览器指纹和解封基础设施。生产环境里,大多数工具最先失败的地方就是这里。

解析与提取:AI 最擅长的部分

一旦你拿到了干净的页面内容,AI 就非常适合把非结构化 HTML 转成结构化字段。基于 schema 的提取、自适应字段识别,以及不用脆弱的 XPath 选择器去硬扛页面布局变化,这些都是 AI 在爬虫场景里的强项。

后处理:标注、翻译、分类

提取完成后,AI 可以继续帮你对商品分类、翻译文本、规范化电话号码,或者总结描述。这个场景很适合 AI,但前提是提取出来的数据本身就是对的。

下面是这 12 款工具在这些层级上的分布:

| 工具 | 爬取/获取 | 解析/提取 | 后处理 | 最佳描述 |

|---|---|---|---|---|

| Thunderbit | 强 | 强 | 强 | 全栈无代码 AI 爬虫 |

| Octoparse | 强 | 中 | 低 | 基于规则的可视化爬虫,配云端基础设施 |

| Browse AI | 中 | 中 | 中 | 以监控为主的云端机器人平台 |

| Firecrawl | 中 | 强 | 低-中 | 面向开发者的提取 API |

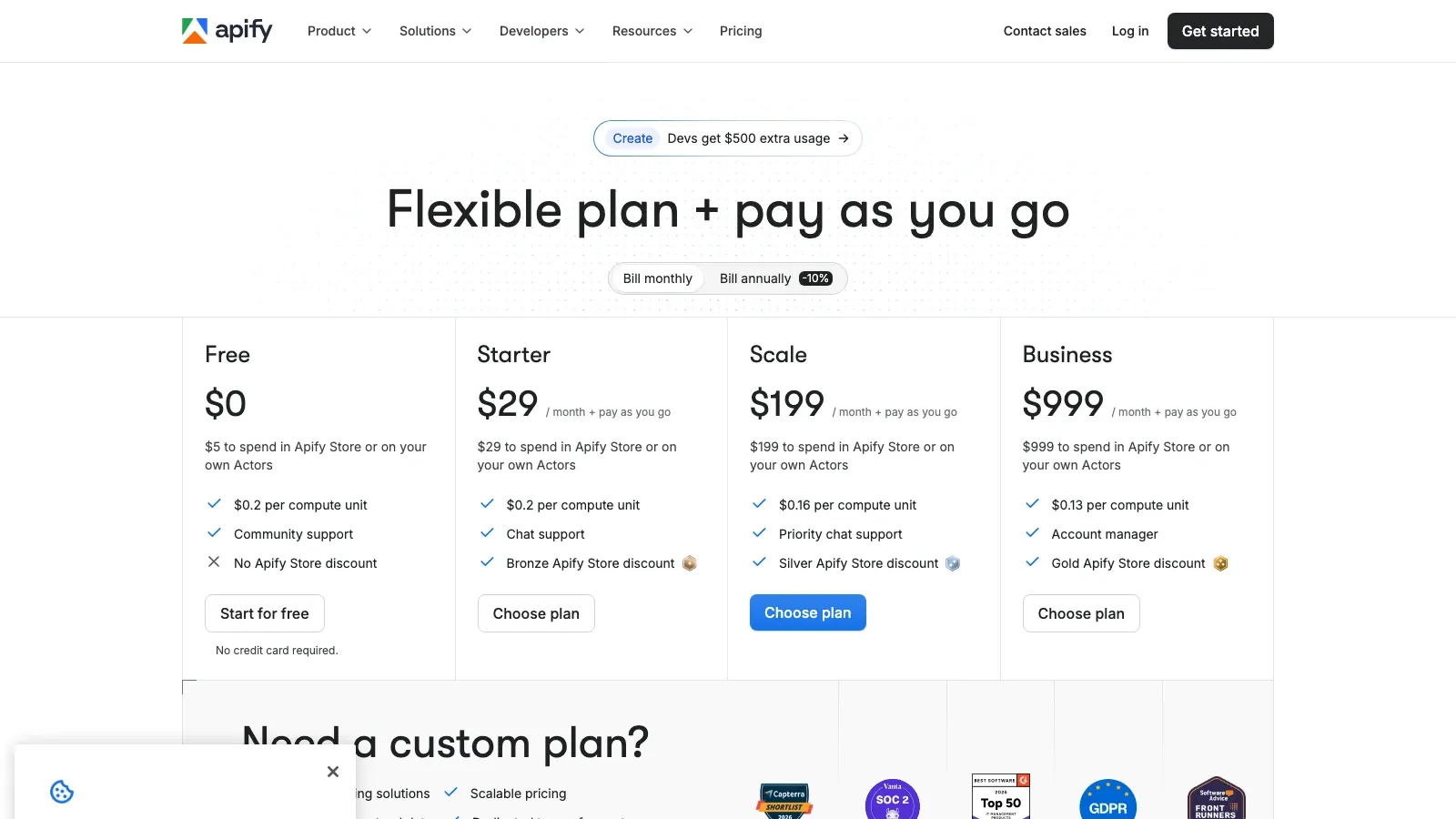

| Apify | 强 | 中-强 | 中 | actor 市场与编排平台 |

| Gumloop | 中 | 中 | 强 | 带爬虫节点的工作流自动化 |

| Bright Data | 很强 | 中 | 低-中 | 企业级基础设施栈 |

| Bardeen | 中 | 中 | 强 | 面向 GTM 工作流的浏览器自动化 |

| Diffbot | 低-中 | 很强 | 中 | 预训练提取 + 知识图谱 |

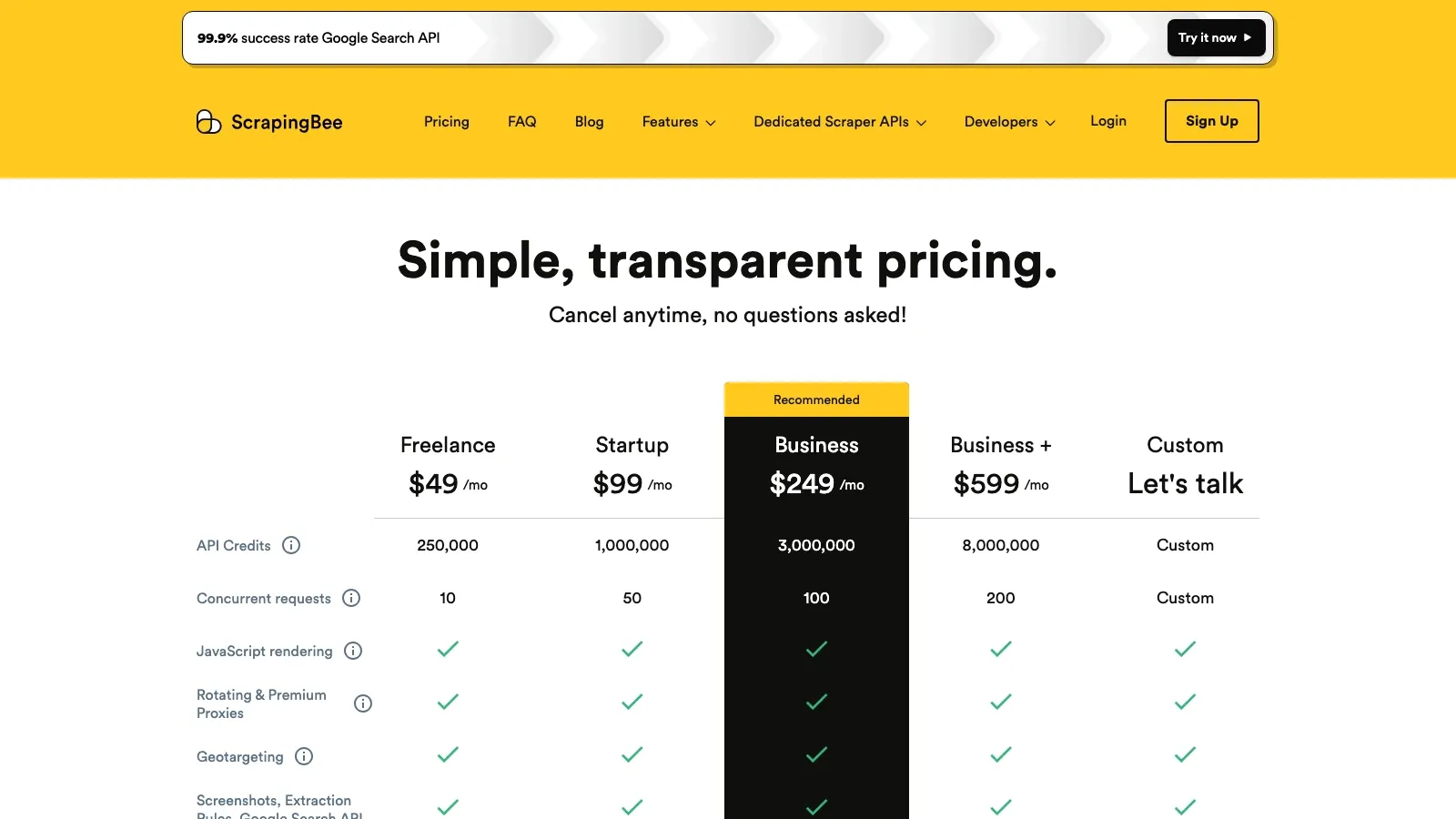

| ScrapingBee | 强 | 低-中 | 低 | 获取与解封 API |

| Instant Data Scraper | 低 | 中(简单页面) | 低 | 基于启发式规则的浏览器侧快速爬虫 |

| ParseHub | 中 | 中 | 低 | 适合复杂交互的桌面可视化爬虫 |

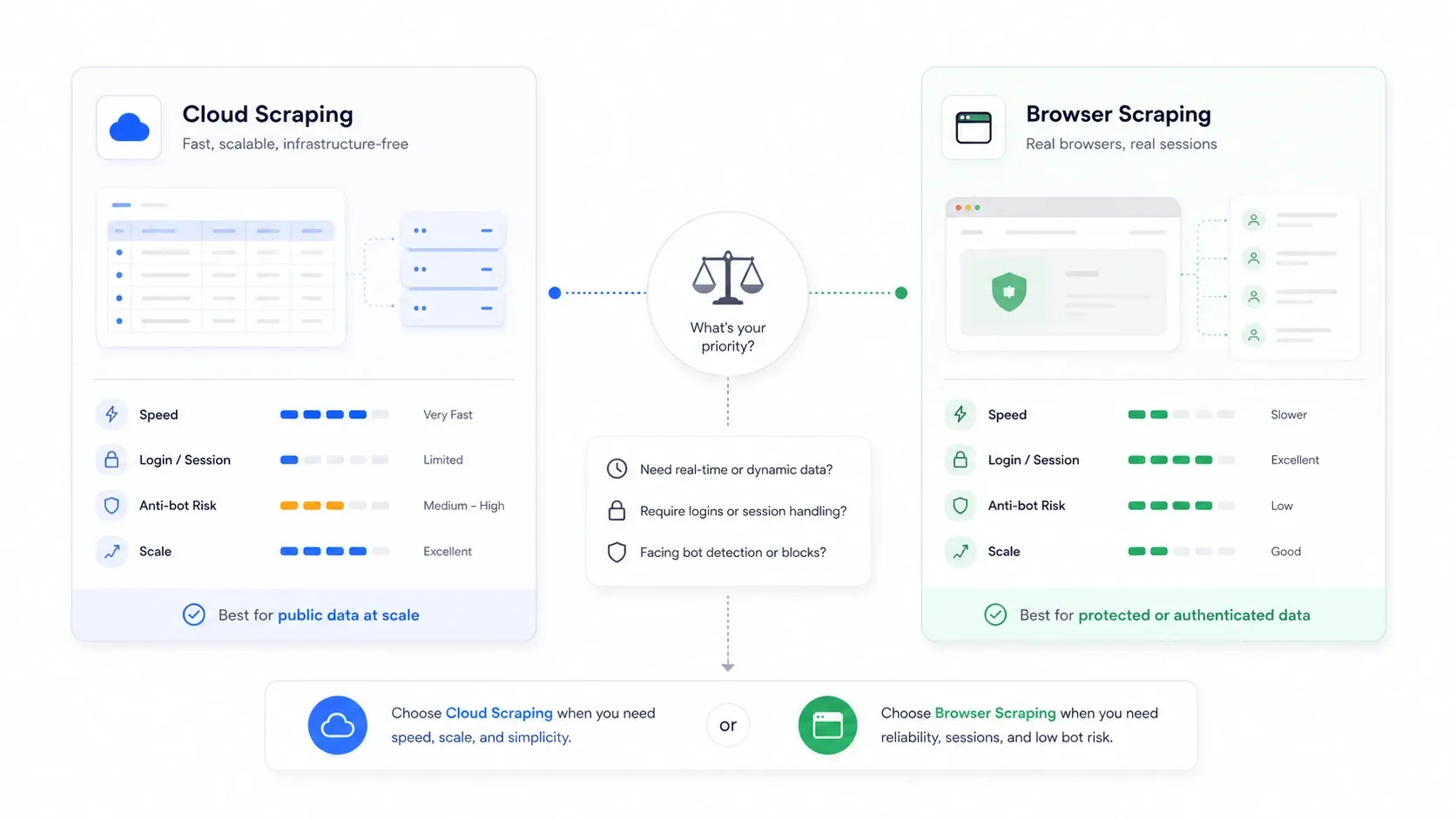

云端爬取 vs 浏览器爬取:没人讲清楚的那个选择

这是一项大多数综述文章都会完全忽略的架构决策,但它往往比你选哪款工具更重要。

云端爬取指的是由远程服务器替你抓取网页。浏览器爬取指的是在你自己的浏览器会话里完成提取,使用的是你的 Cookie、你的 IP 和你的登录状态。

| 场景 | 更适合的模式 | 原因 |

|---|---|---|

| 面向大量公开电商和列表页 | 云端 | 并发更快,也不会受本地机器限制 |

| 需要登录或身份验证的网站 | 浏览器 | 可复用你真实的会话 Cookie |

| 对数据中心 IP 很敏感的网站 | 浏览器 | 更像正常用户流量 |

| 大型、持续性的监控任务 | 云端 | 更容易调度,也更稳定 |

| 一次性、脆弱、对反爬敏感的任务 | 浏览器 | 更容易查看网站实际渲染出来的内容 |

这在经济层面上也很重要。Apify 的 2026 年网页爬取状态报告发现,,而且有 表示基础设施支出更高了。反爬不只是技术问题,还是预算问题。

大多数工具只提供一种模式。下面是具体情况:

| 工具 | 云端 | 浏览器 | 两者都有 |

|---|---|---|---|

| Thunderbit | ✅ | ✅ | ✅ |

| Octoparse | ✅ | ✅(本地) | ✅ |

| Browse AI | ✅ | 仅设置 | — |

| Firecrawl | ✅ | 交互式 API | — |

| Apify | ✅ | ✅(通过 actors) | ✅ |

| Gumloop | ✅ | ✅(Web Agent) | ✅ |

| Bright Data | ✅ | ✅ | ✅ |

| Bardeen | 有限(公开页面) | ✅ | 部分 |

| Diffbot | ✅ | — | — |

| ScrapingBee | ✅ | — | — |

| Instant Data Scraper | — | ✅ | — |

| ParseHub | ✅(付费) | ✅(桌面端) | ✅ |

12 款 AI 网页爬虫一览

下面是这 12 款工具的总对比:

| 工具 | 最适合 | 免费档 | 云端/浏览器 | API 访问 | 定时爬取 | 反爬处理 |

|---|---|---|---|---|---|---|

| Thunderbit | 非技术团队 | ✅(6 页) | 两者都有 | ✅ | ✅ | 强 |

| Octoparse | 重模板型爬取 | ✅(有限) | 两者都有 | ✅ | ✅ | 中-强 |

| Browse AI | 监控变化 | ✅(有限) | 主要是云端 | ✅ | ✅ | 中 |

| Firecrawl | 开发者提取流水线 | ✅(每月 1,000 credits) | 云端 + 浏览器 API | ✅ | 否 | 中 |

| Apify | 开发团队 + 市场生态 | ✅($5 免费额度) | 两者都有 | ✅ | ✅ | 强(配插件) |

| Gumloop | 工作流自动化 | ✅(每月 5,000 credits) | 两者都有 | ✅ | ✅ | 中 |

| Bright Data | 企业数据访问 | 试用 / credits | 两者都有 | ✅ | 外部 | 很强 |

| Bardeen | 销售与运营浏览器自动化 | ✅(100 credits) | 以浏览器为主 | 有限 | ✅ | 中-低 |

| Diffbot | 结构化提取 API | ✅(10,000 credits) | 云端 | ✅ | 否 | 获取层低 / 提取层高 |

| ScrapingBee | 面向开发者的获取与解封 | ✅(1,000 credits) | 云端 | ✅ | 否 | 强 |

| Instant Data Scraper | 免费的一次性爬取 | ✅(完全免费) | 仅浏览器 | 否 | 否 | 低 |

| ParseHub | 复杂可视化流程 | ✅(5 个项目) | 桌面端 + 云端 | ✅ | ✅(付费) | 中 |

1. Thunderbit

是我们专门为非技术团队打造的 AI 网页爬虫,目标是让你不用写代码、也不用管理基础设施,就能拿到生产级数据。核心流程真的只要两步:AI Suggest Fields 先读取页面并建议字段,然后 Scrape 在云端或浏览器模式下执行提取。

它和其他无代码爬虫不同的地方在架构。Thunderbit 把云端基础设施、代理轮换、反爬处理、JavaScript 渲染这些抓取层问题,与负责读取 HTML 并输出结构化列的 AI 提取层分开。这正好符合专家推荐的“先爬虫,后 LLM”模式,只是它被打包进了一个 Chrome 扩展工作流,销售人员和运营经理都能直接用。

主要优势

- 同一个界面同时支持云端和浏览器爬取。 你可以根据目标网站是公开页面还是需要登录会话,在两种模式间切换。云端模式可并行处理最多 50 页。

- AI 每次都会重新读取页面结构。 不需要维护 XPath。网站一旦改版,Thunderbit 在下一次运行时会自动适配。

- 子页面爬取。 AI 会访问链接的详情页,并在不需要手动配置的情况下丰富主数据表。

- 字段 AI 提示词。 在提取过程中就能做自定义标注、翻译和分类,而不是提取后再单独处理。

- 免费导出 到 Google Sheets、Excel、Airtable 和 Notion。

- 即用型爬虫模板,适用于 Amazon、Zillow 和 LinkedIn 等热门网站。

- 自然语言定时。 你只要说“每周一上午 9 点抓取”,它就会自动转换成周期任务。

- 开放 API,提供 Distill 和 Extract 端点,支持最多 100 个 URL 的批处理,并公开了并发上限:免费版 2,Pro 1 为 50。

还可以改进的地方

- 免费档刻意设计得比较小。

- 无代码体验主要围绕 Chrome 扩展展开。想做纯 API 工作流的开发者需要单独使用 Open API。

- 如果你主要需要的是原始代理基础设施,而不是提取能力,它就不是最合适的工具。

定价

提供免费档。无代码方案起价为按年计费 $9/月,或按月计费 $15/月 的 Starter。API 定价另算:一次性免费 600 units,之后 Starter API 为按年计费 $16/月,Pro 1 API 为按年计费 $40/月。详见 和 。

适合: 需要结构化网页数据、但不想依赖工程团队的销售、电商和运营团队。

2. Octoparse

是一款可视化网页爬取工作流构建器,内置大量预制模板。它已经存在足够久,云端基础设施比较成熟,在结构化、可预测的网站上分页处理得很好。

主要优势

- 针对热门网站的丰富预制爬取模板

- 支持云端提取与定时运行

- 付费附加功能包括 IP 轮换和 CAPTCHA 处理

- 高阶套餐支持 API 访问

还可以改进的地方

- AI 能力比原生 LLM 工具弱。字段建议仍然更多依赖模板,而不是自适应读取。

- 复杂或不常见的页面布局,需要在可视化编辑器里大量手动调整。

- 一旦你需要条件逻辑或绕过封禁的方案,学习曲线会明显变陡。

定价

提供永久免费方案。官方帮助中心目前显示,按年计费的 Standard 起价约 $75/月,Professional 起价约 $208/月;不过某些本地化页面和升级路径显示的月费等价更高。关键点是,Octoparse 现在的定价混合了订阅档位和额外付费功能,例如住宅代理和 CAPTCHA 处理。

适合: 需要在中等规模下爬取结构化、模板友好型网站的分析师和运营团队。

3. Browse AI

是一个基于云的无代码平台,主要用于长期监控网站变化,例如竞品价格、库存可用性和内容更新。爬取只是产品的一部分,真正的差异点在于它的周期监控和告警系统。

主要优势

- 内置变化检测和告警

- 点选式无代码机器人录制器

- 针对热门网站的预制机器人

- 高阶套餐支持高级代理

还可以改进的地方

- 按 credit 计费,在大规模监控详情页时成本会涨得很快

- 对于大批量一次性提取,不如 API 优先型工具有吸引力

- 反爬能力中等;有些网站仍然需要高级代理或其他绕过方案

定价

提供免费账户。付费方案起价约 $19/月按年计费 的 Starter,更高的 credit 和监控等级在其上。

适合: 需要持续监控竞品价格、内容变化或库存状态,而不是一次性批量提取的团队。

4. Firecrawl

是一款面向开发者的 API,可以把网页转换成干净的 Markdown 或结构化 JSON。它主要位于提取层,非常适合构建 RAG 流水线,或者把网页内容喂给 LLM 的团队。

主要优势

- Markdown 输出质量很高,适合下游 LLM 工作流

- API 干净,支持 scrape、crawl、map、search、extract 和 browser actions

- 支持批处理

- 并发从免费版的 2 到 Growth 的 100 不等

还可以改进的地方

- 没有无代码界面,需要开发技能

- 虽然内置代理和反爬支持,但定位并不像专门的解封服务商

- 没有原生定时器来处理周期任务

- 对只想要一个数据表的非开发者来说,不够划算

定价

免费方案包含 每月 1,000 credits。付费方案按年计费,Hobby 起价 $16/月,并随着 credits、并发和浏览器使用量提升而升级。浏览器会话会单独按 credits 计费。

适合: 构建 LLM 流水线、RAG 系统或自定义提取工作流的开发者,他们需要从网页中拿到干净的 Markdown 或 JSON。

5. Apify

是一个带有预制爬取 actor 市场的平台,也支持你自己构建定制 actor。你可以把它理解成一个编排层:先为特定网站挑选或搭建专用爬虫,再通过统一 API 去调度和管理它们。

主要优势

- 巨大的 actor 市场,社区为数百个网站构建了爬虫

- 对开发者来说,API 和 SDK 都很强

- 内置代理管理和调度

- 可与很多下游工具集成

还可以改进的地方

- 一旦离开市场、需要写自定义逻辑,“无代码”就只是部分成立

- actor 的稳定性取决于社区维护

- 成本可能叠加得很快,因为计算、actor 费用和代理费用都会算进去

定价

免费档包含 每月 $5 的平台 credits。付费方案起价 $39/月 的 Starter,更高的层级面向规模化使用。

适合: 想要可复用、可调度的爬取工作流,并且依赖庞大预制生态的开发团队。

6. Gumloop

是一个无代码工作流自动化平台,内置网页爬取节点。它的真正价值不只在爬取本身,而在于把提取结果和 LLM、Google Sheets、CRM 以及其他工具连到同一个可视化画布里。

主要优势

- 可视化拖拽式工作流构建器

- 把爬取与 LLM 以及下游业务工具整合在一条流程里

- 目前公开宣传的免费方案是 每月 5,000 credits

- 支持按时间调度周期性工作流

- 基础爬取和交互式 Web Agent 模式,覆盖简单和更丰富的流程

还可以改进的地方

- 爬虫引擎不如专门的 AI 网页爬虫工具稳健

- 和专业厂商相比,反爬与代理深度都有限

- 免费档的并发和触发限制更紧

- 不适合作为大规模、高流量爬取的核心用途

定价

提供免费方案。Gumloop 在 2025 年末把原来的 Solo 和 Team 结构合并成了 Pro 方案,从那以后公开宣传更多聚焦在更慷慨的免费 credits 和合并后的付费层级,而不是以爬取为中心的定价。

适合: 想把爬取作为更大自动化流程中的一个步骤:抓取、分析,再推送到业务工具的团队。

如果你想在继续看后面的列表之前,先感受一下 AI 原生提取工作流在实际中的样子,下面这个 Thunderbit 演示最适合非技术团队。

7. Bright Data

是这份名单里企业级别最强的基础设施栈。如果你的问题是“无论怎么试都过不了这个网站的机器人防护”,Bright Data 大概率就是答案,不过它也伴随着相应的企业复杂度和价格。

主要优势

- 覆盖住宅、数据中心和移动 IP 的行业领先代理网络

- Web Unlocker,可用于绕过反爬和 CAPTCHA

- 内置解封能力的 Scraping Browser

- 可购买预采集数据集

- 通过 API 和 SDK 获得完整的程序化控制

还可以改进的地方

- 并非为非技术用户设计

- 定价体现了企业定位

- AI 提取不是购买这个平台的主要原因

定价

Browser API 起价 $8/GB 按量付费,更大的月承诺会有更低的单 GB 价格。Bright Data 的其他产品,比如 Unlocker、Scraper API、数据集和代理池,使用不同的计费单位。

适合: 需要大规模爬取高防护网站,并且有技术团队管理基础设施的企业数据团队。

8. Bardeen

是一款浏览器自动化工具,重点在点击、填写表单和抓取,同时叠加了 AI 数据提取。更准确地说,它更像是一款 GTM 工作流工具,顺带能爬取数据,而不是一款顺带做 GTM 的爬虫工具。

主要优势

- 直观的 playbook 风格自动化,把爬取作为其中一步

- Bardeen 团队为热门网站维护官方爬虫

- 与 CRM、Google Sheets、Slack 和其他业务工具集成度高

- 适合线索抓取、数据补全和导出到 CRM 的流程

还可以改进的地方

- 以浏览器为先的架构限制了高流量无人值守爬取

- 云端爬取只适用于公开页面,不适用于受限页面

- 反爬处理大多取决于你当前浏览器会话本身能提供什么

- AI 提取在复杂或非标准页面布局上会吃力

定价

免费方案包含 每月 100 credits。公开支持文档提到老用户仍可使用历史上的 $15/月 Pro 定价,而当前 Bardeen 的商业包装更偏企业和工作流,而不是传统低价爬虫定价。

适合: 需要把爬取作为更大浏览器自动化工作流一部分的销售和运营团队。

9. Diffbot

使用计算机视觉和 NLP 像人一样读取网页,输出文章、商品、讨论和组织的结构化数据。如果你的页面类型符合它的预训练模型,它是可用的高质量提取 API 之一。

主要优势

- 面向文章、商品、讨论等内容的预训练提取模型

- 知识图谱包含数十亿实体,可用于数据补全

- 在受支持的页面类型上,结构化输出质量很高

- 开发者 API 清晰,并公开了速率限制

还可以改进的地方

- 没有无代码界面

- 没有内置爬取、代理管理或反爬处理

- 对小团队来说价格偏高

- 对非标准页面类型的灵活性不如 schema 提示词型提取器

定价

免费方案包含 10,000 credits。Startup 方案为 $299/月,包含 250,000 credits;Plus 方案为 $899/月,包含 1,000,000 credits。

适合: 需要从标准页面类型中高精度提取结构化数据,并愿意把获取层单独处理的开发团队。

10. ScrapingBee

是一款专注于获取层和解封层的网页爬取 API。你把 URL 发给它,它负责代理、无头浏览器渲染和反爬防护,然后返回 HTML,或者在可选情况下返回提取后的数据。

主要优势

- 内置代理轮换和反爬处理

- 支持 JavaScript 渲染

- 简单的 REST API

- 提供 Google Search 爬取端点

- 按套餐公开并发上限

还可以改进的地方

- AI 提取功能有限

- 没有无代码界面

- 没有内置调度或监控

- 返回

200也可能只是成功拿到了一个被拦截页面

定价

免费方案包含 1,000 API credits。付费方案起价 $49/月,并随并发和请求量提升。

适合: 主要需要稳定穿过反爬防护去获取页面,并打算用自己的代码或其他工具完成提取的开发者。

11. Instant Data Scraper

是一款免费 Chrome 扩展,用户超过 1,000,000,它会自动识别页面上的数据模式,并允许你导出为 CSV 或 Excel。它没有 LLM 意义上的 AI 字段建议,而是使用启发式模式检测。

主要优势

- 完全免费,无需账号

- 在很多列表页和表格页上可一键检测数据

- 对部分网站支持分页处理

- 上手门槛极低

- 仍在维护,2026 年也有 Chrome Web Store 更新

还可以改进的地方

- 没有 AI 驱动的字段建议或数据标注

- 不支持云端爬取、调度或 API

- 对复杂布局、动态内容和重 JS 网站支持较弱

- 除了浏览器本身能加载的内容之外,没有额外的反爬处理

- 仅支持导出 CSV 和 Excel

定价

免费。永久免费。

适合: 任何只需要快速、一次性抓取一个简单列表页,而且不想注册账号或付任何费用的人。

12. ParseHub

是一款桌面应用,提供可视化、点选式界面来构建爬取项目。它可以处理复杂的嵌套数据、AJAX 加载内容、无限滚动和下拉交互,这些往往是更简单的扩展做不到的。

主要优势

- 用可视化选择器定义提取规则

- 支持嵌套数据、下拉菜单、无限滚动和 AJAX 内容

- 免费档最多可创建 5 个项目

- 可导出为 JSON、CSV 和 Excel

- 付费方案支持云端调度和 IP 轮换

还可以改进的地方

- 只能在桌面端使用,没有浏览器扩展那种便利

- 执行速度比云原生工具更慢

- 因为没有 AI 重新读取层,网站布局一变,项目就容易失效

- AI 能力有限,整体还是更像传统可视化爬虫

定价

提供免费方案,包含 5 个项目 和 每次运行 200 页。付费方案起价 $189/月,提供调度、IP 轮换和更高上限。

适合: 需要爬取复杂交互网站、且愿意投入时间搭建可视化流程的非技术用户。

如何在 5 步内开始使用 AI 网页爬虫

这份名单里的每款工具,上手流程都不一样。我会用 Thunderbit 作为具体示例,因为它最符合“我只是想让它在真实页面上跑起来”的搜索意图。

第 1 步:安装并进入目标页面

安装 ,然后打开你想爬取的页面:商品列表、目录页,或者房产门户。

第 2 步:让 AI 建议数据字段

点击 AI Suggest Fields。AI 会读取当前页面并提出列名和数据类型建议。比如在商品页上,它可能会建议商品名称、价格、评分、图片 URL 和描述。

第 3 步:用 AI 提示词自定义字段

如果默认字段不完全合适,就调整一下列。给字段添加 AI 提示词,做自定义转换,例如“把描述翻译成西班牙语”、“分类为电子产品、家居或时尚”,或者“只提取数字价格”。

第 4 步:选择云端或浏览器模式并开始爬取

如果是公开网站,就选云端爬取;如果需要登录,或者目标站点防护很强,就选浏览器爬取。然后点击 Scrape。

第 5 步:把数据导出到任何地方

把结果导出到 Google Sheets、Excel、Airtable 或 Notion。导出是免费的。

如果网站布局变了怎么办?

这正是 AI 原生提取器相对基于规则工具的关键生产优势。像 ParseHub 和老版本 Octoparse 工作流这类传统爬虫,依赖 XPath 选择器或 CSS 路径。网站 HTML 结构一更新,这些选择器就会失效,你又得手动重配。

像 Thunderbit 这样的 AI 提取器会在每次运行时重新读取页面结构。这意味着不需要维护 XPath,也不会被脆弱的选择器拖垮。AI 会在下一次运行时自动适应布局变化。

定时爬取和 API 访问:没人真正认真评测的高阶功能

一次性爬取适合做研究。像价格监控、线索列表刷新和库存跟踪这样的生产场景,需要周期性提取和程序化访问。这些功能把“玩具”和“工具”区分开来。

调度支持

| 工具 | 原生调度 | 备注 |

|---|---|---|

| Thunderbit | ✅ | 自然语言设置 |

| Octoparse | ✅ | 云端定时运行 |

| Browse AI | ✅ | 核心产品功能 |

| Firecrawl | ❌ | 需要外部 cron |

| Apify | ✅ | 支持完整 cron 表达式 |

| Gumloop | ✅ | 基于时间的工作流触发器 |

| Bright Data | 外部 | 通常通过客户自有系统编排 |

| Bardeen | ✅ | playbook 调度 |

| Diffbot | ❌ | API 优先,需外部编排 |

| ScrapingBee | ❌ | 仅 API |

| Instant Data Scraper | ❌ | 手动浏览器工具 |

| ParseHub | ✅(付费) | 高级功能 |

开发者 API 对比

| 工具 | 并发或速率信号 | 定价模型 |

|---|---|---|

| Thunderbit | 2 → 50 并发 | 按 credits 计费 |

| Firecrawl | 2 → 100 并发 | 按 credits 计费 |

| Apify | 取决于套餐 | 计算单元 |

| Gumloop | 受套餐限制的工作流并发 | 按 credits 计费 |

| Diffbot | 5 次/分钟 → 25 次/秒 | 按 credits 计费 |

| ScrapingBee | 10 → 200 并发 | API credits 计费 |

| Bright Data | Browser API 宣称可无限并发请求 | 按 GB 计费 |

如果你的使用场景更偏技术,正在权衡自己要承担多少基础设施,这个 Firecrawl 演示会是上面产品对比的一个很好的执行层补充。

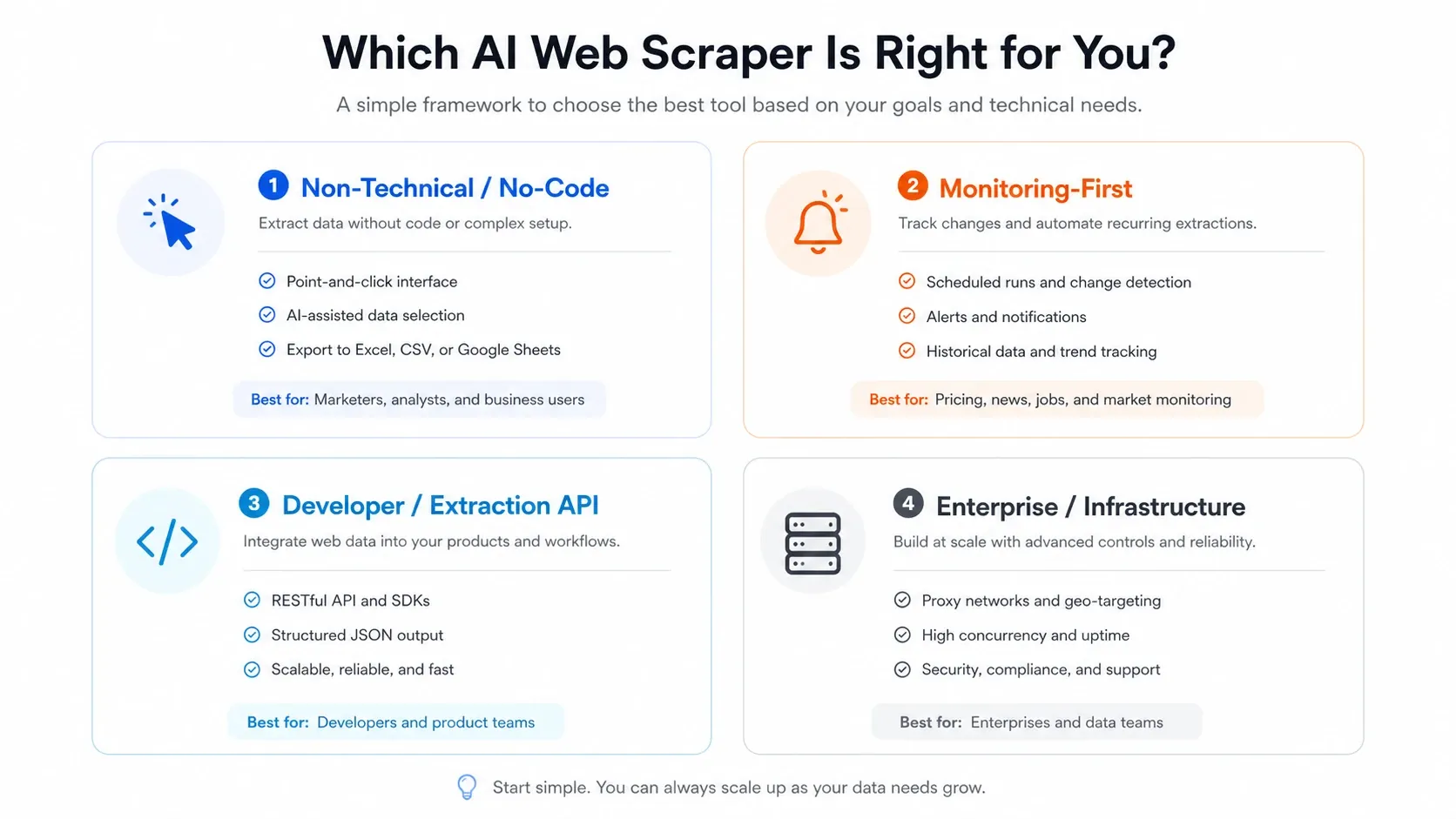

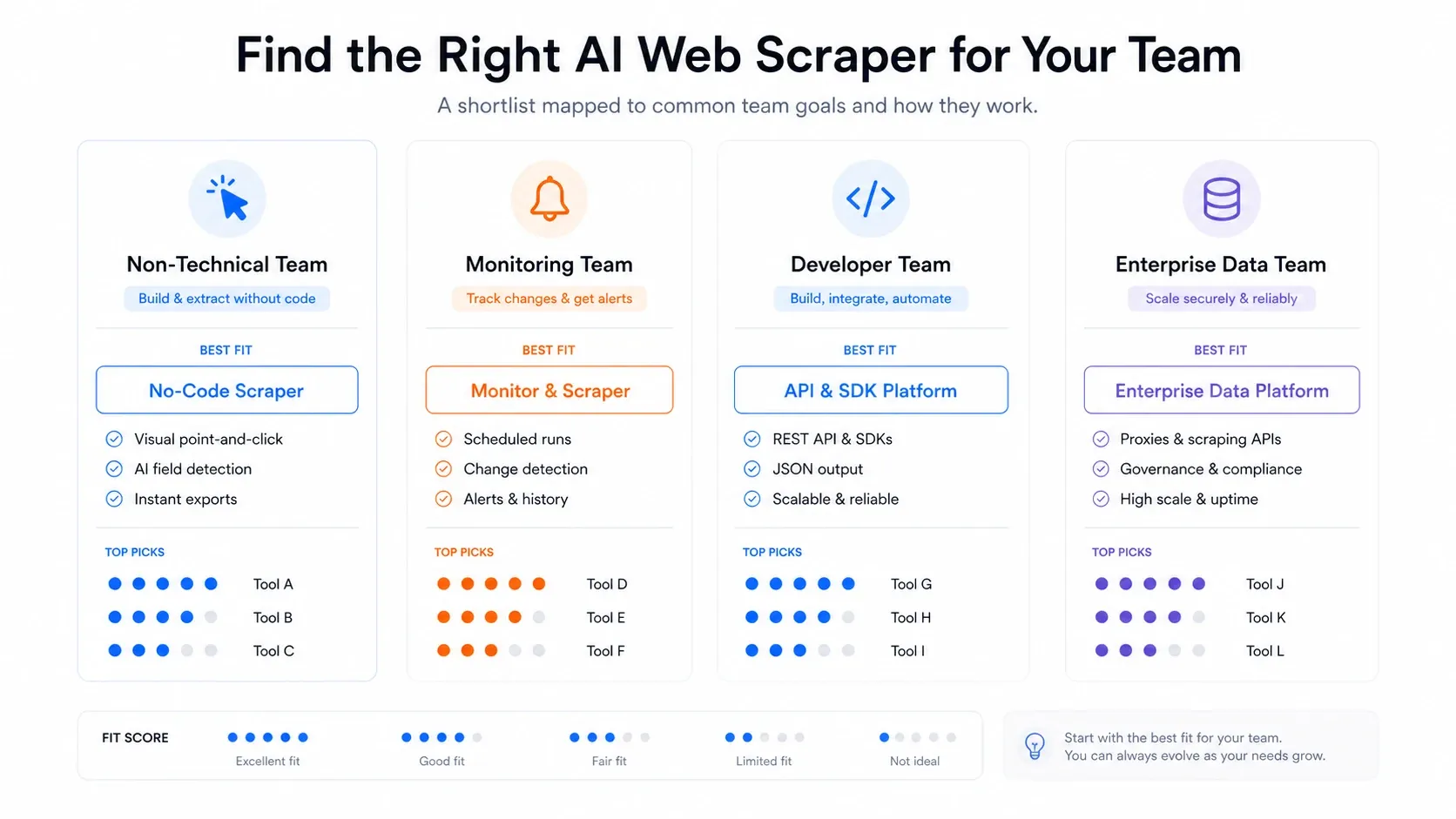

如何选择合适的 AI 网页爬虫

测试完这 12 款工具后,我会这样选择:

- 需要快速拿数据的非技术团队: 先用 Thunderbit。两步流程、免费导出,以及浏览器/云端切换,基本覆盖了大多数业务爬取需求,而不用工程支持。

- 需要持续监控和告警: Browse AI 就是为这个场景设计的。它未必是最强的一次性提取器,但变化检测是它的核心能力。

- 开发者要搭 LLM 流水线: 用 Firecrawl 做 Markdown 或 JSON 提取,或者用 Diffbot 做预训练结构化提取。如果你在获取层也需要强反爬,就搭配 ScrapingBee 或 Bright Data。

- 需要预制爬虫市场: Apify 拥有最大的 actor 生态。不过 actor 挂掉后,你要做好维护准备。

- 企业级、强防护目标: Bright Data。没有其他工具的代理基础设施能和它匹配,但预算和技术团队也要跟上。

- 想把爬取作为更大自动化的一部分: 选 Gumloop 或 Bardeen,取决于你是在自动化工作流,还是浏览器型 GTM 任务。

- 只是想快速免费抓一次: Instant Data Scraper。零配置、零成本、零复杂度,但也没有调度、没有 AI、没有云端。

- 复杂交互网站,带下拉和 AJAX: ParseHub 依然比大多数扩展更能处理这些,但维护成本也确实存在。

结论

2026 年的 AI 网页爬虫市场很拥挤,很多工具在演示里都很漂亮,但一到生产环境就让人失望。“营销截图里能跑”和“凌晨 3 点按计划在受防护的电商站上稳定运行”之间的差距,正是大多数买家浪费时间和金钱的地方。

评估完这 12 款工具后,最重要的结论其实很简单:获取层仍然是最难的部分。 AI 擅长提取和后处理,但它并不能替代代理基础设施、反爬处理或会话管理。最好的工具要么同时把这两层都解决掉,比如 Thunderbit 和 Bright Data;要么诚实地说明自己覆盖的是哪一层,比如 Firecrawl 负责提取,ScrapingBee 负责获取。

如果你想在不写代码的情况下看看一个可投入生产的 AI 网页爬虫长什么样, 。免费档已经足够你在真实页面上测试完整流程。如果你的需求更偏开发者,那就把提取 API 和专门的获取服务配起来,别再指望一款工具包办所有事情,从而让自己更省心。

常见问题

为什么大多数 AI 网页爬虫在演示里没问题,到了真实网站就失效?

演示通常只展示在干净、没有防护的页面上提取。真实网站会加入 Cloudflare 防护、动态 JavaScript 渲染、分页、登录要求,以及频繁变化的页面结构。大多数工具在解析和提取层做得不错,但在获取层缺少足够稳健的基础设施。

云端爬取和浏览器爬取有什么区别,分别什么时候用?

云端爬取使用远程服务器抓取页面,速度更快、并发更高、可扩展性更强。浏览器爬取运行在你自己的浏览器会话里,更适合需要登录的网站,或者反机器人检测很强的网站。Thunderbit 是少数能在同一界面里同时提供两种模式的工具之一。

我能把 AI 网页爬虫用于价格监控这类周期性任务吗?

可以,但前提是工具支持定时爬取。Thunderbit、Octoparse、Browse AI、Apify、Gumloop、Bardeen,以及付费版 ParseHub 都支持调度。

如果我不会编程,哪款 AI 网页爬虫最适合我?

Thunderbit 是非技术用户最快拿到可用数据的路径。Instant Data Scraper 完全免费,但只适合简单页面。Browse AI 和 Octoparse 提供可视化界面,但需要更多设置。ParseHub 对复杂交互网站很强,但学习曲线也更陡。

生产级 AI 网页爬取到底要花多少钱?

价格区间很大。Instant Data Scraper 免费。Thunderbit、Firecrawl 和 Browse AI 都提供免费入口和低成本付费方案。Octoparse、ParseHub 和 ScrapingBee 这类中端工具的月费大约在 $49 到 $189 之间。Bright Data 和 Diffbot 这类企业方案起价要高得多。