Web, değerli verilerle dolu — ister satışta, ister e-ticarette, ister pazar araştırmasında olun; web scraping, lead oluşturma, fiyat takibi ve rakip analizi için gizli silahınız olabilir. Ama işin bir de öte tarafı var: daha fazla işletme scraping’e yöneldikçe, web siteleri de hiç olmadığı kadar sert önlemler alıyor. Hatta bugün büyük sitelerin %60’ından fazlası anti-bot önlemleri kullanıyor ve artık neredeyse standart hale geldi. Python script’inizin 20 dakika boyunca sorunsuz çalışıp sonra birdenbire 403 hataları duvarına çarptığını gördüyseniz, o hayal kırıklığını iyi bilirsiniz.

SaaS ve otomasyon tarafında yıllar geçirdim; scraping projelerinin bir anda “Vay be, bu çok kolaymış” seviyesinden “Neden her yerde engelleniyorum?” noktasına nasıl düştüğünü bizzat gördüm. O yüzden gelin işe pratik bakalım: Python’da engellenmeden web scraping nasıl yapılır, hangi teknikler ve kod parçaları gerçekten işe yarar, ne zaman gibi yapay zekâ destekli alternatifleri düşünmeniz gerekir — hepsini anlatacağım. İster Python ustası olun ister scraping’i zar zor yapıyor olun, güvenilir ve engelsiz veri çekmek için kullanabileceğiniz bir araç setiyle çıkacaksınız.

Python’da Engellenmeden Web Scraping Nedir?

Özünde engellenmeden web scraping, sitelerin anti-bot savunmalarını tetiklemeden veri çekmek demektir. Python dünyasında bu, sadece bir requests.get() döngüsü yazmaktan çok daha fazlasıdır; sisteme karışmak, gerçek kullanıcıları taklit etmek ve tespit mekanizmalarından bir adım önde kalmak anlamına gelir.

Neden Python? — basit sözdizimi, devasa ekosistemi (requests, BeautifulSoup, Scrapy, Selenium gibi araçlar) ve hızlı script’lerden dağıtık tarayıcılara kadar her şeye uygun esnekliği sayesinde. Ama bu popülerliğin bir bedeli var: birçok anti-bot sistemi artık Python tabanlı scraping kalıplarını tespit edecek şekilde ayarlanmış durumda.

Dolayısıyla, veriyi güvenle çekmek istiyorsanız temel bilgilerin ötesine geçmeniz gerekir. Yani sitelerin botları nasıl tespit ettiğini ve etik ya da hukuki sınırları aşmadan bunu nasıl aşabileceğinizi anlamanız gerekir.

Python Web Scraping Projelerinde Engellenmemek Neden Önemli?

Engellenmek sadece teknik bir aksaklık değildir; tüm iş akışlarını bozabilir. Gelin parçalayalım:

| Kullanım Senaryosu | Engellenmenin Etkisi |

|---|---|

| Lead Oluşturma | Eksik veya güncelliğini yitirmiş potansiyel müşteri listeleri, kayıp satışlar |

| Fiyat Takibi | Rakip fiyat değişikliklerinin kaçırılması, yanlış fiyat kararları |

| İçerik Toplama | Haber, yorum veya araştırma verilerinde boşluklar |

| Pazar İstihbaratı | Rakip veya sektör takibinde kör noktalar |

| Emlak İlanları | Yanlış ya da eski mülk verileri, kaçan fırsatlar |

Bir scraper engellendiğinde sadece veri kaybetmiş olmazsınız; kaynakları boşa harcar, uyumluluk riskleri alır ve eksik bilgiye dayanarak yanlış iş kararları verme ihtimalini yükseltirsiniz. bir dünyada, güvenilirlik her şeydir.

Web Siteleri Python Web Scraper’larını Nasıl Tespit Edip Engeller?

Web siteleri botları fark etme konusunda epey akıllandı. Karşınıza çıkabilecek en yaygın anti-scraping savunmaları şunlar (, ):

- IP Adresi Kara Listeleme: Aynı IP’den fazla istek mi geldi? Engellendiniz.

- User-Agent ve Header Kontrolleri: Eksik ya da genel başlıklı istekler (Python’ın varsayılan

python-requests/2.25.1gibi) hemen dikkat çeker. - Rate Limiting: Kısa sürede çok fazla istek atmak, yavaşlatma veya ban tetikler.

- CAPTCHA’lar: Botların kolayca çözemedikleri “insan olduğunuzu kanıtlayın” bulmacaları.

- Davranışsal Analiz: Siteler, aynı butona hep aynı aralıkla tıklamak gibi robotik desenleri izler.

- Honeypot’lar: Sadece botların etkileşime gireceği gizli bağlantılar veya alanlar.

- Browser Fingerprinting: Otomasyon araçlarını yakalamak için tarayıcınız ve cihazınızla ilgili ayrıntıların toplanması.

- Cookie ve Oturum Takibi: Cookie veya session’ı doğru yönetmeyen botlar işaretlenir.

Bunu havaalanı güvenliği gibi düşünün: herkes gibi görünür, davranır ve hareket ederseniz sorunsuz geçersiniz. Trençkot ve güneş gözlüğüyle gelirseniz, ek sorulara hazırlıklı olun.

Engellenmeden Web Scraping İçin Temel Python Teknikleri

Gelelim asıl işe: Python ile scraping yaparken engellerden nasıl kaçınılır? Her scraper’ın bilmesi gereken temel stratejiler şunlar:

Dönen Proxy’ler ve IP Adresleri

Neden önemli: Tüm istekleriniz aynı IP’den geliyorsa, IP ban için kolay bir hedef olursunuz. Dönen proxy’ler istekleri birçok IP arasında dağıtmanızı sağlar ve sizi engellemek çok daha zor hale gelir.

Python’da nasıl yapılır:

1import requests

2proxies = [

3 "<http://proxy1.example.com:8000>",

4 "<http://proxy2.example.com:8000>",

5 # ...daha fazla proxy

6]

7for i, url in enumerate(urls):

8 proxy = {"http": proxies[i % len(proxies)]}

9 response = requests.get(url, proxies=proxy)

10 # response'u işleDaha yüksek güvenilirlik için ücretli proxy servisleri (residential veya rotating proxy’ler gibi) kullanabilirsiniz ().

User-Agent ve Özel Header Ayarlama

Neden önemli: Python’ın varsayılan header’ları adeta “ben bot’um” diye bağırır. User-Agent ve diğer header’ları ayarlayarak gerçek tarayıcıları taklit edin.

Örnek kod:

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

3 "Accept-Language": "en-US,en;q=0.9",

4 "Accept-Encoding": "gzip, deflate, br",

5 "Connection": "keep-alive"

6}

7response = requests.get(url, headers=headers)Ek gizlilik için user-agent’ları döndürün ().

İstek Zamanlamasını ve Desenlerini Rastgeleleştirme

Neden önemli: Botlar hızlı ve tahmin edilebilirdir; insanlar ise daha yavaş ve rastgeledir. Gecikmeler ekleyin ve gezinme kalıbınızı karıştırın.

Python ipucu:

1import time, random

2for url in urls:

3 response = requests.get(url)

4 time.sleep(random.uniform(2, 7)) # 2–7 saniye bekleSelenium kullanıyorsanız tıklama yollarını ve kaydırma desenlerini de rastgeleleştirebilirsiniz.

Cookie ve Oturumları Yönetme

Neden önemli: Pek çok site içeriğe erişmek için cookie veya session token ister. Bunları yok sayan botlar engellenir.

Python’da nasıl yönetilir:

1import requests

2session = requests.Session()

3response = session.get(url)

4# session cookie'leri otomatik yönetirDaha karmaşık akışlarda cookie’leri yakalamak ve yeniden kullanmak için Selenium kullanın.

Headless Tarayıcılarla İnsan Davranışını Taklit Etme

Neden önemli: Bazı siteler gerçek kullanıcı sinyali olarak JavaScript’i, fare hareketini veya kaydırmayı kullanır. Selenium veya Playwright gibi headless tarayıcılar bu eylemleri taklit edebilir.

Selenium ile örnek:

1from selenium import webdriver

2from selenium.webdriver.common.action_chains import ActionChains

3import random, time

4driver = webdriver.Chrome()

5driver.get(url)

6actions = ActionChains(driver)

7actions.move_by_offset(random.randint(0, 100), random.randint(0, 100)).perform()

8time.sleep(random.uniform(2, 5))Bu yaklaşım davranışsal analizi ve dinamik içeriği aşmanıza yardımcı olur ().

Gelişmiş Stratejiler: Python’da CAPTCHA ve Honeypot’ları Aşmak

CAPTCHA’lar, botları anında durdurmak için tasarlanmıştır. Bazı Python kütüphaneleri basit CAPTCHA’ları çözebilse de, ciddi scraper’ların çoğu bunları ücret karşılığında çözmek için 2Captcha veya Anti-Captcha gibi üçüncü taraf servislerden yararlanır ().

Örnek entegrasyon:

1# 2Captcha API kullanımı için псевдokod

2import requests

3captcha_id = requests.post("<https://2captcha.com/in.php>", data={...}).text

4# Çözümü bekle, sonra isteğinle gönderHoneypot’lar, yalnızca botların etkileşime gireceği gizli alanlar veya bağlantılardır. Gerçek bir tarayıcıda görünmeyen hiçbir şeye tıklamayın veya hiçbir şeyi göndermeyin ().

Python Kütüphaneleriyle Sağlam Request Header’ları Tasarlama

User-Agent’in ötesinde, daha iyi karışmak için diğer header’ları da (Referer, Accept, Origin vb.) döndürebilir ve rastgeleleştirebilirsiniz.

Scrapy ile:

1class MySpider(scrapy.Spider):

2 custom_settings = {

3 'DEFAULT_REQUEST_HEADERS': {

4 'User-Agent': '...',

5 'Accept-Language': 'en-US,en;q=0.9',

6 # Daha fazla header

7 }

8 }Selenium ile: Tarayıcı profilleri veya eklentiler kullanarak header ayarlayın ya da bunları JavaScript ile enjekte edin.

Header listenizi güncel tutun — ilham almak için gerçek tarayıcı isteklerini browser DevTools ile kopyalayın.

Geleneksel Python Scraping Yeterli Olmadığında: Anti-Bot Teknolojisinin Yükselişi

Gerçek şu: scraping popülerleştikçe anti-bot önlemleri de artıyor. . Yapay zekâ destekli tespit, dinamik istek eşikleri ve browser fingerprinting, ileri düzey Python script’lerinin bile fark edilmeden kalmasını her zamankinden zor hale getiriyor ().

Bazen kodunuz ne kadar akıllı olursa olsun bir duvara çarpar. İşte o zaman farklı bir yaklaşımı düşünme vakti gelir.

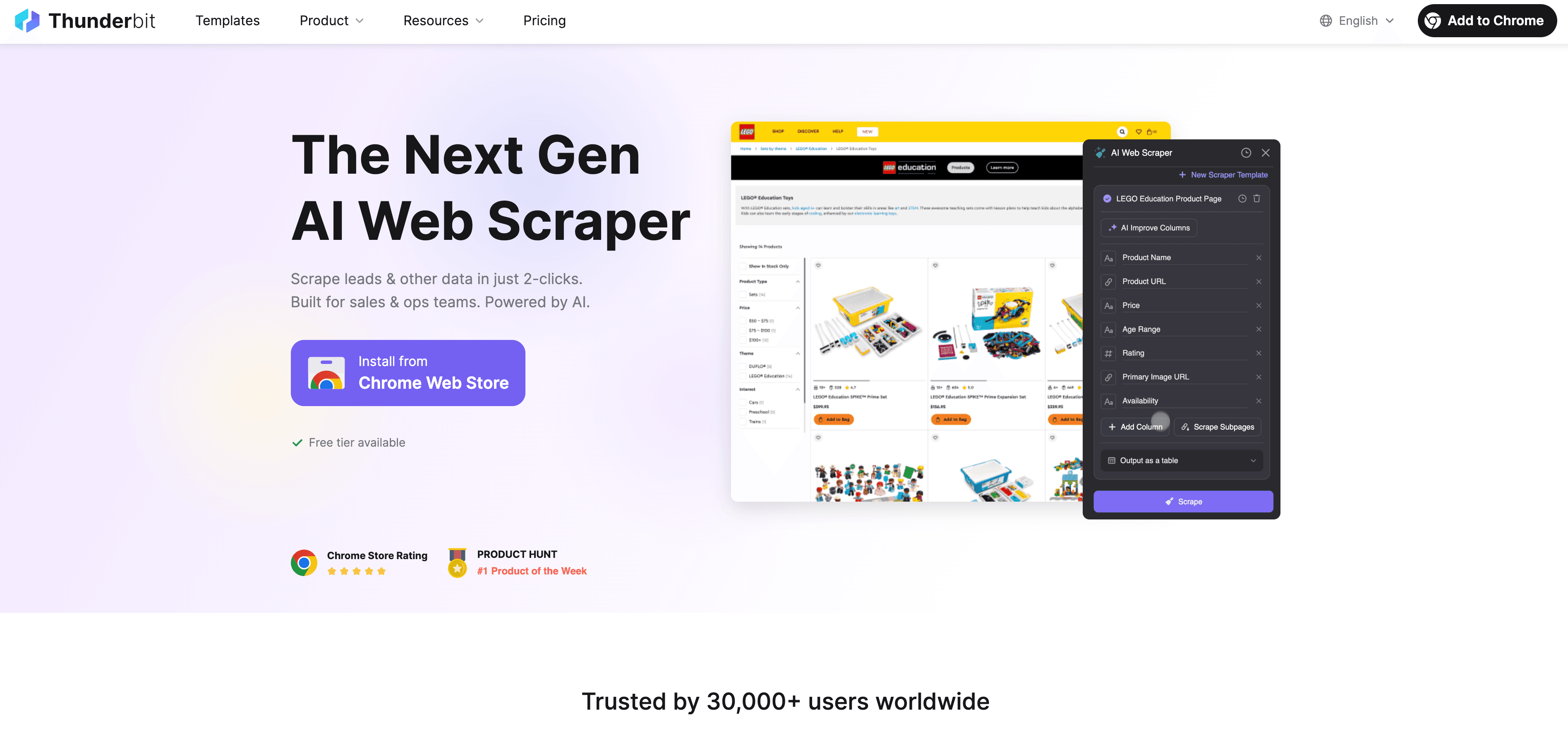

Thunderbit: Python Scraping’e AI Web Scraper Alternatifi

Python sınırlarına geldiğinizde, kod yazmadan kullanılabilen, yapay zekâ destekli bir web scraper olarak devreye girer; üstelik geliştiriciler için değil, iş kullanıcıları için tasarlanmıştır. Proxy’lerle, header’larla ve CAPTCHA’larla uğraşmak yerine Thunderbit’in AI aracı siteyi okur, çıkarılacak en iyi alanları önerir ve alt sayfa gezinmesinden veri dışa aktarıma kadar her şeyi halleder.

Thunderbit’i farklı kılan nedir?

- AI Alan Önerisi: “AI Alanları Öner”e tıklayın; Thunderbit sayfayı tarar, sütunlar önerir ve hatta çıkarma talimatları oluşturur.

- Alt Sayfa Scraping: Thunderbit her alt sayfayı (ürün detayları veya LinkedIn profilleri gibi) ziyaret edip tablonuzu otomatik olarak zenginleştirebilir.

- Bulut veya Tarayıcı Scraping: En hızlı seçeneği seçin — herkese açık siteler için bulut, giriş korumalı sayfalar için tarayıcı.

- Zamanlanmış Scraping: Ayarlayın ve unutun — Thunderbit planlı şekilde çalışabilir, böylece veriniz her zaman güncel kalır.

- Hazır Şablonlar: Popüler siteler için (Amazon, Zillow, Shopify vb.) Thunderbit tek tıkla şablonlar sunar — kurulum gerekmez.

- Ücretsiz Veri Dışa Aktarma: Excel, Google Sheets, Airtable veya Notion’a dışa aktarın — ek ücret yok.

Thunderbit, dünya çapında tarafından güvenilir bulunuyor ve tek satır kod yazmanız gerekmiyor.

Thunderbit, Kullanıcıların Engellerden Kaçınmasına ve Veri Çekmeyi Otomatikleştirmesine Nasıl Yardımcı Olur?

Thunderbit’in yapay zekâsı sadece insan davranışını taklit etmez; her siteye gerçek zamanlı uyum sağlayarak engellenme riskini azaltır. Nasıl mı?

- AI, düzen değişikliklerine uyum sağlar: Site tasarımı değiştiğinde script’leriniz bozulmaz.

- Alt sayfa ve sayfalama yönetimi: Thunderbit, gerçek bir kullanıcı gibi bağlantıları ve sayfalı listeleri otomatik takip eder.

- Ölçekli bulut scraping: Tek seferde 50 sayfaya kadar, yıldırım hızında veri çekin.

- Kod yok, bakım yok: Vaktinizi debug yerine analiz için kullanın.

Daha derinlemesine incelemek için yazısına göz atın.

Python Scraping ile Thunderbit Karşılaştırması: Hangisini Seçmelisiniz?

Yan yana koyalım:

| Özellik | Python Scraping | Thunderbit |

|---|---|---|

| Kurulum Süresi | Orta-Yüksek (script’ler, proxy’ler vb.) | Düşük (2 tık, gerisini AI yapar) |

| Teknik Beceri | Kodlama gerekir | Kod gerekmez |

| Güvenilirlik | Değişken (kolay bozulur) | Yüksek (AI değişikliklere uyum sağlar) |

| Engellenme Riski | Orta-Yüksek | Düşük (AI kullanıcıyı taklit eder, uyum sağlar) |

| Ölçeklenebilirlik | Özel kod/bulut kurulumu gerekir | Yerleşik bulut/toplu scraping |

| Bakım | Sık (site değişiklikleri, engeller) | Minimum (AI otomatik ayarlar) |

| Dışa Aktarma Seçenekleri | Manuel (CSV, DB) | Doğrudan Sheets, Notion, Airtable, CSV |

| Maliyet | Ücretsiz (ama zaman alıcı) | Ücretsiz plan, ölçek için ücretli planlar |

Python ne zaman kullanılmalı:

- Tam kontrol, özel mantık veya diğer Python iş akışlarıyla entegrasyon gerekiyorsa.

- Anti-bot savunması zayıf siteleri scrape ediyorsanız.

Thunderbit ne zaman kullanılmalı:

- Hız, güvenilirlik ve sıfır kurulum istiyorsanız.

- Karmaşık veya sık değişen siteleri scrape ediyorsanız.

- Proxy, CAPTCHA veya kodla uğraşmak istemiyorsanız.

Adım Adım Kılavuz: Python’da Engellenmeden Web Scraping Kurulumu

Şimdi pratik bir örnek üzerinden gidelim: anti-engelleme en iyi uygulamalarını uygulayarak örnek bir siteden ürün verisi çekelim.

1. Gerekli Kütüphaneleri Kurun

1pip install requests beautifulsoup4 fake-useragent2. Script’inizi Hazırlayın

1import requests

2from bs4 import BeautifulSoup

3from fake_useragent import UserAgent

4import time, random

5ua = UserAgent()

6urls = ["<https://example.com/product/1>", "<https://example.com/product/2>"] # URL'lerinizle değiştirin

7for url in urls:

8 headers = {

9 "User-Agent": ua.random,

10 "Accept-Language": "en-US,en;q=0.9"

11 }

12 response = requests.get(url, headers=headers)

13 if response.status_code == 200:

14 soup = BeautifulSoup(response.text, "html.parser")

15 # Veriyi burada çıkarın

16 print(soup.title.text)

17 else:

18 print(f"{url} için engellendi veya hata oluştu: {response.status_code}")

19 time.sleep(random.uniform(2, 6)) # Rastgele gecikme3. Proxy Döndürme Ekleyin (İsteğe Bağlı)

1proxies = [

2 "<http://proxy1.example.com:8000>",

3 "<http://proxy2.example.com:8000>",

4 # Daha fazla proxy

5]

6for i, url in enumerate(urls):

7 proxy = {"http": proxies[i % len(proxies)]}

8 headers = {"User-Agent": ua.random}

9 response = requests.get(url, headers=headers, proxies=proxy)

10 # ...kodun geri kalanı4. Cookie ve Session’ları Ele Alın

1session = requests.Session()

2for url in urls:

3 response = session.get(url, headers=headers)

4 # ...kodun geri kalanı5. Sorun Giderme İpuçları

- Çok sayıda 403/429 hatası görüyorsanız, isteklerinizi yavaşlatın veya yeni proxy’ler deneyin.

- CAPTCHA ile karşılaşırsanız, Selenium veya CAPTCHA çözüm hizmeti kullanmayı düşünün.

- Her zaman sitenin

robots.txtdosyasını ve hizmet şartlarını kontrol edin.

Sonuç ve Temel Çıkarımlar

Python’da web scraping güçlüdür — ancak anti-bot teknolojisi geliştikçe engellenme riski de sürekli vardır. Engellerden kaçınmanın en iyi yolu nedir? Teknik en iyi uygulamaları (dönen proxy’ler, akıllı header’lar, rastgele gecikmeler, session yönetimi ve headless tarayıcılar) sitenin kurallarına ve etik ilkelere saygıyla birleştirmek.

Ama bazen en iyi Python numaraları bile yetmez. İşte burada gibi yapay zekâ destekli araçlar öne çıkar — ihtiyacınız olan veriyi hızlı, kod yazmadan, engellere karşı daha dayanıklı ve iş dostu bir şekilde çekmenin yolunu sunar.

Scraping’in ne kadar kolay olabileceğini görmek ister misiniz? ve kendiniz deneyin — ya da daha fazla scraping ipucu ve eğitim için sayfamıza göz atın.

SSS

1. Siteler neden Python web scraper’larını engeller?

Siteler verilerini korumak, sunucu yükünü önlemek ve otomatik botların hizmetlerini kötüye kullanmasını durdurmak için scraper’ları engeller. Python script’leri varsayılan header’lar kullanıyorsa, cookie yönetmiyorsa veya çok kısa sürede çok fazla istek atıyorsa kolayca fark edilir.

2. Python ile scraping yaparken engellenmemek için en etkili yöntemler nelerdir?

Dönen proxy’ler kullanın, gerçekçi user-agent ve header’lar ayarlayın, istek zamanlamasını rastgeleleştirin, cookie/session yönetin ve Selenium veya Playwright gibi araçlarla insan davranışını taklit edin.

3. Thunderbit, Python script’lerine kıyasla engellerden kaçınmaya nasıl yardımcı olur?

Thunderbit, site düzenlerine uyum sağlamak, insan gezintisini taklit etmek ve alt sayfalar ile sayfalama işlemlerini otomatik yönetmek için AI kullanır. Ortama karışıp yaklaşımını gerçek zamanlı güncelleyerek engellenme riskini azaltır — kod ya da proxy gerekmez.

4. Python scraping ile Thunderbit gibi bir AI aracı ne zaman kullanılmalı?

Özel mantığa, diğer Python kodlarıyla entegrasyona ihtiyacınız varsa veya basit siteleri scrape ediyorsanız Python kullanın. Hızlı, güvenilir ve ölçeklenebilir scraping için Thunderbit kullanın — özellikle siteler karmaşıksa, sık değişiyorsa veya script’leri agresif biçimde engelliyorsa.

5. Web scraping yasal mı?

Web scraping, herkese açık veriler için yasaldır; ancak her sitenin hizmet şartlarına, gizlilik politikalarına ve ilgili yasalara saygı göstermeniz gerekir. Asla hassas veya özel veri çekmeyin ve scraping’i her zaman etik ve sorumlu şekilde yapın.

Daha akıllı, daha zor değil, scraping yapmaya hazır mısınız? Thunderbit’i deneyin ve engelleri geride bırakın.

Daha Fazla Bilgi:

- Python ile Google News Scraping: Adım Adım Kılavuz

- Python Kullanarak Bir Best Buy Fiyat Takip Aracı Oluşturma

- Engellenmeden Web Scraping Yapmanın 14 Yolu

- Web Scraping Yaparken Engellenmemek İçin 10 En İyi İpucu