Eskiden bir web scraping geliştiricisi işe al fikri daha çok “niş” bir hamleydi—genelde veri bilimcilerin ya da arada bir teknik pazarlamacıların başvurduğu bir yoldu. Ama 2025’e geldiğimizde, konuştuğum neredeyse her satış, operasyon veya pazarlama ekibi; ya bir freelance web scraping uzmanı ya da bir web veri çıkarma uzmanı arıyor. Sebebi basit: Web, dünyanın en büyük ama aynı zamanda en dağınık veri deposu; bu karmaşayı aksiyona dökülebilir içgörülere çevirmek için üzerimizdeki baskı da her geçen gün artıyor. Doğru (ya da yanlış) işe alımın bir projeyi nasıl uçurduğunu ya da nasıl çökerttiğini bizzat gördüm—bazen gerçekten “gösterişli” şekilde.

Web scraping ve veri çıkarma pazarı resmen roket gibi büyüyor; küresel harcamanın önümüzdeki on yılda dört katına çıkması bekleniyor (). Ama siteler sürekli şekil değiştirirken, anti-bot savunmaları daha da akıllanırken ve iş birimleri daha temiz, daha hızlı veri isterken; doğru kişiyi işe almak (ya da doğru aracı seçmek) her zamankinden daha kritik hale geliyor. İster kurucu ol, ister ekip lideri, ister “kısa çöpü çekmiş” veri sorumlusu… Gel, web scraping geliştiricisi nasıl işe alınır ve hangi durumlarda buna hiç gerek kalmayabilir, birlikte netleştirelim.

Web Scraping Geliştiricisi Ne Yapar?

Bir web scraping geliştiricisi, internetin “vahşi batısı” ile ekibinin gerçekten ihtiyaç duyduğu düzenli tablolar arasında köprü kurar. Temel görevi; sürekli değişen, dağınık web sayfalarını yapılandırılmış ve güvenilir veri setlerine dönüştürmektir—CSV, JSON ya da doğrudan veritabanına akan akışlar gibi. Ama olay sadece hızlıca bir script yazıp geçmek değil. Asıl mesele; siteler değiştikçe bu script’lerin çalışmaya devam etmesini sağlamak, sayfalama (pagination), alt sayfalar, anti-bot engelleri ve modern web’in tüm “acayiplikleriyle” başa çıkmaktır ().

Tipik sorumluluklar:

- Web sayfalarını analiz edip en uygun çıkarım yöntemini seçmek (HTML scraping, API çağrıları, headless browser)

- Dinamik içerik, JavaScript render ve giriş (login) akışlarını yönetmek

- Sayfalama ve alt sayfa zenginleştirmesi yapmak (ör. ürün listesini çekip her ürün sayfasına girerek detayları toplamak)

- Analize hazır, temiz veri çıktısı üretmek (CSV, JSON, veritabanı veya doğrudan entegrasyon)

- Bir şeyler bozulduğunda (ki bozulur) izleme, yeniden deneme ve uyarı mekanizmaları kurmak

- Veri spesifikasyonlarını, alan tanımlarını ve yenileme takvimini dokümante etmek

Freelance web scraping uzmanları genellikle tek seferlik işler, niş hedefler veya hızlı prototipler için daha çok tercih edilir. Şirket içi web veri çıkarma uzmanları ise veri çıkarma işinin işin merkezinde olduğu, süreklilik isteyen senaryolarda devreye girer—günlük fiyat takibi, lead üretimi veya dahili dashboard’ları beslemek gibi ().

Teknik olmayan ekipler için bu roller altın değerindedir. Saatler süren kopyala-yapıştır işini otomatik akışlara çevirir; analistlerin ve satış ekiplerinin gerçekten sonuç getiren işlere odaklanmasını sağlar.

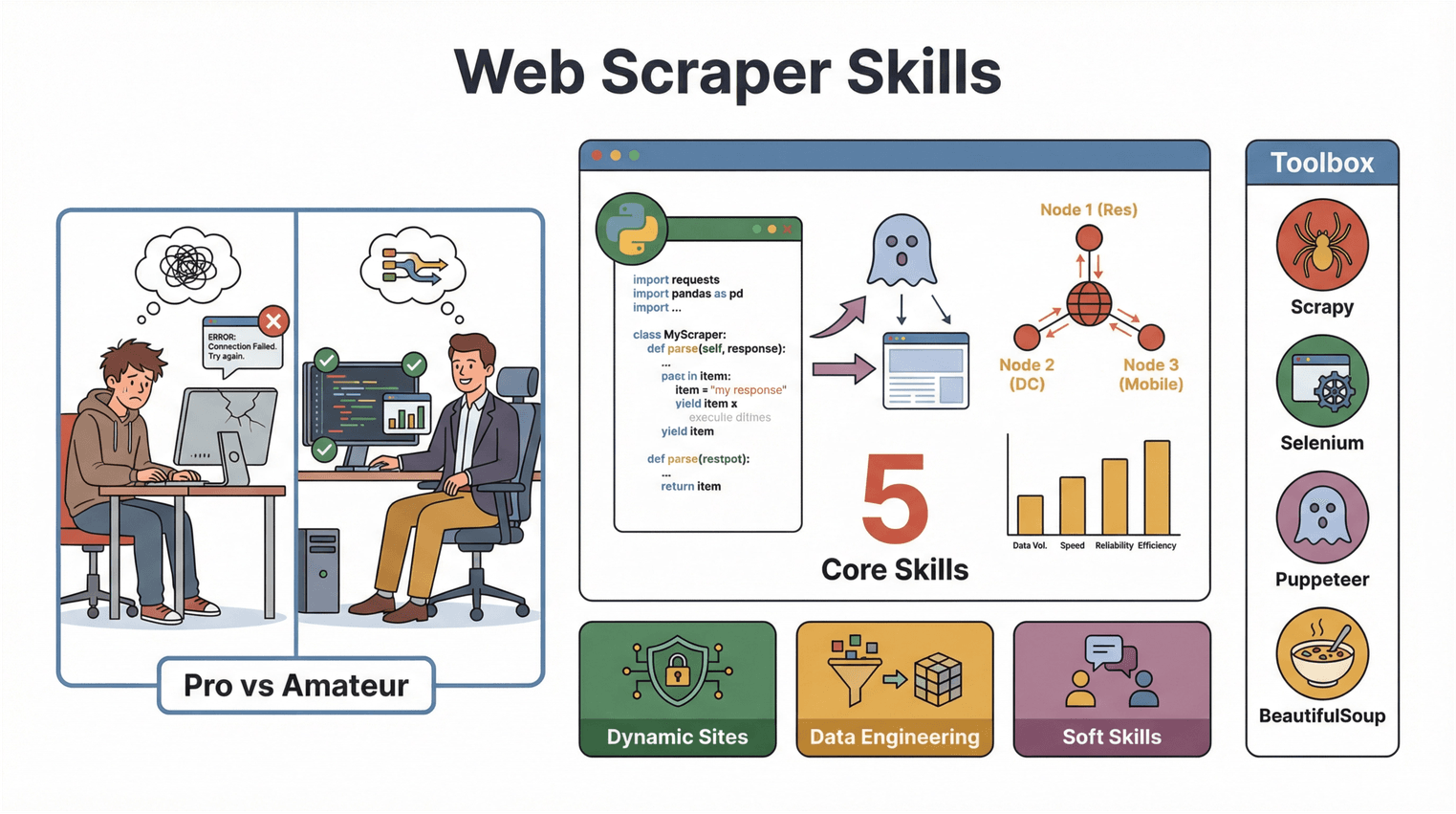

Web Scraping Geliştiricisi İşe Alırken Aranacak Temel Yetkinlikler ve Deneyim

Her scraper aynı seviyede değildir. Yıllar içinde, bir öğleden sonra script yazabilen ama bir hafta boyunca ayakta tutamayan geliştiriciler gördüm. Profesyonelleri amatörlerden ayıran çizgi genelde şuralardan geçiyor:

- Güçlü programlama becerileri: Python en yaygını; ama JavaScript, Node.js hatta Go da sık kullanılır. BeautifulSoup, Scrapy, Selenium veya Puppeteer gibi kütüphanelerle deneyim arayın.

- Web scraping araçlarına aşinalık: Hem kod tabanlı hem de no-code araçları (ör. ) bilmek ciddi avantaj. En iyi adaylar, ne zaman araçla ilerleyeceğini ne zaman sıfırdan geliştireceğini bilir.

- Dinamik ve korumalı sitelerle çalışma: Modern siteler JavaScript ve anti-bot savunmalarını sever. Headless browser, proxy, CAPTCHA ve oturum yönetimi konularında rahat olmalı.

- Veri mühendisliği bakışı: Sadece çekmek yetmez—temizleme, tekilleştirme, doğrulama ve yapılandırma en az çıkarım kadar kritiktir.

- Soft skill’ler: İletişim, detaycılık ve problem çözme. “Tabii, çekerim” deyip geçen değil; doğru soruları soran birini istersin.

Teknik Yetkinlik Kontrol Listesi

Adayları hızlıca elemek için kullanabileceğin pratik bir liste:

| Olmazsa Olmaz Yetkinlikler | Olursa İyi Olur Yetkinlikler |

|---|---|

| Python (veya JS/Node) | Bulut tabanlı scraping platformları deneyimi |

| HTML/CSS/DOM ayrıştırma | Konteynerleştirme (Docker) bilgisi |

| Sayfalama ve alt sayfa yönetimi | İzleme, loglama ve alarm kurulumları |

| Anti-bot stratejileri (proxy, hız sınırlama) | Veri hattı entegrasyonu (ETL, API’ler) |

| Veri doğrulama ve QA | Uyumluluk ve gizlilik farkındalığı |

| Thunderbit, Octoparse gibi araçlarla deneyim | AI destekli çıkarım deneyimi |

Ekstra artı: gibi araçları kullanabilen adaylar, özellikle rutin iş senaryolarında daha hızlı sonuç üretir ve daha az bakım ihtiyacı çıkarır.

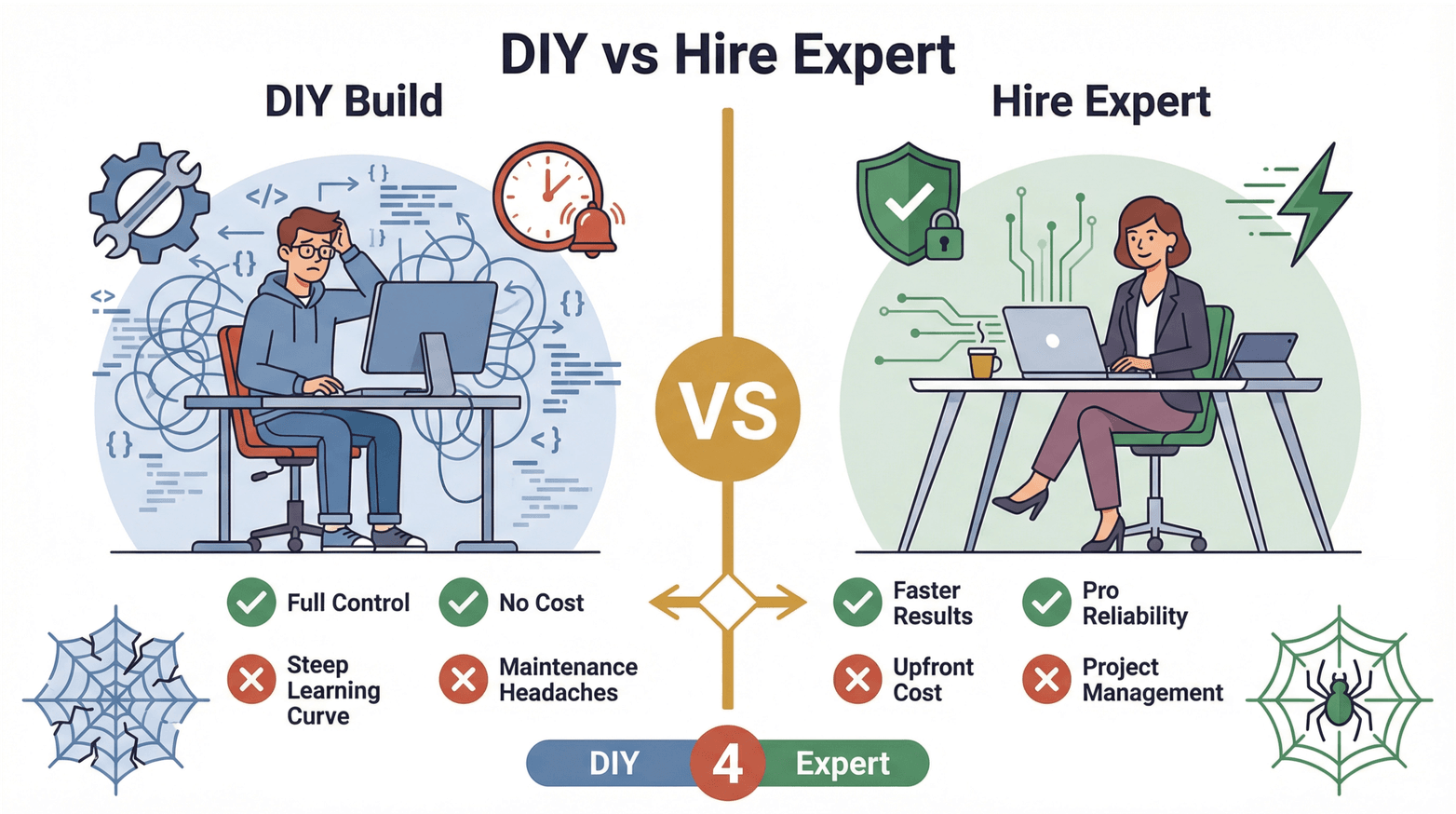

Kendin Yap mı, Web Scraping Uzmanı mı? Maliyet ve Verimlilik Karşılaştırması

Peki kendi scraper’ını mı geliştirmelisin, yoksa bir freelance web scraping uzmanı mı tutmalısın? Gel, netçe parçalayalım.

Kendin Yap (DIY):

- Artıları: Tam kontrol, dış maliyet yok, öğrenmek için iyi.

- Eksileri: Öğrenme eğrisi dik, zaman yer, bakım kabusu, karmaşıklığı hafife almak çok kolay.

Freelance Web Scraping Uzmanı Tutmak:

- Artıları: Daha hızlı teslim, profesyonel seviyede güvenilirlik, site değişince “patlama” riski daha düşük, niş uzmanlığa erişim.

- Eksileri: Başlangıç maliyeti, proje yönetimi ihtiyacı, iletişim kopukluğu riski.

Maliyet Karşılaştırma Tablosu:

| Yaklaşım | Tipik Maliyet | Teslim Süresi | Bakım |

|---|---|---|---|

| DIY | Zamanınız (fırsat maliyeti) | Günler–haftalar (öğreniyorsanız) | Tüm kırılma/düzeltme sizde |

| Freelance (saatlik) | $20–$40/saat (upwork.com) | Çoğu proje için 1–2 hafta | Sürekli destek pazarlık edilebilir |

| Freelance (sabit fiyat) | $500–$5,000+ (upwork.com) | Kapsama göre 1–4 hafta | Bakım ekstra ücretli olabilir |

| Şirket içi işe alım | $100k+/yıl (glassdoor.com) | Süreklidir | Tam sahiplik (ve tam maliyet) |

DIY ne zaman mantıklı? Teknik altyapın varsa, iş basitse ve kurcalamaktan çekinmiyorsan. İş açısından kritik, yüksek hacimli veya sık değişen hedeflerde ise uzman tutmak çok hızlı şekilde kendini amorti eder.

Ne Zaman Web Veri Çıkarma Uzmanı Tercih Etmeli?

Şu durumlarda bir web veri çıkarma uzmanı işe almayı ciddi ciddi düşün:

- Karmaşık, dinamik veya korumalı sitelerden veri çekmen gerekiyorsa

- Veri iş açısından kritikse veya düzenli yenilenmesi gerekiyorsa

- Diğer sistemlerle entegrasyon şartsa (CRM, veritabanları, API’ler)

- Uyumluluk, gizlilik veya hukuki gereklilikler devredeyse

- Sürekli bakım ve arıza giderme yükünü üstlenmek istemiyorsan

Hızlı, tek seferlik çekimler veya basit liste oluşturma için gibi bir araç çoğu zaman fazlasıyla yeterli olur.

Web Scraping Geliştiricileri ve Freelance Uzmanlar Nerede Bulunur?

Web scraping yeteneği bulabileceğin yer çok; ama her platformun kendine has bir “işleyişi” var.

- : En geniş havuz; junior’dan kıdemliye. Saatlik veya sabit fiyat; riski azaltmak için milestone kullan.

- : Teslimatları net, bütçe odaklı işler için iyi. Milestone ödemeleriyle ilerlemeyi güvenceye al.

- : Daha üst segment, ön elemeden geçmiş yetenekler. Eleme sürecini outsource etmek isteyen ve premium ödemeye hazır ekipler için ideal.

- Fiverr: Küçük ve iyi tanımlanmış “gig” işleri için uygun. Karmaşık veya uzun soluklu projelerde temkinli yaklaş.

Adayları filtreleme ipuçları:

- “Python developer” değil, spesifik web scraping deneyimi olan profilleri ara

- Sektör deneyimini kontrol et (ör. e-ticaret, emlak, B2B lead)

- Portföy incele; örnek proje veya kod parçası iste

- Yorumları ve puanları dikkatle oku

Eleme ve Mülakat İpuçları

Sadece anlatılanlara güvenme. Ben adayları genelde şöyle tartıyorum:

Sorulacak kritik sorular:

- Yakın zamanda teslim ettiğiniz bir web scraping projesini anlatır mısınız? Zorluklar nelerdi?

- JavaScript kullanan veya anti-bot korumalı sitelerde nasıl ilerliyorsunuz?

- Veri kalitesini ve güvenilirliğini nasıl garanti ediyorsunuz?

- Devir teslim veya ileride bakım için dokümantasyonu nasıl hazırlıyorsunuz?

- Yeni bir projeye başlamadan önce uyumluluk kontrol listeniz nedir?

Pratik testler:

- Liste + detay sayfası olan örnek bir site ver. Zenginleştirilmiş verilerle bir CSV iste.

- Kodlamaya başlamadan önce kısa bir “veri sözleşmesi” (alan tanımları, zorunluluk, yenileme takvimi) hazırlamasını iste.

- JavaScript ağırlıklı bir tablodan kısa bir demo çekim talep et.

Thunderbit, Web Scraping Geliştiricilerine Bağımlılığınızı Nasıl Azaltır?

Küçük bir gerçek: Çoğu iş kullanıcısı her proje için özel kodlanmış bir scraper’a ihtiyaç duymaz. gibi araçlar teknik olmayan ekipler için oyunu ciddi anlamda değiştiriyor.

Thunderbit, neredeyse her web sitesinden birkaç tıklamayla yapılandırılmış veri çıkarmanı sağlayan bir . Ne istediğini tarif et, “AI Suggest Fields”e tıkla; gerisini Thunderbit’in AI’ı halleder. Alt sayfa scraping, sayfalama ve Excel, Google Sheets, Airtable veya Notion’a doğrudan dışa aktarma da işin içinde.

Bu, işe alım açısından neden önemli? Çünkü geliştirici gerektiren proje sayısını ciddi biçimde azaltır. Satış, e-ticaret ve araştırma ekipleri için rutin veri çekimleri, lead listeleri veya fiyat takibi gibi işlerde Thunderbit’i kullanmak çoğu zaman daha hızlı (ve daha ucuz) olur. Ağır mühendisliği gerçekten karmaşık işlere sakla.

Thunderbit ve Geleneksel Web Scraping Yaklaşımları

Thunderbit’in iş akışını bir freelance web scraping uzmanı tutmakla yan yana koyalım:

| Kriter | Thunderbit | Freelance Uzman |

|---|---|---|

| Kurulum Süresi | Dakikalar (kodsuz) | Günler–haftalar |

| Maliyet | Ücretsiz katman, sonra $15–$249/ay (Thunderbit Pricing) | Proje başına $500–$5,000+ |

| Bakım | AI, site değişikliklerine uyum sağlar | Manuel güncelleme gerekir |

| Dışa Aktarma | Excel, Sheets, Airtable, Notion, CSV, JSON | Değişken (çoğunlukla CSV/JSON) |

| Alt Sayfa/Sayfalama | Dahili, 2 tık | Özel kod gerekir |

| En Uygun Olduğu Durum | Hızlı, sık, hafif işler | Karmaşık, yüksek hacimli, özel entegrasyonlar |

Yine de ne zaman geliştirici tutmalısın? İş açısından kritik veri hatları, “zor hedefler” (login gerektiren veya yoğun korumalı siteler) ya da özel entegrasyon ve izleme ihtiyacı olduğunda.

Dış Kaynak Web Scraping Projelerini Başarıyla Yönetmek

Doğru kişiyi bulmak işin başlangıcı. Projeyi iyi yönetmek ise işin rayında kalmasını sağlar (ve “verim nerede?” anlarını azaltır).

En iyi uygulamalar:

- Başta net bir “veri sözleşmesi” tanımlayın: Gerekli alanlar, veri tipleri, yenileme sıklığı ve kabul kriterleri ().

- Milestone ve escrow kullanın: İşi parçalara bölün (örnek veri seti, tam koşu, zamanlanmış koşu, izleme) ve her teslimde ödeme serbest bırakın ().

- QA kapıları kurun: Verinin tekilleştirildiğinden, doğrulandığından ve kullanım senaryonuza hazır olduğundan emin olun.

- Bakımı planlayın: Scraper’lar bozulur. Veri kritikse retainer veya bakım planı üzerinde anlaşın.

- Her şeyi dokümante edin: README, runbook ve bilinen hata senaryolarını isteyin. İyi dokümantasyon sonradan pahalı sürprizleri önler.

İletişim ve İş Birliği İpuçları

- Düzenli kontrol: Haftalık güncellemeler veya demo’lar hizayı korur.

- Ortak proje araçları: Trello, Asana veya Google Docs ile ilerleme ve geri bildirimleri takip edin.

- Net eskalasyon yolları: Tıkanıklıklar nasıl ele alınacak, baştan belirleyin.

- Soru sormayı teşvik edin: En iyi freelancer’lar erken ve sık netleştirici sorular sorar.

Web Scraping Geliştiricisi İşe Alırken Hukuki, Etik ve Uyumluluk Konuları

Web scraping artık eskisi kadar “vahşi batı” değil. Özellikle kişisel veriler, kullanım şartları ve anti-bot önlemleri devreye girince gerçek hukuki ve etik riskler ortaya çıkıyor.

Öne çıkan noktalar:

- Herkese açık veri ≠ sınırsız kullanım: Kamuya açık veriyi çekmek bile riskli olabilir; özellikle teknik engelleri aşıyorsan veya kullanım şartlarını yok sayıyorsan ().

- Gizlilik yasaları önemli: GDPR, CCPA ve benzeri düzenlemeler; veri toplama gerekçesi, etkiyi minimize etme ve opt-out taleplerine uyma gibi yükümlülükler getirir ().

- Uyumluluk kontrol listesi: Onaylı siteler ve veri tipleriyle sınırlı kalın, açıkça izin verilmedikçe hassas/kişisel veriden kaçının, süreci dokümante edin ve kimlik bilgilerini güvenli yönetin ().

- Şeffaflık: Uyumluluk gereksinimlerinizi geliştiriciyle en baştan paylaşın ve iş kapsamına dahil edin.

Thunderbit, kamuya açık ve iş odaklı verilere odaklanarak; neyi neden topladığını belgelemeyi kolaylaştırmasıyla da işini rahatlatır.

Adım Adım: Web Scraping Geliştiricisi Nasıl İşe Alınır?

Başlamaya hazır mısın? İşte basit ve uygulanabilir bir yol haritası:

- İhtiyacını netleştir: Hangi veriye ihtiyacın var? Hangi sitelerden? Ne sıklıkla? Hangi formatta?

- “Veri sözleşmesi” hazırla: Gerekli alanlar, veri tipleri, yenileme sıklığı ve kabul kriterleri.

- İşe alım platformunu seç: Upwork, Freelancer, Toptal veya Fiverr—bütçe, zaman ve eleme ihtiyacına göre.

- İlanı yayınla: Teslimatlar, takvim ve uyumluluk gereksinimlerinde net ol.

- Adayları ele: Yukarıdaki liste ve soruları kullan. Örnek iş veya küçük ücretli test iste.

- Milestone’ları pazarlık et: Mantıklı parçalara böl ve her parça için net çıktı tanımla.

- Projeyi yönet: Düzenli kontrol, QA kapıları ve ortak araçlarla ilerlemeyi takip et.

- Bakımı planla: Güncellemeler, düzeltmeler ve değişiklikler nasıl yönetilecek, belirle.

- Her şeyi dokümante et: README, runbook ve net bir devir teslim süreci iste.

Ve şunu unutma: Pek çok rutin işte hiç işe alım yapman gerekmeyebilir—önce ile dene, ihtiyacını karşılıyor mu gör.

Sonuç ve Öne Çıkanlar

web scraping geliştiricisi işe al yaklaşımı artık sadece teknoloji devlerine özgü bir lüks değil—web verisini iş değerine çevirmek isteyen her ekip için gerçek bir ihtiyaç. Üstelik web scraping ve veri çıkarma pazarı gösterirken, riskler (ve karmaşıklık) da aynı hızla artıyor.

En kritik noktalar:

- Güçlü programlama, gerçek dünya scraping deneyimi ve veri mühendisliği bakışı olan geliştiricileri seç.

- Upwork, Freelancer ve Toptal gibi platformlarla yetenek bul; ama net sözleşmeler, milestone’lar ve QA kapılarıyla projeyi disiplinli yönet.

- Rutin ve hızlı işler için gibi araçlar; zaman, para ve bakım yükünden tasarruf sağlar—kod yazmadan.

- Uyumluluk, gizlilik ve dokümantasyonu her zaman önceliklendir.

- En iyi sonuçlar; net beklentiler, düzenli iletişim ve sitelerin (kaçınılmaz) değişimine uyum sağlama isteğiyle gelir.

İşe almadan önce kendine şunu sor: Bu iş tek seferlik mi, düzenli bir ihtiyaç mı, yoksa iş açısından kritik bir veri hattı mı? Bazen en akıllı hamle, ekibini kullanımı kolay araçlarla güçlendirmek ve ağır mühendisliği gerçekten gerektiğinde devreye almaktır.

Geliştirici tutmadan neler yapabileceğini merak ediyor musun? ve kendin dene. Web scraping, veri otomasyonu veya modern bir veri altyapısı kurma hakkında daha fazla ipucu için sayfasına göz at.

SSS

1. Freelance web scraping uzmanı ile şirket içi web veri çıkarma uzmanı arasındaki fark nedir?

Freelance uzmanlar genellikle belirli, kısa süreli projeler veya niş hedefler için tutulur. Şirket içi uzmanlar ise süreklilik gerektiren, iş açısından kritik veri hatlarını ve entegrasyonları yönetir.

2. Web scraping geliştiricisi tutmanın maliyeti ne kadar?

Freelancer’lar genellikle saatlik $20–$40 veya proje başına $500–$5,000+ aralığında ücret alır; karmaşıklığa göre değişir. Şirket içi roller yıllık $100k+ seviyelerine çıkabilir. Thunderbit ise $15/ay’dan başlayan abonelik seçenekleri sunar.

3. Web scraping geliştiricisi işe alırken hangi becerilere bakmalıyım?

Güçlü programlama (Python, JS), dinamik siteler ve anti-bot stratejileri deneyimi, veri mühendisliği bilgisi ve Thunderbit gibi hem kodlu hem no-code araçlara aşinalık arayın.

4. Ne zaman geliştirici tutmak yerine Thunderbit gibi bir araç kullanmalıyım?

Thunderbit; hızlı, sık veya tek seferlik veri çekimleri, lead üretimi ya da fiyat takibi için idealdir—özellikle yapılandırılmış çıktı ve minimum kurulum istiyorsan. Karmaşık, iş açısından kritik veya çok özelleştirilmiş projelerde geliştirici tut.

5. Web scraping için işe alım yaparken hangi hukuki/uyumluluk konularını dikkate almalıyım?

Site kullanım şartlarına saygı göster, GDPR/CCPA gibi gizlilik yasalarına uy ve açık izin olmadan hassas/kişisel veri çekmekten kaçın. Süreci dokümante et ve geliştiricinin uyumluluk en iyi uygulamalarını izlediğinden emin ol.

Bir sonraki veri projeni başarıya taşımaya hazır mısın? Doğru plan, doğru insanlar ve doğru araçlarla; ne kadar fazlasını başarabileceğine şaşıracaksın.

Daha Fazlasını Keşfedin