Dürüst olayım: büyük bir siteden ilk kez tüm URL’leri çekmeye çalıştığımda, “Ne kadar zor olabilir ki?” diye düşündüm. Birkaç saat sonra hâlâ sayfalar arasında durmadan tıklıyor, bağlantıları bir e-tabloya kopyalayıp yapıştırıyor ve hayat seçimlerimi sorguluyordum. Bir web sitesindeki tüm sayfaları bulmaya hiç çalıştıysanız — içerik denetimi, potansiyel müşteri listesi ya da rakip araştırması için olsun — bu çilenin ne olduğunu bilirsiniz. Sıkıcıdır, hata yapmaya açıktır ve açıkçası zamanınızın ve yeteneğinizin israfıdır.

Ama iyi haber şu: Artık bunu zor yoldan yapmak zorunda değilsiniz. gibi yapay zekâ destekli araçlar, iş kullanıcıları için oyunun kurallarını değiştiriyor; bir alan adındaki tüm URL’leri bulmayı günler yerine dakikalar içinde mümkün kılıyor. Hatta yapay zekâ destekli web scraping araçlarını kullanan şirketler, veri toplama işlerinde bildirdi ve bazıları manuel yöntemlere kıyasla görüyor. Bu yalnızca bir istatistik değil; hayatınızdan geri kazandığınız saatler, hatta günler demek.

Gelin, bir web sitesindeki tüm sayfaları bulmanın neden bu kadar zor olduğuna, GPT ya da Claude gibi genel amaçlı yapay zekâ modellerinin neden pek yardımcı olamadığına ve Thunderbit gibi uzmanlaşmış yapay zekâ ajanlarının bu işi nasıl çocuk oyuncağına çevirdiğine bakalım. Evet, kod yazmayı bilmiyor olsanız bile ihtiyacınız olan her URL’yi nasıl çıkaracağınızı adım adım anlatacağım.

Bir Alan Adındaki Tüm URL’leri Bulmak Neden Bu Kadar Zor?

Kabul edelim: web siteleri, içerdikleri her sayfanın düzenli bir listesini size sunmak için tasarlanmamıştır. Ziyaretçiler için yapılırlar; bir sitedeki tüm sayfaları aynı anda bulmaya çalışanlar için değil. Bu iş neden bu kadar baş ağrıtıcı, gelin bakalım:

- Manuel Kopyala-Yapıştır Çılgınlığı: Her menüye, listeye ve dizine tek tek tıklayıp URL’leri birer birer kopyalamak, bileklerinizi zorlamanın ve sayfaların yarısını kaçırmanın en iyi yoludur.

- Sayfalama ve Sonsuz Kaydırma: Birçok site içeriği birden fazla sayfaya böler ya da siz aşağı kaydırdıkça daha fazla sonuç yükler. “Sonraki” düğmesini atlamak ya da yeterince aşağı kaydırmamak, tüm bölümleri kaçırmanıza neden olur.

- Tutarsız Sayfa Yapıları: Bazı sayfalar bağlantıları bir formatta listeler, diğerleri bambaşka bir düzen kullanır. Hepsini takip etmek tam bir kabustur.

- Gizli ya da Sahipsiz Sayfalar: Her sayfa ana menüden bağlantı almaz. Bazıları derine gömülüdür; yalnızca site haritaları ya da dahili arama ile bulunabilir.

- İnsan Hatası: Ne kadar çok sayfa kopyalamanız gerekirse, hata yapma ihtimaliniz o kadar artar — yinelenen URL’ler, yazım hataları ya da düpedüz atlanan satırlar.

Peki ya yüzlerce hatta binlerce sayfası olan bir site üzerinde çalışıyorsanız? O zaman manuel çıkarma yöntemini unutun. Ölçeklenmez. Bir veri ekibinin dediği gibi, önemsiz vakaların ötesinde her durumda, .

“Bir Web Sitesindeki Tüm Sayfaları Bulmak” Ne Anlama Gelir?

Çözümlere geçmeden önce, aslında ne aradığımızı netleştirelim.

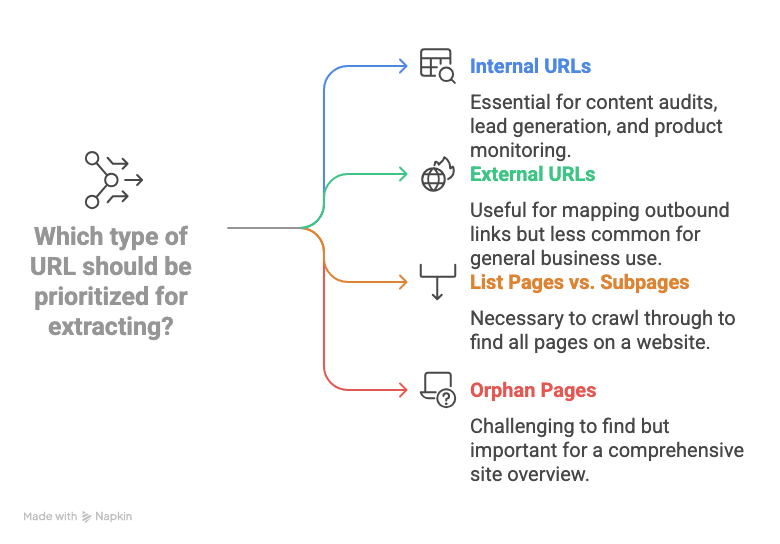

- Dahili URL’ler: Aynı alan adındaki sayfalara giden bağlantılardır (örneğin /about-us ya da /products/widget-123). Çoğu iş senaryosunda — içerik denetimi, potansiyel müşteri üretimi, ürün takibi — ana hedef bunlardır.

- Harici URL’ler: Başka web sitelerine giden bağlantılardır. Genelde, giden bağlantıları haritalamıyorsanız bunlara ihtiyacınız olmaz.

- Liste Sayfaları ve Alt Sayfalar: Birçok sitede bağlantıları başka sayfalara veren “merkez” ya da “liste” sayfaları vardır (kategori sayfaları, blog arşivleri, dizinler gibi). Gerçekten bir web sitesindeki tüm sayfaları bulmak için bu listelerin içinden geçip bağladıkları her alt sayfayı toplamanız gerekir.

- Sahipsiz Sayfalar: Açıkça bağlantı verilmeyen sayfalardır. Bazen site haritaları veya dahili arama ile yakalanabilirler, ama kolayca gözden kaçarlar.

Dolayısıyla, bir alan adındaki tüm URL’leri bulmaktan söz ederken kastımız şudur: ana sayfadan en derin ürün ya da makaleye kadar tüm dahili sayfa URL’lerini, ideal olarak bir e-tabloda kullanabileceğiniz bir biçimde elde etmek.

Bir Alan Adındaki Tüm URL’leri Bulmanın Geleneksel Yöntemleri

Bunu çözmek için birkaç klasik yöntem var; ama her birinin kendine özgü sıkıntıları da var:

Manuel Kopyala-Yapıştır ve Tarayıcı Araçları

Bu, “gücünü kullan” yaklaşımıdır: her bağlantıya tıklarsınız, her URL’yi kopyalarsınız, bir e-tabloya yapıştırırsınız ve hiçbir şeyi kaçırmadığınızı umarsınız. Bazı kişiler, mevcut sayfadaki tüm bağlantıları almak için tarayıcı eklentileri kullanır; ancak bunu yine her sayfa için tekrarlamanız gerekir ve sayfalama ya da gizli bölümler konusunda yalnız başınızasınızdır. Beş sayfalık bir site için idare eder; daha büyük bir şey için değil.

Site Araması ve Site Haritaları Kullanmak

- Google’ın site: araması: Google’a site:alanadiniz.com yazdığınızda dizine eklenmiş bir sürü sayfa görürsünüz. Ama Google yalnızca indekslediğini gösterir (çoğu zaman yaklaşık 1.000 sonuçla sınırlıdır), bu yüzden yeni, gizli veya düşük kaliteli sayfaları kaçırırsınız. bunun eksiksiz bir çözüm olmadığını kabul ediyor.

- XML Site Haritaları: Birçok sitede önemli URL’leri listeleyen bir /sitemap.xml bulunur. Harika — tabii site haritası güncelse ve her sayfayı içeriyorsa. Ancak her sitede yoktur; bazılarında site haritası birden fazla dosyaya bölünmüştür. Sahipsiz sayfalar çoğu zaman dışarıda kalır.

Teknik Tarayıcılar ve Betikler

- SEO Araçları (Screaming Frog gibi): Bunlar bir siteyi arama motoru gibi tarar ve size bir URL listesi çıkarır. Güçlüdürler, ancak kurulum, yapılandırma ve büyük siteler için bazen ücretli lisans gerektirirler.

- Python Betikleri (Scrapy gibi): Geliştiriciler URL’leri taramak ve çıkarmak için betikler yazabilir. Ama dürüst olalım: kodla rahat değilseniz bu seçenek baştan elenir. Üstelik sitenin düzeni değiştiğinde betikler bozulur; yani sürekli yetişmeye çalışırsınız.

Kısacası: Geleneksel yöntemler çoğu iş kullanıcısı için ya fazla manuel, ya eksik, ya da fazla teknik. Bu yüzden bu işi yarıda bırakan o kadar çok insan var.

Neden Genel Amaçlı Yapay Zekâ Modelleri URL Çıkarmayı Tam Olarak Otomatikleştiremez?

Şunu düşünüyor olabilirsiniz: “Neden ChatGPT ya da Claude’a sitedeki tüm sayfaları bulmasını söylemeyeyim?” Keşke bu kadar kolay olsaydı. Gerçek şu:

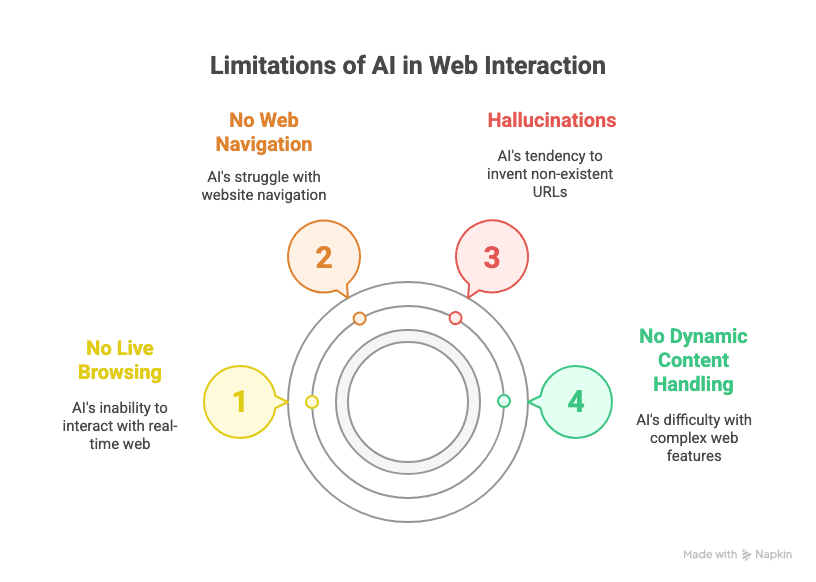

- Canlı Tarama Yok: GPT veya Claude gibi genel amaçlı yapay zekâ modelleri web’de gerçek zamanlı dolaşamaz. Bir web sitesinin o anki hâlini “görmezler”; yalnızca eğitim verileriyle ya da sizin yapıştırdığınız içerikle çalışırlar.

- Web’de Gezinme Yok: Eklentiler veya tarama özelliği açık olsa bile, LLM’ler “Sonraki”ye tıklamayı, sonsuz kaydırmayı işlemeyi ya da bir sitedeki her bağlantıyı sistematik biçimde izlemeyi bilmez.

- Halüsinasyonlar: Bir genel amaçlı yapay zekâdan bir alan adındaki tüm URL’leri isteyin; çoğu zaman kulağa mantıklı gelen ama gerçekte var olmayan bağlantılar uydurur. (Hiç /about-us sayfası olmayan siteler için böyle sayfalar icat ettiğine şahit oldum.)

- Dinamik İçerik Desteği Yok: JavaScript ile içerik yükleyen, giriş gerektiren ya da karmaşık gezinme yapısına sahip siteler genel LLM’lerin erişim alanının dışındadır.

şöyle deniyor: “Yüzlerce ya da binlerce sayfayı scrape etmek istiyorsanız… ChatGPT tek başına yetersiz kalır.” Bunun için özellikle bu iş için tasarlanmış bir araca ihtiyacınız var.

Dikey Yapay Zekâ Ajanları Gelecektir (ve Bunun Önemi)

İşte SaaS ve otomasyon konusundaki deneyimimin devreye girdiği yer: dikey yapay zekâ ajanları — web verisi çıkarma gibi belirli bir alan için geliştirilmiş yapay zekâ araçları — iş görevlerinde güvenilir ve ölçeklenebilir sonuç almanın tek yoludur. Neden mi?

- Genel amaçlı LLM’ler yazma ya da arama için harikadır, ancak “halüsinasyon” üretmeye eğilimlidirler ve işletmelerin ihtiyaç duyduğu kararlılıkla çok adımlı, tekrarlanabilir iş akışlarını yönetemezler.

- Kurumsal SaaS araçlarının çok sayıda tekrarlayan, yapılandırılmış işi otomatikleştirmesi gerekir. Dikey yapay zekâ ajanlarının parladığı yer burasıdır — tek bir şeyi yapmak ve bunu en az hatayla iyi yapmak için tasarlanmışlardır.

- Sektörler boyunca örnekler bol: web veri çıkarma için Thunderbit, yazılım geliştirme için Devin AI, satış otomasyonu için Alta, eğitim için Infinity Learn’ün IL VISTA’sı, İK için Rippling, hukuk için Harvey… liste uzayıp gidiyor.

Kısacası: Bir web sitesindeki tüm sayfaları güvenilir biçimde bulmak istiyorsanız, iş için üretilmiş bir dikey yapay zekâ ajanına ihtiyacınız var; genel amaçlı bir sohbet botuna değil.

Thunderbit ile Tanışın: Herkes İçin Yapay Zekâ Destekli URL Çıkarma

İşte burada devreye giriyor. Bir AI web scraper Chrome eklentisi olarak Thunderbit, iş kullanıcıları için tasarlanmıştır — kod yok, teknik kurulum yok, sadece sonuç var. Onu farklı kılan şeyler şunlar:

- Doğal Dil Arayüzü: Sadece ne istediğinizi anlatın (“Bu sitedeki tüm sayfa URL’lerini listele”), Thunderbit’in yapay zekâsı bunu nasıl çıkaracağını çözer.

- Yapay Zekâ ile Alan Önerisi: Thunderbit sayfayı tarar ve otomatik olarak sütun adları önerir (“Sayfa URL’si” gibi) — CSS seçicilerle ya da XPath ile uğraşmanız gerekmez.

- Sayfalama ve Sonsuz Kaydırma Desteği: Thunderbit “Sonraki”ye tıklayabilir veya otomatik olarak aşağı kaydırabilir; böylece hiçbir sayfayı kaçırmazsınız.

- Alt Sayfa Gezinmesi: Daha derine inmeniz mi gerekiyor? Thunderbit bağlantıları takip edip alt sayfalardan da veri çekebilir.

- Yapılandırılmış Dışa Aktarım: Sonuçlarınızı Google Sheets, Excel, Notion, Airtable veya CSV’ye doğrudan, tek tıkla ve ücretsiz olarak aktarın.

- Kod Gerekmez: Bir web sitesinde gezinebiliyorsanız Thunderbit’i kullanabilirsiniz. Bu kadar basit.

Ve Thunderbit bir dikey yapay zekâ ajanı olduğu için, kararlılık ve tekrar edilebilirlik için tasarlanmıştır — aynı işleri defalarca otomatikleştirmesi gereken iş kullanıcıları için birebirdir.

Adım Adım: Thunderbit ile Bir Alan Adındaki Tüm URL’leri Nasıl Bulursunuz?

Nasıl çalıştığını görmek ister misiniz? İhtiyacınız olan her URL’yi çıkarmak için teknik olmayan bir anlatımla ilerleyelim.

1. Thunderbit Chrome Eklentisini Kurun

İlk iş: . Chrome, Edge, Brave ve diğer Chromium tabanlı tarayıcılarda çalışır. Kolay erişim için araç çubuğunuza sabitleyin.

2. Hedef Listenizi veya Dizin Sayfanızı Açın

URL’leri çıkarmak istediğiniz web sitesine gidin. Bu ana sayfa, bir site haritası, bir dizin ya da önem verdiğiniz sayfalara bağlantı veren herhangi bir liste sayfası olabilir.

3. Thunderbit’i Başlatın ve Alanlarınızı Kurun

Eklentiyi açmak için Thunderbit simgesine tıklayın. Yeni bir scraper şablonu başlatın. Sihir burada başlıyor:

- “AI Alanları Öner” seçeneğine tıklayın. Thunderbit’in yapay zekâsı sayfayı tarayıp sütunlar önerecek — “Sayfa URL’si”, “Bağlantı” ya da benzeri bir etiket arayın.

- İstediğiniz alanın tam adını görmüyorsanız, sadece “Sayfa URL’si” adında bir sütun ekleyin (ya da ne anlamlıysa onu). Thunderbit’in yapay zekâsı bu terimleri tanıyacak ve doğru veriye eşleştirecek şekilde eğitilmiştir.

4. Gerekirse Sayfalama veya Kaydırmayı Etkinleştirin

Hedef sayfanızda birden fazla sayfa varsa (“1., 2., 3. sayfa…” gibi ya da bir “Daha fazla yükle” düğmesi), Thunderbit’te sayfalama özelliğini açın:

- “Sonraki” düğmesi olan siteler için “Tıklayarak Sayfalama” moduna, aşağı kaydırdıkça daha fazla içerik yükleyen siteler için “Sonsuz Kaydırma” moduna geçin.

- Thunderbit sizden “Sonraki” düğmesini ya da kaydırma alanını seçmenizi ister — sadece tıklayın, gerisini yapay zekâ halleder.

5. Scraping’i Başlatın ve Sonuçlarınızı Kontrol Edin

“Scrape” düğmesine basın. Thunderbit tüm sayfaları tarayacak ve bulduğu her URL’yi toplayacaktır. Sonuçların eklenti içinde doğrudan bir tabloda dolduğunu göreceksiniz. Büyük sitelerde bu birkaç dakika sürebilir, ama yine de elle yapmaktan çok daha hızlıdır.

6. URL Listenizi Dışa Aktarın

Scrape işlemi bittiğinde Export seçeneğine tıklayın. Verilerinizi doğrudan şuralara gönderebilirsiniz:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Dışa aktarımlar ücretsizdir ve tüm biçimlendirmeyi korur. Artık kopyala-yapıştır eziyeti yok.

Thunderbit’i Diğer URL Çıkarma Çözümleriyle Karşılaştırma

| Yöntem | Kullanım Kolaylığı | Doğruluk ve Kapsam | Ölçeklenebilirlik | Dışa Aktarım Seçenekleri |

|---|---|---|---|---|

| Manuel Kopyala-Yapıştır | Can sıkıcı | Düşük (kolayca kaçırılır) | Yok | Manuel (Excel vb.) |

| Tarayıcı Bağlantı Çıkarıcıları | 1 sayfa için iyi | Orta | Zayıf | Manuel |

Google site: Araması | Kolay | Orta (eksiksiz değil) | ~1.000 sonuçla sınırlı | Manuel |

| XML Site Haritası | Kolay (varsa) | İyi (güncelse) | İyi | Manuel/Betik |

| SEO Araçları (Screaming Frog) | Teknik | Yüksek | Yüksek (ücretli) | CSV, Excel |

| Python Betikleri (Scrapy vb.) | Çok teknik | Yüksek | Yüksek | Özel |

| Thunderbit | Çok kolay | Çok yüksek | Yüksek | Google Sheets, CSV vb. |

Thunderbit size profesyonel bir tarayıcının doğruluğunu ve ölçeğini bir tarayıcı eklentisinin kullanım kolaylığıyla sunar. Kod yok, kurulum yok, sadece sonuç var.

Bonus: Thunderbit ile Sadece URL’lerden Fazlasını Çıkarma

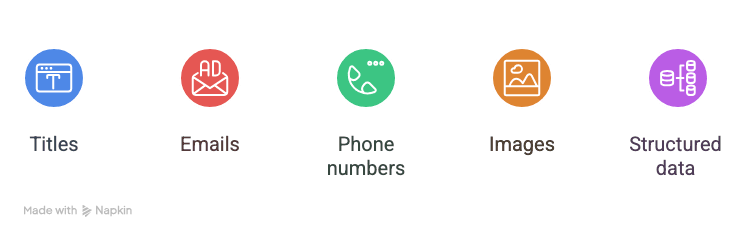

İşin ilginç kısmı burada başlıyor. Thunderbit yalnızca URL’ler için değil; şunları da çıkarabilirsiniz:

- Başlıklar

- E-postalar

- Telefon numaraları

- Görseller

- Sayfadaki herhangi bir yapılandırılmış veri

Örneğin, bir potansiyel müşteri listesi oluşturuyorsanız, Thunderbit’in her dizin girdisinden profil URL’sini, adı, e-postayı ve telefon numarasını tek seferde almasını sağlayabilirsiniz. Ürün denetimi yapıyorsanız, ürün URL’sini, adını, fiyatını ve stok durumunu çekebilirsiniz. Thunderbit ayrıca desteği sunar; yani her bağlantıya tıklayıp oradaki ayrıntıları da çıkarabilir.

Ve evet, Thunderbit’in e-posta ve telefon çıkarıcıları tamamen ücretsizdir. Satış ve pazarlama ekipleri için bu büyük bir avantajdır.

Önemli Çıkarımlar: Yapay Zekâ ile Bir Web Sitesindeki Tüm Sayfalar Nasıl Bulunur?

Kısaca toparlayalım:

- Bir alan adındaki tüm URL’leri çıkarmak, manuel ya da genel araçlarla zordur.

- GPT gibi genel amaçlı yapay zekâ modelleri web’de gezinme, sayfalama veya dinamik içerikle baş edemez.

- Thunderbit gibi dikey yapay zekâ ajanları web verisi çıkarma için özel olarak tasarlanmıştır — kararlı, tekrar edilebilir ve iş kullanıcıları için kolaydır.

- Thunderbit işi basitleştirir: eklentiyi kurun, alanları önermek için yapay zekâyı kullanın, sayfalama açın, scrape edin ve dışa aktarın. Kod yok, uğraş yok.

- Sadece URL’lerden fazlasını çıkarabilirsiniz: başlıklar, e-postalar, telefon numaraları ve daha fazlası — potansiyel müşteri üretimi, denetim ya da araştırma için mükemmel.

Bağlantıları kopyala-yapıştırmaktan ya da teknik tarayıcılarla boğuşmaktan yorulduysanız, . Ücretsiz bir planı var; böylece ne kadar zaman ve akıl sağlığı kazanacağınızı kendiniz görebilirsiniz.

Thunderbit’in başka neler yapabildiğini merak ediyorsanız — mesela , ya da — daha fazla rehber ve ipucu için sayfasına göz atın.

Manuel veri toplamaya harcadığınız zamanı geri kazanmak için hazır mısınız? Web verisi çıkarma geleceği dikey yapay zekâ ajanlarında; Thunderbit de bu alanda öncü. Deneyin ve bir sonraki denetiminizin, potansiyel müşteri listenizin ya da araştırma projenizin şimdiye kadarki en kolay iş olmasına izin verin.

Daha Fazla Okuyun

P.S. Eğer bir gün 1.000 URL’yi elle kopyala-yapıştırmaya kalkışacak gibi olursanız, şunu hatırlayın: artık bunun için bir yapay zekâ var. Bilekleriniz de patronunuz da size teşekkür edecek.