Web scraping için hangi programlama dilini seçmelisin? Cevap tamamen projenin karakterine bağlı — ve sırf yanlış dili seçtiği için “tamam ya, ben bu işi bırakıyorum” noktasına gelen geliştiriciler gördüm.

Web scraping yazılım pazarı 2024’te . Doğru dil; daha hızlı çıktı, daha az bakım demek. Yanlış dil ise sürekli patlayan scraper’lar ve çöpe giden hafta sonları.

Yıllardır otomasyon araçları geliştiriyorum. Aşağıda scraping için en sık başvurduğum yedi dili; kod örnekleri, net artı-eksi’ler ve bazen de kodu tamamen kenara bırakıp kullanmanın daha mantıklı olduğu senaryolarla birlikte anlatıyorum.

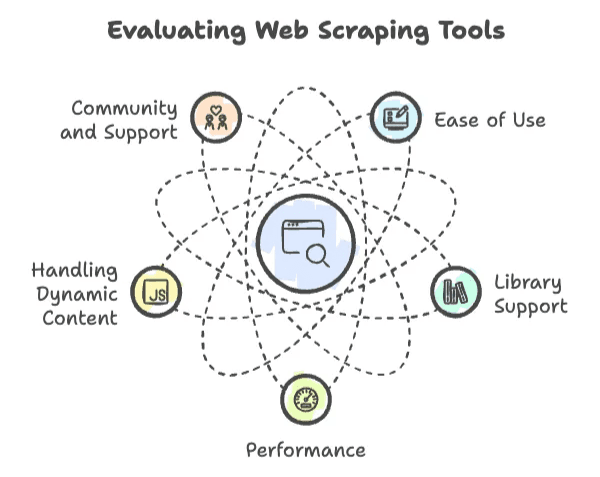

Web Scraping için En İyi Dili Nasıl Seçtik?

Web scraping işinde her dil aynı ligde oynamıyor. Birkaç kritik kriter var; doğru seçim projeyi uçurur, yanlış seçim yere çakar:

- Kullanım Kolaylığı: Ne kadar çabuk ayağa kalkıyorsun? Söz dizimi akıcı mı, yoksa “Hello World” için bile bilgisayar bilimi doktorası mı lazım?

- Kütüphane Desteği: HTTP istekleri, HTML ayrıştırma ve dinamik içerik yönetimi için sağlam kütüphaneler var mı? Yoksa her şeyi sıfırdan mı örüyorsun?

- Performans: Milyonlarca sayfayı kaldırır mı, yoksa birkaç yüz sayfada nefesi mi kesilir?

- Dinamik İçerikle Başa Çıkma: Modern siteler JavaScript’e bayılıyor. Seçtiğin dil buna yetişebiliyor mu?

- Topluluk ve Destek: Duvara tosladığında (toslayacaksın), el uzatacak bir topluluk var mı?

Bu kriterlere — ve gecenin bir yarısı yapılan bolca deneme-yanılmaya — dayanarak ele alacağım yedi dil şunlar:

- Python: Hem yeni başlayanların hem profesyonellerin gözdesi.

- JavaScript & Node.js: Dinamik içerikte en rahat seçeneklerden.

- Ruby: Tertemiz söz dizimi, hızlı script’ler.

- PHP: Sunucu tarafında pratik ve erişilebilir.

- C++: Ham hız gerektiğinde.

- Java: Kurumsal ölçekte sağlam ve ölçeklenebilir.

- Go (Golang): Hızlı ve concurrency konusunda çok güçlü.

Ve eğer “Shuai, ben hiç kod yazmak istemiyorum” diyorsan, en sonda Thunderbit kısmını sakın atlama.

Python ile Web Scraping: Yeni Başlayan Dostu Güç Merkezi

Herkesin favorisiyle açalım: Python. Veriyle uğraşan bir odaya “web scraping için en iyi programlama dili hangisi?” diye sorsan, Taylor Swift konserindeki tezahürat gibi Python sesi yükselir.

Neden Python?

- Yeni başlayan dostu söz dizimi: Python kodunu sesli okuyunca neredeyse İngilizce gibi akar.

- Rakipsiz kütüphane ekosistemi: HTML ayrıştırma için , büyük ölçekli crawling için , HTTP için ve tarayıcı otomasyonu için — hepsi elinin altında.

- Devasa topluluk: Sadece web scraping tarafında bile var.

Python Örnek Kod: Sayfa Başlığını Çekme

1import requests

2from bs4 import BeautifulSoup

3response = requests.get("<https://example.com>")

4soup = BeautifulSoup(response.text, 'html.parser')

5title = soup.title.string

6print(f"Page title: {title}")Güçlü Yanları:

- Hızlı geliştirme ve prototipleme.

- Tonla eğitim içeriği ve soru-cevap kaynağı.

- Veri analiziyle müthiş uyum: Python ile scrape et, pandas ile analiz et, matplotlib ile görselleştir.

Sınırlamaları:

- Çok büyük işlerde derlenen dillere göre daha yavaş kalabilir.

- Aşırı dinamik sitelerde süreç ağırlaşabilir (Selenium ve Playwright burada imdada yetişir).

- Milyonlarca sayfayı “ışık hızında” çekmek için en ideal seçenek değildir.

Özet:

Scraping’e yeni giriyorsan ya da hızlıca sonuç almak istiyorsan, web scraping için en iyi dil Python’dur — net. .

JavaScript & Node.js: Dinamik Siteleri Rahatça Scrape Etmek

Python bir İsviçre çakısıysa, JavaScript (ve Node.js) özellikle JavaScript’le şişirilmiş modern sitelerde tam bir matkap gibi çalışır.

Neden JavaScript/Node.js?

- Dinamik içerikte doğal avantaj: Tarayıcı dili olduğu için kullanıcı ne görüyorsa onu yakalar — sayfa React, Angular veya Vue ile kurulmuş olsa bile.

- Varsayılan olarak async: Node.js aynı anda yüzlerce isteği çevirebilir.

- Web geliştiricilere tanıdık: Web geliştirdiysen zaten JavaScript’e aşinasındır.

Öne Çıkan Kütüphaneler:

- : Headless Chrome otomasyonu.

- : Çoklu tarayıcı otomasyonu.

- : Node için jQuery tadında HTML ayrıştırma.

Node.js Örnek Kod: Puppeteer ile Sayfa Başlığını Çekme

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('<https://example.com>', { waitUntil: 'networkidle2' });

6 const title = await page.title();

7 console.log(`Page title: ${title}`);

8 await browser.close();

9})();Güçlü Yanları:

- JavaScript ile render edilen içeriği doğal şekilde yakalar.

- Sonsuz kaydırma, pop-up ve etkileşimli sayfalarda çok başarılıdır.

- Büyük ölçekte eşzamanlı scraping için verimlidir.

Sınırlamaları:

- Async mantığı yeni başlayanları biraz zorlayabilir.

- Headless tarayıcılar paralel çalışınca RAM’i hızlıca sömürebilir.

- Python’a kıyasla veri analizi tarafındaki araçlar daha sınırlıdır.

JavaScript/Node.js ne zaman web scraping için en iyi seçim olur?

Hedef siten dinamikse veya tarayıcı aksiyonlarını otomatikleştirmen gerekiyorsa. .

Ruby: Hızlı Web Scraping Script’leri için Temiz Söz Dizimi

Ruby sadece Rails ve “şık kod şiiri” değil. Web scraping için de gayet sağlam bir seçenek — özellikle kodun haiku gibi akmasını seviyorsan.

Neden Ruby?

- Okunabilir ve ifade gücü yüksek söz dizimi: Ruby ile yazdığın bir scraper, alışveriş listesi gibi okunur.

- Prototipleme için ideal: Yazması hızlı, değiştirmesi kolay.

- Önemli kütüphaneler: Ayrıştırma için , gezinmeyi otomatikleştirmek için .

Ruby Örnek Kod: Sayfa Başlığını Çekme

1require 'open-uri'

2require 'nokogiri'

3html = URI.open("<https://example.com>")

4doc = Nokogiri::HTML(html)

5title = doc.at('title').text

6puts "Page title: #{title}"Güçlü Yanları:

- Çok okunabilir ve kısa.

- Küçük projeler, tek seferlik script’ler veya zaten Ruby kullanıyorsan harika.

Sınırlamaları:

- Büyük işlerde Python veya Node.js kadar hızlı değildir.

- Scraping tarafında daha az kütüphane ve daha küçük topluluk.

- JavaScript ağırlıklı siteler için ideal değil (Watir veya Selenium ile çözülür).

En uygun senaryo:

Ruby kullanıyorsan veya hızlı bir script çıkarmak istiyorsan Ruby keyiflidir. Devasa ve dinamik scraping için başka seçeneklere bakmak daha doğru olur.

PHP: Web Verisi Çıkarmada Sunucu Tarafı Pratikliği

PHP kulağa “eski internet” gibi gelebilir ama hâlâ sahnede — özellikle veriyi doğrudan sunucunda çekmek istiyorsan.

Neden PHP?

- Her yerde çalışır: Çoğu web sunucusunda PHP zaten hazır gelir.

- Web uygulamalarına kolay entegrasyon: Veriyi çekip aynı akışta sitende gösterebilirsin.

- Önemli kütüphaneler: HTTP için , istekler için , headless tarayıcı otomasyonu için .

PHP Örnek Kod: Sayfa Başlığını Çekme

1<?php

2$ch = curl_init("<https://example.com>");

3curl_setopt($ch, CURLOPT_RETURNTRANSFER, true);

4$html = curl_exec($ch);

5curl_close($ch);

6$dom = new DOMDocument();

7@$dom->loadHTML($html);

8$title = $dom->getElementsByTagName("title")->item(0)->nodeValue;

9echo "Page title: $title\n";

10?>Güçlü Yanları:

- Web sunucularında dağıtımı kolay.

- Web iş akışının bir parçası olarak scraping için uygun.

- Basit sunucu tarafı scraping işlerinde hızlıdır.

Sınırlamaları:

- İleri seviye scraping için kütüphane desteği daha sınırlı.

- Yüksek eşzamanlılık veya dev ölçek için tasarlanmamıştır.

- JavaScript ağırlıklı siteler zorlayabilir (Panther burada yardımcı olur).

En uygun senaryo:

Teknoloji yığınında zaten PHP varsa veya veriyi çekip sitende göstermek istiyorsan, PHP gayet mantıklı bir tercihtir. .

C++: Büyük Ölçekli Projeler için Yüksek Performanslı Web Scraping

C++ programlama dillerinin kaslı spor arabasıdır. Ham hız ve kontrol istiyorsan ve biraz “el emeği” gözünü korkutmuyorsa, C++ seni bayağı ileri taşır.

Neden C++?

- Çok hızlı: CPU ağırlıklı işlerde çoğu dili geride bırakır.

- İnce ayar kontrolü: Bellek, thread’ler ve performans optimizasyonlarında tam kontrol.

- Önemli kütüphaneler: HTTP için , ayrıştırma için .

C++ Örnek Kod: Sayfa Başlığını Çekme

1#include <curl/curl.h>

2#include <iostream>

3#include <string>

4size_t WriteCallback(void* contents, size_t size, size_t nmemb, void* userp) {

5 std::string* html = static_cast<std::string*>(userp);

6 size_t totalSize = size * nmemb;

7 html->append(static_cast<char*>(contents), totalSize);

8 return totalSize;

9}

10int main() {

11 CURL* curl = curl_easy_init();

12 std::string html;

13 if(curl) {

14 curl_easy_setopt(curl, CURLOPT_URL, "<https://example.com>");

15 curl_easy_setopt(curl, CURLOPT_WRITEFUNCTION, WriteCallback);

16 curl_easy_setopt(curl, CURLOPT_WRITEDATA, &html);

17 CURLcode res = curl_easy_perform(curl);

18 curl_easy_cleanup(curl);

19 }

20 std::size_t startPos = html.find("<title>");

21 std::size_t endPos = html.find("</title>");

22 if(startPos != std::string::npos && endPos != std::string::npos) {

23 startPos += 7;

24 std::string title = html.substr(startPos, endPos - startPos);

25 std::cout << "Page title: " << title << std::endl;

26 } else {

27 std::cout << "Title tag not found" << std::endl;

28 }

29 return 0;

30}Güçlü Yanları:

- Devasa scraping işlerinde çok yüksek hız.

- Scraping’i yüksek performanslı sistemlere entegre etmek için ideal.

Sınırlamaları:

- Öğrenme eğrisi dik (kahveyi hazır et).

- Manuel bellek yönetimi.

- Üst seviye kütüphaneler sınırlı; dinamik içerik için uygun değil.

En uygun senaryo:

Milyonlarca sayfayı çekmen gerekiyorsa veya performans “olmazsa olmaz” ise. Yoksa scraping’den çok debug’a gömülme ihtimalin var.

Java: Kurumsal Seviyede Web Scraping Çözümleri

Java, kurumsal dünyanın yük beygiri. Uzun süre çalışacak, çok veri kaldıracak ve kıyamet kopsa bile ayakta kalacak bir şey kuruyorsan Java iyi bir yol arkadaşıdır.

Neden Java?

- Sağlam ve ölçeklenebilir: Büyük ve uzun soluklu scraping projeleri için biçilmiş kaftan.

- Güçlü tip sistemi ve hata yönetimi: Prod ortamında daha az sürpriz.

- Önemli kütüphaneler: Ayrıştırma için , tarayıcı otomasyonu için , HTTP için .

Java Örnek Kod: Sayfa Başlığını Çekme

1import org.jsoup.Jsoup;

2import org.jsoup.nodes.Document;

3public class ScrapeTitle {

4 public static void main(String[] args) throws Exception {

5 Document doc = Jsoup.connect("<https://example.com>").get();

6 String title = doc.title();

7 System.out.println("Page title: " + title);

8 }

9}Güçlü Yanları:

- Yüksek performans ve eşzamanlılık.

- Büyük ve sürdürülebilir kod tabanları için çok uygun.

- Dinamik içerik için iyi destek (Selenium veya HtmlUnit ile).

Sınırlamaları:

- Söz dizimi daha “uzun”; script dillerine göre daha fazla kurulum ister.

- Küçük, tek seferlik işler için fazla ağır kalabilir.

En uygun senaryo:

Kurumsal ölçekte scraping veya uzun vadede güvenilirlik ve ölçeklenebilirlik gerektiğinde.

Go (Golang): Hızlı ve Eşzamanlı Web Scraping

Go nispeten yeni sayılır ama özellikle yüksek hızlı ve eşzamanlı scraping tarafında hızlıca öne çıktı.

Neden Go?

- Derlenen dil hızı: C++’a yakın performans.

- Yerleşik concurrency: Goroutine’ler paralel scraping’i ciddi anlamda kolaylaştırır.

- Önemli kütüphaneler: Scraping için , ayrıştırma için .

Go Örnek Kod: Sayfa Başlığını Çekme

1package main

2import (

3 "fmt"

4 "github.com/gocolly/colly"

5)

6func main() {

7 c := colly.NewCollector()

8 c.OnHTML("title", func(e *colly.HTMLElement) {

9 fmt.Println("Page title:", e.Text)

10 })

11 err := c.Visit("<https://example.com>")

12 if err != nil {

13 fmt.Println("Error:", err)

14 }

15}Güçlü Yanları:

- Büyük ölçekli scraping’de çok hızlı ve verimli.

- Dağıtımı kolay (tek binary).

- Eşzamanlı crawling için çok uygun.

Sınırlamaları:

- Python veya Node.js kadar büyük bir topluluğu yok.

- Üst seviye scraping kütüphaneleri daha az.

- JavaScript ağırlıklı siteler için ekstra kurulum gerekir (Chromedp veya Selenium).

En uygun senaryo:

Ölçekli scraping gerektiğinde veya Python yeterince hızlı gelmediğinde. .

Web Scraping için En İyi Programlama Dillerinin Karşılaştırması

Hepsini tek tabloda toparlayalım. 2026’da web scraping için en doğru dili seçmene yardımcı olacak yan yana bir karşılaştırma:

| Dil/Araç | Kullanım Kolaylığı | Performans | Kütüphane Desteği | Dinamik İçerik Yönetimi | En İyi Kullanım Senaryosu |

|---|---|---|---|---|---|

| Python | Çok Yüksek | Orta | Mükemmel | İyi (Selenium/Playwright) | Genel amaç, yeni başlayanlar, veri analizi |

| JavaScript/Node.js | Orta | Yüksek | Güçlü | Mükemmel (doğal) | Dinamik siteler, async scraping, web geliştiriciler |

| Ruby | Yüksek | Orta | İyi | Sınırlı (Watir) | Hızlı script’ler, prototipleme |

| PHP | Orta | Orta | Orta | Sınırlı (Panther) | Sunucu tarafı, web uygulaması entegrasyonu |

| C++ | Düşük | Çok Yüksek | Sınırlı | Çok Sınırlı | Performans kritik, devasa ölçek |

| Java | Orta | Yüksek | İyi | İyi (Selenium/HtmlUnit) | Kurumsal, uzun süre çalışan servisler |

| Go (Golang) | Orta | Çok Yüksek | Gelişiyor | Orta (Chromedp) | Yüksek hızlı, eşzamanlı scraping |

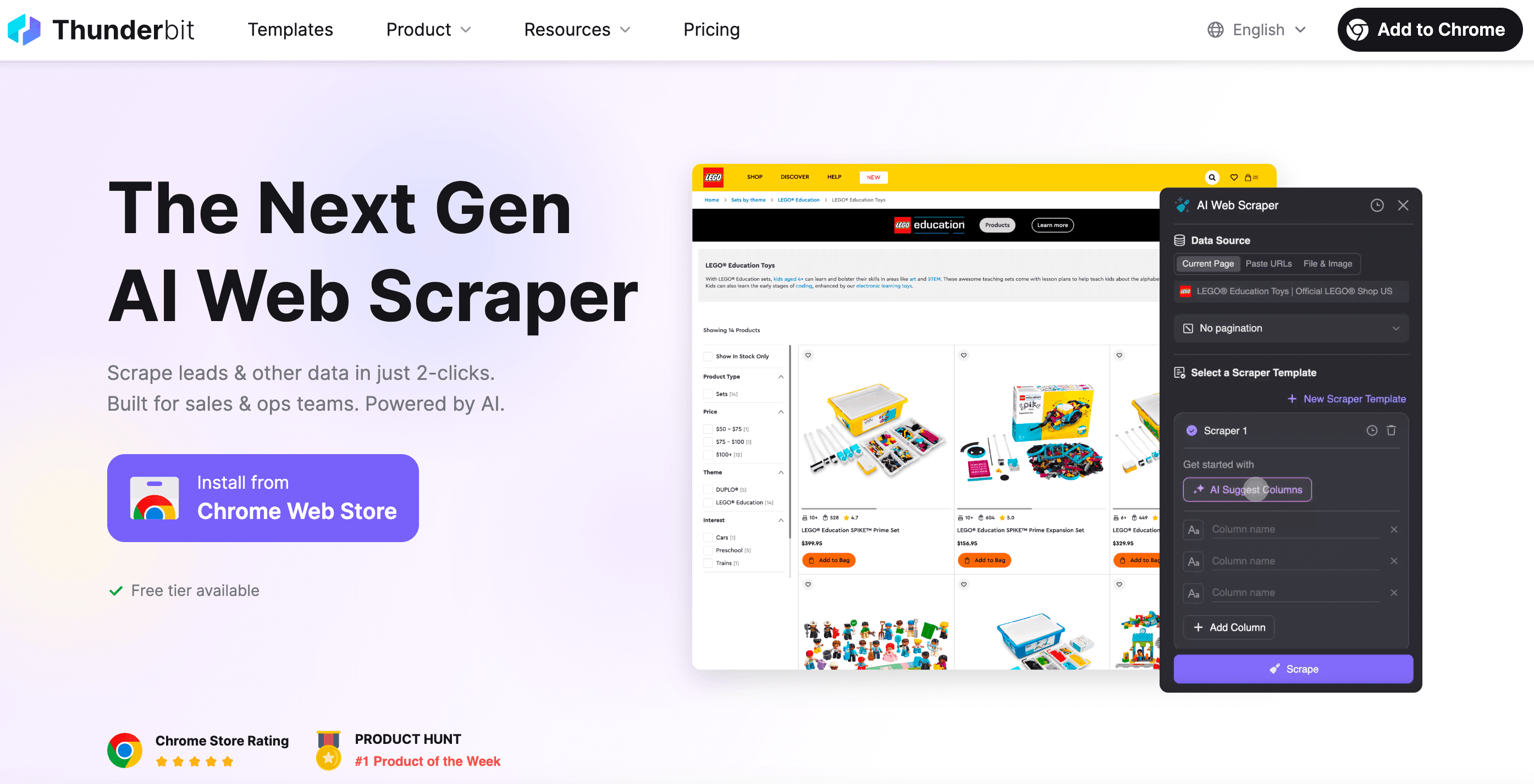

Ne Zaman Kod Yazmamalı: No-Code Web Scraping Çözümü Olarak Thunderbit

Dürüst olalım: Bazen tek istediğin şey veridir — kod yazmadan, debug’a girmeden, “bu selector niye yine bozuldu?” stresini yaşamadan. İşte tam bu noktada devreye giriyor.

Thunderbit’in kurucu ortağı olarak, web scraping’i yemek siparişi vermek kadar kolay hale getiren bir araç yapmak istedim. Thunderbit’i farklı kılan şeyler:

- 2 Tıkla Kurulum: “AI Suggest Fields” ve ardından “Scrape”e bas. HTTP istekleri, proxy’ler, anti-bot taktikleriyle uğraşmak yok.

- Akıllı Şablonlar: Tek bir scraper template, farklı sayfa düzenlerine uyum sağlayabilir. Site değiştikçe scraper’ı baştan yazman gerekmez.

- Tarayıcı & Bulut Scraping: Tarayıcıda scraping (giriş yapılmış siteler için süper) veya bulutta scraping (herkese açık veride çok hızlı) arasında seçim yap.

- Dinamik İçeriği Yönetir: Thunderbit’in yapay zekâsı gerçek bir tarayıcıyı kontrol eder; sonsuz kaydırma, pop-up, giriş ekranları ve daha fazlasını halleder.

- Her Yere Aktarın: Excel’e indir, Google Sheets, Airtable, Notion’a gönder veya panoya kopyala.

- Bakım Derdi Yok: Site değişirse AI önerisini yeniden çalıştır. Gece yarısı debug seanslarına son.

- Zamanlama & Otomasyon: Scraper’ları belirli aralıklarla çalışacak şekilde planla — cron job yok, sunucu kurulum derdi yok.

- Özel Extractor’lar: E-posta, telefon numarası veya görsel mi lazım? Thunderbit’te bunlar için tek tıkla extractor’lar var.

En güzel tarafı: Tek satır kod bilmen gerekmiyor. Thunderbit; iş kullanıcıları, pazarlamacılar, satış ekipleri, emlak profesyonelleri — kısacası hızlı ve düzenli veriye ihtiyaç duyan herkes için.

Thunderbit’i canlı görmek ister misin? veya demolar için uğra.

Sonuç: 2026’da Web Scraping için En İyi Dili Seçmek

2026’da web scraping her zamankinden daha ulaşılabilir — ve daha güçlü. Otomasyonun içinde yıllar geçirdikten sonra bende kalan net çıkarımlar şunlar:

- Python, hızlı başlamak ve bol kaynağa yaslanmak isteyenler için hâlâ en iyi seçenek.

- JavaScript/Node.js, dinamik ve JavaScript ağırlıklı sitelerde rakipsiz.

- Ruby ve PHP, özellikle zaten kullanıyorsan hızlı script’ler ve web entegrasyonu için çok iyi.

- C++ ve Go, hız ve ölçek gerektiğinde en yakın arkadaşın.

- Java, kurumsal ve uzun vadeli projelerde güvenilir bir tercih.

- Ve hiç kod yazmak istemiyorsan? Gizli silahın: .

Başlamadan önce kendine şunları sor:

- Projem ne kadar büyük?

- Dinamik içerikle uğraşmam gerekiyor mu?

- Teknik konfor seviyem ne?

- Bir şey inşa etmek mi istiyorum, yoksa sadece veriyi almak mı?

Yukarıdaki kod örneklerinden birini dene ya da bir sonraki işinde Thunderbit’i kullan. Daha derine inmek istersen, daha fazla rehber, ipucu ve gerçek hayattan scraping hikâyeleri için sayfamıza göz at.

Keyifli scraping’ler — verin hep temiz, düzenli ve tek tık uzağında olsun.

Not: Eğer kendini gece 2’de web scraping tavşan deliğinde kaybolmuş bulursan, şunu unutma: Her zaman Thunderbit vardır. Ya da kahve. Ya da ikisi birden.

SSS

1. 2026’da web scraping için en iyi programlama dili hangisi?

Python; okunabilir söz dizimi, güçlü kütüphaneleri (BeautifulSoup, Scrapy, Selenium gibi) ve geniş topluluğu sayesinde hâlâ ilk sırada. Scraping’i veri analiziyle birleştirmek isteyen yeni başlayanlar ve profesyoneller için çok uygun.

2. JavaScript ağırlıklı web sitelerini scrape etmek için en iyi dil hangisi?

Dinamik sitelerde en iyi tercih JavaScript (Node.js). Puppeteer ve Playwright gibi araçlar tam tarayıcı kontrolü sağlar; React, Vue veya Angular ile yüklenen içerikle etkileşime girebilirsin.

3. Web scraping için no-code bir seçenek var mı?

Evet — dinamik içerikten zamanlamaya kadar her şeyi yöneten, no-code bir AI Web Scraper çözümüdür. “AI Suggest Fields”e tıklarsın ve scraping’e başlarsın. Hızlıca yapılandırılmış veriye ihtiyaç duyan satış, pazarlama veya operasyon ekipleri için idealdir.

Daha Fazlası: