GitHub’da "amazon scraper" araması yaklaşık döndürüyor. Bunu son altı ay içinde push edilmiş depolara daralttığınızda sayı yaklaşık oluyor — yani ancak %20 civarı. Geri kalanlar mı? Terk edilmiş eğitimler, güncelliğini yitirmiş sarmalayıcılar ve Amazon savunmalarını sıkılaştırdığı anda çalışmayı bırakan betikler.

Amazon scraper depolarını incelemek, GitHub sorunlarını okumak ve Reddit ile Stack Overflow’daki topluluk başlıklarını takip etmek için epey zaman harcadım. Desen hep aynı: biri popüler bir repo buluyor, kurmak için bir saat harcıyor, bir kez çalıştırıyor ve CAPTCHAs ya da 503 hataları duvarına çarpıyor. Amazon’un 2026’daki bot karşıtı yaklaşımı, iki yıl öncesiyle bile aynı değil — TLS parmak izi tespiti, davranış analizi ve agresif CAPTCHA kullanımı, eski "kullanıcı aracısını döndür ve en iyisini um" oyun planını neredeyse işe yaramaz hale getirdi. Bu rehber, GitHub deposundan güvenilir Amazon verisi almak istiyorsanız gerçekten önemli olan en iyi uygulamaları ve scraper’ınız bozulduğunda ne yapmanız gerektiğini kapsıyor.

GitHub’daki Amazon Scraper Nedir (ve Neden Bu Kadar Çoğu Başarısız Olur)?

GitHub’daki bir Amazon scraper deposu genellikle Amazon sayfalarından yapılandırılmış veri çıkaran açık kaynak bir betiktir — çoğunlukla Python, Node.js ya da Scrapy tabanlıdır. Veri hedefleri tanıdık şeylerdir: ürün başlığı, fiyat, ASIN, puanlar, yorum sayıları, stok durumu, satıcı bilgisi, arama sonucu kartları ve yorum metni.

Mimari genellikle oldukça basittir:

- Bir HTTP istemcisi ya da headless tarayıcı sayfayı çeker.

- Bir HTML ya da JSON ayrıştırıcı alanları çıkarır.

- Veriler CSV, JSON ya da bir veritabanına kaydedilir.

Depolar genelde dört gruba ayrılır:

- Hafif Python kütüphaneleri (ör. )

- Scrapy örümcekleri (ör. )

- Selenium veya Playwright tabanlı tarayıcı otomasyonları

- API sarmalayıcı projeleri; bunlar aslında ticari bir scraping hizmeti için ön yüzdür (ör. )

Başarısızlık deseni tahmin edilebilir. Çoğu repo şu nedenlerle bozulur:

- Amazon sayfa düzenini veya HTML parçalarını değiştirir

- Amazon gerçek içerik yerine 503 ya da CAPTCHA döner

- Scraper’ın TLS ve HTTP parmak izi artık tarayıcıya benzemiyordur

- Yerel ayar, dil ya da header uyumsuzlukları şüphe uyandırır

- Bakımcı, ilk ve dar kullanım senaryosunu çözdükten sonra projeyi bırakır

Yüksek yıldız sayısı ile "şu anda kullanılabilir" olmak çok farklı şeylerdir. Bu yazı için yaptığım incelemede, geniş kitlelerce görünen sekiz deponun yalnızca yaklaşık üçü 2026’da açıkça aktif görünüyordu.

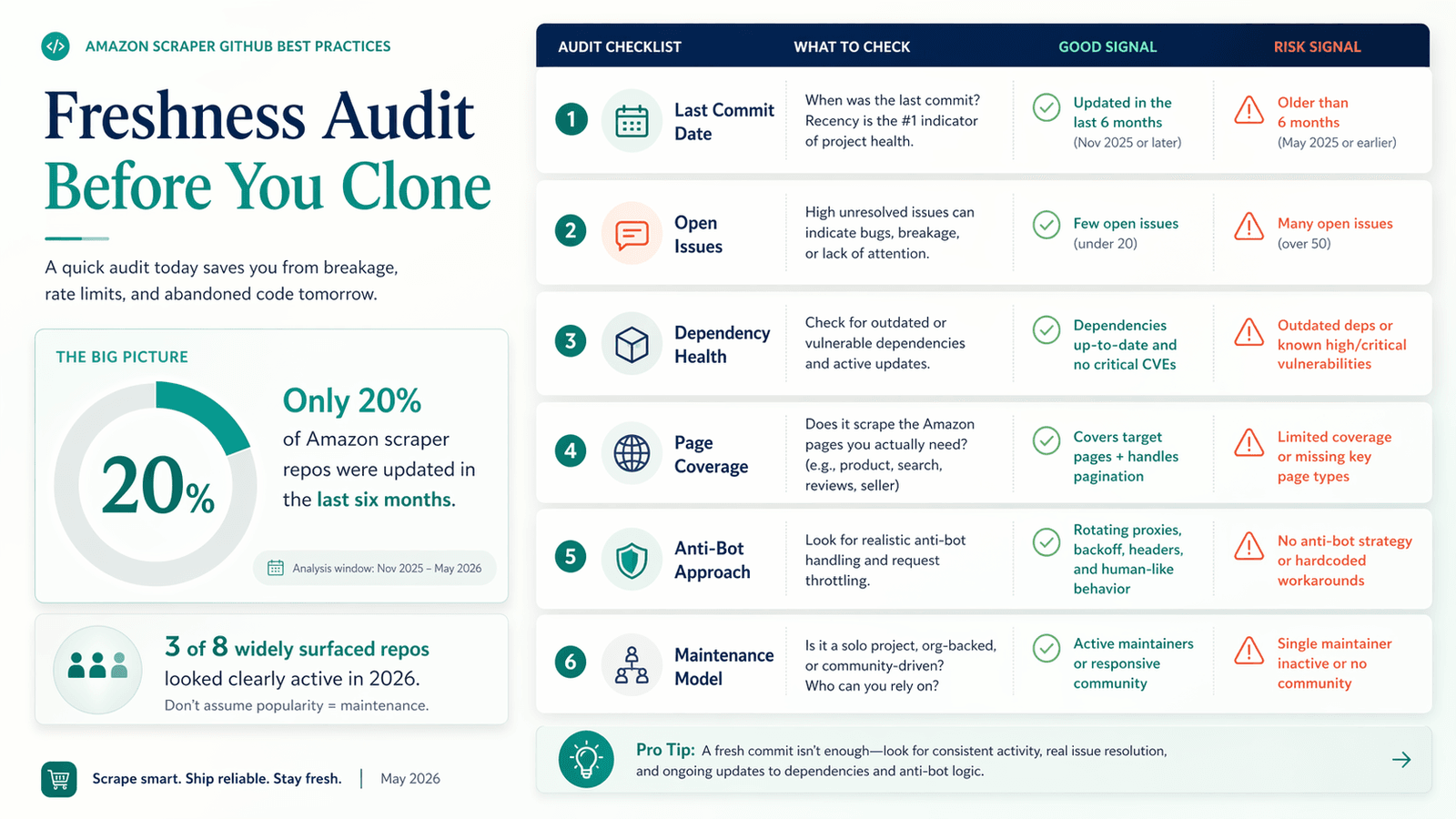

Herhangi Bir Amazon Scraper GitHub Deposunu Klonlamadan Önce 2026 Tazelik Denetimi Yapın

Bu adım Amazon için çoğu hedefe göre daha önemlidir. Amazon’un savunmacı yaklaşımı tipik bir e-ticaret sitesinden daha hızlı değişir; bu yüzden bir broşür sitesinde sorunsuz çalışan depo, Amazon’da birkaç hafta içinde işe yaramaz hale gelebilir. Buna rağmen "best amazon scraper github" listelerinin çoğu, hâlâ çalışıp çalışmadığını kontrol etmeden repo öneriyor. Kullanıcılar bozuk araçları kurmakla saatlerini harcıyor.

Bir GitHub Deposunun Hâlâ Canlı Olup Olmadığı Nasıl Kontrol Edilir?

Bir şey git clone etmeden önce şu kontrolleri yapın:

- Son commit tarihi: Amazon’da 6 aydan eski olan her şey ciddi uyarı işaretidir.

- Açık sorunlar ve yanıt oranı: Issues sekmesinde "captcha," "503," "blocked" ve "not working" araması yapın. Bu raporlar birikiyor ama bakımcıdan yanıt gelmiyorsa uzak durun.

- Bağımlılık sağlığı:

requirements.txtya dapackage.jsondosyasını açın. Güncelliğini yitirmiş kütüphaneler (ör. modern TLS desteği olmayan eskirequests) kırmızı bayraktır. - Amazon sayfa türü kapsamı: Repo ürün sayfalarını, arama sonuçlarını VE yorumları mı destekliyor? Yoksa yalnızca birini mi?

- Bot karşıtı yaklaşım: Proxy desteği olmayan sabitlenmiş header’lar, 2023 yaklaşımıdır ve 2026’ya dayanmaz.

Amazon Scraper GitHub Tazelik Kontrol Listesi

| Tazelik Sinyali | Ne Kontrol Edilmeli | Kırmızı Bayrak 🚩 |

|---|---|---|

| Son commit tarihi | Commit akışı veya depo push tarihi | 6 aydan eski |

| Açık sorunlar | Issues sekmesi — "captcha," "503," "blocked" için filtreleyin | Bakımcı yanıtı olmadan tekrarlayan bozulmalar |

| Bağımlılık sağlığı | requirements.txt / package.json | Eski kütüphaneler, modern TLS stratejisi yok |

| Amazon sayfa kapsamı | README + kod örnekleri | Yalnızca tek sayfa türünü işler (ör. ürün sayfası ama arama ya da yorum değil) |

| Bot karşıtı yaklaşım | Kaynak kod, proxy yapılandırması | Sadece sabit header’lar ve UA dizeleri |

| Bakım modeli | Gerçek bir scraper mı, eğitim mi, ticari API sarmalayıcı mı? | Repo aslında ücretli bir hizmet için yalnızca ön yüzdür |

Denetim Gerçekte Ne Gösterdi?

Bu kriterlere göre sekiz yaygın Amazon scraper deposunu inceledim. Sonuçlar pek iç açıcı değil:

| Repo / Araç | Yıldız | Son Commit Sinyali | Kapsam | 2026 Durumu | Notlar |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2.872 | 2026-04-02 | Yönetilen scraper API sarmalayıcısı | Canlı, ama DIY değil | Güncel, fakat bu aslında yönetilen bir hizmete ön yüz |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | Arama, detaylar, yorumlar için yönetilen API | Canlı, ama DIY değil | İyi kapsam, fakat ham bir scraper değil, bir API ürünü |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Hafif Python kütüphanesi | Canlı | curl_cffi kullanan en net doğrudan GitHub scraper’ı |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Yalnızca yorumlar | Dar kapsamlı ama kullanılabilir | Eski ve çok yorum odaklı |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Son commit 2023; repo 2024-08-20’de push edilmiş | Scrapy örümcekleri + proxy middleware | Eğitim seviyesi, yaşlanmış | Öğrenmek için faydalı, ama tek adımda hazır 2026 yığını değil |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | Arama, detaylar, yorumlar için Node CLI | Yüksek risk | Kapsam geniş, ama bakım çok eski |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Aramadan CSV’ye | 2026 için ölü | Tarihsel olarak popüler, ama açıkça güncel değil |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Arama/ürün eğitimi | 2026 için ölü | Fiilen arşiv niteliğinde |

Açık sorunlar da aynı hikâyeyi anlatıyor. deposunda "All requests receive captcha response." başlıklı bir sorun var. için "Doesn't seem to be working." yazıyor. içinse "Bypass Amazon protection." başlığı bulunuyor. Bunlar uç durumlar değil — kullanıcıların ilk karşılaştığı şeyler bunlar.

Banlardan Kaçınma Oyun Planı: GitHub’daki Amazon Scraper ile Nasıl Engellenmezsiniz?

Engellenmek, bir amazon scraper github projesi kullanan herkes için en büyük can sıkıntısıdır. "Proxy kullan ve user-agent döndür" gibi genel tavsiyeler artık yeterli değil. Amazon’un 2025-2026 bot karşıtı yığını TLS parmak izi tespiti, davranış analizi ve agresif CAPTCHA dağıtımını içeriyor. Katmanlı bir yaklaşım gerekiyor.

TLS Parmak İzi Eşleştirme: Neden Düz requests Sizi Banlatır?

Bu, en çok gözden kaçan ban önleme tekniklerinden biridir. TLS parmak izi şu şekilde çalışır: betiğiniz Amazon’a güvenli bir bağlantı açtığında, sunucu istemcinin nasıl "tokalaştığına" bakarak onun hakkında çok şey anlayabilir — sunulan şifre takımları, uzantıların sırası, HTTP/2 ayarları. Tarayıcılar nispeten sabit TLS ve HTTP/2 ayarları kullanır ve bu kombinasyonlar gibi tekniklerle ayırt edilebilir.

Düz requests ve sıradan httpx kurulumları header’ları kopyalayabilir, ama Chrome benzeri TLS ve HTTP/2 davranışını kopyalayamaz. Amazon farkı anlar.

bunu doğrudan çözer. Tarayıcı taklidi sunar — desteklenen hedefler arasında chrome136, safari184 ve firefox133 bulunur — böylece HTTP istemcinizin TLS parmak izi gerçek bir tarayıcıyla eşleşir. Belgeler, rastgele JA3 dizeleri üretmeyi açıkça önermiyor: tarayıcı parmak izleri çoğunlukla sürüm başına sabittir ve rastgele uydurma dizeler, gerçek bir parmak izini kopyalamaktan daha kolay tespit edilir.

Topluluk verileri de bunu doğruluyor. impersonate argümanının faydalı olduğunu, çünkü tarayıcı profillerini döndürüp header’ları uyumlu tuttuğunu söylüyor. Bir başka Amazon’un istemcileri TLS parmak izine göre "yaklaşık bir iki ay sonra" engellediğini belirtiyor. Bir özellikle Amazon’un python-requests’i parmak iziyle tanıyıp tanımadığını soruyor (spoiler: evet).

Hâlâ ilk tercih Amazon istemciniz olarak düz requests kullanıyorsanız, başka bir şeye geçmeden önce bu varsayımı güncelleyin.

Proxy Döndürmeyi Doğru Yapmak (Proxy Kullan Demekten Daha Fazlası)

Proxy’lerin amacı mümkün olduğunca sık döndürmek değildir. Amaç, oturumların inandırıcı görünmesini sağlamaktır.

Residential vs. datacenter: Datacenter proxy’leri daha ucuzdur ama tespit edilmeleri daha kolaydır. Residential proxy’ler daha pahalıdır ama Amazon’un işaretlemesi çok daha zordur. kullanım başına GB için $4,00’dan başlar; daha büyük planlarda $3,50/GB’a kadar düşer. $6/GB’dan başlar. Amazon, residential proxy’lerin prim ödemeye değdiği "sofistike hedef" kategorisine girer.

İstek başına vs. oturum başına rotasyon: Çoğu eğitim burada hata yapıyor. Çerezleri ve header’ları sabit tutarken her istekte proxy döndürmek, daha insani değil, daha az insani görünebilir. Daha güvenli desen şu şekildedir:

- Mümkün olduğunda arama → ürün → yorum dolaşımını aynı yapışkan oturumda tutun

- Her istekte değil, yeni bir arama yolculuğuna başlarken oturumu değiştirin

- Tek bir gezinme oturumu içinde rastgele değil, oturumlar arasında döndürün

Bir standart ISP IP’lerinin popüler e-ticaret sitelerinde mobil IP’ler kadar iyi performans göstermediğini belirtti. Başka bir kullanıcı aracısını döndürüp residential proxy kullansalar bile engellendiklerini söylüyor — bu da proxy’lerin tek başına yeterli olmadığını iyi hatırlatıyor.

İstek Ritmi, Geri Çekilme ve Hız Sınırlandırma

Amazon’un 503 sayfaları rastgele kötü şans değildir. Bunlar geri bildirimdir.

500’den fazla ASIN kazıma üzerine bir , her seferinde aynı noktada — yaklaşık ASIN 101 civarında — 503 aldığını ve aralara uyku koysa bile sonucun değişmediğini bildiriyordu. Desen eski, ama ders güncel: tek bir IP ya da parmak izinden gelen ham hacim sonunda savunmaları tetikler.

Kendi kendinize kurduğunuz GitHub scraper’ları için iyi ritim uygulamaları:

- İstekler arasında rastgele gecikmeler kullanın (sabit aralıklar tespit edilebilir)

- Basit HTTP istemcileri için kamuya açık ürün istekleri arasında 2 ila 5 saniye bırakın

- 503 veya CAPTCHA sonrası üstel geri çekilme uygulayın — hemen tekrar denemek yerine kademeli uzaklaşın

- İhtiyacınız olduğunu düşündüğünüzden daha düşük eşzamanlılık kullanın

- Sıkı yeniden deneme döngüleri yerine fail-open loglama yapın

Çoğu amazon scraper github deposunda yerleşik hız sınırlandırma yoktur. Bunu kendiniz eklemeniz gerekir.

Header Orkestrasyonu: Sadece User-Agent Dizelerinden Fazlası

Amazon yalnızca User-Agent’a bakmaz, tüm header setini kontrol eder.

Gerçekçi bir tarayıcı header seti şunları içermelidir:

User-AgentAcceptAccept-LanguageAccept-Encoding- Uygun durumlarda

Sec-CH-*ipuçları - Seçilen tarayıcı profiliyle tutarlı bağlantı davranışı

Header’lar pazar yeri yerel ayarıyla eşleşmelidir. 10 Amazon yerel ayarını kazıyan bir , aynı bot kurulumunun yalnızca bazı yerel ayarlarda tespit edildiğini, başka bir yorumcunun ise Accept-Language gibi bölgeyle ilgili header’lara işaret ettiğini bulmuştu.

Kural şu: header’lar, TLS/tarayıcı profili ve proxy coğrafyası birbirini çeliştirmemeli. Chrome header’larını Firefox UA ile göndermeyin. Accept-Language: de-DE ile ABD proxy’si kullanmayın.

CAPTCHA İşleme: Ne Zaman Çözmeli, Ne Zaman Geri Çekilmeli?

CAPTCHA ile karşılaşmak, Amazon’un zaten şüphelendiği anlamına gelir. Onu çözmek güven puanınızı sıfırlamaz.

İzole, düşük sıklıklı CAPTCHA olayları için:

- PyPI paketi, saf Python ile çalışan bir Amazon metin CAPTCHA çözücüsüdür; ancak son sürümü Mayıs 2023’tendir — bunu kalıcı bir strateji değil, taktik bir araç olarak görün

- , Amazon Captcha çözümünü 1.000 çözüm başına $0,45 olarak listeliyor

Tekrarlayan CAPTCHA döngüleri için:

- Çözmeye çalışmayı bırakın ve geri çekilin

- Tekrarlayan CAPTCHA’lar, oturumun yandığı anlamına gelir — bunları çözmek parmak izine, oturum geçmişine ya da IP itibarına güveni yeniden oluşturmaz

- CAPTCHA’lar proxy alt ağlarına göre kümeleniyorsa, sorun ayrıştırıcıda değil ağ katmanındadır

Gerçekten Ne Zaman Headless Tarayıcıya İhtiyacınız Var? Ne Zaman Aşırı Kaçar?

Yanlış içgüdü, her şey için Playwright çalıştırmaktır.

Tarayıcı kullanmak için iyi senaryolar:

- JavaScript render’ına veya yerel ayara bağlı duruma dayanan arama sonuçları

- Giriş ya da oturum açma sayfalarına yönlendiren yorum akışları

- Çerezlerin ve tarayıcı bağlamının ham hızdan daha önemli olduğu iş akışları

Tarayıcı kullanmak için kötü senaryolar:

- Sıradan herkese açık ürün sayfaları

- Tarayıcı benzeri bir HTTP istemcisinin yeterli olduğu statik ürün detay çıkarımı

- Hesaplama verimliliğinin önemli olduğu büyük ölçekli toplu çekimler

İşe yarayan en hafif istemciyle başlayın. Ölçekli kazıma üzerine bir anlatılan ilerleme şuydu: önce requests, sonra curl_cffi, ancak hafif seçenekler başarısız olursa tam tarayıcıya geçin. Headless tarayıcılar, Amazon ürün sayfası kazımada HTTP istemcilerine kıyasla belirgin biçimde daha yavaştır ve daha fazla kaynak tüketir.

Amazon Scraper GitHub Projeleri İçin Ban Karşıtı Karar Matrisi

| Senaryo | Önerilen Yaklaşım | Neden |

|---|---|---|

| Genel ürün sayfaları (küçük ölçek) | Yapışkan residential oturumla curl_cffi | Hâlâ tarayıcıya benzer görünen en ucuz yol |

| Arama sonuçları sayfaları | Önce curl_cffi, render ya da durum HTTP’yi bozarsa yalnızca Playwright | Arama daha durumlu ve yerel ayara daha duyarlıdır |

| Yorumlar (giriş gerekli) | Gerçek çerez/oturumla tarayıcı modu | Giriş ve dinamik yorum akışlarını ham HTTP ile taklit etmek daha zordur |

| Büyük ölçek (günlük 5k+) | Yönetilen scraper API, unlocker ya da no-code platform | Sadece DIY GitHub kodu bir altyapı sorununa dönüşür |

Amazon Scraper GitHub Projeniz Bozulduğunda: No-Code Bir Yedek Planınız Olsun

Deneyimli her scraper kullanıcısının bir Plan B’si vardır.

Amazon güncellemeleri er ya da geç herhangi bir GitHub deposunu en kötü anda bozar. E-ticaret ekipleri için bozuk bir scraper; kaçırılan fiyat değişimleri, güncelliğini yitirmiş rakip verileri ve panolardaki boşluklar demektir.

"amazon scraper github" arayan birçok kişi aslında iş kullanıcısıdır — e-ticaret operasyonları, pazarlamacılar, FBA araştırmacıları — ve daha iyi seçenek bulamadıkları için kod tabanlı çözümleri denemiştir. Forum verileri, Amazon’un resmi konusunda da ciddi bir hayal kırıklığı olduğunu gösteriyor: kısıtlı erişim, sınırlı veri ve birçok satıcının karşılayamadığı .

Neden GitHub Amazon Scraper’ları Sürekli Bakım İster?

Yukarıdaki denetim bunu somutlaştırıyor:

- Eski depolar, düzeltme olmadan bozulma raporları biriktiriyor

- "Çalışan" depolar artık README’de açıkça bot karşıtı önlemlerden bahsediyor

- Topluluk başlıkları giderek CSS seçicilerden değil; TLS parmak izlerinden, CAPTCHA döngülerinden ve proxy kalitesinden söz ediyor

İş kullanıcıları için gerçek gizli maliyet bu bakım yüküdür. Repo ücretsizdir. Onu sabaha karşı 2’de ayıklamak için harcadığınız zaman ücretsiz değildir.

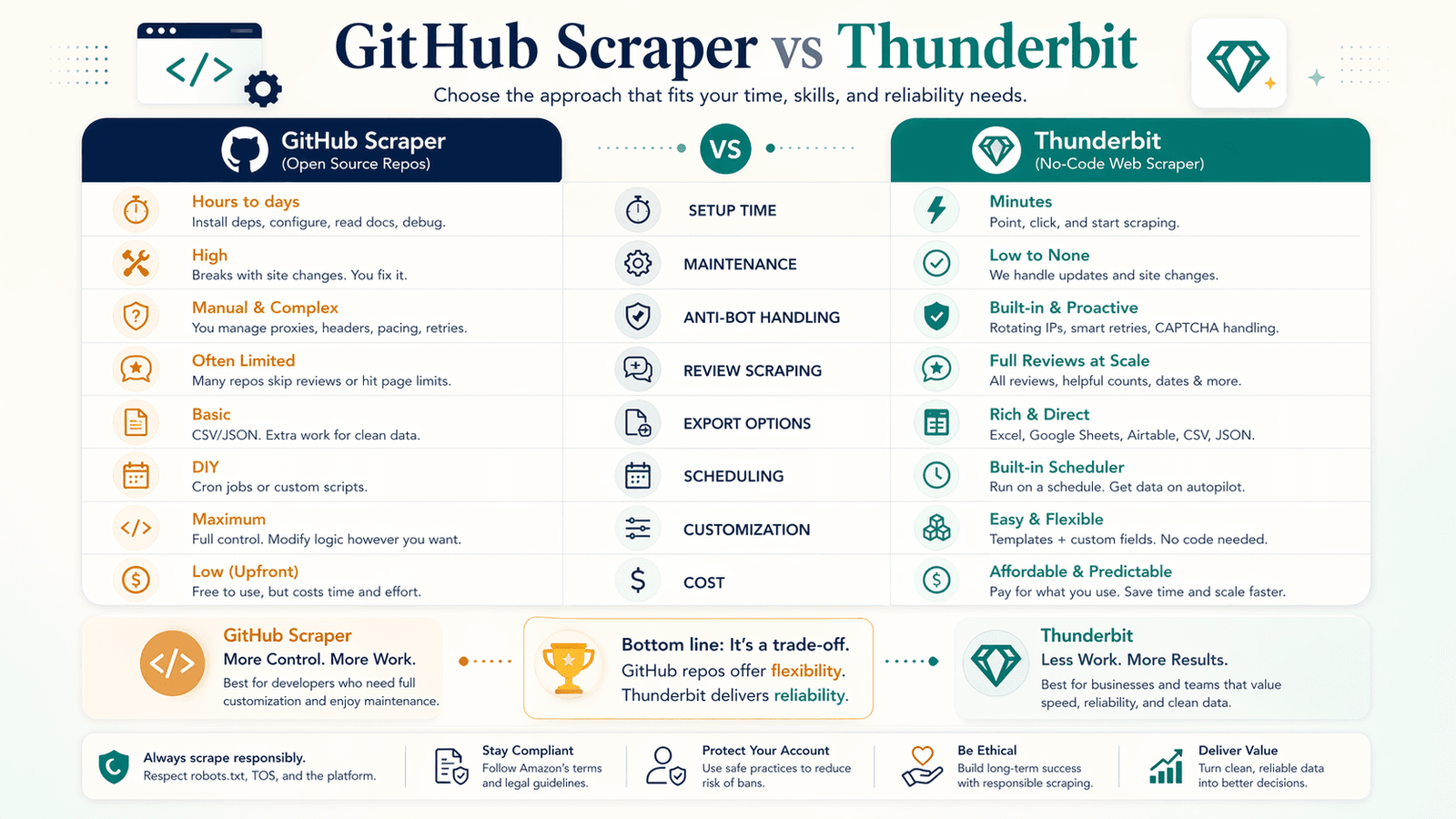

Pratik Bir Amazon Scraper Alternatifi Olarak Thunderbit

, kod yazmadan başlık, fiyat, ASIN, puanlar, marka, stok durumu, gönderim çıkış noktası ve orijinal URL’yi çıkaran bir sunar.

Pratikte bu şu anlama gelir:

- 2 tıkla scraping — Python ortamları, bağımlılıklar ve proxy yapılandırmaları kurmaya kıyasla

- Anında Amazon şablonu — AI ek yükü yok, yalnızca tek tıkla çıkarım

- Giriş gerektiren sayfalar için tarayıcı scraping modu (GitHub scraper kullanıcılarını zorlayan yorum sayfaları gibi)

- Herkese açık ürün sayfaları için hızla bulut scraping (bir seferde 50 sayfa)

- Yalnızca CSV/JSON değil, Google Sheets, Airtable, Notion, Excel’e ücretsiz dışa aktarma

- Sürekli fiyat takibi için zamanlanmış scraper

- AI, düzen değişikliklerine uyum sağlar — bakım yükü sizde olmaz

GitHub Amazon Scraper ile Thunderbit: Dürüst Karşılaştırma

| Faktör | GitHub Scraper (ör. AmzPy) | Thunderbit |

|---|---|---|

| Kurulum süresi | 15–60 dk (Python, bağımlılıklar, proxy’ler) | ~2 dk (Chrome uzantısını kurun) |

| Bakım | Bozulmaları siz düzeltirsiniz | AI, düzen değişikliklerine uyum sağlar |

| Bot karşıtı yönetim | DIY (proxy’ler, header’lar, TLS) | Yerleşik (bulut + tarayıcı modları) |

| Yorum kazıma (giriş yapılmış) | Karmaşık oturum yönetimi | Tarayıcı scraping modu |

| Veri dışa aktarma | Yalnızca CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Zamanlama | DIY (cron, Airflow vb.) | Yerleşik zamanlanmış scraper |

| Özelleştirme | Daha yüksek | Daha düşük |

| Maliyet | Ücretsiz (artı proxy maliyetleri) | Ücretsiz plan mevcut; kredi tabanlı |

Dürüst takas şu: GitHub depoları daha fazla özelleştirme sunar; Thunderbit daha fazla güvenilirlik sunar. Ekibiniz esneklikten çok kesintisiz çalışmaya önem veriyorsa, no-code yol genellikle daha rasyonel seçimdir.

Zamanlanmış ve Tekrarlayan Amazon Scraping İçin En İyi Uygulamalar

Çoğu amazon scraper github projesi tek seferlik çalışmalar için yapılmıştır; ancak gerçek iş senaryoları — fiyat takibi, stok izleme, rakip analizi — tekrarlayan scrape işlemleri gerektirir. GitHub depolarında zamanlama neredeyse hiçbir zaman yerleşik olarak gelmez; kullanıcılar cron işleri, Airflow veya n8n iş akışları ile parçaları birleştirmek zorunda kalır.

GitHub Amazon Scraper’ları İçin DIY Zamanlama

Asgari uygulanabilir tekrarlayan kurulum:

- Betiği zamanlanmış şekilde çalıştırmak için Linux ya da macOS üzerinde bir cron işi

- Sonradan hata ayıklayabilmek için yalnızca eklenen günlükler

- Aynı veriyi iki kez kaydetmemek için ASIN + zaman damgası bazlı tekilleştirme

- Bir çalışma sabah 3’te bozulursa bunu bilmek için hata uyarıları (en basitinden sıfır dışı çıkışta e-posta)

Daha karmaşık ekipler için:

- Topluluk başlıklarında sıkça anılan hafif iş akışı otomasyonu için n8n

- Daha ağır zamanlanmış boru hatları için Airflow

- Farklar ve geçmiş gerekiyorsa veritabanı destekli durum

Buradaki kilit en iyi uygulama zamanlayıcının kendisi değil — durum yönetimidir. Son başarılı çalışmayı, son ASIN kümesini, değişen fiyatları ve başarısız URL’leri takip edin.

Thunderbit ile Zamanlama Daha Basit

Thunderbit’in özelliği, aralığı sade İngilizceyle tanımlamanıza, URL’leri girmenize ve "Schedule"a tıklamanıza izin verir. AI, doğal dili cron zamanlamasına dönüştürür — teknik kurulum gerekmez. Fiyat veya rakip ürün lansmanlarını izleyen mühendislik dışı e-ticaret ekipleri için bu, operasyonel sürtünmede anlamlı bir azalmadır.

Tekrarlayan Amazon Scrape İşleri İçin En İyi Uygulamalar

Bunlar hangi aracı kullanırsanız kullanın geçerlidir:

- ASIN + zaman penceresiyle tekilleştirin — aynı ürünü her çalıştırmada iki kez kaydetmeyin

- Fiyatları ham dizeler yerine sayı olarak saklayın — sonradan temizleme işini azaltır

- Her satıra scrape zaman damgası ekleyin — trend analizi için bunlara ihtiyacınız olacak

- Yalnızca mevcut durumu değil, farkları da takip edin — "fiyat geçen haftaya göre %12 düştü" bilgisi, "fiyat 24,99 $" bilgisinden daha faydalıdır

- Anlamlı değişikliklerde uyarı verin — bir rakibin fiyatı %15 düşerse bildirim değer; %0,5 dalgalanma gürültüdür

- Veri depolamayı düşünün — küçük işler için düz dosyalar yeter; günlük 5k+ ASIN için veritabanı ya da bulut tablo düşünün

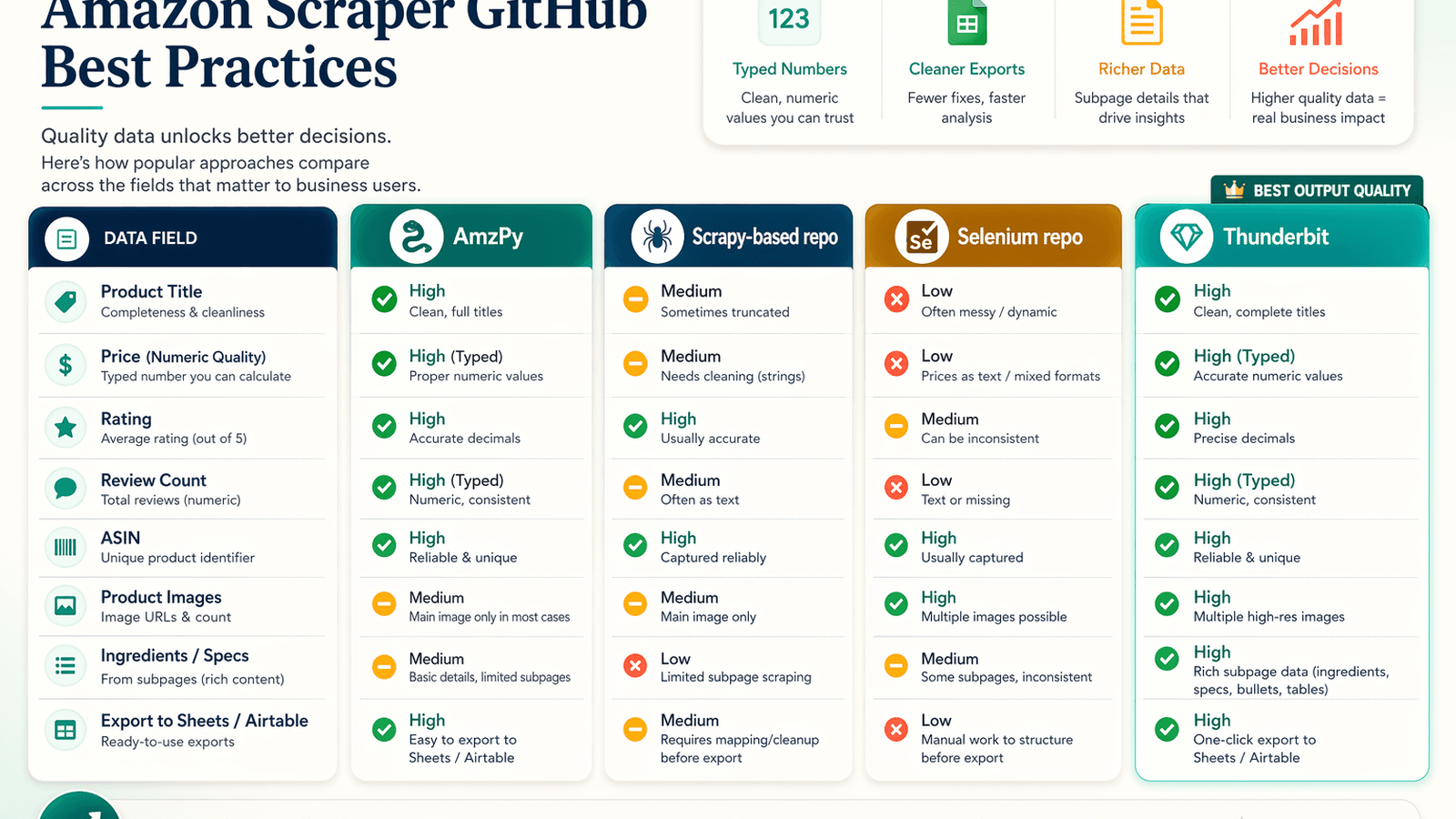

Yan Yana Çıktı Kalitesi: Her Amazon Scraper GitHub Yaklaşımı Gerçekte Ne Döndürür?

Hiç kimse amazon scraper github depoları arasında gerçek çıktı kalitesini karşılaştırmıyor. Kullanıcılar veri kalitesine derinden önem veriyor — "hangi araç en temiz, en eksiksiz veriyi veriyor" — ama her bir depoyu kendilerinin klonlayıp test etmesi gerekiyor. Bu bölüm o boşluğu dolduruyor.

Popüler GitHub Depoları Gerçekte Neleri Çıkarıyor, Neleri Kaçırıyor?

README örneklerine, herkese açık örneklere ve belgelenmiş çıktı biçimlerine dayanarak:

| Yaklaşım | Açıkça Çıkardığı Şeyler | Yaygın Eksikler / Takaslar |

|---|---|---|

| amzpy | Başlık, fiyat, para birimi, görsel URL’si, puanlar, yorumlar, varyantlar, ASIN | Ürün sayfası odaklı; tam yorumlar/özellik bölümlerinde daha az zengin |

| tducret/amazon-scraper-python | Başlık, puan, yorum sayısı, ürün URL’si, görsel URL’si, ASIN içeren CSV | Eski, listelemeye odaklı, zayıf bot karşıtı hikâye |

| python-scrapy-playbook scraper | Arama sonuçları, ürün sayfaları, yorumlar, CSV/JSON boru hatları | Eğitim seviyesi; harici proxy middleware’e dayanıyor; daha fazla temizleme gerekebilir |

| omkarcloud/amazon-scraper | Arama, kategori, detaylar, en iyi yorumlar, çok sayıda görsel/video/özellik | Ham scraper değil — yönetilen API hizmeti |

| Thunderbit Amazon template | Başlık, fiyat, ASIN, marka, puan, yorumlar, stok durumu, gönderim çıkış noktası, alt sayfa zenginleştirmesi | Özel betiklere göre daha az kod seviyesi kontrol |

Çıktı Kalitesi Karşılaştırma Tablosu

| Veri Alanı | AmzPy | Scrapy tabanlı Repo | Selenium Repo | Thunderbit |

|---|---|---|---|---|

| Ürün başlığı | ✅ | ✅ | ✅ | ✅ |

| Fiyat (sayısal) | ⚠️ dize | ✅ | ⚠️ dize | ✅ (sayı tipi) |

| Puan | ✅ | ✅ | ✅ | ✅ |

| Yorum sayısı | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Ürün görselleri | ❌ | ⚠️ yalnızca küçük görsel | ✅ | ✅ (tam çözünürlük, dışa aktarılabilir) |

| İçerikler/özellikler | ❌ | ❌ | ❌ | ✅ (alt sayfa scraping + AI ile) |

| Sheets/Airtable’a dışa aktarma | ❌ | ❌ | ❌ | ✅ ücretsiz |

Veri Biçimlendirme İş Kullanıcıları İçin Neden Önemlidir?

Dağınık veri gizli emek yaratır. Başarılı bir scraper bile şu durumlarda operasyonel bir başarısızlık olabilir:

- Fiyatlar temiz sayılar yerine para birimi sembollü dizelerse

- Eksik değerler tutarsızsa (boş dize, null ya da "N/A")

- Görseller yalnızca düşük çözünürlüklü küçük önizlemelerse

- Yorum alanları ya da özellikler analizden önce son işlem gerektiriyorsa

E-ticaret operasyon ekipleri için temiz veri, analiz hızını ve karar vermeyi doğrudan etkiler. Thunderbit’in AI’si verileri türüne göre biçimlendirir — sayılar sayı olarak, tarihler tarih olarak, URL’ler URL olarak — böylece hemen kullanıma hazır olur. GitHub depoları bu konuda çok değişken davranır ve temizlik süresi hızla birikir.

Hızlı Başvuru: Amazon Scraper GitHub En İyi Uygulamalar Kontrol Listesi

- Klonlamadan önce son commit tarihini kontrol edin. Amazon’da altı aydan eski olanlar ciddi uyarı işaretidir.

- Kurulumdan önce issues içinde "captcha," "503," "blocked" ve "not working" arayın.

- Düz

requestsyerinecurl_cffiya da tarayıcı taklidi yapan başka bir HTTP istemcisini tercih edin. - Header’ları, TLS profilini, dili ve proxy coğrafyasını tutarlı tutun — çelişki olmasın.

- Gezinme akışlarında yapışkan oturumlar kullanın; her istekte körlemesine döndürmeyin.

- Rastgele ritim ve üstel geri çekilme ekleyin.

- Tekrarlayan CAPTCHA’yı bir bulmaca değil, yanmış oturum olarak görün.

- Headless tarayıcıları yalnızca HTTP istemcileri sayfayı güvenilir biçimde taklit edemediğinde kullanın.

- Başarısız çalışmalardan güvenli şekilde devam edebilmek için kontrol noktaları ve durum saklayın.

- İster yönetilen bir API olsun ister gibi no-code bir araç, bir yedek planınız olsun.

2026’da Amazon Scraping İçin Yasal ve Etik Hususlar

Kısaca bilmeye değer birkaç şey.

Amazon’un yaklaşımı kısıtlayıcı ve giderek daha da kısıtlayıcı hale geliyor. En güçlü sinyaller:

- Amazon’un kendi yardım sayfaları artık "To discuss automated access to Amazon data please contact api-services-support@amazon.com." diyen bir döndürüyor.

- Amazon’un dosyası, dinamik, yorum, profil, istek listesi ve teklif listeleme yollarının geniş bir bölümünü engelliyor.

- Amazon’un , gizli veya kamufle edilmiş ajan erişimine, güvenlik önlemlerini aşmaya ve bir ajanı Google Chrome olarak yanlış tanıtmaya açıkça itiraz ediyor. Amazon ayrıca olayla ilgili yaptı.

- Amazon, 2025 sonlarında OpenAI tarayıcılarına karşı .

Pratik risk, herkese açık ürün sayfalarından kimlik doğrulamalı akışlara, gizlenmiş otomasyona veya yüksek hacimli ticari çıkarmaya geçtiğinizde açıkça yükselir. Bu bir hukuki tavsiye değildir — kendi özel durumunuz için hukuk ekibinize danışın.

Öne Çıkanlar: Ban Yemeden Güvenilir Amazon Verisi Nasıl Alınır?

Önem sırasıyla:

- Klonlamadan önce denetleyin. GitHub sonuçlarının çoğunun güncelliğini yitirmiş, eğitim amaçlı ya da ticari API’lerin etrafına sarılmış çözümler olduğunu varsayın.

- Önce ağ katmanınızı yükseltin. TLS parmak izi ve oturum tutarlılığı, HTML seçicilerden daha önemlidir.

- Rastgele proxy kaosu yerine yapışkan residential oturumlar kullanın. Oturumlar arasında döndürün, oturumun içinde değil.

- İstekleri stres testi gibi değil, bir kullanıcı gibi hızlandırın. Rastgele gecikmeler ve üstel geri çekilme pazarlığa kapalıdır.

- İzole CAPTCHAs’ı çözün; tekrar tekrar uyarılan oturumları emekli edin. Yanmış bir parmak izini brute-force etmeye çalışmayın.

- Bir yedek planınız olsun. Amazon hafta ortasında bir şeyi değiştirir ve GitHub scraper’ınız bozulur. gibi bakımı yapılan bir no-code araç ya da yönetilen bir API, siz ayıklama yaparken veri hattınızı ayakta tutabilir.

- Çıktı kalitesine öncelik verin. Temiz, türlenmiş veri, hızlı ama dağınık bir scraper’dan daha fazla zaman kazandırır.

Özelleştirmeden çok güvenilirlik istiyorsanız, Thunderbit bakımı yapılan bir alternatif sunar — göz atın ya da üzerindeki eğitimleri izleyin. Tam kontrol isteyen geliştiriciler elbette GitHub depolarını kullanabilir — ama yalnızca bu rehberde ele alınan ban karşıtı ve bakım uygulamalarıyla.

SSS

GitHub’daki bir scraper ile Amazon ürün verilerini kazımak yasal mı?

Amazon’un Hizmet Şartları otomatik veri toplamayı kısıtlar ve Amazon bunu özellikle 2025-2026 döneminde ihtar mektupları ve teknik karşı önlemlerle aktif biçimde uyguladı. Herkese açık ürün verilerini kazımak gri bir alandır; giriş arkasındaki verileri kazımak veya botunuzu gerçek bir tarayıcı gibi gizlemek daha yüksek risk taşır. Bu bir hukuki tavsiye değildir — özel kullanım durumunuz için hukuk ekibinize danışın.

Amazon scraper GitHub depoları ne sıklıkla bozulur?

Sık sık. Amazon düzenli olarak sayfa düzenlerini değiştirir, yeni bot karşıtı katmanlar ekler ve uç noktaları kullanım dışı bırakır. Bu yazı için yaptığım denetimde, geniş kitlelerce görünen 8 deponun yalnızca yaklaşık 3’ü 2026’da açıkça işlevseldi. "Çalışan" depolarda bile çoğu zaman CAPTCHA ve 503 hatalarıyla ilgili açık sorunlar bulunur. Her birkaç haftada ya da ayda bir sorun gidermeniz veya kurulumunuzu güncellemeniz gerekmesini bekleyin.

2026’da GitHub’daki en iyi Amazon scraper hangisi?

Tek bir kazanan yok — kullanım senaryonuza ve teknik rahatlık seviyenize bağlı. Hafif, doğrudan bir Python scraper için daha güncel seçeneklerden biridir. Yönetilen bir API üzerinden daha geniş kapsam için çalışır ama tam anlamıyla DIY değildir. Karar vermeden önce herhangi bir depoyu değerlendirmek için bu yazıdaki tazelik kontrol listesini uygulayın.

Thunderbit, kod yazmadan Amazon kazıyabilir mi?

Evet. Thunderbit’in , ürün başlığı, fiyat, ASIN, puanlar, marka, stok durumu ve daha fazlasını tek tıkla çıkarır. Giriş gerektiren sayfalar için tarayıcı scraping modu, herkese açık sayfalar için hızla bulut scraping, tekrarlayan işler için zamanlanmış scraping ve Google Sheets, Airtable, Notion ve Excel’e ücretsiz dışa aktarma desteği vardır. kurarak başlayabilirsiniz.

Amazon kazırken IP’min banlanmasını nasıl önlerim?

Katmanlı bir yaklaşım kullanın: (1) düz requests yerine curl_cffi gibi TLS taklit eden bir istemciye geçin, (2) rastgele datacenter rotasyonu yerine yapışkan oturumlu residential proxy’ler kullanın, (3) rastgele ritim ve üstel geri çekilme ekleyin, (4) tam header setinizi tarayıcı profiliniz ve pazar yeri yerel ayarıyla tutarlı tutun ve (5) tekrarlayan CAPTCHAs’ı sonsuza kadar çözülmesi gereken bir bulmaca değil, oturumu emekliye ayırma sinyali olarak görün. Daha fazla ayrıntı için yazının önceki kısmındaki ban karşıtı karar matrisine bakın.