Det är något nästan nostalgiskt med att öppna en terminal, skriva ett enda kommando och se rå webbdata forsa in – som om du precis lyckats hacka Matrix. För utvecklare och tekniknördar är den där magiska trollstaven: ett anspråkslöst kommandoradsverktyg som i det tysta finns på miljarder enheter, från molnservrar till din smarta kyl. Och även 2026, trots alla blanka no-code- och AI-verktyg för scraping, är webbskrapning med curl fortfarande ett givet val för dig som vill ha fart, kontroll och något som går att skripta utan krångel.

Jag har lagt år på att bygga automationsverktyg och hjälpa team att få ordning på webbdata, och jag plockar fortfarande fram cURL när jag snabbt behöver hämta en sida, felsöka ett API eller skissa på ett scrapingflöde. I den här guiden får du en curl webbskrapning-tutorial som tar dig från grunderna till proffstricken – med riktiga kommandoexempel, handfasta tips och en ärlig genomgång av var cURL glänser (och var det tar stopp). Och om du är mer av en business-användare som helst slipper kommandoraden visar jag hur , vår AI-drivna web scraper, kan ta dig från ”jag behöver den här datan” till ”här är mitt kalkylark” på två klick – helt utan kod.

Nu kör vi: varför cURL fortfarande är relevant för webbskrapning 2025, hur du använder det smart, och när det är dags att ta till något ännu kraftfullare.

Vad är cURL? Grunden för web-scraping-with-curl

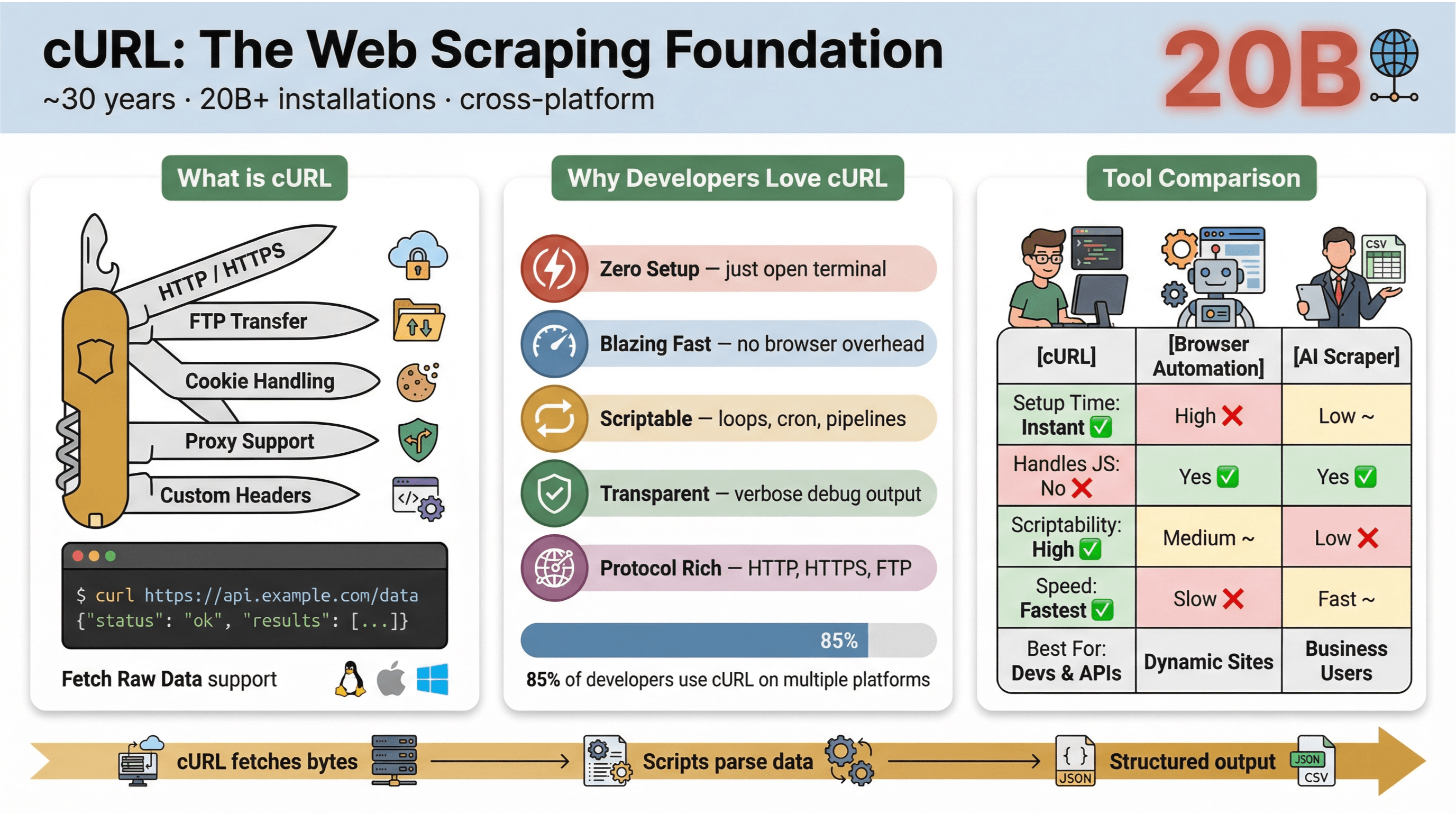

I grunden är ett kommandoradsverktyg och ett bibliotek för att flytta data via URL:er. Det har funnits i nästan 30 år (ja, på riktigt) och finns typ överallt – inbyggt i operativsystem, i scripts och som en tyst motor för dataöverföringar i mer än . Har du någon gång kört ett snabbt kommando för att hämta en webbsida, testa ett API eller ladda ner en fil, är chansen stor att du redan använt cURL.

Det här är varför cURL är så omtyckt för webbskrapning:

- Lättviktigt och plattformsoberoende: Funkar på Linux, macOS, Windows och även inbyggda enheter.

- Stöd för protokoll: Klarar HTTP, HTTPS, FTP med mera.

- Skriptvänligt: Perfekt för automation, cron-jobb och ”glue code”.

- Ingen interaktion krävs: Byggt för icke-interaktiv användning – klockrent för batchjobb och pipelines.

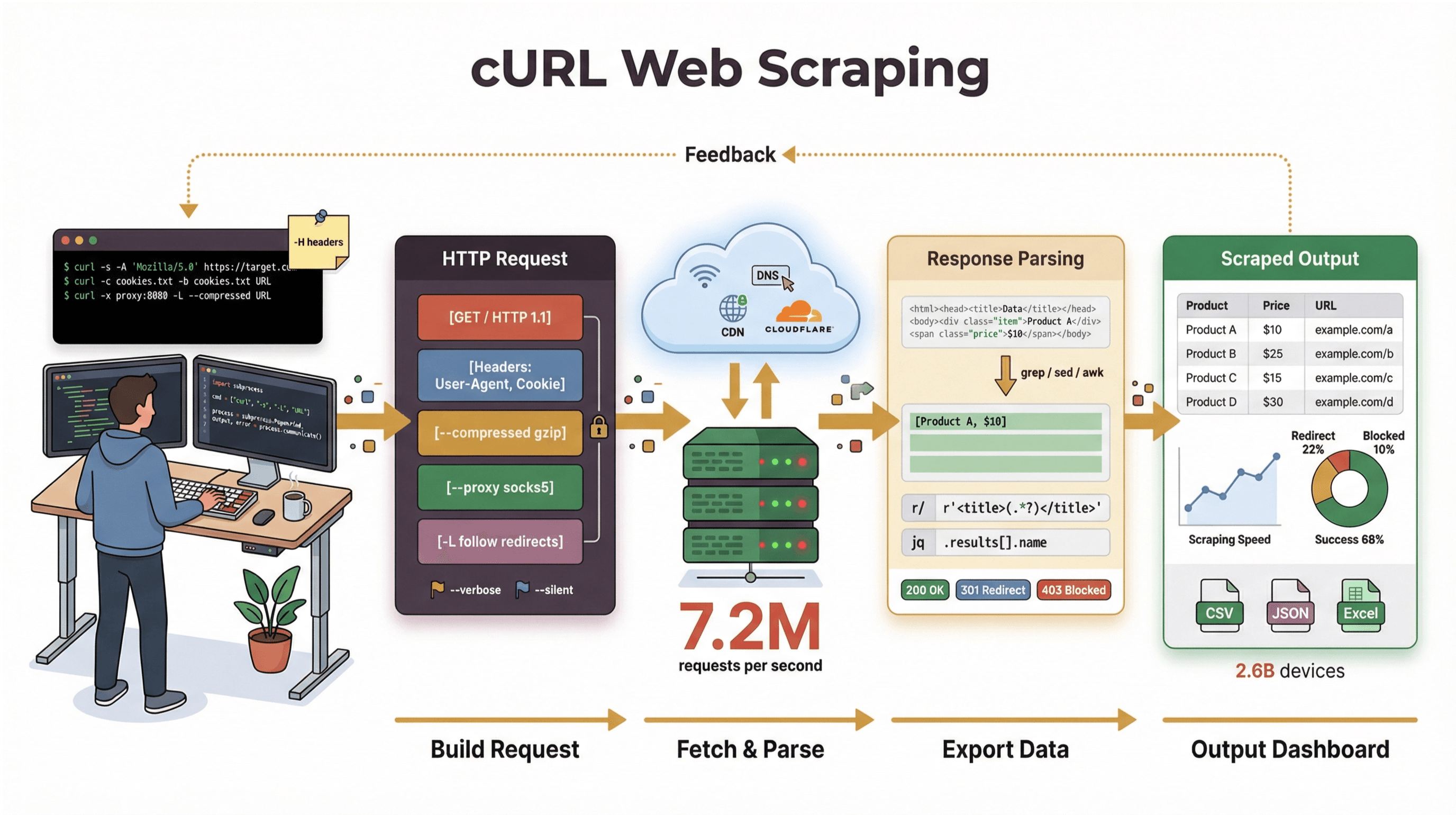

Men vi ska vara tydliga: cURL:s huvudgrej är att hämta rådata – HTML, JSON, bilder, vad du vill. Det varken tolkar, renderar eller strukturerar datan åt dig. Se cURL som ”första kilometern” i webbskrapning: det levererar bytesen, men du behöver andra verktyg (t.ex. Python-skript, grep/sed/awk eller en AI Web Scraper) för att göra om det till strukturerad information.

Vill du läsa originaldokumentationen, kika på .

Varför använda cURL för webbskrapning? (curl web scraping tutorial)

Varför kommer utvecklare och tekniska användare tillbaka till cURL för webbskrapning, trots alla nya verktyg? Här är det som gör cURL extra vasst:

- Minimal startsträcka: Inga installationer, inga beroenden – öppna terminalen och kör.

- Snabbt: Hämtar data direkt utan att vänta på att en webbläsare ska ladda.

- Skriptbart: Enkelt att loopa över URL:er, automatisera anrop och kedja kommandon.

- Stöd för funktioner: Hantera cookies, proxy, omdirigeringar, egna headers och mer.

- Transparens: Med verbose/debug ser du exakt vad som händer.

I uppgav över 85 % att de använder cURL:s kommandoradsverktyg, och nästan alla kör det på flera plattformar. Det är fortfarande schweiziska armékniven för HTTP-anrop, snabba datahämtningar och felsökning.

Här är en snabb jämförelse mellan cURL och andra metoder:

| Funktion | cURL | Webbläsarautomation (t.ex. Selenium) | AI Web Scraper (t.ex. Thunderbit) |

|---|---|---|---|

| Startsträcka | Omedelbar | Hög | Låg |

| Skriptbarhet | Hög | Medel | Låg (ingen kod behövs) |

| Hanterar JavaScript | Nej | Ja | Ja (Thunderbit: via webbläsare) |

| Cookie-/sessionsstöd | Manuellt | Automatiskt | Automatiskt |

| Datastrukturering | Manuellt (tolka sen) | Manuellt (tolka sen) | AI-/mallbaserat |

| Passar bäst för | Devs, snabba hämtningar | Komplexa, dynamiska sajter | Business, strukturerad export |

Kort sagt: cURL är oslagbart för snabba, skriptbara datahämtningar – särskilt för statiska sidor, API:er eller när du vill automatisera enkla flöden. Men så fort du behöver tolka krånglig HTML, hantera JavaScript eller exportera strukturerad data vill du ha något mer specialiserat.

Kom igång: Grundläggande exempel på cURL-webbskrapning

Nu blir det hands-on. Så här använder du cURL för vanliga webbskrapningsmoment, steg för steg.

Hämta rå HTML med cURL

Det enklaste scenariot: hämta HTML från en webbsida.

1curl https://books.toscrape.com/Kommandot hämtar startsidan för , en publik demosajt för webbskrapning. Du ser rå HTML i terminalen – leta efter taggar som <title> eller text som ”In stock.”

Spara output till en fil

Vill du spara HTML:en för att tolka senare? Använd flaggan -o:

1curl -o page.html https://books.toscrape.com/Nu får du en fil page.html med hela HTML-innehållet. Perfekt om du vill analysera eller parsa med andra verktyg.

Skicka POST-anrop med cURL

Behöver du skicka ett formulär eller prata med ett API? Använd -d för POST. Här är ett exempel med , en sajt för HTTP-testning:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Du får ett JSON-svar som speglar datan du skickade – bra för test och prototypning.

Inspektera headers och felsöka

Ibland vill du se svarshuvuden eller felsöka själva anropet:

-

Endast headers (HEAD-anrop):

1curl -I https://books.toscrape.com/ -

Headers + body:

1curl -i https://httpbin.org/get -

Verbose/debug-output:

1curl -v https://books.toscrape.com/

De här flaggorna hjälper dig att förstå vad som händer bakom kulisserna – ovärderligt när något strular.

Snabb referenstabell:

| Uppgift | Kommandoexempel | Noteringar |

|---|---|---|

| Hämta HTML | curl URL | Skriver HTML till terminalen |

| Spara till fil | curl -o file.html URL | Sparar output i en fil |

| Inspektera headers | curl -I URL eller curl -i URL | -I = endast HEAD, -i = headers + body |

| POST:a formulärdata | curl -d "a=1&b=2" URL | Skickar formkodad data |

| Felsök request/response | curl -v URL | Visar detaljerad info om request/response |

Fler exempel finns i .

Ta nästa steg: Avancerad webbskrapning med cURL (web-scraping-with-curl)

När du har koll på grunderna öppnar cURL upp en hel verktygslåda för mer avancerade scrapingbehov.

Hantera cookies och sessioner

Många sajter kräver cookies för att hålla inloggning eller spåra användare. Med cURL kan du spara och återanvända cookies mellan anrop:

1# Spara cookies efter inloggning

2curl -c cookies.txt https://example.com/login

3# Använd cookies i efterföljande anrop

4curl -b cookies.txt https://example.com/accountDet gör att du kan efterlikna en webbläsarsession och nå sidor bakom inloggning (så länge det inte finns en JavaScript-utmaning).

Fejka User-Agent och egna headers

Vissa webbplatser serverar olika innehåll beroende på User-Agent eller headers. Som standard identifierar cURL sig som “curl/VERSION”, vilket kan trigga blockeringar eller alternativt innehåll. För att efterlikna en webbläsare:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Du kan också sätta egna headers, t.ex. språkpreferenser:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/Det hjälper dig att få samma innehåll som en riktig webbläsare.

Använda proxy vid webbskrapning

Behöver du skicka trafiken via en proxy (för geo-testning eller för att minska risken för IP-blockering)? Använd -x:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Se bara till att du använder proxy på ett ansvarsfullt sätt och i linje med webbplatsens villkor.

Automatisera skrapning över flera sidor

Vill du hämta flera sidor, t.ex. paginerade produktlistor? Använd en enkel shell-loop:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneDet hämtar sidorna 2 till 5 i Books to Scrape-katalogen och sparar varje sida i en egen fil. (Sida 1 är startsidan.)

Begränsningar med web-scraping-with-curl: det här behöver du känna till

Hur mycket jag än gillar cURL är det ingen universallösning. Här är var det brister:

- Ingen JavaScript-körning: cURL klarar inte sidor som kräver JavaScript för att rendera innehåll eller lösa anti-bot-utmaningar ().

- Manuell parsing krävs: Du får rå HTML eller JSON, men du måste själv tolka den – ofta med extra skript eller verktyg.

- Begränsad sessionshantering: Komplexa inloggningar, tokens eller flerstegsformulär blir snabbt röriga.

- Ingen inbyggd strukturering: cURL gör inte om webbsidor till rader, tabeller eller kalkylark.

- Känsligt för bot-detektering: Många sajter använder avancerade skydd (JavaScript, fingerprinting, CAPTCHA) som cURL helt enkelt inte kan ta sig förbi ().

Snabb jämförelse:

| Begränsning | Endast cURL | Moderna scrapingverktyg (t.ex. Thunderbit) |

|---|---|---|

| JavaScript-stöd | Nej | Ja |

| Datastrukturering | Manuellt | Automatiskt (AI/mall) |

| Sessionshantering | Manuellt | Automatiskt |

| Anti-bot-bypass | Begränsat | Avancerat (webbläsarbaserat/AI) |

| Användarvänlighet | Tekniskt | Icke-tekniskt |

För statiska sidor och API:er är cURL suveränt. För mer dynamiska eller skyddade sajter behöver du kliva upp i verktygskedjan.

Thunderbit vs. cURL: bästa vägen för icke-tekniska användare

Nu till , vår AI-drivna web scraper som Chrome-tillägg. Om du jobbar med sälj, marknad eller operations och bara vill få data från en curl webbplats (eller vilken sajt som helst) till Excel, Google Sheets eller Notion – utan att pilla i terminalen – är Thunderbit byggt för dig.

Så här står Thunderbit mot cURL:

| Funktion | cURL | Thunderbit |

|---|---|---|

| Gränssnitt | Kommandorad | Peka-och-klicka (Chrome-tillägg) |

| AI-förslag på fält | Nej | Ja (AI läser sidan och föreslår kolumner) |

| Paginering/undersidor | Manuell skriptning | Automatiskt (AI upptäcker och skrapar) |

| Export av data | Manuellt (parsa + spara) | Direkt till Excel, Google Sheets, Notion, Airtable |

| JavaScript/skyddade sidor | Nej | Ja (webbläsarbaserad scraping) |

| No-code | Nej (kräver skript) | Ja (vem som helst kan använda) |

| Gratisnivå | Alltid gratis | Gratis upp till 6 sidor (10 med trial-boost) |

Med Thunderbit öppnar du tillägget, klickar på “AI Suggest Fields” och låter AI:n lista ut vilken data som ska hämtas. Du kan skrapa tabeller, listor, produktdetaljer och till och med besöka undersidor automatiskt. Sedan exporterar du direkt till dina favoritverktyg – ingen parsing, inget strul.

Thunderbit används av över och är särskilt populärt hos team inom sälj, e-handel och fastigheter som behöver strukturerad data snabbt.

Vill du prova? .

Kombinera cURL och Thunderbit: flexibla strategier för webbskrapning

Om du är teknisk behöver du inte välja bara ett verktyg. Många team kör faktiskt cURL och Thunderbit ihop för maximal flexibilitet:

- Prototypa med cURL: Snabbkolla endpoints, granska headers och förstå hur sajten svarar.

- Skala med Thunderbit: När du behöver strukturerad data, skrapning över många sidor eller ett repeterbart flöde, byt till Thunderbit för peka-och-klicka och direktexport.

Exempel på arbetsflöde för marknadsanalys:

- Använd cURL för att hämta några sidor och titta på HTML-strukturen.

- Bestäm vilka fält du vill ha (t.ex. produktnamn, priser, recensioner).

- Öppna Thunderbit, klicka “AI Suggest Fields” och låt AI:n sätta upp skrapningen.

- Skrapa alla sidor (inklusive undersidor eller paginerade listor) och exportera till Google Sheets.

- Analysera, dela och agera på datan – utan manuell parsing.

Snabb beslutstabell:

| Scenario | Använd cURL | Använd Thunderbit | Använd båda |

|---|---|---|---|

| Snabbt API- eller statiskt sid-hämt | ✅ | ||

| Behöver strukturerad data i kalkylark | ✅ | ||

| Felsöka headers/cookies | ✅ | ||

| Skrapa dynamiska/JS-tunga sidor | ✅ | ||

| Bygga ett repeterbart no-code-flöde | ✅ | ||

| Prototypa och sedan skala | ✅ | ✅ | Hybridflöde |

Vanliga utmaningar och fallgropar vid webbskrapning med cURL

Innan du gasar på med cURL är det värt att ha koll på de vanligaste problemen i verkligheten:

- Anti-bot-system: Många sajter har avancerade skydd (JavaScript-utmaningar, CAPTCHA, fingerprinting) som cURL inte kan ta sig förbi ().

- Datakvalitet: HTML ändras, fält saknas eller layouten varierar – vilket kan knäcka dina skript.

- Underhåll: Varje gång sajten ändras måste du uppdatera din parsinglogik.

- Juridik och compliance: Kolla alltid villkor, robots.txt och relevanta lagar innan du skrapar. Att data är publik betyder inte att den är fri att använda (, ).

- Skalningsgränser: cURL är toppen för små jobb, men vid större skrapning behöver du hantera proxy, rate limits och felhantering.

Tips för felsökning och regelefterlevnad:

- Börja alltid med sajter där du har tillstånd eller demosajter (som ).

- Respektera rate limits – överbelasta inte endpoints.

- Undvik att skrapa personuppgifter om du inte har laglig grund.

- Om du fastnar på JavaScript eller CAPTCHA, överväg att byta till ett webbläsarbaserat verktyg som Thunderbit.

Steg-för-steg-sammanfattning: Så skrapar du webbplatser med cURL

Här är din snabbchecklista för web-scraping-with-curl:

- Välj mål-URL(er): Börja med en statisk sida eller en API-endpoint.

- Hämta sidan:

curl URL - Spara output till fil:

curl -o file.html URL - Inspektera headers/felsök:

curl -I URL,curl -v URL - Skicka POST-data:

curl -d "a=1&b=2" URL - Hantera cookies/sessioner:

curl -c cookies.txt ...,curl -b cookies.txt ... - Sätt egna headers/User-Agent:

curl -A "..." -H "..." URL - Följ omdirigeringar:

curl -L URL - Använd proxy (vid behov):

curl -x proxy:port URL - Automatisera flera sidor: Använd shell-loopar eller skript.

- Parsa och strukturera data: Använd extra verktyg/skript vid behov.

- Byt till Thunderbit för strukturerad no-code-scraping eller dynamiska sidor.

Slutsats & viktigaste lärdomarna: välj rätt verktyg för webbskrapning

Web-scraping-with-curl är fortfarande en stark färdighet för tekniska användare 2026 – särskilt för snabba datahämtningar, prototypning och automation. cURL:s hastighet, skriptbarhet och utbredning gör det till en självklar del av varje utvecklares verktygslåda. Men i takt med att webben blir mer dynamisk och mer skyddad, och när business-användare vill ha strukturerad data utan kod, flyttar verktyg som fram gränserna för vad som är möjligt.

Viktigaste takeaways:

- Använd cURL för statiska sidor, API:er och snabb prototypning – särskilt när du vill ha full kontroll.

- Byt till Thunderbit (eller liknande AI Web Scraper-verktyg) när du behöver strukturerad data, ska hantera dynamiska/JavaScript-tunga sidor eller vill ha ett no-code-flöde som funkar för verksamheten.

- Kombinera båda för maximal flexibilitet: prototypa med cURL, skala och strukturera med Thunderbit.

- Skrapa alltid ansvarsfullt – respektera villkor, rate limits och juridiska ramar.

Vill du se hur enkelt webbskrapning kan vara? och upplev AI-driven dataextraktion själv. Och vill du fördjupa dig, kika på för fler guider, tips och branschinsikter. Du kanske också gillar:

Lycka till med skrapningen – och må din data alltid vara ren, strukturerad och bara ett kommando (eller klick) bort.

FAQs

1. Kan cURL hantera webbsidor som renderas med JavaScript?

Nej, cURL kan inte köra JavaScript. Det hämtar rå HTML som servern levererar. Om en sida kräver JavaScript för att rendera innehåll eller lösa anti-bot-utmaningar kommer cURL inte åt datan. I de fallen behöver du webbläsarbaserade verktyg som .

2. Hur sparar jag cURL-output direkt till en fil?

Använd flaggan -o: curl -o filename.html URL. Då skrivs svarets body till en fil i stället för att visas i terminalen.

3. Vad är skillnaden mellan cURL och Thunderbit för webbskrapning?

cURL är ett kommandoradsverktyg för att hämta rå webbdata – perfekt för tekniska användare och automation. Thunderbit är ett AI-drivet Chrome-tillägg för business-användare som vill extrahera strukturerad data från vilken webbplats som helst, hantera dynamiska sidor och exportera direkt till verktyg som Excel eller Google Sheets – utan kod.

4. Är det lagligt att skrapa webbplatser med cURL?

Att skrapa publik data är i regel lagligt i USA efter nyliga domstolsbeslut, men du bör alltid kontrollera webbplatsens villkor, robots.txt och relevanta lagar. Undvik att skrapa personuppgifter eller skyddad data utan tillstånd, och respektera rate limits och etiska riktlinjer (, ).

5. När bör jag byta från cURL till ett mer avancerat verktyg som Thunderbit?

Om du behöver skrapa dynamiska/JavaScript-tunga sidor, vill ha strukturerad data i ett kalkylark eller föredrar ett no-code-flöde är Thunderbit ett bättre val. Använd cURL för snabba, tekniska uppgifter; använd Thunderbit för verksamhetsvänlig och repeterbar dataextraktion.

För fler tips och guider om webbskrapning, besök eller kolla vår .