Bilder finns överallt — i produktgallerier, bostadsannonser och konkurrentkataloger. Om du jobbar med försäljning, marknadsföring eller research har du säkert någon gång behövt hämta dussintals, eller till och med hundratals, bilder från webbplatser.

Ingen vill högerklicka och spara 500 bilder. Det är precis vad bildskrapare är till för.

Jag har testat 10 alternativ på — från webbläsartillägg till Python-bibliotek. Här är vad som fungerar bäst för olika behov.

Varför du behöver en bildskrapare 2026

Visuellt innehåll är inte bara ögongodis — det är affärsintelligens. Inlägg med bilder får upp till , och engagemanget i sociala medier kan öka med när du lägger till visuella element. Företag skrapar bilder för allt från marknadsundersökningar (för att upptäcka trender i konkurrentkataloger) till innehållsskapande (för att fylla på med produktbilder) och till och med AI-träning (genom att mata modeller med märkta foton).

Men här är problemet: webbplatser blir allt knepigare. Bilder laddas dynamiskt, göms bakom oändlig scroll eller ligger på undersidor. Manuell nedladdning är långsam, felbenägen och — låt oss vara ärliga — själsdödande. Och för team utan teknisk kompetens kan det lika gärna vara raketvetenskap att skriva en egen crawler.

Det är där moderna bildskrapare kommer in. De automatiserar grovjobbet, hanterar komplexa webbplatser och låter vem som helst — ja, till och med kollegan som bara använder Excel — samla bilder i stor skala. Marknaden för webbskrapningsprogramvara växer snabbt och förväntas , medan över nu använder webbskrapning för affärsinsikter. Slutsatsen? Om du inte använder en bildskrapare ligger du redan efter.

Så valde vi de bästa bildskrapverktygen

Alla bildskrapare är inte skapade lika. Här är vad jag tittade efter när jag valde topp 10:

- Användarvänlighet: Kan någon utan kodkunskaper få resultat på några minuter? Stöd för naturligt språk, klicka-och-peka-gränssnitt och omedelbar feedback är stora plus.

- Exportalternativ: Låter verktyget dig ladda ner bilder eller URL:er till Excel, Google Sheets, Notion eller via API? Integration är avgörande för affärsflöden.

- Anpassning och flexibilitet: Kan det hantera inloggningar, dynamiskt innehåll eller egen extraktionslogik? Avancerade användare behöver mer än bara “Spara som”.

- Automatisering och schemaläggning: Kan du ställa in det och glömma bort det? Schemalagda körningar och molnbearbetning är räddare i nöden för återkommande uppgifter.

- Skalbarhet: Klarar det 10 000 bilder? Verktygen måste fungera för både små och massiva jobb.

- Pris och värde: Finns det en gratisnivå? Är kostnaden rimlig för små team eller är den byggd för företagsbudgetar?

Med det i åtanke är här de 10 bästa bildskrapverktygen att överväga 2026 — var och en med sina egna styrkor, egenheter och ideala användningsområden.

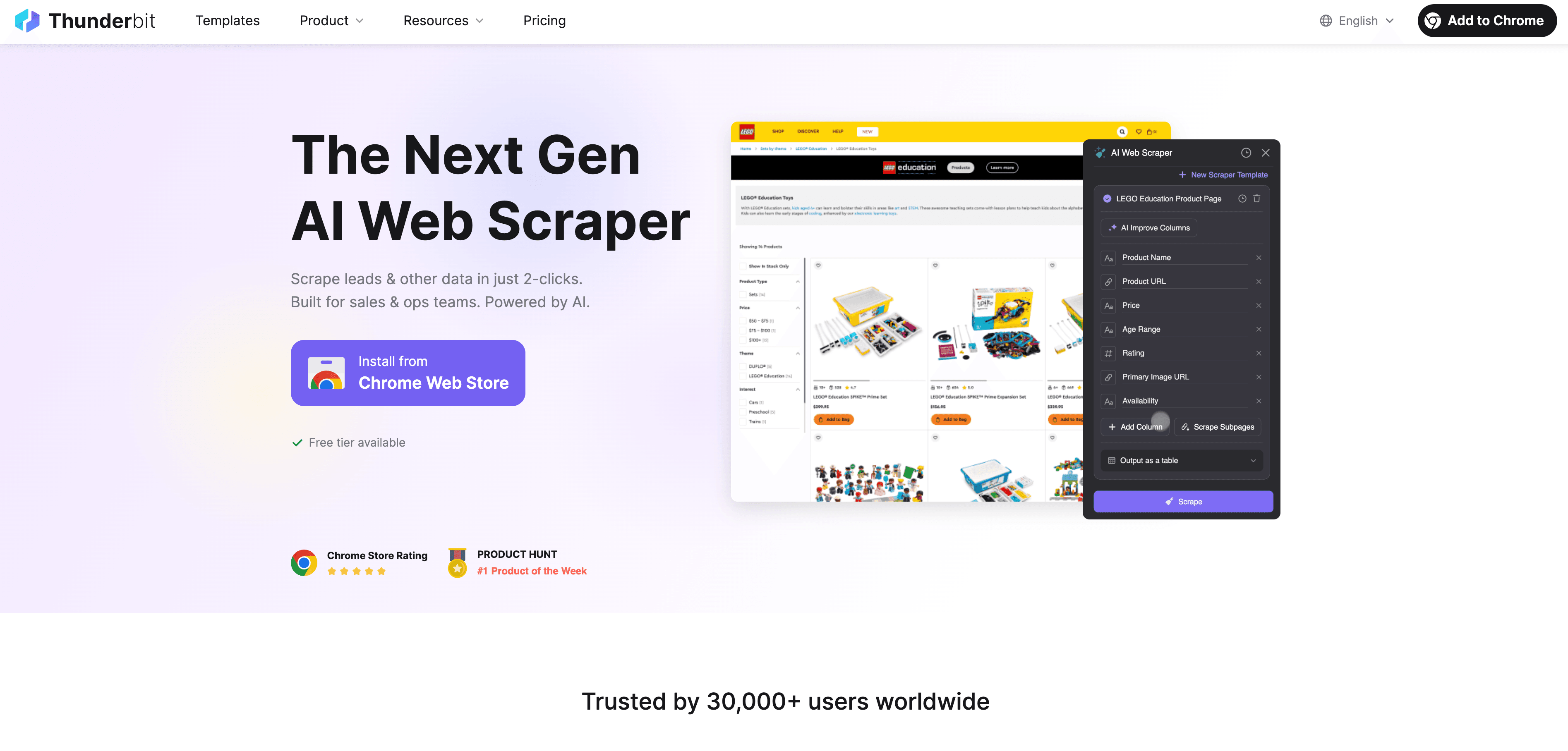

1. Thunderbit

är mitt förstahandsval för icke-tekniska team och alla som vill extrahera bilder med så lite friktion som möjligt. Som medgrundare är jag förstås lite partisk — men vårt uppdrag har alltid varit att göra webbskrapning så enkel att till och med din mormor skulle kunna göra det (förutsatt att hon gillar konkurrensanalys).

Vad gör Thunderbit speciellt? Allt handlar om enkelhet. Klicka bara på “AI föreslår fält”, låt AI:n identifiera alla bilder (och annan data du vill ha), och tryck sedan på “Skrapa”. Thunderbit navigerar automatiskt till undersidor, hanterar oändlig scroll och exporterar bilder direkt till Excel, Google Sheets, Airtable eller Notion. Du kan till och med använda det kostnadsfria för att extrahera varje bild på en sida med ett klick — ingen konfiguration, ingen kod.

Viktiga funktioner:

- Bildextrahering med 2 klick (AI gör det tunga jobbet)

- Skrapning av undersidor (hämta bilder från detaljsidor automatiskt)

- Gratis bild-/e-post-/telefonextraherare

- Omedelbar export till Sheets, Notion, Airtable, Excel, CSV eller JSON

- Gratisnivå (6 sidor, obegränsat antal rader), betalda planer från 15 dollar/månad

- Flerspråkigt stöd (34 språk)

- Inget underhåll — AI anpassar sig till förändringar på webbplatsen

Bäst för: Försäljnings-, marknadsförings- och driftteam som vill ha snabb och korrekt bilddata utan kodning eller installation. Perfekt för att katalogisera konkurrentprodukter, samla bostadsbilder eller bygga innehållsbibliotek.

Om du vill se hur Thunderbit står sig i jämförelse, kolla in vår .

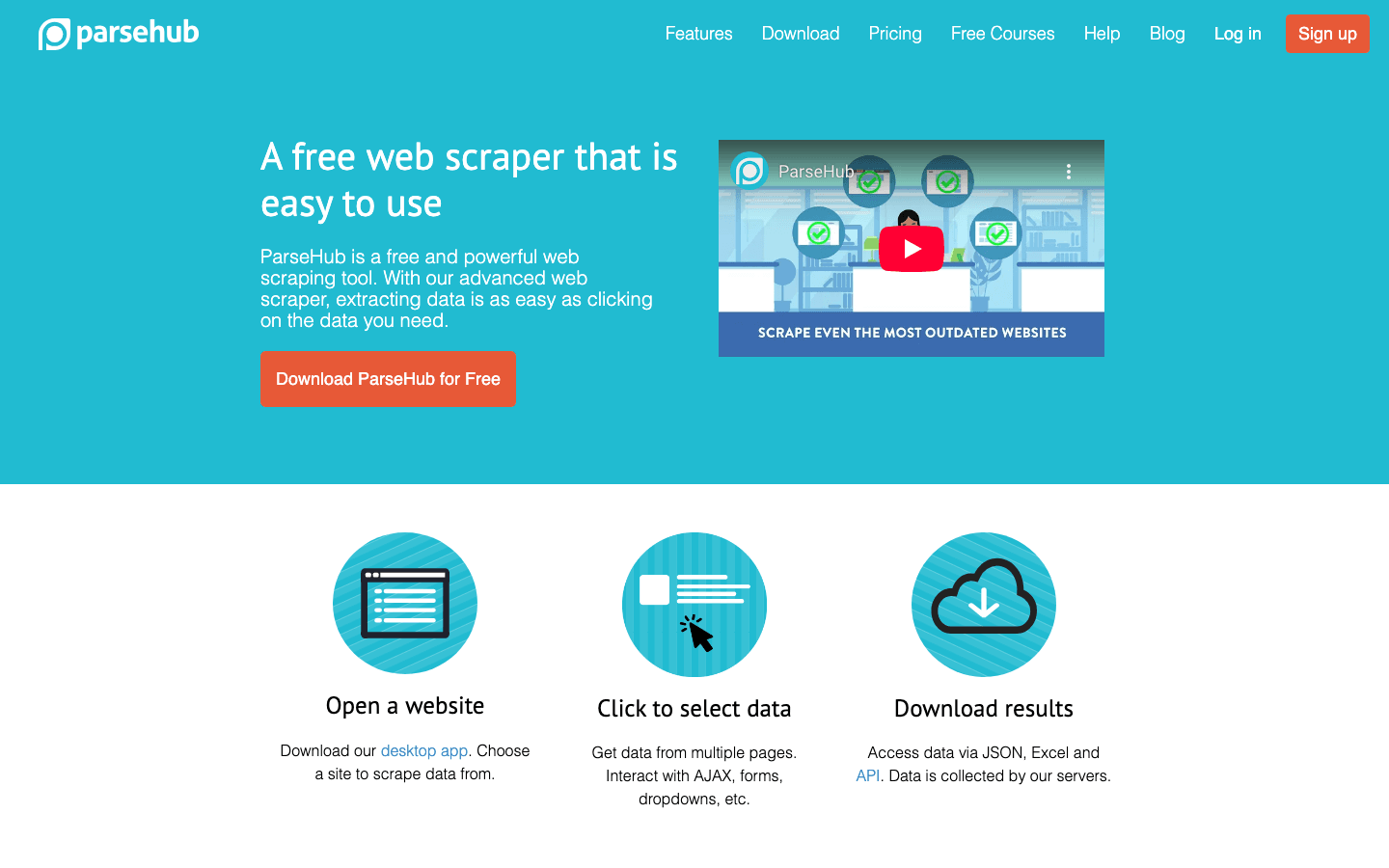

2. ParseHub

är ett kraftpaket för användare som behöver skrapa bilder från komplexa, dynamiska webbplatser — tänk oändlig scroll, AJAX-laddade gallerier eller sajter som kräver att du klickar dig igenom filter och popupfönster.

Därför utmärker sig ParseHub: Den visuella arbetsflödesredigeraren låter dig bygga upp flerstegslig skraplogik utan att skriva kod. Du kan lägga till villkor, loopar och till och med variabler för att hantera knepiga sajter. ParseHub kan interagera med formulär, klicka på knappar och extrahera bilder som bara visas efter vissa åtgärder.

Viktiga funktioner:

- Visuell redigerare med avancerad logik (villkor, loopar)

- Hanterar JavaScript-tunga och dynamiska sidor

- Molnschemaläggning och API-åtkomst

- Automatisk IP-rotation för att undvika blockeringar

- Exporterar till CSV, JSON och integreras med Tableau

Bäst för: Dataanalytiker, journalister eller forskare som skrapar komplexa webbplatser och vill ha fin kontroll utan kodning. Det finns en gratisnivå (upp till 200 sidor per körning), men kraftanvändare kommer att vilja ha planen för 189 dollar/månad för molnfunktioner och större volymer.

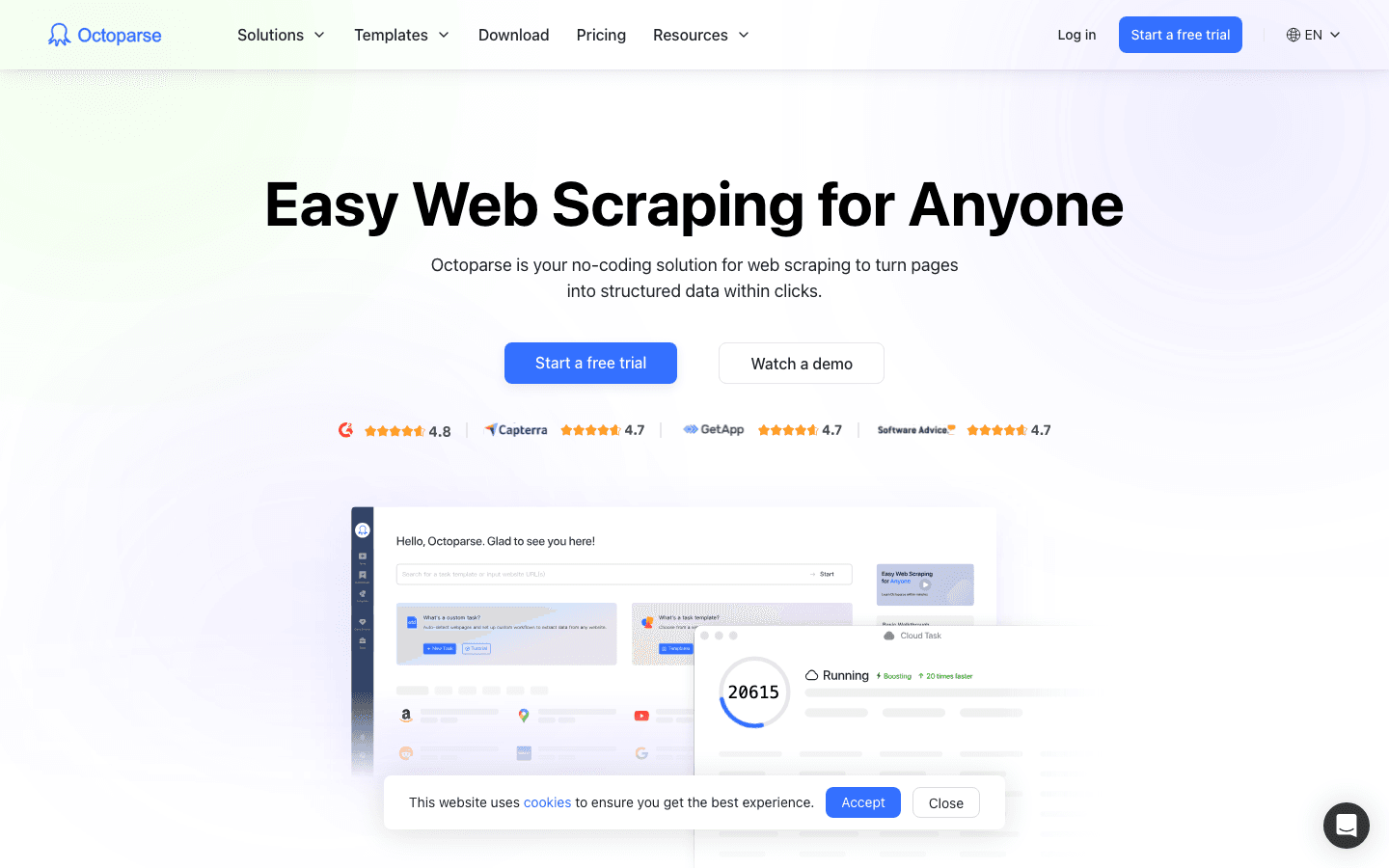

3. Octoparse

är no-code-vinnaren för massextraktion av bilder. Dess kalkylbladsliknande gränssnitt och automatiska igenkänning gör det mycket lätt att komma igång för icke-tekniska användare.

Varför Octoparse är populärt: Klicka bara på en bild eller en lista, så föreslår Octoparse AI vad som ska skrapas. Det är särskilt bra på att hantera sidnumrering, oändlig scroll och sidor som kräver inloggning. Molnbaserad skrapning och schemaläggning finns i betalda planer, så du kan köra stora jobb utan att binda upp din dator.

Viktiga funktioner:

- No-code, klicka-och-peka-installation

- Identifierar automatiskt listor och bilder

- Hanterar sidnumrering, oändlig scroll och inloggningar

- Molnskrapning och schemaläggning

- Exporterar till CSV, Excel, JSON och databaser

Bäst för: Marknadsföringsteam, småföretag eller alla som snabbt behöver extrahera många bilder utan kodning. Gratis plan för mindre jobb; betalda planer från 119 dollar/månad.

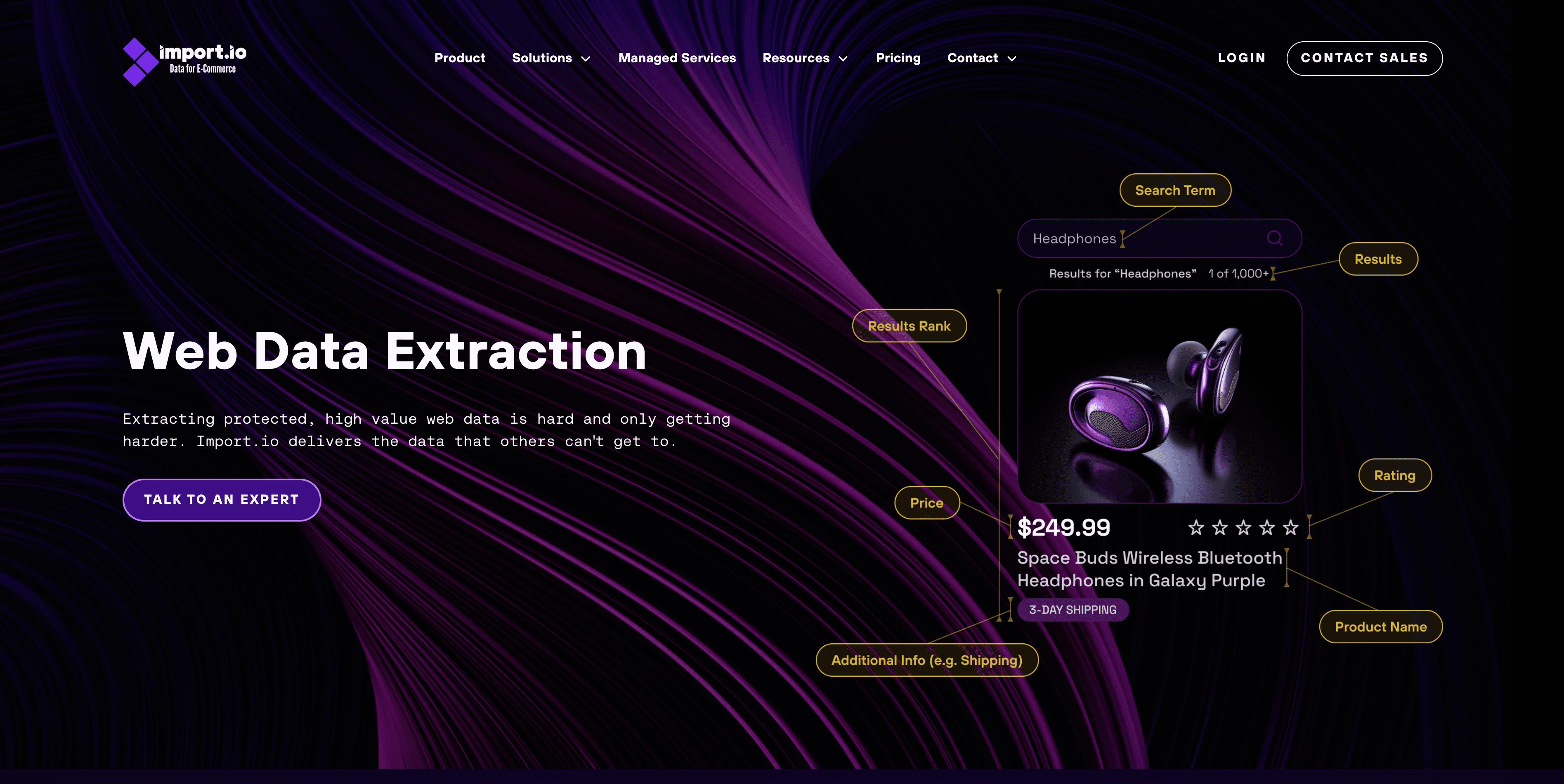

4.

är en företagsanpassad plattform för datainhämtning som också fungerar som en robust bildskrapare. Det interaktiva gränssnittet låter dig spela in arbetsflöden (som att logga in, filtrera och klicka dig igenom gallerier) och sedan köra dem i stor skala i molnet.

Det som skiljer åt: Den är byggd för integration — skrapade bilder och data kan flöda direkt in i analysdashboards, BI-verktyg eller databaser via API:er och webhooks. är också mycket bra på att hantera skyddat eller dynamiskt innehåll.

Viktiga funktioner:

- Interaktiv arbetsflödesinspelare

- Hanterar inloggningar, dynamiskt innehåll och skyddade sidor

- API-/webhook-integration för analysflöden

- Hanterade tjänster för företagskunder

Bäst för: Medelstora till stora företag som behöver tillförlitlig, skalbar bildextraktion som en del av en större datapipeline. Priserna börjar runt 299 dollar/månad, och en gratis provperiod finns.

5. Apify

är en utvecklarvänlig automationsplattform med en marknadsplats för färdiga “Actors” (förbyggda scrapers) och möjligheten att koda egna i Node.js eller Python.

Varför Apify är flexibelt: Du kan hitta en Actor för vanliga sajter (som Instagram eller Amazon) eller bygga en egen scraper för allt annat. Apifys molninfrastruktur hanterar schemaläggning, proxyhantering och skalning — så du kan skrapa tusentals sidor parallellt.

Viktiga funktioner:

- Actor-marknadsplats (förbyggda scrapers för populära sajter)

- Egen kodning i Node.js/Python

- Molnschemaläggning och lagring

- Robust API-integration

Bäst för: Utvecklare, startups eller dataingenjörer som vill ha programmerbar, skalbar skrapning. Gratisnivå för lätt användning; betalda planer från 49 dollar/månad.

6. Mozenda

är en företagslösning med fokus på strukturerad datainhämtning, inklusive bilder, filer och PDF:er. Gränssnittet för klicka-och-peka är lätt att komma igång med, men den verkliga styrkan ligger i automatisering, schemaläggning och teamhantering.

Varför Mozenda är redo för enterprise: Den är byggd för tillförlitlighet — tänk robust schemaläggning, aviseringar och automatisering av arbetsflöden. Mozenda kan slå ihop data från flera källor, exportera i olika format och till och med köras lokalt för känsliga projekt.

Viktiga funktioner:

- Visuell agentbyggare (ingen kodning)

- Hanterar komplexa webbplatser, data på flera nivåer och bilder

- Schemaläggning, aviseringar och arbetsflödesautomatisering

- Teamsamarbete och hanterade tjänster

Bäst för: Stora organisationer eller team med löpande, verksamhetskritiska skrapbehov. Priserna börjar runt 99 dollar/månad, med anpassade företagsalternativ.

7. VisualScraper

är ett lättviktigt, användarvänligt verktyg för snabba bildskrapningsuppgifter. Gränssnittet är avskalat — bara peka, klicka och extrahera.

Varför VisualScraper är praktiskt: Det är perfekt för små jobb eller engångsprojekt. Du kan schemalägga uppgifter, exportera till CSV/JSON/XML och till och med få resultat via e-post eller FTP. Det är inte lika kraftfullt som de stora aktörerna, men för grundläggande behov är det svårt att slå enkelheten (och priset — gratis för de flesta användare).

Viktiga funktioner:

- Enkelt klicka-och-peka-gränssnitt

- Förhandsgranskning av data i realtid

- Schemaläggning och export i flera format

- Gratis Windows-app för mindre jobb

Bäst för: Privatpersoner, entusiaster eller småföretagare som ibland behöver skrapa bilder utan någon större inlärningskurva.

8. WebHarvy

är en Windows-baserad visuell scraper som är känd för sin smarta mönsterigenkänning. Klicka på en bild, så hittar WebHarvy automatiskt alla liknande bilder på sidan och skrapar dem.

Varför WebHarvy är smart: Den kan hantera skrapning i flera nivåer (som att hämta galleribilder från produktsidor), fylla i formulär, klicka på knappar och till och med köra egen JavaScript för knepiga webbplatser. Det är ett engångsköp, så du slipper månadsavgifter.

Viktiga funktioner:

- Intelligent mönsterigenkänning

- Skrapning av bilder i flera nivåer och i gallerier

- Exporterar till Excel, CSV, JSON, SQL

- Engångslicens (ingen prenumeration)

Bäst för: Icke-programmerare som vill ha en kombination av enkelhet och avancerade funktioner, särskilt på Windows. Utmärkt för forskare och småföretag.

9. Diffbot

är AI-hjärnan för webbaserad datautvinning. Mata in en URL (eller en miljon), så identifierar och extraherar dess datorseende och NLP alla huvudbilder — inga regler eller selektorer behövs.

Varför Diffbot är unikt: Det är API-först, extremt skalbart och tåligt mot förändringar på sajter (AI:n anpassar sig automatiskt). Diffbots Knowledge Graph låter dig till och med söka i en webbspecifik databas med bilder och strukturerad data.

Viktiga funktioner:

- AI-driven extraktion (ingen installation krävs)

- Hanterar miljontals sidor via API

- Returnerar bild-URL:er, metadata och taggar

- Knowledge Graph för sökningar över hela webben

Bäst för: Företag, AI-bolag eller dataleverantörer som behöver enorma, underhållsfria bilddatamängder. Gratis för 10 000 API-anrop/månad; betalda planer från 299 dollar/månad. Kräver en del kodning för att användas.

10. Scrapy

är det öppna Python-ramverket för anpassad webbskrapning. Om du är utvecklare ger Scrapy dig full kontroll — skriv spiders för att crawla vilken webbplats som helst, extrahera bilder och bearbeta dem precis som du vill.

Varför Scrapy är kraftfullt: Den inbyggda Images Pipeline automatiserar nedladdning av bilder, skapar miniatyrbilder och filtrerar efter storlek eller format. Scrapy är snabbt, skalbart och har ett enormt ekosystem av tillägg för proxyservrar, molncrawling och mycket mer.

Viktiga funktioner:

- Kod först, maximal flexibilitet

- Asynkront och snabbt crawlingsystem

- Inbyggd bildnedladdning och bildbearbetning

- Gratis och öppen källkod

Bäst för: Utvecklare och tekniska team med anpassade eller storskaliga skrapbehov. Den enda kostnaden är din tid och serverresurser.

Jämförelsetabell för bildskrapverktyg

| Verktyg | Användarvänlighet | Exportformat | Automatisering/schemaläggning | Bäst för | Pris (cirka) |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Excel, Sheets, Notion | Ja | Icke-tekniska team, små och medelstora företag | Gratis, 15 dollar/månad+ |

| ParseHub | ★★★★☆ | CSV, JSON, Tableau | Ja (moln) | Analytiker, komplexa webbplatser | Gratis, 189 dollar/månad+ |

| Octoparse | ★★★★☆ | CSV, Excel, JSON | Ja (moln) | Användare utan kod, massextraktion | Gratis, 119 dollar/månad+ |

| Import.io | ★★★★☆ | API, CSV, databas | Ja (moln) | Enterprise, BI-integration | 299 dollar/månad+ |

| Apify | ★★★☆☆ | JSON, CSV, API | Ja (moln) | Utvecklare, skalbara projekt | Gratis, 49 dollar/månad+ |

| Mozenda | ★★★★☆ | CSV, Excel, API, databas | Ja | Enterprise, teamarbetsflöden | 99 dollar/månad+ |

| VisualScraper | ★★★★☆ | CSV, JSON, XML, e-post | Ja | Privatpersoner, små projekt | Gratis, 49 dollar/månad+ (moln) |

| WebHarvy | ★★★★☆ | Excel, CSV, JSON, SQL | Ja | Användare utan kod, Windows-användare | 99 dollar engångs |

| Diffbot | ★★★☆☆ | API (JSON, metadata) | Ja (API) | Enterprise, AI, utvecklare | Gratis, 299 dollar/månad+ |

| Scrapy | ★★★☆☆ | Valfritt (egen kod) | Ja (anpassat) | Utvecklare, anpassade pipelineflöden | Gratis |

Så väljer du rätt bildskrapare för ditt företag

Här är min snabba beslutsguide:

- Inte teknisk och vill ha snabbhet och enkelhet? Börja med eller .

- Behöver du skrapa komplexa, dynamiska webbplatser? Testa eller .

- Enterprise, behöver integration och support? Titta på , eller .

- Utvecklare, vill du ha full kontroll? eller är dina bästa alternativ.

- Behöver du bara ett snabbt, gratis verktyg för små jobb? är ett stabilt val.

Utnyttja alltid gratis provperioder eller gratisnivåer — kör en liten testskrapning på din målsajt för att se vilket verktyg som passar ditt arbetsflöde och dina databehov.

Slutsats: Hitta din idealiska bildskrapare för 2026

Webbens visuella guldgruva väntar bara på att bli utnyttjad — om du har rätt bildskrapare. Oavsett om du bygger en produktkatalog, följer konkurrenter eller driver nästa virala kampanj kan de här verktygen spara dig timmar (och en hel del huvudvärk). Mitt råd? Börja med ditt verkliga användningsfall, matcha det med det verktyg som passar dina kunskaper och din budget, och var inte rädd för att experimentera.

Och om du vill se hur enkelt bildutvinning faktiskt kan vara, och prova själv. Ditt Ctrl+S-finger kommer att tacka dig.

För fler fördjupningar om skrapning, kolla in .

Vanliga frågor

1. Vad är ett bildskrapverktyg och hur fungerar det?

Ett bildskrapverktyg automatiserar processen att extrahera bilder (eller deras URL:er) från webbplatser. De flesta verktyg låter dig ange vad som ska skrapas (via AI, klicka-och-peka eller kod), och samlar sedan in och exporterar bilderna i bulk — vilket sparar timmar av manuellt arbete.

2. Kan jag använda bildskrapverktyg utan kodkunskaper?

Absolut. Verktyg som , och är byggda för användare utan teknisk bakgrund, med styrning i naturligt språk eller visuella gränssnitt.

3. Vad är skillnaden mellan gratis och betalda bildskrapverktyg?

Gratisverktyg är utmärkta för små, sporadiska jobb men kan ha begränsningar i volym, funktioner eller support. Betalda verktyg erbjuder mer automatisering, molnbearbetning och avancerade funktioner — perfekt för företags- eller enterprise-behov.

4. Hur exporterar jag bilder till Excel, Google Sheets eller Notion?

De flesta moderna scrapers (som ) låter dig exportera resultat direkt till Excel, Sheets, Notion eller Airtable med ett klick. Andra erbjuder nedladdning som CSV/JSON eller API-integration för anpassade arbetsflöden.

5. Är det lagligt att skrapa bilder från vilken webbplats som helst?

Du bör alltid respektera en webbplats användarvillkor och upphovsrättslagar. Skrapa endast bilder som är publikt tillgängliga och undvik att använda skrapat innehåll kommersiellt utan tillstånd. Om du är osäker, rådgör med jurist eller använd bilderna endast för intern analys.

Redo att göra bildutvinning till den enklaste delen av ditt arbetsflöde? Testa några verktyg från den här listan och se vilket som passar dig bäst — ditt nästa stora projekt kan vara bara en skrapning bort.

Läs mer: