Jag kan säga så här: få saker i den digitala vardagen är lika märkligt tillfredsställande som att se en prydlig, komplett lista över varenda sida på en webbplats—lite som när du äntligen hittar alla strumpor efter tvätten. Men om du någon gång har försökt hämta webbplatssidor för en innehållsgranskning, en migrering eller bara för att se vad som egentligen gömmer sig i den digitala källaren, då vet du att det sällan är så enkelt som det låter. Jag har sett team lägga timmar (ibland dagar) på att pussla ihop listor från sitemaps, Google-sökningar och CMS-exporter—för att sedan inse att de ändå missar dolda eller dynamiska sidor. Och låt mig inte ens börja om gången jag försökte hjälpa en vän att exportera alla sina WordPress-URL:er—det slutade med mycket kaffe och en gnutta existentiell ångest.

Den goda nyheten? Du behöver inte fortsätta leka digital kurragömma med din egen webbplats. I den här guiden går jag igenom de viktigaste sätten att hitta webbplats-URL:er—både klassiska och moderna—och visar hur AI-drivna verktyg som kan göra processen mycket snabbare, mer heltäckande och (vågar jag säga) faktiskt rätt trevlig. Oavsett om du är marknadsförare, utvecklare eller den otursförföljda personen som fått uppgiften att “ta fram alla URL:er”, får du konkreta steg, verkliga exempel och ärliga jämförelser som hjälper dig att välja bästa metod för ditt team.

Varför du kan behöva hämta webbplatssidor: verkliga användningsfall

Innan vi går in på hur, låt oss snacka om varför. Varför behöver så många team hitta webbplats-URL:er? Det visar sig att det inte bara handlar om SEO—det här är ett återkommande behov för marknad, sälj, IT och drift. Här är några av de vanligaste scenarierna:

- SEO-innehållsgranskningar & strategi: Innehållsgranskningar är numera standard, och . En komplett URL-lista är grunden för att utvärdera resultat, uppdatera äldre innehåll och förbättra ranking. Faktum är att .

- Webbplatsomdesign & migreringar: ), och varje migrering kräver att man mappar befintliga URL:er för att undvika trasiga länkar och tappad SEO.

- Efterlevnad och underhåll: Driftteam behöver hitta föräldralösa eller inaktuella sidor—ibland gamla kampanj-mikrosajter som fortfarande ligger uppe och bara väntar på att genera någon.

- Konkurrentanalys: Sälj- och marknadsteam skrapar konkurrenters sajter för att lista produktsidor, priser eller blogginlägg och leta efter luckor eller leads.

- Leadgenerering & outreach: Säljteam behöver ofta sammanställa listor över butikssökare, återförsäljarkataloger eller medlemssidor för outreach.

- Innehållsinventering: Innehållsmarknadsförare håller en löpande lista över alla blogginlägg, landningssidor, PDF:er m.m. för att undvika duplicering och maximera värdet.

Här är en snabb tabell som sammanfattar scenarierna:

| Scenario | Vem behöver det | Varför en komplett sidlista spelar roll |

|---|---|---|

| SEO-granskning / Innehållsgranskning | SEO-specialister, innehållsmarknadsförare | Utvärdera allt innehåll; missade sidor = ofullständig analys och missade optimeringsmöjligheter |

| Webbplatsmigrering/omdesign | Webbutvecklare, SEO, IT, Marknad | Mappa gamla till nya URL:er, sätt upp omdirigeringar, undvik trasiga länkar och SEO-tapp |

| Konkurrentanalys | Marknad, Sälj | Se alla konkurrentens sidor för insikter; dolda sidor kan avslöja möjligheter |

| Leadgenerering | Säljteam | Samla kontakt-/resurssidor för outreach; säkerställer att inga potentiella leads missas |

| Innehållsinventering | Innehållsmarknad | Håll ett uppdaterat arkiv, hitta luckor, undvik duplicering och granska äldre sidor |

Och konsekvensen av att missa dolda sidor? Den känns direkt. Tänk dig att planera en omdesign och glömma en dold landningssida som fortfarande konverterar, eller att göra en granskning och missa 5% av sidorna för att de inte är indexerade. Det kan betyda tappade intäkter, SEO-strul och ibland en PR-smäll du inte såg komma.

Vanliga sätt att hitta webbplats-URL:er: traditionella metoder förklarade

Okej, ner i det praktiska: hur brukar man faktiskt hämta webbplatssidor? Det finns några beprövade metoder—vissa är snabba och “good enough”, andra mer noggranna (och ibland mer plågsamma). Så här står de sig:

Google-sökning och sökoperatorer

Så fungerar det:

Öppna Google och skriv site:dinwebbplats.se. Google visar då de sidor som är indexerade för domänen. Du kan vässa sökningen med nyckelord eller undermappar (t.ex. site:dinwebbplats.se/blogg).

Det du får:

En lista över indexerade sidor—i praktiken det Google känner till om din sajt.

Begränsningar:

- Visar bara det som är indexerat, inte allt som faktiskt finns

- Brukar ta stopp efter några hundra resultat, även för stora sajter

- Missar nya, dolda eller avsiktligt oindexerade sidor

När det passar:

Bra för en snabb överblick eller små sajter, men inte för en heltäckande granskning.

Kolla robots.txt och sitemap.xml

Så fungerar det:

Gå till dinwebbplats.se/robots.txt och leta efter rader som börjar med “Sitemap:”. Öppna sitemapen (ofta dinwebbplats.se/sitemap.xml eller /sitemap_index.xml). Sitemaps listar URL:er som webbplatsägaren vill att sökmotorer ska indexera.

Det du får:

En lista över viktiga sidor—ofta alla blogginlägg, produktsidor osv. .

Begränsningar:

- Sitemaps innehåller bara sidor som ägaren vill indexera—dolda eller föräldralösa sidor saknas ofta

- Sitemaps kan vara inaktuella om de inte genereras om

- Vissa sajter har flera sitemaps; du kan behöva leta upp dem

När det passar:

Perfekt om du äger sajten eller vill få en snabb bild av en konkurrents huvudsidor. Men kom ihåg: du ser det webbplatsägaren vill att du ska se.

SEO-spindlar och webbplatscrawlers

Så fungerar det:

Verktyg som Screaming Frog, Sitebulb eller DeepCrawl simulerar en sökmotor-crawler. Du anger webbplatsens URL och verktyget följer interna länkar för att bygga en lista över hittade sidor.

Det du får:

Potentiellt alla sidor som är länkade på sajten, plus data som statuskoder och metataggar.

Begränsningar:

- Föräldralösa sidor (som inte är länkade någonstans) missas om du inte matar in dem manuellt

- Dynamiska eller JavaScript-genererade sidor kan missas om verktyget inte stödjer headless-browsing

- Att crawla stora sajter kan ta lång tid och sluka datorns minne

- Kräver teknisk konfiguration och kunskap

När det passar:

Utmärkt för SEO-proffs eller utvecklare som gör djupa granskningar. Mindre vänligt för icke-tekniska användare.

Google Search Console och Analytics

Så fungerar det:

Om du har åtkomst kan Google Search Console (GSC) och Analytics exportera URL-listor.

- GSC: Rapporter för indexering och prestanda visar indexerade och exkluderade URL:er (upp till 1 000 per export, mer via API).

- Analytics: Visar alla sidor som fått trafik under en vald period (GA4 tillåter upp till 100 000 rader per export).

Begränsningar:

- GSC och Analytics visar bara sidor som Google känner till eller som fått trafik

- Exportbegränsningar (1 000 rader för GSC, 100k för GA4)

- Kräver ägarskap/verifiering; går inte att använda för konkurrentresearch

- Sidor med noll trafik eller som inte är indexerade syns inte

När det passar:

Toppen för din egen sajt, särskilt inför migrering eller granskning. Inte lämpligt för konkurrentanalys.

CMS-adminpaneler

Så fungerar det:

Om din sajt kör WordPress, Shopify eller ett annat CMS kan du ofta exportera en lista över sidor och inlägg direkt från adminpanelen (ibland via ett plugin).

Det du får:

En lista över alla innehållsposter—sidor, inlägg, produkter osv.

Begränsningar:

- Kräver adminåtkomst

- Kan missa icke-innehållssidor eller dynamiska sidor

- Om sajten använder flera system (blogg, shop, dokumentation) behöver du slå ihop flera exporter

När det passar:

Bäst för webbplatsägare som gör innehållsinventering eller backup. Inte hjälpsamt för konkurrentresearch.

Begränsningarna med traditionella metoder för att hämta webbplatssidor

Om vi ska vara helt raka: ingen av metoderna är felfri. Här är de vanligaste luckorna:

- Teknisk komplexitet: Många metoder kräver tekniska färdigheter eller specialverktyg. För icke-tekniska teammedlemmar kan det bli en rejäl tröskel. En manuell innehållsgranskning kan ta .

- Ofullständig täckning: Varje metod kan missa vissa sidor—Googles index missar oindexerade eller nya sidor, sitemaps missar föräldralösa sidor, crawlers missar olänkade eller dynamiska sidor, CMS-exporter missar allt utanför systemet.

- Manuellt arbete och tid: Ofta måste du kombinera data från flera källor, avduplicera och städa—trist och lätt att göra fel. Folk delar till och med “hacks” som att kopiera från sitemaps till Excel eller köra kommandoradsskript.

- Underhåll och aktualitet: Listor blir snabbt inaktuella. Traditionella metoder kräver att du kör om processen varje gång sajten ändras.

- Åtkomst och behörigheter: Vissa metoder kräver adminåtkomst eller ägarskap—inte toppen för konkurrentresearch.

- Databrus: SEO-spindlar kan dränka dig i tekniska detaljer när du egentligen bara vill ha en enkel URL-lista.

Kort sagt: den traditionella processen är som att “försöka baka en kaka medan receptet hela tiden ändras och ugnen ibland låser dig ute.” (Ja, det är en riktig liknelse från en content strategist—och jag fattar exakt.)

Möt Thunderbit: det AI-drivna sättet att hitta webbplats-URL:er

Nu till den roliga biten. Tänk om du bara kunde säga till en assistent: “Gå igenom den där webbplatsen och lista alla sidor åt mig,” och den faktiskt gjorde det—utan kod och utan strul? Det är precis vad går ut på.

Thunderbit är ett AI Web Scraper-tillägg för Chrome, byggt för icke-tekniska användare (men fortfarande tillräckligt vasst för proffs). Med AI kan det “läsa” webbplatser, strukturera data och exportera alla webbplats-URL:er—inklusive dolda, dynamiska och undersidor. Du behöver varken skriva kod eller pilla med krångliga inställningar. Öppna bara sajten, klicka på “AI Suggest Fields” och låt Thunderbit göra grovjobbet.

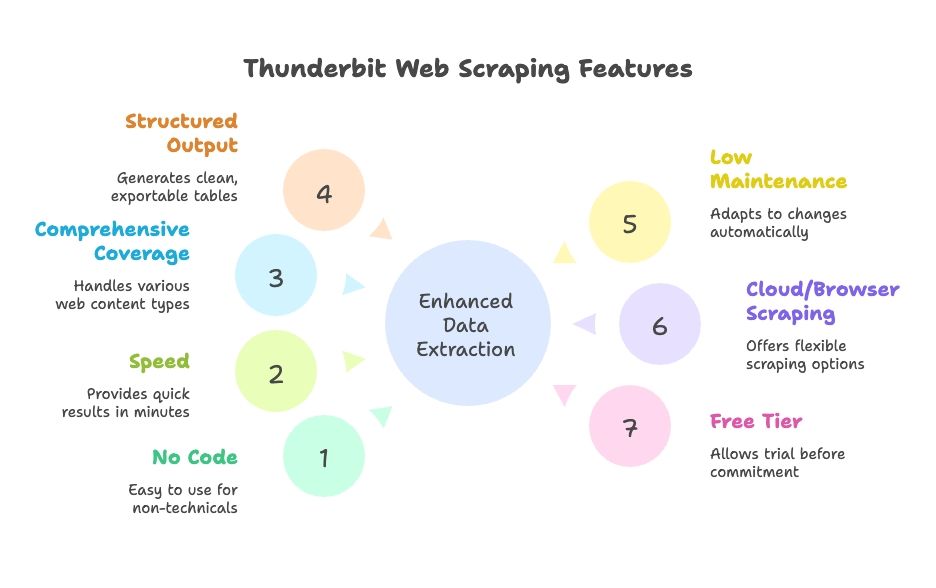

Därför sticker Thunderbit ut:

- Ingen kod och ingen uppsättning: Naturligt språk-gränssnitt, styrt av AI. Alla i teamet kan använda det.

- Hastighet: Resultat på minuter, inte timmar.

- Heltäckande: Klarar dynamiskt innehåll, paginering, infinite scroll och undersidor.

- Strukturerad output: Rena tabeller som är redo att exporteras till Google Sheets, Excel, Airtable, Notion, CSV eller JSON.

- Lågt underhåll: AI anpassar sig automatiskt när sajten ändras; mindre finjustering.

- Moln- eller webbläsarskrapning: Välj det som passar ditt arbetssätt.

- Gratisnivå finns: Testa innan du bestämmer dig.

Så gör Thunderbit det enkelt att hämta webbplatssidor

Låt oss gå igenom hur Thunderbit funkar i praktiken. Jag visar hur du går från “jag behöver en lista över alla sidor på vår webbplats” till “här är ett kalkylark, chef” på bara några klick.

Steg 1: Installera och starta Thunderbit

Ladda ner och fäst den i webbläsaren. Gå till webbplatsen du vill skrapa (t.ex. startsidan) och klicka på Thunderbit-ikonen för att öppna gränssnittet.

Proffstips: Thunderbit ger gratis krediter till nya användare, så du kan provköra utan att ta fram kortet.

Steg 2: Välj datakälla

Thunderbit skrapar som standard den aktuella sidan, men du kan också mata in en lista med URL:er (t.ex. från en sitemap eller kategorisidor) om du vill börja i en specifik del.

- För de flesta sajter: börja med startsidan eller en sitemap.

- För e-handel: börja kanske med en kategori- eller produktlistningssida.

Steg 3: Använd “AI Suggest Fields” för att hitta URL:er

Här händer AI-magin. Klicka på “AI Suggest Fields” (eller “AI Suggest Columns”). Thunderbits AI skannar sidan, känner igen mönster och föreslår kolumner som “Sidtitel” och “Sid-URL” för alla länkar den hittar. Du kan justera kolumnerna efter behov.

- På en startsida kan du få länkar från navigation, sidfot och utvalda sektioner.

- På en sitemap får du en ren URL-lista.

- Du kan lägga till/ta bort kolumner eller förfina vad du vill extrahera.

Thunderbits AI gör det tunga jobbet—du behöver inte skriva XPaths eller CSS-selektorer. Det är som att ha en robotpraktikant som faktiskt fattar vad du menar.

Steg 4: Aktivera skrapning av undersidor

De flesta sajter listar inte alla sidor på startsidan. Där kommer Thunderbits Subpage Scraping in. Markera URL-kolumnen som en “follow”-länk, så klickar Thunderbit vidare på varje länk den hittar och skrapar fler URL:er från de sidorna. Du kan till och med sätta upp nästlade mallar för skrapning i flera nivåer.

- För paginerade listor eller “ladda fler”-knappar: aktivera Pagination & Scrolling så fortsätter Thunderbit tills allt är hittat.

- För sajter med subdomäner eller sektioner (som en blogg på ): Thunderbit kan följa dem också om du styr den dit.

Steg 5: Kör skrapningen

Klicka på “Scrape” och se Thunderbit jobba. Den fyller en tabell med URL:er (och andra fält du valt) i realtid. För större sajter kan du låta den köra i bakgrunden och komma tillbaka när den är klar.

Steg 6: Granska och exportera

När den är klar granskar du resultatet—Thunderbit låter dig sortera, filtrera och ta bort dubbletter direkt i appen. Exportera sedan med ett klick till Google Sheets, Excel, CSV, Airtable, Notion eller JSON. Inget mer copy-paste eller bråk med formatering.

Hela processen? För en liten till medelstor sajt kan du gå från noll till en komplett URL-lista på under 10 minuter. För större sajter är det fortfarande dramatiskt snabbare (och mindre stressigt) än att pussla ihop data från flera källor.

Hitta dolda och dynamiska sidor med Thunderbit

En av mina favoritgrejer i Thunderbit är hur den hanterar sidor som traditionella verktyg ofta missar:

- JavaScript-renderat innehåll: Eftersom Thunderbit kör i en riktig webbläsare kan den fånga sidor som laddas dynamiskt (som jobbportaler med infinite scroll eller produktlistor).

- Föräldralösa/olänkade sidor: Om du har en ledtråd (som en sitemap eller en intern sökfunktion) kan Thunderbit använda den för att hitta sidor som inte länkas någon annanstans.

- Subdomäner eller sektioner: Thunderbit kan följa länkar över subdomäner vid behov och ge en komplett bild av sajten.

- Interaktion som en användare: Behöver du fylla i ett sökfält eller klicka i ett filter för att visa dolda sidor? Thunderbits AI Autofill klarar det också.

Exempel från verkligheten: Ett marknadsteam behövde hitta alla sina gamla landningssidor—många var inte länkade någonstans men fanns kvar. Genom att skrapa Googles sökresultat med Thunderbit och mata in kända URL-mönster hittade de dussintals bortglömda sidor och sparade företaget från förvirring (och en del huvudvärk).

Thunderbit jämfört med traditionella metoder: hastighet, enkelhet och täckning

Låt oss ställa Thunderbit mot de klassiska metoderna:

| Aspekt | Google “site:”-sökning | XML-sitemap | SEO-crawler (Screaming Frog) | Google Search Console | CMS-export | Thunderbit AI Scraper |

|---|---|---|---|---|---|---|

| Hastighet | Väldigt snabb, men begränsad | Omedelbar om den finns | Varierar (minuter till timmar) | Snabb för små sajter | Omedelbar för små sajter | Snabbt—konfig på minuter, automatiserad skrapning |

| Användarvänlighet | Mycket enkel | Enkel | Medel (kräver uppsättning) | Medel | Enkel (om admin) | Mycket enkel, ingen kod |

| Täckning | Låg (bara indexerat) | Hög för avsedda sidor | Hög för länkade sidor | Hög för indexerat, men exportbegränsad | Medel (bara innehåll) | Mycket hög—klarar dynamiskt innehåll & undersidor |

| Output & integration | Manuell kopiera-klistra | XML (kräver tolkning) | CSV med mycket extradata | CSV/Excel, upp till 1 000 rader | CSV/XML, kan behöva städas | Ren tabell, 1-klicksexport till Sheets, Excel m.m. |

| Underhåll | Manuell omkörning | Kräver uppdatering | Crawla om när sajten ändras | Periodisk export | Export efter ändringar | Lågt—AI anpassar sig, kan schemalägga skrapning |

Thunderbit är som starkast när det gäller användarvänlighet, fullständighet och integration. Traditionella metoder har var och en sina styrkor, men kräver mer jobb för att kombinera resultat och hålla dem uppdaterade. Thunderbits AI anpassar sig när sajten förändras, så du slipper sitta och justera inställningar eller göra manuella exporter hela tiden.

Välj rätt angreppssätt: vem bör använda vilken metod?

Så, vad passar dig bäst? Här är min bedömning, baserad på år av att hjälpa team få ordning på webbplatsdata:

- SEO-proffs / utvecklare: Om du behöver djup teknisk data (metataggar, trasiga länkar osv.) eller granskar en enorm enterprise-sajt kan en crawler eller ett eget skript fortfarande vara rätt. Men även då kan Thunderbit snabbt ge dig en URL-lista att mata in i andra verktyg.

- Marknadsförare, innehållsstrateger, projektledare: Thunderbit är en räddare i nöden. Slipp vänta på att IT ska köra skript eller slå ihop exporter. För innehållsinventering, konkurrentanalys eller snabb audit kan du göra jobbet själv.

- Säljteam / lead gen: Thunderbit gör det enkelt att hämta listor över butiker, eventsidor eller medlemsregister från vilken sajt som helst—utan kod.

- Små webbplatser / snabba uppgifter: För pyttesajter kan en manuell koll eller sitemap räcka. Men Thunderbit går så snabbt att sätta upp att det ofta är värt det ändå för att inte missa något.

- Budget: Traditionella metoder är billiga (förutom din tid). Thunderbit har en gratisnivå och betalplaner som brukar vara rimliga för de flesta företag. Kom ihåg: din tid är värdefull.

- Mycket specialanpassade databehov: Om du behöver extremt specifik data eller komplex logik kan egen kod vara nödvändig. Men Thunderbits AI klarar de flesta use cases med minimal uppsättning.

Tips för beslut:

- Om du äger sajten och har under 1 000 sidor: testa export från Google Search Console—men dubbelkolla att den är komplett.

- Om du saknar åtkomst eller behöver konkurrentdata: Thunderbit eller en crawler är din vän.

- Om du värderar tid och vill ha en lösning som skalar: Thunderbit är svårslaget.

- För samarbete i team: direkt export till Google Sheets är ett stort plus.

Många organisationer kör en hybrid: Thunderbit för snabba uppgifter och för att ge icke-tekniska team möjlighet att jobba själva, och traditionella verktyg för djupare granskningar.

Viktigaste slutsatserna: hämta webbplatssidor för alla affärsbehov

Vi rundar av:

- En komplett lista över webbplatsens sidor är avgörande för SEO, innehållsstrategi, migreringar och säljarbete. Den minskar risken för överraskningar, trasiga länkar och missade möjligheter. De flesta marknadsförare gör numera innehållsgranskningar minst årligen ().

- Traditionella metoder finns, men alla har luckor. Ingen enskild metod garanterar en komplett och uppdaterad lista. Ofta krävs teknisk kompetens och att man kombinerar flera källor.

- AI-driven skrapning (Thunderbit) är en modern lösning. Thunderbit använder AI för att göra “tänket” och klickandet, så att webbskrapning blir tillgängligt för alla. Den hanterar dynamiskt innehåll, undersidor och exporterar data i ett format som går att använda direkt—vilket sparar tid och minskar fel. I direkta jämförelser klarar Thunderbit ofta på minuter det som tidigare tog timmar, med minimal inlärningskurva ().

- Matcha metod efter behov och team. För jättesajter kan du behöva hela verktygslådan, men för de flesta affärsanvändare räcker Thunderbit långt.

- Håll listan uppdaterad. Regelbundna granskningar gör att du hittar problem tidigt och håller webbplatsen slimmad och effektiv. Thunderbits schemaläggning gör detta realistiskt, medan manuella processer ofta prioriteras bort eftersom de tar för mycket tid.

Sista tanke: Inga fler ursäkter för att inte veta vad som finns på din egen webbplats (eller konkurrentens). Med rätt metod kan du få en heltäckande lista över alla sidor och använda den kunskapen för att förbättra SEO, användarupplevelse och affärsstrategi. Jobba smartare, inte hårdare—låt AI göra grovjobbet och se till att ingen sida faller mellan stolarna.

Nästa steg

Om du vill sluta våndas över uppgiften “ge mig alla URL:er”, och testa på din egen sajt eller en konkurrents. Du kommer att bli förvånad över hur mycket tid (och sinnesro) du sparar. Vill du fördjupa dig i webbskrapning kan du även läsa fler guider på , som eller .

Vanliga frågor (FAQ)

1. Varför skulle jag behöva en lista över alla sidor på en webbplats?

Team inom SEO, marknad, sälj och IT behöver ofta kompletta URL-listor för uppgifter som innehållsgranskningar, webbplatsmigreringar, leadgenerering och konkurrentanalys. En fullständig och korrekt lista hjälper dig att undvika trasiga länkar, säkerställer att innehåll inte dupliceras eller glöms bort och kan synliggöra dolda möjligheter.

2. Vilka är de traditionella sätten att hitta alla webbplats-URL:er?

Vanliga metoder är att använda Googles site:-sökning, kontrollera sitemap.xml och robots.txt, crawla med SEO-verktyg som Screaming Frog, exportera data från CMS-plattformar som WordPress samt hämta indexerade-/trafik-sidor från Google Search Console och Analytics. Men varje metod har begränsningar i täckning och användbarhet.

3. Vilka begränsningar har traditionella metoder för att hitta URL:er?

Traditionella metoder missar ofta dynamiska, föräldralösa eller oindexerade sidor. De kan kräva teknisk kunskap, ta timmar att kombinera och rensa, och skalar ofta dåligt för stora sajter eller återkommande granskningar. Du kan också behöva ägarskap eller adminåtkomst, vilket inte alltid är möjligt.

4. Hur förenklar Thunderbit processen att hitta alla sidor på en webbplats?

Thunderbit är en AI Web Scraper som skannar webbplatser ungefär som en människa—klickar vidare till undersidor, hanterar JavaScript och strukturerar data automatiskt. Den kräver ingen kod, fungerar via ett Chrome-tillägg och kan exportera rena URL-listor till Google Sheets, Excel, CSV med mera på bara några minuter.

5. Vem bör använda Thunderbit jämfört med traditionella verktyg?

Thunderbit passar bäst för marknadsförare, innehållsstrateger, säljteam och icke-tekniska användare som vill ha snabba och kompletta URL-listor utan krångel. Traditionella verktyg är bättre för tekniska granskningar som kräver djup metadata eller egen scripting. Många team använder båda—Thunderbit för snabbhet och enkelhet, och traditionella verktyg för djupanalys.